大模型的數(shù)學(xué)能力或許一直都在關(guān)鍵在于如何喚醒它

在追求人工智能極限的道路上,"更大即更強(qiáng)" 似乎已成為共識(shí)。特別是在數(shù)學(xué)推理這一被視為 AI 終極挑....

TeleAI提出COPO對(duì)齊方法:8B模型超越Llama3-70B的表現(xiàn)

在自然界中,好奇心驅(qū)使著生物探索未知,是生存和進(jìn)化的關(guān)鍵。人類,作為地球上最具智能的物種,其探索精神....

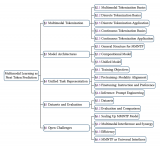

2025年Next Token Prediction范式會(huì)統(tǒng)一多模態(tài)嗎

訓(xùn)練方法與推理策略 性能評(píng)測(cè)體系 現(xiàn)存挑戰(zhàn)與未來(lái)方向 綜述的完整目錄如下: 多模態(tài)的 Tokeniz....

大連理工提出基于Wasserstein距離(WD)的知識(shí)蒸餾方法

自 Hinton 等人的開(kāi)創(chuàng)性工作以來(lái),基于 Kullback-Leibler 散度(KL-Div)....

探索對(duì)抗訓(xùn)練的概率分布偏差:DPA雙概率對(duì)齊的通用域自適的目標(biāo)檢測(cè)方法

? 論文標(biāo)題:Universal Domain Adaptive Object Detection ....

SparseViT:以非語(yǔ)義為中心、參數(shù)高效的稀疏化視覺(jué)Transformer

? 背景簡(jiǎn)介 隨著圖像編輯工具和圖像生成技術(shù)的快速發(fā)展,圖像處理變得非常方便。然而圖像在經(jīng)過(guò)處理后不....

基于移動(dòng)自回歸的時(shí)序擴(kuò)散預(yù)測(cè)模型

在人工智能領(lǐng)域,目前有很多工作采用自回歸方法來(lái)模擬或是替代擴(kuò)散模型,其中視覺(jué)自回歸建模(Visual....

港大提出SparX:強(qiáng)化Vision Mamba和Transformer的稀疏跳躍連接機(jī)制

本文分享香港大學(xué)計(jì)算和數(shù)據(jù)科學(xué)學(xué)院俞益洲教授及其研究團(tuán)隊(duì)發(fā)表于 AAAI 2025 的論文——Spa....

準(zhǔn)確性超Moshi和GLM-4-Voice,端到端語(yǔ)音雙工模型Freeze-Omni

GPT-4o 提供的全雙工語(yǔ)音對(duì)話帶來(lái)了一股研究熱潮,目前諸多工作開(kāi)始研究如何利用 LLM 來(lái)實(shí)現(xiàn)端....

CNN, RNN, GNN和Transformer模型的統(tǒng)一表示和泛化誤差理論分析

背景介紹 本文是基于我們之前的 RPN(Reconciled Polynomial Network)....

復(fù)旦提出大模型推理新思路:Two-Player架構(gòu)打破自我反思瓶頸

在 AI 領(lǐng)域,近期的新聞焦點(diǎn)無(wú)疑是關(guān)于「Scaling Law 是否撞墻?」的辯論。這一曾經(jīng)被視作....

浙大、微信提出精確反演采樣器新范式,徹底解決擴(kuò)散模型反演問(wèn)題

隨著擴(kuò)散生成模型的發(fā)展,人工智能步入了屬于?AIGC?的新紀(jì)元。擴(kuò)散生成模型可以對(duì)初始高斯噪聲進(jìn)行逐....

經(jīng)典圖神經(jīng)網(wǎng)絡(luò)(GNNs)的基準(zhǔn)分析研究

本文簡(jiǎn)要介紹了經(jīng)典圖神經(jīng)網(wǎng)絡(luò)(GNNs)的基準(zhǔn)分析研究,發(fā)表在 NeurIPS 2024。 文章回顧....

一種信息引導(dǎo)的量化后LLM微調(diào)新算法IR-QLoRA

大模型應(yīng)用開(kāi)卷,連一向保守的蘋(píng)果,都已釋放出發(fā)展端側(cè)大模型的信號(hào)。 問(wèn)題是,大語(yǔ)言模型(LLM)卓越....

適配器微調(diào)在推薦任務(wù)中的幾個(gè)關(guān)鍵因素

可遷移的推薦系統(tǒng) (TransRec) 通常包含一個(gè)用戶編碼器和一個(gè)或多個(gè)基于模態(tài)的物品編碼器,其中....

再登Nature!DeepMind大模型突破60年數(shù)學(xué)難題,解法超出人類已有認(rèn)知

用大模型解決困擾數(shù)學(xué)家60多年的問(wèn)題,谷歌DeepMind最新成果再登 Nature。 作者之一、谷....

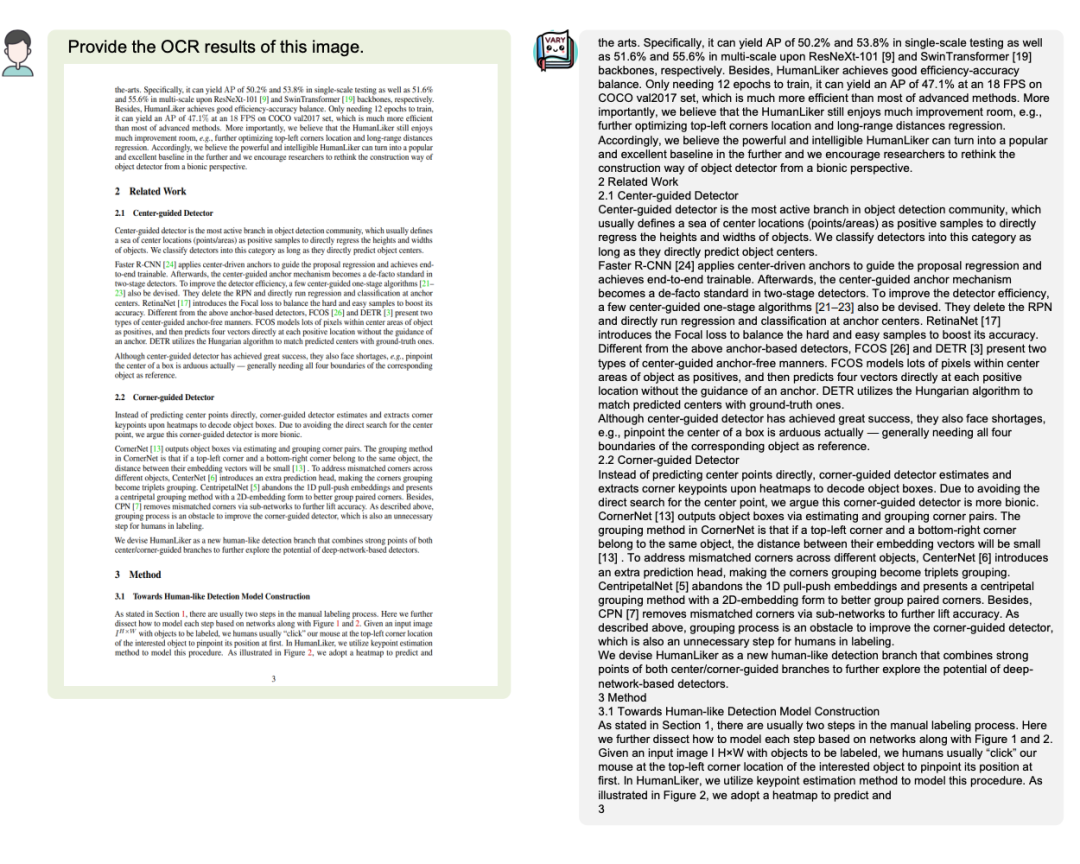

OCR終結(jié)了?曠視提出可以文檔級(jí)OCR的多模態(tài)大模型框架Vary,支持中英文,已開(kāi)源!

想將一份文檔圖片轉(zhuǎn)換成 Markdown 格式?以往這一任務(wù)需要文本識(shí)別、布局檢測(cè)和排序、公式表格處....

NeurIPS23|視覺(jué) 「讀腦術(shù)」:從大腦活動(dòng)中重建你眼中的世界

在這篇 NeurIPS23 論文中,來(lái)自魯汶大學(xué)、新加坡國(guó)立大學(xué)和中科院自動(dòng)化所的研究者提出了一種視....

ICLR 2024高分投稿:用于一般時(shí)間序列分析的現(xiàn)代純卷積結(jié)構(gòu)

這篇是 ICLR 上用 TCN 來(lái)做一般的時(shí)間序列分析的論文,在 Rebuttal 之后的分?jǐn)?shù)為 8....

DeepMind論文登上Nature:困擾數(shù)學(xué)家?guī)资甑碾y題,大模型發(fā)現(xiàn)全新解

除了模仿人類說(shuō)話、寫(xiě)作、寫(xiě)代碼,大模型還能用來(lái)發(fā)現(xiàn)新知識(shí)。 作為今年 AI 圈的頂流,大型語(yǔ)言模型(....

GPT推斷中的批處理(Batching)效應(yīng)簡(jiǎn)析

機(jī)器學(xué)習(xí)模型依賴于批處理(Batching)來(lái)提高推斷吞吐量,尤其是對(duì)于 ResNet 和 Dens....

大規(guī)模神經(jīng)網(wǎng)絡(luò)優(yōu)化:超參最佳實(shí)踐與規(guī)模律

從理論分析入手把握大規(guī)模神經(jīng)網(wǎng)絡(luò)優(yōu)化的規(guī)律,可以指導(dǎo)實(shí)踐中的超參數(shù)選擇。反過(guò)來(lái),實(shí)踐中的超參數(shù)選擇也....

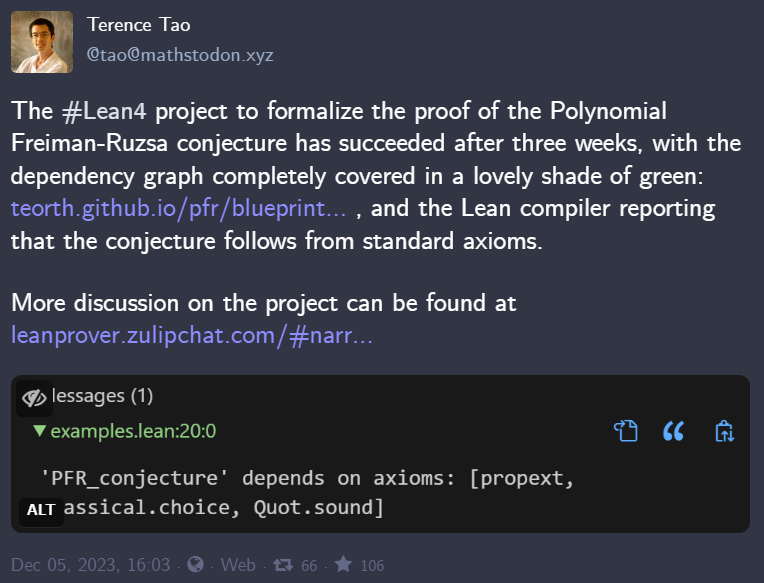

陶哲軒用 AI 形式化的證明究竟是什么?一文看懂 PFR 猜想的前世今生

正是包括兩位菲爾茲獎(jiǎng)獲得者在內(nèi)四位數(shù)學(xué)家的堅(jiān)持,才得以證明了一個(gè)堪稱「加性組合學(xué)圣杯」的猜想,其中 ....

星載傳算能力——天地一體化網(wǎng)絡(luò)在軌邊緣計(jì)算產(chǎn)業(yè)發(fā)展的攔路虎

2023年11月18日CCF YOCSEF太原在太原理工大學(xué)明向校區(qū)信計(jì)學(xué)院北樓一層會(huì)議室舉辦“衛(wèi)星....

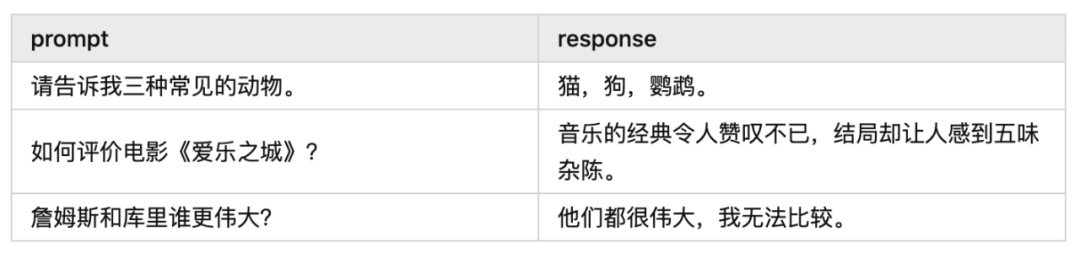

任意文本、視覺(jué)、音頻混合生成,多模態(tài)有了強(qiáng)大的基礎(chǔ)引擎CoDi-2

研究者表示,CoDi-2 標(biāo)志著在開(kāi)發(fā)全面的多模態(tài)基礎(chǔ)模型領(lǐng)域取得了重大突破。 今年 5 月,北卡羅....