AI一天,人間一年。

現(xiàn)在不論是大模型本身,亦或是AI應(yīng)用的更新速度簡(jiǎn)直令人直呼跟不上——

Sora、Suno、Udio、Luma……重磅應(yīng)用一個(gè)接一個(gè)問(wèn)世。

也正如來(lái)自InfoQ的調(diào)查數(shù)據(jù)顯示的那般,雖然AIGC目前還處于起步階段,但市場(chǎng)規(guī)模已初具雛形:

行業(yè)整體迅速發(fā)展固然是好事,但具體到每個(gè)的應(yīng)用或者大模型的落地來(lái)說(shuō),面臨的競(jìng)爭(zhēng)也越發(fā)激烈了。

例如前不久各個(gè)大模型廠(chǎng)商之間展開(kāi)的非常激烈的“價(jià)格戰(zhàn)”,主打一個(gè)比誰(shuí)更便宜,甚至直接把大模型價(jià)格推向“厘時(shí)代”。

加上最近OpenAI的“斷供”事件,更是讓國(guó)內(nèi)廠(chǎng)商們?cè)诖虺觥拜p松搬家”計(jì)劃的同時(shí),再加碼Tokens送送送的力度。

究其原因,也是與當(dāng)下應(yīng)用為王,尤其是以盡量低的成本把業(yè)務(wù)快速落地的這一大趨勢(shì)緊密相關(guān)。

那么問(wèn)題來(lái)了,大模型玩家們何以在又快又好又省之間做到平衡?

這就回到了那個(gè)避不開(kāi),同時(shí)又是成本里占絕對(duì)大頭的因素——算力。

現(xiàn)在提及大模型的訓(xùn)練和推理,很多人的第一反應(yīng)或許就是想到了GPU。

誠(chéng)然GPU在高性能上占據(jù)著一定的優(yōu)勢(shì),但它所存在“硬傷”也是比較明顯,那便是供應(yīng)不足、價(jià)格昂貴。

何以破局?國(guó)產(chǎn)大模型第一梯隊(duì)玩家百度智能云千帆大模型平臺(tái),就給出了自己的一個(gè)更具“效價(jià)比”的解法:

具體到算力的部署上,百度智能云AI與大模型平臺(tái)總經(jīng)理忻舟認(rèn)為:

一言蔽之,在大模型時(shí)代,CPU甚至比以往更加重要了,而且是能讓大模型和應(yīng)用做到“快好省”落地的關(guān)鍵因素之一。

那么具體“上崗”效果又是如何,我們繼續(xù)往下看。

國(guó)產(chǎn)頭部大模型玩家,pick了CPU

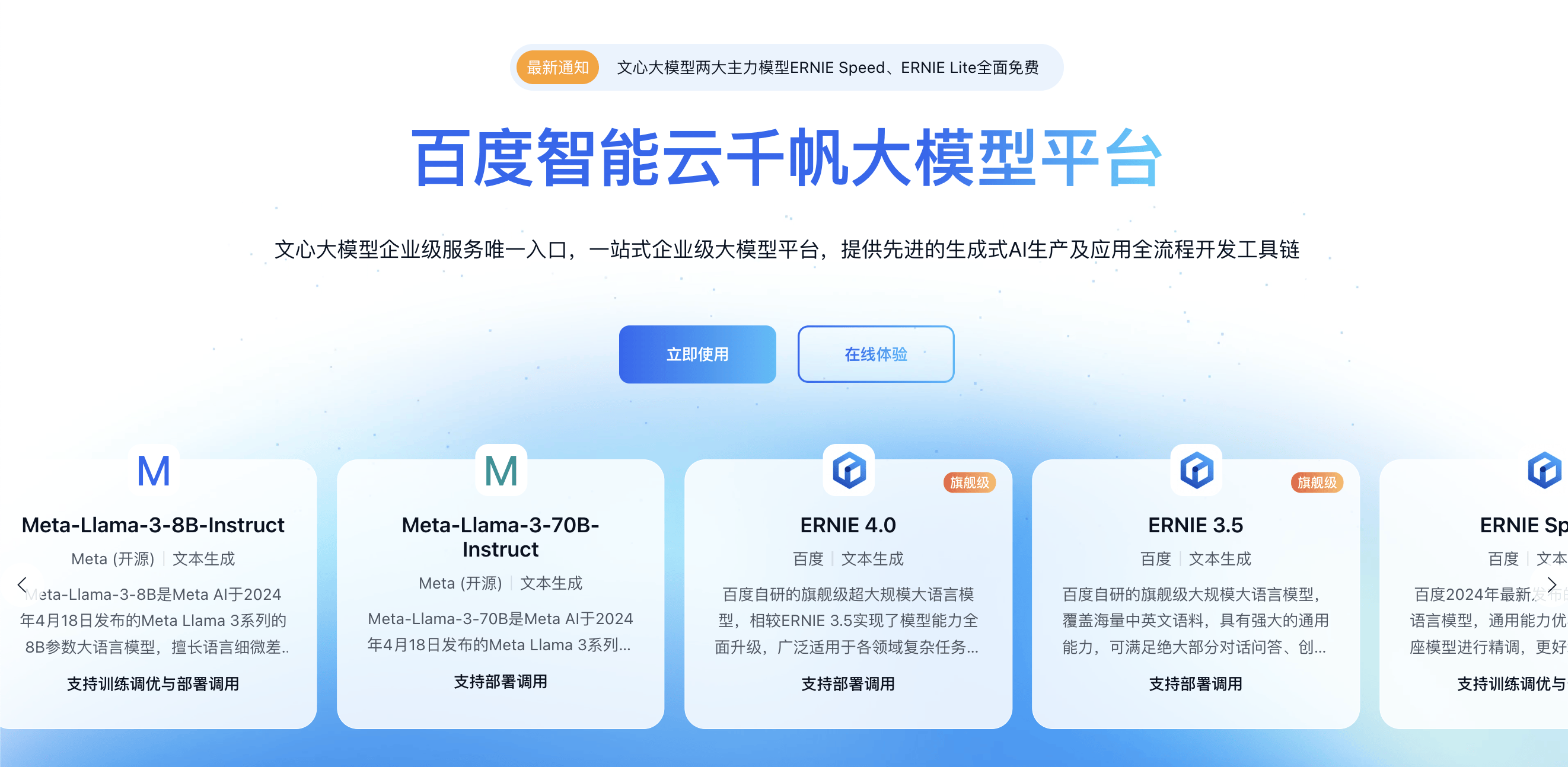

國(guó)內(nèi)AIGC應(yīng)用爆發(fā),這其中,百度智能云千帆大模型平臺(tái)功不可沒(méi)。

作為企業(yè)使用大模型的”一站式”服務(wù)平臺(tái),千帆大模型平臺(tái)自去年3月發(fā)布以來(lái)已有超12萬(wàn)客戶(hù)使用,累計(jì)調(diào)優(yōu)模型2萬(wàn)個(gè),孵化應(yīng)用4.2萬(wàn)個(gè)。

這些應(yīng)用覆蓋教育、金融、辦公、醫(yī)療等眾多場(chǎng)景,為行業(yè)數(shù)字化轉(zhuǎn)型提供了有力支撐。

在教育領(lǐng)域,千帆大模型平臺(tái)賦能了試題生成、在線(xiàn)批改、題目解析等應(yīng)用,大大提升了教學(xué)和備考效率。

例如用戶(hù)可以提供參考材料,設(shè)定題型和難度,平臺(tái)就能自動(dòng)生成高質(zhì)量的試題。而交互式的題目解析,則可以針對(duì)每位學(xué)生的薄弱環(huán)節(jié),提供個(gè)性化的學(xué)習(xí)指導(dǎo)。

在辦公場(chǎng)景,千帆大模型平臺(tái)與業(yè)內(nèi)頭部企業(yè)合作,共同打造了智能寫(xiě)作助手等創(chuàng)新應(yīng)用,能夠根據(jù)用戶(hù)輸入的關(guān)鍵詞,快速生成招聘文案、營(yíng)銷(xiāo)方案、數(shù)據(jù)報(bào)告等專(zhuān)業(yè)文檔。

還可以專(zhuān)注于各類(lèi)寫(xiě)作場(chǎng)景,可以智能生成論文大綱、項(xiàng)目匯報(bào)、品牌宣傳稿等,大大提升了行政和營(yíng)銷(xiāo)人員的工作效率。

醫(yī)療健康是千帆大模型平臺(tái)的另一大應(yīng)用賽道。基于醫(yī)療知識(shí)庫(kù)訓(xùn)練的模型,可以自動(dòng)生成體檢報(bào)告解讀,用通俗易懂的語(yǔ)言向用戶(hù)解釋各項(xiàng)指標(biāo),并給出個(gè)性化的健康指導(dǎo)。

這讓普通大眾也能更好地了解自己的身體狀況,實(shí)現(xiàn)”健康自主管理”。

可以看到,千帆大模型平臺(tái)在多個(gè)領(lǐng)域?qū)崿F(xiàn)了AI模型的”最后一公里”落地。

那么千帆大模型平臺(tái)是怎么支撐如此多AI應(yīng)用的呢?

答案是:讓CPU成為客戶(hù)的選擇之一,讓“效價(jià)比”的紅利普惠千行百業(yè)。

之所以如此,百度智能云所給出的解釋是:

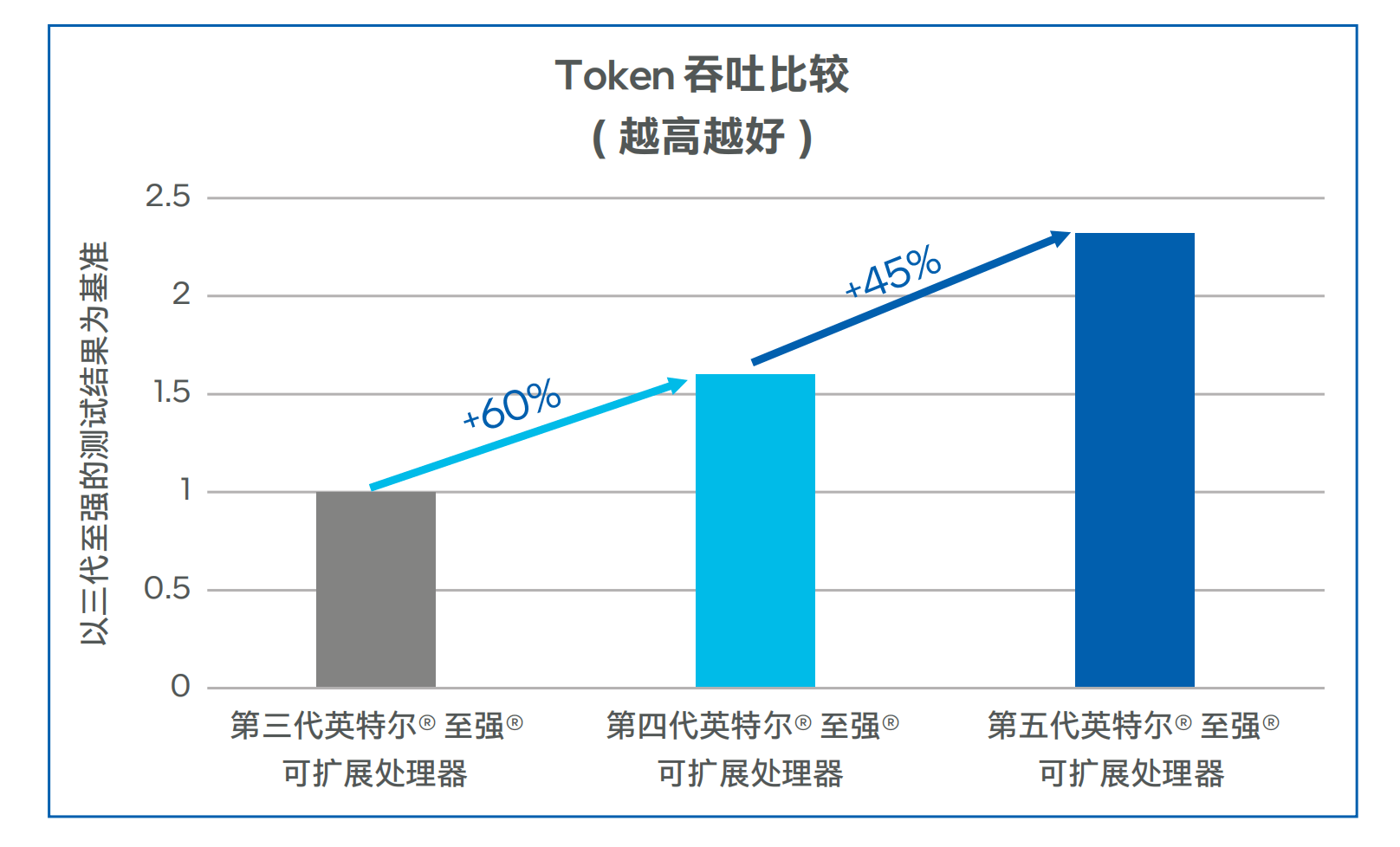

至于效果,以L(fǎng)lama-2-7B為例,在第四代英特爾? 至強(qiáng)? 可擴(kuò)展處理器上輸出 Token 吞吐可達(dá) 100 TPS 以上,相比第三代提升了60%。

△Llama-2-7b模型輸出Token吞吐

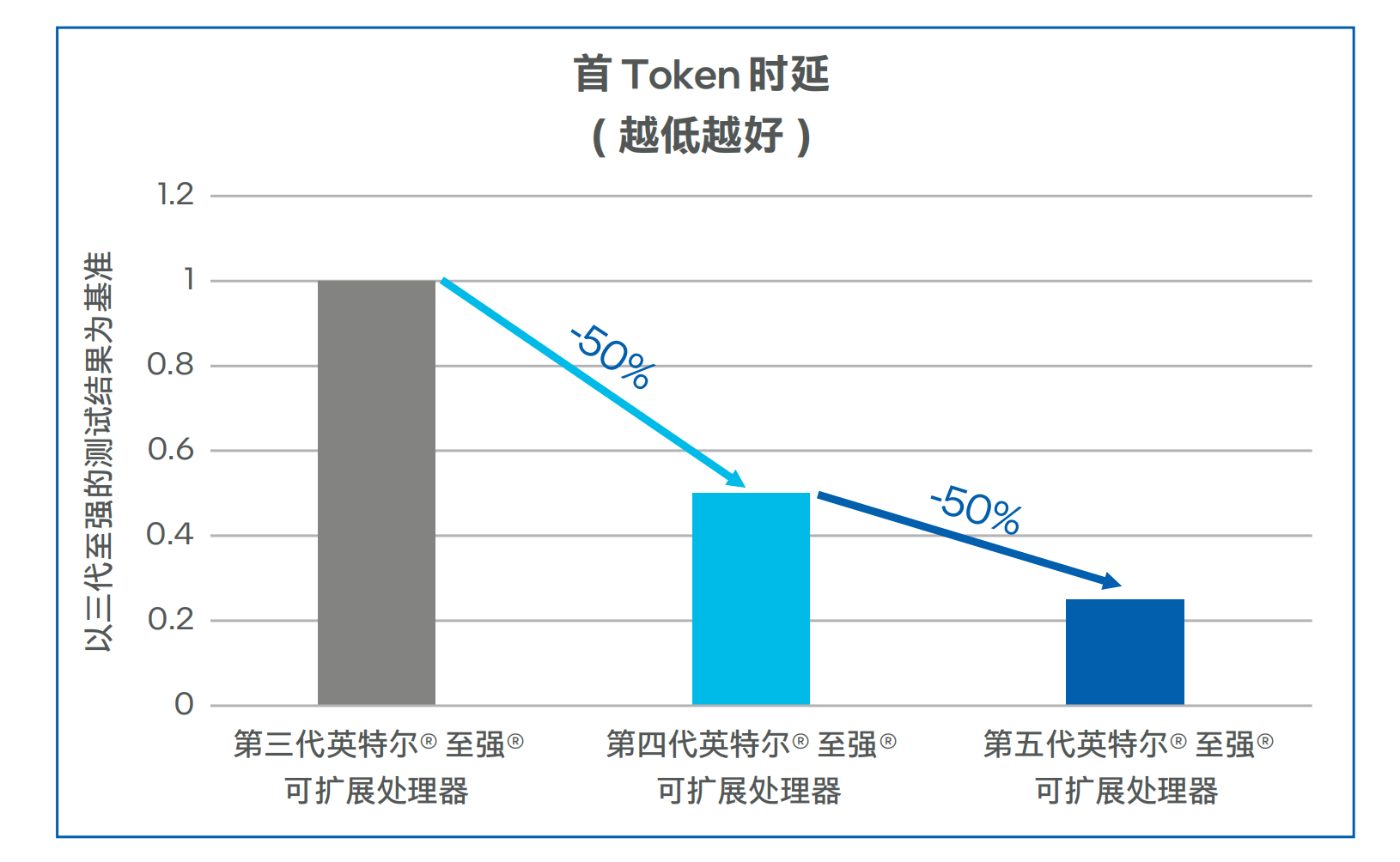

在低延遲的場(chǎng)景,同等并發(fā)下,第四代至強(qiáng)? 可擴(kuò)展處理器的首Token時(shí)延比第三代至強(qiáng)? 可降低50%以上。

在將處理器升級(jí)為第五代至強(qiáng)? 可擴(kuò)展處理器之后,較上代的吞吐可提升45%左右,首 Token 時(shí)延下降50%左右。

△Llama-2-7b模型首Token時(shí)延

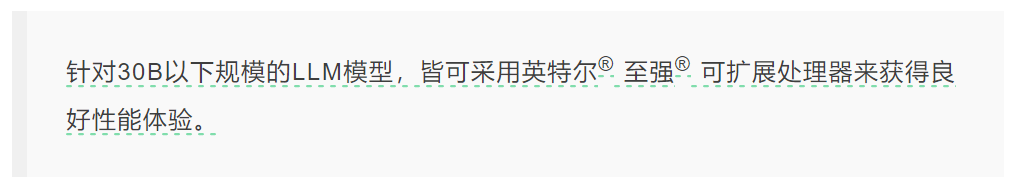

并且千帆大模型平臺(tái)團(tuán)隊(duì)根據(jù)實(shí)踐經(jīng)驗(yàn)還表示:

不僅如此,利用充足的CPU資源,降低對(duì)于A(yíng)I加速卡的需求,從而降低 LLM 推理服務(wù)的總體擁有成本 (TCO),特別是在離線(xiàn)的 LLM 推理場(chǎng)景中表現(xiàn)出色。

而且在千帆大模型平臺(tái)上,可不止是有自家的ERNIE,還有很多主流的大模型都集成于此。

這也在一定程度上從側(cè)面印證了第五代英特爾? 至強(qiáng)? 可擴(kuò)展處理器在性能上的過(guò)關(guān)。

英特爾第五代至強(qiáng),如何讓性能和效率變得Pro Max?

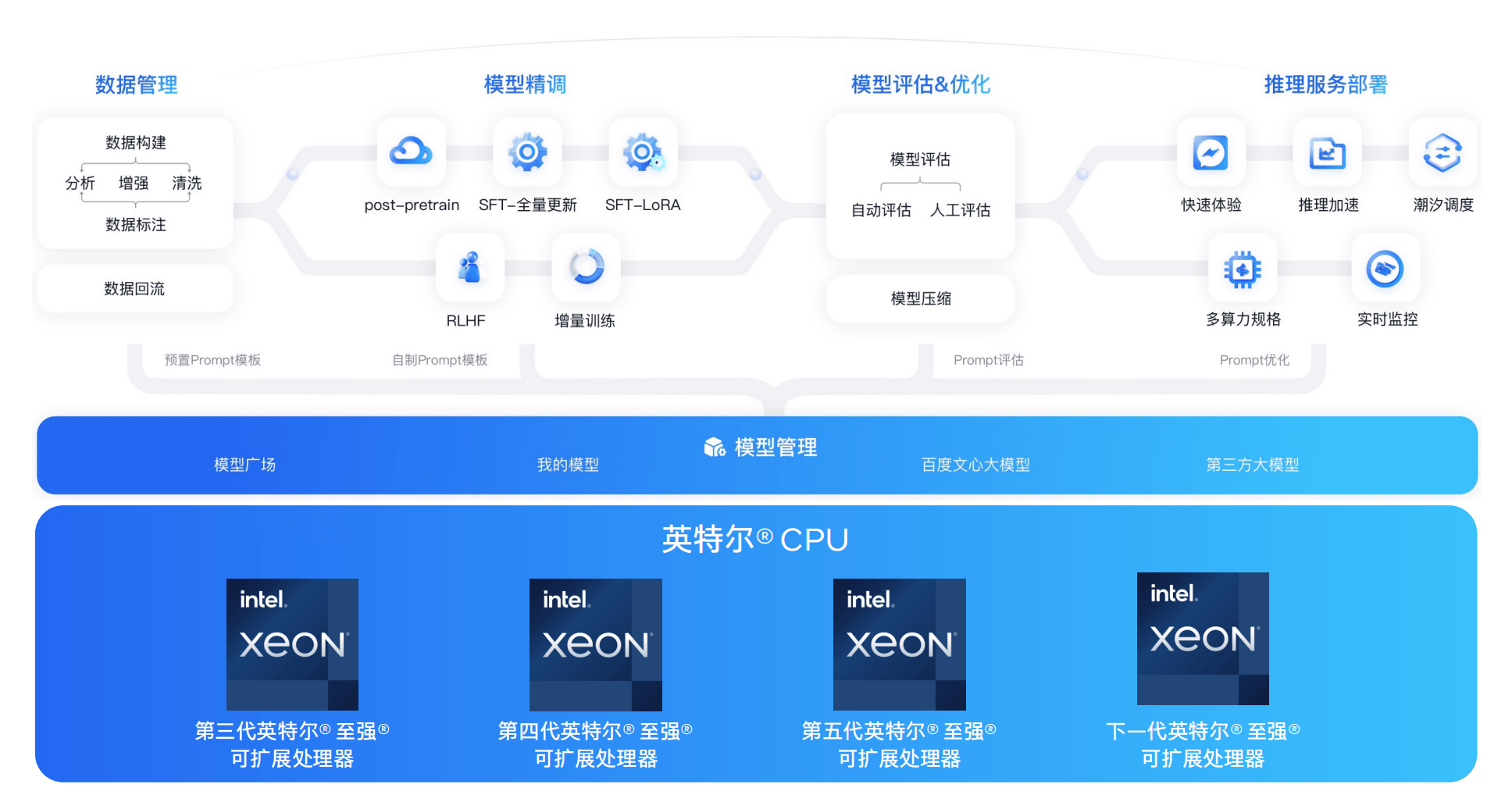

百度智能云千帆大模型平臺(tái),不止需要大模型推理一種工作負(fù)載,它其實(shí)是一個(gè)覆蓋大模型全生命周期的平臺(tái)。

具體來(lái)說(shuō),千帆大模型平臺(tái)提供數(shù)據(jù)標(biāo)注,模型訓(xùn)練與評(píng)估,推理服務(wù)與應(yīng)用集成的全面功能服務(wù),以及快速應(yīng)用編排與插件集成,助力大模型多場(chǎng)景落地應(yīng)用。這樣一來(lái),比起專(zhuān)為大模型推理部署專(zhuān)用加速器,充分利用平臺(tái)已廣泛部署的CPU資源,就是更劃算的選擇了。

對(duì)于千帆大模型平臺(tái)上存在的大量離線(xiàn)大模型應(yīng)用需求來(lái)說(shuō),如生成文章總結(jié)、摘要、評(píng)估多個(gè)模型的效果等,這類(lèi)需求對(duì)推理的時(shí)延要求其實(shí)不高,但內(nèi)存容易成為瓶頸。

采用CPU來(lái)做,擴(kuò)展內(nèi)存更方便,還可以利用起平臺(tái)閑時(shí)的算力資源,進(jìn)一步提高資源利用率,起到降低總擁有成本的作用。

在這個(gè)大背景下,第五代英特爾? 至強(qiáng)? 可擴(kuò)展處理器中的性能密集型通用計(jì)算應(yīng)用負(fù)載(類(lèi)似P Core性能核)的設(shè)計(jì)就尤為關(guān)鍵了。

與E Core(能效核)相比,P Core采用了追求性能最大化的設(shè)計(jì),能承載非常重的負(fù)載,同時(shí)還兼顧了AI推理加速。

采用此設(shè)計(jì)的第五代至強(qiáng)? 可擴(kuò)展處理器,在兼顧AI推理加速這一點(diǎn)上可不是說(shuō)說(shuō)而已,而是軟硬件協(xié)同優(yōu)化,各方面都考慮到位了。

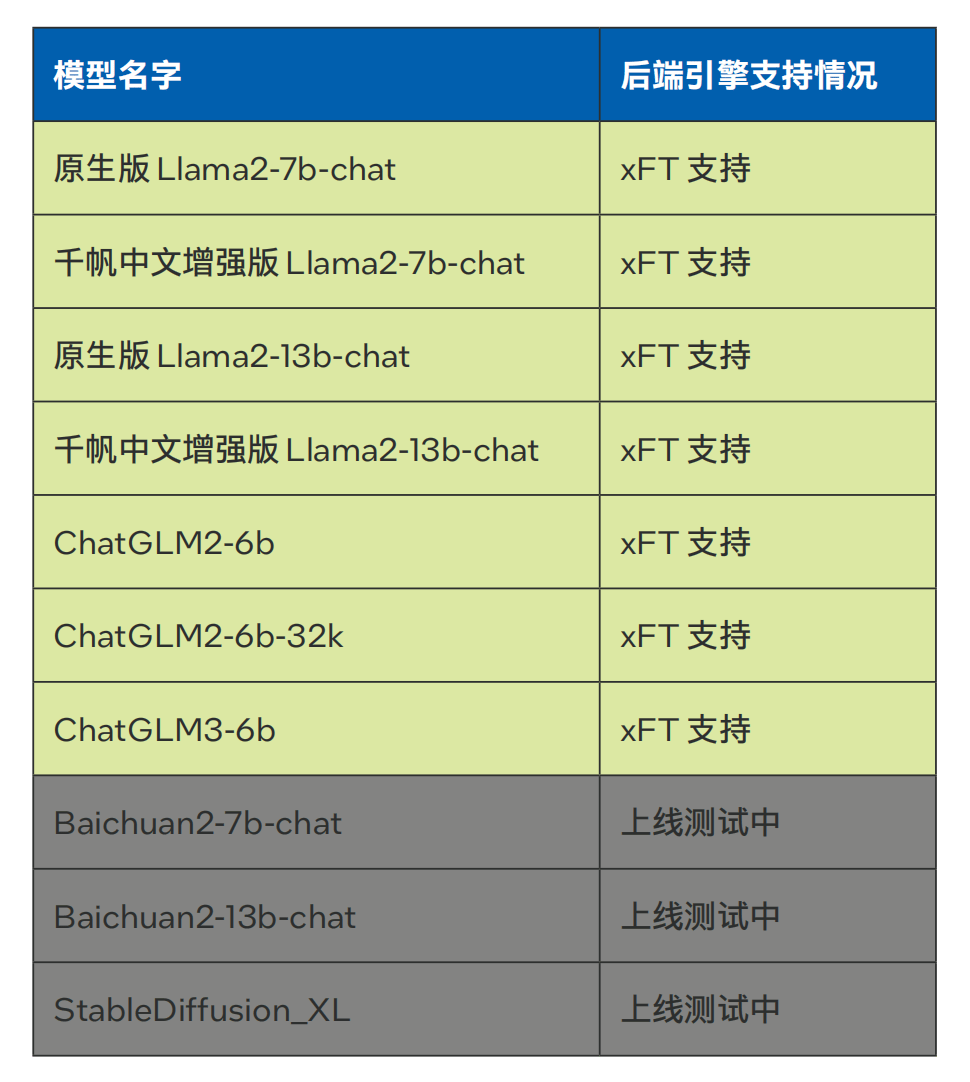

硬件方面,英特爾? AMX(高級(jí)矩陣擴(kuò)展)技術(shù),正是為大模型推理重深度學(xué)習(xí)中大量的矩陣乘法運(yùn)算專(zhuān)門(mén)優(yōu)化的,可以理解成”CPU 里的 Tensor Core”。

有了英特爾? AMX,處理器每個(gè)時(shí)鐘周期可完成高達(dá)2048個(gè)INT8運(yùn)算,比上一代AVX512_VNNI指令提升8倍之多。

更重要的是,英特爾? AMX加速器是內(nèi)置在CPU核心里的,讓矩陣存儲(chǔ)和運(yùn)算更近,這一特性應(yīng)用在大模型推理上,能夠降低處理下一個(gè)Token的時(shí)延,讓終端用戶(hù)的體驗(yàn)更好。

△英特爾? AMX 可以更高效的實(shí)現(xiàn) AI 加速

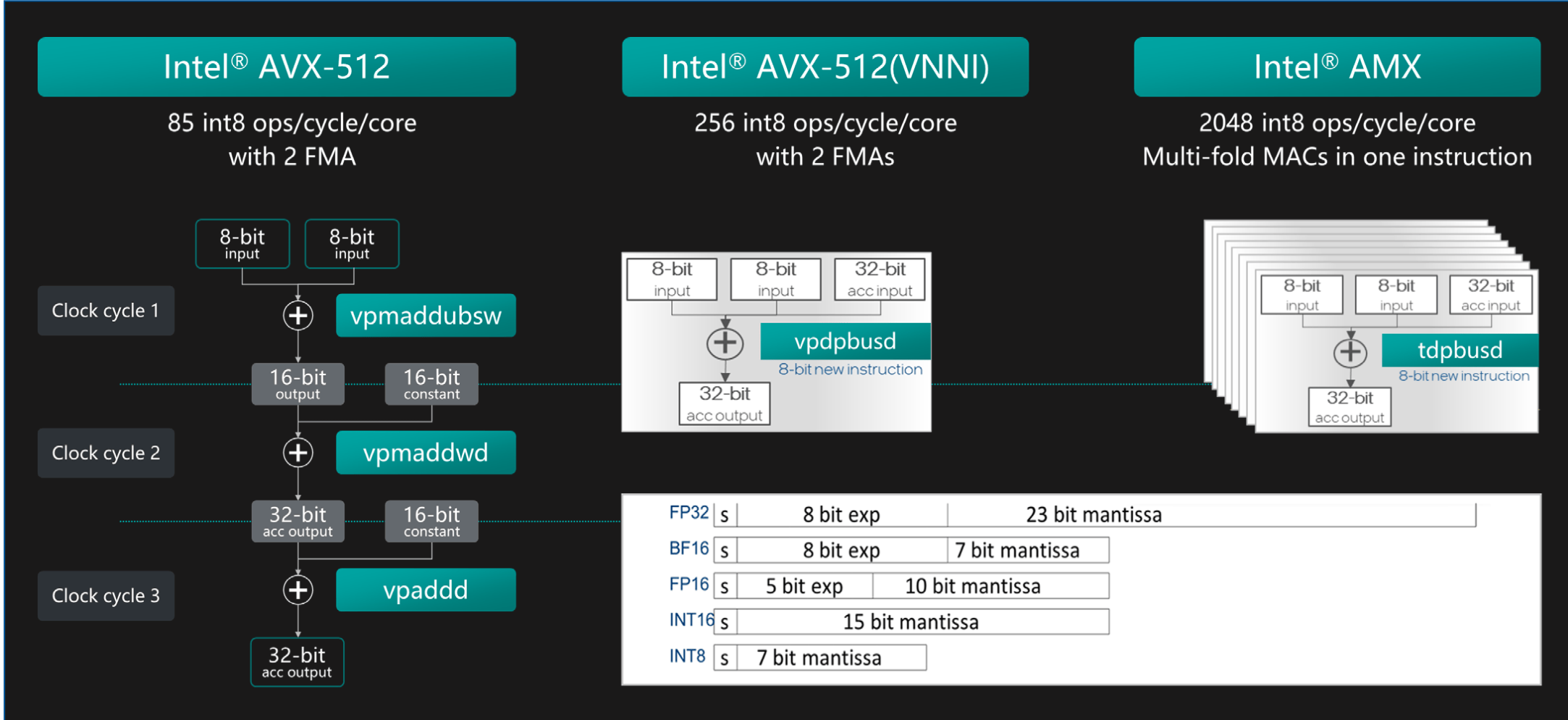

軟件方面,百度智能云千帆大模型平臺(tái)已經(jīng)引入了針對(duì)英特爾? 至強(qiáng)? 可擴(kuò)展平臺(tái)深度優(yōu)化的大模型推理軟件解決方案xFasterTransformer (xFT),并將其作為后端推理引擎。主要優(yōu)化策略如下:

- 充分利用 AMX/AVX512 等指令集,高效實(shí)現(xiàn)核心算子如 Flash Attention 等

- 采用低精度量化,降低數(shù)據(jù)訪(fǎng)存量,發(fā)揮 INT8/BF16 運(yùn)算的優(yōu)勢(shì)

- 支持超大規(guī)模模型的多機(jī)多卡并行推理

△英特爾? 至強(qiáng)? 可擴(kuò)展處理器 LLM 推理軟件解決方案

最后還要補(bǔ)充的一點(diǎn)是,要知道選擇一種硬件平臺(tái),不止關(guān)乎于設(shè)備本身的采購(gòu)價(jià)格,還會(huì)影響到后續(xù)的維護(hù)成本,甚至人才儲(chǔ)備成本。

所以正如百度智能云所言,高性?xún)r(jià)比的算力基礎(chǔ)設(shè)施,與先進(jìn)的大模型算法和平臺(tái)軟件相輔相成,讓上層的開(kāi)發(fā)者們能夠更加平滑地應(yīng)用,構(gòu)建他們的業(yè)務(wù),才能最大化云計(jì)算平臺(tái)的商業(yè)價(jià)值。

大模型時(shí)代,CPU大有可為

縱觀(guān)當(dāng)下,大模型正從實(shí)驗(yàn)室走向產(chǎn)業(yè),從少數(shù)人的“玩具”變?yōu)榇蟊娍捎玫摹肮ぞ摺薄?/p>

這意味著,大模型服務(wù)不僅要有優(yōu)秀的性能表現(xiàn),還要做到價(jià)格親民、部署便捷。一言以蔽之,“快好省”成了大模型商業(yè)化的關(guān)鍵一環(huán)。

而要實(shí)現(xiàn)“快好省”,算力基礎(chǔ)設(shè)施的選擇至關(guān)重要。

傳統(tǒng)觀(guān)點(diǎn)認(rèn)為,專(zhuān)用加速器才是AI的“標(biāo)配”。但在供應(yīng)緊張、成本高企的背景下,專(zhuān)用加速器的優(yōu)勢(shì)正在減弱。

相比之下,優(yōu)化良好的高端 CPU 不僅能提供足夠應(yīng)對(duì)大模型推理的算力,而且具有更廣泛的部署基礎(chǔ)和更成熟的軟件生態(tài)、以及更好的安全保障,開(kāi)始受到越來(lái)越多業(yè)界玩家的青睞。

以英特爾? 至強(qiáng)? 系列為代表的x86架構(gòu)CPU,擁有成熟完善的軟件生態(tài)和廣泛的應(yīng)用基礎(chǔ)。數(shù)以百萬(wàn)計(jì)的開(kāi)發(fā)者可以利用現(xiàn)有工具和框架,快速構(gòu)建和優(yōu)化AI應(yīng)用,而無(wú)需額外學(xué)習(xí)專(zhuān)門(mén)的加速器軟件棧,大大降低了開(kāi)發(fā)難度和遷移成本。

同時(shí),企業(yè)級(jí)用戶(hù)還可以利用CPU內(nèi)置的多層次安全技術(shù),實(shí)現(xiàn)從硬件到軟件的全棧保護(hù),充分保障數(shù)據(jù)安全和隱私。這些優(yōu)勢(shì),是當(dāng)前專(zhuān)用加速器難以比擬的。

由此可見(jiàn),充分利用CPU進(jìn)行推理,讓AI從“燒錢(qián)游戲”變?yōu)椤捌栈?a target="_blank">科技”,正是AIGC產(chǎn)業(yè)應(yīng)對(duì)算力門(mén)檻,推動(dòng)規(guī)模化應(yīng)用落地的關(guān)鍵一招。未來(lái),隨著技術(shù)創(chuàng)新和生態(tài)完善,這一模式還將為更多企業(yè)創(chuàng)造價(jià)值,為產(chǎn)業(yè)發(fā)展注入新的動(dòng)力。

除了直接加速推理任務(wù)外,CPU在完整的端到端AI管線(xiàn)中還能高效完成數(shù)據(jù)預(yù)處理、特征工程等AI全流程中的關(guān)鍵步驟。而支持機(jī)器學(xué)習(xí)和圖分析的各類(lèi)數(shù)據(jù)庫(kù),也主要是構(gòu)建在CPU之上的。以至強(qiáng)? 可擴(kuò)展處理器為例,除了英特爾? AMX之外,還有諸如英特爾? 數(shù)據(jù)保護(hù)與壓縮加速技術(shù)(英特爾? QAT)、英特爾? 存內(nèi)分析加速器(英特爾? IAA)等一系列數(shù)據(jù)分析引擎內(nèi)置于處理器中,通過(guò)卸載特定任務(wù)使CPU得到更好的利用,從而提升工作負(fù)載整體性能,實(shí)現(xiàn)數(shù)據(jù)分析加速。

由此可見(jiàn),構(gòu)建“快、準(zhǔn)、穩(wěn)”的 AI 應(yīng)用,既要靠專(zhuān)用加速器強(qiáng)大的算力,也離不開(kāi)CPU超強(qiáng)的通用計(jì)算能力去釋放整個(gè)系統(tǒng)的潛力。

為了科普CPU在A(yíng)I推理新時(shí)代的玩法,量子位開(kāi)設(shè)了《最“in”AI》專(zhuān)欄,將從技術(shù)科普、行業(yè)案例、實(shí)戰(zhàn)優(yōu)化等多個(gè)角度全面解讀。

我們希望通過(guò)這個(gè)專(zhuān)欄,讓更多的人了解CPU在A(yíng)I推理加速,甚至是整個(gè)AI平臺(tái)或全流程加速上的實(shí)踐成果,重點(diǎn)就是如何更好地利用CPU來(lái)提升大模型應(yīng)用的性能和效率。

-

cpu

+關(guān)注

關(guān)注

68文章

11033瀏覽量

215996 -

AI

+關(guān)注

關(guān)注

87文章

34205瀏覽量

275367 -

大模型

+關(guān)注

關(guān)注

2文章

3026瀏覽量

3825

發(fā)布評(píng)論請(qǐng)先 登錄

破局時(shí)刻:大陸首款55A/-200V/50mΩ高壓MOSFET問(wèn)世-VBP2205N

海康機(jī)器人如何站穩(wěn)機(jī)器視覺(jué)行業(yè)第一梯隊(duì)

一鍵對(duì)焦+一鍵調(diào)平,測(cè)量效率提升7倍 | 優(yōu)可測(cè)全新旗艦白光干涉儀發(fā)布

魔視智能攜手奇瑞汽車(chē)共筑智能駕駛新生態(tài)

商湯科技位列中國(guó)大模型應(yīng)用市場(chǎng)領(lǐng)域第一梯隊(duì)

商湯“日日新”融合大模型登頂大語(yǔ)言與多模態(tài)雙榜單

當(dāng) DeepSeek 顛覆 AI 格局,線(xiàn)路板行業(yè)何去何從?

飛騰CPU成功支持DeepSeek全系列大模型

商湯科技位列GenAI IaaS領(lǐng)域第一梯隊(duì)

東風(fēng)日產(chǎn)與Momenta合作推出高階智駕方案

2024安防行業(yè)前三季度報(bào)出爐:誰(shuí)在爭(zhēng)先,誰(shuí)在嘆氣?

商湯日日新·商量大模型位列國(guó)內(nèi)大模型第一梯隊(duì)

RISC-V擁有巨大市場(chǎng)潛力的原因

云知聲山海大模型位居全球大模型第一梯隊(duì)

GenAI IaaS增速驚人,商湯科技躋身第一梯隊(duì)

國(guó)產(chǎn)大模型第一梯隊(duì)玩家,為什么pick了CPU?

國(guó)產(chǎn)大模型第一梯隊(duì)玩家,為什么pick了CPU?

評(píng)論