人類能夠通過觸摸找到周圍的物體并明確其某些屬性,這一技能對盲人來說尤其重要,而沒有視覺障礙的人同樣在日常生活中頻繁用到這一點,例如在口袋中摸索并抓住一樣東西。

近日,麻省理工學院(MIT)的研究人員進行了一項技術研究,旨在將這種人類能力復制到機器人上,從而使其通過觸摸即可了解對象的位置并可實時估計對象的姿態。該研究成果預先發表在 arXiv 上,論文著重強調了不再局限于視覺、音頻處理而只需通過觸摸就能與其周圍的環境進行交互的機器人的優勢。

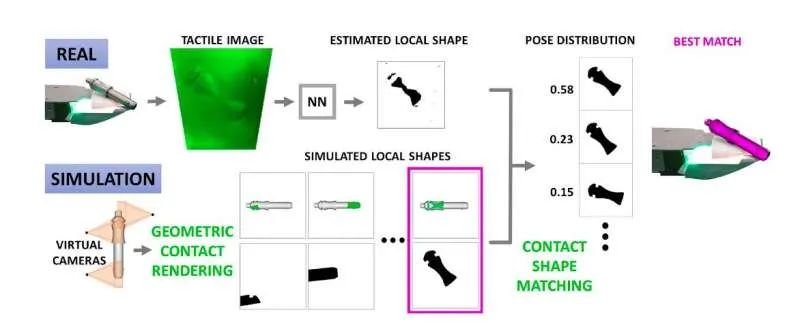

圖 | 幫助機器人通過觸覺感知來定位物體

“我們的研究目標是想證明,機器人通過高分辨率的觸覺感應,甚至首次接觸就可以準確定位已知的對象。與以前在觸覺定位方面的工作相比,我們的方法有了重要的飛躍,因為我們不依賴于任何其他外部感應方式(例如視覺)或以前收集的與被操縱對象有關的觸覺數據。恰恰相反,我們的技術是在模擬中直接訓練的,它第一次觸摸就可以定位已知對象,這在實際的機器人應用中至關重要,因為在真實的機器人中,實時數據收集成本很高或根本不可行。” 進行該項研究的研究人員之一 Maria Bauza 表示。

由于這項技術是在模擬中得到過訓練,因此 Bauza 及其同事不再需要大量的數據收集。這些研究人員最初開發了一個框架,該框架可模擬給定對象與觸覺傳感器之間的接觸,因此假設機器人有權訪問與其交互的對象有關的數據(例如其 3-D 形狀、特性等)。這些接觸會被描繪為深度圖像,可顯示出對象穿透觸覺傳感器的程度。

隨后,他們使用先進的機器學習技術進行計算機視覺和表征學習,將機器人收集的真實觸覺觀察結果與模擬生成的一組接觸信息進行匹配。根據模擬數據集中的每次接觸與實際或觀察到的接觸的匹配可能性,對其進行加權,最終框架會獲得對象的可能姿勢的概率分布。

Bauza 說道:“我們的方法將被繪為深度圖像的接觸編碼到一個嵌入式空間中,這極大地簡化了計算成本,可以做到實時執行。由于它可以產生有意義的姿勢分布,因此可以輕松地與其他感知系統結合使用。例如,在多觸點場景中,多個觸覺傳感器同時觸摸一個對象,我們必須將所有的觀察結果都整合到對象的姿態估計中。”

本質上,這種方法可以根據對象的 3D 形狀模擬出接觸信息。但他們發現,在利用這種技術仔細觸摸對象時并不需要收集任何以前的觸覺數據。也就是說,有了這項技術,機器人的觸覺傳感器可以在首次觸摸到對象時就生成可能的姿勢判斷。

Bauza 表示,他們意識到觸覺感知具有高度鑒別性,并能產生高度精確的姿勢估計。“視力有時會受到遮擋的影響,但觸覺感應卻不會。因此,如果機器人觸碰到了某個獨特對象的一部分,且這種接觸與其他的不同,那么我們的算法可以輕松識別出這一接觸及對象的姿態。”

由于許多接觸對象不具備的獨特區域(即它們的放置方式可能導致最終的接觸極其類似),因此 Bauza 及其同事開發的方法可以預測的是姿勢分布,而不是單個姿勢估計。這與此前開發的只收集單個姿勢估計的對象姿態估計方法形成了鮮明的對比。而且,該框架預測的分布信息可以直接與外部信息進行合并,從而能夠進一步減少對象姿態預測的不確定性。

值得注意的是,他們還觀察到,同時使用多個手指接觸對象,并同時對多個接觸進行組合,也可以迅速減少對象姿態估計的不確定性。

參與這項研究的另一位研究員 Alberto Rodriguez 表示,“感應觸摸能力最近在業界引起了極大了研究興趣,而我們主要是通過結合三個因素來實現這一點的:(1)一種分辨率高但并不昂貴的感應技術,該技術使用小型相機來捕獲觸摸表面的變形(例如 GelSight 感應);(2)將此傳感技術緊密結合到機器人手指(例如 GelSlim 手指)中;(3)基于深度學習的計算框架,來有效處理高分辨率觸覺圖像,從而通過已知零件完成觸覺定位。”

總之,該研究小組設計的這項技術可以讓機器人實時、高水平地估計其正在操作的對象的姿態,這樣一來,就讓機器人能夠對其具體動作的影響做出更準確的預測,從而可以提高其在操作任務時的表現。這對工業當中根據物品形狀的模型進行組裝的制造商來說極具價值。

在未來的工作中,Bauza 團隊計劃擴展這一框架,使其能夠涵蓋有關對象的視覺信息。理想情況下,他們還希望將其技術轉變為一種視覺 - 觸覺傳感系統,從而能夠以更高的精度來估算對象的姿態。

“我們正在進行的另一項研究與這種方法密切相關,目的是探索觸覺感知方法在復雜操作任務中的運用。現在我們正在學習能讓機器人執行精確地抓放操作的模型,以實現穩定地抓握,幫助提高感知水平,改善觸覺定位。” Bauza 表示。

原文標題:不再局限于視覺!MIT研發新技術讓機器人通過觸摸即可與周圍環境進行交互

文章出處:【微信公眾號:DeepTech深科技】歡迎添加關注!文章轉載請注明出處。

責任編輯:haq

-

機器人

+關注

關注

213文章

29731瀏覽量

212842

原文標題:不再局限于視覺!MIT研發新技術讓機器人通過觸摸即可與周圍環境進行交互

文章出處:【微信號:deeptechchina,微信公眾號:deeptechchina】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

一天吃透一條產業鏈:具身智能(AI+機器人)

詳細介紹機場智能指路機器人的工作原理

LD Gen2 Lite激光雷達:賦予機器人 “感知力” 的關鍵

什么是機器人?追蹤機器人技術的發展和未來

讓人形機器人像人一樣去感知,這家國產芯片公司選擇從信號鏈入手

為什么要費這么大勁讓機器人像人一樣,而不是更實用的形態?

【「具身智能機器人系統」閱讀體驗】2.具身智能機器人的基礎模塊

【「具身智能機器人系統」閱讀體驗】+兩本互為支持的書

【「具身智能機器人系統」閱讀體驗】2.具身智能機器人大模型

《具身智能機器人系統》第7-9章閱讀心得之具身智能機器人與大模型

【「具身智能機器人系統」閱讀體驗】+數據在具身人工智能中的價值

《具身智能機器人系統》第1-6章閱讀心得之具身智能機器人系統背景知識與基礎模塊

解鎖機器人視覺與人工智能的潛力,從“盲人機器”改造成有視覺能力的機器人(上)

MIT讓機器人像人類一樣通過觸摸和周圍環境交互

MIT讓機器人像人類一樣通過觸摸和周圍環境交互

評論