人工智能 (AI) 正在加速發(fā)展,也越來越智能化。當今的開源大語言模型不僅功能強大,而且在設計時充分考慮了實際部署的需求,因而具有輕量化和經濟高效的特點,可大規(guī)模部署到數(shù)十億臺設備上。簡而言之,對于開發(fā)者可能想到的各種情形,當今的開源大語言模型幾乎都能滿足其需求。

Meta 近期發(fā)布的 Llama 4 就很好地印證了上述觀點,它在基于 Arm 架構的平臺上能夠充分發(fā)揮其性能潛力。Llama 4 采用創(chuàng)新的混合專家模型 (MoE) 架構,在多模態(tài)推理、工具使用等方面表現(xiàn)出色。而 Llama 4 最大的亮點在于能輕松部署到各種實際場景中,而這在很大程度上得益于 Arm 平臺。

性能優(yōu)化,隨時部署

憑借 Arm 靈活且高能效的計算平臺,Llama 4 可以在基于 Arm 架構的云基礎設施上高效運行,讓開發(fā)者能夠在多樣化的云環(huán)境中部署性能更強、能耗更低且可擴展性更高的大語言模型。

整體而言,行業(yè)正呈現(xiàn)出一種頗有意味的轉變。盡管行業(yè)仍在追求更大、更智能的多模態(tài)模型,但 Llama 4 代表著一種新興趨勢,部分模型正朝著更小型、更實用的方向演進,便于企業(yè)和客戶在自己的云端或本地基礎設施上運行 AI 模型。Llama 4,尤其是其中的 Scout 模型,兼具高效性與專注性,基于智能體和 MoE 架構打造,與 Arm 這樣的高性價比、可擴展的平臺高度契合。

自 Llama 2 發(fā)布以來,Arm 一直致力于優(yōu)化其平臺對模型的兼容性,從而確保開發(fā)者和最終用戶可以高效部署 Meta 新推出的每一代 Llama 模型。Llama 4 Scout 模型正是上述優(yōu)化措施的直觀體現(xiàn),能夠在 Arm 生態(tài)系統(tǒng)中流暢運行。

Llama 4 Scout 模型:

Arm 架構系統(tǒng)的新里程碑

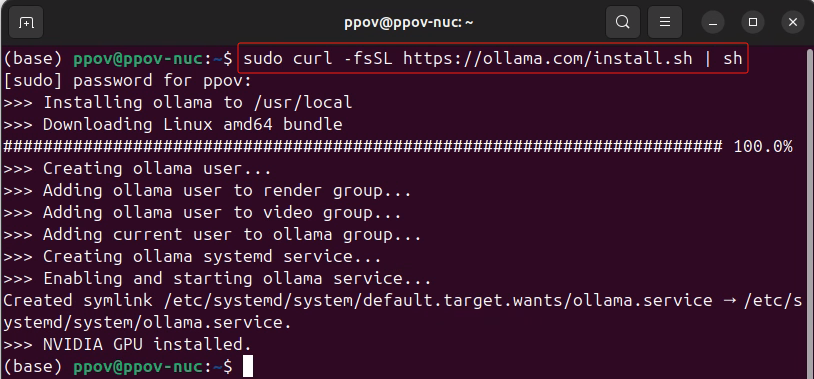

Llama 4 Scout 模型現(xiàn)可在基于 Arm 架構的基礎設施上高效運行。為了驗證兼容性,團隊使用開源推理引擎 llama.cpp 在搭載 Arm 架構的 AWS Graviton4 上成功部署了 Llama 4 Scout 模型。部署操作簡單快捷,開發(fā)者無需專用硬件或專有軟件,就可以無縫集成先進的 AI 功能。在部署到生產環(huán)境中時,借助 llama.cpp 這樣的垂直集成框架和 PyTorch 這樣的通用機器學習工具,整個過程變得清晰且易于實現(xiàn)。

MoE 架構適合 Arm 平臺的原因

智能高效:MoE 模型可智能地將輸入分發(fā)到專用子網絡,從而動態(tài)分配算力資源。這種自適應策略與 Arm 廣受贊譽的高能效和資源感知型工作負載管理機制相得益彰。

可擴展設計:基于 Arm 架構的平臺(例如 AWS Graviton、Google Axion 和 Microsoft Cobalt 等)具備可擴展的核心數(shù)量和線程能力,非常適合 MoE 模型的并行特性,可有效管理工作負載,從而大幅提升吞吐量與整體效率。

針對各種工作負載進行優(yōu)化:Arm 的架構理念注重在不同應用中都實現(xiàn)高性能與高能效,這與 MoE 對任務進行劃分并交由專用子網絡進行處理的能力非常契合。

具有前瞻性的協(xié)同模式:Arm 平臺與 MoE 架構的結合代表了一種具有前瞻性的協(xié)同模式,能夠滿足今后對更智能、更節(jié)省資源的 AI 解決方案的動態(tài)需求。

探索在Arm 平臺運行的 Llama 4

在 Arm 平臺上運行的 Llama 4 Scout 模型是 Arm 致力于打造開放、協(xié)作式 AI 的有力體現(xiàn),誠邀開發(fā)者和生態(tài)系統(tǒng)合作伙伴探索和體驗。Llama 4 Scout 模型可在 AWS Graviton 等基于 Arm 架構的基礎設施上運行,提供現(xiàn)代 AI 工作負載所需的性能、效率和可擴展性。

探索基于 Arm 平臺的 AI,發(fā)現(xiàn)其中蘊含的廣闊潛力,從云端部署到邊緣設備,助力構建更智能且互聯(lián)的未來。

開發(fā)者伙伴們,準備好開始了嗎?期待與你一起探索相關工具,參與社區(qū)交流互動,依托 Arm 技術,攜手塑造更智能、更互聯(lián)的未來!

-

ARM

+關注

關注

134文章

9312瀏覽量

375168 -

AI

+關注

關注

87文章

34294瀏覽量

275481 -

模型

+關注

關注

1文章

3488瀏覽量

50021

原文標題:探索在 Arm 平臺運行的 Llama 4,攜手塑造智能互聯(lián)的 AI 未來

文章出處:【微信號:Arm社區(qū),微信公眾號:Arm社區(qū)】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

今日看點丨臺積電、Intel合資運營代工業(yè)務;韓國計劃向當?shù)仄囆袠I(yè)注入3萬億韓元援助

無法在OVMS上運行來自Meta的大型語言模型 (LLM),為什么?

IBM在watsonx.ai平臺推出DeepSeek R1蒸餾模型

在算力魔方上本地部署Phi-4模型

用Ollama輕松搞定Llama 3.2 Vision模型本地部署

使用NVIDIA TensorRT提升Llama 3.2性能

Meta發(fā)布Llama 3.2量化版模型

Llama 3 模型與其他AI工具對比

Llama 3 與 GPT-4 比較

Llama 3 語言模型應用

使用OpenVINO 2024.4在算力魔方上部署Llama-3.2-1B-Instruct模型

亞馬遜云科技上線Meta Llama 3.2模型

AMD發(fā)布首款小語言AI模型Llama-135m

英偉達發(fā)布AI模型 Llama-3.1-Nemotron-51B AI模型

源2.0-M32大模型發(fā)布量化版 運行顯存僅需23GB 性能可媲美LLaMA3

探索在Arm平臺運行的Llama 4 Scout模型

探索在Arm平臺運行的Llama 4 Scout模型

評論