Llama 3.2 模型集擴展了 Meta Llama 開源模型集的模型陣容,包含視覺語言模型(VLM)、小語言模型(SLM)和支持視覺的更新版 Llama Guard 模型。與 NVIDIA 加速計算平臺搭配使用,Llama 3.2 可為開發者、研究者和企業提供極具價值的新功能和優化,幫助實現生成式 AI 用例。

1B 和 3B 規模的 SLM 基于 NVIDIA Tensor Core GPU 訓練而成,最適合用于在各種邊緣設備上部署基于 Llama 的 AI 助手。11B 和 90B 規模的 VLM 支持文本和圖像輸入以及文本輸出。憑借多模態支持,VLM 可以幫助開發者構建需要視覺基礎、推理和理解能力的強大應用。例如,他們可以構建用于圖像描述生成、圖像轉文本檢索、視覺問答和文檔問答等的 AI 智能體。除文本輸入外,Llama Guard 模型現在還支持圖像輸入護欄。

Llama 3.2 模型架構是一種自動回歸語言模型,使用了經過優化的 Transformer 架構。其指令調整版本使用了監督微調(SFT)和人類反饋強化學習(RLHF)技術,以符合人類對有用性和安全性的偏好。所有模型均支持 128K 詞元的長上下文長度,并通過支持分組查詢注意力(GQA)針對推理進行了優化。

NVIDIA 已對 Llama 3.2 模型集進行了優化,使其能夠在全球數百萬個 GPU 上實現高吞吐量和低延遲,其中包括數據中心、搭載NVIDIA RTX的本地工作站和搭載NVIDIA Jetson的邊緣應用。本文將介紹針對硬件和軟件的優化、定制和易于部署的功能。

使用 NVIDIA TensorRT

提升 Llama 3.2 的性能

為了提供空前吞吐量和最佳終端用戶體驗,同時降低成本和延遲,NVIDIA 正在加速 Llama 3.2 模型集。NVIDIA TensorRT包含了適用于高性能深度學習推理的 TensorRT 和 TensorRT-LLM 程序庫。

Llama 3.2 1B 和 Llama 3.2 3B 模型在 TensorRT-LLM 中使用按比例旋轉位置嵌入(RoPE)技術和其他幾項優化措施(包括 KV 緩存和飛行批處理)獲得加速,以支持長上下文。

Llama 3.2 11B 和 Llama 3.2 90B 模型均為多模態模型,并且包含一個視覺編碼器和一個文本解碼器。視覺編碼器通過將模型導出為 ONNX 圖并構建 TensorRT 引擎獲得加速。ONNX 導出創建了一個包含內置運算符和標準數據類型的標準模型定義,主要用于推理。TensorRT 利用 ONNX 圖,通過構建 TensorRT 引擎針對目標 GPU 優化模型。這種引擎能夠提供各種硬件級優化,通過層和張量融合以及內核自動調整最大程度地提高 NVIDIA GPU 的利用率。

借助 TensorRT-LLM 支持的交叉注意力機制,視覺編碼器的視覺信息被融合到 Llama 文本解碼器中。這樣一來,VLM 就能聯系輸入的文本進行視覺推理和理解,從而高效率地生成文本。

使用 NVIDIA NIM

輕松部署生成式 AI 解決方案

用戶可使用NVIDIA NIM微服務將 TensorRT 優化直接部署到生產中。NIM 微服務加速了生成式 AI 模型在所有 NVIDIA 加速基礎設施上的部署,包括云、數據中心和工作站等。

NIM 微服務支持 Llama 3.2 90B Vision Instruct,Llama 3.2 11B Vision Instruct,Llama 3.2 3B Instruct 和 Llama 3.2 1B Instruct 在生產中的部署。NIM 為生成式 AI 工作負載提供了經過簡化的管理和編排、標準應用編程接口(API)以及帶有生產就緒容器的企業級支持。世界各地的開發者、研究者和企業對整個生態系統提供了強大且日益增強的支持,目前已有超過 175 家合作伙伴將其解決方案與 NVIDIA NIM 微服務集成,他們可以從生成式 AI 應用投資中取得最大的回報。

使用 NVIDIA AI Foundry 和 NVIDIA NeMo

定制和評估 Llama 3.2 模型

NVIDIA AI Foundry提供了一個端到端的 Llama 3.2 模型定制平臺,使用戶能夠獲取先進的 AI 工具、計算資源和 AI 專業知識。定制模型在專有數據上進行微調,使企業能夠在特定領域的任務中實現更高的性能和準確性,從而獲得競爭優勢。

開發者可以借助NVIDIA NeMo整理他們的訓練數據,充分利用 LoRA、SFT、DPO、RLHF 等先進的調校技術定制 Llama 3.2 模型、評估準確性和添加護欄,以此保證模型提供適當的回答。AI Foundry 在 NVIDIA DGX Cloud 上提供專用容量并得到 NVIDIA AI 專家的支持。輸出被打包成 NVIDIA NIM 推理微服務的定制 Llama 3.2 模型,該模型可部署在任何地方。

使用 NVIDIA RTX 和

NVIDIA Jetson 擴展本地推理

如今,Llama 3.2 模型已在全球超過 1 億臺 NVIDIA RTX PC 和工作站上進行了優化。為了部署在 Windows 中,NVIDIA 已對這套模型進行了優化,使其能夠利用 ONNX-GenAI 運行時和 DirectML 后端實現高效運行。

全新的 VLM 和 SLM 為 NVIDIA RTX 系統解鎖了新的功能。為了進行演示,我們創建了一個多模態檢索增強生成(RAG)管線示例。該管線結合了文本和可視化數據處理(例如圖像、統計圖和圖表),具有更強大的信息檢索和生成功能。

請注意,您需要一個配備 NVIDIA RTX 專業 GPU且顯存在 30GB 以上的 Linux 工作站。

SLM 專為邊緣設備本地部署而定制,采用了蒸餾、剪枝和量化等技術降低顯存、延遲和計算要求,同時保持了重點應用領域的準確性。如要下載 Llama 3.2 1B 和 3B SLM 并將其部署到 GPU 推理能力經過優化且具有 INT4/FP8 量化功能的 Jetson 上,請參見NVIDIA Jetson AI Lab 上的 SLM 教程。

多模態模型為視頻分析和機器人領域帶來了獨一無二的視覺功能,因此在邊緣應用中的作用越來越突出。

推動社區 AI 模型的發展

作為積極的開源貢獻者,NVIDIA 致力于優化社區軟件,幫助用戶應對最嚴峻的挑戰。開源 AI 模型還能促進公開透明,使用戶能夠大范圍地分享 AI 安全性和彈性方面的工作成果。

借助 Hugging Face 推理即服務功能,開發者能夠快速部署領先的大語言模型(LLM),例如在 NVIDIA DGX Cloud 上運行且通過 NVIDIA NIM 微服務優化的 Llama 3 模型集。

-

NVIDIA

+關注

關注

14文章

5238瀏覽量

105746 -

gpu

+關注

關注

28文章

4909瀏覽量

130632 -

AI

+關注

關注

87文章

34146瀏覽量

275281 -

模型

+關注

關注

1文章

3483瀏覽量

49962

原文標題:從邊緣到云端部署經加速的 Llama 3.2

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

NVIDIA推出開放式Llama Nemotron系列模型

在NVIDIA TensorRT-LLM中啟用ReDrafter的一些變化

解鎖NVIDIA TensorRT-LLM的卓越性能

NVIDIA TensorRT-LLM Roadmap現已在GitHub上公開發布

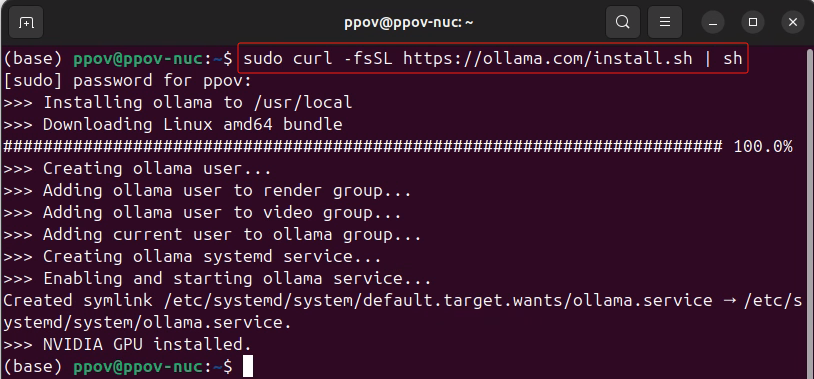

用Ollama輕松搞定Llama 3.2 Vision模型本地部署

TensorRT-LLM低精度推理優化

Meta發布Llama 3.2量化版模型

Llama 3 的未來發展趨勢

Llama 3 性能評測與分析

使用OpenVINO 2024.4在算力魔方上部署Llama-3.2-1B-Instruct模型

亞馬遜云科技上線Meta Llama 3.2模型

亞馬遜云科技正式上線Meta Llama 3.2模型

Meta發布多模態LLAMA 3.2人工智能模型

魔搭社區借助NVIDIA TensorRT-LLM提升LLM推理效率

NVIDIA AI Foundry 為全球企業打造自定義 Llama 3.1 生成式 AI 模型

使用NVIDIA TensorRT提升Llama 3.2性能

使用NVIDIA TensorRT提升Llama 3.2性能

評論