一、引言

隨著自動駕駛技術的逐步落地,感知系統對數據的依賴正以前所未有的速度增長。傳統實車采集雖然真實可信,但在效率、安全性、標注精度以及邊緣場景覆蓋方面均存在顯著限制。

合成數據(Synthetic Data)因具備低成本、高可控性、無限擴展性和高精度標簽等優勢,已成為感知算法訓練與驗證的重要數據來源。尤其在多模態、多場景、大規模自動化生成等方面,仿真平臺正成為構建感知數據體系的重要工具。

在感知系統的開發過程中,我們依托仿真平臺生成覆蓋多種場景和傳感器類型的合成數據,用于支持AVM(環視系統)開發,同時也利用合成數據生成符合公開格式標準的數據集,助力算法在真實部署前實現高效迭代與驗證。本文將系統介紹利用合成數據開發的具體應用流程和實踐效果。

二、 AVM系統開發中的仿真驗證應用

環視系統(AVM, Around View Monitor)是自動駕駛和高級輔助駕駛系統(ADAS)中常見的功能模塊,通常由4個或更多廣角魚眼相機構成,通過拼接多個攝像頭圖像生成車輛周圍360°的鳥瞰圖。

自動泊車系統(APA)需要環視圖像提供對車輛周圍環境的精準感知。通過仿真方式模擬魚眼相機布設和 BEV 拼接,可生成多種泊車場景下的高保真圖像,包括地庫、斜列車位、窄通道等復雜工況。相比實車采集,仿真不僅可以批量構造極端和邊緣泊車條件,還能自動提供精確的障礙物位置與車輛姿態標注,大幅加速感知模型的訓練和驗證流程,減少實車調試時間。

傳統 AVM 系統的相機標定依賴人工操作和實車設備,流程繁瑣且精度受限。通過仿真,可控制各攝像頭位置與視角,并生成可重復、可驗證的圖像和標定數據,適用于整車項目開發初期的快速迭代。虛擬標定不僅提高了標定效率,還支持在方案切換、批量測試、相機布局驗證等場景中自動生成對齊標注,降低人力投入,提升系統上線速度。

在實際開發中,AVM對圖像畸變建模、拼接精度、投影映射等有較高要求,傳統方法依賴人工標定與測試,周期長、靈活性差。而基于aiSim的仿真流程,可有效提升開發效率與驗證精度。

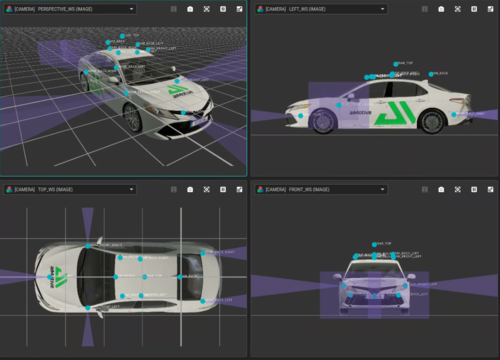

通過合成數據仿真平臺,我們借助從環境搭建到數據生成的全流程仿真,成功實現了4個魚眼相機生成AVM合成數據的優化和驗證。

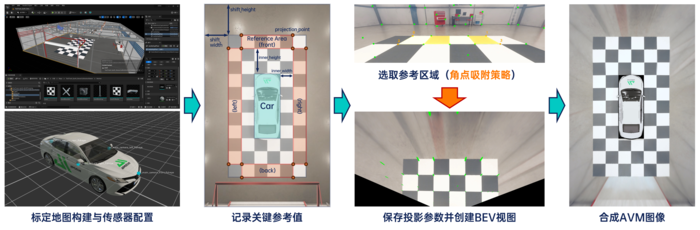

圖1 基于aiSim構建AVM圖像流程

1、標定地圖與仿真環境構建

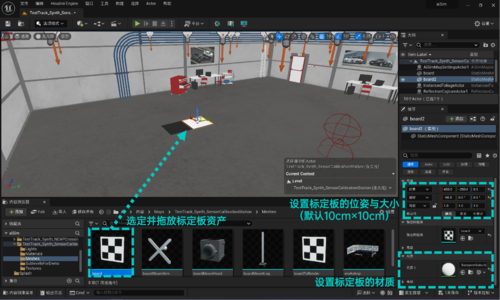

我們在Unreal Engine環境中快速搭建6米×11米標定區域,使用2×2黑白相間標定板構成特征紋理區域,并精確布設車輛初始位置,確保視野重疊區域滿足投影需求,并通過特定插件將其無縫導入仿真器中。

圖2 基于aiSim插件的Unreal Engine地圖編輯

2、魚眼相機配置與參數設置

設置前、后、左、右四個魚眼相機,分別具備:

(1)高水平FOV(約180°);

(2)不同俯仰角(前15°、后25°、側向40°);

(3)安裝位置貼近真實車輛安裝場景(如后視鏡下方)。

我們采用了仿真器內置的OpenCV標準內參建模,輸出圖像同步生成物體的2D/3D邊界框與語義標簽。

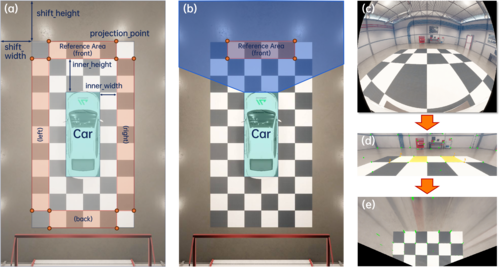

圖3 環視OpenCV魚眼相機傳感器配置

3、BEV圖像生成與AVM拼接

利用已知相機內參和標定區域結構,通過OpenCV完成圖像去畸變與投影矩陣求解,逐方向生成BEV視圖(Bird's Eye View)。結合車輛圖層與坐標對齊規則,拼接生成完整的AVM圖像。

支持配置圖像分辨率(如1cm2/像素)與投影視野范圍,確保幾何準確性。

圖4 投影區域及BEV轉化示意圖

4、多場景合成與傳感器布局優化

通過批量仿真腳本,可快速測試不同環境(如夜間、窄巷、地庫)、不同相機布局組合對AVM系統效果的影響。在算法不變的前提下,系統性評估外參配置的優劣,為傳感器部署提供數據支持。

圖5 不同場景下的AVM合成數據

三、合成數據構建多模態數據集

隨著智能駕駛逐步從基礎輔助走向復雜場景下的高階功能,對感知系統的數據需求也在迅速升級。不僅需要覆蓋高速、城區、出入口等典型 NOA 場景,還要求在不同模態之間實現精確對齊,以支撐融合感知模型的訓練與驗證。在這類任務中,仿真生成的合成數據具備可控性強、標簽精準、格式標準的優勢,正在成為算法開發的重要支撐手段。

在智能領航輔助(NOA)場景中,系統需識別高速匝道、變道車輛、道路邊緣等要素,對訓練數據多樣性與標注精度要求極高。通過仿真構建城市快速路、高速公路等多類 NOA 場景,配合光照、天氣、車流密度等變量自動生成圖像與多模態同步數據。這類合成數據可用于訓練檢測、分割、追蹤等模型模塊,特別適合用于填補實車采集難以覆蓋的復雜或高風險場景,增強模型魯棒性。

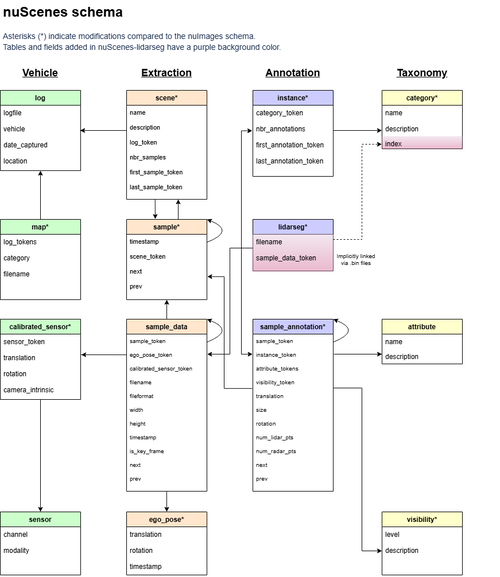

融合感知模型依賴相機、毫米波雷達、激光雷達等多種傳感器協同輸入,對數據的同步性和一致性要求較高。通過仿真,可以同時生成這三類傳感器的視角數據,并自動對齊時間戳、坐標系和標注信息,輸出包括 3D 邊界框、語義分割、目標速度等在內的完整標簽,且格式兼容 nuScenes 等主流標準。這類數據可用于訓練融合模型識別道路上的異形障礙物,例如夜間難以通過視覺識別的散落雜物,或需要多模態補強感知的邊緣目標。仿真帶來的高度可控性也便于統一測試條件,對模型性能進行定量分析與精細化調優。

在實際項目中,合成數據的價值不僅體現在生成效率和標注精度,更在于其能否與下游算法開發流程無縫銜接。為了實現這一目標,我們將 aiSim 導出的多模態原始數據,通過自研數據處理腳本,轉換為基本符合 nuScenes 標準格式的數據集。

數據構建流程如下:

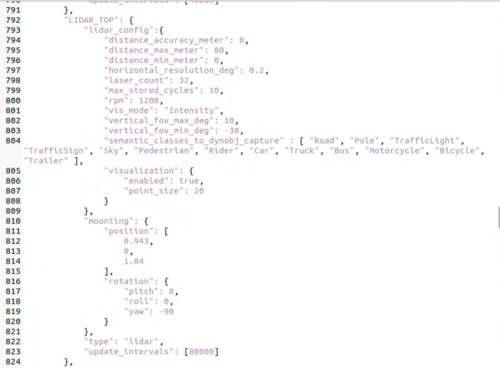

1、編寫符合 nuScenes 規范的傳感器配置文件

首先,我們根據 nuScenes 的數據結構要求,定義并生成了包含相機、雷達、激光雷達等傳感器的配置文件,包括傳感器類型、安裝位置、外參信息等。該步驟確保生成數據可直接映射至 nuScenes 的calibrated_sensor.json和sensor.json。

圖6 激光雷達部分的傳感器配置文件

圖7 符合nuScenes格式的傳感器配置

2、利用 aiSim Stepped 模式導出對齊的原始數據

其次,在仿真階段,我們啟用了仿真器的 Stepped Simulation 模式,該模式支持以固定時間步長(如每 0.1 秒)推進仿真,并確保所有傳感器在同一時間戳輸出數據。這種方式實現了多模態數據的時間戳全局對齊,滿足 nuScenes 對數據同步的要求。

圖8 aiSim相機傳感器Bounding Box真值輸出

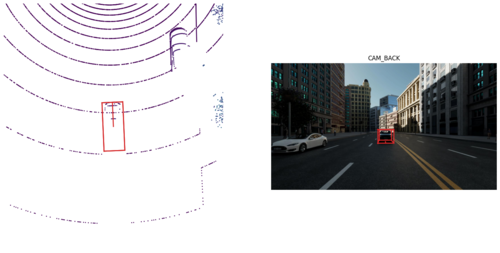

然后,在仿真運行中,我們導出包含圖像、點云、雷達、Ego Pose、2D/3D 標注等原始數據,場景長度約為 20 秒,覆蓋了一段在高流量城市交通中經過十字路口的場景,作為構建示例數據集的基礎。

3、結構化轉換為 nuScenes JSON 格式

此外,使用自研轉換腳本,我們將導出的原始數據組織并填充為 nuScenes 所需的各類JSON 文件,并和官方標準格式對齊,包括:

scene.json:記錄場景序列;

sample.json:定義幀級時間結構;

sample_data.json:圖像、雷達、點云等數據路徑與時間戳;

calibrated_sensor.json和sensor.json:傳感器類型及配置;

ego_pose.json:車輛軌跡;

sample_annotation.json:3D 邊界框、類別、屬性;

instance.json、category.json、visibility.json等其他語義層級數據。

圖9 nuScenes 標準數據集JSON結構表

4、數據集結構搭建完成

最終,構建完成的數據集具備完整的時空同步結構與語義標簽,可直接用于視覺感知、雷達檢測、融合感知等模型訓練與評估任務。該流程驗證了合成數據向標準訓練數據的轉換路徑,并具備可擴展性,適用于更大規模的批量數據生成。

圖10 激光雷達點云 + 相機融合標注框

圖11 激光雷達點云 + 同類型標注框 (俯視/側視)

圖12 多幀實例+激光雷達點云 (俯視+路徑)

這一完整流程不僅驗證了合成數據在工程流程中的落地能力,也為后續基于大規模仿真生成標準訓練集打下了結構基礎。

四、aiSim:感知研發全流程平臺

在自動駕駛感知系統的開發過程中,仿真平臺已逐漸發展為合成數據生產的重要基礎設施。aiSim通過集成環境建模、傳感器仿真、多模態數據輸出與標準格式轉換等功能,支持從場景構建到數據集生成的完整流程。

1、多樣場景與數據格式的靈活支持

aiSim 可精細還原環視系統中魚眼相機的安裝布局、圖像畸變特性及 BEV 視角拼接邏輯,生成貼近實車采集的高保真圖像。同時,平臺有一套自成體系的仿真數據組織與輸出機制,涵蓋視覺、激光雷達、毫米波雷達等多類型傳感器數據及真值標注。支持通過腳本調度自動批量生成不同氣候、光照、地形和交通條件下的多樣化場景,滿足大規模訓練與邊緣場景驗證的需求。

2、從物理建模到標簽輸出的完整鏈條

借助圖形引擎,aiSim 實現了對真實物理光照、材質、陰影和天氣的動態建模。平臺支持相機、激光雷達、毫米波雷達等傳感器的物理與幾何特性建模,兼容 OpenCV、ROS 等常見開發標準。在數據輸出方面,aiSim支持多傳感器同步控制,可自動生成對齊的 2D/3D 檢測框、語義標簽、Ego 軌跡等數據,覆蓋感知算法訓練常見需求,減少數據清洗與后處理工作量。

3、工程集成與可擴展性

aiSim 提供圖形界面、工具鏈與開放 API,方便用戶將其集成至企業現有的數據平臺和模型訓練流程中。平臺內的場景配置與資源系統具備良好的可擴展性,支持用戶自定義傳感器布設、交通要素和場景資產,用于支持環視系統、感知模型、融合算法等不同研發階段的需求。

無論是環視系統的泊車能力與虛擬標定,還是面向NOA 和多模態融合的訓練任務,仿真生成的數據都在感知系統的實際落地中提供了可衡量、可擴展的價值。讓數據獲取從“拍”到“造”,從“靠人”到“自動”,為智能駕駛研發提速、降本、增穩。

-

數據

+關注

關注

8文章

7239瀏覽量

90989 -

算法

+關注

關注

23文章

4698瀏覽量

94719 -

仿真

+關注

關注

51文章

4234瀏覽量

135294 -

標定

+關注

關注

0文章

17瀏覽量

7594 -

汽車

+關注

關注

14文章

3794瀏覽量

39211

發布評論請先 登錄

技術分享 | AVM合成數據仿真驗證方案

FRAM實現更快速的數據存儲

利用合成數據和NVIDIA ISAAC Sim加速機器人訓練

技術分享 | 高逼真合成數據助力智駕“看得更準、學得更快”

技術分享 | 高逼真合成數據助力智駕“看得更準、學得更快”

評論