摘要

近年來,從結(jié)構(gòu)化數(shù)據(jù)生成文本的方法有了長足的進步,這主要歸功于在大型數(shù)據(jù)集上對預(yù)先訓(xùn)練好的語言模型進行微調(diào)。然而,這些模型可能無法生成忠實于輸入數(shù)據(jù)的輸出結(jié)果,尤其是在域外數(shù)據(jù)上。對于特定領(lǐng)域來說,通常無法獲得足夠的注釋數(shù)據(jù),因此本文需要尋求一種無監(jiān)督的方法來提高輸出文本的忠實性。

由于問題的根本在于結(jié)構(gòu)化數(shù)據(jù)和文本表征之間的一致性,本文在這項工作中評估了循環(huán)訓(xùn)練的有效性。循環(huán)訓(xùn)練使用兩個互為逆變的模型:一個模型從結(jié)構(gòu)化數(shù)據(jù)生成文本,另一個模型從自然語言文本生成結(jié)構(gòu)化數(shù)據(jù)。本文的研究表明,在 WebNLG、E2E、WTQ 和 WSQL 數(shù)據(jù)集的數(shù)據(jù)到文本生成任務(wù)中,循環(huán)訓(xùn)練在使用少量監(jiān)督數(shù)據(jù)(在本文的案例中為 100 個樣本)進行初始化時,可獲得與完全監(jiān)督方法幾乎相同的性能。

本文利用自動評估指標和新設(shè)計的人工評估模式進行了廣泛的實證分析,以揭示不同循環(huán)訓(xùn)練策略在減少各類生成錯誤方面的有效性。

引言

大量信息(如電影信息數(shù)據(jù)庫或產(chǎn)品目錄)以結(jié)構(gòu)化知識的形式存在,為了充分利用這些數(shù)據(jù)到各種任務(wù)中,本文希望將這些信息闡述化。現(xiàn)階段有研究人員利用免費公開的數(shù)據(jù)來解決這種數(shù)據(jù)到文本的生成任務(wù)。然而,仍然存在兩大挑戰(zhàn)。

1 要實現(xiàn)良好的性能,所需的訓(xùn)練數(shù)據(jù)量非常大,尤其是在現(xiàn)有語料庫不能包含的領(lǐng)域。

2 從結(jié)構(gòu)化數(shù)據(jù)中自然語言生成(NLG)往往會產(chǎn)生多種錯誤,從而限制了這些模型在面向客戶的應(yīng)用中的實用性。當NLG 模型在生成的輸出文本時注入與輸入結(jié)構(gòu)化數(shù)據(jù)無關(guān)的無意義詞語或信息就會產(chǎn)生幻覺。

為了在數(shù)據(jù)轉(zhuǎn)文本的過程中解決這些問題,一般有兩條研究思路:

1 設(shè)計能直接生成更忠實于輸入數(shù)據(jù)的輸出的模型。

2 設(shè)計在輸出文本生成后檢測并糾正事實錯誤或幻覺的模型。

針對這兩種情況,先前的研究一般都假定有足夠多的結(jié)構(gòu)化數(shù)據(jù)和文本對作為訓(xùn)練數(shù)據(jù),從而在任務(wù)中達到相持與人類水平的性能。由于它們一般都是在 100,000 個或更多實例的大型語料庫中訓(xùn)練出來的,雖然在域內(nèi)數(shù)據(jù),事實驗證模型可以達到很高的性能,卻在域外數(shù)據(jù)上下降,這對事實驗證模型來說是一個很大的限制。同樣,像 WebNLG 這樣的語料庫包含約 20,000 個示例;這可能太小,即使在完全監(jiān)督下也無法達到人類性能,但其規(guī)模足以使生成 WebNLG 規(guī)模的特定領(lǐng)域語料。盡管存在上述事實,但很少有為數(shù)據(jù)到文本和表到文本任務(wù)模型針對數(shù)據(jù)和相應(yīng)文本之間的一致性出發(fā)而開發(fā)模型。

本文從克服缺乏訓(xùn)練數(shù)據(jù)(尤其是域外數(shù)據(jù))和結(jié)構(gòu)化數(shù)據(jù)與文本之間需要一致性兩方面出發(fā),采用了循環(huán)訓(xùn)練法。主要思想為:用主謂賓三元組形式的無配對數(shù)據(jù) D 和不一定來自同一領(lǐng)域文本 T。還用一小組(100 個樣本)配對數(shù)據(jù)Dpr和文本Tpr,用來循環(huán)訓(xùn)練兩個反復(fù)訓(xùn)練的模型(正向模型 F:D → T,反向模型 R:T → D)。訓(xùn)練是無監(jiān)督的,即凍結(jié)一個模型,用它來解碼一組輸入,用來訓(xùn)練另一個模型,之后用新的模型反向預(yù)測第一個模型輸入。具體來說,在一個循環(huán)中,本文凍結(jié) F,并通過將輸入 D 重構(gòu)為 R(F(D))來訓(xùn)練 R。一個訓(xùn)練周期后,本文將兩個模型的角色互換。值得注意的是,正如本文將要展示的那樣,即使最初的模型很差,也能收斂到接近監(jiān)督性能的模型。此外,本文還證明,即使配對數(shù)據(jù)很少或根本沒有,這一過程也能確保輸出文本忠實于輸入數(shù)據(jù),反之亦然。

此外,本文還詳細研究循環(huán)訓(xùn)練的有效條件,重點關(guān)注領(lǐng)域以及訓(xùn)練文本和結(jié)構(gòu)化數(shù)據(jù)的性質(zhì)。發(fā)現(xiàn),無監(jiān)督循環(huán)訓(xùn)練的效果優(yōu)于低資源微調(diào)模型,而且在使用少量注釋數(shù)據(jù)進行初始化和后期調(diào)整時,可以達到接近完全監(jiān)督的效果。

本文主要貢獻:

1、僅使用一個預(yù)先訓(xùn)練的語言模型 T5,就成功地將循環(huán)訓(xùn)練應(yīng)用于數(shù)據(jù)到文本和文本到數(shù)據(jù)模型,而無需使用圖方法或其他輔助模型。

2、證明了循環(huán)訓(xùn)練在某些領(lǐng)域的性能幾乎與監(jiān)督模型相同。

3、對循環(huán)訓(xùn)練效果良好的條件以及不同類型生成錯誤下數(shù)據(jù)到文本的忠實性進行了廣泛的實證分析。

4、設(shè)計了一種新穎的基于計數(shù)和排名的注釋模式,以便從正確性、忠實性、數(shù)據(jù)覆蓋率和流暢性等角度更全面地評估生成文本的忠實性。本文采用的方案在客觀性、一致性、精確性和易評估性方面改進了WebNLG 2020 挑戰(zhàn)賽使用的基于評級的方案。

相關(guān)研究

與以往研究主要由維基百科等通用來源的數(shù)據(jù)為基礎(chǔ),模型已在大規(guī)模表對文語料庫上進行了訓(xùn)練,以執(zhí)行事實驗證。然而,這些模型在它們沒有訓(xùn)練過的特定領(lǐng)域的表現(xiàn)可能不理想。有些研究嘗試使用 GPT-3 來增加訓(xùn)練數(shù)據(jù),而另一些則使用信息檢索系統(tǒng)來建立生成原型。本文直接利用了目標語料庫的未配對基礎(chǔ)數(shù)據(jù)和文本,而無需借助任何額外的信息檢索或生成系統(tǒng)。此外,以往研究數(shù)據(jù)到文本的任務(wù)主要是通過 BLEU或 METEOR等單詞或語法級別的自動指標進行評估,對忠實度的評估很少(而且大多是主觀的)。本文中設(shè)計了一種新穎的評估模式來對生成文本對輸入數(shù)據(jù)的忠實度進行更全面的評估。

循環(huán)訓(xùn)練依賴于兩個模型,這兩個模型本質(zhì)上是彼此的逆變換,用于創(chuàng)建 “循環(huán)”,其返回的輸出應(yīng)與給定的輸入完全相同。循環(huán)訓(xùn)練有兩種不同的形式。第一種形式旨在學(xué)習(xí)從一種輸入形式轉(zhuǎn)換到另一種輸入形式。另一種形式是使用 “周期一致性損失 ”作為其他任務(wù)的輔助損失。在這項工作中,作者只使用循環(huán)一致性進行訓(xùn)練。在一個文本到文本的應(yīng)用中,有研究用類似的無監(jiān)督方法進行雙向文本轉(zhuǎn)換,將關(guān)鍵詞搜索查詢轉(zhuǎn)換為自然語言問題。在沒有大量注釋文本的情況下,它也被用于命名實體識別。在這種情況下,一個模型提取實體,反向模型根據(jù)這些實體創(chuàng)建文本。這種方法的局限性在于,有許多方法可以實現(xiàn)具有相同實體的句子。

WebNLG 數(shù)據(jù)集上的數(shù)據(jù)到文本生成而開發(fā)的 CycleGT 模型明確提出數(shù)據(jù)到文本生成任務(wù)的一致性要求。不過,CycleGT 依靠已有的 NER 模型從輸出文本中提取實體。然后,訓(xùn)練一個反向模型來預(yù)測實體和謂詞之間的聯(lián)系。如果實體未被他們的NER 系統(tǒng)識別,將影響珍整體模型的性能。原則上,可以像 CycleNER那樣,利用循環(huán)訓(xùn)練建立一個單獨的NER模型,但 CycleGT 的作者并沒有這樣做。而循環(huán)訓(xùn)練的一個主要優(yōu)點是無需依賴任何監(jiān)督,而是主要或完全依賴輸入和輸出的自一致性,在本工作中,作者設(shè)計了一種簡單的方法,使用預(yù)先訓(xùn)練好的語言生成模型,針對數(shù)據(jù)到文本和文本到數(shù)據(jù)的生成循環(huán)進行微調(diào)。

方法及骨干模型

循環(huán)訓(xùn)練的前提是有兩個互逆模型。根據(jù) WebNLG2020 挑戰(zhàn)賽,本文采用了性能明顯較強的 T5 模型,作為正向生成(F: D→T,執(zhí)行 RDF 到文本的生成)和反向生成(R : T → D,執(zhí)行文本到 RDF 的生成)的骨干模型。將每個樣本的 RDF 三元組線性化為序列 d,分別用 [S]、[P] 和 [O] 標記表示每個三元組的主語、謂語和賓語。因此,RDF 到文本和文本到 RDF 都可以作為序列到序列生成任務(wù)來處理和訓(xùn)練。

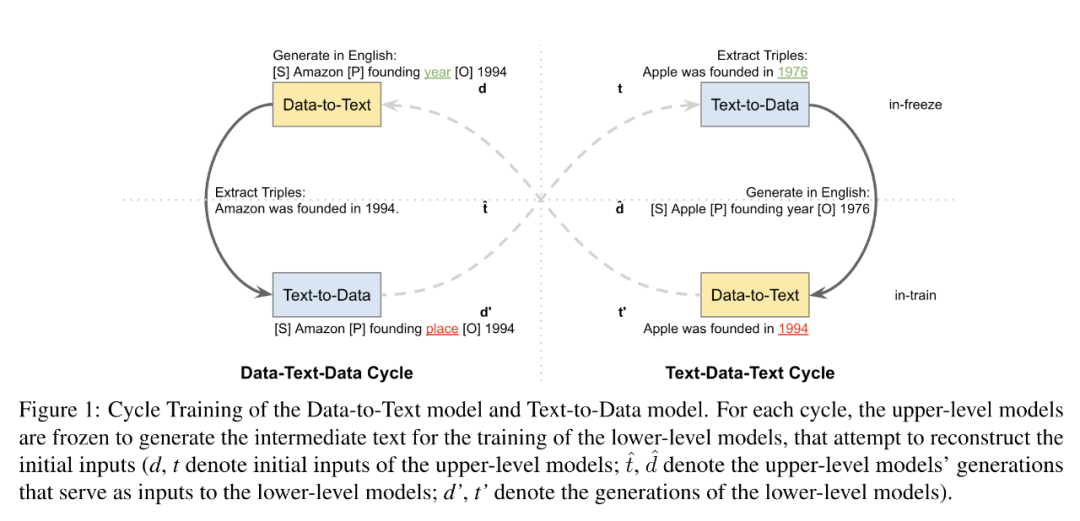

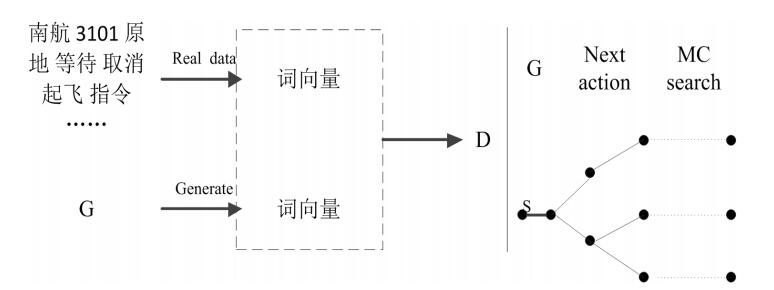

本文應(yīng)用迭代回譯可以增強各種 NLP任務(wù)的循環(huán)一致性的思想來迭代循環(huán)訓(xùn)練模型。這包括強制數(shù)據(jù)自洽的數(shù)據(jù)-文本-數(shù)據(jù) (DTD) 循環(huán)和文本-數(shù)據(jù)-文本 (TDT) 循環(huán)。如圖 1 所示,對于 DTD 循環(huán),數(shù)據(jù)到文本模型將線性化三元組 d 作為輸入并生成關(guān)聯(lián)的中間文本 。接下來,訓(xùn)練文本到數(shù)據(jù)模型,目標是使用提供的 重建 d。重建損失 Ld′ 是平均負對數(shù)似然,如下所示,其中 di 表示序列 t 的第 i 個標記,|d|是序列長度:

用相反的方式,對 TDT 循環(huán),文本到數(shù)據(jù)模型首先將文本 t 作為輸入并生成關(guān)聯(lián)的線性化三元組 。接下來,訓(xùn)練文本到數(shù)據(jù)模型,目標是使用提供的 重建 t。重建損失 是平均負對數(shù)似然,如下所示,其中 表示序列 t 的第 i 個標記,|t|是序列長度:

由于生成離散中間輸出標記的過程是無差別的,重構(gòu)損失只能通過每個循環(huán)的第二個模型傳播,即DTD 循環(huán)的文本到數(shù)據(jù)模型和 TDT 循環(huán)的數(shù)據(jù)到文本模型。因此,兩個模型的訓(xùn)練只能通過 TDT 循環(huán)和 DTD 循環(huán)的交替進行,這樣兩個模型的性能才能逐步提高。

實驗設(shè)置

本文在現(xiàn)有的數(shù)據(jù)源上進行實了驗,這些數(shù)據(jù)源已注釋了成對的數(shù)據(jù)三元組和參考文本。其中英語數(shù)據(jù)使用來自WebNLG 3.0 版本的WebNLG+ 2020 挑戰(zhàn)賽。為了更好地促進在不同領(lǐng)域的實驗和評估,分別利用 DART 的 E2E、WTQ 和 WSQL 的人工注釋部分。為了按照 WebNLG 的格式調(diào)整數(shù)據(jù),還刪除了一些包含非常規(guī)結(jié)構(gòu)標簽的 WSQL 和 WTQ 示例。

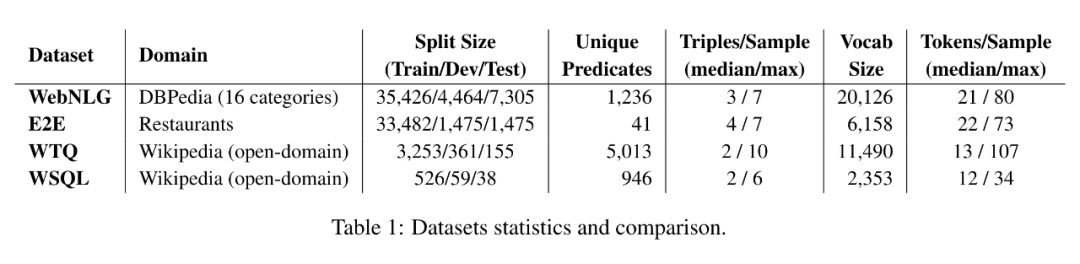

表1顯示了該文詳細的數(shù)據(jù)集統(tǒng)計數(shù)據(jù)。在使用這些數(shù)據(jù)進行循環(huán)訓(xùn)練時,本文沿用了之前的工作方法,將所有配對樣本拆分為一個獨立的洗碼文本語料庫和另一個獨立的洗碼三元組語料庫。如圖 1 所示:

微調(diào)大型預(yù)訓(xùn)練模型已被證明在眾多任務(wù)中表現(xiàn)很出色的性能。在這項工作中,詳細介紹并運用完全監(jiān)督下的微調(diào)、低資源微調(diào)及額外的預(yù)訓(xùn)練進行低資源微調(diào)三個基線微調(diào)策略。還探索了無監(jiān)督循環(huán)訓(xùn)練和低資源循環(huán)訓(xùn)練兩種不同的訓(xùn)練策略,評估不同數(shù)據(jù)約束下循環(huán)訓(xùn)練的有效性和通用性。為了憑經(jīng)驗評估“文本語料庫和數(shù)據(jù)語料庫的潛在內(nèi)容或?qū)嶓w分布必須具有某種不確定程度的重疊才能使循環(huán)訓(xùn)練方法發(fā)揮作用”這個先決條件,本文在不同匹配級別應(yīng)用相同大小的文本和數(shù)據(jù)語料庫的無監(jiān)督循環(huán)訓(xùn)練以作為潛在內(nèi)容或?qū)嶓w分布重疊的粗略近似。具體來說,隨機選擇一半的 WebNLG 三元組作為數(shù)據(jù)語料庫。針對性地選擇五個大小相等的文本語料庫,其中包含0%、25%、50%、75%和100%的原始相關(guān)參考文本,并分別補充包括100%、75%、50%、25%、0%的不相關(guān)參考文本。

本文選擇了T5-base模型作為基線,具有線性權(quán)重衰減的 AdamW 作為優(yōu)化器,最大輸入長度設(shè)為256,Learningrate設(shè)為3e-4,batchisze設(shè)為了256,共訓(xùn)練了50輪。

實驗結(jié)果和討論

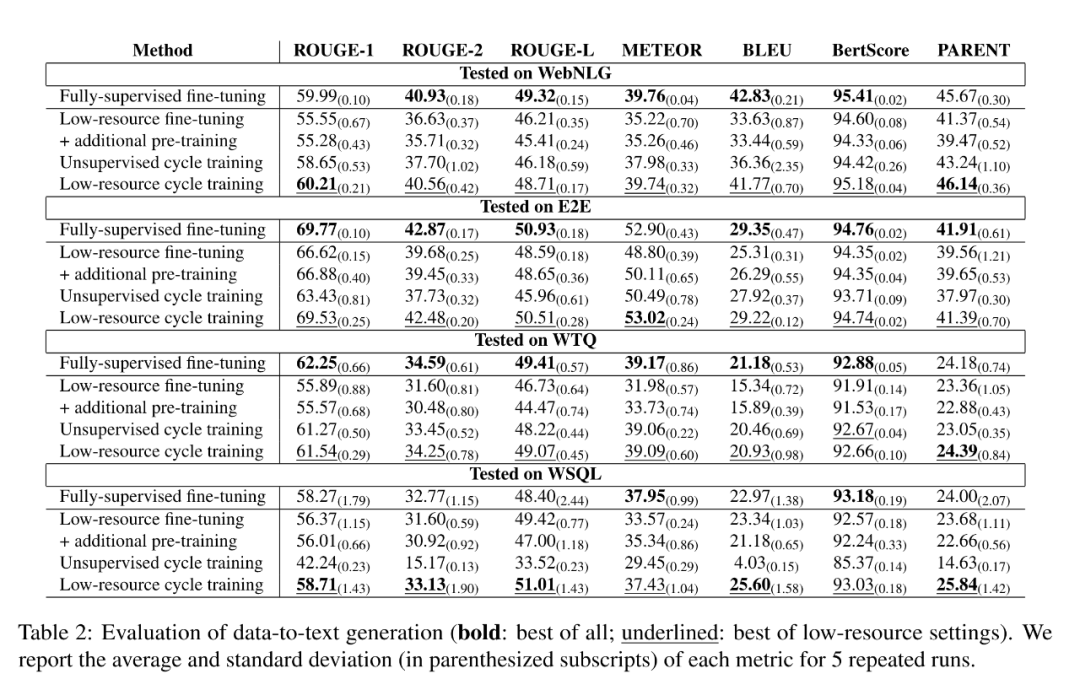

本文使用自動評價和人工評價兩種方法對使用的策略進行了評估。使用ROUGE、 BLEU、 METEOR、BertScore和PARENT五個廣泛使用的自動評估指標來評估每個策略,這些指標從字符的匹配、語義相似性和忠實度三個方面衡量生成的質(zhì)量。表 2 顯示了多種數(shù)據(jù)到文本生成方法在不同設(shè)置下的性能。發(fā)現(xiàn),無監(jiān)督循環(huán)訓(xùn)練法的性能普遍低于全監(jiān)督微調(diào)法。與低資源微調(diào)方法相比,它在 WebNLG 和 WTQ 上的得分較高,但在 E2E 和 WSQL 上的表現(xiàn)較差,其中在 WSQL 上的性能差距更大。作者將這種差異歸因于獨特謂詞和詞匯量的不同。通過接觸更多不同的文本和結(jié)構(gòu)化數(shù)據(jù),以及通過逐步學(xué)習(xí)不同的數(shù)據(jù)-文本關(guān)聯(lián)的能力,循環(huán)訓(xùn)練應(yīng)該能夠提高模型的泛化能力和魯棒性。對于 E2E 和 WSQL 這樣的數(shù)據(jù)集來說,它們的詞匯量和獨特謂詞的數(shù)量都較少,這意味著少量的注釋樣本就可能涵蓋數(shù)據(jù)集的大量潛在變化。這成就了強大的低資源微調(diào)性能,與相應(yīng)的完全監(jiān)督的方法只有很小的性能差距,并掩蓋了無監(jiān)督的循環(huán)訓(xùn)練方法。

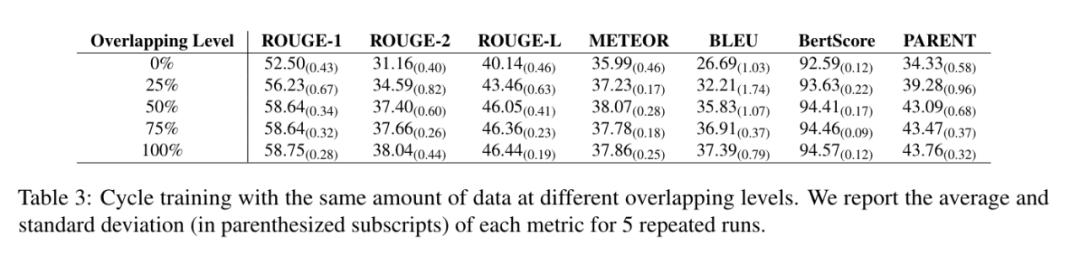

無論如何,當有少量注釋數(shù)據(jù)可用于初始化循環(huán)訓(xùn)練時,低資源循環(huán)訓(xùn)練策略顯著提高了生成性能,超過了低資源微調(diào)方法,并達到了與完全監(jiān)督方法堪比的性能。這種改進在所有四個數(shù)據(jù)集和五種評估指標中都是一致的。值得注意的是,當應(yīng)用于多領(lǐng)域和開放域數(shù)據(jù)集(WebNLG、WTQ 和 WSQL)時,與完全監(jiān)督的相比,低資源循環(huán)訓(xùn)練生成的文本對輸入數(shù)據(jù)具有更好的忠實度(從 PARENT 分數(shù)可以明顯看出)。與采用額外預(yù)訓(xùn)練的設(shè)置相比,循環(huán)訓(xùn)練的作用顯然不僅僅是提高生成目標域標記的概率。至于使用不同重疊度的無配對數(shù)據(jù)集進行循環(huán)訓(xùn)練的實驗,表 3 中的結(jié)果顯示,隨著重疊度的增加,性能在開始時急劇上升,然后在重疊度達到 50%左右時趨于平穩(wěn)。這表明,在規(guī)模相同的情況下,用于循環(huán)訓(xùn)練的未配對數(shù)據(jù)語料庫和文本語料庫至少需要有 50%的實體(或者說潛在信息)重疊,才能達到理想的性能水平。作者認為 50% 是一個合理的水平,因為許多相關(guān)但未配對的文本和結(jié)構(gòu)化數(shù)據(jù)可能具有更高的信息重疊。我們認為低資源循環(huán)訓(xùn)練是一種普遍適用的方法,它能以最少的人力從大量未配對的結(jié)構(gòu)化數(shù)據(jù)和文本中有效地學(xué)習(xí)。

為了定量比較生成文本的正確性、忠實性、數(shù)據(jù)覆蓋率和流暢性,作者開發(fā)了新的基于計數(shù)和排名的注釋模式,采用事實錯誤計數(shù) (FE)、幻覺錯誤計數(shù) (HE)、信息丟失計數(shù) (IM)和流暢性偏好 (FP)并用來進行人工評估。與 WebNLG 2020 挑戰(zhàn)賽使用的基于 0-100 評分的模式相比,本文使用的模式具有更好的客觀性、一致性和精確性。人工評估表明,低資源循環(huán)訓(xùn)練持續(xù)減少事實錯誤、幻覺錯誤和信息遺漏。人工評估表明,低資源循環(huán)訓(xùn)練可以持續(xù)減少事實錯誤、幻覺錯誤和信息遺漏。當循環(huán)訓(xùn)練應(yīng)用于底層關(guān)系和表面實現(xiàn)變化較多的數(shù)據(jù)集時,其性能會有較大提升。人類對錯誤和信息覆蓋率的評價與 PARENT 分數(shù)的相關(guān)性更好,這證實了 PARENT 衡量忠實性的能力。從結(jié)果中還可以看出,所有三種被評估的數(shù)據(jù)到文本生成模型都更容易出現(xiàn)幻覺錯誤,而不是事實錯誤,這就要求我們在今后的工作中更加努力地減少幻覺錯誤。在生成文本的流暢性方面,低資源循環(huán)訓(xùn)練比低資源微調(diào)方法有所改進,但仍無法持續(xù)擊敗完全監(jiān)督方法。

結(jié)論

在這項工作中,作者將循環(huán)訓(xùn)練應(yīng)用在數(shù)據(jù)到文本生成任務(wù)當中。系統(tǒng)地研究了跨不同領(lǐng)域的循環(huán)訓(xùn)練的有效性,以及循環(huán)前微調(diào)在資源匱乏環(huán)境中的應(yīng)用。表明,本文使用的方法大大提高了低資源環(huán)境中數(shù)據(jù)到文本的生成性能,與完全監(jiān)督的模型相比,實現(xiàn)了有競爭力的性能,并且還通過減少事實錯誤、幻覺和信息遺漏提高了生成文本的忠實度,即使與完全監(jiān)督的方法相比也是如此。此外還設(shè)計了一種對數(shù)據(jù)到文本生成進行有效人類評估的模式,該模式改進了之前的工作并鼓勵對忠實度進行更客觀和一致的審查。

本方法局限性

作者認識到,本文的注釋和分析方法可能需要大量的人力,這可能會限制可以收集的注釋數(shù)據(jù)量。此外,盡管循環(huán)訓(xùn)練被普遍認為是一種與模型無關(guān)的方法,但由于資源限制,無法測試各種骨干模型。此外,盡管本文放寬了實體約束并對數(shù)據(jù)到文本生成進行端到端的循環(huán)訓(xùn)練,但不可微性問題仍未解決。假設(shè)每個周期的第一個模型生成的中間輸出是正確是一個弱假設(shè),可能會將誤導(dǎo)性的訓(xùn)練信號傳播到每個周期的第二個模型,特別是在訓(xùn)練的早期階段。

-

數(shù)據(jù)庫

+關(guān)注

關(guān)注

7文章

3900瀏覽量

65728 -

模型

+關(guān)注

關(guān)注

1文章

3480瀏覽量

49947 -

語言模型

+關(guān)注

關(guān)注

0文章

558瀏覽量

10655 -

自然語言

+關(guān)注

關(guān)注

1文章

291瀏覽量

13594

原文標題:通過循環(huán)訓(xùn)練實現(xiàn)忠實的低資源數(shù)據(jù)文本生成

文章出處:【微信號:zenRRan,微信公眾號:深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

我用labview調(diào)用matlab腳本,想保存matlab腳本生成的數(shù)據(jù)向量,怎么實現(xiàn)?

如何構(gòu)建文本生成器?如何實現(xiàn)馬爾可夫鏈以實現(xiàn)更快的預(yù)測模型

循環(huán)神經(jīng)網(wǎng)絡(luò)卷積神經(jīng)網(wǎng)絡(luò)注意力文本生成變換器編碼器序列表征

基于生成對抗網(wǎng)絡(luò)GAN模型的陸空通話文本生成系統(tǒng)設(shè)計

基于生成器的圖像分類對抗樣本生成模型

文本生成任務(wù)中引入編輯方法的文本生成

受控文本生成模型的一般架構(gòu)及故事生成任務(wù)等方面的具體應(yīng)用

基于GPT-2進行文本生成

基于用于自然語言生成的“語境調(diào)優(yōu)”技術(shù)

基于VQVAE的長文本生成 利用離散code來建模文本篇章結(jié)構(gòu)的方法

ELMER: 高效強大的非自回歸預(yù)訓(xùn)練文本生成模型

ETH提出RecurrentGPT實現(xiàn)交互式超長文本生成

面向結(jié)構(gòu)化數(shù)據(jù)的文本生成技術(shù)研究

通過循環(huán)訓(xùn)練實現(xiàn)忠實的低資源數(shù)據(jù)文本生成

通過循環(huán)訓(xùn)練實現(xiàn)忠實的低資源數(shù)據(jù)文本生成

評論