Meta 公司稱,這款模型在文生圖方面的表現(xiàn),達到了業(yè)界最高水平。 Meta 開發(fā)出文生圖模型CM3Leon

近日,Meta 公司宣布開發(fā)出一款名為 CM3Leon(發(fā)音類似「chameleon」)的文生圖模型,該模型能夠獨力解決文本到圖像和圖像到文本的雙向生成任務。

Meta 表示:“在打造高質量生成模型的探索之路上,我們相信 CM3leon 在各類任務中的強大性能,正是邁向高保真度圖像生成與理解的重要一步。像 CM3leon 這樣的模型終將成為元宇宙中的創(chuàng)造力源泉與應用成果,我們也期待繼續(xù)突破多模態(tài)語言模型的新疆界、未來將更多優(yōu)秀模型呈現(xiàn)在大家面前。”

據(jù)介紹,CM3leon 是首個使用純文本語言模型配方改編和訓練而成的多模態(tài)模型,并經(jīng)歷了大規(guī)模檢索增強預訓練和隨后的多任務監(jiān)督微調(SFT)階段。與 Stable Diffusion、DALL-E、Midjourney 等文生圖模型依賴于擴散(diffusion)模型技術不同,CM3Leon 采用了基于 token 的自回歸模型方法。

Meta 表示,盡管訓練時的計算量僅相當于以往基于 Transformer 方法的五分之一,但 CM3leon 在文本到圖像的生成方面還是獲得了同類領先的性能。CM3leon 既具備自回歸模型的功能多樣性和有效性,也保持著較低的訓練成本和良好的推理效率。作為一套因果掩碼混合模態(tài)(CM3)模型,它能夠以其他圖像和文本內容的任意序列為條件,生成相應的文本與圖像序列。這極大擴展了以往大模型只能從文本到圖像、或者只能從圖像到文本的功能局限。

一般來講,純文本生成模型往往會針對各類不同任務進行多任務指令調整,借此增強其遵循指令提示的能力;而圖像生成模型則更多適配特定任務。Meta 將大規(guī)模多任務指令調節(jié)運用到 CM3leon 的圖像和文本生成當中,事實證明能夠顯著提高圖像標題生成、視覺問答、基于文本的圖像編輯和按條件生成圖像等能力。這也成為強有力的實例,證明為純文本模型開放的擴展配方也能直接推廣到基于 token 化的圖像生成模型當中。

Meta 稱,與目前廣泛使用的圖像生成基準(零樣本 MS-COCO)進行性能比較時,CM3leon 獲得了 4.88 的 FID(Fréchet Inception Distance,一種用于計算真實圖像與生成圖像間特征向量距離的指標,F(xiàn)ID 值越小則相似度越高,最好為 0),超越谷歌的文本到圖像模型 Parti,證明了自身技術的先進性。

此外,CM3leon 還表現(xiàn)出令人印象深刻的復雜組合對象生成能力。CM3leon 在各類視覺語言任務中均表現(xiàn)良好,包括視覺問答和生成長格式標題。由于訓練數(shù)據(jù)集僅包含 30 億文本 token,因此 CM3leon 的零樣本性能也超越了由更廣泛數(shù)據(jù)集訓練而成的、體量更大的其他模型。

CM3leon 是如何打造出來的?

據(jù)介紹,CM3leon 架構采用的是類似基于文本類模型、已經(jīng)成熟的純解碼器 Transformer。但它的獨特之處,在于能夠同時輸入和生成文本加圖像。正是憑借這種能力,CM3leon 才得以成功解決前文提到的各項任務。

訓練方面,Meta 表示,通過一系列努力,CM3leon 的訓練檢索得到了增強,大大提高了模型成果的效率和可控性。此外,Meta 還根據(jù)各種不同圖像和文本生成任務對模型進行了指令微調。

隨著 AI 行業(yè)的不斷發(fā)展,像 CM3leon 這樣的生成模型正變得越來越復雜。這些模型通過數(shù)百萬的示例圖像接受訓練,學習視覺效果與文本之間的關系,但同時也可能反映訓練數(shù)據(jù)集中存在的偏差 / 偏見。Meta 稱,目前 AI 行業(yè)仍處于理解和應對這些挑戰(zhàn)的早期階段,提升透明度才是加速解決這些問題的關鍵。

Meta 使用許可數(shù)據(jù)集作為 CM3leon 的訓練素材。在預訓練階段,Meta 使用了數(shù)百萬張來自 Shutterstock 的授權圖片,有著高達 70 億個參數(shù),這也達到了 OpenAI EALL-E2 模型的兩倍以上。

Meta 方面表示:“在文本到圖像生成領域,圖像數(shù)據(jù)來源的道德影響已經(jīng)引發(fā)了廣泛的討論。在這一研究中,我們只使用 Shutterstock 上的經(jīng)過授權的圖像,因此可以避免與圖像所有權和歸屬相關的擔憂,同時不會犧牲性能。”

事實證明,即使使用與先前所有模型的訓練數(shù)據(jù)都截然不同的數(shù)據(jù)分布,仍可實現(xiàn)強大的性能。通過全工作流程的透明展示,Meta 希望鼓勵生成式 AI 領域能夠迎來更多合作與創(chuàng)新,打造出不僅更準確、而且對每個人都更加公平和公正的 AI 模型。

CM3leon 的跨任務執(zhí)行

CM3leon 的強大之處在于更好地遵循輸入提示以生成更連貫的圖像。例如,多數(shù)原有圖像生成模型都難以準確還原全局形態(tài)和局部細節(jié),而 CM3leon 在這方面表現(xiàn)出色,以下是 CM3leon 在各類任務中的表現(xiàn)(所有任務均由單一模型處理完成):

文本引導的圖像生成與編輯

一般來說,如果約束條件要求將復雜的對象或提示全部體現(xiàn)在輸出結果中時,圖像生成模型往往難以很好地完成工作。這就讓文本引導的圖像編輯(例如“將天空的顏色更改為蔚藍色”)更具挑戰(zhàn),因為模型需要同時理解文本指令與視覺內容。CM3leon 在這類場景下表現(xiàn)良好,具體請參考以下示例。

文本到圖像

給定具有潛在高組合度結構的提示文本,生成遵循提示的連貫圖像。

例如,CM3leon 根據(jù)提示詞創(chuàng)建了以下四幅圖像:

撒哈拉沙漠中戴著草帽和彩色太陽鏡的小仙人掌;

人手特定照片,高質量手部模型;

動漫風格的浣熊角色準備用武士刀展開戰(zhàn)斗,蓄勢待發(fā),幻想風,插圖風格;

奇幻風格的停車標志,內容為“1991”。

文本引導的圖像編輯

給定圖像與文本提示,根據(jù)文本說明對圖像內容做編輯處理。憑借強大的通用性,CM3leon 能夠在單一模型之上完成以上與以下各項任務,這全面突破了以往只能借專用模型(例如 InstructPix2Pix)進行文本引導圖像編輯的局限。

文本任務

CM3leon 模型還能按照一系列不同揭示詞生成或短或長的標題,并回答關于圖像內容的問題。

例如,圖像內容為一只狗叼著一根棍子。

提示問題: 狗叼著什么?

模型輸出: 棍子

提示詞: 詳細描述這張圖像的內容。

模型輸出: 在這張圖片中,有一只狗嘴里叼著一根棍子。地面有草覆蓋,背景中是一片林地。

Meta 還根據(jù)經(jīng)驗評估了這套指令微調模型在各種圖像標題生成和視覺問答任務中的表現(xiàn),并將結果與之前最先進的性能基準進行了比較。盡管 CM3leon 模型的文本數(shù)據(jù)量明顯低于 Flamingo(100B)和 OpenFlamingo(40B),但其在 MS-COCO 字幕與 VQA2 問答上的零樣本性能水平仍與 OpenFlamingo 相當,甚至在 VizWiz 任務上以接近 10 分的成績擊敗了 Flamingo 模型。

結構引導的圖像編輯

結構引導的圖像編輯不僅要求模型正確理解并解釋文本指令,還需要在輸入中自行獲取結構或布局信息。而 CM3leon 同樣展現(xiàn)出強大能力,在對圖像進行視覺連貫且匹配背景的編輯的同時,也能嚴格遵守給定的結構或布局指引。

物體到圖像

根據(jù)給定的圖像邊界框生成文本描述,再將結果生成為新圖像。

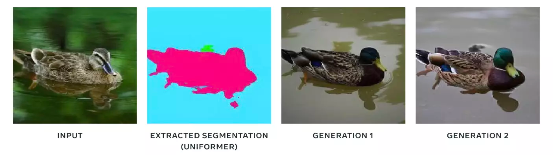

摳圖

根據(jù)給定的圖像(無文本類)摳圖并生成新的圖像。這里的輸入,代表我們希望進行摳圖的原始素材。

超分辨率結果

以上生成的所有圖像均為 CM3leon 模型的原始輸出結果。當然,圖像生成還涉及另一種常見技巧,就是單獨做超分辨率訓練,借此根據(jù)原始模型生成分辨率更高的新圖像。CM3leon 在這項任務上同樣表現(xiàn)出色,具體請參見下面的文本到圖像生成示例。

每段提示詞對應四張示例圖像:

一杯熱氣騰騰的咖啡,以山脈為背景,公路旅行中的小憩;

夕陽下美麗而雄偉的道路,審美化構圖;

湖中央的圓形小島,湖畔有森林分布,高對比度。

以下是更多生成示例:

海龜在水下游泳,審美化構圖,奇幻風格;

大象在水下游泳,審美化構圖,奇幻風格;

羊群,審美化構圖,奇幻風格。

-

解碼器

+關注

關注

9文章

1163瀏覽量

41695 -

圖像

+關注

關注

2文章

1092瀏覽量

41016 -

模型

+關注

關注

1文章

3483瀏覽量

49987 -

Meta

+關注

關注

0文章

300瀏覽量

11742

原文標題:號稱業(yè)界最強!Meta發(fā)布全新文生圖模型,實力碾壓Stable Diffusion、Midjourney

文章出處:【微信號:AI前線,微信公眾號:AI前線】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

?Diffusion生成式動作引擎技術解析

安裝OpenVINO?工具包穩(wěn)定擴散后報錯,怎么解決?

騰訊混元文生圖登頂智源FlagEval評測榜首

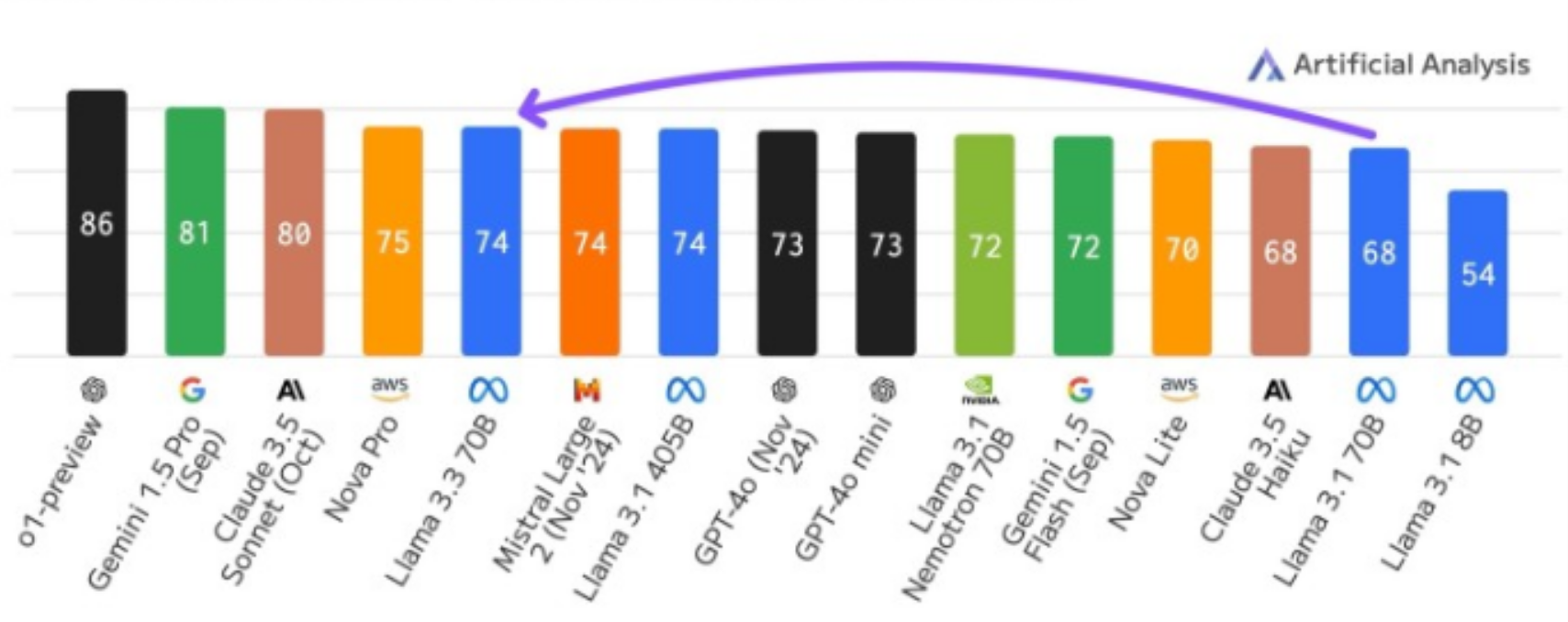

Meta重磅發(fā)布Llama 3.3 70B:開源AI模型的新里程碑

Meta發(fā)布全新文生圖模型,實力碾壓Stable Diffusion、Midjourney

Meta發(fā)布全新文生圖模型,實力碾壓Stable Diffusion、Midjourney

評論