一、本文貢獻(xiàn)

1.網(wǎng)絡(luò)通過提取顯著性區(qū)域并融合這些區(qū)域特征,以同時學(xué)習(xí)局部和全局的特征2.通過混雜來自負(fù)例的注意力特征來增強(qiáng)網(wǎng)絡(luò)對于每個注意力區(qū)域的學(xué)習(xí)3.網(wǎng)絡(luò)得到了 SOTA 的結(jié)果

二、動機(jī)

細(xì)粒度分類任務(wù)與常規(guī)的分類問題不同,它希望分類器能夠看到不同類別之間的細(xì)微差異。當(dāng)前流行的細(xì)粒度方法通常從兩個方面設(shè)計以洞察到更加細(xì)微的特征:“更有區(qū)分度的表征學(xué)習(xí)”與“定位特征顯著的部分”。然而,學(xué)習(xí)更有區(qū)分度的圖像表征本身就是有挑戰(zhàn)的,同時僅僅通過沒有監(jiān)督的分類信息也很難保證學(xué)習(xí)有顯著區(qū)別的部分的準(zhǔn)確位置。

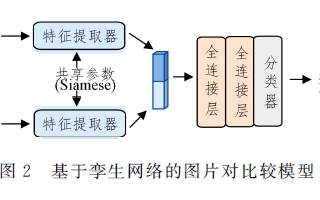

與現(xiàn)有方法不同,在本文中,作者主張從對比學(xué)習(xí)的角度解決上述的困境,并提出一種新穎的注意力對比學(xué)習(xí)網(wǎng)絡(luò)(ACLN)。該網(wǎng)絡(luò)旨在吸引來自同一類別的正對的表示,并排斥來自不同類別的負(fù)對的表示。為了實現(xiàn)這個目標(biāo),提出了一個配備兩個對比損失的對比學(xué)習(xí)模塊。具體來說,注意力生成器生成的關(guān)注區(qū)域分別與原始CNN特征作為正對,而不同圖像相應(yīng)的不同注意力區(qū)域成負(fù)對。此外,最終的分類結(jié)果是通過一個協(xié)同學(xué)習(xí)模塊同時利用原始特征和注意力圖獲得的。該方法在四個基準(zhǔn)數(shù)據(jù)集上進(jìn)行了綜合實驗,我們的 ACLN 在這些數(shù)據(jù)集上優(yōu)于所有現(xiàn)有的 SOTA 方法。作者已經(jīng)將代碼開源: https://github.com/mpskex/AttentiveContrastiveLearningNetwork

三、方法

該方法主要分為了三個部分:

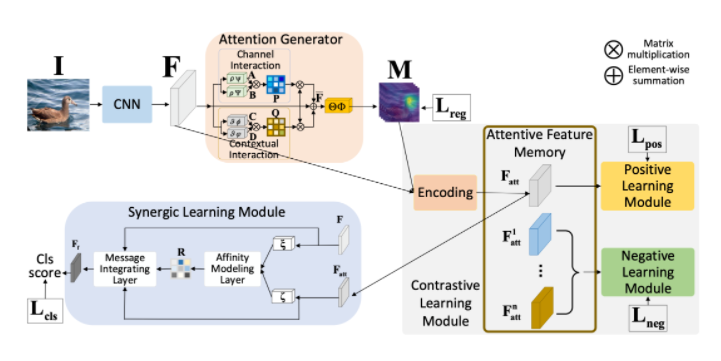

1.注意力生成器:用于生成需要關(guān)注的區(qū)域2.對比學(xué)習(xí)模塊:用于區(qū)分學(xué)習(xí)不同類別不同區(qū)域的特征3.注意力特征記憶:用于為對比學(xué)習(xí)進(jìn)行采樣

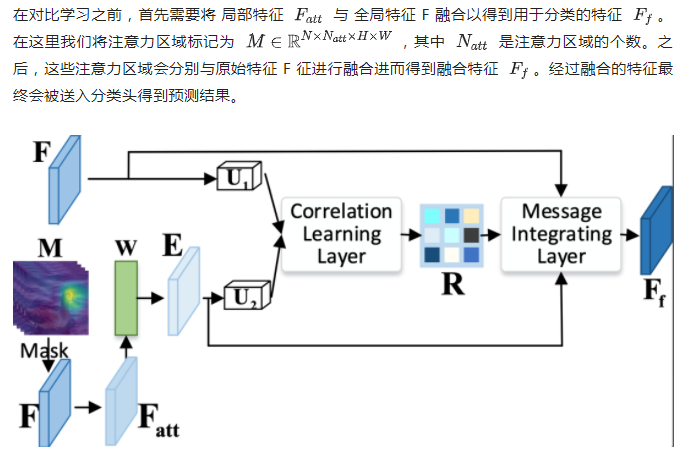

該方法的總體框架可以參考下圖:

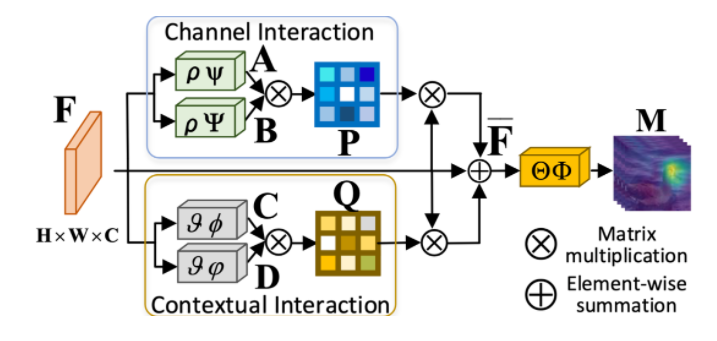

1.注意力生成器

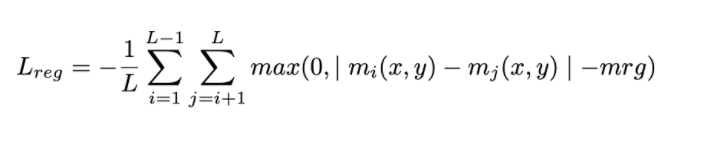

其中 ? 代表元素之間相乘,? 代表矩陣乘法。α 和 β 可學(xué)習(xí)參數(shù),用于平衡 兩種交互的比例。同時,為了讓注意力之間能夠相互分開,作者設(shè)計了簡單的對比損失函數(shù)來約束不同通道之間注意力生成的區(qū)別。

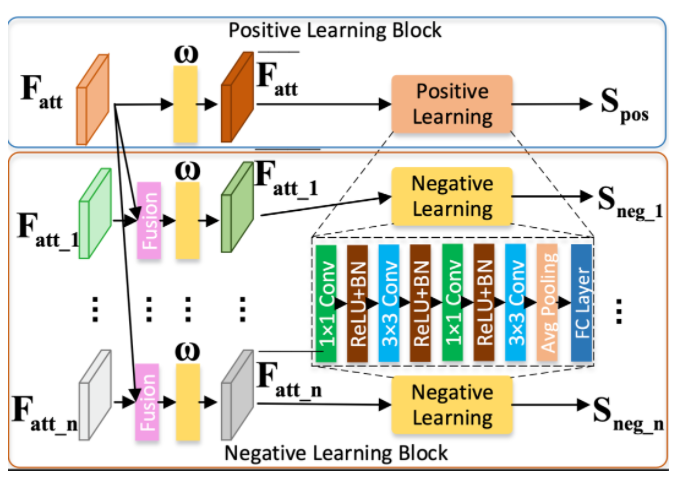

2.對比學(xué)習(xí)模塊

作者為了達(dá)成更高的準(zhǔn)確率,設(shè)計了注意力對比學(xué)習(xí)模塊以強(qiáng)化分類器對于局部特征的敏感性。作者把融合特征當(dāng)作正例的同時,將一些受到干擾的融合特征作為難負(fù)例。更確切地說,作者把在原有特征中雜糅一些顯著的且屬于其他類別的特征當(dāng)作負(fù)例,認(rèn)為這些特征受到了來自其他類別樣本特征的干擾。舉例來講,例如一張圖片 i 應(yīng)該被分類為 A,這個分類結(jié)果是由 n 個關(guān)注區(qū)域共同判定得出的。如果從另一張屬于 B 類的圖像 j 中摘取一個關(guān)注區(qū)域的特征融合到 i 圖像的 (n-1) 個關(guān)注區(qū)域的特征中,那么網(wǎng)絡(luò)不應(yīng)該把這個收到干擾的融合特征判別為類別 A。這樣做有兩個好處:

1.對于用來作為干擾的特征來說,這些特征需要包含足夠顯著且飽含信息的特征來干擾分類器判定為 A 的分類。

2.對于分類器而言,分類器需要更靈敏地識別這樣的離群點。這實際上也鼓勵了分類器在訓(xùn)練中讓這些來自不同類別的關(guān)注區(qū)域特征分布在類別上更加松散。

在學(xué)習(xí)的過程中,作者設(shè)計了一個簡單的二分類判別器來區(qū)分融合特征中是否包含離群特征。首先,方法會將來自不同關(guān)注區(qū)域的特征拆散。之后,這些拆散的關(guān)注區(qū)域特征會根據(jù)類別信息隨機(jī)融合到異類中。最終這些特征會被送入判別器輸出最終的分類分?jǐn)?shù)。判別器的目標(biāo)是區(qū)分含有干擾和不含干擾的特征,從而使得學(xué)習(xí)到的特征在每個部分都能包含具有明顯語義的特征。

為了增加負(fù)樣本的多樣性,作者還設(shè)計了一個類似 Memory Bank 的機(jī)制來積累來自不同類別的特征。這些特征可以幫助網(wǎng)絡(luò)尋找更多更隨機(jī)的融合方式,使得難樣本構(gòu)建的邊界更加光滑。

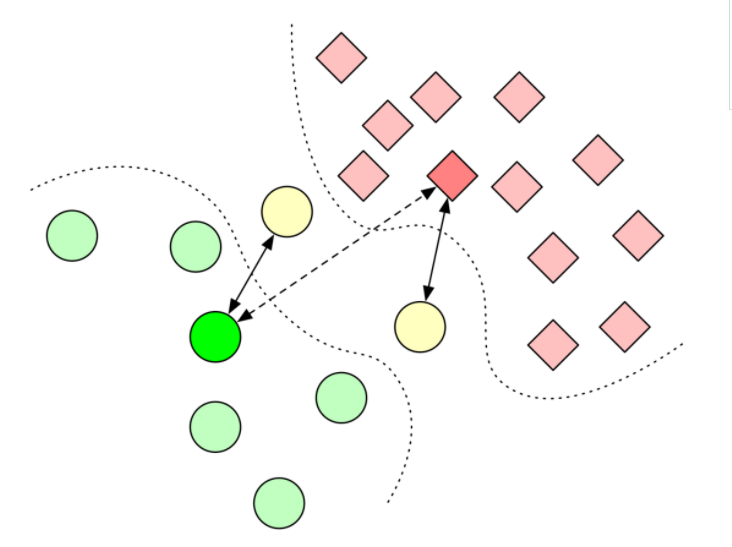

如上圖所示,通過如此設(shè)計的對比學(xué)習(xí)機(jī)制,就能夠?qū)ふ乙粋€在特征空間更加緊致的分布。因為在實際數(shù)據(jù)集當(dāng)中,數(shù)據(jù)在空間的分布可能都比較離散。如果在這樣的訓(xùn)練數(shù)據(jù)中訓(xùn)練,可能會遺漏很多本應(yīng)該關(guān)注的信息,從而導(dǎo)致網(wǎng)絡(luò)不能獲得足夠的泛化性能。其現(xiàn)象就是網(wǎng)絡(luò)明明在訓(xùn)練集中效果非常好,但是卻總是不能在測試集合上獲得更好的性能。

同時,在類別之間構(gòu)建負(fù)樣本能夠鼓勵特征分布在類別上能夠更加顯著。舉例來說,在左圖中如果同時拉開實線箭頭的距離,會比以同等速率來開虛線箭頭獲得的類別間距離更大。這樣我們也就通過構(gòu)建難樣本獲得了更大的類別間距離,使不同類別的特征更好被區(qū)分。

作者在使用對比學(xué)習(xí)機(jī)制之后,構(gòu)建了很多特征層面的難樣本。這些難樣本能夠讓分類器更加魯棒,一定程度上改善了模型的泛化性。

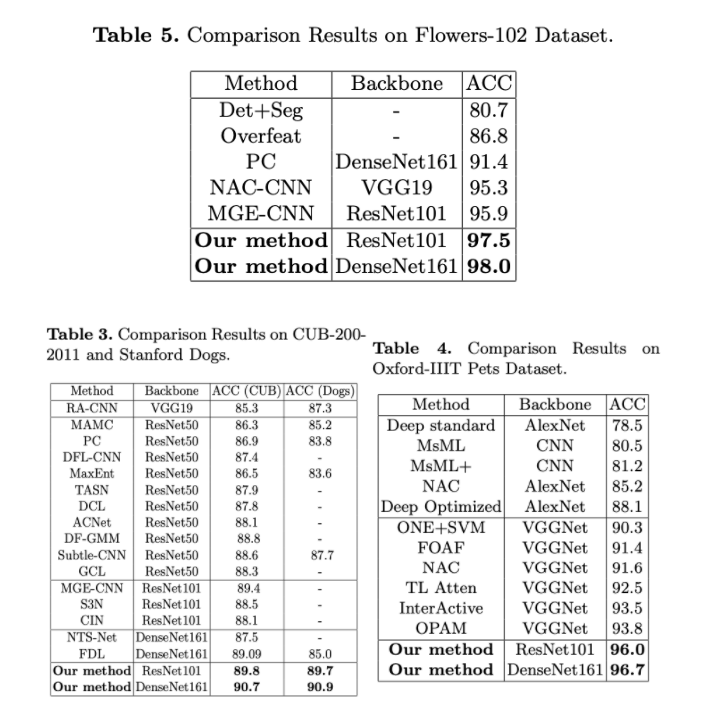

Result

模型在 Flowers-102 / CUB-200-2011 / Oxford Pets 數(shù)據(jù)集上都獲得了更好的成績。作者分別使用 ResNet-101 和 DenseNet 161 在公開測試集上評價,均高于當(dāng)前的 SOTA 方法。

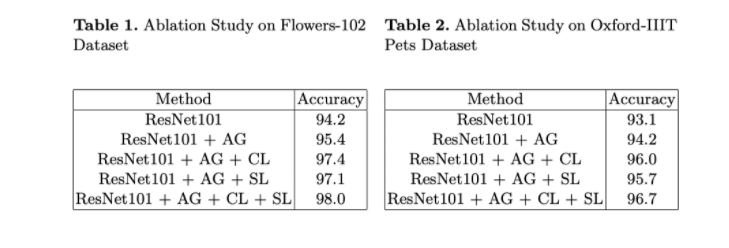

同時作者還設(shè)計了消融實驗,在使用注意力生成器、對比學(xué)習(xí)以及本文提出的關(guān)注區(qū)域特征融合方法的不同條件下,評價了網(wǎng)絡(luò)的性能。

來源:墨奇科技

-

對比

+關(guān)注

關(guān)注

0文章

4瀏覽量

7999 -

細(xì)粒度

+關(guān)注

關(guān)注

0文章

4瀏覽量

6635 -

墨奇科技

+關(guān)注

關(guān)注

0文章

16瀏覽量

4572

發(fā)布評論請先 登錄

通過排查電能質(zhì)量問題來縮短停產(chǎn)時間

細(xì)粒度圖像分析技術(shù)詳解

一種細(xì)粒度的面向產(chǎn)品屬性的用戶情感模型

基于Modbus功能碼細(xì)粒度過濾算法的研究

基于ABS細(xì)粒度隱私隔絕的身份追溯研究

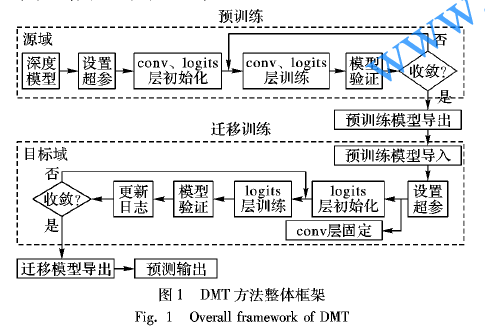

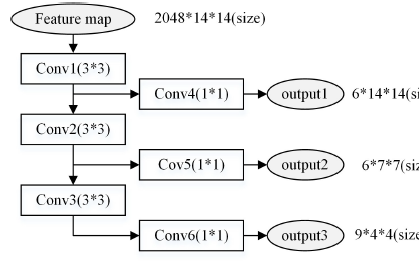

使用深度模型遷移進(jìn)行細(xì)粒度圖像分類的方法說明

FGIA 中的主要問題和挑戰(zhàn)

細(xì)粒度圖像分析任務(wù)在發(fā)展過程中面臨著獨(dú)特的挑戰(zhàn)

電能質(zhì)量問題的分類_電能質(zhì)量的檢測方法

結(jié)合非局部和多區(qū)域注意力機(jī)制的細(xì)粒度識別方法

基于文本的細(xì)粒度美妝圖譜視覺推理問題

通過對比學(xué)習(xí)的角度來解決細(xì)粒度分類的特征質(zhì)量問題

通過對比學(xué)習(xí)的角度來解決細(xì)粒度分類的特征質(zhì)量問題

評論