NVIDIA Megatron 是一個基于 PyTorch 的框架,用于訓練基于 Transformer 架構的巨型語言模型。本系列文章將詳細介紹Megatron的設計和實踐,探索這一框架如何助力大模型的預訓練計算。 上篇主要介紹了大模型訓練的發展趨勢、NVIDIA Megatron的模型并行設計,本篇將承接上篇的內容,解析Megatron 在NVIDIA DGX SuperPOD 上的實踐。

優化的分布式集群架構:NVIDIA DGX SuperPOD

有了高效的分布式訓練框架,自然也需要優化的分布式訓練集群。

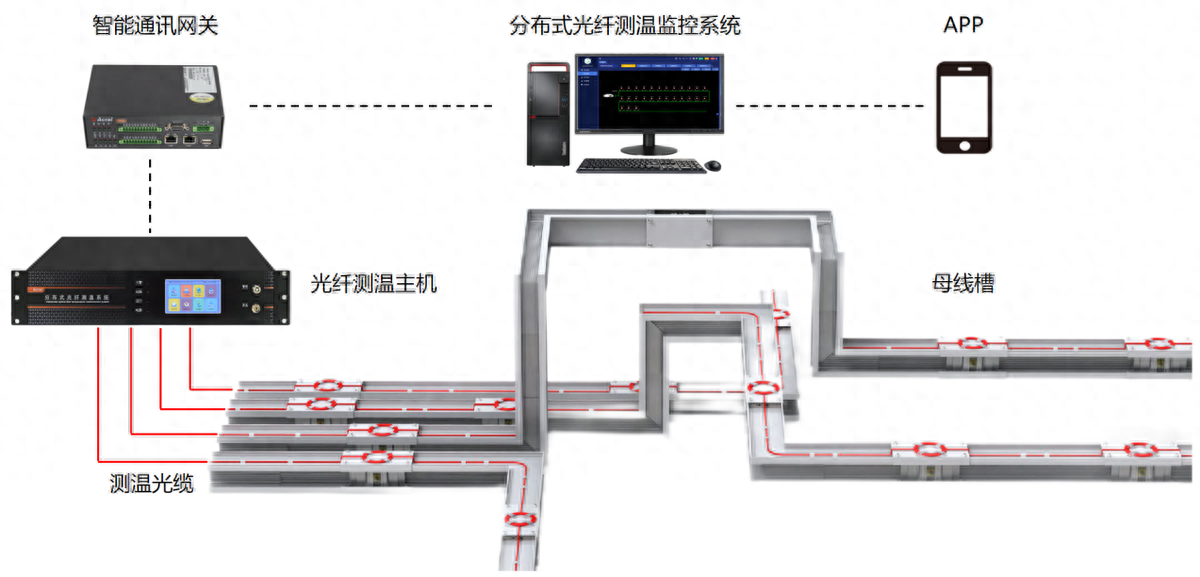

NVIDIA DGX SuperPOD 便是 NVIDIA 推出的一個分布式集群的參考架構,最新一代是基于NVIDIA DGX A100 和NVIDIA HDR 200Gb/s ConnectX-6 HCAs組建,旨在幫助AI 研究人員快速搭建一套強大、靈活、高效的系統,以滿足工業界日益復雜、多變的模型對計算資源不同程度的需求。尤其對于超大語言模型預訓練這一復雜場景,DGX SuperPOD 架構尤為重要。

DGX SuperPOD 采用模塊化的設計,支持不同規模大小的設計。一個標準的SuperPOD 由140 臺DGX A100和三層Infiniband 交換機通過胖樹結構全互聯起來。每臺DGX A100 配有8個200Gb/s 的高速計算網,并配有2個200Gb/s的高速存儲網,采用計算和存儲網絡分離的方案。

多個POD之間可以通過核心層交換機直連起來,可以支持多達560 臺DGX A100的互聯規模。

更多關于NVIDIA DGX SuperPOD 架構的詳細設計,請參閱下列連接中的白皮書:https://images.nvidia.com/aem-dam/Solutions/Data-Center/gated-resources/nvidia-dgx-superpod-a100.pdf

NVIDIA Megatron 在 DGX SuperPOD 上的實踐

基于DGX SuperPOD 的Megatron實踐在不同大小的模型上,都表現出了很好的計算效率。

模型從1.7B 到1T ,訓練規模從32 卡到3072 卡。

基于GPT-3 175B 模型的訓練,采用如下的配置:

128 臺 DGX A100,總共 1024張 A100

Tensor 并行度:8;Pipeline 并行度:16; 數據并行度:8

全局Batch size : 1536;Micro-batch size: 1

在如此大的訓練規模下,GPU 仍可達到44% 左右的計算效率,在規模和效率上,都遠遠超過已有的公開結果。

詳細內容請參考以下鏈接:

Megatron repro: https://github.com/nvidia/megatron-lm

GPT3-175B training scripts: https://github.com/NVIDIA/Megatron-LM/blob/main/examples/pretrain_gpt3_175B.sh

總結

1. 大模型是大勢所趨。

2. 大規模分布式訓練是訓練大模型的必須。

3. NVIDIA Megatron 是開源的、軟硬協同設計的訓練框架,專為Transformer-based的超大語言模型設計。

4. NVIDIA DGX SuperPOD 是開放的集群參考設計架構,專為大規模分布式訓練而準備。

5. Megatron 優化的Tensor模型并行:用于intra-transformer 層,可以高效地執行在HGX based的系統上。

6. Megatron優化的 Pipeline 模型并行:用于inter-transformer 層,可以有效地利用集群中多網卡的設計。

7. 數據并行的加持,可以擴展到更大規模、訓練更快。

8. GPT-3 175B 的大模型,在1024 張 A100上可達到44%左右的計算效率。

9. NVIDIA Megatron 的設計和實踐,已廣泛用于學術界和工業界。

編輯:jq

-

數據

+關注

關注

8文章

7238瀏覽量

90950 -

NVIDIA

+關注

關注

14文章

5232瀏覽量

105715 -

交換機

+關注

關注

21文章

2718瀏覽量

101315 -

分布式

+關注

關注

1文章

976瀏覽量

75148

原文標題:NVIDIA Megatron:超大Transformer語言模型的分布式訓練框架 (二)

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

AI原生架構升級:RAKsmart服務器在超大規模模型訓練中的算力突破

淺談工商企業用電管理的分布式儲能設計

小白學大模型:訓練大語言模型的深度指南

騰訊公布大語言模型訓練新專利

分布式云化數據庫有哪些類型

大模型訓練框架(五)之Accelerate

分布式通信的原理和實現高效分布式通信背后的技術NVLink的演進

分布式光纖測溫是什么?應用領域是?

探究超大Transformer語言模型的分布式訓練框架

探究超大Transformer語言模型的分布式訓練框架

評論