神經網絡的初始化是訓練流程的重要基礎環節,會對模型的性能、收斂性、收斂速度等產生重要的影響。本文是deeplearning.ai的一篇技術博客,文章指出,對初始化值的大小選取不當, 可能造成梯度爆炸或梯度消失等問題,并提出了針對性的解決方法。

初始化會對深度神經網絡模型的訓練時間和收斂性產生重大影響。簡單的初始化方法可以加速訓練,但使用這些方法需要注意小心常見的陷阱。本文將解釋如何有效地對神經網絡參數進行初始化。

有效的初始化對構建模型至關重要

要構建機器學習算法,通常要定義一個體系結構(例如邏輯回歸,支持向量機,神經網絡)并對其進行訓練來學習參數。下面是訓練神經網絡的一些常見流程:

初始化參數

選擇優化算法

然后重復以下步驟:

1、向前傳播輸入

2、計算成本函數

3、使用反向傳播計算與參數相關的成本梯度

4、根據優化算法,利用梯度更新每個參數

然后,給定一個新的數據點,使用模型來預測其類型。

初始化值太大太小會導致梯度爆炸或梯度消失

初始化這一步對于模型的最終性能至關重要,需要采用正確的方法。比如對于下面的三層神經網絡。可以嘗試使用不同的方法初始化此網絡,并觀察對學習的影響。

在優化循環的每次迭代(前向,成本,后向,更新)中,我們觀察到當從輸出層向輸入層移動時,反向傳播的梯度要么被放大,要么被最小化。

假設所有激活函數都是線性的(恒等函數)。 則輸出激活為:

其中 L=10 ,且W[1]、W[2]…W[L-1]都是2*2矩陣,因為從第1層到L-1層都是2個神經元,接收2個輸入。為了方便分析,如果假設W[1]=W[2]=…=W[L-1]=W,那么輸出預測為

如果初始化值太大或太小會造成什么結果?

情況1:初始化值過大會導致梯度爆炸

如果每個權重的初始化值都比單位矩陣稍大,即:

可簡化表示為

且a[l]的值隨l值呈指數級增長。當這些激活用于向后傳播時,會導致梯度爆炸。也就是說,與參數相關的成本梯度太大。 這導致成本圍繞其最小值振蕩。

初始化值太大導致成本圍繞其最小值震蕩

情況2:初始化值過小會導致梯度消失

類似地,如果每個權重的初始化值都比單位矩陣稍小,即:

可簡化表示為

且a[l]的值隨l值減少呈指數級下降。當這些激活用于后向傳播時,可能會導致梯度消失。也就是說,與參數相關的成本梯度太小。這會導致成本在達到最小值之前收斂。

初始化值太小導致模型過早收斂

總而言之,使用大小不合適的值對權重進行將導致神經網絡的發散或訓練速度下降。 雖然我們用的是簡單的對稱權重矩陣來說明梯度爆炸/消失的問題,但這一現象可以推廣到任何不合適的初始化值。

如何確定合適的初始化值

為了防止以上問題的出現,我們可以堅持以下經驗原則:

1.激活的平均值應為零。

2.激活的方差應該在每一層保持不變。

在這兩個假設下,反向傳播的梯度信號不應該在任何層中乘以太小或太大的值。梯度應該可以移動到輸入層,而不會爆炸或消失。

更具體地說,對于層l,其前向傳播是:

我們想讓下式成立:

確保均值為零,并保持每層輸入方差值不變,可以保證信號不會爆炸或消失。該方法既適用于前向傳播(用于激活),也適用于向后傳播(用于關于激活的成本梯度)。這里建議使用Xavier初始化(或其派生初始化方法),對于每個層l,有:

層l中的所有權重均自正態分布中隨機挑選,其中均值μ=0,方差E= 1/( n[l?1]),其中n[l?1]是第l-1層網絡中的神經元數量。偏差已初始化為零。

下圖說明了Xavier初始化對五層全連接神經網絡的影響。數據集為MNIST中選取的10000個手寫數字,分類結果的紅色方框表示錯誤分類,藍色表示正確分類。

結果顯示,Xavier初始化的模型性能顯著高于uniform和標準正態分布(從上至下分別為uniform、標準正態分布、Xavier)。

結論

在實踐中,使用Xavier初始化的機器學習工程師會將權重初始化為N(0,1/( n[l?1]))或N(0,2/(n[l-1]+n[1])),其中后一個分布的方差是n[l-1]和n[1]的調和平均。

Xavier初始化可以與tanh激活一起使用。此外,還有大量其他初始化方法。 例如,如果你正在使用ReLU,則通常的初始化是He初始化,其初始化權重通過乘以Xavier初始化的方差2來初始化。 雖然這種初始化證明稍微復雜一些,但其思路與tanh是相同的。

-

神經網絡

+關注

關注

42文章

4807瀏覽量

102766 -

函數

+關注

關注

3文章

4369瀏覽量

64187 -

機器學習

+關注

關注

66文章

8491瀏覽量

134083

原文標題:一文看懂神經網絡初始化!吳恩達Deeplearning.ai最新干貨

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

【案例分享】基于BP算法的前饋神經網絡

改善深層神經網絡--超參數優化、batch正則化和程序框架 學習總結

怎么解決人工神經網絡并行數據處理的問題

基于BP神經網絡的PID控制

卷積神經網絡模型發展及應用

如何進行高效的時序圖神經網絡的訓練

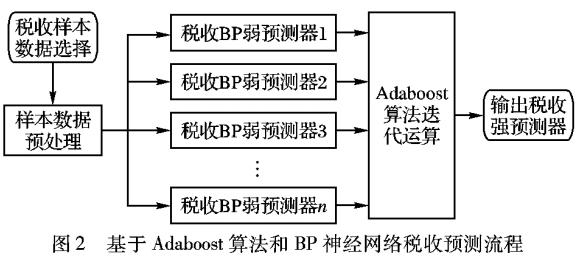

BP神經網絡的稅收預測

教大家怎么選擇神經網絡的超參數

如何有效地對神經網絡參數進行初始化

如何有效地對神經網絡參數進行初始化

評論