摘要:”當(dāng)研究問題或數(shù)據(jù)集包括多個這樣的模態(tài)時,其特征在于多模態(tài)。

【導(dǎo)讀】人工智能領(lǐng)域最頂級國際期刊IEEE Transactions on Pattern Analysis and Machine Intelligence(IEEETPAMI,影響因子為 9.455),2019年1月最新一期發(fā)表了關(guān)于多模態(tài)機(jī)器學(xué)習(xí)綜述論文。我們周圍的世界涉及多種形式 - 我們看到物體,聽到聲音,感覺質(zhì)地,聞到異味等等。 一般而言,模態(tài)指的是事物發(fā)生或經(jīng)歷的方式。 大多數(shù)人將形態(tài)與感覺方式聯(lián)系起來,這些感覺方式代表了我們主要的交流和感覺渠道,例如視覺或觸覺。

因此,當(dāng)研究問題或數(shù)據(jù)集包括多個這樣的模態(tài)時,其特征在于多模態(tài)。 本文主要關(guān)注但不僅僅關(guān)注三種形式:自然語言既可以是書面的,也可以是口頭的; 視覺信號,通常用圖像或視頻表示; 和聲音信號,編碼聲音和口頭信息,如韻律和聲音表達(dá)。

我們對世界的體驗(yàn)是多模式的 - 我們看到物體,聽到聲音,感覺質(zhì)地,聞到異味和味道。情態(tài)是指某種事物發(fā)生或經(jīng)歷的方式,并且當(dāng)研究問題包括多種這樣的形式時,研究問題被描述為多模式。為了使人工智能在理解我們周圍的世界方面取得進(jìn)展,它需要能夠?qū)⑦@種多模態(tài)信號一起解釋。多模式機(jī)器學(xué)習(xí)旨在構(gòu)建可以處理和關(guān)聯(lián)來自多種模態(tài)的信息的模型。這是一個充滿活力的多學(xué)科領(lǐng)域,具有越來越重要的意義和非凡的潛力。本文不是關(guān)注特定的多模態(tài)應(yīng)用,而是研究多模態(tài)機(jī)器學(xué)習(xí)本身的最新進(jìn)展。我們超越了典型的早期和晚期融合分類,并確定了多模式機(jī)器學(xué)習(xí)所面臨的更廣泛的挑戰(zhàn),即:表示,翻譯,對齊,融合和共同學(xué)習(xí)。這種新的分類法將使研究人員能夠更好地了解該領(lǐng)域的狀況,并確定未來研究的方向。

論文地址:

http://www.zhuanzhi.ai/paper/2236c08ef0cd1bc87cae0f14cfbb9915

https://ieeexplore.ieee.org/document/8269806

模態(tài)特征表示

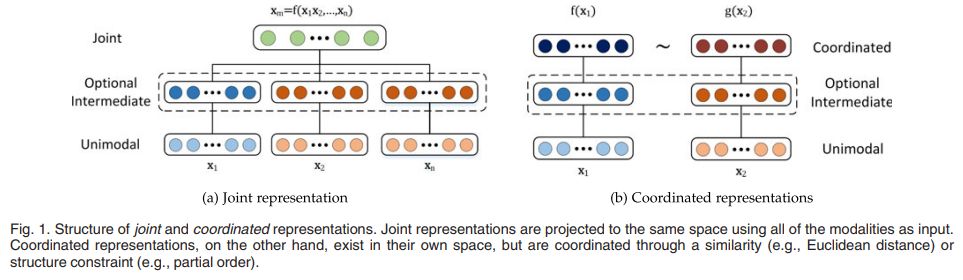

多模態(tài)的表示方法有兩類:

聯(lián)合表示將不同模態(tài)的特征映射到同一個空間,代表方法有神經(jīng)網(wǎng)絡(luò)的方法、圖模型方法與序列模型方法。

協(xié)調(diào)方法特征仍在原空間,但是通過相似度或者結(jié)構(gòu)特征協(xié)調(diào)。

多模態(tài)特征翻譯

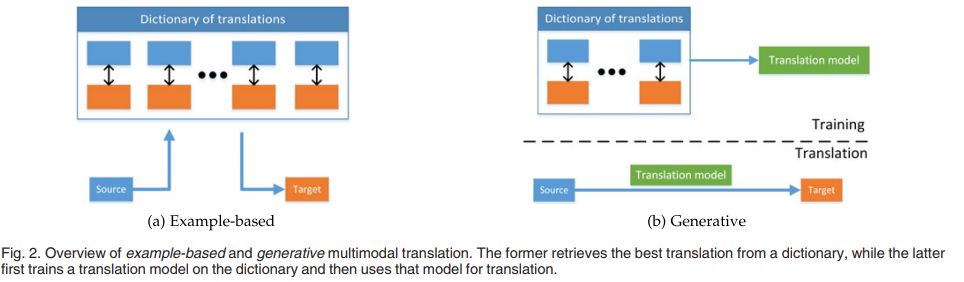

多模態(tài)特征翻譯分為基于樣本的和生成式的:

基于樣本的方法從特征字典中找出最佳翻譯。基于樣本的方法分為基于檢索式的和合并的方法。

生成式的方法則是通過樣本,訓(xùn)練一個翻譯模型,并使用翻譯模型完成對特征的轉(zhuǎn)換。生成式的方法有基于語法的、encoder-decoder模型和連續(xù)模型。

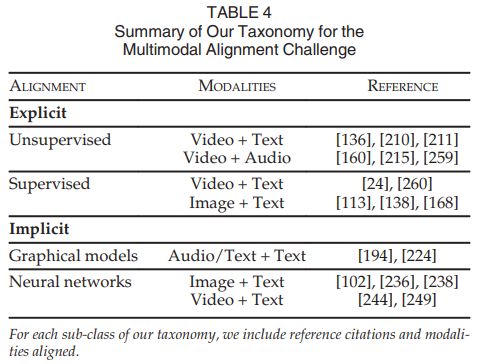

多模態(tài)特征對齊

多模態(tài)特征對齊是找到同一個實(shí)例的不同之間模態(tài)特征之間的關(guān)系。

顯式對齊方法包括監(jiān)督模型和無監(jiān)督模型。無監(jiān)督模型如CCA和DTW(Dynamic time warping)等。

隱式對齊的方法包括圖模型和神經(jīng)網(wǎng)絡(luò)

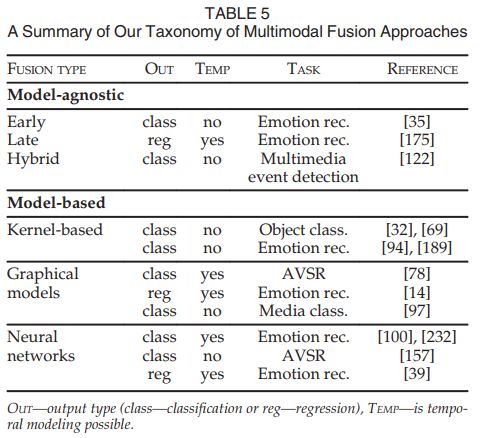

多模態(tài)特征融合

多模態(tài)特征融合是指將從不同模態(tài)的特征集成在一起,共同完成一個任務(wù),如分類。

無模型融合的方法被分為早期模型(基于特征)、晚期模型(基于決策)和混合模型

有模型融合的方法有核方法、圖模型方法、神經(jīng)網(wǎng)絡(luò)模型方法等。

-

人工智能

+關(guān)注

關(guān)注

1805文章

48899瀏覽量

247982 -

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8499瀏覽量

134331 -

自然語言

+關(guān)注

關(guān)注

1文章

291瀏覽量

13628

原文標(biāo)題:人工智能頂刊TPAMI2019最新《多模態(tài)機(jī)器學(xué)習(xí)綜述》

文章出處:【微信號:AItists,微信公眾號:人工智能學(xué)家】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

NVIDIA在多模態(tài)生成式AI領(lǐng)域的突破性進(jìn)展

愛芯通元NPU適配Qwen2.5-VL-3B視覺多模態(tài)大模型

?多模態(tài)交互技術(shù)解析

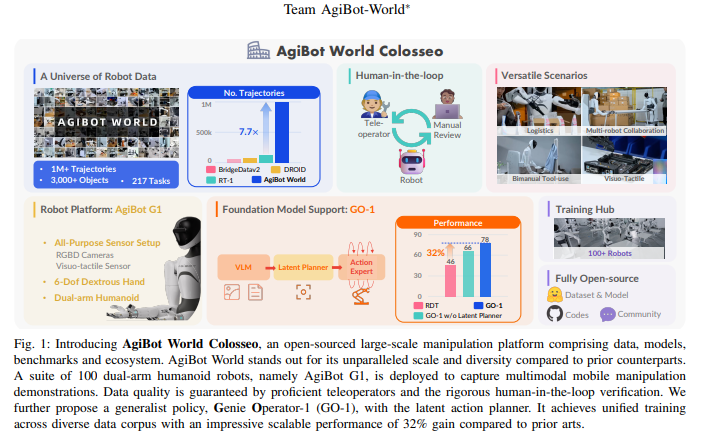

AgiBot World Colosseo:構(gòu)建通用機(jī)器人智能的規(guī)模化數(shù)據(jù)平臺

海康威視發(fā)布多模態(tài)大模型文搜存儲系列產(chǎn)品

2025年Next Token Prediction范式會統(tǒng)一多模態(tài)嗎

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗(yàn)】2.具身智能機(jī)器人大模型

商湯日日新多模態(tài)大模型權(quán)威評測第一

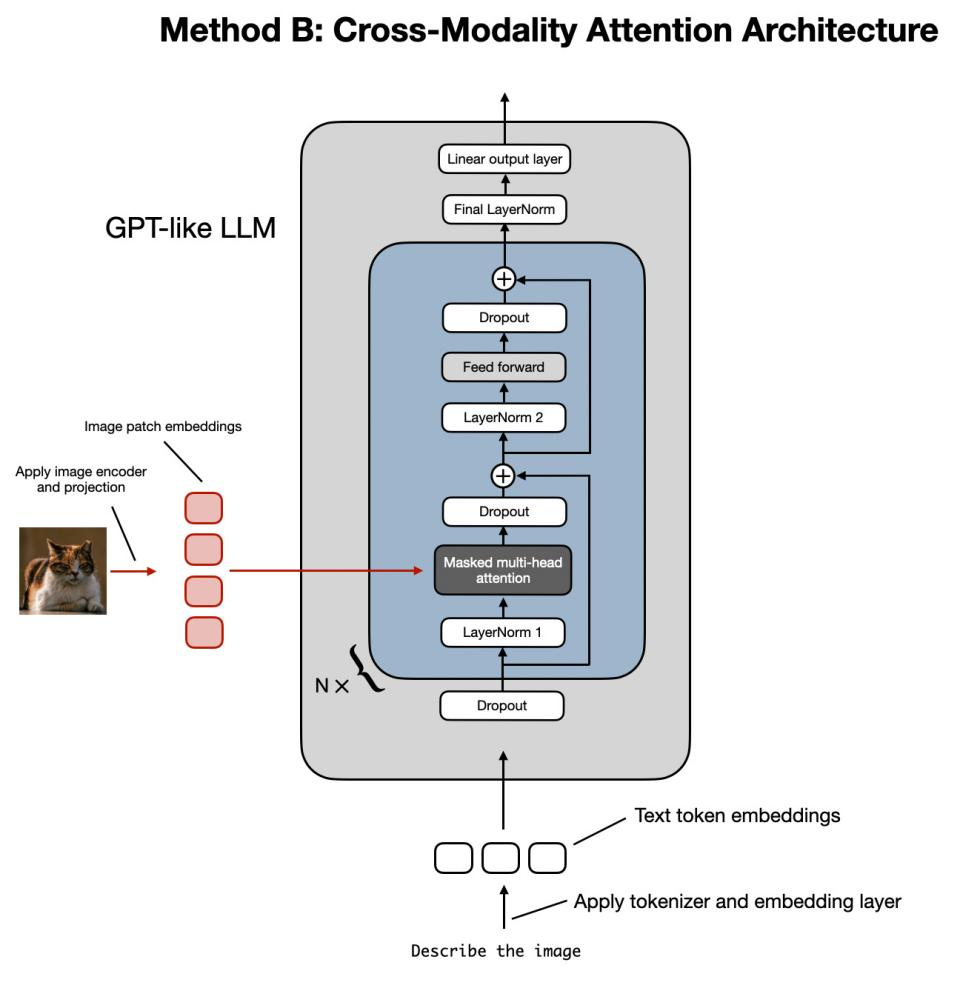

一文理解多模態(tài)大語言模型——下

一文理解多模態(tài)大語言模型——上

利用OpenVINO部署Qwen2多模態(tài)模型

云知聲推出山海多模態(tài)大模型

清華大學(xué):軟體機(jī)器人柔性傳感技術(shù)最新研究進(jìn)展

關(guān)于多模態(tài)機(jī)器學(xué)習(xí)綜述論文

關(guān)于多模態(tài)機(jī)器學(xué)習(xí)綜述論文

評論