摘要

擁有指令跟隨能力的大型語言模型已經徹底改變了人工智能領域。這些模型通過其自然語言界面展現出卓越的通用性,能夠應對各種現實世界任務。

然而,它們的性能在很大程度上依賴于高質量的示例數據,通常難以獲得。當涉及到多模態指令跟隨時,這一挑戰進一步加劇。

我們介紹了TextBind,這是一個幾乎無需注釋的框架,用于賦予更大型的語言模型多輪交織的多模態指令跟隨能力。

我們的方法僅需要圖像描述對,并從語言模型生成多輪多模態指令-響應對話。我們發布了我們的數據集、模型和演示,以促進未來在多模態指令跟隨領域的研究。

數據

TextBind提供了處理和生成任意交織的圖像和文本內容的示例,使語言模型能夠在開放世界場景中與用戶進行自然互動。

模型

我們的模型包括一個圖像編碼器、一個圖像解碼器、一個語言模型,以及連接它們的橋接網絡,支持多輪交織的多模態指令跟隨。它可以生成并處理任意交織的圖像和文本內容。

demo

語言模型能夠執行各種任務,包括根據一組圖像創作引人入勝的故事,比較多個圖像中的共同和不同之處,用生動的圖像解釋概念,生成帶有插圖的長篇連貫故事等等。最有趣的是,我們模型的核心創新在于其能夠在廣泛的真實場景中與用戶自然互動。歡迎訪問我們的demo[1]。

例子

-

編碼器

+關注

關注

45文章

3775瀏覽量

137149 -

圖像

+關注

關注

2文章

1092瀏覽量

41027 -

語言模型

+關注

關注

0文章

558瀏覽量

10673

原文標題:TextBind:在開放世界中多輪交織的多模態指令跟隨

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

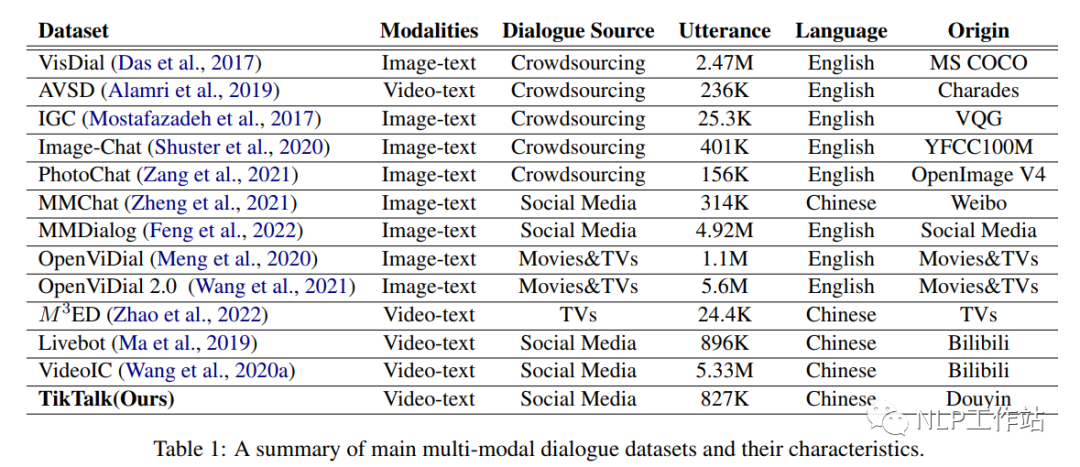

多文化場景下的多模態情感識別

多模態GPT:國內發布一款可以在線使用的多模態聊天機器人!

多模態上下文指令調優數據集MIMIC-IT

VisCPM:邁向多語言多模態大模型時代

更強更通用:智源「悟道3.0」Emu多模態大模型開源,在多模態序列中「補全一切」

TextBind:在開放世界中多輪交織的多模態指令跟隨

TextBind:在開放世界中多輪交織的多模態指令跟隨

評論