Stability AI 是 Stable Diffusion 圖像生成工具背后的公司,如今他們不再局限于開發(fā)圖像 / 視頻生成方面的 AI,于今天正式發(fā)布了一套開源的大型語言模型(LLM)—— StableLM,首次涉足目前由 OpenAI、Meta 和 Google 等科技公司主導(dǎo)的語言模型領(lǐng)域。

StableLM 跟 ChatGPT、Bard 這些一樣,被設(shè)計(jì)用來生成文本和代碼。它是通過使用開源數(shù)據(jù)集 the Pile 訓(xùn)練而來的,這個(gè)數(shù)據(jù)集包含的數(shù)據(jù)來源就有維基百科、Stack Exchange 和 PubMed。不過,Stability AI 在 the Pile 的基礎(chǔ)上進(jìn)行了擴(kuò)展,所使用的數(shù)據(jù)集大小是標(biāo)準(zhǔn) the Pile 的 3 倍。

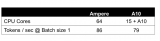

Stability AI 現(xiàn)在已經(jīng)將這個(gè) StableLM 模型發(fā)布到了 GitHub 上,開發(fā)者可以使用或經(jīng)過調(diào)整后再使用。StableLM 模型還處于 Alpha 階段,它的參數(shù)也比較少,只有 30 億和 70 億個(gè)參數(shù),之后他們還會(huì)推出有 150 億到 650 億參數(shù)的模型。

對于 AI 可能會(huì)產(chǎn)生的風(fēng)險(xiǎn),Stability AI 也給出了提醒:

對于任何沒有額外微調(diào)和強(qiáng)化學(xué)習(xí)的預(yù)訓(xùn)練大型語言模型來說,用戶得到的回應(yīng)質(zhì)量可能參差不齊,并且可能包括冒犯性的語言和觀點(diǎn)。這有望隨著規(guī)模、更好的數(shù)據(jù)、社區(qū)反饋和優(yōu)化而得到改善。

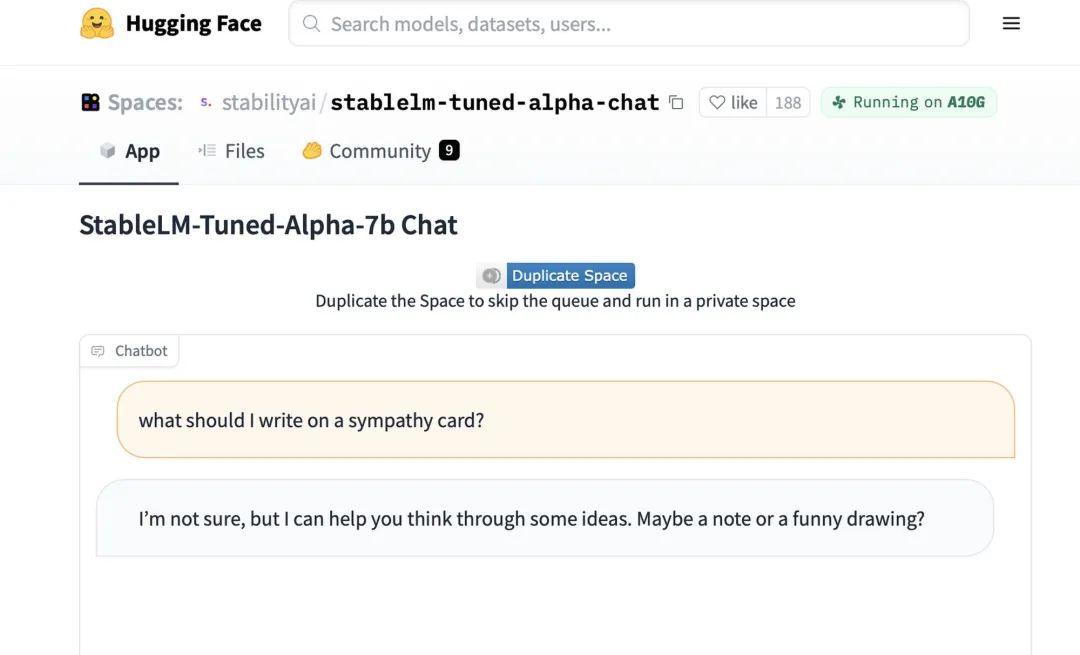

除了將代碼托管在 GitHub 上,Stability AI 還在 Hugging Face 上發(fā)布了一個(gè)演示版本,經(jīng)過測試 StableLM 會(huì)說中文,但只會(huì)一點(diǎn)點(diǎn)(回復(fù)內(nèi)容對應(yīng)不上,語句也不通順)。

在 Stable Diffusion 發(fā)布后,Stability AI 遭到了很多藝術(shù)家的投訴和起訴,指控它通過使用網(wǎng)絡(luò)抓取的受版權(quán)保護(hù)的圖像開發(fā) AI 圖像生成工具,侵犯了藝術(shù)家們的權(quán)利。在之前的糾紛還沒解決的情況下,如今推出 StableLM 不知道是否還會(huì)引發(fā)更多的訴訟。

Stability AI 在去年 10 月融資了 1 億美元,公司估值也超過了 10 億美元。但 AI 是一個(gè)投入非常高,可能短期也很難產(chǎn)生收益的領(lǐng)域,也不知道這 1 億美金現(xiàn)在還剩多少,為了在這個(gè)領(lǐng)域持續(xù)發(fā)展,Stability AI 會(huì)不會(huì)繼續(xù)融資,亦或是投入某個(gè)大型公司的懷抱呢?

項(xiàng)目地址:https://github.com/Stability-AI/StableLM

審核編輯 :李倩

-

語言模型

+關(guān)注

關(guān)注

0文章

558瀏覽量

10670 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1222瀏覽量

25275 -

GitHub

+關(guān)注

關(guān)注

3文章

481瀏覽量

17452 -

LLM

+關(guān)注

關(guān)注

1文章

319瀏覽量

680

原文標(biāo)題:AI作畫鼻祖Stability AI推出大型語言模型,會(huì)一點(diǎn)點(diǎn)中文

文章出處:【微信號(hào):OSC開源社區(qū),微信公眾號(hào):OSC開源社區(qū)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

小白學(xué)大模型:從零實(shí)現(xiàn) LLM語言模型

無法在OVMS上運(yùn)行來自Meta的大型語言模型 (LLM),為什么?

什么是LLM?LLM在自然語言處理中的應(yīng)用

如何訓(xùn)練自己的LLM模型

新品|LLM Module,離線大語言模型模塊

LLM大模型推理加速的關(guān)鍵技術(shù)

基于CPU的大型語言模型推理實(shí)驗(yàn)

一套開源的大型語言模型(LLM)—— StableLM

一套開源的大型語言模型(LLM)—— StableLM

評論