導(dǎo)讀

日前,計算機視覺和模式識別領(lǐng)域的三大頂級會議之一CVPR正在進行中,深蘭DeepBlueAI團隊在動作識別國際挑戰(zhàn)賽 (ActivityNet) 研討會上,參加了 MMAct 挑戰(zhàn)賽中僅設(shè)的兩個賽道——“跨模態(tài)裁剪動作識別”和“跨模態(tài)未裁剪動作時序定位”,并均以大比分領(lǐng)先取得第一。

冠軍方案解讀

競賽要求參賽者提出跨模態(tài)視頻動作識別/定位方法,以彌補使用 MMAct[1] 數(shù)據(jù)集的純視覺方法的缺點。此任務(wù)的目標是利用基于傳感器的,例如穿戴式傳感器數(shù)據(jù)作為特權(quán)信息,以及基于視覺的模態(tài),其方式可以克服訓(xùn)練(傳感器 + 視頻)和測試(僅視頻)階段之間模態(tài)差異所帶來的限制。用于此競賽的多模態(tài)數(shù)據(jù)包括:加速度、方向、陀螺儀、RGB 視頻和人體關(guān)鍵點。

挑戰(zhàn)賽促進了關(guān)于如何通過使用跨模態(tài)方法解決視覺挑戰(zhàn)的另一種觀點,希望擴大對視頻動作理解的研究,以進一步利用日常使用的智能設(shè)備(例如智能手機)中的傳感器。

賽題一

跨模態(tài)裁剪動作識別

Cross-Modal Trimmed Action Recognition

在此任務(wù)中,參與者使用來自MMAct 的修剪視頻以及配對的傳感器數(shù)據(jù),在數(shù)據(jù)中包含交叉視角和交叉場景兩種類型的數(shù)據(jù),共35個動作類別。任務(wù)允許參與者使用修剪過的傳感器數(shù)據(jù)和修剪過的視頻進行訓(xùn)練,但不能同時使用交叉視角和交叉場景的數(shù)據(jù),且僅對修剪過的視頻進行測試以進行動作識別,并采用mAP作為評價指標。

賽題難點:

不同視頻等多模態(tài)數(shù)據(jù)時序長度變化大,從幾秒到幾分鐘不等;

測試階段只提供了視頻數(shù)據(jù)。

應(yīng)用場景:

視頻監(jiān)控、異常行為識別

解決方案:

考慮到視頻長度較長,為了有效地捕獲視頻中的動作信息,團隊優(yōu)先采用了等間隔采樣的方式對每個視頻進行采樣,然后采用隨機尺度裁剪、水平翻轉(zhuǎn)等數(shù)據(jù)增強方式進行增強。

在算法選型上,團隊優(yōu)先采用了TSM[2]進行實驗,它具有高效率和高性能。具體來說,它可以達到 3D CNN 的性能,但保持 2D CNN 的復(fù)雜性。TSM 沿時間維度移動部分通道,從而促進相鄰幀之間的信息交換,它還可以插入到 2D CNN 中以實現(xiàn)零計算和零參數(shù)的時間建模。

作為對比,團隊同時采用了滑動窗口的形式進行幀數(shù)據(jù)采樣,并采用ir-CSN[3]進行實驗。CSN探索了通道之間交互的重要性,并達到了節(jié)省計算參數(shù)和通道之間交互的平衡,網(wǎng)絡(luò)具有結(jié)構(gòu)精簡、計算量小、速度快、準確率好的優(yōu)點,并且還有一定的正則化能力。

最后,在進行了為每個視頻采樣不同的幀數(shù),是否添加Non-Local模塊,以及MixUp與ColorJitter數(shù)據(jù)增強的實驗之后,團隊采用TSM,以ResNet50作為Backbone, 并以等間隔采樣的方式采樣32幀,最終取得了最好的單模成績。在融合ir-CSN結(jié)果后,取得了最好的線上成績。

賽題二

跨模態(tài)未裁剪動作時序定位

Cross-Modal Untrimmed Action Temporal Localization,在這項任務(wù)中,參與者使用來自MMAct 的未修剪視頻以及配對的傳感器數(shù)據(jù),在數(shù)據(jù)中包含交叉視角和交叉場景兩種類型的數(shù)據(jù),共35個動作類別。參與者允許使用未修剪的配對傳感器數(shù)據(jù)和視頻進行訓(xùn)練,然后在僅包含未修剪的視頻數(shù)據(jù)的測試集上進行時間動作定位,輸出未修剪視頻中識別的動作類別及其開始和結(jié)束時間,并采用AP作為評價指標。

賽題難點:

視頻時長較長,從幾分鐘到十幾分鐘不等;

測試階段只提供了視頻數(shù)據(jù)。

應(yīng)用場景:

視頻監(jiān)控、異常行為識別、定位

解決方案:

考慮到在測試集中只提供了視頻數(shù)據(jù),因此團隊的實現(xiàn)方案主要在視頻數(shù)據(jù)上進行實驗。在時序動作定位相關(guān)的工作中,主流的方法如BSN[5]、BMN[6]等。需要經(jīng)過:視頻抽幀-》提取光流-》行為識別算法進行特征提取-》時序動作定位算法進行動作定位-》行為識別算法進行動作識別等多個環(huán)節(jié),整個方案實現(xiàn)流程十分繁雜。

在實現(xiàn)方案中為了簡化方案流程,采用AFSD[7]作為算法實現(xiàn)。這是一個anchor-free的時序定位框架,并且是一個end-to-end使用視頻幀作為輸入而不是特征作為輸入的算法。

為了獲得模型的輸入,團隊對每個視頻以動態(tài)幀率采樣2304幀,并進行光流計算,這樣可以保證10分鐘以上的視頻有大約3幀的采樣幀率,不至于丟失過多的視頻信息。最后再分別采用RGB數(shù)據(jù)和光流數(shù)據(jù)進行訓(xùn)練,并融合兩種類型的預(yù)測結(jié)果后,取得了團隊最好成績。

編輯:jq

-

RGB

+關(guān)注

關(guān)注

4文章

803瀏覽量

59591 -

計算機視覺

+關(guān)注

關(guān)注

9文章

1706瀏覽量

46573 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1223瀏覽量

25276 -

深蘭科技

+關(guān)注

關(guān)注

1文章

71瀏覽量

6182

原文標題:賽道 | CVPR2021-MMAct挑戰(zhàn)賽跨模態(tài)動作識別雙冠方案解讀

文章出處:【微信號:kmdian,微信公眾號:深蘭科技】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

e絡(luò)盟社區(qū)聯(lián)合 TDK 發(fā)起超聲波傳感器挑戰(zhàn)賽

平頭哥半導(dǎo)體亮相AICAS 2025挑戰(zhàn)賽技術(shù)研討會

微軟AI開發(fā)者挑戰(zhàn)賽即將開啟

優(yōu)秀獎及決賽陣容震撼公布 第二屆OpenHarmony創(chuàng)新應(yīng)用挑戰(zhàn)賽決戰(zhàn)在即

探索具身智能邊界,地瓜機器人邀你共戰(zhàn)ICRA 2025 Sim2Real挑戰(zhàn)賽

芯華章持續(xù)助力EDA精英挑戰(zhàn)賽

EDA精英挑戰(zhàn)賽賽果公布!思爾芯“戰(zhàn)隊”薪火相承斬獲“麒麟杯”

e絡(luò)盟社區(qū)攜手恩智浦發(fā)起智能空間樓宇自動化挑戰(zhàn)賽

2024年ICPC與華為挑戰(zhàn)賽冠軍杯圓滿落幕

PI助力aCentauri車隊在太陽能車挑戰(zhàn)賽中大放異彩

50萬獎金池!開放原子大賽——第二屆OpenHarmony創(chuàng)新應(yīng)用挑戰(zhàn)賽正式啟動

NVIDIA為AI城市挑戰(zhàn)賽構(gòu)建合成數(shù)據(jù)集

AI4Science黑客松光子計算挑戰(zhàn)賽成功舉辦

思爾芯賽題正式發(fā)布,邀你共戰(zhàn)EDA精英挑戰(zhàn)賽!

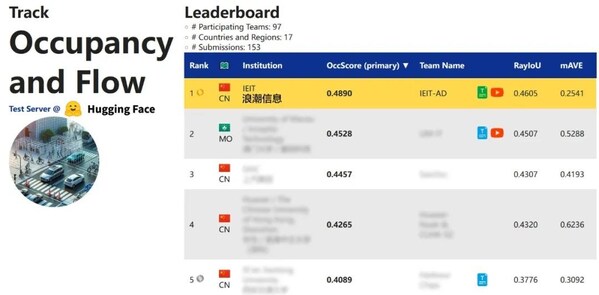

浪潮信息獲CVPR2024自動駕駛挑戰(zhàn)賽"Occupancy& Flow"冠軍

全面解讀CVPR2021-MMAct挑戰(zhàn)賽跨模態(tài)動作識別雙冠方案

全面解讀CVPR2021-MMAct挑戰(zhàn)賽跨模態(tài)動作識別雙冠方案

評論