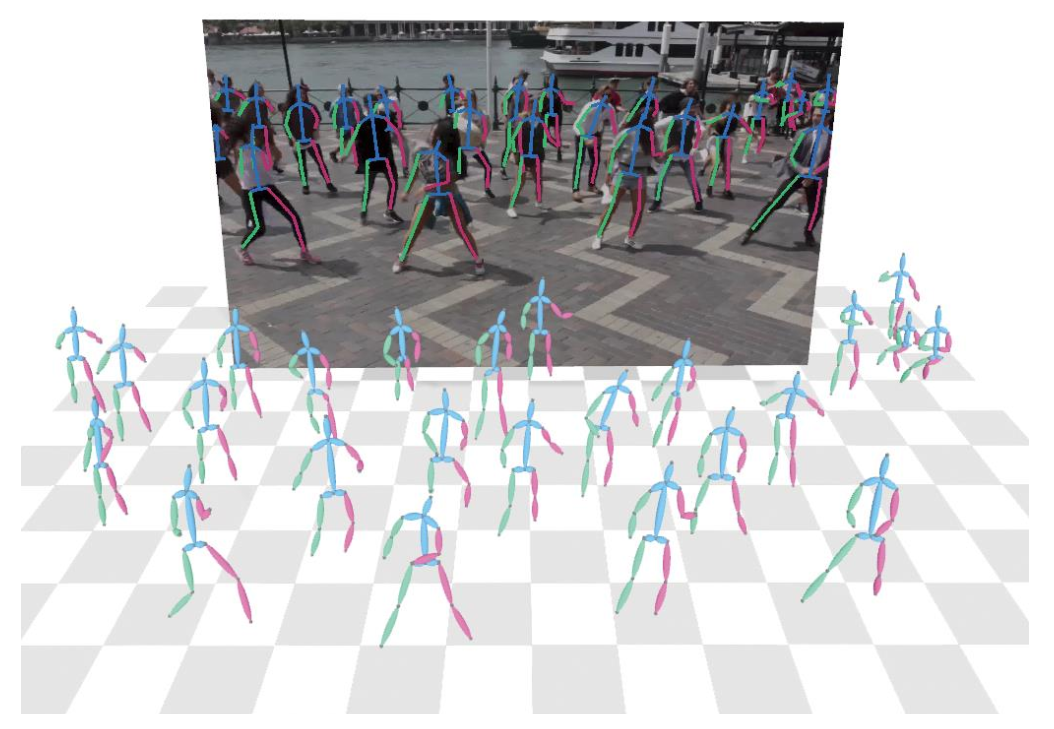

由單幀彩色圖像恢復(fù)多人的三維姿態(tài)和人與相機(jī)的絕對(duì)位置關(guān)系是一個(gè)具有挑戰(zhàn)性的任務(wù),因?yàn)閳D像在拍攝過程中損失了深度和尺度信息。在 ECCV2020 上,商湯與浙大聯(lián)合實(shí)驗(yàn)室提出了單步多人絕對(duì)三維姿態(tài)估計(jì)網(wǎng)絡(luò)和 2.5D 人體姿態(tài)表示方法,并且基于所提出的深度已知的關(guān)鍵點(diǎn)匹配算法,得到絕對(duì)三維人體姿態(tài)。該方法結(jié)合圖像的全局特征和局部特征,能獲得準(zhǔn)確的人體前后關(guān)系和人與相機(jī)的距離,在 CMU Panoptic 和 MuPoTS-3D 多人三維人體姿態(tài)估計(jì)數(shù)據(jù)集上均達(dá)到 SOTA(state-of-the-art),并且在未見過的場(chǎng)景中具有很好的泛化能力。

論文名稱:SMAP: Single-Shot Multi-PersonAbsolute 3D Pose Estimation

動(dòng)機(jī)

基于單幀圖像的人體絕對(duì)三維姿態(tài)估計(jì)在混合現(xiàn)實(shí)、視頻分析、人機(jī)交互等領(lǐng)域有很廣泛的應(yīng)用。近幾年研究人員多將注意力集中于人體相對(duì)三維姿態(tài)估計(jì)任務(wù)上,并且取得了不錯(cuò)的成果。但是對(duì)于多人場(chǎng)景下人體絕對(duì)三維姿態(tài)估計(jì)任務(wù),除了要估計(jì)相對(duì)人體三維姿態(tài),更重要的是估計(jì)人與相機(jī)的絕對(duì)位置關(guān)系。

當(dāng)前大多數(shù)方法對(duì)檢測(cè)到的人體區(qū)域進(jìn)行裁剪后,分別估計(jì)絕對(duì)位置。有的方法利用檢測(cè)框的大小作為人體尺寸的先驗(yàn),通過網(wǎng)絡(luò)回歸深度信息,但是這樣的方法忽略了圖像的全局信息;另外一些方法基于一些假設(shè),通過后處理的手段估計(jì)人體深度,如地面約束,但是這樣的方法依賴于姿態(tài)估計(jì)的準(zhǔn)確度,而且很多假設(shè)在實(shí)際場(chǎng)景中無法滿足(比如人腳不可見)。

我們認(rèn)為要準(zhǔn)確地估計(jì)人的絕對(duì)三維位置需要利用圖像中所有與深度相關(guān)的信息,比如人體尺寸、前后遮擋關(guān)系、人在場(chǎng)景中的位置等。近年來有很多工作利用卷積神經(jīng)網(wǎng)絡(luò)回歸場(chǎng)景的深度信息,這啟發(fā)我們使用網(wǎng)絡(luò)直接估計(jì)場(chǎng)景中所有人的深度信息,而不是在后處理過程中恢復(fù)深度。

綜上,我們提出了新的單步自底向上的方法估計(jì)多人場(chǎng)景的人體絕對(duì)三維姿態(tài),它可以在一次網(wǎng)絡(luò)推理后得到所有人的絕對(duì)位置信息和三維姿態(tài)信息。另外,我們還提出了基于深度信息的人體關(guān)鍵點(diǎn)匹配算法,包括深度優(yōu)先匹配和自適應(yīng)骨長(zhǎng)約束,進(jìn)一步優(yōu)化關(guān)鍵點(diǎn)的匹配結(jié)果。

方法介紹

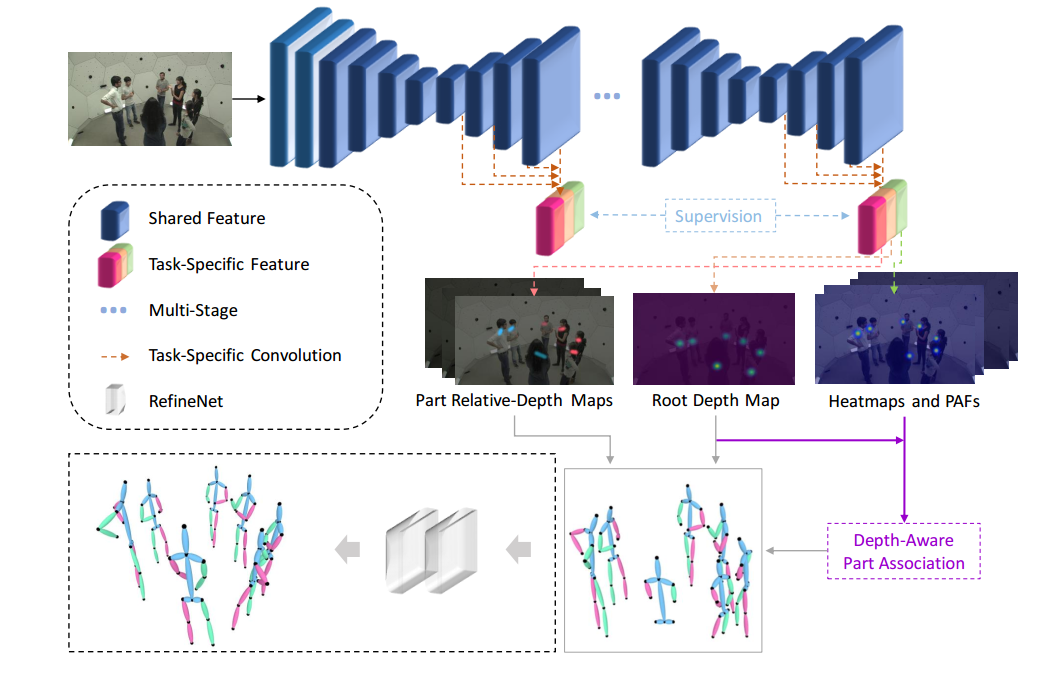

上圖展示了所提出方法的流程,包括 SMAP 網(wǎng)絡(luò),基于深度的關(guān)鍵點(diǎn)匹配(Depth-Aware Part Association), 和可選的微型優(yōu)化網(wǎng)絡(luò)(RefineNet)。輸入一張彩色圖像,SMAP 網(wǎng)絡(luò)同時(shí)輸出人體根節(jié)點(diǎn)深度圖(Root Depth Map)、二維關(guān)鍵點(diǎn)熱度圖(Heatmaps)、關(guān)鍵點(diǎn)連接向量場(chǎng)(PAFs)和骨骼相對(duì)深度圖(Part Relative-Depth Maps)。基于以上的 2.5D 特征表示方法,進(jìn)行關(guān)鍵點(diǎn)匹配,然后利用相機(jī)模型得到人體絕對(duì)三維關(guān)鍵點(diǎn)坐標(biāo)。最后,可以使用微型優(yōu)化網(wǎng)絡(luò)對(duì)結(jié)果進(jìn)行補(bǔ)全和優(yōu)化。

2.12.5D特征表示方式

2.1.1人體根節(jié)點(diǎn)深度圖(RootDepthMap)

由于圖像中人體數(shù)目是未知的,我們提出了人體根節(jié)點(diǎn)深度圖來表示場(chǎng)景中人的絕對(duì)深度,根節(jié)點(diǎn)深度圖中,每個(gè)人根節(jié)點(diǎn)(如脖子或腰部)位置的值表示其根節(jié)點(diǎn)的絕對(duì)深度,在訓(xùn)練時(shí),只對(duì)根節(jié)點(diǎn)位置進(jìn)行監(jiān)督。其優(yōu)勢(shì)在于,不受圖中人數(shù)限制,并且只需要三維人體姿態(tài)數(shù)據(jù)便可以訓(xùn)練,而不需要整張圖的深度信息。

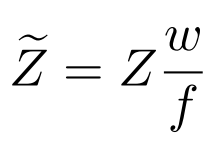

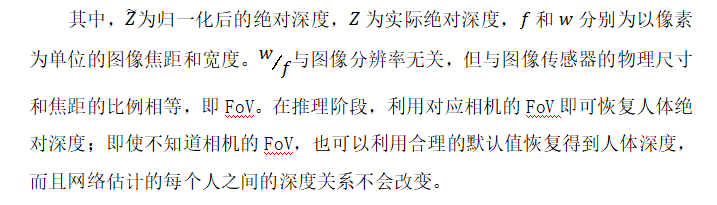

對(duì)于同一個(gè)深度下的同一個(gè)人,具有不同內(nèi)參(FoV, field of view)的相機(jī)會(huì)得到不同的二維圖像,這對(duì)建立二維信息(如人體尺寸)和絕對(duì)深度之間的映射關(guān)系是不利的,所以需要對(duì)輸入網(wǎng)絡(luò)的深度利用 FoV 進(jìn)行歸一化:

2.1.2Heatmaps和 PAFs

對(duì)于二維信息,我們采用與 OpenPose 相同的表示方式。關(guān)鍵點(diǎn)熱度圖(Heatmaps)表示關(guān)鍵點(diǎn)位于某個(gè)像素的概率,關(guān)鍵點(diǎn)連接向量場(chǎng)(PAFs)表示關(guān)鍵點(diǎn)之間相連的方向和概率。

2.1.3骨骼相對(duì)深度圖(PartRelative-DepthMaps)

骨骼相對(duì)深度圖生成方式與 PAFs 相同,區(qū)別在于它的值表示的是關(guān)鍵點(diǎn)之間的深度差。

2.2基于深度的關(guān)鍵點(diǎn)匹配算法

由關(guān)鍵點(diǎn)熱度圖(Heatmap)得到人體根節(jié)點(diǎn)位置后,便可以從根節(jié)點(diǎn)深度圖(Root DepthMap)中讀取每個(gè)人的深度信息,我們利用深度信息進(jìn)一步優(yōu)化人體關(guān)鍵點(diǎn)匹配算法,以解決二維關(guān)鍵點(diǎn)匹配算法中存在的歧義性問題。

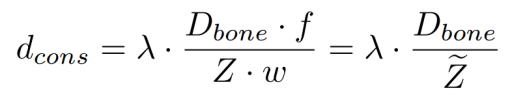

如圖第一行所示,我們提出深度優(yōu)先匹配,當(dāng)兩個(gè)人存在遮擋時(shí),如果同一個(gè)關(guān)鍵點(diǎn)有所重疊,單純基于二維信息的匹配方式無法確定該關(guān)鍵點(diǎn)的所屬關(guān)系,有可能導(dǎo)致大部分關(guān)鍵點(diǎn)的錯(cuò)連,如第三列所示。而重疊的關(guān)鍵點(diǎn)在絕大多數(shù)場(chǎng)景中應(yīng)該屬于前一個(gè)人,所以基于網(wǎng)絡(luò)推斷的深度信息,我們給予靠近相機(jī)的人更大的連接優(yōu)先級(jí),如第四列所示。 另外,我們還提出了自適應(yīng)骨長(zhǎng)距離約束。在二維匹配算法中,一般設(shè)置圖像寬度的一半為關(guān)鍵點(diǎn)匹配的距離約束,但是由于人與相機(jī)距離不同,在二維圖像中呈現(xiàn)的尺寸不同,固定的約束無法起到很好的效果,如圖中第二行第三列所示。對(duì)于每個(gè)骨骼,我們使用訓(xùn)練集中該骨骼的平均長(zhǎng)度作為其實(shí)際長(zhǎng)度,然后利用網(wǎng)絡(luò)輸出的深度計(jì)算其在二維圖像中的最大長(zhǎng)度如下:

2.3絕對(duì)三維姿態(tài)恢復(fù)

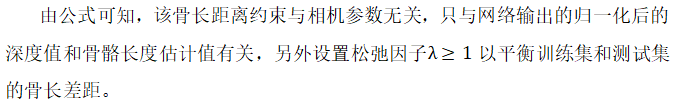

由基于深度的匹配算法獲得人體關(guān)鍵點(diǎn)匹配結(jié)果后,可以由根節(jié)點(diǎn)絕對(duì)深度和骨骼相對(duì)深度得到每一個(gè)關(guān)鍵點(diǎn)的絕對(duì)深度,然后利用如下公式

反投影得到人體關(guān)鍵點(diǎn)絕對(duì)三維坐標(biāo)。其中 K 是相機(jī)內(nèi)參矩陣,在絕大部分應(yīng)用中都是已知的,如果未知,可以使用估計(jì)值。

由上述步驟恢復(fù)的結(jié)果可能會(huì)引入兩種誤差:由于骨架是以級(jí)聯(lián)的方式表示的,在恢復(fù)末端關(guān)節(jié)點(diǎn)深度時(shí),會(huì)有累計(jì)誤差;另外,嚴(yán)重的遮擋和圖像截?cái)鄷?huì)導(dǎo)致人體某些關(guān)鍵點(diǎn)的缺失。對(duì)此,我們提出了微型補(bǔ)全網(wǎng)絡(luò) RefineNet,輸入估計(jì)的相對(duì)二維和三維關(guān)鍵點(diǎn)坐標(biāo),輸出優(yōu)化和補(bǔ)全后的相對(duì)三維關(guān)鍵點(diǎn)坐標(biāo)。RefinNet 并不會(huì)對(duì)人體根節(jié)點(diǎn)絕對(duì)深度進(jìn)行優(yōu)化。

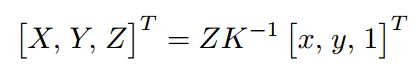

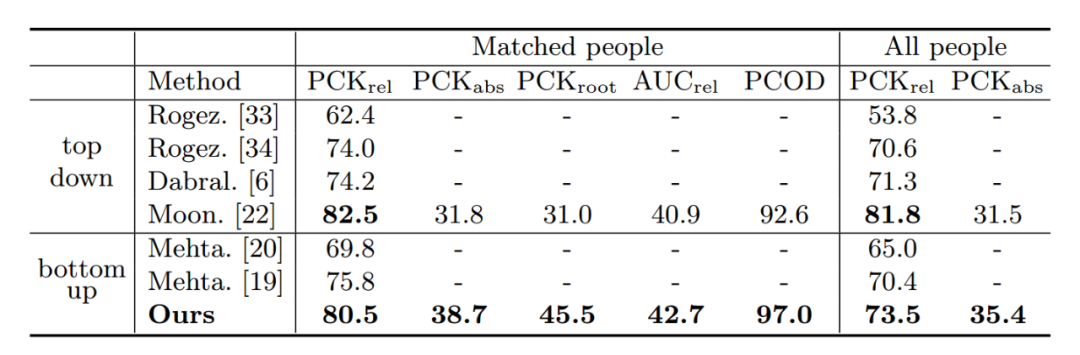

實(shí)驗(yàn)結(jié)果 我們提出的方法在 CMU Panoptic 和 MuPoTS-3D 多人三維人體姿態(tài)估計(jì)數(shù)據(jù)集上均達(dá)到 SOTA。

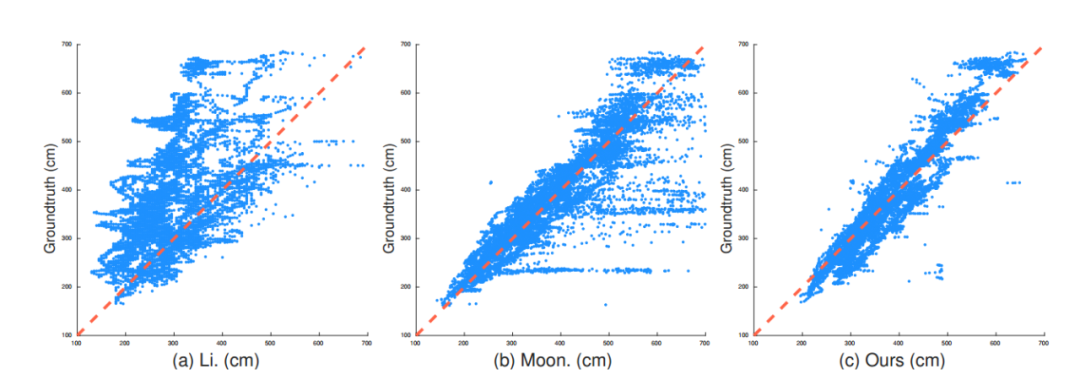

另外,我們對(duì)不同可選的深度估計(jì)方法進(jìn)行了對(duì)比。第一種,回歸全圖的深度[1],如圖第一列;第二種,根據(jù)檢測(cè)框的尺寸回歸人體深度[2],如圖第二列。散點(diǎn)圖的橫坐標(biāo)為人體深度估計(jì)值,縱坐標(biāo)為實(shí)際值,散點(diǎn)越靠近 x=y 直線說明回歸的深度越準(zhǔn)確。可以看出,我們提出的方法(Root Depth Map)具有更好的深度一致性和泛化能力。

為了體現(xiàn)單步自底向上網(wǎng)絡(luò)相對(duì)于自頂向下網(wǎng)絡(luò)[2]的優(yōu)勢(shì),我們進(jìn)行了定性分析。圖中左邊為自頂向下網(wǎng)絡(luò)的結(jié)果,可見自頂向下的方法會(huì)受到姿態(tài)變化、人體遮擋、人體截?cái)嗟挠绊懀覀兲岢龅淖缘紫蛏系姆椒梢岳萌中畔⒕徑膺@個(gè)問題。

-

三維

+關(guān)注

關(guān)注

1文章

516瀏覽量

29353 -

匹配算法

+關(guān)注

關(guān)注

0文章

24瀏覽量

9434 -

SMAP

+關(guān)注

關(guān)注

0文章

4瀏覽量

8899

原文標(biāo)題:ECCV2020 | SMAP: 單步多人絕對(duì)三維姿態(tài)估計(jì)

文章出處:【微信號(hào):tyutcsplab,微信公眾號(hào):智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

基于深度學(xué)習(xí)的三維點(diǎn)云配準(zhǔn)方法

起點(diǎn),經(jīng)過點(diǎn),終點(diǎn),三點(diǎn)xyz,畫三維圓弧。

基于OpenGL 的汽車轉(zhuǎn)向三維模型設(shè)計(jì)

三維快速建模技術(shù)與三維掃描建模的應(yīng)用

視頻運(yùn)動(dòng)捕獲系統(tǒng)中多標(biāo)記點(diǎn)的三維跟蹤算法

三維模型的空間匹配與拼接

利用并查集的多視匹配點(diǎn)提取算法

彩色分割立體匹配的三維目標(biāo)快速重建

計(jì)算機(jī)視覺:三維點(diǎn)云數(shù)據(jù)處理學(xué)習(xí)內(nèi)容總結(jié)

圖像匹配應(yīng)用及方法

基于深度學(xué)習(xí)的三維點(diǎn)云語義分割研究分析

什么樣的點(diǎn)可以稱為三維點(diǎn)云中的關(guān)鍵點(diǎn)呢?

三維計(jì)算視覺研究分析

總結(jié)!三維點(diǎn)云基礎(chǔ)知識(shí)

基于深度的關(guān)鍵點(diǎn)匹配算法實(shí)現(xiàn)單步多人絕對(duì)三維姿態(tài)

基于深度的關(guān)鍵點(diǎn)匹配算法實(shí)現(xiàn)單步多人絕對(duì)三維姿態(tài)

評(píng)論