在過去的幾年中,隨著AI解決方案在我們的日常生活中越來越根深蒂固,人工智能(AI)的偏見已成為熱門話題。 作為轉向數據科學的心理學家,這個話題非常貼切。

為了避免使AI模型產生偏差,首先必須意識到存在各種各樣的偏差。

為了檢測偏見,必須意識到它的存在。

為此,本文將指導您解決在開發AI的不同階段中可能遇到的許多常見和不常見的偏見。 這些階段包括:

· 數據采集

· 數據預處理

· 數據分析

· 建模

希望,了解您可能遇到的偏見將有助于您開發偏見較少的AI解決方案。

1.什么是偏見?

偏見被認為是對一個想法或事物的偏愛或偏見。 偏見通常是在人類的背景下想到的,但它可以存在于許多不同的領域:

· 統計信息-例如,統計信息的系統失真

· 研究-例如,偏向于發表某些實驗性重大成果

· 社會科學-例如,對某些人群的偏見

在本文中,我們將結合幾個領域,在這些領域中可能會出現(認知)偏差,以了解偏差如何進入人工智能。

在下文中,我將經歷AI開發的常見階段,并確定步驟以檢測可能在哪里發現偏差。

2.數據收集

數據收集是您會發現偏見的第一個也是最常見的地方之一。 造成這種情況的最大原因是,數據通常是由人收集或創建的,從而允許錯誤,離群值和偏差易于滲入數據中。

數據收集過程中常見的偏見:

· 選擇偏差-選擇數據時樣本不能代表總體的數據選擇

例如,在許多社會研究中,研究人員一直在使用學生作為參與者,以檢驗其假設。 學生顯然不能代表一般人群,并且可能會偏向所發現的結果。

Selection Bias

· 框架效應-調查以特定傾向構建的問題。

如下圖所示,如果這個問題的答案是肯定的,那么人們更有可能挽救200條生命,而挽救所有人的幾率是33%。

當出現正構架提示(“挽救200條生命”)時,有72%的參與者選擇了治療A,而當出現負構架提示(“ 400人將死亡”)時,則下降為22%。

· 系統性偏差-這是一個一致且可重復的錯誤。

這通常是設備故障的結果。 由于此錯誤很難檢測,因此更正此錯誤很重要。 必須對機械或過程有充分的了解。

Systematic Error

· 回應偏見—一系列偏見,參與者對問題的回答不正確或錯誤。

答復偏見經常出現在問卷中。 由于這些都是參與者填寫的,因此人為偏見很容易在數據中找到。 例如,《社會可取性偏見》指出人們很可能否認其反應中的不良特征。 這可以通過強調良好行為或低估不良行為來實現。 類似地,"問題順序偏向"指出人們可能會根據問題的順序不同地回答問題。

重要的是要了解,您如何設計收集過程會嚴重影響將要收集的數據類型。 如果不小心,您的數據將嚴重偏向某些群體。 任何結果分析都可能有缺陷!

3.數據預處理

處理數據時,可以采取許多步驟來準備進行分析:

· 離群值檢測

您通常希望刪除異常值,因為它們可能對某些分析產生不成比例的影響。 在所有人都在20到30歲之間的數據集中,一個110歲的人可能不太能代表數據。

· 缺失值

您如何處理某些變量的缺失值會引入偏差。 如果要用均值填充所有缺失值,那么您有意將數據推向均值。 這可能會使您偏向表現更接近均值的某些群體。

· 篩選資料

我已經多次看到這種情況,對數據進行了如此多的過濾,以致于它幾乎不再代表目標人群。 這以某種方式將選擇偏差引入數據。

4.數據分析

在開發AI解決方案時,最終產品可能是模型或算法。 但是,在數據分析中也很容易發現偏差。 通常,我們會在數據分析中看到以下偏見:

· 誤導圖-扭曲的圖,它歪曲了數據,因此可能從中得出不正確的結論。

例如,當報告分析結果時,數據科學家可以選擇將其圖的y軸從0開始。盡管這不會在數據本身中引入偏差,但由于差異似乎是 更明顯(見下圖)。

如果Y軸從0%開始,則農作物產量的差異似乎很小。但是,簡單地將其更改為從70%開始會產生看似不同的觀點,而結果實際上是相同的。

如果您想進一步了解誤導圖的影響,強烈建議您閱讀"如何利用統計數據撒謊"一書!

· 確認偏見—傾向于專注于確認先入之見的信息的傾向。

假設您認為癌癥和喝酒之間有很強的關系。 在執行分析時,您僅通過不考慮任何混淆變量來搜索以確認該假設。

The confirmation Bias

這似乎是一個極端的例子,您將永遠做不到。 但是現實是,人類天生就有偏見,這很難撼動。 發生在我身上的次數比我想承認的要多!

5.建模

當談論AI的偏見時,人們通常指的是某種程度上有利于特定人群的AI系統。 一個很好的例子就是亞馬遜創建的招聘算法,該算法在決策中顯示了性別偏見。 他們用于此算法的數據主要由擔任技術職務的男性組成,這使其傾向于使用男性作為高潛力候選人。

這是垃圾填充現象的經典示例,其中您的AI解決方案僅與您使用的數據一樣好。 這就是為什么在開始對數據進行建模之前檢測數據中的偏差如此重要的原因。

讓我們研究一下在創建預測模型時經常會看到的幾種類型的偏差:

· 偏差/方差折衷-偏差(模型的基本假設)和方差(如果使用不同的數據,則預測的變化)之間的折衷。

具有高方差的模型將過多地關注火車數據,并且不能很好地推廣。 另一方面,高偏差假定數據始終以相同的方式運行,這很少是正確的。 當增加偏見時,通常會降低方差,反之亦然。 因此,我們經常尋求平衡偏見和差異。

Demonstrating the effect of the trade-off between bias and variance.

· 概念漂移–一種現象,目標變量的統計屬性會隨時間發生意外變化。

假設您創建了一個模型,可以預測在線商店中客戶的行為。 該模型起初很棒,但一年后性能下降。 發生的事情是客戶的行為在過去一年中發生了變化。 客戶行為的概念已經改變,并對模型的質量產生負面影響。

解決方案可能只是簡單地使用新數據重新訓練您的模型,以便及時掌握新行為。 但是,可能需要一個全新的模型。

The original data (left) versus concept drift (right) after time has passed and new data was added.

· 分類不平衡-(目標)分類頻率的極端不平衡。

假設您要對圖片包含貓還是狗進行分類。 如果您有1000張狗的照片而只有10張貓的照片,則存在類不平衡。

階級失衡的結果是該模型可能偏向多數階級。 由于數據中的大多數圖片都是狗,因此該模型只需要始終猜測"狗"即可達到99%的準確率。 實際上,該模型尚未了解到貓和狗的圖片之間的差異。 可以通過選擇正確的驗證措施(例如,平衡準確度或F1得分而不是準確度)來補救。

6.接下來是什么?

在了解了AI解決方案中的所有這些潛在偏見之后,您可能會認為:

"但是我該如何消除解決方案中的偏見?"

我認為,要解決偏見,您需要了解其根源。 知道是成功的一半。 之后,由您自己確定消除或處理該特定偏差的方法。 例如,如果您發現問題是由于數據中的選擇偏差引起的,那么最好添加其他數據。 如果類別不平衡使您的模型更偏向多數群體,那么您可以研究重采樣策略(例如SMOTE)。

注意:有關常見認知偏差的交互式概述,請參見此驚人的可視化。

-

AI

+關注

關注

87文章

34173瀏覽量

275339 -

人工智能

+關注

關注

1804文章

48691瀏覽量

246423

發布評論請先 登錄

生成式AI如何重塑設計思維與品牌創新?從工具到認知革命的躍遷

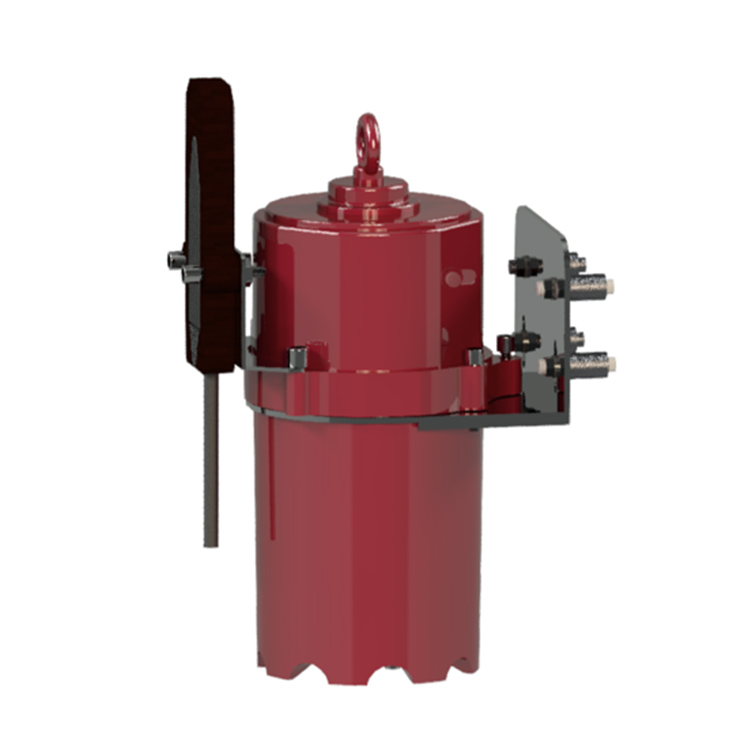

解決手表后殼氣密性檢測儀常見問題的實用技巧

中偉視界:解密AI智能攝像機算法,讓傳送帶跑偏檢測更高效!

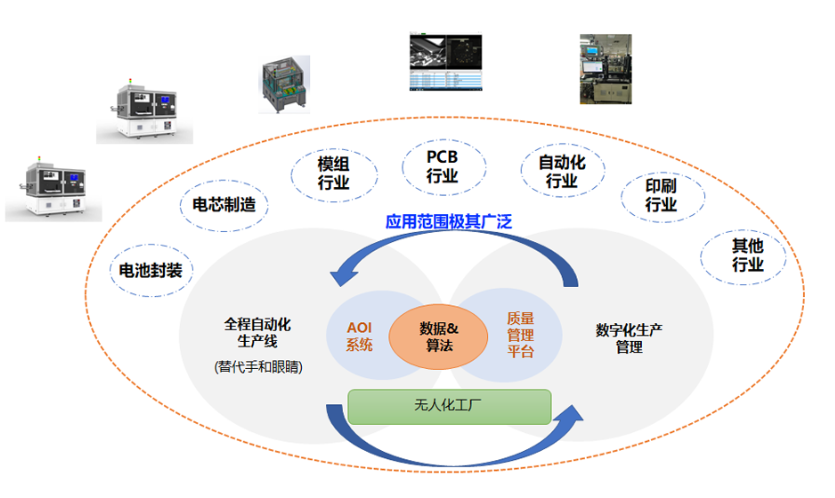

AI智能質檢系統 工業AI視覺檢測

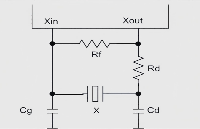

晶振的頻率偏差與解決方法

電源檢測設備如何解決常見問題?

常見晶振故障及解決方法 晶振在物聯網中的應用

電子電器氣密性檢測儀使用方法:操作中的常見錯誤與糾正

莫拉維克悖論與多模態AI:邁向機器人認知的新時代

檢測系統中常見的信號類型有哪些

新一代智能插件AOI用極速編程顛覆了傳統AOI認知

檢測AI中的常見認知偏差

檢測AI中的常見認知偏差

評論