華為申請的此項專利,能夠在保證神經(jīng)網(wǎng)絡(luò)精度的前提下,壓縮網(wǎng)絡(luò)模型,同時還能極大地減小了憶阻器器件噪音對神經(jīng)網(wǎng)絡(luò)準確性的影響。

集微網(wǎng)消息,憶阻器全稱記憶電阻,即表示具有記憶能力的電阻,被認為是能夠突破摩爾定律的新方向。有數(shù)據(jù)統(tǒng)計稱,一個憶阻器的工作量相當于一枚CPU芯片中十幾個晶體管共同產(chǎn)生的效用,而國內(nèi)巨頭華為公司也開始“低調(diào)”研發(fā)。

近年來,神經(jīng)網(wǎng)絡(luò)(neural network,NN)計算取得了突破性進展,在圖像識別、語言識別、自然語言處理等諸多領(lǐng)域均取得了很高的準確率。然而神經(jīng)網(wǎng)絡(luò)需要海量計算資源,傳統(tǒng)的通用處理器已經(jīng)很難滿足深度學習的計算需求,設(shè)計專用芯片已經(jīng)成為了一個重要的發(fā)展方向。憶阻器具有高密度、非易失、低功耗、存算合一、易于3D等優(yōu)點,為神經(jīng)網(wǎng)絡(luò)芯片設(shè)計提供了一種高效的解決方案。憶阻器陣列作為神經(jīng)網(wǎng)絡(luò)加速芯片,以加速矩陣乘法運算為主要的設(shè)計目標,整個過程在模擬電路下實現(xiàn),具有速度快,面積小的優(yōu)點。

但是,憶阻器器件在實際應(yīng)用中,存在噪音的問題,即設(shè)置的憶阻器電導值并不精確的等于所需要的值,而是落在期望值附近的一個分布中。如何降低憶阻器器件噪聲對神經(jīng)網(wǎng)絡(luò)的準確性的影響,是亟待解決的問題。

為此,華為申請了一項名為“一種神經(jīng)網(wǎng)絡(luò)訓練方法及裝置”的發(fā)明專利(申請?zhí)枺?01810702883 .9),申請人為華為技術(shù)有限公司。

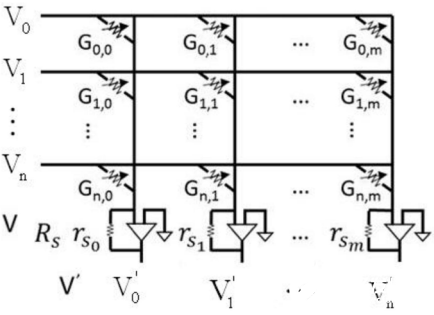

圖1 神經(jīng)網(wǎng)絡(luò)示意圖

神經(jīng)網(wǎng)絡(luò)的建模通常以若干神經(jīng)元為一層,層與層之間相互連接來構(gòu)建,如圖1所示,是一種鏈狀的神經(jīng)網(wǎng)絡(luò)示意圖。其中圖1中每一個圓表示一個神經(jīng)元,每一個箭頭表示神經(jīng)元之間的連接,每個連接均有權(quán)重。

在神經(jīng)網(wǎng)絡(luò)的應(yīng)用中,矩陣向量乘運算是常見的操作,可以利用憶阻器交叉開關(guān)陣列具有的存儲和計算在同一個物理位置的特性,用憶阻器交叉開關(guān)陣列來進行矩陣向量乘運算來提高神經(jīng)網(wǎng)絡(luò)的計算效率。

圖2 憶阻器開關(guān)陣列

本專利提出的神經(jīng)網(wǎng)絡(luò)訓練方法可以應(yīng)用于如圖2所示的憶阻器開關(guān)陣列,如圖2所示,輸入向量為不同的電壓值V0-Vn,可以表示為向量V,經(jīng)過憶阻器交叉開關(guān)陣列計算后,輸出為新的電壓值V '0-V 'm,可以表示為向量V '。其中,V '=VGRs,向量Rs包括元素 rs0, rs1,…, rsm其中rsj表示第j列的接地電阻值。

實際應(yīng)用中,憶阻器器件的噪音會給基于憶阻器的神經(jīng)網(wǎng)絡(luò)的表達能力帶來負面影響,為了消除噪音對于實際神經(jīng)網(wǎng)絡(luò)性能的影響,可以在神經(jīng)網(wǎng)絡(luò)訓練時引入噪音,通過將底層器件噪音暴露給軟件訓練層面,來抵消一部分硬件層面的噪音所帶來的精度影響。

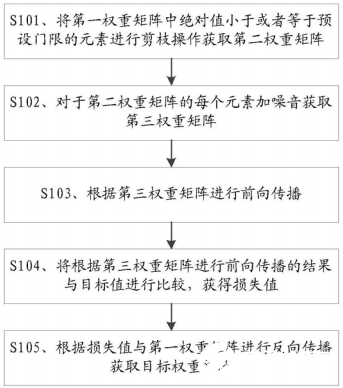

圖3 神經(jīng)網(wǎng)絡(luò)訓練方法示意圖

該專利中提出的可用于圖1、2的神經(jīng)網(wǎng)絡(luò)訓練方法示意圖如上所示,該訓練方法主要包括如下幾個步驟:

首先,將第一權(quán)重矩陣中絕對值小于或者等于預(yù)設(shè)門限的元素進行剪枝操作獲取第二權(quán)重矩陣。其中,第一權(quán)重矩陣為預(yù)設(shè)權(quán)重矩陣,可以將神經(jīng)網(wǎng)絡(luò)中需要進行訓練的權(quán)重矩陣設(shè)置為預(yù)設(shè)權(quán)重矩陣。然后為第二權(quán)重矩陣的每個元素附加一個噪音,該噪音用于模擬憶阻器器件噪音,以此獲得第三權(quán)重矩陣。接著,根據(jù)第三權(quán)重矩陣進行前向傳播,并將相應(yīng)的結(jié)果與目標值進行比較,獲得損失值。最后再將損失值和第一權(quán)重矩陣進行反向傳播以獲取目標權(quán)重矩陣。

華為申請的此項專利,能夠在保證神經(jīng)網(wǎng)絡(luò)精度的前提下,壓縮網(wǎng)絡(luò)模型,同時還能極大地減小了憶阻器器件噪音對神經(jīng)網(wǎng)絡(luò)準確性的影響。

雖然憶阻器前景較好,但國內(nèi)市場進行憶阻器芯片研發(fā)的企業(yè)較少,憶阻器的大部分技術(shù)仍停留在實驗室階段,而作為國內(nèi)科技“領(lǐng)頭羊”的華為公司也開始展開阻器的研究,可謂給其他企業(yè)吃了一顆“定心丸”,勢必會引起國內(nèi)憶阻器行業(yè)的研發(fā)浪潮。

-

華為

+關(guān)注

關(guān)注

216文章

35024瀏覽量

255045 -

憶阻器

+關(guān)注

關(guān)注

8文章

75瀏覽量

20296

發(fā)布評論請先 登錄

BP神經(jīng)網(wǎng)絡(luò)與卷積神經(jīng)網(wǎng)絡(luò)的比較

人工神經(jīng)網(wǎng)絡(luò)的原理和多種神經(jīng)網(wǎng)絡(luò)架構(gòu)方法

自旋憶阻器:最像大腦的存儲器

吉時利源表軟件在憶阻器測試中的應(yīng)用

華為降低憶阻器對神經(jīng)網(wǎng)絡(luò)的影響專利

華為降低憶阻器對神經(jīng)網(wǎng)絡(luò)的影響專利

評論