來源:OpenVINO 中文社區

為什么選擇 Ollama + OpenVINO 組合?

雙引擎驅動的技術優勢

Ollama 和 OpenVINO 的結合為大型語言模型(LLM)的管理和推理提供了強大的雙引擎驅動。Ollama 提供了極簡的模型管理工具鏈,而 OpenVINO 則通過 Intel 硬件(CPU/GPU/NPU)為模型推理提供了高效的加速能力。這種組合不僅簡化了模型的部署和調用流程,還顯著提升了推理性能,特別適合需要高性能和易用性的場景。

項目地址:openvino_contrib

(https://github.com/openvinotoolkit/openvino_contrib/tree/master/modules/ollama_openvino)

Ollama 的核心價值

1.極簡的 LLM 管理工具鏈:Ollama 提供了簡單易用的命令行工具,用戶可以輕松地下載、管理和運行各種 LLM 模型。

2.支持模型一鍵部署:通過簡單的命令,用戶可以快速部署和調用模型,無需復雜的配置。

3.提供統一的 API 接口:Ollama 提供了統一的 API 接口,方便開發者集成到各種應用中。

4.活躍的開源社區生態:Ollama 擁有活躍的開源社區,用戶可以獲取豐富的資源和支持。

Ollama 局限性

Ollama 目前僅支持 llama.cpp 作為后端,這帶來了一些不便:

1.硬件兼容性受限:llama.cpp 主要針對 CPU 以及NVIDIA GPU優化,無法充分利用 INTEL GPU 或 NPU 等硬件加速能力,導致在需要高性能計算的場景下表現不足。

2.性能瓶頸:對于大規模模型或高并發場景,llama.cpp 的性能可能無法滿足需求,尤其是在處理復雜任務時,推理速度較慢。

OpenVINO 的突破性能力

1.為 Intel 硬件提供深度優化(CPU/iGPU/Arc dGPU/NPU):OpenVINO 針對 Intel 硬件進行了深度優化,能夠充分發揮 CPU、集成 GPU、獨立 GPU 和 NPU 的性能潛力。

2.支持跨平臺異構計算:OpenVINO 支持跨平臺異構計算,能夠在不同硬件平臺上實現高效的模型推理。

3.提供模型量化壓縮工具鏈:OpenVINO 提供了豐富的模型量化壓縮工具鏈,能夠顯著減少模型大小,提升推理速度。

4.實現推理性能顯著提升:通過 OpenVINO 的優化,模型推理性能可以得到顯著提升,特別是在大規模模型和高并發的場景。

5.可擴展性與靈活性支持: OpenVINO GenAI 為 Ollama-OV 提供了強大的可擴展性和靈活性,支持speculative decoding,Prompt-lookup decoding, pipeline parallel, continuous batching 等 pipeline 優化技術,為未來更多 pipeline serving 優化奠定了堅實基礎。

集成帶來的開發者紅利

1.極簡開發體驗:保留 Ollama 的 CLI 交互特性,開發者可以繼續使用熟悉的命令行工具進行模型管理和調用。

2.性能飛躍:通過 OpenVINO 獲得硬件級加速,模型推理性能得到顯著提升,特別是在大規模模型和高并發場景下。

3.多硬件適配,生態擴展:OpenVINO 的支持使得 Ollama 能夠適配多種硬件平臺,擴展了其應用生態,為開發者提供了更多的選擇和靈活性。

三步開啟加速體驗

1. 下載預先編譯好了 Linux、Windows 系統的可執行文件,文件下載地址:

下載鏈接參考:

https://github.com/openvinotoolkit/openvino_contrib/tree/master/modules/ollama_openvino#%E7%99%BE%E5%BA%A6%E4%BA%91%E7%9B%98

源碼編譯參考:

https://github.com/openvinotoolkit/openvino_contrib/tree/master/modules/ollama_openvino#building-from-source

2. 配置 OpenVINO GenAI 的環境

以 windows 系統為例,首先將下載的 OpenVINO GenAI 壓縮包解壓到目錄 openvino_genai_windows_2025.2.0.0.dev20250320_x86_64 下。

然后執行以下命令:

cd openvino_genai_windows_2025.2.0.0.dev20250320_x86_64 setupvars.bat

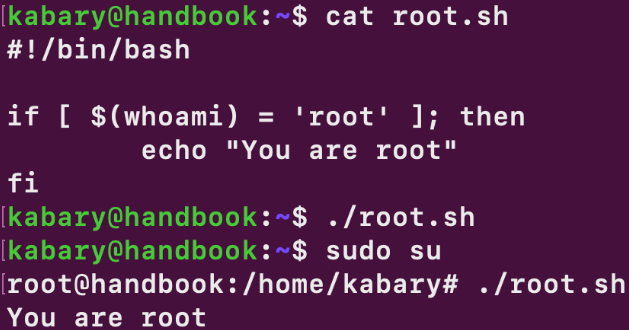

3. 設置 cgocheck

Windows:

set GODEBUG=cgocheck=0

Linux:

export GODEGUG=cgocheck=0

到此,可執行文件已經下載完成、OpenVINO GenAI、OpenVINO、CGO環境也已經配置完成。

自定義模型實戰

因為 Ollama model library 不支持上傳非 GGUF 格式的 IR,所以我們在本地基于 OpenVINO IR 制作 Ollama 支持的 OCI image;我們以 DeepSeek-R1-Distill-Qwen-7B 為例:

1. 下載 OpenVINO IR 模型,從 ModelScope 下載:

pip install modelscope modelscope download --model zhaohb/DeepSeek-R1-Distill-Qwen-7B-int4-ov --local_dir ./DeepSeek-R1-Distill-Qwen-7B-int4-ov

2. 把下載的 OpenVINO IR 的目錄打包成 *tar.gz 的格式

tar -zcvf DeepSeek-R1-Distill-Qwen-7B-int4-ov.tar.gz DeepSeek-R1-Distill-Qwen-7B-int4-ov

3. 創建 Modelfile 文件

FROM DeepSeek-R1-Distill-Qwen-7B-int4-ov.tar.gz ModelType "OpenVINO" InferDevice "GPU" PARAMETER repeat_penalty 1.0 PARAMETER top_p 1.0 PARAMETER temperature 1.0

4. 創建 ollama 支持的模型

ollama create DeepSeek-R1-Distill-Qwen-7B-int4-ov:v1 -f Modelfile

這樣我們就創建了 DeepSeek-R1-Distill-Qwen-7B-int4-ov:v1 可以供 Ollama OpenVINO 后端使用的模型。

5. 使用該模型

ollama run DeepSeek-R1-Distill-Qwen-7B-int4-ov:v1 "請幫我推薦北京著名的景點"

至此,您已經掌握了如何在 Ollama 中使用 OpenVINO 后端。

-

英特爾

+關注

關注

61文章

10152瀏覽量

173740 -

接口

+關注

關注

33文章

8904瀏覽量

153068 -

gpu

+關注

關注

28文章

4891瀏覽量

130506 -

AI

+關注

關注

87文章

33789瀏覽量

274614 -

OpenVINO

+關注

關注

0文章

113瀏覽量

395

原文標題:當 Ollama 遇上 OpenVINO? :解鎖多硬件 AI 推理新范式

文章出處:【微信號:英特爾物聯網,微信公眾號:英特爾物聯網】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

無法在OpenVINO工具套件中使用ENetwork.層怎么解決?

如何在UltraScale+設計中使用UltraRAM模塊

如何在測試中使用ChatGPT

在MAC mini4上安裝Ollama、Chatbox及模型交互指南

如何在Ollama中使用OpenVINO后端

如何在Ollama中使用OpenVINO后端

評論