作者:算力魔方創始人/英特爾創新大使劉力

一,簡介

本文將指導您如何在MAC mini4上安裝Ollama和Chatbox,并下載Deepseek-r1:32b模型。Ollama是一個用于管理和運行大型語言模型的工具,而Chatbox則是一個用戶友好的聊天界面,用于與這些模型進行交互。Deepseek-r1:32b是一個高性能的語言模型,適用于多種自然語言處理任務。

二,安裝Ollama和Chatbox AI

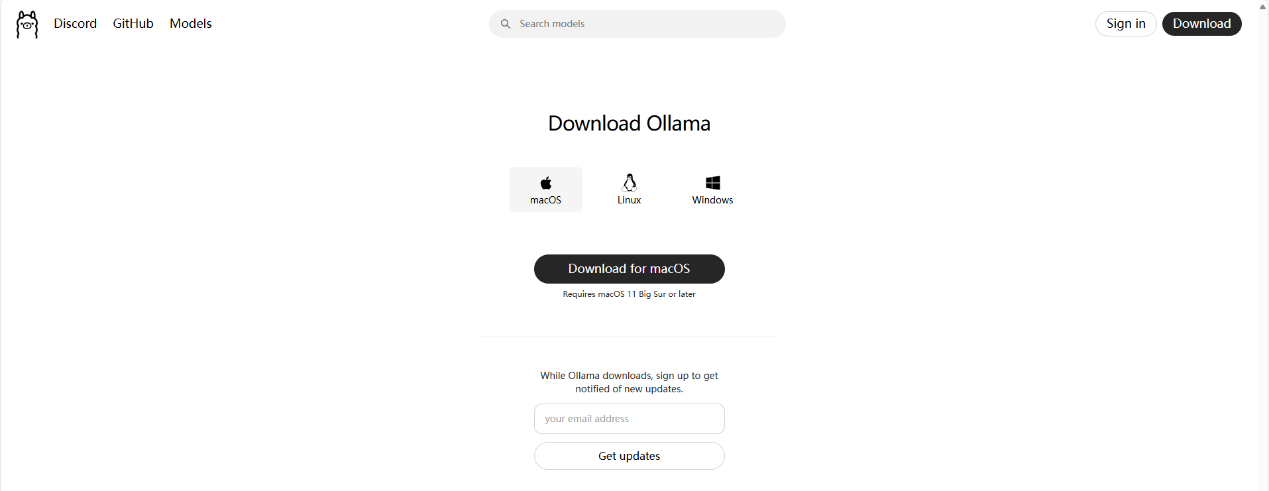

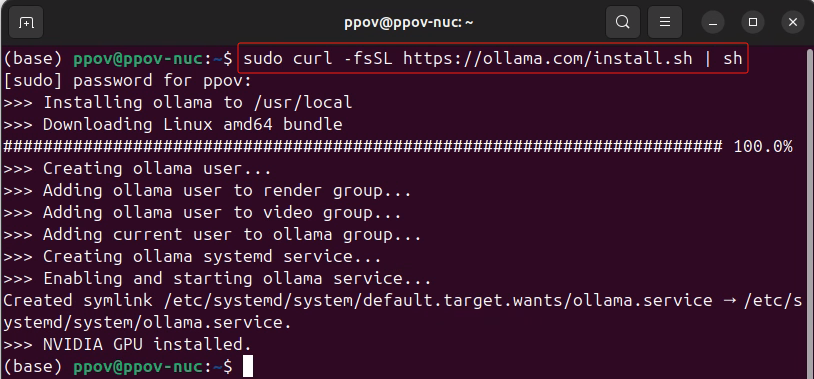

1,下載安裝Ollama;

訪問Ollama的官方網址:(https://ollama.com/)。下載最新的macOS版本文件。

打開下載的文件雙擊ollama圖標安裝程序進行默認安裝即可。

2,下載安裝Chatbox;

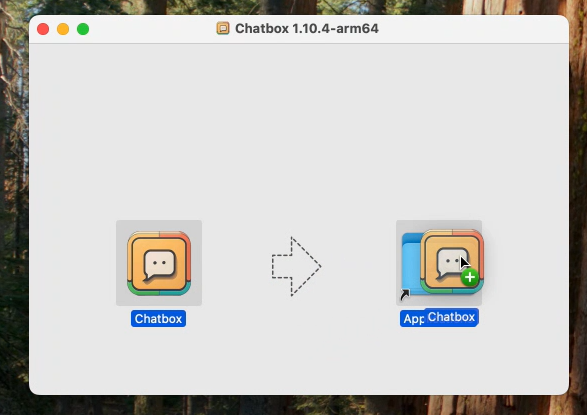

訪問Chatbox的官方網站(https://chatboxai.app/zh#download)下載最新的macOS版本(.dmg文件)。

雙擊下載的.dmg文件,將Chatbox應用程序拖到“應用程序”文件夾中。打開“應用程序”文件夾,雙擊Chatbox圖標啟動應用程序。

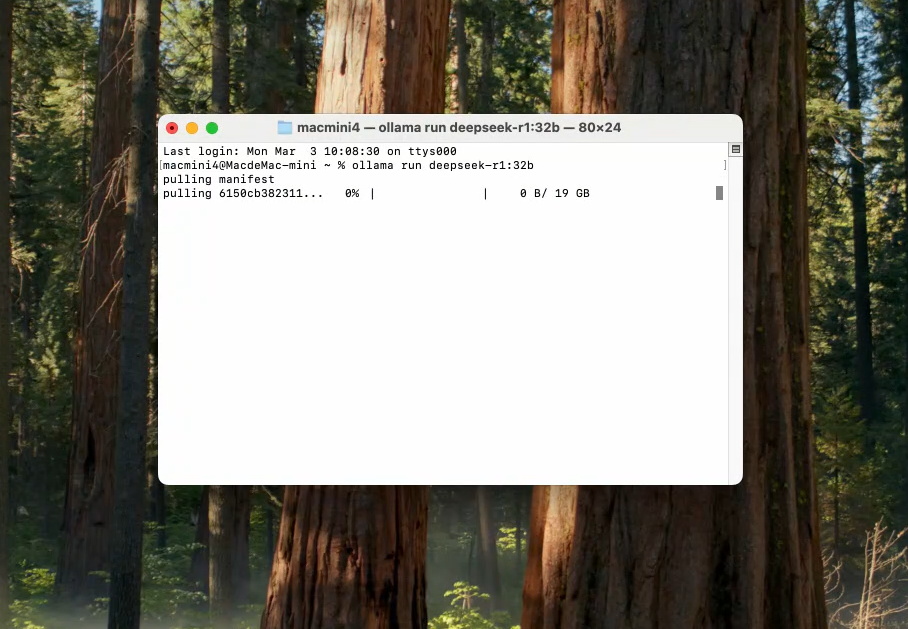

三,使用Ollama運行模型

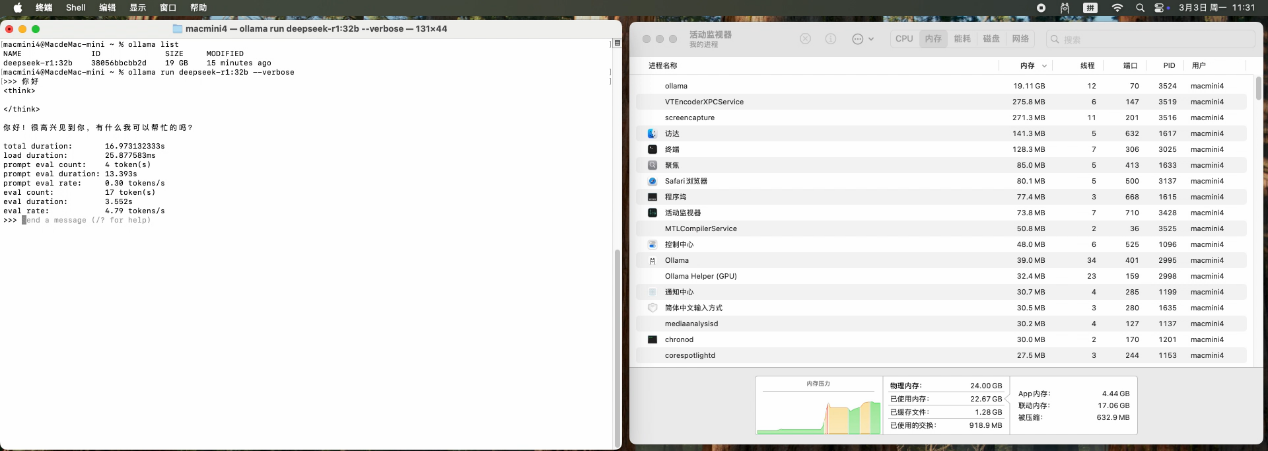

1,打開終端,運行以下命令啟動Deepseek-r1:32b模型:ollama run deepseek-r1:32b(若未下載則會自動進行下載)。

2,輸入您的問題或文本,模型將生成響應。32B模型下運行得出平均輸出為:4.79token/s。

四,使用Chatbox與模型交互

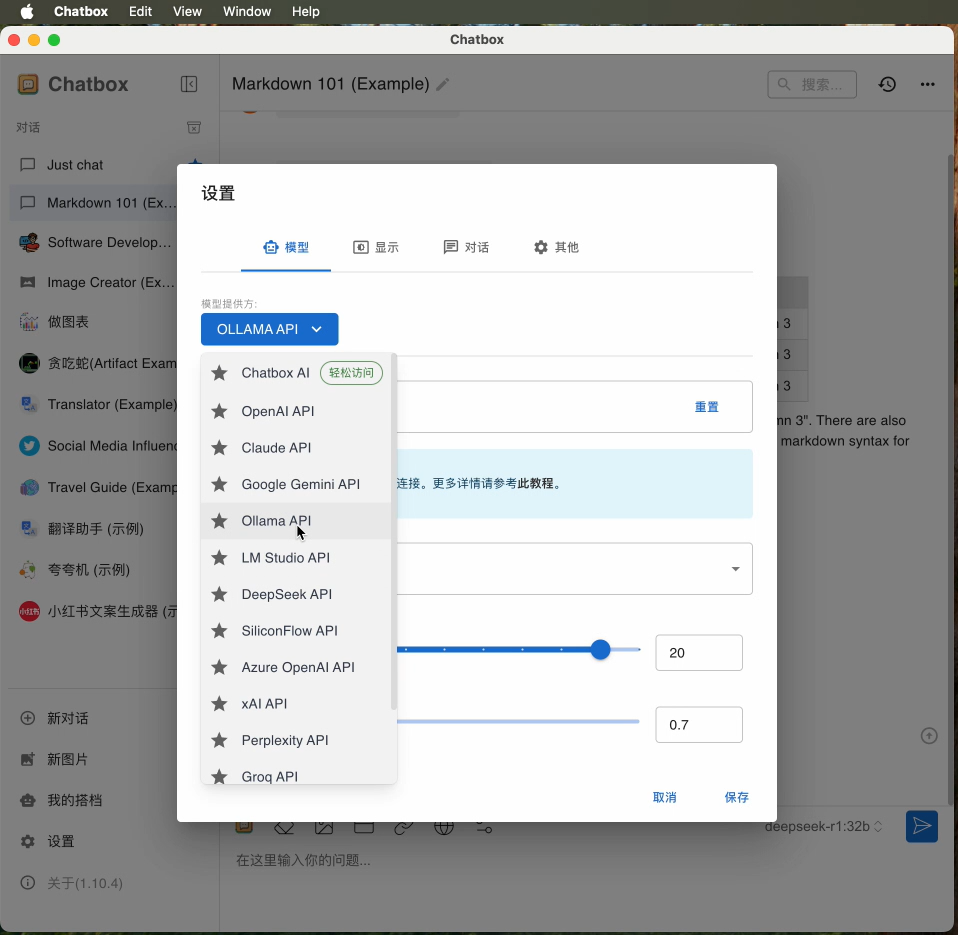

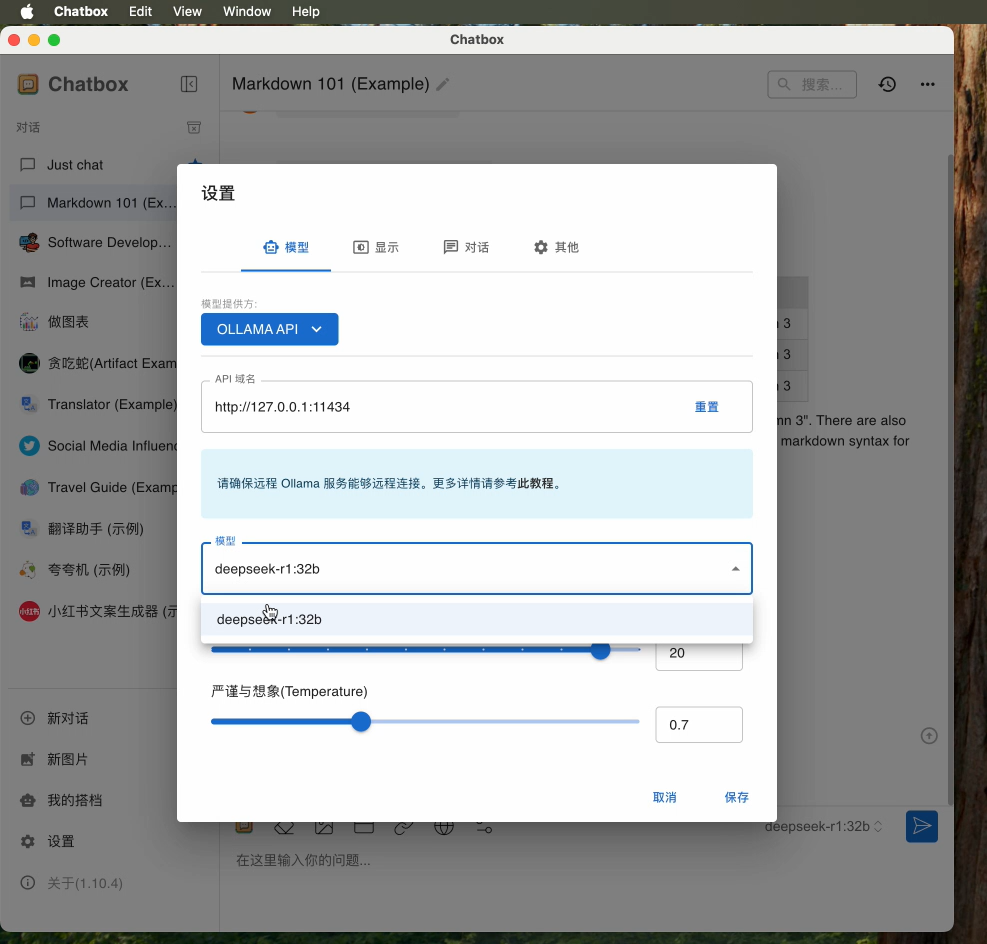

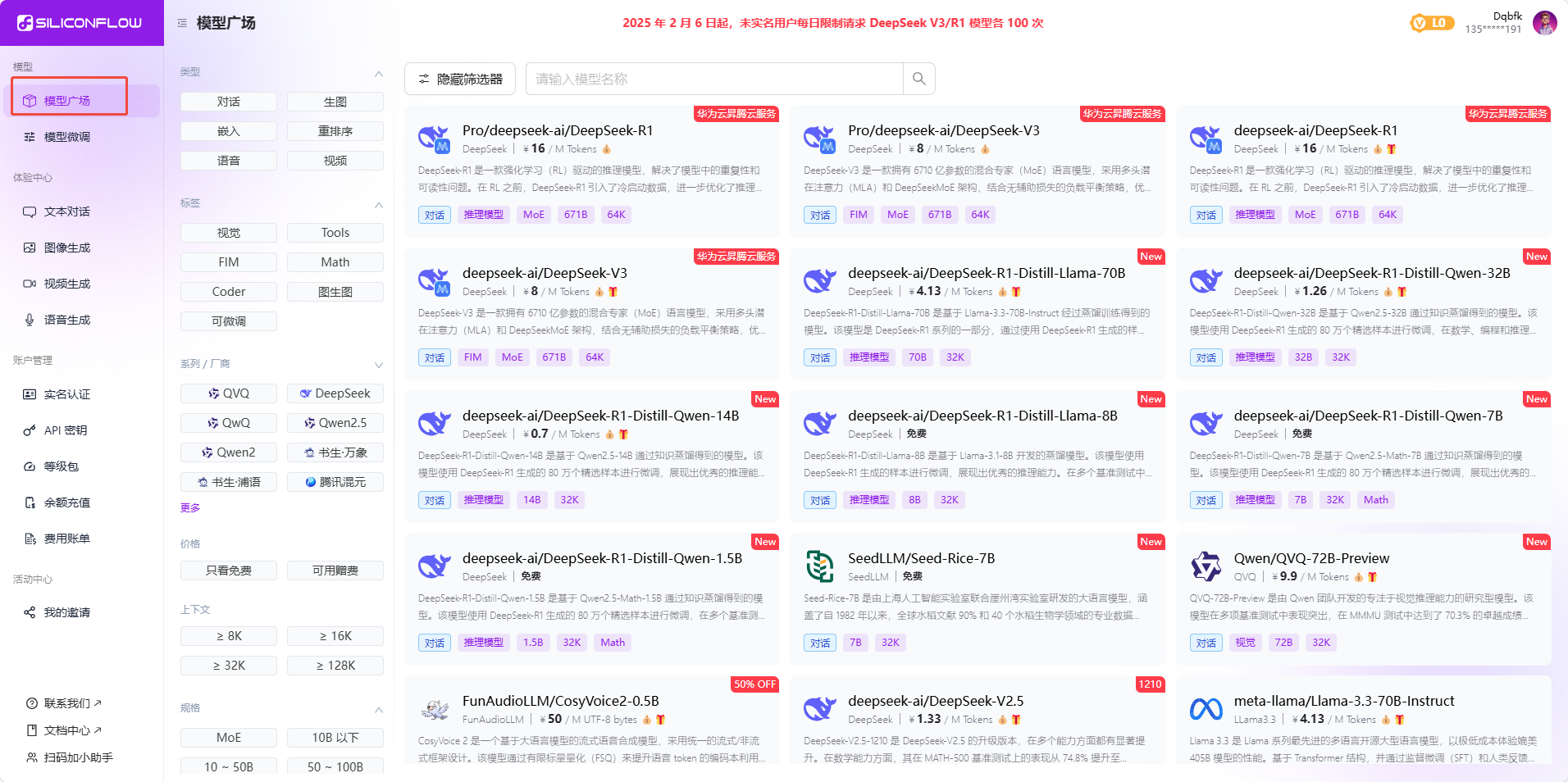

1,打開Chatbox應用程序,在設置中,選擇“Ollama”作為后端服務,并輸入Ollama的API地址(默認是`http://localhost:11434`)。

2,選擇“Deepseek-r1:32b”模型。

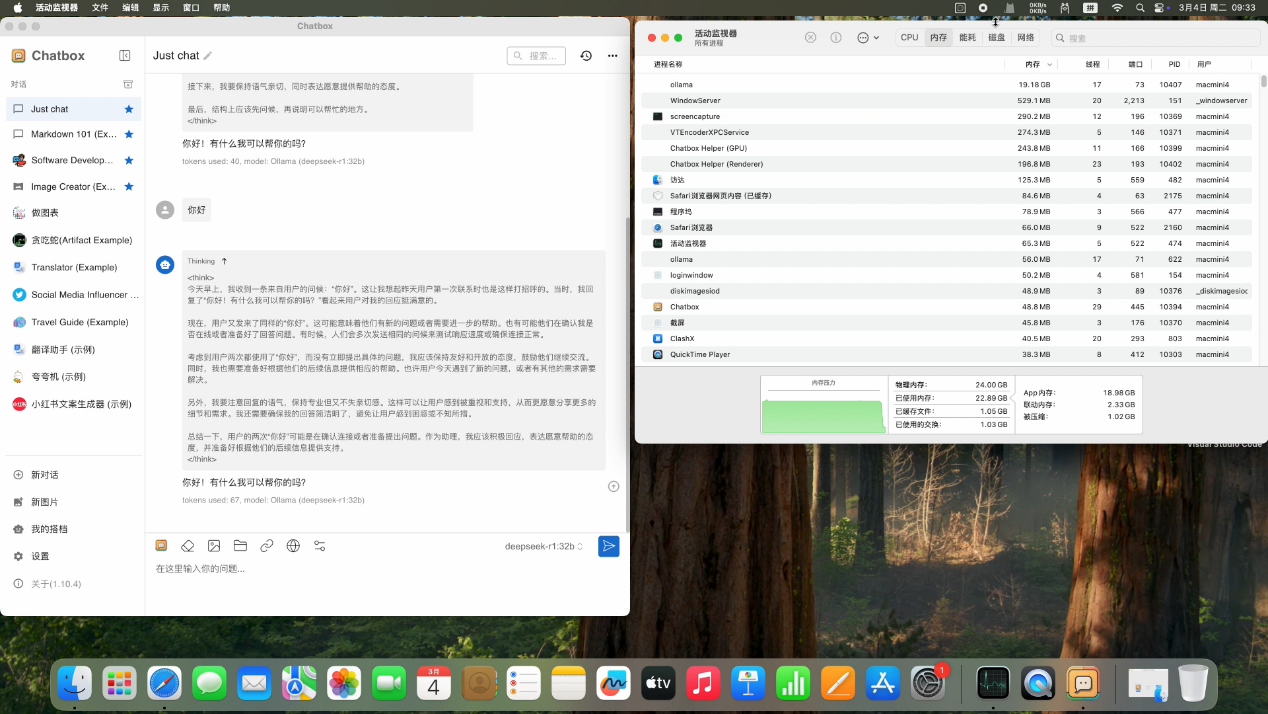

3,在聊天界面中輸入您的問題或文本,Chatbox將顯示模型的響應。

五,總結

通過本文的指導,您已經成功在MAC mini4上安裝了Ollama和Chatbox,并部署了Deepseek-r1:32b模型。現在,您可以使用這些工具進行自然語言處理任務,享受高性能的語言模型帶來的便利。

如果你有更好的文章,歡迎投稿!

稿件接收郵箱:nami.liu@pasuntech.com

更多精彩內容請關注“算力魔方?”!

審核編輯 黃宇

-

DeepSeek

+關注

關注

1文章

769瀏覽量

1297

發布評論請先 登錄

【幸狐Omni3576邊緣計算套件試用體驗】CPU部署DeekSeek-R1模型(1B和7B)

如何在Ollama中使用OpenVINO后端

如何在RakSmart服務器上用Linux系統部署DeepSeek

在 MAC mini4 上安裝與使用 ComfyUI 文生圖軟件完整指南

在 MAC mini4 上使用 VSCode 和 Cline 插件對接 Deepseek-R1:32b 的完整指南

DeepSeek與Chatbox:開啟本地AI交互新時代!

米爾RK3576開發板評測】+ RKLLM-Toolkit 環境安裝

添越智創基于 RK3588 開發板部署測試 DeepSeek 模型全攻略

在龍芯3a6000上部署DeepSeek 和 Gemma2大模型

OpenAI:GPT-4o及4o-mini模型性能下降,正展開調查

用Ollama輕松搞定Llama 3.2 Vision模型本地部署

在MAC mini4上安裝Ollama、Chatbox及模型交互指南

在MAC mini4上安裝Ollama、Chatbox及模型交互指南

評論