據路透社報道,微軟、谷歌以及OpenAI等16家全球科技巨頭在5月21至22日舉行的“人工智能(AI)首爾峰會”上,公開表態承諾進行AI模型的安全開發,并在無法有效控制最極端風險時,對其尖端系統進行關閉。

此次峰會上,與會公司還包含了中國本土的科技力量如智譜AI(IT之家備注:騰訊、阿里、美團和小米曾對其投資)、IBM、亞馬遜、Meta及三星等知名企業。

此外,這些公司在會議中就安全性問題達成共識,包括發布明確的評估框架,用以衡量模型可能帶來的風險。若風險嚴重且無法承受,人工智能公司將被迫按下緊急停止按鈕,暫停模型和系統的開發或部署。

然而,這并非人工智能行業首次提出此類看似高尚卻缺乏實際約束力的安全承諾。早在去年,亞馬遜、谷歌、Meta及微軟便已簽署由美國政府推動的自愿保障措施,以確保其產品在上市前具備足夠的安全性。

盡管如此,被譽為“人工智能教父”的計算機科學家約書亞·本吉奧對此類承諾表示歡迎,同時也強調自愿承諾需伴隨著嚴格的監管機制。

-

微軟

+關注

關注

4文章

6673瀏覽量

105386 -

人工智能

+關注

關注

1804文章

48737瀏覽量

246664 -

模型

+關注

關注

1文章

3488瀏覽量

50020

發布評論請先 登錄

【「零基礎開發AI Agent」閱讀體驗】+ 入門篇學習

AI端側部署開發(SC171開發套件V3)

首創開源架構,天璣AI開發套件讓端側AI模型接入得心應手

《AI Agent 應用與項目實戰》----- 學習如何開發視頻應用

NVIDIA推出加速物理AI開發的Cosmos世界基礎模型

AI大語言模型開發步驟

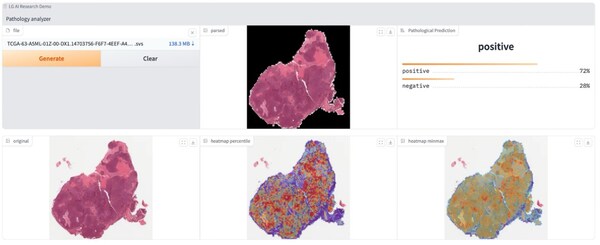

LG AI Research使用亞馬遜云科技開發AI模型 加快癌癥診斷速度

16家科技巨頭保證AI模型安全開發

16家科技巨頭保證AI模型安全開發

評論