本文來自“GPT-4精華專題:多模態(tài)能力提升,應(yīng)用生態(tài)加速(2023)”,2023年11月7日,OpenAI通過開發(fā)者大會推出新產(chǎn)品:

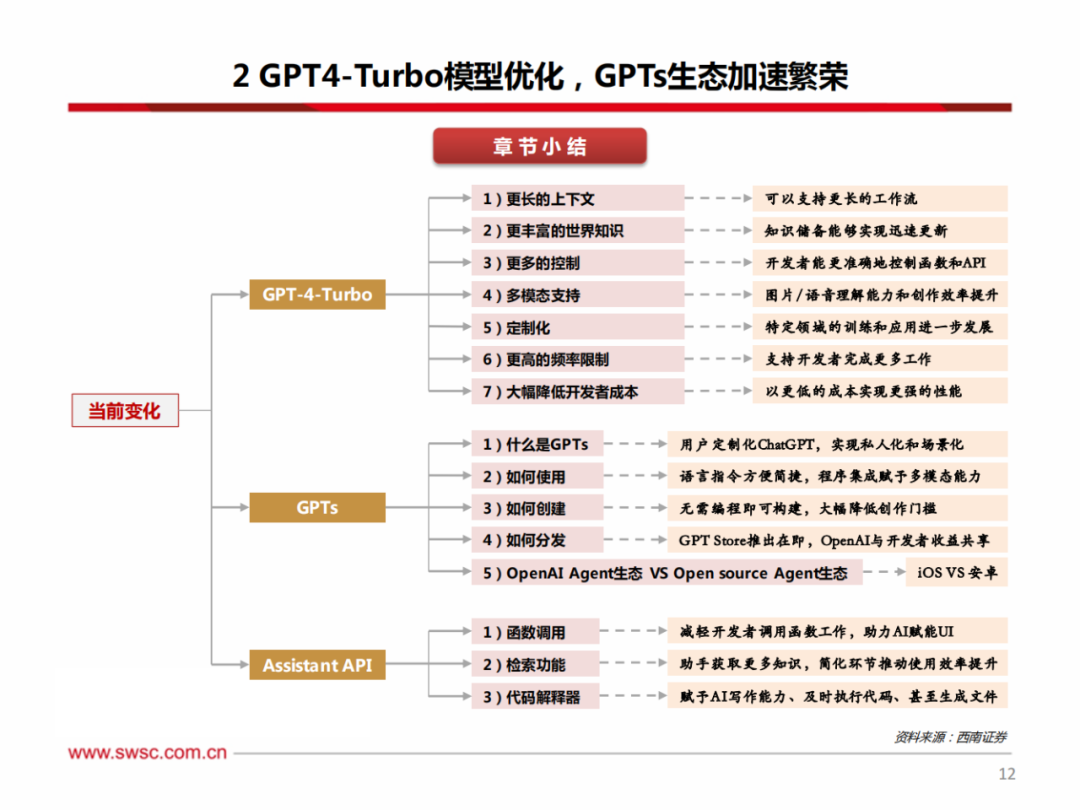

1)GPT4-Turbo:該模型通過增加上下文窗口以支持更長的工作流,同時具備視覺和語音等多模態(tài)能力,輸入和輸出的tokens價格大幅下降,從而幫助開發(fā)者以更低的價格獲取更高的模型性能。

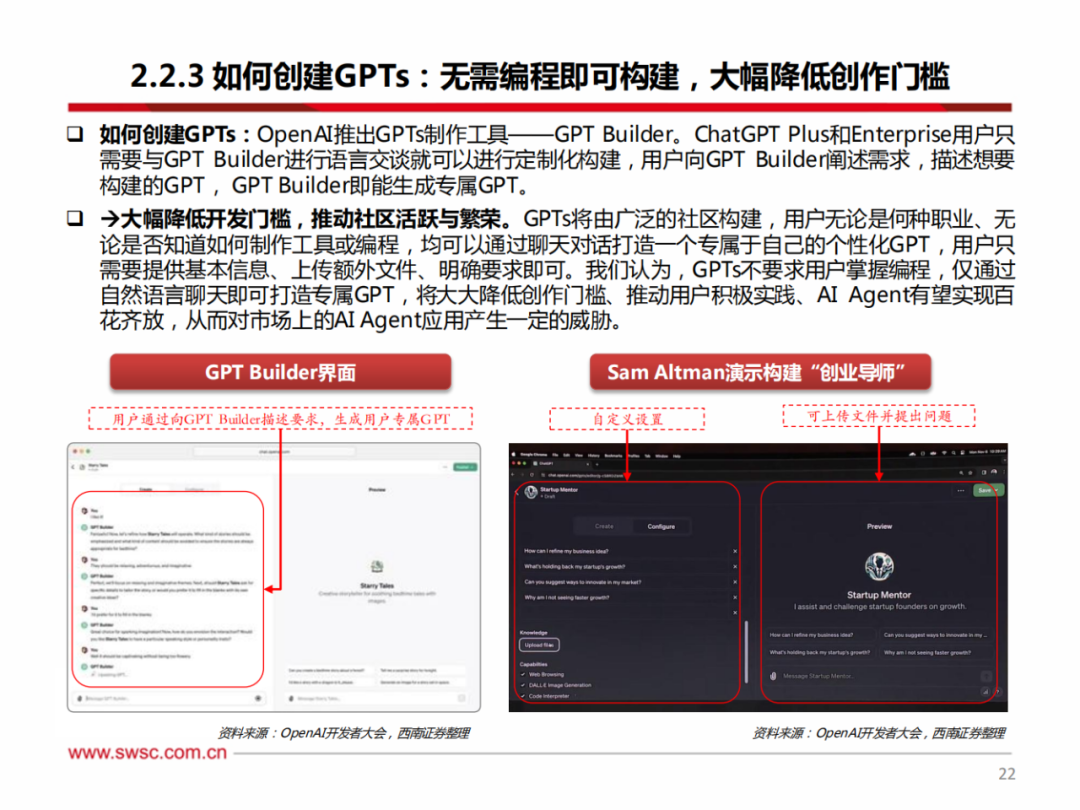

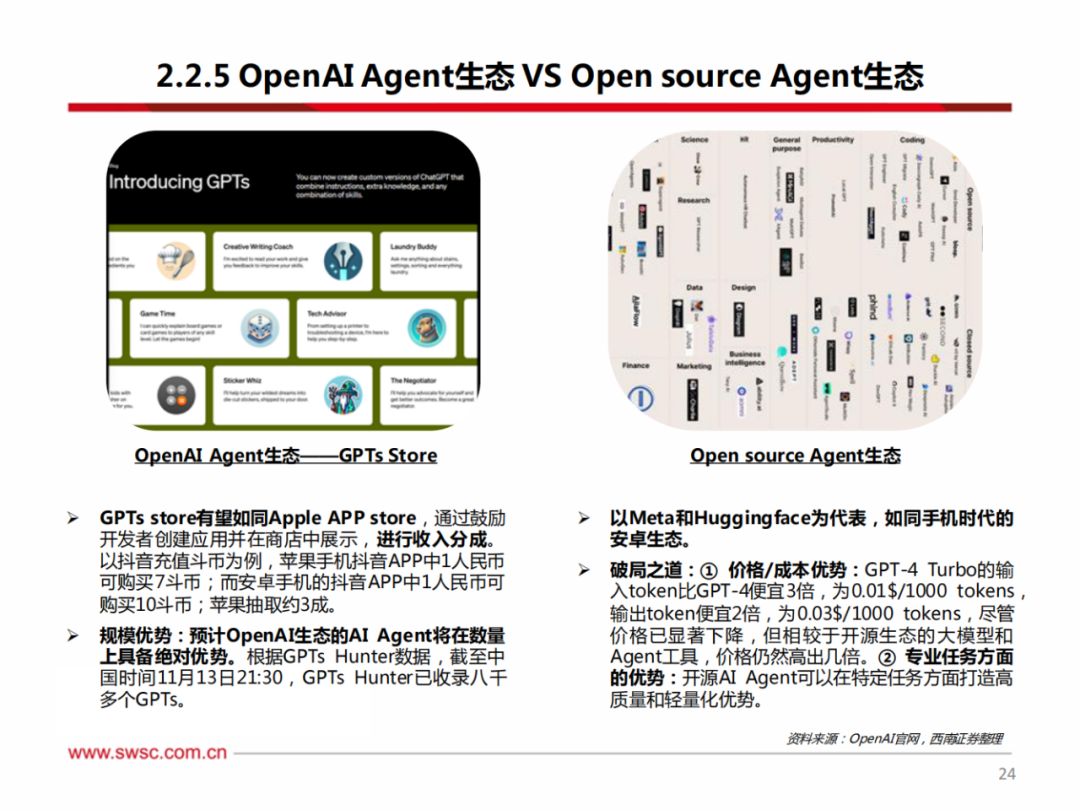

2)GPTs:用戶只需輸入指令并提供外設(shè)的知識庫即可創(chuàng)建專屬GPT,應(yīng)用開發(fā)門檻大幅降低,未來在收益計劃的助力下,AI應(yīng)用有望迎來大爆發(fā),形成全新的AI Agent生態(tài)。

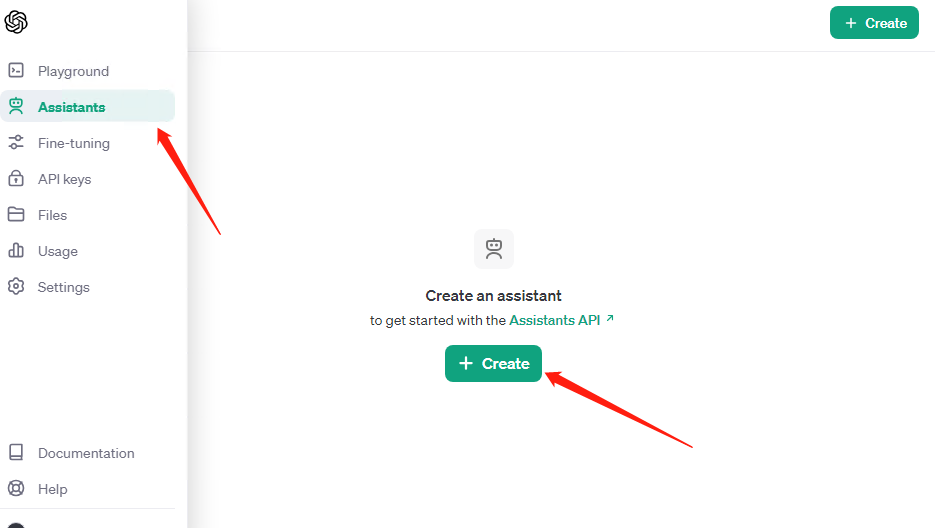

3)Assistant API:開發(fā)者可以通過函數(shù)調(diào)用、知識檢索、代碼解釋器簡化應(yīng)用開發(fā)流程、實現(xiàn)效率提升。

《400+份重磅ChatGPT專業(yè)報告》

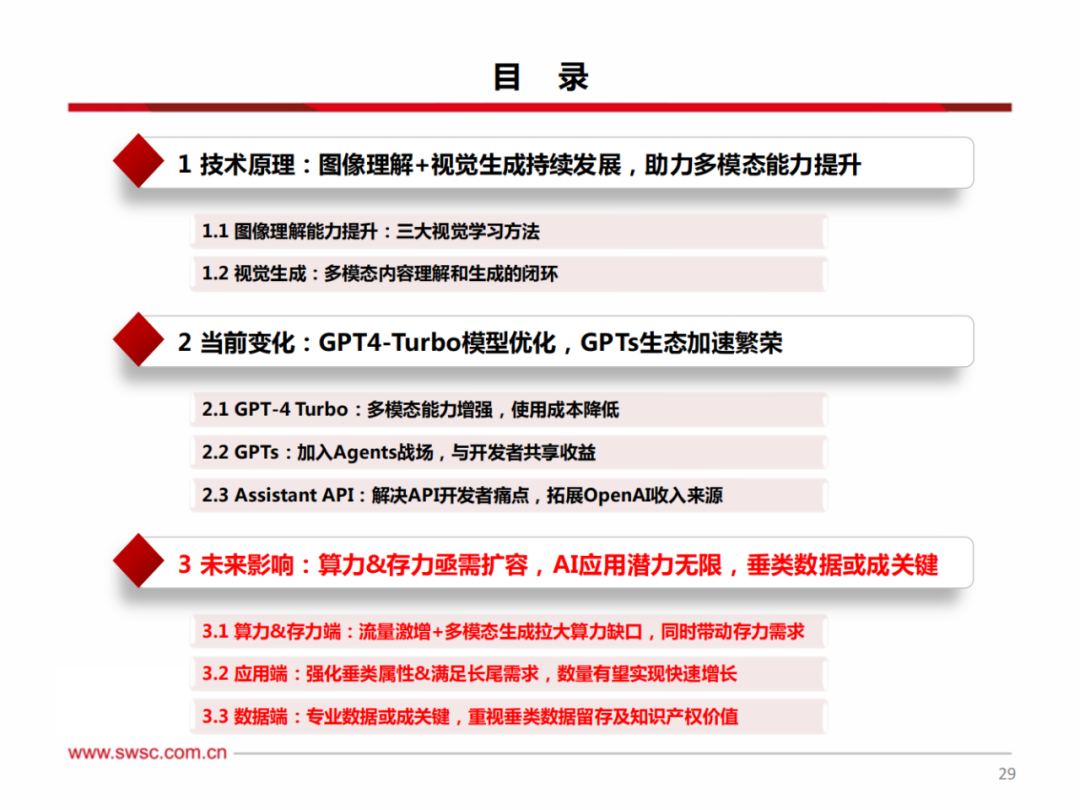

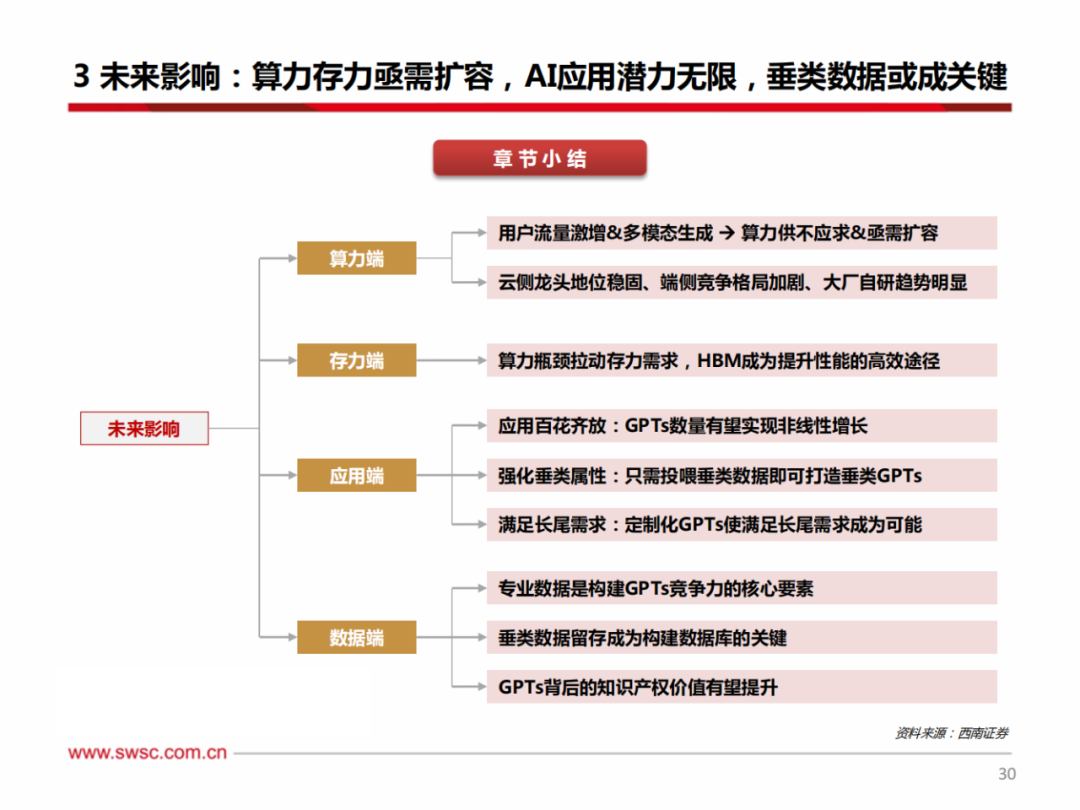

1)算力端:OpenAI一系列新產(chǎn)品的推出成功打開新流量入口,更多的用戶和開發(fā)者希望參與其中,巨大的流量對算力底座提出更高的要求;疊加圖片等多模態(tài)生成所要求的tokens計算量遠高于文本模態(tài)(根據(jù)OpenAI官網(wǎng)信息推算,在GPT-4-Turbo的Vision pricing calculator高保真度模式下,1張圖片所產(chǎn)生的tokens數(shù)大約是1個單詞的570或830倍),算力供給亟需擴容。

2)存力端:在算力提效到達一定瓶頸的情況下,AI芯片未來將逐步通過堆疊HBM的方式來提升性能,擴大單位算力的存儲能力,HBM等存力需求將迎來暴增。

3)應(yīng)用端:類比移動互聯(lián)網(wǎng)時代,AI時代的應(yīng)用市場有望如同移動互聯(lián)網(wǎng)時代具備無限潛力,GPTs數(shù)量將呈現(xiàn)非線性高速增長;此外,OpenAI的GPTs通過提供API,使得開發(fā)者只需喂給大模型更多的垂類數(shù)據(jù)即可打造垂類AI應(yīng)用,同時使?jié)M足更多長尾需求成為可能。

4)數(shù)據(jù)端:從OpenAI GPTs的Knowledge功能來看,專業(yè)知識與大模型通用能力的結(jié)合將成為未來的重中之重,私域數(shù)據(jù)庫和專業(yè)數(shù)據(jù)庫方向?qū)粩喈a(chǎn)生新熱點、新需求,因此,如何在合規(guī)前提下留存垂類數(shù)據(jù)并構(gòu)建體系化數(shù)據(jù)庫、以及保證知識產(chǎn)權(quán)的確權(quán)或成為未來的重要議題。

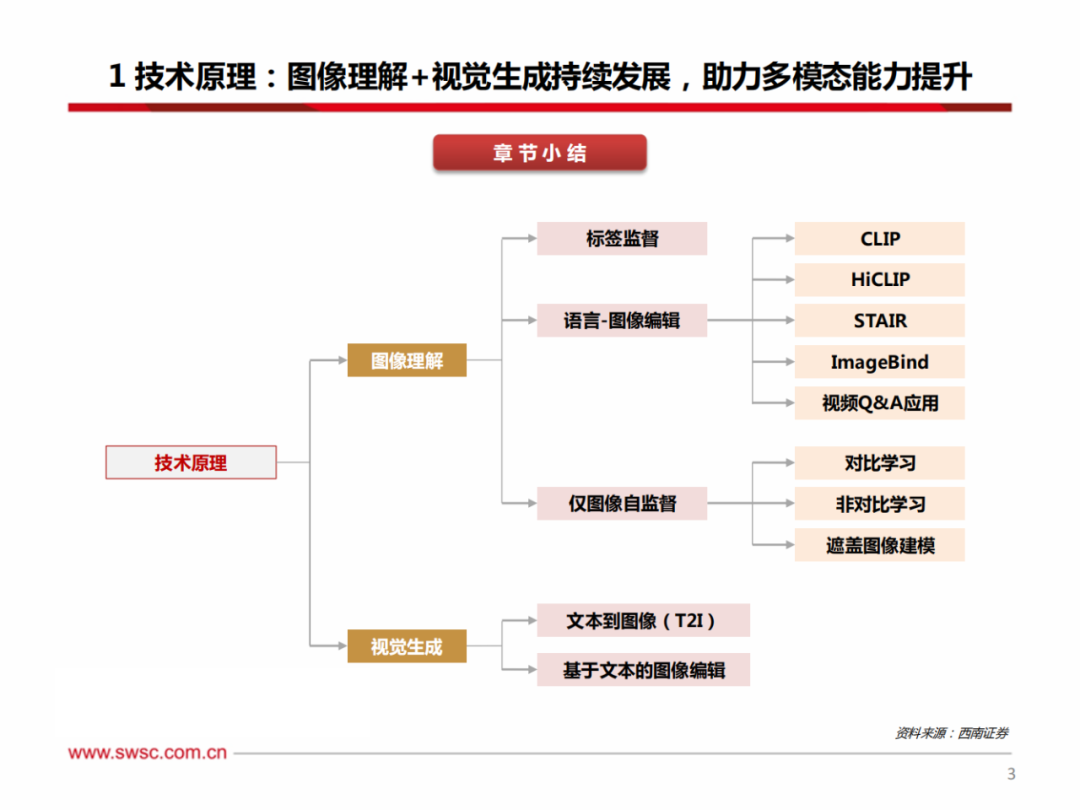

為打造視覺大模型,建立高效視覺預(yù)訓(xùn)練體系以提升圖像理解能力至關(guān)重要,這影響到從圖像整體(如分類、圖文檢索、標注)到部分區(qū)域(如物體識別、短語定位)及到像素細節(jié)(如語義、實例、全景分割)的各項任務(wù)。

通用視覺預(yù)訓(xùn)練方法主要可歸納為三大類。1)標簽監(jiān)督:此方法在每張圖片都配有對應(yīng)標簽的數(shù)據(jù)集上進行訓(xùn)練,如圖像分類中,一張狗的照片會對應(yīng)“狗”的標簽,模型的核心任務(wù)是準確預(yù)測此標簽。2)語言-圖像監(jiān)督:利用完整的文本描述來引導(dǎo)模型學(xué)習(xí),使模型能夠深入挖掘圖像內(nèi)容與文本語義間的關(guān)聯(lián)。3)僅圖像自監(jiān)督:利用圖像本身固有的結(jié)構(gòu)和信息來學(xué)習(xí)有意義的表示,而不依賴于顯式的人工注釋標簽。

1)更長的上下文(Context Length):GPT-4-turbo支持的上下文窗口(128k)相較于GPT-4-8k提升16倍,相較于GPT-4-32k提升4倍,即GPT-4-turbo可在單個prompt中處理超過300頁的文本,且GPT-4-turbo模型在較長的上下文中更加準確。我們認為GPT-4-turbo更長且更準確的上下文處理能力將支持更長的工作流,在B端有能力承擔(dān)更多的工作負載,提升用戶體驗。

2)更豐富的世界知識(Better Knowledge):外部文檔和數(shù)據(jù)庫的截止更新日期從21年9月更新至23年4月,意味著OpenAI的大模型在半年內(nèi)已學(xué)習(xí)互聯(lián)網(wǎng)一年半的知識,學(xué)習(xí)速度極快。

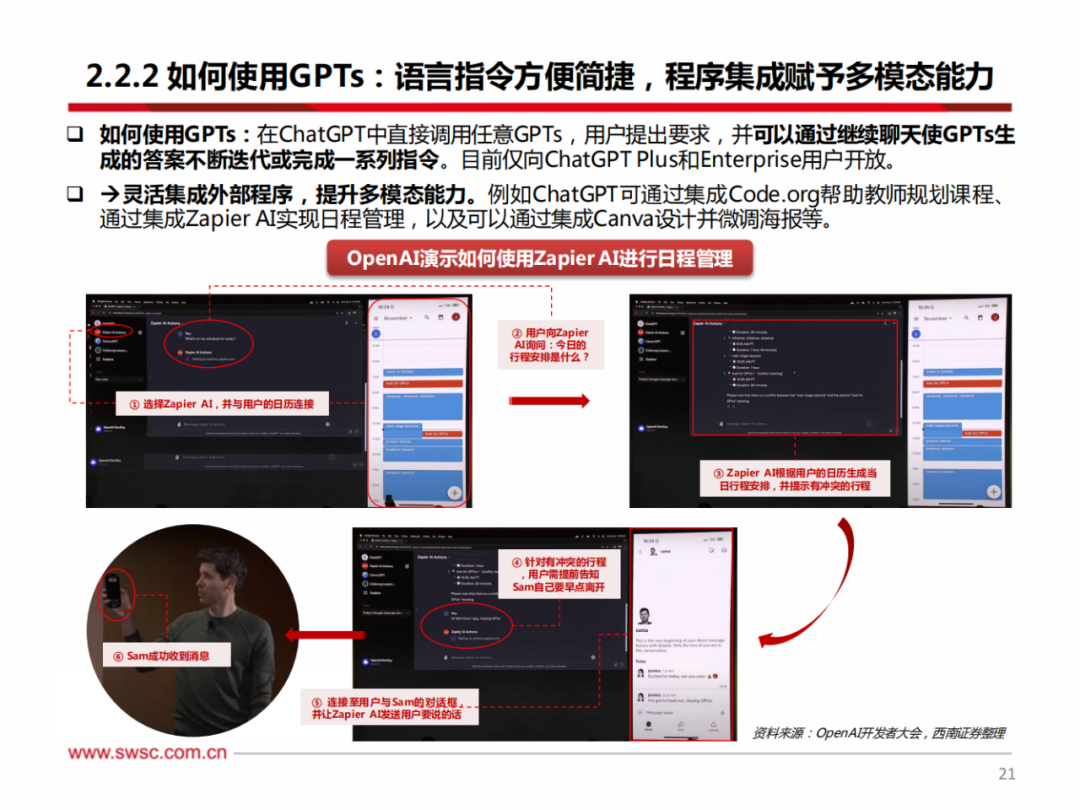

什么是GPTs:GPTs是指“針對特定目的定制的ChatGPT”,用戶可以通過自定義行為創(chuàng)建一個定制版的ChatGPT,定制版的ChatGPT具備帶有任何功能的可能性(在保證隱私和安全的情況下)。

不論是開發(fā)者還是不會寫代碼的普通人,都可以擁有自定義版本的GPT。

更加個性化、私人化、場景化,每個人都可以擁有自己的AI Agent。GPTs通過結(jié)合①說明/Instruction+②擴展的知識/Expand knowledge+③操作/Actions,能夠在很多情況下更好地工作,并且為用戶提供更好地控制,用以幫助用戶輕松完成各種任務(wù)、或者獲得更多樂趣。

針對開發(fā)者在開發(fā)API中的痛點,OpenAI推出Assistant API,致力于為開發(fā)者賦能。根據(jù)此前市場上推出的各種API,我們可以發(fā)現(xiàn)API通過接入各種程序和應(yīng)用,有助于幫助應(yīng)用實現(xiàn)特定功能。

例如,Shopify的Sidekick允許用戶在平臺上進行操作;Discord的Clyde允許discord版主設(shè)置自定義人格;Snap my AI作為定制聊天機器人工具,可以添加至群聊中并提出建議。但以上API的構(gòu)建可能需要開發(fā)者耗費幾個月的時間、并由數(shù)十名工程師搭建,而目前Assistant API的推出將使其變得容易實現(xiàn)。

1)云側(cè)芯片龍頭:英偉達龍頭地位穩(wěn)固,AMD加速發(fā)展。

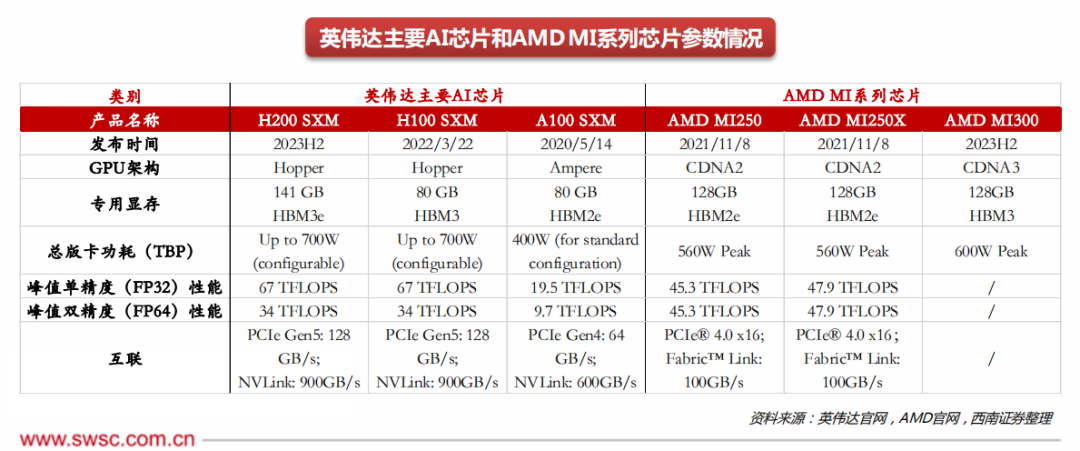

① 英偉達:2023年11月13日,英偉達推出H200,內(nèi)存方面首次采用HBM3e,容量高達141GB,帶寬實現(xiàn)大幅提升;性能方面著重強化推理能力和HPC性能,可將Llama2模型的推理速度提高近一倍,相較于H100可降低50%的TCO和能耗成本。2023年以來,英偉達AI芯片已發(fā)布多個產(chǎn)品,在云側(cè)算力芯片領(lǐng)域龍頭優(yōu)勢明顯。

② AMD:2023年6月,AMD正式發(fā)布MI300系列,MI300將CPU、GPU和內(nèi)存封裝為一體,大幅縮短DDR內(nèi)存行程和CPU-GPU PCIe行程,提高性能和效率;MI300采用Chiplet設(shè)計,擁有13個基于3D堆疊的小芯片(5nm: 3個CPU,6個GPU;4個6nm芯片),包括24個Zen4 CPU內(nèi)核,同時融合CDNA 3和8個HBM3顯存堆棧,集成5nm和6nm IP,總共包含128GB HBM3顯存和1460億個晶體管。對比MI250加速卡,MI300可帶來8倍AI性能和5倍每瓦性能的提升(FP8),使ChatGPT和DALL-E等超大AI模型的訓(xùn)練時間可以從幾個月縮短到幾周。

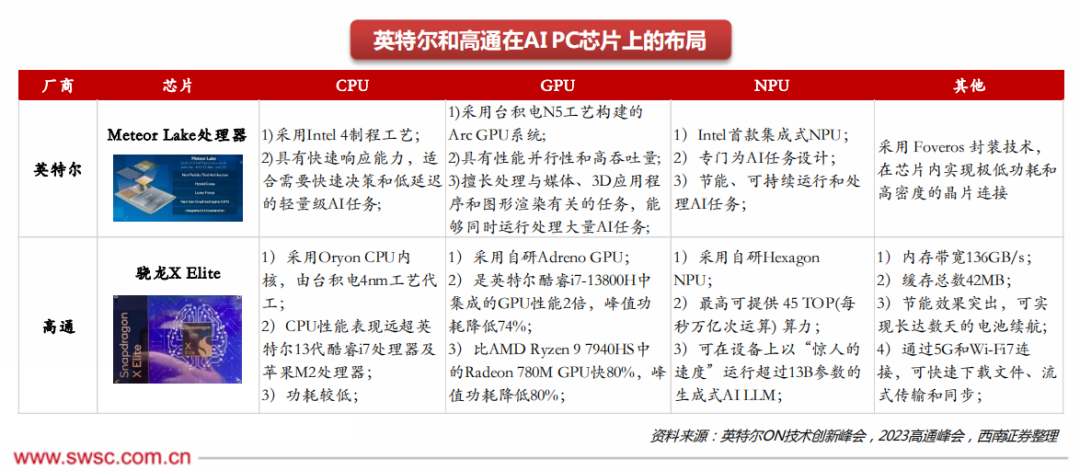

2)端側(cè)芯片格局:對于AI PC端側(cè)適用芯片,英特爾進展保持領(lǐng)先,高通有望實現(xiàn)從0到1。

① 英特爾:PC主芯片包括CPU和GPU。GPU方面,根據(jù)Statista數(shù)據(jù),英特爾在22Q4全球PC GPU市場中占據(jù)71%的市場份額;CPU方面,根據(jù)Counterpoint Research數(shù)據(jù),英特爾在2022年全球Notebook CPU/SoC市場中占據(jù)69.6%的市場份額,當(dāng)前英特爾在PC主芯片市場中處于主導(dǎo)地位。23H2,英特爾推出Meteor Lake處理器,助力PC效能提升,專為AI任務(wù)設(shè)計,在AI PC主芯片市場中具備先發(fā)優(yōu)勢。

② 高通:2023年10月,高通于驍龍峰會上推出驍龍X Elite芯片,可支持130億參數(shù)大模型,為Windows-on-Arm筆記本設(shè)計,預(yù)計在2024年中期發(fā)布。算力方面,AI PC對PC芯片的算力要求更高,高通在端側(cè)AI推理能力優(yōu)于英特爾。與此同時,生態(tài)方面,2022年至今Windows開始支持高通,已發(fā)布多輪支持Arm架構(gòu)芯片的操作系統(tǒng)。未來,高通在以驍龍X Elite為代表的AI PC芯片的助力下,將在PC領(lǐng)域?qū)崿F(xiàn)重要突破,逐步搶占市場份額。

3)大廠自研趨勢:科技巨頭加速自研,優(yōu)先服務(wù)于自身云服務(wù)業(yè)務(wù)及AI條線。微軟于23年11月16日Ignite技術(shù)大會上發(fā)布兩款自研芯片——Azure Maia 100和Azure Cobalt 100,分別用于大語言模型的訓(xùn)練推理和通用云服務(wù)的支持。近年來,各大科技廠商紛紛自研芯片,一是為了降低自身對第三方芯片和外部供應(yīng)鏈的依賴;二是自研芯片可幫助各大廠商克服一定的通用芯片局限,通過CPU+GPU+DPU+定制芯片等結(jié)合方案,提升全系統(tǒng)整合效率、實現(xiàn)業(yè)務(wù)賦能;三是提高計算能效、減少長期硬件成本。

-

AI芯片

+關(guān)注

關(guān)注

17文章

1968瀏覽量

35696 -

算力

+關(guān)注

關(guān)注

2文章

1148瀏覽量

15459 -

OpenAI

+關(guān)注

關(guān)注

9文章

1202瀏覽量

8649

原文標題:GPT-4 Turbo多模態(tài),應(yīng)用生態(tài)加速

文章出處:【微信號:AI_Architect,微信公眾號:智能計算芯世界】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

OpenAI即將發(fā)布GPT-4.5與GPT-5

商湯日日新多模態(tài)大模型權(quán)威評測第一

訊飛星火大模型技術(shù)進展及落地

訊飛星火大模型4.0 Turbo正式發(fā)布

Llama 3 與 GPT-4 比較

科大訊飛發(fā)布訊飛星火4.0 Turbo:七大能力超GPT-4 Turbo

利用OpenVINO部署Qwen2多模態(tài)模型

訊飛星火內(nèi)容運營大師新增三大功能

云知聲山海多模態(tài)大模型UniGPT-mMed登頂MMMU測評榜首

云知聲推出山海多模態(tài)大模型

OpenAI 推出 GPT-4o mini 取代GPT 3.5 性能超越GPT 4 而且更快 API KEY更便宜

OpenAI發(fā)布高性價比小型AI模型GPT-4o mini

OpenAI推出新模型CriticGPT,用GPT-4自我糾錯

OpenAI API Key獲取:開發(fā)人員申請GPT-4 API Key教程

GPT-4 Turbo多模態(tài),應(yīng)用生態(tài)加速

GPT-4 Turbo多模態(tài),應(yīng)用生態(tài)加速

評論