大型語言模型(LLM)的出現(xiàn)標(biāo)志著NLP的重大突破,導(dǎo)致文本理解和生成的顯著進(jìn)步。然而,除了這些進(jìn)步,LLM還產(chǎn)生了幻覺現(xiàn)象,導(dǎo)致生成內(nèi)容與現(xiàn)實(shí)世界的事實(shí)或用戶輸入不一致。這篇綜述從LLM幻覺的分類開始,深入研究導(dǎo)致幻覺的因素。對(duì)幻覺檢測(cè)方法和基準(zhǔn)進(jìn)行了全面概述。此外,還相應(yīng)地介紹了緩解幻覺的代表性方法。最后分析了面臨的挑戰(zhàn),突出了當(dāng)前的局限性,并提出了開放問題。

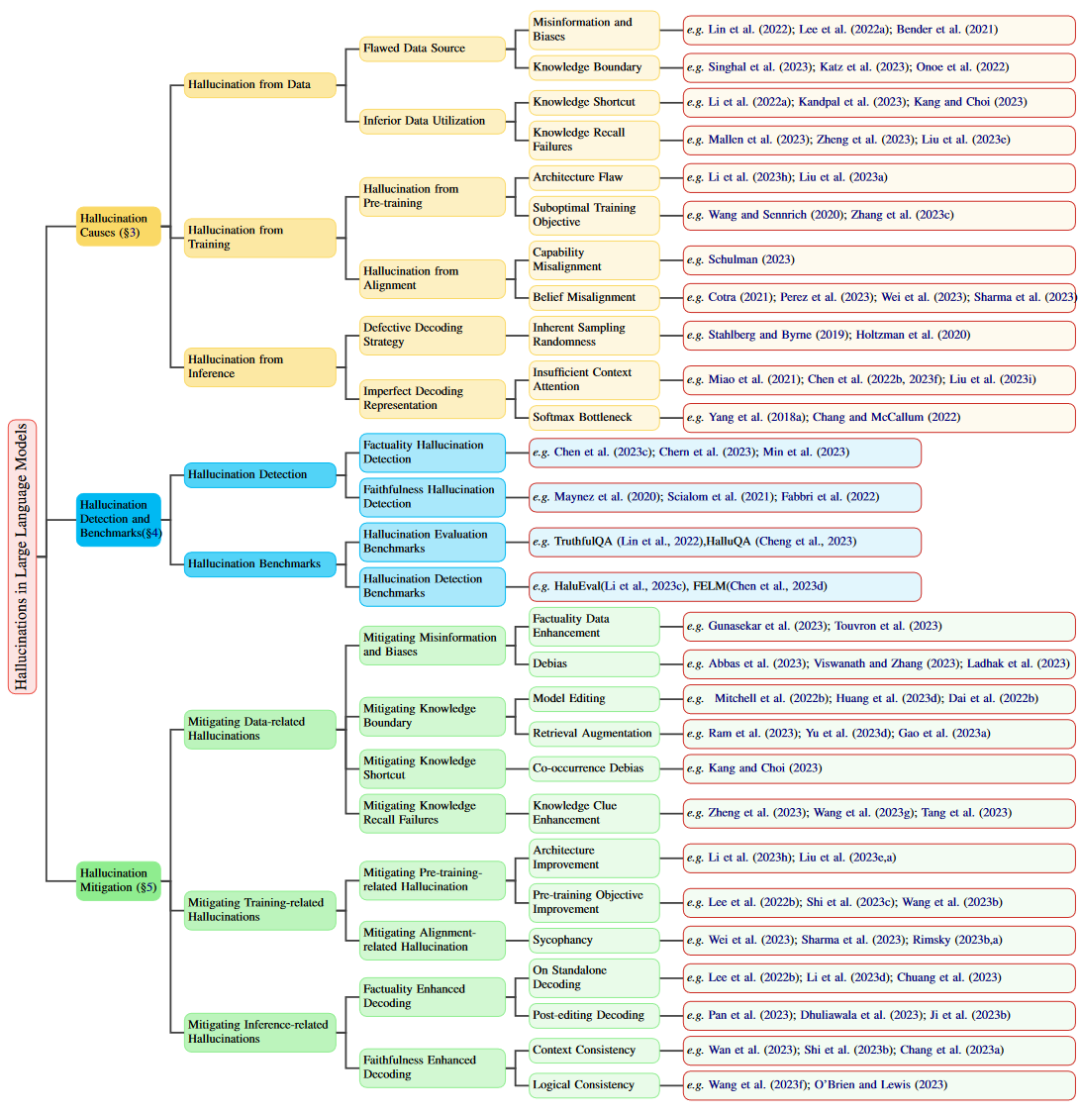

文中相關(guān)引用論文如下圖所示:

背景介紹

最近,LLM的出現(xiàn)引領(lǐng)了NLP范式的轉(zhuǎn)變,在語言理解和推理方面取得了前所未有的進(jìn)步。然而,隨著LLMs的快速發(fā)展,有一個(gè)令人擔(dān)憂的趨勢(shì),即其產(chǎn)生幻覺的傾向,導(dǎo)致看似合理但實(shí)際上不支持的內(nèi)容。

幻覺被描述為無意義或不忠實(shí)于所提供源內(nèi)容的生成內(nèi)容。根據(jù)與源內(nèi)容的矛盾,這些幻覺又進(jìn)一步分為內(nèi)在幻覺和外在幻覺。在LLMs中,幻覺的范圍包含了一個(gè)更廣泛、更全面的概念,主要集中在事實(shí)錯(cuò)誤上。本文重新定義了幻覺的分類,為L(zhǎng)LM應(yīng)用程序提供了一個(gè)更定制的框架。

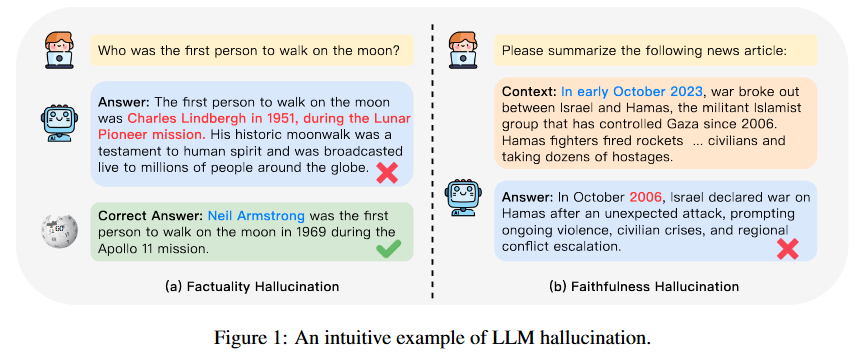

我們把幻覺分為兩大類:事實(shí)幻覺和忠實(shí)幻覺。事實(shí)幻覺強(qiáng)調(diào)生成的內(nèi)容與可驗(yàn)證的現(xiàn)實(shí)世界事實(shí)之間的差異,通常表現(xiàn)為事實(shí)不一致或捏造。如圖1(a)所示,當(dāng)被問及第一個(gè)在月球上行走的人是誰時(shí),模型可能會(huì)斷言是1951年的查爾斯·林德伯格。而事實(shí)是尼爾·阿姆斯特朗在1969年阿波羅11號(hào)任務(wù)中成為第一個(gè)在月球上行走的人。

忠實(shí)幻覺是指生成內(nèi)容與用戶指令或輸入提供的上下文背離,以及生成內(nèi)容內(nèi)部的自一致性。如圖1(b)所示,當(dāng)模型被要求總結(jié)一篇新聞文章時(shí),該模型不準(zhǔn)確地生成了以色列和哈馬斯之間沖突的實(shí)際事件日期。針對(duì)事實(shí)幻覺,我們根據(jù)可驗(yàn)證來源的內(nèi)容將其進(jìn)一步分為兩類:事實(shí)不一致和事實(shí)捏造。為了保證可靠性,我們強(qiáng)調(diào)從用戶的角度解決不一致性,將其分類為指令不一致性、上下文不一致性和邏輯不一致性,從而使其更好地與LLM的當(dāng)前使用保持一致。

相關(guān)定義

大語言模型(LLM)

LLM是指一系列基于transformer的語言模型架構(gòu)的通用模型,并在大量文本語料庫(kù)上進(jìn)行了廣泛的訓(xùn)練,其中著名模型有GPT-3、PaLM、LLaMA、GPT-4等。通過擴(kuò)展數(shù)據(jù)量和模型容量,llm提高了驚人的應(yīng)急能力,通常包括上下文學(xué)習(xí)(ICL) (Brown等人,2020)、思維鏈提示(Wei等人,2022)和指令遵循(Peng等人,2023)。

LLMs的訓(xùn)練階段

LLM經(jīng)歷的3個(gè)主要訓(xùn)練階段:預(yù)訓(xùn)練、監(jiān)督微調(diào)(SFT)和從人工反饋中強(qiáng)化學(xué)習(xí)(RLHF)。

預(yù)訓(xùn)練

語言模型在預(yù)訓(xùn)練期間,旨在自回歸地預(yù)測(cè)序列中的下一個(gè)標(biāo)記。通過在廣泛的文本語料庫(kù)上進(jìn)行自監(jiān)督訓(xùn)練,模型獲得了語言語法、世界知識(shí)和推理的知識(shí),為后續(xù)的微調(diào)任務(wù)提供了強(qiáng)大的基礎(chǔ)。語言模型的本質(zhì)在于預(yù)測(cè)下一個(gè)單詞的概率分布。

監(jiān)督微調(diào)

雖然LLM在預(yù)訓(xùn)練階段獲得了大量的知識(shí),但預(yù)訓(xùn)練主要是為了完成優(yōu)化。因此,預(yù)訓(xùn)練的LLM基本上充當(dāng)了補(bǔ)全機(jī)器,這可能會(huì)導(dǎo)致LLM的下一個(gè)單詞預(yù)測(cè)目標(biāo)和用戶獲得所需響應(yīng)的目標(biāo)之間的不一致。為了彌補(bǔ)這一差距引入SFT ,其中涉及使用精心注釋的(指令,響應(yīng))對(duì)集進(jìn)一步訓(xùn)練LLM,從而增強(qiáng)LLM的能力和改進(jìn)的可控性。

人類反饋的強(qiáng)化學(xué)習(xí)

雖然SFT過程成功地使LLM能夠遵循用戶指示,但它們?nèi)匀挥锌臻g更好地與人類偏好保持一致。在利用人類反饋的各種方法中,RLHF脫穎而出,成為一種通過強(qiáng)化學(xué)習(xí)來符合人類偏好的研究解決方案。通常,RLHF采用了一個(gè)偏好模型,該模型經(jīng)過訓(xùn)練可以在給定提示和人工標(biāo)記的反應(yīng)情況下預(yù)測(cè)偏好排名。為了與人類偏好一致,RLHF優(yōu)化LLM,以生成最大化訓(xùn)練偏好模型提供的獎(jiǎng)勵(lì)的輸出,通常采用強(qiáng)化學(xué)習(xí)算法,如近端策略優(yōu)化。

LLMs的幻覺

幻覺通常指的是生成的內(nèi)容看起來荒謬或不忠實(shí)于提供的源內(nèi)容的現(xiàn)象。一般來說,自然語言生成任務(wù)中的幻覺可以分為兩種主要類型:內(nèi)在幻覺和外在幻覺。具體來說,內(nèi)在幻覺屬于與源內(nèi)容沖突的輸出。相反,外在幻覺指的是無法從源內(nèi)容中驗(yàn)證的輸出。

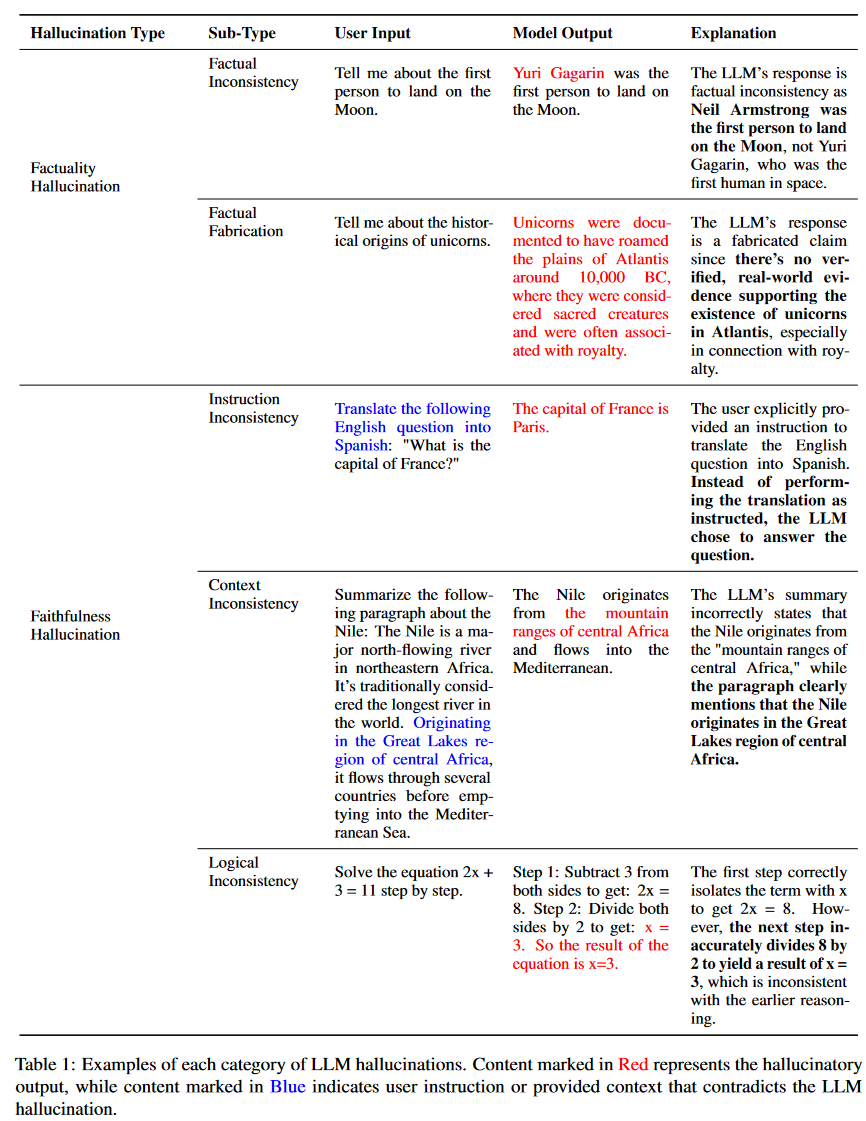

考慮到LLMs非常強(qiáng)調(diào)以用戶為中心的交互,并優(yōu)先考慮與用戶指令保持一致,再加上它們的幻覺主要出現(xiàn)在事實(shí)層面,我們引入了更細(xì)粒度的分類法。為了更直觀地說明我們對(duì)LLM幻覺的定義,我們?cè)诒?中給出了每種幻覺的例子,并附有相應(yīng)的解釋。

具體分類如下:

事實(shí)幻覺

現(xiàn)有的LLM偶爾會(huì)表現(xiàn)出產(chǎn)生與現(xiàn)實(shí)世界事實(shí)不一致或可能具有誤導(dǎo)性的輸出的趨勢(shì),這對(duì)人工智能的可信性構(gòu)成了挑戰(zhàn)。在這種情況下,我們將這些事實(shí)性錯(cuò)誤歸類為事實(shí)性幻覺。根據(jù)生成的事實(shí)內(nèi)容是否可以根據(jù)可靠來源進(jìn)行驗(yàn)證,它們可以進(jìn)一步分為兩種主要類型:

事實(shí)不一致性:指LLM的輸出包含可以基于現(xiàn)實(shí)世界信息的事實(shí),但存在矛盾的情況。這種類型的幻覺發(fā)生得最頻繁,并且來自不同的來源,包括LLM對(duì)事實(shí)知識(shí)的捕捉、存儲(chǔ)和表達(dá)。

事實(shí)捏造:指LLM的輸出包含無法根據(jù)既定的現(xiàn)實(shí)世界知識(shí)進(jìn)行驗(yàn)證的事實(shí)的實(shí)例。

忠實(shí)幻覺

隨著LLM的使用轉(zhuǎn)向更以用戶為中心的應(yīng)用程序,確保它們與用戶提供的指令和上下文信息的一致性變得越來越重要。此外,LLM的忠實(shí)還體現(xiàn)在其生成內(nèi)容的邏輯一致性上。從這個(gè)角度出發(fā),我們將忠實(shí)幻覺分為三種類型:

指令不一致:指LLM的輸出偏離用戶指令。雖然一些偏差可能符合安全指導(dǎo)原則,但這里的不一致表示無意中與非惡意用戶指令不一致。

上下文不一致:指向LLM的輸出與用戶提供的上下文信息不一致的實(shí)例。

邏輯不一致:通常在推理任務(wù)中觀察到,LLM輸出表現(xiàn)出內(nèi)部邏輯矛盾。這表現(xiàn)為推理步驟本身之間以及步驟和最終答案之間的不一致。

產(chǎn)生幻覺的原因

來自數(shù)據(jù)的幻覺

預(yù)訓(xùn)練數(shù)據(jù)是LLM的基石,使它們能夠獲得泛化能力和事實(shí)知識(shí)。然而,它可能在不經(jīng)意間成為L(zhǎng)LM幻覺的來源。這主要表現(xiàn)在兩個(gè)方面:有缺陷的數(shù)據(jù)源,以及對(duì)數(shù)據(jù)中捕獲的事實(shí)知識(shí)的低劣利用。

有缺陷的數(shù)據(jù)源

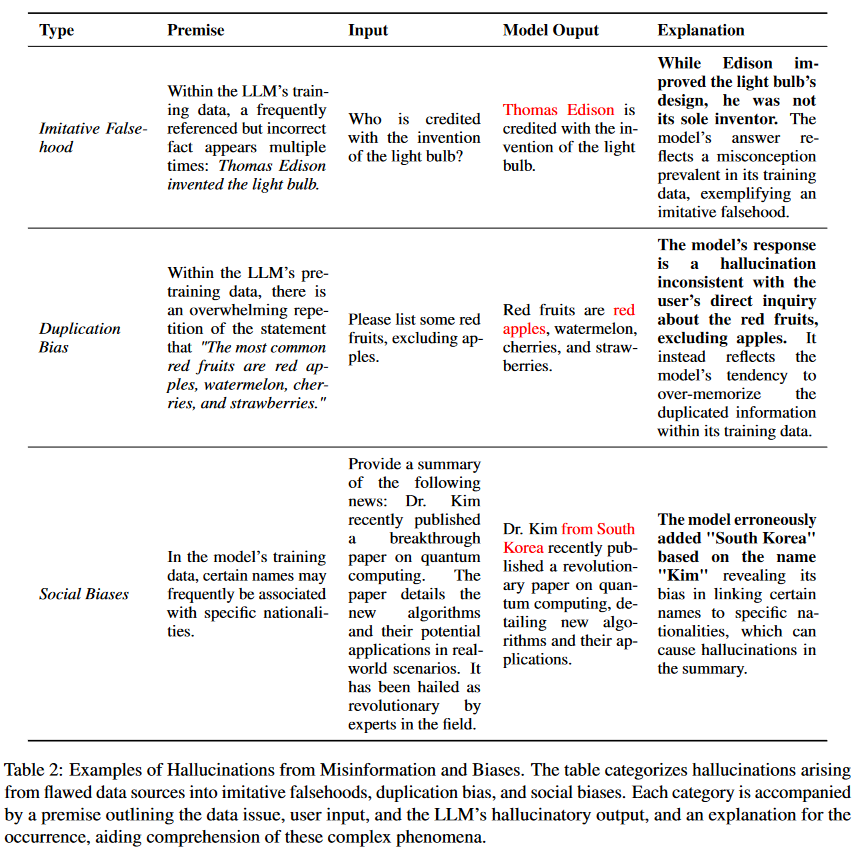

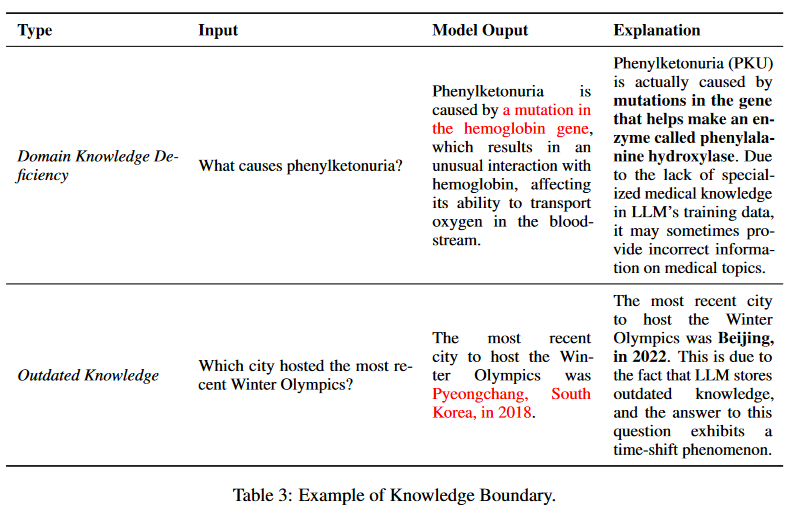

當(dāng)擴(kuò)大預(yù)訓(xùn)練數(shù)據(jù)大大提高了LLM的能力,但在保持一致的數(shù)據(jù)質(zhì)量方面出現(xiàn)了挑戰(zhàn),這可能會(huì)引入錯(cuò)誤信息和偏差。此外,特定領(lǐng)域知識(shí)和數(shù)據(jù)中最新事實(shí)的缺乏會(huì)導(dǎo)致LLM形成知識(shí)邊界,這為特定場(chǎng)景中的LLM帶來了限制。基于此,主要將可能導(dǎo)致幻覺的因素分為錯(cuò)誤信息、偏見和知識(shí)邊界限制。為了更全面地理解,表2列出了每種數(shù)據(jù)導(dǎo)致的幻覺的示例。

錯(cuò)誤信息和偏見:隨著對(duì)大規(guī)模語料庫(kù)需求的日益增長(zhǎng),啟發(fā)式數(shù)據(jù)收集方法被用于高效地收集大量數(shù)據(jù),增加了模仿虛假信息的風(fēng)險(xiǎn)。在提供大量數(shù)據(jù)的同時(shí),它們可能無意中引入錯(cuò)誤信息。此外,社會(huì)偏見可能無意中引入到LLM的學(xué)習(xí)過程。這些偏見主要包括重復(fù)偏見和各種社會(huì)偏見。

模仿虛假信息:LLMs預(yù)訓(xùn)練的主要目標(biāo)是模擬訓(xùn)練分布。當(dāng)LLMs在事實(shí)不正確的數(shù)據(jù)上進(jìn)行訓(xùn)練時(shí),它們可能無意中放大這些不準(zhǔn)確性,可能導(dǎo)致事實(shí)不正確的幻覺,稱為"模仿性虛假信息" 。

重復(fù)偏差:LLMs具有記憶訓(xùn)練數(shù)據(jù)的內(nèi)在傾向,這種記憶趨勢(shì)隨著模型大小的增加而增長(zhǎng)。然而,在預(yù)訓(xùn)練數(shù)據(jù)中存在重復(fù)信息的背景下,固有的記憶能力變得有問題。這種重復(fù)可能會(huì)使LLM從泛化轉(zhuǎn)向記憶,最終導(dǎo)致重復(fù)偏差,即LLM對(duì)重復(fù)數(shù)據(jù)的召回過于優(yōu)先,導(dǎo)致偏離所需內(nèi)容的幻覺。

社會(huì)偏見:某些偏見本質(zhì)上與幻覺有關(guān),特別是與性別和國(guó)籍有關(guān)的偏見。

知識(shí)邊界:雖然龐大的預(yù)訓(xùn)練語料庫(kù)使LLM具有廣泛的事實(shí)知識(shí),但它們本質(zhì)上具有邊界。這種限制主要表現(xiàn)在兩個(gè)方面:缺乏最新的事實(shí)知識(shí)和專業(yè)領(lǐng)域知識(shí)。表3給出了一個(gè)例子。

域內(nèi)知識(shí)缺乏:LLM在通用領(lǐng)域的廣泛下游任務(wù)中表現(xiàn)出了卓越的性能。然而,鑒于這些通用LLM主要是在廣泛的公開數(shù)據(jù)集上訓(xùn)練的,在特定領(lǐng)域的專業(yè)知識(shí)內(nèi)在地受到缺乏專有訓(xùn)練數(shù)據(jù)的限制。

過時(shí)的事實(shí)知識(shí):除了特定領(lǐng)域知識(shí)的不足之外,關(guān)于LLM知識(shí)邊界的另一個(gè)內(nèi)在限制是其最新知識(shí)的能力有限。LLM中嵌入的事實(shí)知識(shí)表現(xiàn)出明確的時(shí)間邊界,并可能隨著時(shí)間的推移而過時(shí)。

數(shù)據(jù)利用率低下

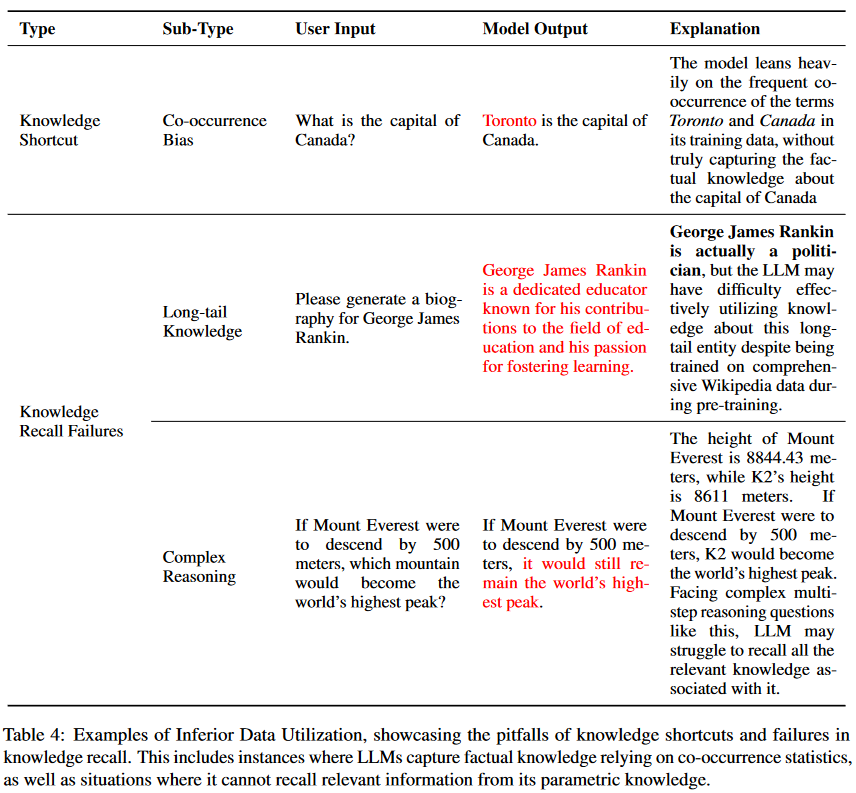

預(yù)訓(xùn)練數(shù)據(jù)體現(xiàn)了豐富的現(xiàn)實(shí)世界事實(shí)知識(shí),使LLM能夠在其參數(shù)中捕獲并隨后編碼大量事實(shí)知識(shí)。然而,盡管有這么龐大的知識(shí)儲(chǔ)備,由于參數(shù)化知識(shí)的低劣利用,仍然可能產(chǎn)生知識(shí)誘導(dǎo)的幻覺。表4列出了與劣質(zhì)數(shù)據(jù)利用相關(guān)的每種幻覺類型的例子。

知識(shí)捷徑:LLM捕獲事實(shí)知識(shí)的確切機(jī)制仍然難以捉摸。最近的研究指出,LLM不是真正理解事實(shí)知識(shí)的復(fù)雜性,而是經(jīng)常求助于捷徑。它們表現(xiàn)出過度依賴預(yù)訓(xùn)練數(shù)據(jù)中的位置接近、共生統(tǒng)計(jì)和相關(guān)文檔計(jì)數(shù)的趨勢(shì),這可能會(huì)引入對(duì)虛假相關(guān)性的偏差,如果偏差反映了事實(shí)不正確的信息,可能導(dǎo)致幻覺。

知識(shí)召回失敗:當(dāng)LLM難以有效利用其廣泛的知識(shí)時(shí),就會(huì)出現(xiàn)幻覺。本文探討了知識(shí)召回中的兩個(gè)主要挑戰(zhàn):記憶長(zhǎng)尾知識(shí)的不足,以及在需要多跳推理和邏輯推理的復(fù)雜場(chǎng)景中的困難。

長(zhǎng)尾知識(shí):長(zhǎng)尾知識(shí)的特點(diǎn)是在預(yù)訓(xùn)練數(shù)據(jù)中相對(duì)稀少,為L(zhǎng)LM提出了固有的挑戰(zhàn),主要依賴共現(xiàn)模式來記憶事實(shí)知識(shí)。

復(fù)雜場(chǎng)景:在多跳問答場(chǎng)景中,由于其推理的局限性,即使LLM擁有必要的知識(shí),如果問題之間存在多種關(guān)聯(lián),則可能難以產(chǎn)生準(zhǔn)確的結(jié)果。此外,研究人員揭示了LLM中被稱為逆轉(zhuǎn)詛咒的特定推理失敗。具體來說,雖然當(dāng)問題表述為“A是B”時(shí),模型可以正確回答,但當(dāng)被問及相反的“B是A”時(shí),它表現(xiàn)出了失敗的邏輯推理。這種推理上的差異超出了簡(jiǎn)單的推論。

來自訓(xùn)練的幻覺

LLM的訓(xùn)練過程主要包括兩個(gè)主要階段:1)預(yù)訓(xùn)練階段,其中LLM學(xué)習(xí)通用表示并捕獲世界知識(shí),以及2)對(duì)齊階段,LLM被調(diào)整以更好地與用戶指令和偏好保持一致。

來自預(yù)訓(xùn)練的幻覺

預(yù)訓(xùn)練是基礎(chǔ)階段,通常采用基于transformer的架構(gòu)在大量語料庫(kù)上進(jìn)行因果語言建模。然而,與幻覺有關(guān)的問題可能來自固有的結(jié)構(gòu)設(shè)計(jì)和所采用的特定訓(xùn)練策略。在本節(jié)中,我們深入研究了結(jié)構(gòu)缺陷和曝光偏差的影響所帶來的挑戰(zhàn)。

結(jié)構(gòu)缺陷:LLM通常采用基于transformer的架構(gòu),遵循GPT建立的范式,通過因果語言建模目標(biāo)獲得表示,該框架以O(shè)PT、Falcon和Llama-2等模型為例。盡管取得了成功,但它也并非沒有缺陷,特別是在單向表示不足和注意力缺陷方面。

單向表示不充分:遵循因果語言建模范式,LLM僅基于前面的token,以從左到右的方式預(yù)測(cè)后面的token。這種單向建模在促進(jìn)高效訓(xùn)練的同時(shí),也有其局限性。它只利用單一方向的上下文,這阻礙了其捕捉復(fù)雜上下文依賴關(guān)系的能力,潛在地增加了幻覺出現(xiàn)的風(fēng)險(xiǎn)。

注意力缺陷:基于transformer的架構(gòu),配備了自注意力模塊,在捕捉長(zhǎng)程依賴關(guān)系方面表現(xiàn)出了非凡的能力。然而,無論模型規(guī)模如何,它們?cè)谒惴ㄍ评淼谋尘跋屡紶枙?huì)出現(xiàn)不可預(yù)測(cè)的推理錯(cuò)誤,包括長(zhǎng)短程依賴關(guān)系。一個(gè)潛在的原因是軟注意力的局限性,隨著序列長(zhǎng)度的增加,注意力在各個(gè)位置上稀釋。

曝光偏差:除了結(jié)構(gòu)缺陷,訓(xùn)練策略也發(fā)揮了至關(guān)重要的作用。暴光偏差現(xiàn)象是由于自回歸生成模型中的訓(xùn)練和推理之間存在差異。在訓(xùn)練過程中,這些模型通常采用教師模型的最大似然估計(jì)(MLE)訓(xùn)練策略,其中提供真實(shí)值作為輸入。然而,在推理過程中,模型依賴于自己生成的內(nèi)容來進(jìn)行后續(xù)的預(yù)測(cè),這種不一致性會(huì)導(dǎo)致幻覺。

來自對(duì)齊的幻覺

對(duì)齊通常涉及兩個(gè)主要過程,即監(jiān)督微調(diào)和從人類反饋中強(qiáng)化學(xué)習(xí)。雖然對(duì)齊顯著提高了LLM響應(yīng)的質(zhì)量,但它也引入了幻覺的風(fēng)險(xiǎn)。我們將與幻覺相關(guān)的對(duì)齊缺陷分為兩部分:能力偏差和信念偏差。

能力未對(duì)齊:考慮到LLM在預(yù)訓(xùn)練過程中建立了固有的能力邊界,SFT利用高質(zhì)量的指令及其相應(yīng)的響應(yīng)來讓LLM遵循用戶指令,釋放他們?cè)诖诉^程中獲得的能力。然而,當(dāng)來自校準(zhǔn)數(shù)據(jù)的需求超過預(yù)定義的能力邊界時(shí),LLM被訓(xùn)練產(chǎn)生超出其自身知識(shí)邊界的內(nèi)容,從而放大了幻覺的風(fēng)險(xiǎn)。

觀點(diǎn)未對(duì)齊:LLM的激活封裝了與其生成的真實(shí)性相關(guān)的內(nèi)部觀點(diǎn)。然而,在這些觀點(diǎn)和生成的輸出之間偶爾會(huì)出現(xiàn)不一致。即使通過人類反饋進(jìn)行了改進(jìn),有時(shí)也會(huì)產(chǎn)生與內(nèi)在觀點(diǎn)不同的輸出。這種行為被稱為諂媚,強(qiáng)調(diào)了模型傾向于安撫人類評(píng)估者,往往以犧牲真實(shí)性為代價(jià)。

來自推理的幻覺

解碼在體現(xiàn)LLM預(yù)訓(xùn)練和對(duì)齊后的能力方面起著重要作用。然而,解碼策略中的某些缺陷可能會(huì)導(dǎo)致LLM幻覺。解碼過程的兩個(gè)潛在原因是解碼策略的固有隨機(jī)性和不完美的解碼表示。

解碼抽樣的隨機(jī)性

隨機(jī)抽樣是目前LLMs采用的主流解碼策略。將隨機(jī)性納入解碼策略的原因在于認(rèn)識(shí)到高似然序列往往會(huì)導(dǎo)致令人驚訝的低質(zhì)量文本,這被稱為似然陷阱。解碼策略中的隨機(jī)性帶來的多樣性是有代價(jià)的,因?yàn)樗c幻覺風(fēng)險(xiǎn)的增加呈正相關(guān)。采樣溫度的升高導(dǎo)致更均勻的token概率分布,增加了從分布尾部采樣頻率較低的token的可能性。因此,這種對(duì)不經(jīng)常出現(xiàn)的token進(jìn)行采樣的傾向加劇了幻覺的風(fēng)險(xiǎn)。

不完美的解碼表示

在解碼階段,LLM使用頂層表示來預(yù)測(cè)下一個(gè)token。然而,頂層表示有其局限性,主要表現(xiàn)在兩個(gè)方面:上下文注意力不足和Softmax瓶頸。

上下文注意力不足:之前的研究,特別是在機(jī)器翻譯和摘要等領(lǐng)域,強(qiáng)調(diào)了使用編碼器-解碼器架構(gòu)的生成模型的過度自信問題。這種過度自信源于過度關(guān)注部分生成的內(nèi)容,通常優(yōu)先考慮流暢性,而不是忠實(shí)地遵循源上下文。雖然主要采用因果語言模型架構(gòu)的大型語言模型已得到廣泛使用,但過度自信現(xiàn)象仍然存在。在生成過程中,對(duì)下一個(gè)詞的預(yù)測(cè)同時(shí)取決于語言模型上下文和部分生成的文本。然而,語言模型在注意力機(jī)制中往往表現(xiàn)出局部焦點(diǎn),優(yōu)先考慮附近的單詞,從而導(dǎo)致上下文注意力的顯著缺陷。這種注意力不足會(huì)直接產(chǎn)生忠實(shí)度幻覺問題,其中模型輸出的內(nèi)容偏離了原始上下文。

Softmax瓶頸:大多數(shù)語言模型使用softmax層,該層與詞嵌入一起對(duì)語言模型中的最終層表示進(jìn)行操作,以計(jì)算與單詞預(yù)測(cè)相關(guān)的最終概率。然而,基于Softmax的語言模型的有效性受到公認(rèn)的Softmax瓶頸的限制,其中將Softmax與分布式詞嵌入結(jié)合使用,在給定上下文的情況下,限制了輸出概率分布的表達(dá)能力,這阻止了語言模型輸出所需的分布引入了幻覺的風(fēng)險(xiǎn)。

幻覺檢測(cè)和基準(zhǔn)

幻覺檢測(cè)

檢測(cè)LLM中的幻覺對(duì)于確保生成內(nèi)容的可靠性和可信性至關(guān)重要。傳統(tǒng)的衡量標(biāo)準(zhǔn)主要是基于詞的重疊,無法區(qū)分合理內(nèi)容和幻覺內(nèi)容之間的細(xì)微差異。鑒于這些幻覺的不同性質(zhì),檢測(cè)方法也會(huì)有所不同。

事實(shí)幻覺檢測(cè)

針對(duì)事實(shí)幻覺的檢測(cè)方法通常分為檢索外部事實(shí)和不確定性估算。

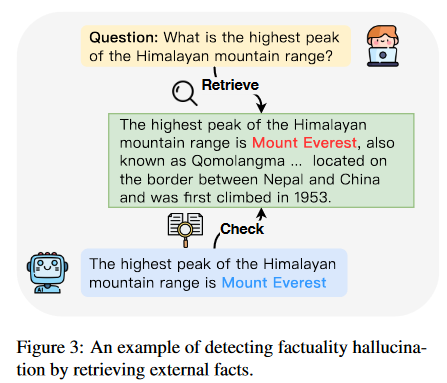

檢索外部事實(shí):為了有效查明LLM輸出中的事實(shí)不準(zhǔn)確性,一種直觀的策略涉及將模型生成的內(nèi)容與可靠的知識(shí)源進(jìn)行比較,如圖3所示。然而,傳統(tǒng)的事實(shí)核查方法經(jīng)常納入簡(jiǎn)化的實(shí)用性假設(shè),在應(yīng)用于復(fù)雜的現(xiàn)實(shí)場(chǎng)景時(shí),會(huì)導(dǎo)致差異。認(rèn)識(shí)到這些限制,研究人員更加強(qiáng)調(diào)現(xiàn)實(shí)世界的場(chǎng)景。他們開創(chuàng)了一個(gè)集成多個(gè)組件的全自動(dòng)管道:斷言分解、原文檔檢索、細(xì)粒度檢索、基于斷言的摘要和準(zhǔn)確性分類。

一些方法通過引入了FACTSCORE,一種專門用于長(zhǎng)文本生成的細(xì)粒度事實(shí)指標(biāo)。它將生成內(nèi)容分解為原事實(shí),然后計(jì)算可靠知識(shí)源支持的百分比。最近,研究人員通過查詢擴(kuò)展增強(qiáng)了檢索幻覺檢測(cè)支持證據(jù)的標(biāo)準(zhǔn)方法。通過在檢索過程中將原始問題與LLM生成的答案相結(jié)合,解決了主題偏航的問題,確保檢索到的段落與問題和LLM的響應(yīng)一致。

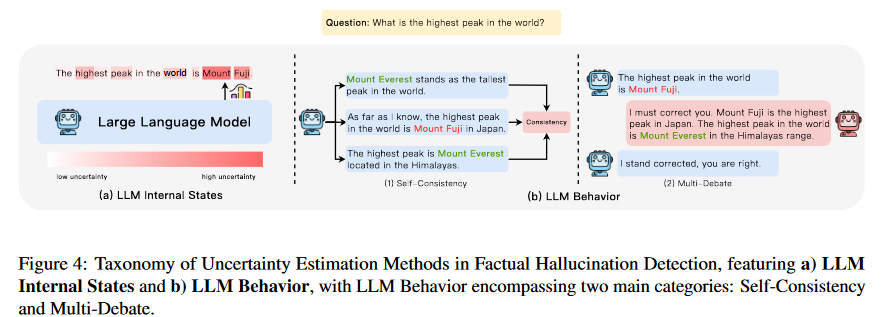

不確定性估算:雖然許多幻覺檢測(cè)方法依賴外部知識(shí)進(jìn)行事實(shí)核查,但已有一些方法用來解決零資源環(huán)境下的這個(gè)問題,從而消除了檢索的需要。這些策略背后的基本前提是,LLM幻覺的起源本質(zhì)上與模型的不確定性有關(guān)。因此,通過估計(jì)模型生成的事實(shí)內(nèi)容的不確定性,檢測(cè)幻覺變得可行。不確定性估計(jì)方法大致可以分為兩類:基于內(nèi)部狀態(tài)的方法和基于LLM行為的方法,如圖4所示。前者的運(yùn)行假設(shè)是人們可以訪問模型的內(nèi)部狀態(tài),而后者則泛化到更受限的環(huán)境,僅利用模型的可觀察行為來推斷其潛在的不確定性。

LLM的內(nèi)部狀態(tài):LLM的內(nèi)部狀態(tài)可以作為其不確定性的信息性指標(biāo),通常通過token概率或熵等指標(biāo)表現(xiàn)出來。通過考慮這些概念中的最小token概率來確定模型對(duì)量化的關(guān)鍵概念的不確定性。其基本原理是,低概率作為模型不確定性的有力指標(biāo),受概念中存在的高概率token的影響較小。類似地,另一種方法采用了一種基于自我評(píng)估的方法來進(jìn)行不確定性估計(jì),其依據(jù)是,語言模型從其生成的解釋中熟練地重建原始概念的能力表明其對(duì)該概念的熟練程度。首先促使模型為給定概念生成解釋,然后利用約束解碼使模型根據(jù)其生成的解釋重新創(chuàng)建原始概念,從響應(yīng)序列中獲得的概率分?jǐn)?shù)可以作為該概念的熟悉度分?jǐn)?shù)。此外,另一種方法通過對(duì)抗性攻擊的視角來解釋幻覺。利用基于梯度的token替換,設(shè)計(jì)了誘導(dǎo)幻覺的提示。值得注意的是,與來自對(duì)抗性攻擊的token相比,從原始提示生成的第一個(gè)token通常表現(xiàn)出低熵。

LLM行為:然而,當(dāng)系統(tǒng)只能通過API調(diào)用訪問時(shí),可能無法訪問輸出的標(biāo)記級(jí)概率分布。鑒于這種限制,一些研究已經(jīng)將重點(diǎn)轉(zhuǎn)移到探索模型的不確定性上,或者通過自然語言提示以檢查其行為表現(xiàn)。例如,通過對(duì)LLM對(duì)同一提示的多個(gè)響應(yīng)進(jìn)行采樣,通過評(píng)估事實(shí)陳述之間的一致性來檢測(cè)幻覺。然而,這些方法主要依賴于直接查詢,明確地從模型中請(qǐng)求信息或驗(yàn)證。受調(diào)查性訪談的啟發(fā),可以使用間接查詢。與直接問題不同,這些間接問題通常提出開放式問題,以引出具體信息。通過使用這些間接查詢,可以更好地評(píng)估多個(gè)模型生成的一致性。除了從單個(gè)LLM的多代的自一致性來評(píng)估不確定性之外,還可以通過合并其他LLM來?yè)肀Ф嘀悄荏w的視角。

忠實(shí)幻覺檢測(cè)

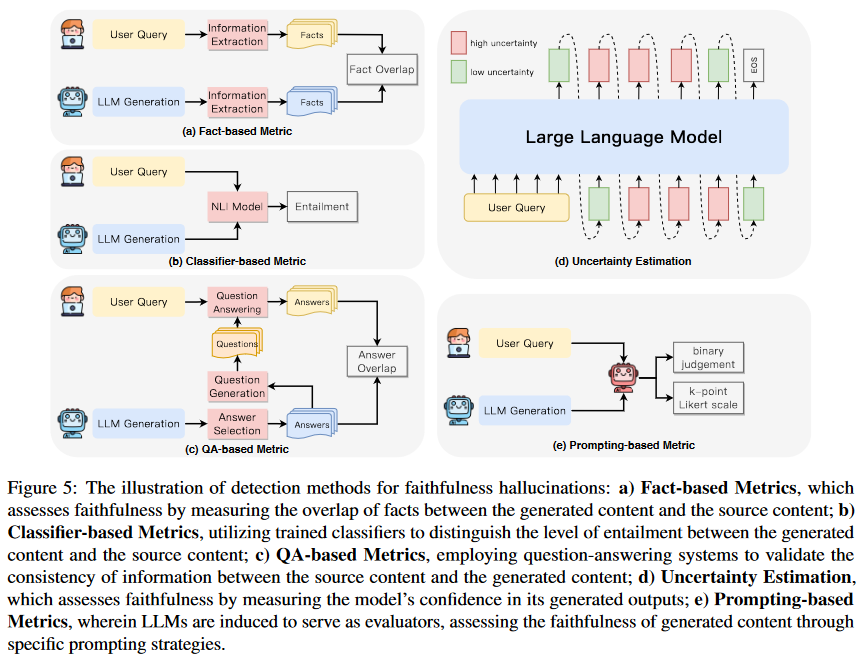

確保LLM忠實(shí)地提供上下文或用戶指令,對(duì)于它們?cè)跓o數(shù)應(yīng)用中的實(shí)際效用至關(guān)重要。忠實(shí)度幻覺檢測(cè)主要關(guān)注于確保生成的內(nèi)容與給定的上下文相一致,避開無關(guān)或矛盾輸出的潛在陷阱。在本節(jié)中,我們將探索在LLM中檢測(cè)不忠實(shí)的方法,并提供圖5中的概述。

基于事實(shí)的指標(biāo):在評(píng)估忠實(shí)度的領(lǐng)域中,最直觀的方法之一涉及測(cè)量生成的內(nèi)容和源內(nèi)容之間關(guān)鍵事實(shí)的重疊度。考慮到事實(shí)的不同表現(xiàn)形式,可以根據(jù)實(shí)體、關(guān)系三元組和知識(shí)對(duì)度量進(jìn)行分類。

基于N-gram:當(dāng)將源內(nèi)容作為參考時(shí),傳統(tǒng)的基于N-gram重疊度的評(píng)價(jià)指標(biāo),如ROUGE和PARENT-T,也可以用于評(píng)估忠實(shí)度。

基于實(shí)體:基于實(shí)體重疊的指標(biāo)普遍應(yīng)用于摘要任務(wù),因?yàn)檫@些關(guān)鍵實(shí)體的遺漏或不準(zhǔn)確的生成都可能導(dǎo)致不忠實(shí)的摘要。

基于關(guān)系:即使實(shí)體匹配,它們之間的關(guān)系也可能是錯(cuò)誤的。因此,更應(yīng)該關(guān)注關(guān)系元組的重疊,該類標(biāo)準(zhǔn)使用經(jīng)過訓(xùn)練的端到端事實(shí)提取模型來計(jì)算提取的關(guān)系元組的重疊。

基于知識(shí):在以知識(shí)為基礎(chǔ)的對(duì)話任務(wù)中,事實(shí)往往與對(duì)話中呈現(xiàn)的知識(shí)相對(duì)應(yīng)。知識(shí)指標(biāo)F1,用以評(píng)估模型的生成與提供的知識(shí)的匹配程度。

基于分類器的指標(biāo):除了計(jì)算事實(shí)重疊度之外,評(píng)估模型忠實(shí)度的另一種直接方法涉及分類器,這些分類器包括特定任務(wù)的幻覺內(nèi)容和忠實(shí)內(nèi)容,以及相關(guān)任務(wù)的數(shù)據(jù)或合成的數(shù)據(jù)。它可以大致分為以下幾種類型:

基于Entailment:許多研究在NLI數(shù)據(jù)集上訓(xùn)練了分類器,以識(shí)別事實(shí)不準(zhǔn)確性,特別是在抽象摘要的背景下。然而,傳統(tǒng)NLI數(shù)據(jù)集與不一致檢測(cè)數(shù)據(jù)集之間的輸入粒度不匹配限制了它們有效檢測(cè)不一致的適用性。在此基礎(chǔ)上,更先進(jìn)的研究提出了一些方法,如對(duì)抗性數(shù)據(jù)集的微調(diào),在依賴acr級(jí)別分解隱含決策,以及將文檔分割成句子單位,然后在句子對(duì)之間匯總分?jǐn)?shù)等方法。

弱監(jiān)督:雖然使用相關(guān)任務(wù)的數(shù)據(jù)來微調(diào)分類器在評(píng)估準(zhǔn)確率方面顯示出了希望,但認(rèn)識(shí)到相關(guān)任務(wù)和下游任務(wù)之間的固有差距是至關(guān)重要的。為了應(yīng)對(duì)這一挑戰(zhàn),一種使用基于規(guī)則的轉(zhuǎn)換來創(chuàng)建弱監(jiān)督數(shù)據(jù)以微調(diào)分類器的方法被提出。同時(shí),研究人員設(shè)計(jì)了一種自動(dòng)生成標(biāo)記級(jí)幻覺數(shù)據(jù)并執(zhí)行標(biāo)記級(jí)幻覺檢測(cè)的方法。

基于問答的指標(biāo):與基于分類器的指標(biāo)相比,基于QA的指標(biāo)因?yàn)樗鼈冊(cè)鰪?qiáng)了捕捉模型生成與其來源之間信息重疊的能力受到了關(guān)注。這些指標(biāo)通過從LLM輸出內(nèi)的信息單元中初步選擇目標(biāo)答案進(jìn)行操作,然后由問題生成模塊生成問題。這些問題隨后用于根據(jù)用戶上下文生成源答案。最后,通過比較源和目標(biāo)答案的匹配分?jǐn)?shù)來計(jì)算LLM答案的忠實(shí)度。

不確定性估計(jì):有條件文本生成中的幻覺與模型的高度不確定性密切相關(guān)。

基于熵:數(shù)據(jù)到文本生成中的幻覺可能性和預(yù)測(cè)不確定性之間存在正相關(guān),這是通過深度集成估計(jì)的。此外,利用蒙特卡羅Dropout產(chǎn)生的假設(shè)方差作為神經(jīng)機(jī)器翻譯(NMT)中的不確定性度量。最近,特有方法使用條件熵評(píng)估生成式摘要的模型不確定性。

基于對(duì)數(shù)概率:使用長(zhǎng)度歸一化序列對(duì)數(shù)概率來度量模型置信度。

基于模型:使用SelfCheck專注于復(fù)雜推理中的錯(cuò)誤檢測(cè)。該系統(tǒng)通過目標(biāo)提取、信息收集、步驟再生和結(jié)果比較的簡(jiǎn)化過程來聚合置信度分?jǐn)?shù),從而提高問答的準(zhǔn)確性。

基于提示的指標(biāo):LLM卓越的指令能力突出了其自動(dòng)評(píng)估的潛力。利用這種能力,研究人員已經(jīng)冒險(xiǎn)采用新的范式來評(píng)估模型生成內(nèi)容的忠實(shí)度。通過為L(zhǎng)LM提供具體的評(píng)估指南,并向它們提供模型生成的和源內(nèi)容,它們可以有效地評(píng)估忠實(shí)度。最終的評(píng)估輸出可以是忠實(shí)度的二元判斷,也可以是表示忠實(shí)度的k點(diǎn)李克特量表。對(duì)于提示選擇,評(píng)估提示可以是直接提示、思維鏈提示,使用上下文學(xué)習(xí),或允許模型生成帶有解釋的評(píng)估結(jié)果。

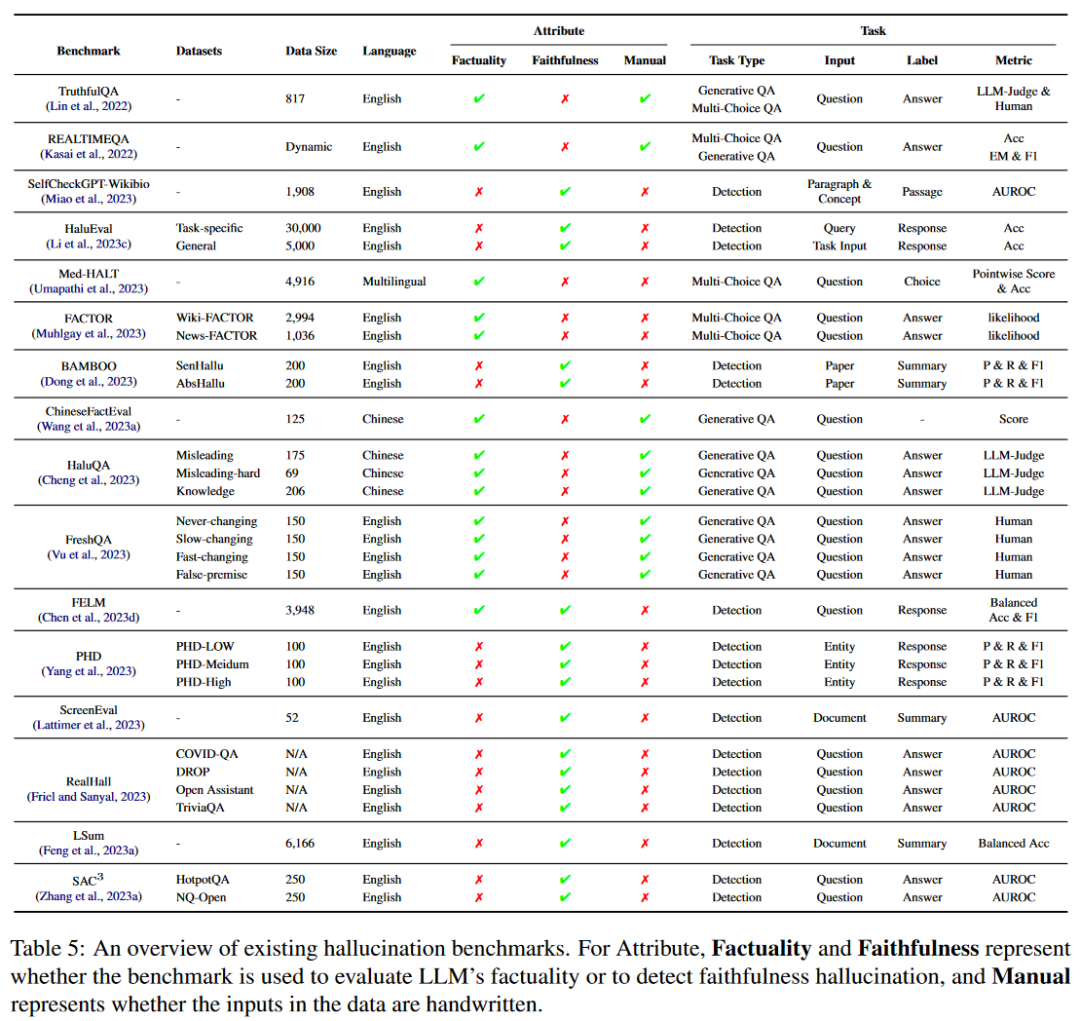

基準(zhǔn)

幻覺基準(zhǔn)可以分為兩個(gè)主要領(lǐng)域:幻覺評(píng)估基準(zhǔn),評(píng)估現(xiàn)有前沿LLM產(chǎn)生的幻覺程度;以及幻覺檢測(cè)基準(zhǔn),專門用于評(píng)估現(xiàn)有幻覺檢測(cè)方法的性能。

幻覺評(píng)估基準(zhǔn)

幻覺評(píng)估基準(zhǔn)是為了評(píng)估LLMs產(chǎn)生幻覺的傾向而設(shè)計(jì)的,特別強(qiáng)調(diào)識(shí)別事實(shí)的不準(zhǔn)確性和測(cè)量與原始環(huán)境的偏差。目前,這些基準(zhǔn)的主要焦點(diǎn)是評(píng)估生成內(nèi)容的真實(shí)性。TruthfulQA:包含817個(gè)問題,涵蓋健康、法律、金融和政治等38個(gè)不同類別,是專門設(shè)計(jì)用于評(píng)估語言模型真實(shí)性的基準(zhǔn)。它使用一種對(duì)抗性的方法,旨在引出“模仿謬誤”——由于模型在訓(xùn)練數(shù)據(jù)中頻繁出現(xiàn)而可能產(chǎn)生的誤導(dǎo)性反應(yīng)。基準(zhǔn)測(cè)試分為兩部分,其中一部分包含人工篩選的問題,通過過濾掉GPT-3正確回答的問題,進(jìn)一步篩選出437個(gè)問題。另一部分包括380個(gè)未經(jīng)過濾的非對(duì)抗性問題。對(duì)于評(píng)估,TruthfulQA提供了兩種類型的問答任務(wù):生成和選擇題,并采用人工評(píng)估來衡量模型的真實(shí)性和信息性。此外,該基準(zhǔn)還引入了一個(gè)名為GPT-judge的自動(dòng)度量,該度量在6.7B GPT-3模型上進(jìn)行了微調(diào)。

REALTIMEQA:考慮到世界知識(shí)是不斷發(fā)展的,驗(yàn)證LLMs關(guān)于當(dāng)前世界的真實(shí)性就變得至關(guān)重要。這個(gè)基準(zhǔn)提供了實(shí)時(shí)的開放域選擇題,這些選擇題來源于新發(fā)布的新聞文章,涵蓋了政治、商業(yè)、體育和娛樂等多種主題。此外,該基準(zhǔn)還提供了一個(gè)實(shí)時(shí)評(píng)估的平臺(tái),可以通過準(zhǔn)確度評(píng)估的多項(xiàng)選擇格式,也可以使用精確匹配和基于token的F1指標(biāo)評(píng)估生成設(shè)置。

Med-HALT:鑒于幻覺在醫(yī)學(xué)領(lǐng)域?qū)颊咦o(hù)理的重要性,該基準(zhǔn)強(qiáng)調(diào)了醫(yī)學(xué)領(lǐng)域特定于LLM的挑戰(zhàn)。Med-HALT結(jié)合了來自不同國(guó)家的多項(xiàng)選擇,旨在評(píng)估LLMs在醫(yī)學(xué)背景下的推理和記憶。推理任務(wù)有18,866個(gè)樣本,通過使用醫(yī)學(xué)多項(xiàng)選擇題測(cè)試LLM區(qū)分不正確或不相關(guān)選項(xiàng)和假問題的能力。同時(shí),由4916個(gè)樣本組成的記憶任務(wù),評(píng)估了LLM通過從PubMed摘要/標(biāo)題生成鏈接或從給定鏈接和PIMDs生成標(biāo)題來召回和生成準(zhǔn)確事實(shí)信息的能力。對(duì)于評(píng)估,LLM的表現(xiàn)由它們?cè)跍y(cè)試問題上的準(zhǔn)確性或逐點(diǎn)分?jǐn)?shù)來衡量,該分?jǐn)?shù)既考慮正確答案的積極分?jǐn)?shù),也考慮錯(cuò)誤答案的消極懲罰。

FACTOR:為了定量評(píng)估語言模型的真實(shí)性,出現(xiàn)了通過擾動(dòng)指定語料庫(kù)中的事實(shí)陳述來自動(dòng)創(chuàng)建基準(zhǔn)的方法。產(chǎn)生了兩個(gè)基準(zhǔn)測(cè)試:Wiki-FACTOR和News-FACTOR。具體來說,對(duì)于給定的前綴文本,語料庫(kù)中的原始補(bǔ)全作為事實(shí)正確的答案。然后用包含特定錯(cuò)誤類型的提示來指導(dǎo)InstructGPT生成非事實(shí)的完成。這些生成的回答隨后被過濾流暢和自我一致性,作為多項(xiàng)選擇任務(wù)的基礎(chǔ)。

ChineseFactEval:通過收集來自常識(shí)、科學(xué)研究、醫(yī)學(xué)、法律、金融、數(shù)學(xué)和中國(guó)近代史等不同領(lǐng)域的問題,ChineseFactEval使用125個(gè)問題來評(píng)估六個(gè)當(dāng)代中國(guó)llm的事實(shí)能力,以及GPT-4。在評(píng)估中,問題根據(jù)各種LLM實(shí)現(xiàn)的準(zhǔn)確性進(jìn)行分類,不同難度的問題分配不同的分?jǐn)?shù)。所有LLM的響應(yīng)主要由人工注釋,由FacTool補(bǔ)充,然后使用最終分?jǐn)?shù)來評(píng)估它們的真實(shí)性。

HalluQA:借鑒了TruthfulQA的構(gòu)建方法,旨在專門評(píng)估中國(guó)LLM中的幻覺,側(cè)重于模仿性的謊言和事實(shí)錯(cuò)誤。該基準(zhǔn)由30個(gè)領(lǐng)域的450個(gè)手工制作的對(duì)抗性問題組成,分為兩部分。誤導(dǎo)部分捕獲了成功欺騙GLM-130B的問題,而知識(shí)部分保留了ChatGPT和Puyu一致回答錯(cuò)誤的問題。為了進(jìn)行評(píng)估,LLM生成這些問題的答案,然后使用GPT-4將這些答案與正確答案進(jìn)行比較,以確定答案是否包含幻覺。

FreshQA:認(rèn)識(shí)到幻覺可能部分源于過時(shí)知識(shí),引入了該基準(zhǔn)來評(píng)估現(xiàn)有LLM的真實(shí)性。該基準(zhǔn)包括600個(gè)手工設(shè)計(jì)的問題,其答案可能隨著時(shí)間的推移而變化,或其前提實(shí)際上不正確,該基準(zhǔn)主要評(píng)估LLM快速變化知識(shí)的能力以及識(shí)別具有錯(cuò)誤前提的問題的能力。在評(píng)估方面,該基準(zhǔn)提供了兩種模式的評(píng)估過程:RELAXED和STRICT,前者只評(píng)估原始答案的正確性,后者進(jìn)一步評(píng)估答案中每個(gè)事實(shí)的正確性。

幻覺檢測(cè)基準(zhǔn)

對(duì)于幻覺檢測(cè)基準(zhǔn),大多數(shù)之前的研究主要集中在特定任務(wù)的幻覺上。然而,這些研究中產(chǎn)生的內(nèi)容往往來自能力較弱的模型,如BART和PEGASUS。因此,它們可能不能準(zhǔn)確地反映幻覺檢測(cè)策略的有效性。

SelfCheckGPT-Wikibio:基于維基生物數(shù)據(jù)集的概念,使用GPT-3生成合成維基百科文章,引入了一個(gè)句子級(jí)的幻覺檢測(cè)數(shù)據(jù)集。然后對(duì)這些段落的真實(shí)性在句子一級(jí)進(jìn)行人工注釋,總共為238篇文章生成了1908個(gè)句子。

HaluEval:為了評(píng)估LLM識(shí)別幻覺的能力,使用自動(dòng)生成和人工注釋相結(jié)合的方式構(gòu)建,產(chǎn)生了5000個(gè)一般用戶查詢與ChatGPT響應(yīng)以及30000個(gè)特定任務(wù)樣本。自動(dòng)生成采用了“先采樣再過濾”的方法。該基準(zhǔn)利用問答、基于知識(shí)的對(duì)話和文本摘要等特定任務(wù)的數(shù)據(jù)集,首先使用ChatGPT根據(jù)與任務(wù)相關(guān)的幻覺模式對(duì)多層面的幻覺答案進(jìn)行采樣,然后用ChatGPT選擇最可信的幻覺樣本。

BAMBOO:該基準(zhǔn)引入了兩個(gè)新的數(shù)據(jù)集SenHallu和AbsHallu,旨在檢測(cè)長(zhǎng)文本背景下的幻覺。這些數(shù)據(jù)集是通過誘導(dǎo)ChatGPT在給定學(xué)術(shù)論文的情況下產(chǎn)生幻覺來構(gòu)建的。

FELM:該基準(zhǔn)評(píng)估了五個(gè)領(lǐng)域的真實(shí)性:世界知識(shí)、科學(xué)和技術(shù)、數(shù)學(xué)、寫作和推薦以及推理。雖然早期的研究有意地根據(jù)特定的模式誘導(dǎo)LLM產(chǎn)生幻覺,但該基準(zhǔn)使用ChatGPT在零樣本設(shè)置中產(chǎn)生響應(yīng),共產(chǎn)生817個(gè)樣本(包括3948個(gè)片段)。每個(gè)段都標(biāo)注了事實(shí)性、錯(cuò)誤原因、錯(cuò)誤類型和外部引用。作為事實(shí)性檢測(cè)器的測(cè)試平臺(tái),該基準(zhǔn)采用F1得分和平衡分類精度來評(píng)估片段和響應(yīng)級(jí)別的事實(shí)性錯(cuò)誤。

PHD:該基準(zhǔn)強(qiáng)調(diào)的不是句子級(jí)的幻覺檢測(cè),而是篇章級(jí)的檢測(cè)。基準(zhǔn)的構(gòu)建首先從Wikipedia轉(zhuǎn)儲(chǔ)中提取實(shí)體,然后使用ChatGPT生成段落。當(dāng)LLM缺乏足夠的知識(shí)時(shí),通常會(huì)出現(xiàn)事實(shí)錯(cuò)誤,因此基準(zhǔn)測(cè)試根據(jù)谷歌搜索返回的相關(guān)項(xiàng)的數(shù)量來選擇實(shí)體。

ScreenEval:該基準(zhǔn)將范圍擴(kuò)展到長(zhǎng)格式對(duì)話中的事實(shí)不一致。基于SummScreen數(shù)據(jù)集,該數(shù)據(jù)集包括電視腳本和人工制作的摘要,該基準(zhǔn)測(cè)試在句子級(jí)別為L(zhǎng)ongformer和GPT-4生成的摘要引入事實(shí)不一致注釋,從而得到包含52個(gè)文檔和624個(gè)摘要句子的數(shù)據(jù)集。在評(píng)估方面,使用AUROC評(píng)分在此基準(zhǔn)上對(duì)幻覺檢測(cè)方法進(jìn)行評(píng)估。

RealHall:該基準(zhǔn)的構(gòu)建遵循以下原則:幻覺檢測(cè)基準(zhǔn)中的任務(wù)應(yīng)該對(duì)LLMs提出實(shí)質(zhì)性的挑戰(zhàn),并與現(xiàn)實(shí)世界的應(yīng)用相關(guān),同時(shí)確保多樣性的廣度。與此一致,基準(zhǔn)測(cè)試將重點(diǎn)放在問答任務(wù)上,根據(jù)提示中參考文本的可用性將其分為Closed和Open組。基準(zhǔn)測(cè)試中的每個(gè)問題最初都使用ChatGPT生成響應(yīng),隨后通過涉及人工注釋、GPT4評(píng)估和基于規(guī)則的自動(dòng)評(píng)估的組合方法為這些響應(yīng)分配布爾真值標(biāo)簽。使用AUROC評(píng)分對(duì)應(yīng)用于該基準(zhǔn)的幻覺檢測(cè)方法的有效性進(jìn)行量化。

LSum:基準(zhǔn)集中在LLMs摘要任務(wù)中的事實(shí)一致性檢測(cè)上。該基準(zhǔn)基于XSum,包括使用來自GPTfamily、GLM-family和LLaMA家族的各種LLM生成摘要,并使用ChatGPT和GPT4在句子層面對(duì)事實(shí)一致性進(jìn)行注釋,總共有6166個(gè)注釋摘要。

SAC3:該基準(zhǔn)測(cè)試包括兩個(gè)數(shù)據(jù)集:HotpotQA-halu和NQopen-halu。這些數(shù)據(jù)集分別從HotpotQA和NQ-open的訓(xùn)練集中抽取250個(gè)樣本來構(gòu)建。然后用GPT-3.5渦輪增壓產(chǎn)生幻覺答案。然后,對(duì)答案進(jìn)行人工注釋,將其與基礎(chǔ)事實(shí)和相關(guān)知識(shí)來源進(jìn)行比較。

緩解幻覺

緩解與數(shù)據(jù)相關(guān)的幻覺

與數(shù)據(jù)相關(guān)的幻覺通常是偏見、錯(cuò)誤信息和知識(shí)差距的原因,這些基本都植根于訓(xùn)練數(shù)據(jù)。

緩解錯(cuò)誤信息和偏差

為了減少錯(cuò)誤信息和偏見的存在,最直觀的方法是收集高質(zhì)量的事實(shí)數(shù)據(jù)以防止引入錯(cuò)誤信息,并進(jìn)行數(shù)據(jù)清洗以消除偏見。

增強(qiáng)事實(shí)數(shù)據(jù):最直接的方法是手動(dòng)管理預(yù)訓(xùn)練數(shù)據(jù)集。然而,隨著預(yù)訓(xùn)練數(shù)據(jù)集的不斷擴(kuò)展,人工管理成為一個(gè)挑戰(zhàn)。考慮到學(xué)術(shù)或?qū)I(yè)領(lǐng)域的數(shù)據(jù)通常是事實(shí)準(zhǔn)確的,收集高質(zhì)量的數(shù)據(jù)成為主要策略。

消除偏見:預(yù)訓(xùn)練數(shù)據(jù)的偏見可分為重復(fù)偏見和社會(huì)偏見,每種都需要不同的消除偏見的方法。

重復(fù)偏見:通常分為完全重復(fù)和近似重復(fù)。對(duì)于完全重復(fù)項(xiàng),最直接的方法包括精確子字符串匹配,以識(shí)別相同的字符串。然而,考慮到預(yù)訓(xùn)練數(shù)據(jù)的龐大,這個(gè)過程可能是計(jì)算密集型的。此外,一種更有效的方法利用后綴數(shù)組的構(gòu)造,能夠在線性時(shí)間內(nèi)有效地計(jì)算大量子字符串查詢。關(guān)于近似重復(fù),識(shí)別通常涉及近似全文匹配,通常使用基于哈希的技術(shù)來識(shí)別具有顯著N-gram重疊的文檔對(duì)。

社會(huì)偏見:當(dāng)前的主流解決方案嚴(yán)重依賴于精心策劃的培訓(xùn)語料庫(kù)。通過仔細(xì)選擇多樣化、平衡和代表性的訓(xùn)練數(shù)據(jù),我們可以減輕偏見,可能會(huì)引發(fā)幻覺。此外,還引入了工具包,使用戶能夠消除現(xiàn)有模型和自定義模型的偏見。

緩解知識(shí)邊界

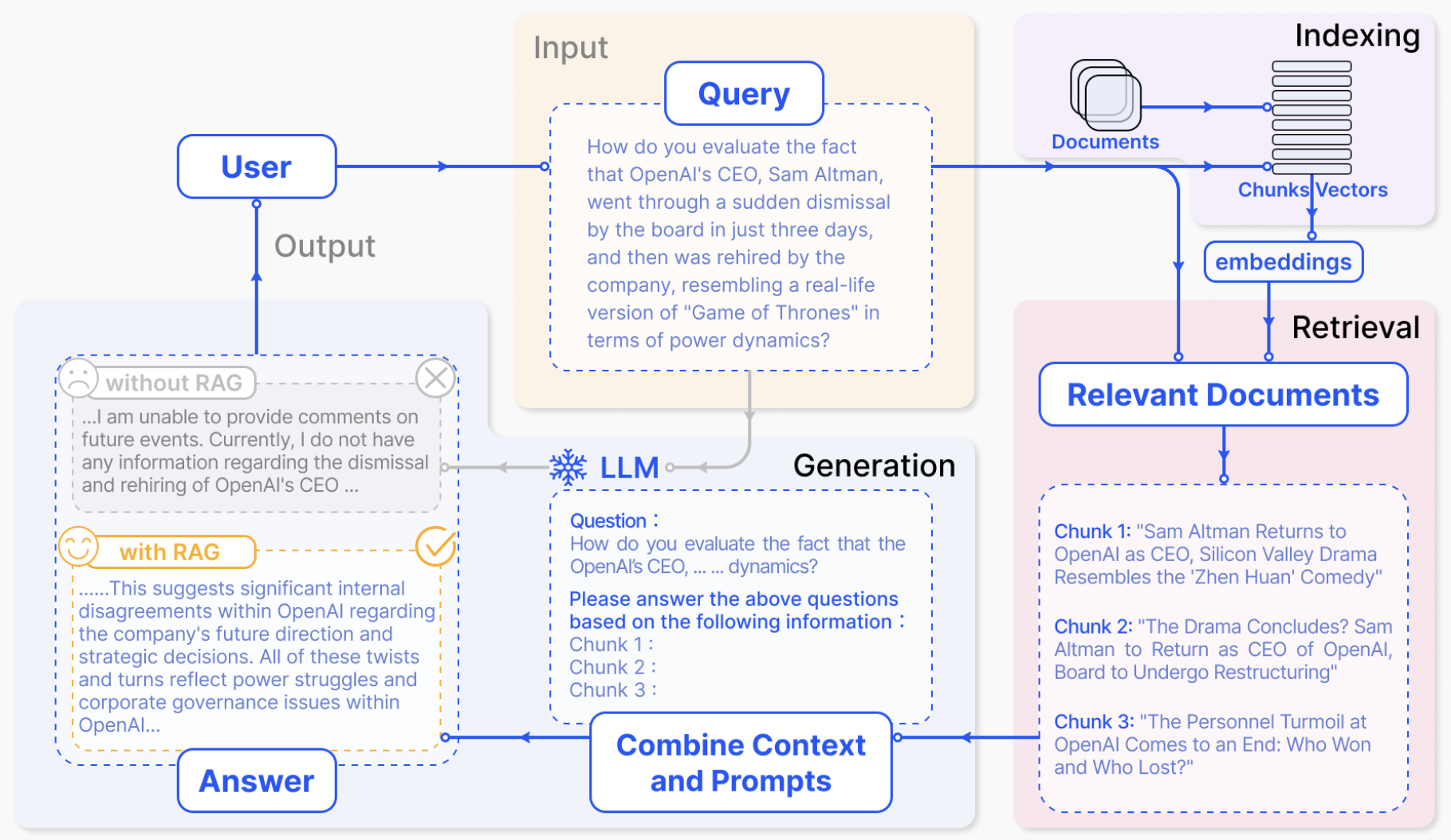

受訓(xùn)練數(shù)據(jù)的覆蓋范圍和時(shí)間邊界的限制,不可避免地形成知識(shí)邊界。通常有兩種方法解決這一問題,一是知識(shí)編輯,旨在直接編輯模型參數(shù)以彌合知識(shí)鴻溝。另一種通過檢索增強(qiáng)生成(RAG)利用非參數(shù)知識(shí)源。

知識(shí)編輯:目的是通過納入額外的知識(shí)來糾正模型行為。當(dāng)前的知識(shí)編輯技術(shù)可以修復(fù)事實(shí)性錯(cuò)誤和刷新過時(shí)的信息以緩解知識(shí)鴻溝,可分為兩類:通過修改模型參數(shù)改變模型的行為或使用外部模型插件凍結(jié)原始模型。

修改模型參數(shù):這類技術(shù)直接將知識(shí)注入到原始模型中,導(dǎo)致模型輸出的實(shí)質(zhì)性改變,這可以進(jìn)一步分為定位后編輯方法和元學(xué)習(xí)方法。定位后編輯方法由兩個(gè)階段組成,首先定位模型參數(shù)中“有bug的”部分,然后對(duì)它們進(jìn)行更新以改變模型的行為。元學(xué)習(xí)方法訓(xùn)練一個(gè)外部超網(wǎng)絡(luò)來預(yù)測(cè)原始模型的權(quán)重更新。然而,元學(xué)習(xí)方法往往需要額外的訓(xùn)練和記憶成本,需要專門的設(shè)計(jì)來減小llm時(shí)代超網(wǎng)絡(luò)的規(guī)模(如低秩分解)。雖然這些方法可以細(xì)粒度地調(diào)整模型的行為,但對(duì)參數(shù)的修改可能會(huì)對(duì)模型的固有知識(shí)產(chǎn)生潛在的有害影響。

保留模型參數(shù):一些研究不是直接修改模型參數(shù),而是將額外的模型插件應(yīng)用到原始模型中,以實(shí)現(xiàn)模型行為的所需更改。SERAC采用了一個(gè)范圍分類器,將存儲(chǔ)在外部編輯記憶中的與新知識(shí)相關(guān)的輸入路由到反事實(shí)模型,這可以幫助基本模型處理更新的信息。與整個(gè)模型相比,有多種技術(shù)涉及將額外的參數(shù)層(例如適配器層)作為插件合并到原始模型中。T-Patcher和NKB都將補(bǔ)丁添加到FFN層中,這些層被認(rèn)為是存儲(chǔ)知識(shí)的存儲(chǔ)庫(kù),以糾正事實(shí)錯(cuò)誤。CALINET 提出了一種識(shí)別PLM中錯(cuò)誤知識(shí)的評(píng)估方法,并通過引入類似FFN的內(nèi)存槽來調(diào)整輸出,這有助于緩解知識(shí)鴻溝。這些方法需要額外的步驟來訓(xùn)練參數(shù)模塊,精心設(shè)計(jì)訓(xùn)練功能和結(jié)構(gòu),使插件在保持原始模塊處理未編輯事實(shí)的同時(shí),發(fā)揮更新知識(shí)的作用。

檢索增強(qiáng):減輕知識(shí)鴻溝的直觀方法是檢索增強(qiáng)生成(RAG),通過對(duì)從外部知識(shí)源檢索的相關(guān)文檔進(jìn)行條件約束,使LLM生成ground-truth。通常,RAG遵循檢索后讀取,其中相關(guān)的上下文文檔首先由檢索器從外部源檢索,然后由生成器對(duì)輸入文本和檢索文檔進(jìn)行條件約束生成所需的輸出。將使用檢索增強(qiáng)來減輕幻覺的方法分為三種類型,包括一次性檢索、迭代檢索和事后檢索。

一次檢索:目的是將單次檢索獲得的外部知識(shí)直接添加到LLMs的提示符中。Incontext RALM是一種簡(jiǎn)單而有效的策略,即將選定的文檔預(yù)先添加到LLM的輸入文本中。PKG采用可訓(xùn)練的背景知識(shí)模塊,將其與任務(wù)知識(shí)對(duì)齊,生成相關(guān)的上下文信息。PKG的有效性突出了通過整合檢索到的背景知識(shí)來提高LLM忠誠(chéng)度的潛力。

迭代檢索:當(dāng)面對(duì)復(fù)雜的挑戰(zhàn)時(shí)(如多步推理和長(zhǎng)篇問答),傳統(tǒng)的一次性檢索可能不足。針對(duì)這些苛刻的信息需求,最近的研究提出了迭代檢索,它允許在整個(gè)生成過程中不斷收集知識(shí)。一個(gè)新興的研究方向試圖通過將這些復(fù)雜的任務(wù)分解成更易于管理的子任務(wù)來解決這些復(fù)雜的任務(wù)。認(rèn)識(shí)到思維鏈提示在多步驟推理中帶來的實(shí)質(zhì)性進(jìn)步,許多研究嘗試在每個(gè)推理步驟中納入外部知識(shí),并進(jìn)一步指導(dǎo)基于正在進(jìn)行的推理的檢索過程,減少推理鏈中的事實(shí)錯(cuò)誤。

事后檢索:通過隨后的基于檢索的修訂來細(xì)化LLM輸出。為了提高LLM的可信度和歸因性,研究人員先研究相關(guān)證據(jù),然后根據(jù)發(fā)現(xiàn)的與證據(jù)的差異對(duì)初始生成進(jìn)行修改。同樣,有方法引入了驗(yàn)證和驗(yàn)證框架,通過引入外部知識(shí)來提高推理鏈的事實(shí)準(zhǔn)確性。對(duì)于一致性低于平均水平的推理鏈,框架生成驗(yàn)證問題,然后根據(jù)檢索到的知識(shí)提煉基本原理,確保更真實(shí)的響應(yīng)。

緩解知識(shí)捷徑

當(dāng)LLMs依靠虛假的相關(guān)性(如預(yù)訓(xùn)練語料庫(kù)的共現(xiàn)統(tǒng)計(jì))來獲取事實(shí)知識(shí)時(shí),知識(shí)捷徑就會(huì)顯現(xiàn)出來。可以通過排除有偏樣本構(gòu)建的去偏數(shù)據(jù)集進(jìn)行微調(diào)。盡管這導(dǎo)致頻繁事實(shí)的召回率顯著下降,因?yàn)楦嗟臉颖颈慌懦谕猓?dāng)微調(diào)過程中看不到罕見事實(shí)時(shí),這種方法很難泛化。

緩解知識(shí)召回失敗

LLMs產(chǎn)生幻覺的一個(gè)普遍原因是他們無法準(zhǔn)確地檢索和應(yīng)用嵌入在參數(shù)化知識(shí)中的相關(guān)信息。在信息完整性至關(guān)重要的復(fù)雜推理場(chǎng)景中,這一挑戰(zhàn)尤為嚴(yán)峻。通過增強(qiáng)知識(shí)回憶,我們可以更好地將模型的輸出錨定到可驗(yàn)證的知識(shí)上,從而提供更強(qiáng)大的防御,防止產(chǎn)生幻覺內(nèi)容。通常,召回知識(shí)最直接的方法是讓LLMs通過思維鏈提示進(jìn)行推理。

緩解訓(xùn)練相關(guān)幻覺

為了解決與預(yù)訓(xùn)練相關(guān)的幻覺,大多數(shù)研究強(qiáng)調(diào)探索新的模型架構(gòu)和改進(jìn)預(yù)訓(xùn)練目標(biāo)。

緩解預(yù)訓(xùn)練相關(guān)幻覺

緩解有缺陷的模型結(jié)構(gòu):減輕預(yù)訓(xùn)練相關(guān)幻覺的一個(gè)重要研究途徑集中在模型架構(gòu)固有的局限性上,特別是單向表示和注意故障。鑒于此,許多研究已經(jīng)深入到設(shè)計(jì)新穎的模型架構(gòu),專門針對(duì)這些缺陷進(jìn)行改進(jìn)。

緩解單向表示:引入采用雙向自回歸方法的BATGPT。這種設(shè)計(jì)允許模型基于以前看到的所有標(biāo)記來預(yù)測(cè)下一個(gè)標(biāo)記,同時(shí)考慮過去和未來的上下文,從而捕獲兩個(gè)方向上的依賴關(guān)系。

減輕注意力故障:利用注意銳化正則化器。這種即插即用的方法使用可微損失項(xiàng)來簡(jiǎn)化自關(guān)注架構(gòu),以促進(jìn)稀疏性,從而顯著減少推理幻覺。

緩解次優(yōu)預(yù)訓(xùn)練目標(biāo):傳統(tǒng)目標(biāo)可能導(dǎo)致模型輸出中的碎片化表示和不一致。最近的進(jìn)展試圖通過改進(jìn)預(yù)訓(xùn)練策略,確保更豐富的上下文理解和規(guī)避偏見來解決這些挑戰(zhàn)。本節(jié)闡明了這些開創(chuàng)性的方法,包括新的訓(xùn)練目標(biāo)和消除曝光偏差方法。

訓(xùn)練目標(biāo):由于GPU內(nèi)存約束和計(jì)算效率,文檔級(jí)別的非結(jié)構(gòu)化事實(shí)知識(shí)經(jīng)常被分塊,導(dǎo)致信息碎片化和不正確的實(shí)體關(guān)聯(lián),引入了一種事實(shí)增強(qiáng)的訓(xùn)練方法。通過給事實(shí)文檔中的每個(gè)句子附加一個(gè)TOPICPREFIX,該方法將它們轉(zhuǎn)換為獨(dú)立的事實(shí),顯著減少了事實(shí)錯(cuò)誤,增強(qiáng)了模型對(duì)事實(shí)關(guān)聯(lián)的理解。

曝光偏差:曝光偏差引起的幻覺與錯(cuò)誤積累有著復(fù)雜的聯(lián)系。在置換多任務(wù)學(xué)習(xí)框架中引入了中間序列作為監(jiān)督信號(hào),以減輕NMT領(lǐng)域移位場(chǎng)景中的虛假相關(guān)性。此外,通過采用最小貝葉斯風(fēng)險(xiǎn)解碼也可以進(jìn)一步減少與曝光偏差相關(guān)的幻覺。

緩解未對(duì)齊引起的幻覺

為了解決這個(gè)問題,一個(gè)直接的策略是改進(jìn)人類的偏好判斷,進(jìn)而改進(jìn)偏好模型。研究LLM的使用,以幫助人類標(biāo)記者識(shí)別被忽視的缺陷。此外,匯總多種人類偏好可以提高反饋質(zhì)量,從而減少諂媚。對(duì)LLM內(nèi)部激活的修改也顯示出改變模型行為的潛力。這可以通過微調(diào)或推理期間的激活轉(zhuǎn)向。具體來說,使用綜合數(shù)據(jù)對(duì)語言模型進(jìn)行微調(diào),其中主張的基本事實(shí)獨(dú)立于用戶的意見,旨在減少阿諛奉承的傾向。另一種研究方法是通過激活導(dǎo)向來減輕阿諛奉承。這種方法包括使用成對(duì)的阿諛/非阿諛提示來生成阿諛導(dǎo)向矢量,該矢量來自對(duì)中間激活的差異進(jìn)行平均。

緩解推理相關(guān)幻覺

事實(shí)增強(qiáng)解碼

通過強(qiáng)調(diào)事實(shí)的準(zhǔn)確性,該策略旨在生成嚴(yán)格遵循真實(shí)世界信息的輸出,并抵制產(chǎn)生誤導(dǎo)性或虛假的陳述。

獨(dú)立解碼:考慮到采樣過程中的隨機(jī)性會(huì)將非事實(shí)內(nèi)容引入開放式文本生成,引入了事實(shí)核采樣算法,該算法在整個(gè)句子生成過程中動(dòng)態(tài)調(diào)整"核心"。該解碼策略根據(jù)衰減因子和下界動(dòng)態(tài)調(diào)整核概率,并在每個(gè)新句子開始時(shí)重新設(shè)置核概率,從而在生成事實(shí)內(nèi)容和保持輸出多樣性之間取得平衡。此外,一些研究假設(shè)LLM的激活空間包含與事實(shí)性相關(guān)的可解釋結(jié)構(gòu)。在這個(gè)想法的基礎(chǔ)上,引入了推理-時(shí)間干預(yù)(ITI)。該方法首先在與事實(shí)正確語句相關(guān)的激活空間中確定一個(gè)方向,然后在推理過程中沿著真值相關(guān)的方向調(diào)整激活。通過反復(fù)應(yīng)用這種干預(yù),LLM可以被引導(dǎo)到產(chǎn)生更真實(shí)的反應(yīng)。

后編輯解碼:與直接修改概率分布以防止初始解碼期間出現(xiàn)幻覺的方法不同,后編輯解碼尋求利用LLM的自校正能力來完善最初生成的內(nèi)容,而不依賴外部知識(shí)庫(kù)。一些方法使用驗(yàn)證鏈(COVE),該驗(yàn)證鏈的運(yùn)行假設(shè)是,在適當(dāng)?shù)奶崾鞠拢琇LM可以自糾正其錯(cuò)誤并提供更準(zhǔn)確的事實(shí)。它首先制定驗(yàn)證問題,然后系統(tǒng)地回答這些問題,以便最終產(chǎn)生改進(jìn)的修訂回答。

忠實(shí)度增強(qiáng)編碼

忠實(shí)度增強(qiáng)解碼優(yōu)先考慮與用戶指令或提供的上下文保持一致,并強(qiáng)調(diào)增強(qiáng)生成內(nèi)容的一致性。將現(xiàn)有工作總結(jié)為兩類,包括上下文一致性和邏輯一致性。

上下文一致:由于對(duì)上下文關(guān)注不足而產(chǎn)生的幻覺問題仍然存在。研究人員提出了上下文感知解碼(CAD),通過減少對(duì)先驗(yàn)知識(shí)的依賴來修改輸出分布,從而促進(jìn)模型對(duì)上下文信息的關(guān)注。然而,由于多樣性和歸因之間的內(nèi)在權(quán)衡,過度強(qiáng)調(diào)上下文信息會(huì)降低多樣性。因此引入了一種創(chuàng)新的采樣算法,以在保持多樣性的同時(shí)支持歸因。該方法包括兩個(gè)并行解碼,一個(gè)考慮源,另一個(gè)不考慮源,并根據(jù)token分布之間的KL散度動(dòng)態(tài)調(diào)整溫度以反映源屬性。還有方法探索了一個(gè)更通用的后期編輯框架,以減輕推理過程中的忠實(shí)度幻覺。該方法首先在句子和實(shí)體級(jí)別檢測(cè)幻覺,然后利用這種檢測(cè)反饋來完善生成的響應(yīng)。一些方法提出了知識(shí)約束解碼(KCD),采用token級(jí)幻覺檢測(cè)來識(shí)別幻覺,并通過對(duì)未來基于知識(shí)的更好估計(jì)重新權(quán)衡token分布來指導(dǎo)生成過程。

邏輯一致:為了增強(qiáng)思維鏈提示的內(nèi)在自一致性,可采用知識(shí)蒸餾框架。首先使用對(duì)比解碼生成一致的理由,然后用反事實(shí)推理的目標(biāo)對(duì)學(xué)生模型進(jìn)行微調(diào),這有效地消除了推理捷徑,這些捷徑在不考慮理由的情況下推導(dǎo)出答案。此外,通過采用對(duì)比解碼,可以減少表面級(jí)復(fù)制并防止遺漏推理步驟。

挑戰(zhàn)和開放問題

挑戰(zhàn)

雖然在緩解LLM幻覺方面取得了重大進(jìn)展,但仍存在值得注意的挑戰(zhàn)。本節(jié)主要介紹它們?cè)陂L(zhǎng)文本生成、檢索增強(qiáng)生成和大視覺-語言模型等領(lǐng)域的表現(xiàn)。

長(zhǎng)文本生成的幻覺

隨著生成內(nèi)容長(zhǎng)度的增加,幻覺的傾向也會(huì)增加,導(dǎo)致評(píng)估這種幻覺的成為挑戰(zhàn)。首先,現(xiàn)有的LLM幻覺基準(zhǔn)通常以事實(shí)問答的形式呈現(xiàn),更關(guān)注事實(shí)幻覺。在長(zhǎng)文本生成領(lǐng)域,明顯缺乏人工標(biāo)注的幻覺基準(zhǔn),這阻礙了研究人員在此背景下研究特定類型的幻覺。其次,評(píng)估長(zhǎng)文本生成中的幻覺具有挑戰(zhàn)性。雖然有一些可用的評(píng)估指標(biāo),但它們有局限性,當(dāng)事實(shí)更微妙、開放式和有爭(zhēng)議時(shí),或當(dāng)知識(shí)源中存在沖突時(shí),并不適用。

檢索增強(qiáng)生成的幻覺

檢索增強(qiáng)生成(RAG)已成為一種有希望減輕LLM中的幻覺的策略。隨著人們對(duì)LLM幻覺的擔(dān)憂加劇,RAG越來越受到關(guān)注,為一系列商業(yè)應(yīng)用鋪平了道路,如Perplexity2, YOU.com 3和New Bing 4。RAG通過從外部知識(shí)庫(kù)中檢索證據(jù),使LLM具備最新的知識(shí),并根據(jù)相關(guān)證據(jù)生成響應(yīng)。然而,RAG也有幻覺。一個(gè)值得注意的問題是RAG管道內(nèi)潛在的誤差累積。不相關(guān)的證據(jù)可能會(huì)傳播到生成階段,可能會(huì)污染輸出。另一個(gè)問題在于生成檢索領(lǐng)域,它偶爾會(huì)遭受引用不準(zhǔn)確的問題。雖然引用的目的是為驗(yàn)證目的提供一條可追蹤的信息來源的路徑,但這個(gè)領(lǐng)域的錯(cuò)誤可能會(huì)導(dǎo)致用戶誤入歧途。此外,現(xiàn)有的RAG可能會(huì)在多樣性和事實(shí)性之間進(jìn)行權(quán)衡,這就對(duì)多樣性的需求提出了新的挑戰(zhàn)。

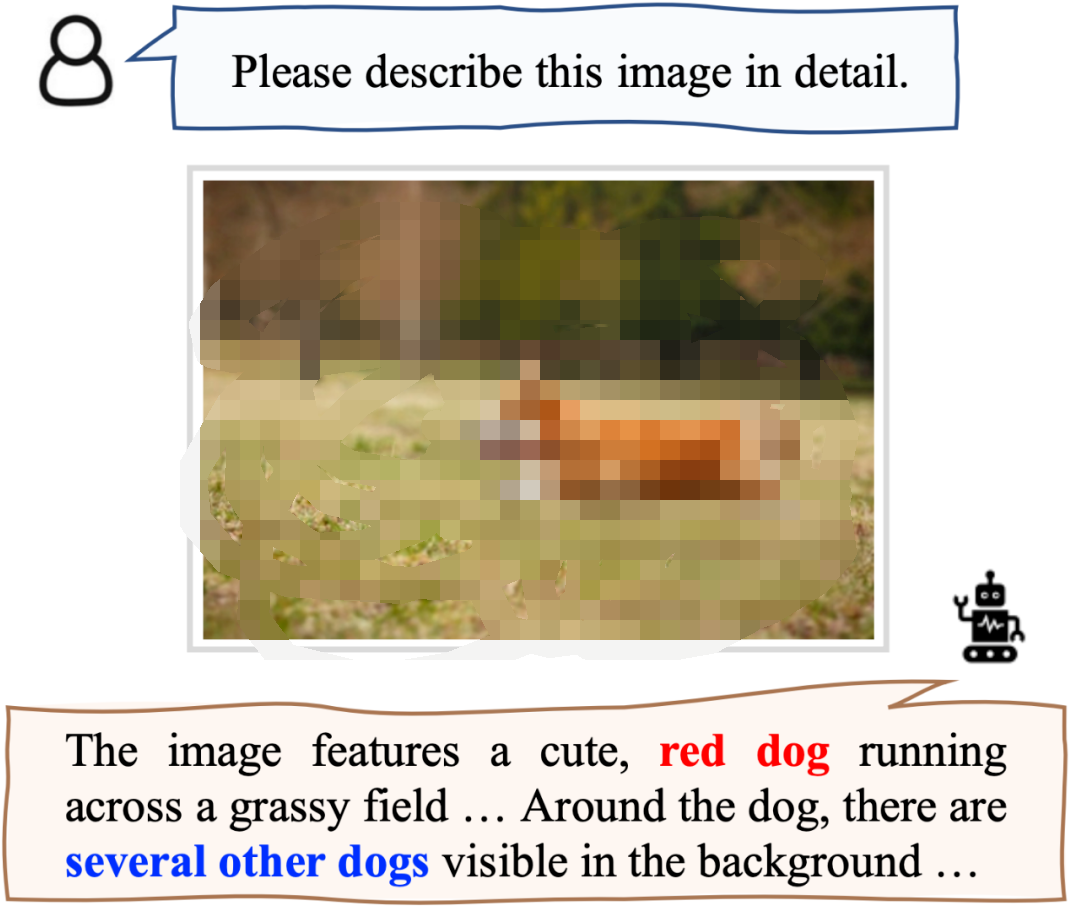

大視覺-語言模型的幻覺

由于具備了視覺感知能力,以及出色的語言理解和生成能力,大視覺-語言模型(LVLM)表現(xiàn)出了非凡的視覺-語言能力。與之前從大規(guī)模視覺語言預(yù)訓(xùn)練數(shù)據(jù)集獲得有限視覺語言能力的預(yù)訓(xùn)練多模態(tài)模型不同,LVLM利用先進(jìn)的大語言模型來更好地與人類和環(huán)境交互。因此,LVLM的多樣化應(yīng)用也為維護(hù)此類系統(tǒng)的可靠性帶來了新的挑戰(zhàn),需要進(jìn)一步研究和緩解。評(píng)估和實(shí)驗(yàn)表明,當(dāng)前的LVLM容易對(duì)相關(guān)圖像產(chǎn)生不一致的響應(yīng),包括不存在的對(duì)象、錯(cuò)誤的對(duì)象屬性、錯(cuò)誤的語義關(guān)系等。此外,由于過度依賴強(qiáng)語言先驗(yàn),LVLM很容易被愚弄,并經(jīng)歷嚴(yán)重的性能下降,以及其抵御不適當(dāng)用戶輸入的能力較差。人們正在努力建立一個(gè)更魯棒的大視覺-語言模型。當(dāng)呈現(xiàn)多個(gè)圖像時(shí),LVLM有時(shí)會(huì)混淆或遺漏部分視覺上下文,以及無法理解它們之間的時(shí)間或邏輯聯(lián)系,這可能會(huì)阻礙它們?cè)谠S多場(chǎng)景中的使用,正確識(shí)別此類障礙的原因并解決它們?nèi)匀恍枰掷m(xù)的努力。

LLM幻覺的開放問題

隨著LLM幻覺研究的進(jìn)展,其自我糾正機(jī)制在減少幻覺方面的有效性,其內(nèi)部對(duì)知識(shí)邊界的理解,以及他們的創(chuàng)造力和真實(shí)性之間的平衡等問題需要進(jìn)一步探討。

自校正機(jī)制能幫助減輕推理幻覺嗎?

雖然LLM在通過思維鏈提示處理復(fù)雜推理任務(wù)方面表現(xiàn)出了非凡的能力,但它們偶爾會(huì)表現(xiàn)出不忠實(shí)的推理,其特征是推理步驟或結(jié)論在邏輯上不遵循推理鏈研究表明,將外部反饋集成到LLM中。這種反饋通常通過檢索過程來自外部知識(shí)源,與其他LLM進(jìn)行互動(dòng)或來自外部評(píng)估指標(biāo)的指導(dǎo)。這探索了自校正機(jī)制的潛力,其中LLM使用其內(nèi)置能力校正其初始響應(yīng),而不依賴外部反饋。盡管自校正已顯示出實(shí)現(xiàn)忠實(shí)和準(zhǔn)確推理的能力,但某些研究對(duì)自矯正機(jī)制的有效性提出質(zhì)疑,指出LLM仍然難以自校正其推理鏈。因此,該機(jī)制的有效性仍然是一個(gè)開放問題,值得進(jìn)一步探索。

是否能準(zhǔn)確計(jì)算知識(shí)邊界?

盡管從廣泛的數(shù)據(jù)中捕獲事實(shí)知識(shí)的能力令人印象深刻,但LMM在識(shí)別自己的知識(shí)邊界方面仍然面臨挑戰(zhàn)。這種不足導(dǎo)致幻覺的發(fā)生,在這種情況下,LMM自信地制造謊言,而沒有意識(shí)到自己的知識(shí)限制。許多研究都深入探索了LMM的知識(shí)邊界,利用了一些策略,如評(píng)估多項(xiàng)選擇題中正確答案的概率,或通過評(píng)估具有不確定含義的句子集之間的相似性來量化模型的輸出不確定性。此外,還有工作揭示了LLM在其激活空間中包含與真實(shí)性信念相關(guān)的潛在結(jié)構(gòu)。最近的研究也發(fā)現(xiàn)了大量證據(jù),表明LLM有能力對(duì)問題的不可回答性進(jìn)行編碼,盡管這些模型在面對(duì)不可回答的問題時(shí)表現(xiàn)出過度自信并產(chǎn)生幻覺。因此,我們是否可以有效地探索LLM的內(nèi)部信念正在進(jìn)行中,需要進(jìn)一步的研究。

如何在創(chuàng)造性和真實(shí)性之間取得平衡?

在LLM發(fā)展過程中,平衡創(chuàng)造力和事實(shí)性的挑戰(zhàn)是一個(gè)重要的問題。確保真實(shí)性對(duì)于用于現(xiàn)實(shí)世界應(yīng)用的LLM至關(guān)重要;任何不準(zhǔn)確的信息都會(huì)誤導(dǎo)用戶,污染網(wǎng)絡(luò)環(huán)境。相反,幻覺有時(shí)可以提供有價(jià)值的視角,特別是在創(chuàng)造性的努力中,如講故事、頭腦風(fēng)暴和產(chǎn)生超越傳統(tǒng)思維的解決方案。雖然目前對(duì)LLM的研究嚴(yán)重傾向于減少幻覺,但往往忽視了其創(chuàng)造力的重要作用。其創(chuàng)造力和事實(shí)準(zhǔn)確性之間取得平衡的挑戰(zhàn)仍然沒有解決。探索多模態(tài)文本生成任務(wù)中的平衡也是有趣的,也適用于視覺生成任務(wù)。這個(gè)問題超越了單純的技術(shù)問題,需要對(duì)人工智能的本質(zhì)及其對(duì)人類互動(dòng)和知識(shí)交流的影響進(jìn)行更廣泛的思考。

總結(jié)

這篇綜述對(duì)大型語言模型中的幻覺進(jìn)行了深入研究,深入研究了其根本原因、檢測(cè)方法以及相關(guān)基準(zhǔn)和有效的緩解策略。盡管已經(jīng)取得了重大進(jìn)展,但大型語言模型中的幻覺問題仍然是一個(gè)令人信服和持續(xù)的問題,需要繼續(xù)進(jìn)行研究。

原文標(biāo)題:LLM的幻覺問題最新綜述

文章出處:【微信公眾號(hào):深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

-

人工智能

+關(guān)注

關(guān)注

1804文章

48701瀏覽量

246445 -

渦輪增壓

+關(guān)注

關(guān)注

1文章

79瀏覽量

5474 -

ChatGPT

+關(guān)注

關(guān)注

29文章

1587瀏覽量

8796 -

LLM

+關(guān)注

關(guān)注

1文章

319瀏覽量

680

原文標(biāo)題:LLM的幻覺問題最新綜述

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

對(duì)比解碼在LLM上的應(yīng)用

TaD+RAG-緩解大模型“幻覺”的組合新療法

基于Transformer的大型語言模型(LLM)的內(nèi)部機(jī)制

最新綜述!當(dāng)大型語言模型(LLM)遇上知識(shí)圖譜:兩大技術(shù)優(yōu)勢(shì)互補(bǔ)

最新研究綜述——探索基礎(chǔ)模型中的“幻覺”現(xiàn)象

幻覺降低30%!首個(gè)多模態(tài)大模型幻覺修正工作Woodpecker

LLM推理加速新范式!推測(cè)解碼(Speculative Decoding)最新綜述

利用知識(shí)圖譜與Llama-Index技術(shù)構(gòu)建大模型驅(qū)動(dòng)的RAG系統(tǒng)(下)

自然語言處理應(yīng)用LLM推理優(yōu)化綜述

LLM的幻覺問題最新綜述

LLM的幻覺問題最新綜述

評(píng)論