主要內(nèi)容:

提出了一種新的基于學(xué)習(xí)的用于車輛上的視覺定位算法,該算法可以在城市規(guī)模的環(huán)境中實(shí)時(shí)運(yùn)行。

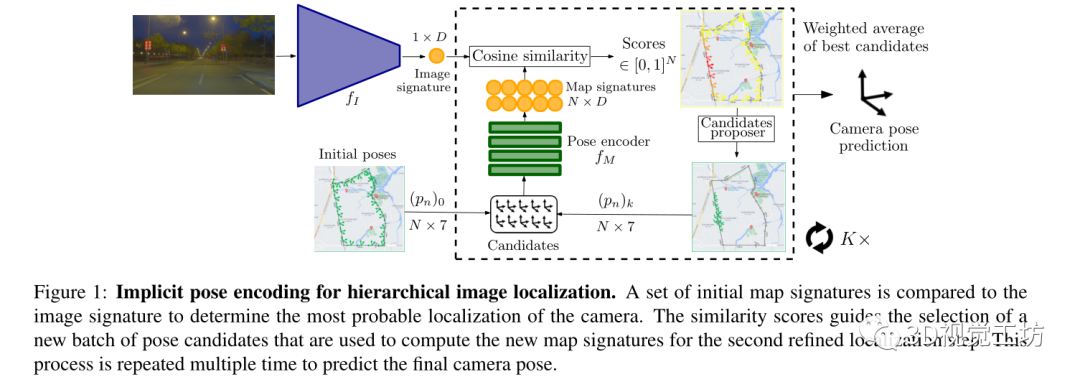

算法設(shè)計(jì)了隱式姿態(tài)編碼,通過2個(gè)獨(dú)立的神經(jīng)網(wǎng)絡(luò)將圖像和相機(jī)姿態(tài)嵌入到一個(gè)共同的潛在表示中來計(jì)算每個(gè)圖像-姿態(tài)對的相似性得分。通過以分層的方式在潛在空間來評估候選者,相機(jī)位置和方向不是直接回歸的,而是逐漸細(xì)化的。算法占的存儲量非常緊湊且與參考數(shù)據(jù)庫大小無關(guān)。

Pipeline:

輸入為查詢圖像

輸出為查詢圖像的六自由度姿態(tài)(t,q)∈SE(3),t是平移向量,q是旋轉(zhuǎn)四元數(shù)。

訓(xùn)練是在帶有相機(jī)姿態(tài)label的數(shù)據(jù)庫圖像上進(jìn)行訓(xùn)練,沒有用額外的場景3D模型。

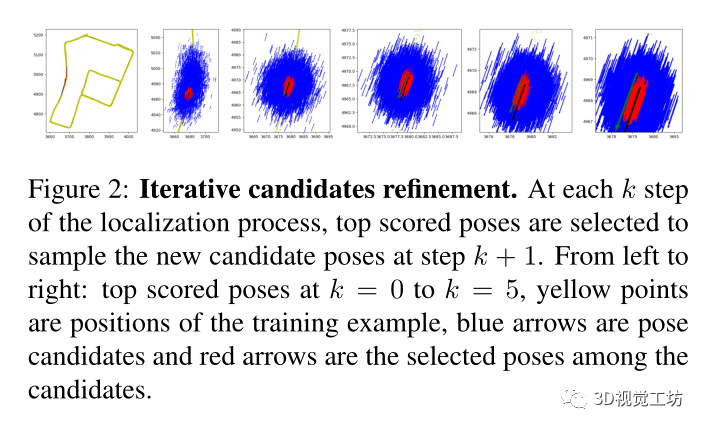

先通過圖像編碼器計(jì)算表示圖像向量。然后通過評估分布在地圖上的初始姿態(tài)候選來搜索相機(jī)姿態(tài)。姿態(tài)編碼器對相機(jī)姿態(tài)進(jìn)行處理以產(chǎn)生可以與圖像向量相匹配的潛在表示,每個(gè)候選姿態(tài)都會有一個(gè)基于到相機(jī)姿態(tài)的距離的分?jǐn)?shù)。高分提供了用于選擇新候選者的粗略定位先驗(yàn)。通過多次重復(fù)這個(gè)過程使候選池收斂到實(shí)際的相機(jī)姿態(tài)。

論文技術(shù)點(diǎn):

圖像編碼器:

使用圖像編碼器從輸入的查詢圖像計(jì)算圖像特征向量。

編碼器架構(gòu)包括一個(gè)預(yù)訓(xùn)練的CNN backbone,然后是全局平均池以及一個(gè)具有d個(gè)輸出神經(jīng)元的全連接層。

特征向量比圖像檢索中常用的全局圖像描述符小一個(gè)數(shù)量級(使用d=256)以便在隨后的步驟中將其與一大組姿態(tài)候選進(jìn)行有效比較。

初始姿態(tài)候選:

起點(diǎn)是一組N個(gè)相機(jī)姿態(tài),這是從參考姿態(tài)(=訓(xùn)練時(shí)相機(jī)姿態(tài))中采樣。通過這種初始選擇為定位過程引入了先驗(yàn),類似于選擇錨點(diǎn)姿態(tài)。

姿態(tài)編碼器:

姿態(tài)候選通過一個(gè)神經(jīng)網(wǎng)絡(luò)處理,輸出潛在向量,這種隱式表示學(xué)習(xí)到了給定場景中的相機(jī)視點(diǎn)與圖像編碼器提供的特征向量之間的對應(yīng)關(guān)系。

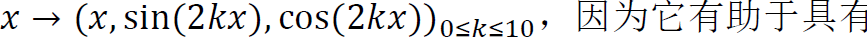

首先使用傅立葉特征將相機(jī)姿態(tài)的每個(gè)分量(tx,ty,tz,qx,qy,qz,qw)投影到更高維度:

,因?yàn)樗兄诰哂械途S輸入的網(wǎng)絡(luò)擬合高頻函數(shù)。然后使用具有4層256個(gè)神經(jīng)元和隱藏層為ReLU激活的MLP。每一組候選姿態(tài)都是在一次batch的前向傳遞中計(jì)算出來的。

,因?yàn)樗兄诰哂械途S輸入的網(wǎng)絡(luò)擬合高頻函數(shù)。然后使用具有4層256個(gè)神經(jīng)元和隱藏層為ReLU激活的MLP。每一組候選姿態(tài)都是在一次batch的前向傳遞中計(jì)算出來的。

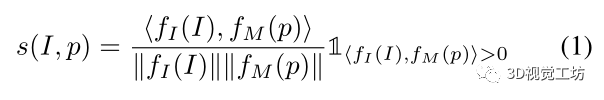

相似性分?jǐn)?shù):

為每個(gè)圖像-姿態(tài)對計(jì)算余弦相似性來獲得相似性得分s。

在點(diǎn)積之后添加一個(gè)ReLU層,使得s∈[0,1]。

直觀地說,其目標(biāo)是學(xué)習(xí)與實(shí)際相機(jī)姿態(tài)接近的候選姿態(tài)的高分。

有了這個(gè)公式后可以評估關(guān)于相機(jī)姿態(tài)的假設(shè),并搜索得分高的姿態(tài)候選者。

相似性分?jǐn)?shù)定義為:

建議新的候選姿態(tài):

基于在上一次迭代中使用的姿態(tài)候選獲得的分?jǐn)?shù),為這一次迭代選擇新的姿態(tài)候選。

首先選擇得分最高的B=100的姿態(tài)

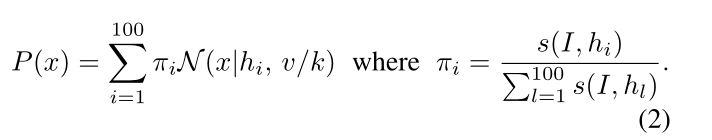

然后從(hi)中以高斯混合模型的方式對新的候選者進(jìn)行采樣:

迭代姿態(tài)優(yōu)化:

在每次迭代之后,將噪聲向量除以2,使得新的候選者被采樣為更接近先前的高分。

因此可以在千米級地圖中收斂到精確的姿態(tài)估計(jì),同時(shí)只評估有限的稀疏姿態(tài)集。在每個(gè)時(shí)間步長獨(dú)立評估每個(gè)相機(jī)幀,但可以使用以前時(shí)間步長的定位先驗(yàn)來減少車輛導(dǎo)航場景中的迭代次數(shù)。

每次迭代時(shí)所選姿態(tài)的示例如圖2所示。通過對初始姿態(tài)的N個(gè)候選進(jìn)行采樣,保留了一個(gè)恒定的記憶峰值。

姿態(tài)平均:

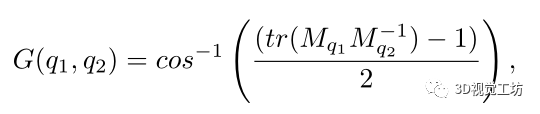

最終的相機(jī)姿態(tài)估計(jì)是256個(gè)得分較高的候選姿態(tài)的加權(quán)平均值,與直接選擇得分最高的姿態(tài)相比,它具有更好的效果。使用分?jǐn)?shù)作為加權(quán)系數(shù),并實(shí)現(xiàn)3D旋轉(zhuǎn)平均。

損失函數(shù):

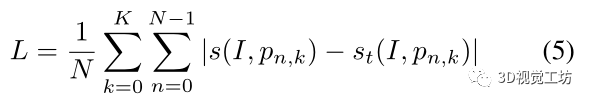

通過計(jì)算參考圖像和以K種不同分辨率采樣的姿態(tài)候選者之間的分?jǐn)?shù)來訓(xùn)練網(wǎng)絡(luò),

其中,st是基于相機(jī)姿態(tài)和候選姿態(tài)之間的平移和旋轉(zhuǎn)距離來定義。

實(shí)驗(yàn):

與最近的方法在幾個(gè)數(shù)據(jù)集上進(jìn)行了比較,這些數(shù)據(jù)集涵蓋了大規(guī)模室外環(huán)境中的各種自動駕駛場景。

由于戶外環(huán)境的動態(tài)部分(移動物體、照明、遮擋等),這項(xiàng)任務(wù)極具挑戰(zhàn)性。

驗(yàn)證了其算法能夠在9個(gè)不同的大型室外場景中進(jìn)行精確定位。

然后展示了算法可以擴(kuò)展到多地圖場景

Baseline:

將ImPosing與基于學(xué)習(xí)的方法進(jìn)行比較。使用CoordiNet報(bào)告了牛津數(shù)據(jù)集上絕對姿態(tài)回歸結(jié)果作為基線。

將ImPosing與檢索進(jìn)行比較,使用了NetVLAD和GeM,使用全尺寸圖像來計(jì)算全局圖像描述符,然后使用余弦相似度進(jìn)行特征比較,然后對前20個(gè)數(shù)據(jù)庫圖像的姿態(tài)進(jìn)行姿態(tài)平均。

沒有使用基于結(jié)構(gòu)的方法進(jìn)行實(shí)驗(yàn),因?yàn)槭褂?D模型進(jìn)行幾何推理,這些方法比更準(zhǔn)確,但由于存儲限制使得嵌入式部署變得困難。

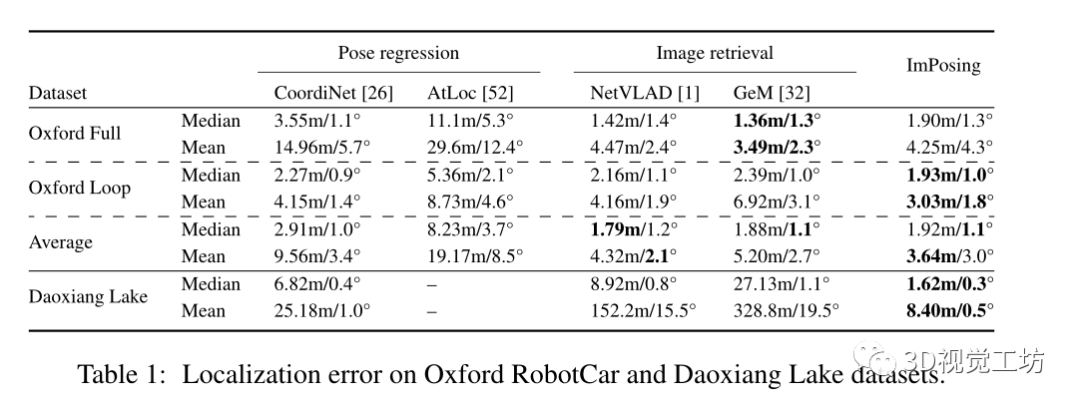

在Oxford RobotCar和Daoxiang Lake數(shù)據(jù)集上的定位誤差比較

Daoxiang Lake是一個(gè)比Oxford RobotCar更具挑戰(zhàn)性的數(shù)據(jù)集,因?yàn)樗闹貜?fù)區(qū)域幾乎沒有判別特征,環(huán)境也多種多樣(城市、城郊、高速公路、自然等)。因此,圖像檢索的性能比姿態(tài)回歸差。ImPosing要準(zhǔn)確得多,并且顯示出比競爭對手小4倍的中值誤差。

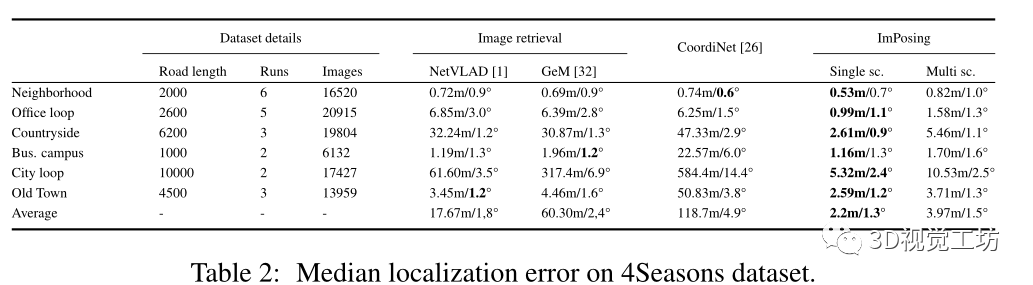

在4Seasons數(shù)據(jù)集上的比較:

4Seasons數(shù)據(jù)集包含慕尼黑地區(qū)在不同季節(jié)條件下的各種場景(城市、居民區(qū)、鄉(xiāng)村)中記錄的數(shù)據(jù)。

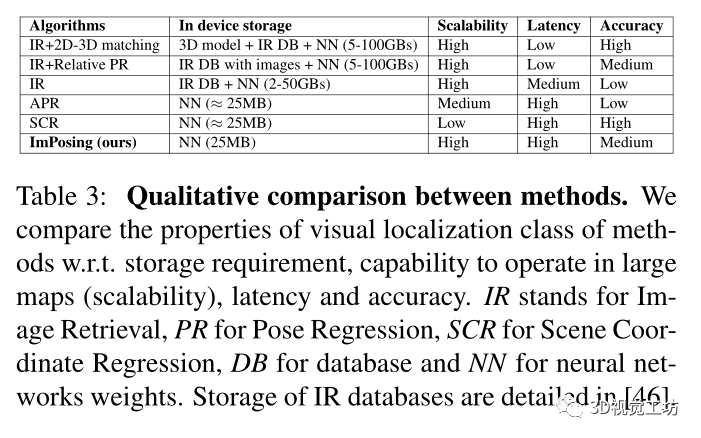

因?yàn)槭轻槍囕v部署的視覺定位算法,比較了各種算法的性能效率:

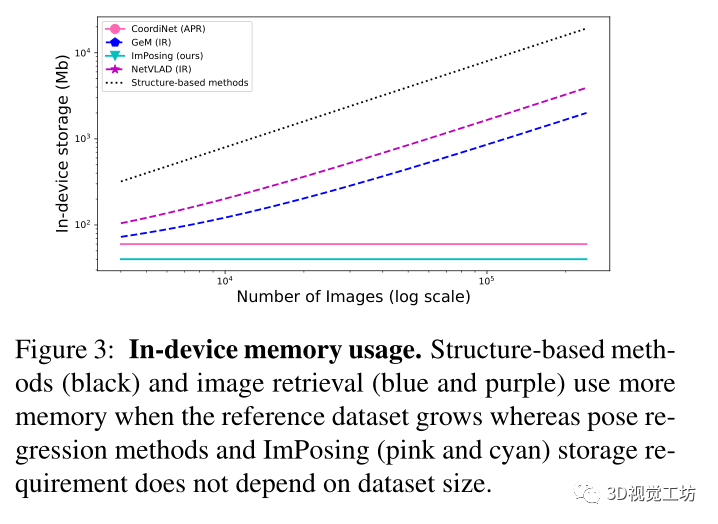

論文的算法只需要在設(shè)備中存儲神經(jīng)網(wǎng)絡(luò)權(quán)重和初始姿態(tài)候選,其中圖像編碼器為23MB,姿態(tài)編碼器小于1MB,初始姿態(tài)候選為1MB。

在圖3中報(bào)告了不同類別視覺定位方法的內(nèi)存占用相對于參考數(shù)據(jù)庫大小的縮放規(guī)律。這是有大量數(shù)據(jù)可用的自動駕駛場景中的一個(gè)重要方面。對于給定的地圖,基于學(xué)習(xí)的方法具有恒定的內(nèi)存需求,因?yàn)榈貓D信息嵌入在網(wǎng)絡(luò)權(quán)重中。

總結(jié):

提出了一種新的視覺定位范式,通過使用地圖的隱式表示,將相機(jī)姿態(tài)和圖像特征連接在一個(gè)非常適合定位的潛在高維流形中。

證明了通過一個(gè)簡單的姿態(tài)候選采樣過程,能夠估計(jì)圖像的絕對姿態(tài)。

通過提供一種高效準(zhǔn)確的基于圖像的定位算法,該算法可以實(shí)時(shí)大規(guī)模操作,使其可以直接應(yīng)用于自動駕駛系統(tǒng)。

但是方法的準(zhǔn)確性在很大程度上取決于可用的訓(xùn)練數(shù)據(jù)的數(shù)量。而且與回歸的方法類似,其不會泛化到遠(yuǎn)離訓(xùn)練示例的相機(jī)位置。

提出的方法可以在許多方面進(jìn)行改進(jìn),包括探索更好的姿態(tài)編碼器架構(gòu);找到一種隱式表示3D模型的方法,將隱式地圖表示擴(kuò)展到局部特征,而不是全局圖像特征。

審核編輯 :李倩

-

編碼器

+關(guān)注

關(guān)注

45文章

3775瀏覽量

137139 -

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4807瀏覽量

102770 -

算法

+關(guān)注

關(guān)注

23文章

4698瀏覽量

94734

原文標(biāo)題:WACV 2023 | ImPosing:用于視覺定位的隱式姿態(tài)編碼

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

動態(tài)環(huán)境中基于神經(jīng)隱式表示的RGB-D SLAM

【芯靈思A83T試用申請】嵌入式視覺--遠(yuǎn)距離物體跟蹤與定位

嵌入式姿態(tài)測量系統(tǒng)的姿態(tài)參數(shù)怎么計(jì)算?

基于三元Golay隱寫碼的快速隱寫算法

TPMS外置編碼存儲器式輪胎定位技術(shù)設(shè)計(jì)方案

面向AAV壓縮域的通用隱寫分析方法

網(wǎng)絡(luò)編碼姿態(tài)監(jiān)控體域網(wǎng)的容錯(cuò)性

醫(yī)療器械視覺定位應(yīng)用

關(guān)于3D視覺定位技術(shù)詳細(xì)解析

STM32操作增量式編碼器(二)----使用編碼器接口實(shí)現(xiàn)定位

機(jī)器視覺檢測與機(jī)器視覺定位的區(qū)別與應(yīng)用

一種基于RGB-D圖像序列的協(xié)同隱式神經(jīng)同步定位與建圖(SLAM)系統(tǒng)

一種將NeRFs應(yīng)用于視覺定位任務(wù)的新方法

ImPosing:用于視覺定位的隱式姿態(tài)編碼

ImPosing:用于視覺定位的隱式姿態(tài)編碼

評論