對于自動駕駛ADS行業(yè)而言,其核心演進趨勢可以定義為群體智能的社會計算,簡單表述為,用NPU大算力和去中心化計算來虛擬化駕駛環(huán)境,通過數(shù)字化智能體即自動駕駛車輛AV的多模感知交互決策,以及車車協(xié)同,車路協(xié)同,車云協(xié)同,通過跨模數(shù)據(jù)融合、高清地圖重建、云端遠程智駕等可信計算來構建元宇宙中ADS的社會計算能力。

ADS算法的典型系統(tǒng)分層架構一般包括傳感層,感知層,定位層,決策層(預測+規(guī)劃)和控制層。每個層面會采用傳統(tǒng)算法模型或者是與深度學習DNN模型相結合,從而在ADS全程駕駛中提供人類可以認可的高可靠和高安全性,以及在這個基礎上提供最佳能耗比、最佳用車體驗、和用戶社交娛樂等基本功能。

01基于DNN模型的感知算法

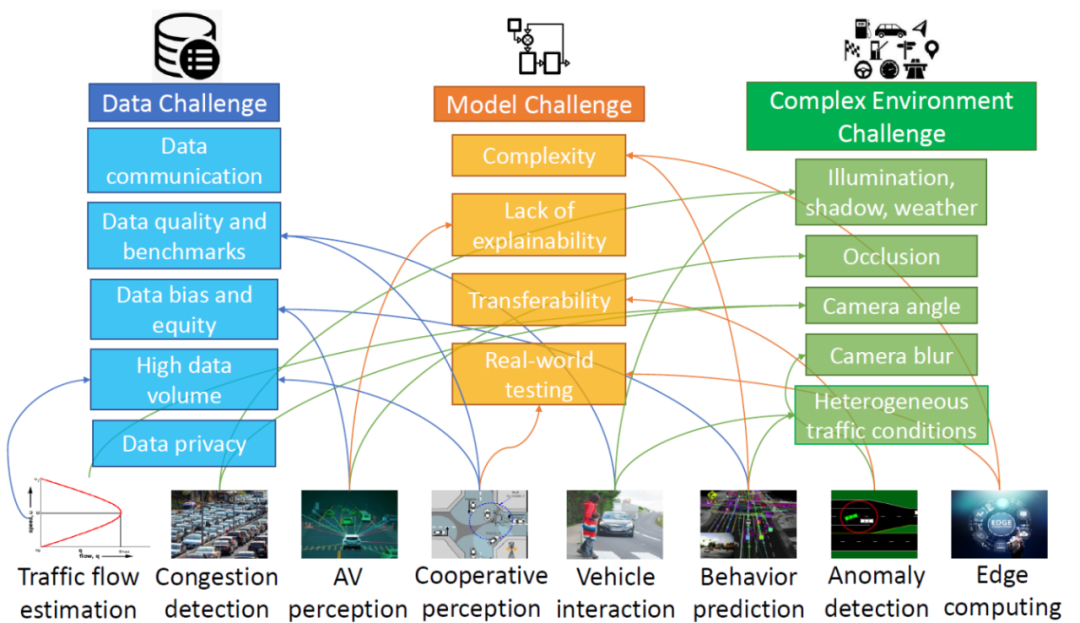

ADS部署的傳感器在極端惡劣場景(雨雪霧、低照度、高度遮擋、傳感器部分失效、主動或被動場景攻擊等)的影響程度是不一樣的。所以傳感器組合應用可以來解決單傳感器的感知能力不足問題,常用的多模傳感器包括Camera(Front-View or Multiview orSurround-View; Mono or Stereo;LD or HD),毫米波Radar(3Dor4D)和激光雷達LIDAR(LDorHD)。ADS的一個主要挑戰(zhàn)是多模融合感知,即如何在感知層能夠有效融合這些多模態(tài)傳感器的輸出,配合高清HD地圖或其它方式定位信息,對應用場景中的交通標識,動態(tài)目標屬性(位置、速度、方向、高度、行為),紅綠燈狀態(tài),車道線,可駕駛區(qū)域,進行特征提取共享和多任務的2D/3D目標檢測、語義分割、在線地圖構建、Occupancy特征和語義提取(Volume/Flow/Surface)等等。基于DNN模型的感知算法,在實際工程部署中的一個挑戰(zhàn),還需要解決圖 1所示的三個方向關鍵難題:數(shù)據(jù)挑戰(zhàn)、模型挑戰(zhàn)、和復雜場景挑戰(zhàn)。

?

?

圖 1DL算法在智能交通ITS和自動駕駛領域ADS的部署挑戰(zhàn)(Azfar 2022) 目前大多數(shù)AI視覺感知任務,包括目標檢測跟蹤分類識別,場景語義分割和目標結構化,其算法流程都可以簡單總結為特征抽取,特征增強和特征融合,然后在特征空間進行(采樣)重建,最后進行多任務的各類檢測識別與語義理解。以目標檢測任務為例,一個主要的發(fā)展趨勢,是從CNN (Compute-bound)向 Transformer (memory-bound)演進。CNN目標檢測方法包括常用的Two-Stage Candidate-based常規(guī)檢測方法(Faster-RCNN)和One-Stage Regression-based 快速檢測方法(YOLO, SSD, RetinaNet, CentreNet)。

Transformer目標檢測方法包括DETR, Vision Transformer, Swin Transformer, DTR3D, BEVFormer, BEVFusion等等。兩者之間的主要差別是目標感知場的尺寸,前者是局部視野,側重目標紋理,后者是全局視野,從全局特征中進行學習,側重目標形狀。可以看出針對各類模型包括混合模型和通過NAS架構搜索生成的模型,學術界和工業(yè)界在持續(xù)推陳出新,高速迭代,依舊呈現(xiàn)出多元多樣化態(tài)勢,但如何有效進行模型選型,以及模型小型化和工程化加速,一直是ADS產(chǎn)業(yè)算法能否成功落地的核心難題。

02基于DNN模型的決策算法

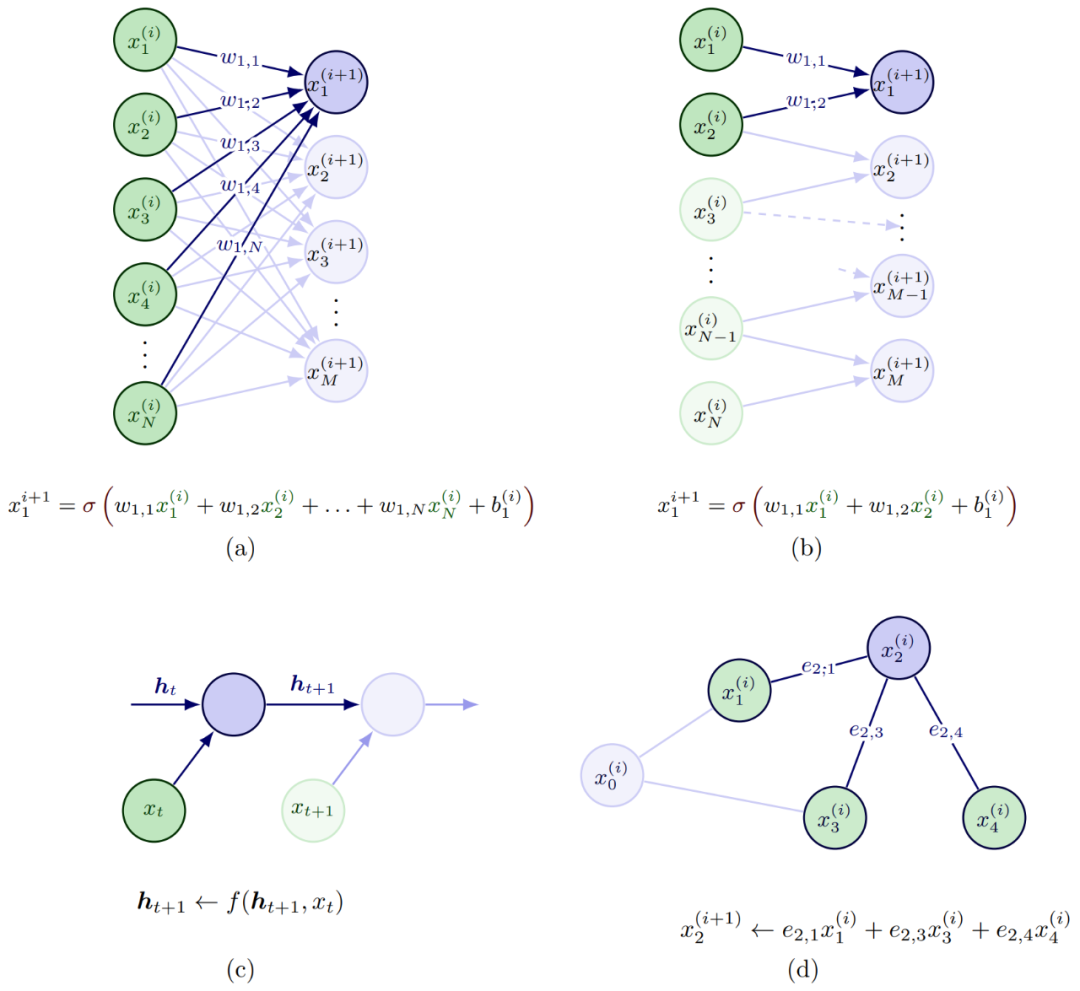

基于DNN模型的決策算法,是一種在數(shù)據(jù)充分的條件下,通過少量的人力投入就可以提供非常有力的設計表達。尤其是針對社交關系建模與推理來解決ADS中預測與規(guī)劃問題,通過監(jiān)督和自監(jiān)督學習的方式,單獨或者聯(lián)合建模的方式,以及模仿學習IL和強化學習RL的學習流程。交互建模的輸入來自車輛狀態(tài),包括定位信息,速度,加速度,角速度,車輛朝向等。端到端的DL-based方法通常直接通過卷積處理原始傳感數(shù)據(jù)(RGB圖像和點云),計算簡潔但會損失弱的或者隱含的交互推理的內容表達。如圖 2所示,深度學習模型中的不同構建模塊,是可以對多智能體的交互推理進行有效建模和表達的,其中

(a)全連接FC層:又稱多層感知器MLP,其中所有輸入通過連接可以與輸出交互并對輸出做出貢獻。 (b)卷積CONV層:卷積層采用局部感知場,所以每層的連接會比較稀疏,通常假定合適用來捕獲空間關系,最初的底層卷積層一般提取類似邊緣紋理類的信息,越接近頂層也偏語義特征。 (c)遞歸Recurrent層 :通常用來處理時間維度的數(shù)據(jù)序列,多用來捕獲時間關系。 (d)圖Graph層:典型的圖包括節(jié)點、邊(用來描述節(jié)點間關系)、和上下文全局屬性,通常用來捕獲圖結構表征中顯性關系推理,與FC層和RNN層一個不同之處是輸入的先后次序不會影響結構,圖結構還可以處理不同數(shù)目的個體,比較適合多個體的ADS環(huán)境。 ?

?

圖 2DNN模塊對多智能體交互的建模案例(Wang 2022) 對于ADS中社交特征表征,常用的有空間時間狀態(tài)特征矢量,空間占用方格和圖區(qū)域動態(tài)插入等方式。空時狀態(tài)特征矢量比較難以定義,尤其是個體數(shù)量變化和有效時間步長的不同,另外一個限制是依賴于個體插入的次序。所以一個常用的設計思路是采用占用方格地圖Occupancy Grid Map (OGM)來解決上述的兩個問題。OGM是以本體ego agent為中心來構建空間方格圖,可以處理ROI區(qū)域不同數(shù)目的智能體。OGM通常采用原始狀態(tài)(定位,速度,加速度)或者采用FC層來進行狀態(tài)編碼,如果FC層隱層包括個體的歷史軌跡信息,可以同時捕獲空間時間信息。

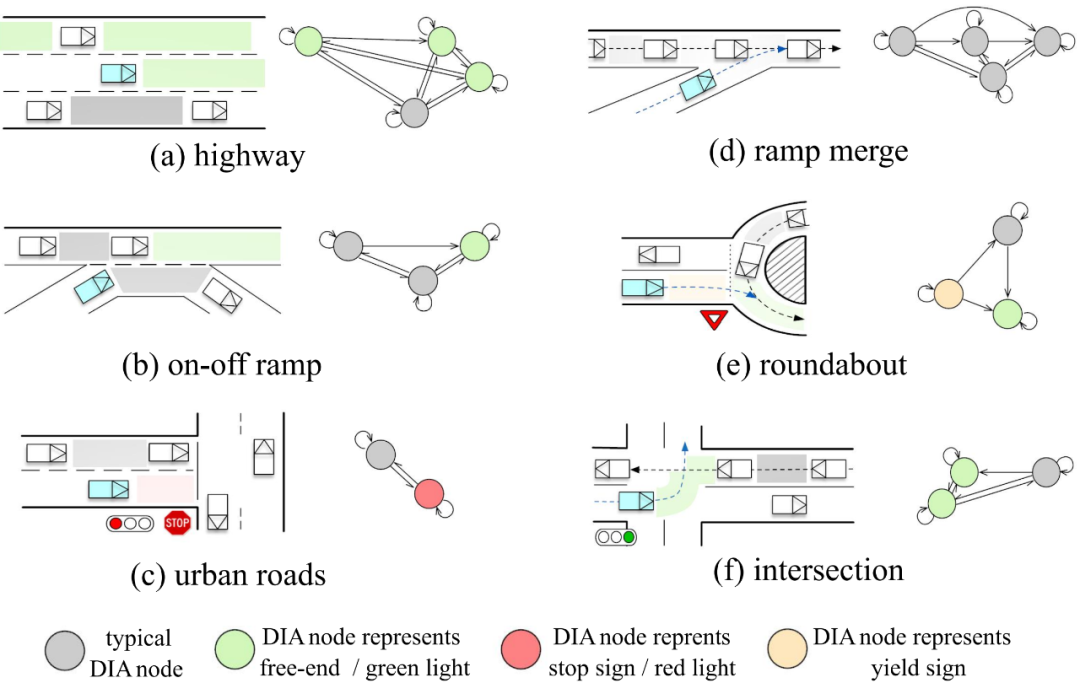

OGM的分辨率對計算性能影響比較大。 相對而言,圖網(wǎng)絡GNN可以通過動態(tài)插入?yún)^(qū)域DIA抽取來更好地構建空間時間交互圖關系,圖的類型可以基于個體(車輛,行人,機動車等),也可以基于區(qū)域area,后者主要聚焦對車輛意圖(車道保持,換道并道,左拐右拐)的表征,這里DIA指的是可駕駛場景中空閑空隔。如圖 3所示,DIA的優(yōu)勢在于對環(huán)境中靜態(tài)元素(道路拓撲,類似stop道路標志牌等)和動態(tài)元素(行駛車輛)非常靈活,可以認為是動態(tài)環(huán)境的統(tǒng)一表征或者也可以叫做環(huán)境的虛擬化。所有時間地平線的DIAs可以用來構建空間時間語義圖。 ?

?

圖 3動態(tài)插入?yún)^(qū)域抽取和場景語義圖構建案例(Wang 2022) 如圖 2所示,群體智能的社會計算,其中的社交關系,可以采用不同的深度學習層來進行交互建模和編碼:

FC層交互編碼:采用將不同個體的特征進行拉平,拼接成一個向量。多用來對單體single agent進行運動和意圖建模,很少用于multiple agent。

CONV層交互編碼:將空間時間特征(狀態(tài)特征張量)或占用方格地圖做為CNN輸入來進行交互編碼。

Recurrent層交互編碼:多采用LSTM來進行時間維度推理,編碼產(chǎn)生的embedding張量可以捕獲時間空間的交互信息。

Graph層交互編碼:對多智能體之間的關系采用節(jié)點之間的無向或者有向邊來表征,可以用消息傳遞機制來進行交互學習,每個節(jié)點通過聚集鄰近節(jié)點的特征來更新自身的屬性特征。

在實際設計中,多將Recurrent層和Graph層相結合,可以很好地處理時間信息。而注意力attention機制編碼可以更好地量化一個特征如何影響其它特征。人類司機會在交互場景中有選擇地選取其它個體來進行關注,包括其過去現(xiàn)在的信息和未來的預判。所以注意力機制編碼可以基于時間域(短期的和長期的)和空間域(本地的和偏遠的),在上述方法中通過加權方案分別進行應用。對個體的注意力建模,可以采用基于距離的方法,這意味著其它個體越近,關注度也越高。 綜上所述,DL-based方法由于模塊化的設計和海量數(shù)據(jù)貢獻,性能占優(yōu),但如何能夠提供模型的安全能力和大規(guī)模部署,需要解決幾個挑戰(zhàn):在保證性能基礎上改善可解釋性;在不同的駕駛個體,場景和態(tài)勢下繼續(xù)增強模型的推廣能力;模型選型和工程實現(xiàn)如何有效加速落地問題。

03CNN與Transformer選型對比探討

Transformer或Transformer + CNN + RNN混合模型選型呈現(xiàn)出了高效的算法性能,對應在工程實現(xiàn)上也開始主導整個ADS行業(yè)市場。Transformer采用Attention機制的主干網(wǎng)絡,而CNN在特征提取和變換上由Convolution來主導,深度理解兩種模型的主要收益到底來自什么樣的算法模塊或者算子,對ADS主流算法的未來演進,可能會有一種積極的推動作用。

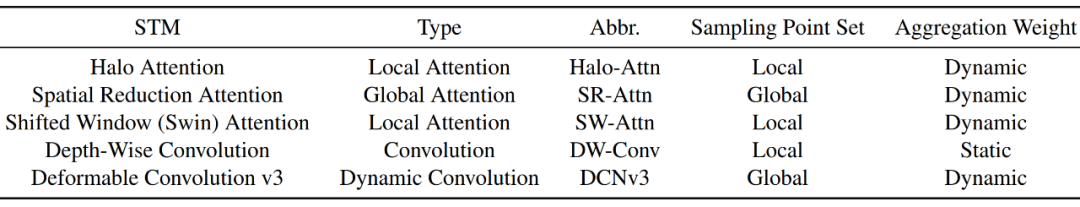

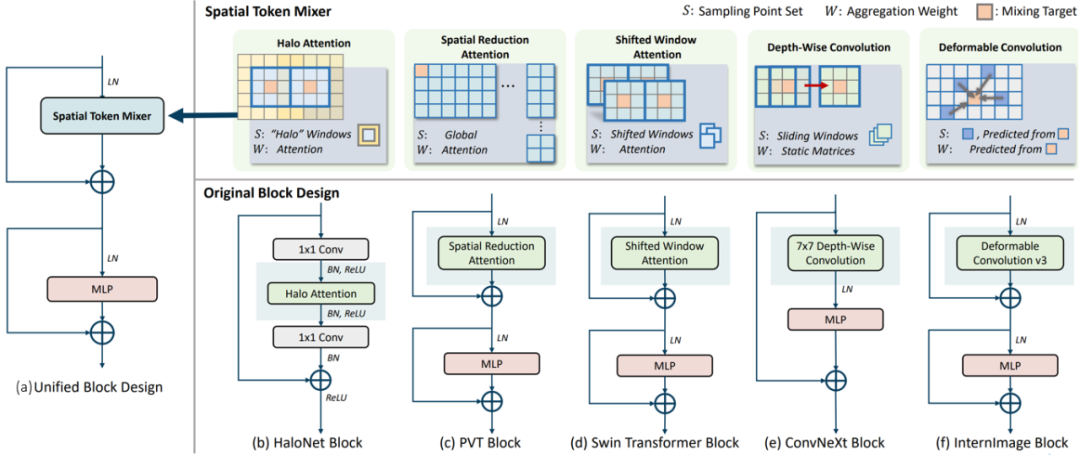

一種看法(Dai 2022)認為,這主要的差別來自特征變換模塊(Attention vs Convolution)對空間特征聚類的處理方式,即所謂的Spatial Token Mixer(STM)問題。當前常用構建DNN網(wǎng)絡模型包括Attention, Convolution, Hybrid等模塊的多種變形,以分類算法為例,先后有HaloNet(Halo Attention), PVT(Spatial Reduction Attention, 2021), Swin Transformer(Shifted Window Attention, 2021), ConvNeXt(7x7 Depth-Wise Convolution, 2022), InternImage (Deformable Convolution v3, 2022)等SOTA模型出世。 ?

?  ?

?

圖 4特征變換模塊的實現(xiàn)案例(Dai 2022) 如圖 4所示,CNN和Transformer模型中最常用的四種STM算子類型包括:Local Attention, Global Attention, Depth-Wise Convolution, Dynamic Convolution。采用固定感知場的Static Convolution只在小容量模型(~5MB參數(shù))中表現(xiàn)不錯,而Local-Attention STM模型結合跨窗間信息轉移策略可以顯著提升性能。

STM的設計也反映了假定空間即歸納偏置中采用的先驗知識和約束條件對模型學習的影響,包括局部特性Locality、平移不變性,旋轉不變性和尺寸不變性等模型特性,這可以從有效感知場ERF與下游多任務學習的關聯(lián)關系來體現(xiàn),有趣的是,當上調模型參數(shù)時,擴大ERF反而會導致模型飽和,同樣我們工程實現(xiàn)中也觀察到,對特征提取backbone而言用CNN來替代Transformer Encoder進行推理加速,也有類似模型飽和問題和上下游任務匹配不齊的問題。

至于對于各類目標不變性的性能對比,性能高的模型,對不同場景變化的魯棒性會好一些,Static Convolution采用權值共享和局部感知場有利于提升平移不變性,而靈活的采樣策略可以動態(tài)地進行特征聚類,在動態(tài)卷積(例如DCNv3)中表現(xiàn)出更好的旋轉和尺寸縮放不變性。 Convolution-based STM模型多采用如下架構:Residual Learning, Dense Connection, Grouping, Spatial Attention,Channel Attention。其中Spatial Attention采用Deformable Convolution和Non-Local算子采用靈活可變的點采樣來構建長范圍的依賴語義依賴關系。

Vision Transformer的出世也給這類設計帶來了新的架構設計和探索思路。 對于Attention-based STM模型,比較而言,Transformer采用的全局感知場和動態(tài)的空間聚類,也帶來了海量的計算復雜度,尤其是ADS 應用中需要場景覆蓋的計算區(qū)域越來越大時,這對ADS NPU的加速設計引入了一個全新課題。

從算法角度而言,圖 4所示的幾個算法,也采用了類似CNN的Local Attention機制,例如采用非重疊的局部計算窗和金字塔結構,以及跨窗間信息遷移的機制,例如Haloing,Shifted Windows等等,當前還有一種新的設計思路采用CNN和Transformer算子塊的交織實現(xiàn)方式,也可以稱作為聯(lián)合或者混合架構,可以很好的融合CNN和Transformer的各自優(yōu)勢,適當降低總體計算復雜度。而NAS網(wǎng)絡架構檢索可以采用更加靈活的算子組合的策略,當然這顯然增加了硬件計算架構和數(shù)據(jù)流優(yōu)化的設計難度。

審核編輯:劉清

-

RGB

+關注

關注

4文章

807瀏覽量

59919 -

ADS仿真

+關注

關注

1文章

71瀏覽量

10855 -

dnn

+關注

關注

0文章

61瀏覽量

9276 -

MLP

+關注

關注

0文章

57瀏覽量

4606

原文標題:ADS深度學習算法選型探討

文章出處:【微信號:算力基建,微信公眾號:算力基建】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

在OpenVINO?工具套件的深度學習工作臺中無法導出INT8模型怎么解決?

機器學習模型市場前景如何

【「基于大模型的RAG應用開發(fā)與優(yōu)化」閱讀體驗】+大模型微調技術解讀

NPU與機器學習算法的關系

NPU在深度學習中的應用

深度學習模型的魯棒性優(yōu)化

FPGA加速深度學習模型的案例

AI大模型與深度學習的關系

FPGA做深度學習能走多遠?

深度識別算法包括哪些內容

基于大數(shù)據(jù)與深度學習的穿戴式運動心率算法

基于DNN模型的ADS深度學習算法選型探討

基于DNN模型的ADS深度學習算法選型探討

評論