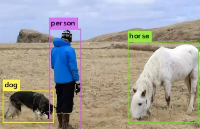

過(guò)去幾年里,3D 傳感器(如激光雷達(dá)、深度傳感攝像頭和雷達(dá))越發(fā)普及,對(duì)于能夠處理這些設(shè)備所捕獲數(shù)據(jù)的場(chǎng)景理解技術(shù),相應(yīng)需求也在不斷增加。此類(lèi)技術(shù)可以讓使用這些傳感器的機(jī)器學(xué)習(xí) (ML) 系統(tǒng),如無(wú)人駕駛汽車(chē)和機(jī)器人,在現(xiàn)實(shí)世界中導(dǎo)航和運(yùn)作,并在移動(dòng)設(shè)備上創(chuàng)建改進(jìn)的增強(qiáng)現(xiàn)實(shí)體驗(yàn)。

最近,計(jì)算機(jī)視覺(jué)領(lǐng)域開(kāi)始在 3D 場(chǎng)景理解方面取得良好進(jìn)展,包括用于移動(dòng) 3D 目標(biāo)檢測(cè)、透明目標(biāo)檢測(cè)等的模型,但由于可應(yīng)用于 3D 數(shù)據(jù)的可用工具和資源有限,進(jìn)入該領(lǐng)域本身可能具有挑戰(zhàn)性。

為了進(jìn)一步提高 3D 場(chǎng)景理解能力,降低感興趣的研究人員的入門(mén)門(mén)檻,我們發(fā)布了 TensorFlow 3D (TF 3D),這一高度模塊化的高效庫(kù)旨在將 3D 深度學(xué)習(xí)功能引入 TensorFlow。TF 3D 提供了一組流行的運(yùn)算、損失函數(shù)、數(shù)據(jù)處理工具、模型和指標(biāo),使更廣泛的研究社區(qū)能夠開(kāi)發(fā)、訓(xùn)練和部署最先進(jìn)的 3D 場(chǎng)景理解模型。

TF 3D 包含用于最先進(jìn) 3D 語(yǔ)義分割、3D 目標(biāo)檢測(cè)和 3D 實(shí)例分割的訓(xùn)練和評(píng)估流水線,并支持分布式訓(xùn)練。它也可實(shí)現(xiàn)其他潛在應(yīng)用,如 3D 目標(biāo)形狀預(yù)測(cè)、點(diǎn)云配準(zhǔn)和點(diǎn)云密化。此外,它還提供了統(tǒng)一的數(shù)據(jù)集規(guī)范和配置,用于訓(xùn)練和評(píng)估標(biāo)準(zhǔn) 3D 場(chǎng)景理解數(shù)據(jù)集。目前支持 Waymo Open、ScanNet 和 Rio 數(shù)據(jù)集。不過(guò),用戶可以將 NuScenes 和 Kitti 等其他流行數(shù)據(jù)集自由轉(zhuǎn)換為相似格式,并將其用于預(yù)先存在或自定義創(chuàng)建的流水線,也可以通過(guò)利用 TF 3D 進(jìn)行各種 3D 深度學(xué)習(xí)研究和應(yīng)用,包括快速原型設(shè)計(jì)以及試驗(yàn)新想法的方式來(lái)部署實(shí)時(shí)推斷系統(tǒng)。

左側(cè)

我們將介紹 TF 3D 提供的高效可配置的稀疏卷積主干,它是在各種 3D 場(chǎng)景理解任務(wù)上取得最先進(jìn)結(jié)果的關(guān)鍵。此外,我們將分別介紹 TF 3D 目前支持的三種流水線:3D 語(yǔ)義分割、3D 目標(biāo)檢測(cè)和 3D 實(shí)例分割。

3D 稀疏卷積網(wǎng)絡(luò)

傳感器捕獲的 3D 數(shù)據(jù)通常具有一個(gè)場(chǎng)景,其中包含一組感興趣的目標(biāo)(如汽車(chē)、行人等),其周?chē)蠖嗍怯邢蓿ɑ驘o(wú))興趣的開(kāi)放空間。因此,3D 數(shù)據(jù)本質(zhì)上是稀疏的。在這樣的環(huán)境下,卷積的標(biāo)準(zhǔn)實(shí)現(xiàn)將需要大量計(jì)算并消耗大量?jī)?nèi)存。因此,在 TF 3D 中,我們使用子流形稀疏卷積和池化運(yùn)算,旨在更有效地處理 3D 稀疏數(shù)據(jù)。稀疏卷積模型是大多數(shù)戶外自動(dòng)駕駛(如 Waymo、NuScenes)和室內(nèi)基準(zhǔn)(如 ScanNet)中應(yīng)用的最先進(jìn)方法的核心。

我們還使用多種 CUDA 技術(shù)來(lái)加快計(jì)算速度(例如,哈希處理、在共享內(nèi)存中分區(qū)/緩存過(guò)濾器,以及使用位運(yùn)算)。Waymo Open 數(shù)據(jù)集上的實(shí)驗(yàn)表明,該實(shí)現(xiàn)比使用預(yù)先存在的 TensorFlow 運(yùn)算的精心設(shè)計(jì)實(shí)現(xiàn)快約 20 倍。

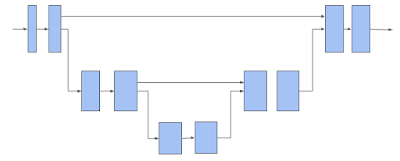

TF 3D 然后使用 3D 子流形稀疏 U-Net 架構(gòu)為每個(gè)體素 (Voxel) 提取特征。通過(guò)讓網(wǎng)絡(luò)同時(shí)提取粗略特征和精細(xì)特征并將其組合以進(jìn)行預(yù)測(cè),事實(shí)證明 U-Net 架構(gòu)是有效的。U-Net 網(wǎng)絡(luò)包括編碼器、瓶頸和解碼器三個(gè)模塊,每個(gè)模塊都由許多稀疏卷積塊組成,并可能進(jìn)行池化或解池化運(yùn)算。

3D 稀疏體素 U-Net 架構(gòu)。請(qǐng)注意,水平箭頭接收體素特征并對(duì)其應(yīng)用子流形稀疏卷積。下移箭頭執(zhí)行子流形稀疏池化。上移箭頭將回收池化的特征,與來(lái)自水平箭頭的特征合并,并對(duì)合并后的特征進(jìn)行子流形稀疏卷積

上述稀疏卷積網(wǎng)絡(luò)是 TF 3D 中提供的 3D 場(chǎng)景理解流水線的主干。下面描述的每個(gè)模型都使用此主干網(wǎng)絡(luò)提取稀疏體素的特征,然后添加一個(gè)或多個(gè)附加預(yù)測(cè)頭來(lái)推斷感興趣的任務(wù)。用戶可以更改編碼器/解碼器層數(shù)和每層中卷積的數(shù)量以及修改卷積過(guò)濾器的大小來(lái)配置 U-Net 網(wǎng)絡(luò),從而通過(guò)不同的主干配置探索大范圍的速度/準(zhǔn)確率權(quán)衡。

3D 語(yǔ)義分割

3D 語(yǔ)義分割模型只有一個(gè)輸出頭,用于預(yù)測(cè)每個(gè)體素的語(yǔ)義分?jǐn)?shù),語(yǔ)義分?jǐn)?shù)映射回點(diǎn)以預(yù)測(cè)每個(gè)點(diǎn)的語(yǔ)義標(biāo)簽。

3D 實(shí)例分割

在 3D 實(shí)例分割中,除了預(yù)測(cè)語(yǔ)義外,目標(biāo)是將屬于同一目標(biāo)的體素歸于一組。TF 3D 中使用的 3D 實(shí)例分割算法基于我們先前的使用深度指標(biāo)學(xué)習(xí)的 2D 圖像分割研究工作。該模型預(yù)測(cè)每個(gè)體素的實(shí)例嵌入向量以及每個(gè)體素的語(yǔ)義分?jǐn)?shù)。實(shí)例嵌入向量將體素映射到一個(gè)嵌入向量空間,其中對(duì)應(yīng)同一目標(biāo)實(shí)例的體素靠得很近,而對(duì)應(yīng)不同目標(biāo)的體素則相距很遠(yuǎn)。在這種情況下,輸入是點(diǎn)云而不是圖像,并使用 3D 稀疏網(wǎng)絡(luò)而不是 2D 圖像網(wǎng)絡(luò)。在推斷時(shí),貪婪的算法每次挑選一個(gè)實(shí)例種子,并使用體素嵌入向量之間的距離將其分組為段。

3D 目標(biāo)檢測(cè)

3D 目標(biāo)檢測(cè)模型預(yù)測(cè)每個(gè)體素的大小、中心、旋轉(zhuǎn)矩陣以及目標(biāo)語(yǔ)義分?jǐn)?shù)。在推斷時(shí),采用盒建議機(jī)制 (Box proposal mechanism) 將成千上萬(wàn)的各體素的盒預(yù)測(cè)減少為幾個(gè)準(zhǔn)確的盒建議,然后在訓(xùn)練時(shí),將盒預(yù)測(cè)和分類(lèi)損失應(yīng)用于各體素的預(yù)測(cè)。我們對(duì)預(yù)測(cè)和基本事實(shí)盒頂角之間的距離應(yīng)用 Huber 損失。由于從其大小、中心和旋轉(zhuǎn)矩陣估計(jì)盒頂角的函數(shù)是可微的,因此損失將自動(dòng)傳播回這些預(yù)測(cè)的目標(biāo)屬性。我們采用動(dòng)態(tài)盒分類(lèi)損失,將與基本事實(shí)強(qiáng)烈重合的盒分類(lèi)為正,將不重合的盒分類(lèi)為負(fù)。

在我們最近的論文《DOPS: Learning to Detect 3D Objects and Predict their 3D Shapes》中,我們?cè)敿?xì)描述了 TF 3D 中用于目標(biāo)檢測(cè)的單階段弱監(jiān)督學(xué)習(xí)算法。此外,在后續(xù)工作中,我們提出基于 LSTM 的稀疏多幀模型,擴(kuò)展了 3D 目標(biāo)檢測(cè)模型以利用時(shí)間信息。我們進(jìn)一步證明,在 Waymo Open 數(shù)據(jù)集中,這種時(shí)間模型比逐幀方法的性能高出 7.5%。

DOPS 論文中介紹的 3D 目標(biāo)檢測(cè)和形狀預(yù)測(cè)模型。3D 稀疏 U-Net 用于提取每個(gè)體素的特征向量。目標(biāo)檢測(cè)模塊使用這些特征建議 3D 盒和語(yǔ)義分?jǐn)?shù)。同時(shí),網(wǎng)絡(luò)的另一個(gè)分支預(yù)測(cè)形狀嵌入向量,用于輸出每個(gè)目標(biāo)的網(wǎng)格

致謝

TensorFlow 3D 代碼庫(kù)和模型的發(fā)布是 Google 研究人員在產(chǎn)品組的反饋和測(cè)試下廣泛合作的結(jié)果。我們要特別強(qiáng)調(diào) Alireza Fathi 和 Rui Huang(在 Google 期間完成的工作)的核心貢獻(xiàn),另外還要特別感謝 Guangda Lai、Abhijit Kundu、Pei Sun、Thomas Funkhouser、David Ross、Caroline Pantofaru、Johanna Wald、Angela Dai 和 Matthias Niessner。

原文標(biāo)題:TensorFlow 3D 助力理解 3D 場(chǎng)景!

文章出處:【微信公眾號(hào):TensorFlow】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

責(zé)任編輯:haq

-

傳感器

+關(guān)注

關(guān)注

2566文章

53008瀏覽量

767494 -

3D

+關(guān)注

關(guān)注

9文章

2959瀏覽量

110768

原文標(biāo)題:TensorFlow 3D 助力理解 3D 場(chǎng)景!

文章出處:【微信號(hào):tensorflowers,微信公眾號(hào):Tensorflowers】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

海伯森3D閃測(cè)傳感器,工業(yè)檢測(cè)領(lǐng)域的高精度利器

對(duì)于結(jié)構(gòu)光測(cè)量、3D視覺(jué)的應(yīng)用,使用100%offset的lightcrafter是否能用于點(diǎn)云生成的應(yīng)用?

3D打印技術(shù)在材料、工藝方面的突破

從2D走向3D的視覺(jué)傳感器

【小白入門(mén)必看】一文讀懂深度學(xué)習(xí)計(jì)算機(jī)視覺(jué)技術(shù)及學(xué)習(xí)路線

探索工業(yè)計(jì)算機(jī)的多元應(yīng)用場(chǎng)景

信號(hào)繼電器在計(jì)算機(jī)系統(tǒng)中的應(yīng)用

探索3D視覺(jué)技術(shù)在活塞桿自動(dòng)化抓取中的應(yīng)用

簡(jiǎn)述計(jì)算機(jī)總線的分類(lèi)

晶體管計(jì)算機(jī)和電子管計(jì)算機(jī)有什么區(qū)別

計(jì)算機(jī)視覺(jué)有哪些優(yōu)缺點(diǎn)

邊沿觸發(fā)器在計(jì)算機(jī)中的應(yīng)用

計(jì)算機(jī)視覺(jué)中的圖像融合

計(jì)算機(jī)視覺(jué)領(lǐng)域開(kāi)始在3D場(chǎng)景理解方面取得良好進(jìn)展

計(jì)算機(jī)視覺(jué)領(lǐng)域開(kāi)始在3D場(chǎng)景理解方面取得良好進(jìn)展

評(píng)論