這是一篇來自谷歌大腦的paper。這篇paper的主要成果是用Transformer[1]取代CNN,并證明了CNN不是必需的,甚至在大規(guī)模數(shù)據(jù)集預(yù)訓(xùn)練的基礎(chǔ)上在一些benchmarks做到了SOTA,并且訓(xùn)練時(shí)使用的資源更少。

圖像分塊

要將圖片分塊是因?yàn)門ransformer是用于NLP領(lǐng)域的,在NLP里面,Transformer的輸入是一個(gè)序列,每個(gè)元素是一個(gè)word embedding。因此將Transformer用于圖像時(shí)也要找出word的概念,于是就有了這篇paper的title:AN IMAGE IS WORTH 16X16 WORDS,將一張圖片看成是16*16個(gè)“單詞”。

inductive biases

在機(jī)器學(xué)習(xí)中,人們對(duì)算法做了各種的假設(shè),這些假設(shè)就是inductive biases(歸納偏置),例如卷積神經(jīng)網(wǎng)絡(luò)就有很強(qiáng)的inductive biases。文中做了一個(gè)實(shí)驗(yàn),在中等大小數(shù)據(jù)集訓(xùn)練時(shí),精度會(huì)略遜色于ResNets。但是這個(gè)結(jié)果也是應(yīng)該預(yù)料到的,因?yàn)門ransformer缺少了CNN固有的一些inductive biases,比如平移不變性和局部性。所以當(dāng)沒有足夠的數(shù)據(jù)用于訓(xùn)練時(shí),你懂的。但是恰恰Transformer就強(qiáng)在這一點(diǎn),由于Transformer運(yùn)算效率更高,而且模型性能并沒有因?yàn)閿?shù)據(jù)量的增大而飽和,至少目前是這樣的,就是說模型性能的上限很高,所以Transformer很適合訓(xùn)練大型的數(shù)據(jù)集。

ViT

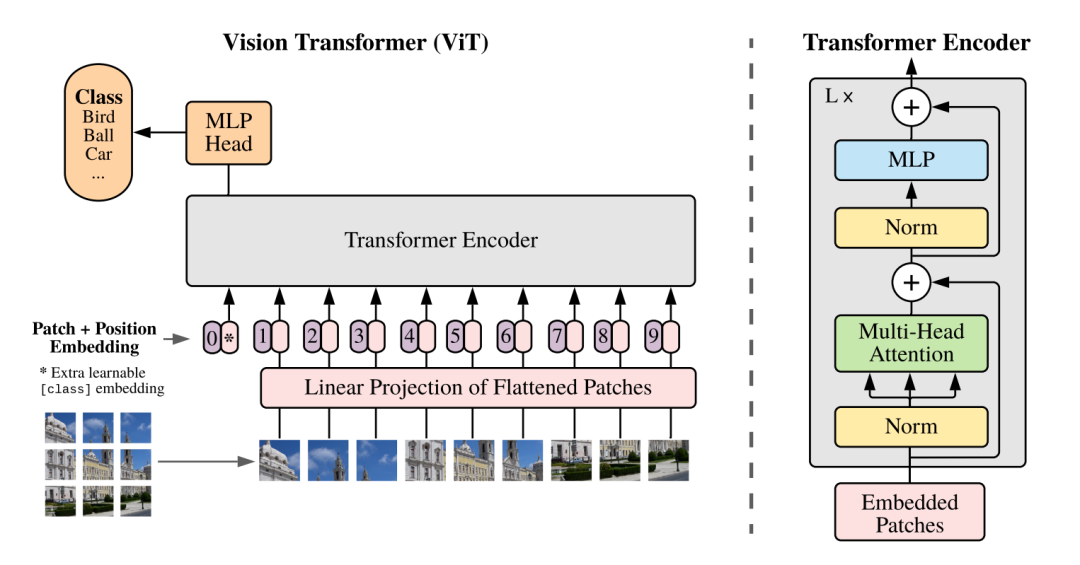

在ViT中,模型只有Encoder的,沒有Decoder,因?yàn)橹皇怯糜谧R(shí)別任務(wù),不需要Decoder。

首先按照慣例,先把圖像的patch映射成一個(gè)embedding,即圖中的linear projection層。然后加上position embedding,這里的position是1D的,因?yàn)榘凑兆髡叩恼f法是在2D上并沒有性能上的提升。最后還要加上一個(gè)learnable classification token放在序列的前面,classification由MLP完成。

Hybrid Architecture。模型也可以是CNN和Transformer的混合,即Transformer的輸入不是原圖像的patch,而是經(jīng)過CNN得到的feature map的patch。

實(shí)驗(yàn)結(jié)果

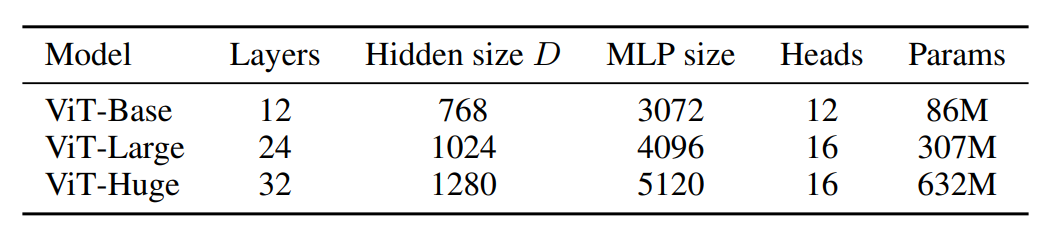

不同大小的ViT的參數(shù)量。

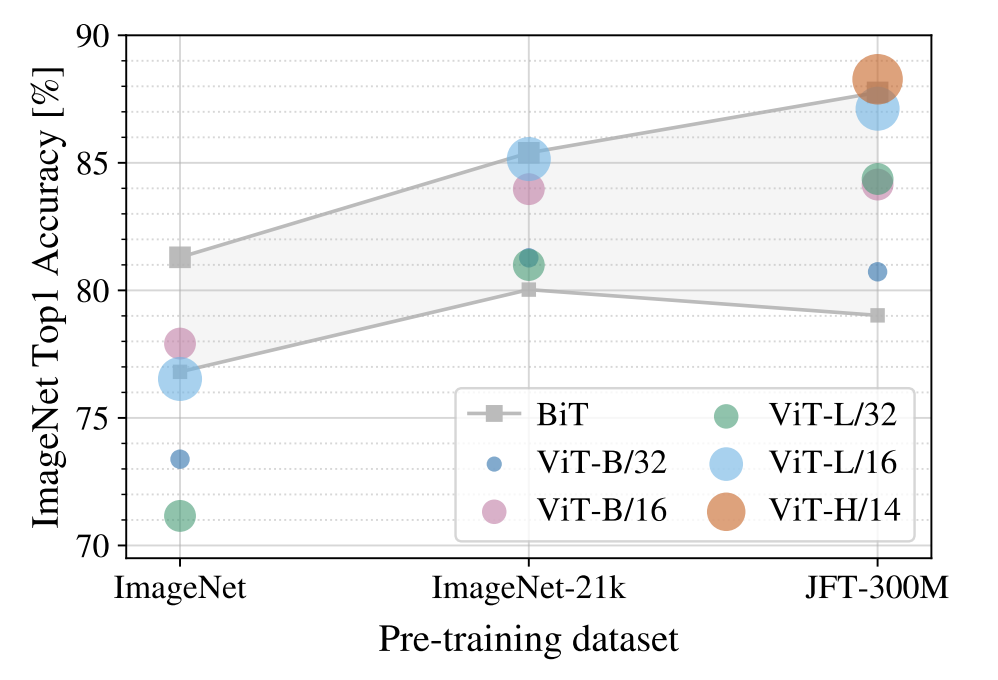

可以看到在預(yù)訓(xùn)練數(shù)據(jù)集很小的情況下ViT的效果并不好,但是好在隨著預(yù)訓(xùn)練數(shù)據(jù)集越大時(shí)ViT的效果越好,最終超過ResNet。

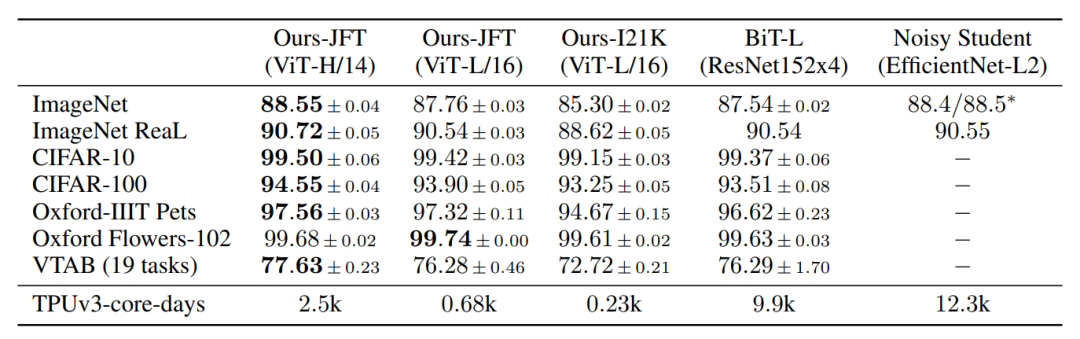

BiT[2]是谷歌用JFT-300M(谷歌內(nèi)部非公開數(shù)據(jù)集)訓(xùn)練的ResNet模型。Noisy Student[3]是谷歌提出借助半監(jiān)督大大提升了imagenet性能的算法。可以看到,在JFT-300M預(yù)訓(xùn)練的情況下,ViT比ResNet好上不少,并且開銷更小。

總結(jié)

ViT的成功我認(rèn)為是以下幾點(diǎn):

1、self-attention比CNN更容易捕捉long-range的信息;

2、大量的數(shù)據(jù),在視覺中CNN是人類實(shí)踐中很成功的inductive biases,顯然大量的數(shù)據(jù)是能戰(zhàn)勝inductive biases的;

3、計(jì)算效率高,因?yàn)閟elf-attention可以看作是矩陣運(yùn)算,所以效率很高,容易訓(xùn)練大型的模型。

原文標(biāo)題:視覺新范式Transformer之ViT

文章出處:【微信公眾號(hào):深度學(xué)習(xí)實(shí)戰(zhàn)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

責(zé)任編輯:haq

-

機(jī)器視覺

+關(guān)注

關(guān)注

163文章

4508瀏覽量

122228 -

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8490瀏覽量

134069 -

Transforme

+關(guān)注

關(guān)注

0文章

12瀏覽量

8869

原文標(biāo)題:視覺新范式Transformer之ViT

文章出處:【微信號(hào):gh_a204797f977b,微信公眾號(hào):深度學(xué)習(xí)實(shí)戰(zhàn)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

ALVA空間智能視覺焊接方案重構(gòu)工業(yè)焊接范式

?VLM(視覺語言模型)?詳細(xì)解析

使用stm32u575vit6時(shí)應(yīng)該是使用lqfp100的引腳順序還是lqfp100-smps的引腳順序?

如何使用MATLAB構(gòu)建Transformer模型

地平線ViG基于視覺Mamba的通用視覺主干網(wǎng)絡(luò)

transformer專用ASIC芯片Sohu說明

知行科技大模型研發(fā)體系初見效果

使用ReMEmbR實(shí)現(xiàn)機(jī)器人推理與行動(dòng)能力

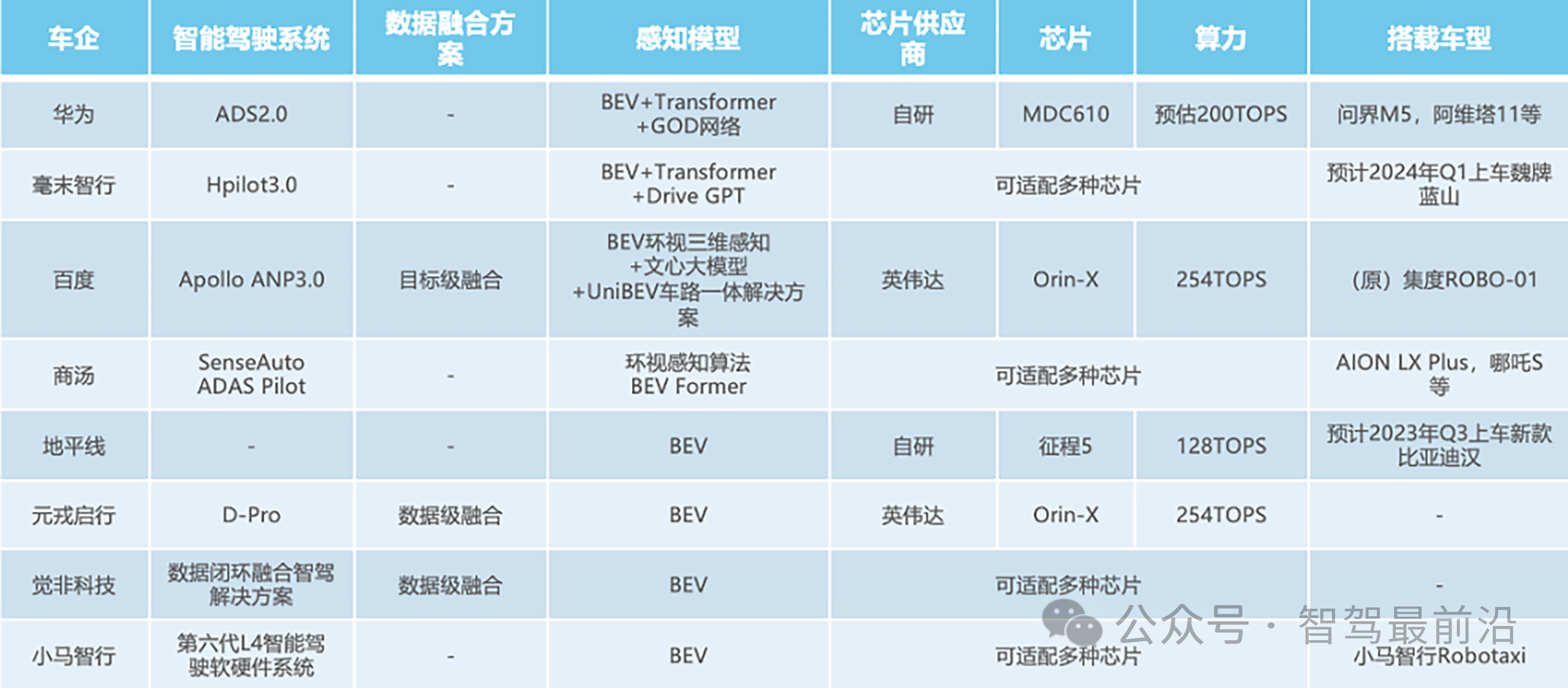

自動(dòng)駕駛中一直說的BEV+Transformer到底是個(gè)啥?

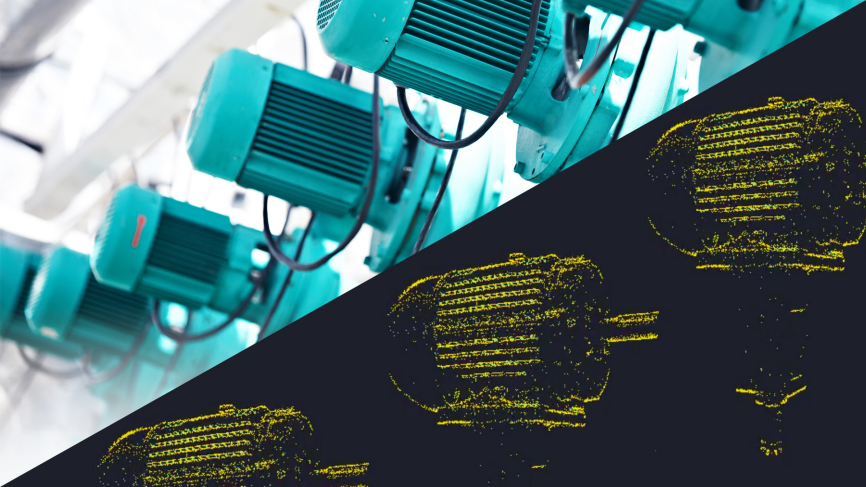

Prophesee:基于EVS打造機(jī)器視覺新范式

視覺新范式Transformer之ViT的成功

視覺新范式Transformer之ViT的成功

評(píng)論