2020年歐洲計算機視覺會議(ECCV)于8月23日至28日在網(wǎng)上舉行,由1360篇論文組成,包括104場orals,160場spotlights以及1096篇posters,共進行有45場workshops和16場tutorials。與近年來的ML和CV會議一樣,有時大量的論文可能不勝枚舉。

半監(jiān)督學(xué)習(xí),無監(jiān)督學(xué)習(xí),遷移學(xué)習(xí),表征學(xué)習(xí)以及小樣本學(xué)習(xí)

Big Transfer (BiT): General Visual Representation Learning (paper)

(https://arxiv.org/abs/1912.11370) 在本文中,作者重新審視了遷移學(xué)習(xí)的簡單范式:首先在一個大規(guī)模標記數(shù)據(jù)集(例如JFT-300M和ImageNet-21k數(shù)據(jù)集)上進行預(yù)訓(xùn)練,然后對目標任務(wù)上的每個訓(xùn)練權(quán)重進行精調(diào)任務(wù),減少目標任務(wù)所需的數(shù)據(jù)量和優(yōu)化時間。作者們擬議的遷移學(xué)習(xí)框架是BiT(大轉(zhuǎn)移),由許多組件組成,包含了大量構(gòu)建有效模型的必需組件,使其能夠借助于大規(guī)模數(shù)據(jù)集學(xué)習(xí)到通用的、可遷移的特征表達。 在(上游)預(yù)訓(xùn)練方面,BiT包括以下內(nèi)容:

對于非常大的數(shù)據(jù)集,由于Batch Normalization(BN)在測試結(jié)果期間使用訓(xùn)練數(shù)據(jù)中的統(tǒng)計信息會導(dǎo)致訓(xùn)練/測試差異,在這種情況下,訓(xùn)練損失可以正確優(yōu)化和回傳,但是驗證損失非常不穩(wěn)定。除了BN對批次大小的敏感性外。為了解決這個問題,BiT既使用了Group Norm,又使用了Weight Norm,而不是Batch Norm。

諸如ResNet 50之類的小型模型無法從大規(guī)模數(shù)據(jù)集中受益,因此模型的大小也需要相應(yīng)地擴大規(guī)模,和數(shù)據(jù)集匹配。

對于(下游)目標任務(wù),BiT建議以下內(nèi)容:

使用標準SGD優(yōu)化器,無需層凍結(jié),dropout,L2正規(guī)化或任何適應(yīng)梯度。別忘了把最后的預(yù)測層的權(quán)重初始化為0。

不用將所有輸入縮放為固定大小,例如224。在訓(xùn)練過程中,輸入圖像會隨機調(diào)整大小并裁剪為具有隨機選擇大小的正方形,并隨機水平翻轉(zhuǎn)。在測試階段,圖像會被縮放為固定大小,

盡管對于數(shù)據(jù)量充足的大規(guī)模數(shù)據(jù)集預(yù)訓(xùn)練來說,mixup 并沒有多大用處,但BiT發(fā)現(xiàn)misup正則化對于用于下游任務(wù)的中型數(shù)據(jù)集訓(xùn)練非常有用。

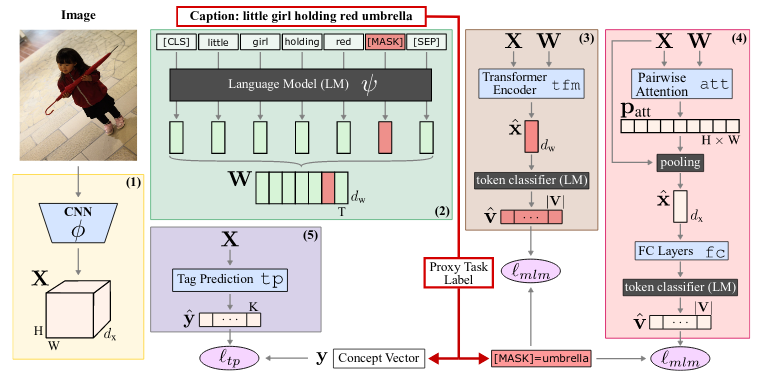

Learning Visual Representations with Caption Annotations

(https://arxiv.org/abs/2008.01392) 在大規(guī)模標注的數(shù)據(jù)集上訓(xùn)練深度模型不僅可以使手頭的任務(wù)表現(xiàn)良好,還可以使模型學(xué)習(xí)對于下游任務(wù)的有用特征形式。但是,我們是否可以在不使用如此昂貴且細粒度的標注數(shù)據(jù)的情況下獲得類似的特征表達能力呢?本文研究了使用噪聲標注(在這種情況下為圖像標題)的弱監(jiān)督預(yù)訓(xùn)練。

目標是用有限對圖像與說明文字來學(xué)習(xí)視覺表達,那么,如何制定訓(xùn)練目標以推動圖像及其標題之間的有效交互?基于BER模型隨機掩蓋15% 的輸入字符,讓模型根據(jù) transformer 模型的編碼器輸出重建整個句子,該方法也隨機對圖像的文字說明進行掩碼操作。論文提出了圖像條件化的掩蔽語言建模(ICMLM),其中利用圖像信息來重構(gòu)其相應(yīng)說明文字的掩碼的字符。為了解決這個問題,作者提出了兩種多模架構(gòu):(1)ICMLM tfm,使用一個卷積神經(jīng)網(wǎng)絡(luò)對原始圖像進行編碼得到圖像特征,接著,經(jīng)過BERT處理的被掩碼的圖像說明、原始圖像說明以及圖像特征被級聯(lián)起來并通過一個 transformer 編碼器,最終輸出一個多模嵌入特征用于預(yù)估被掩碼的字符。(2)首先生成ICMLM att + fc,說明和圖像之間的相似度,接著經(jīng)過一個成對注意力模塊來整合圖像與文字說明之間的信息。得到的特征會經(jīng)過池化后再過一個全連接層來預(yù)測被掩碼的字符。

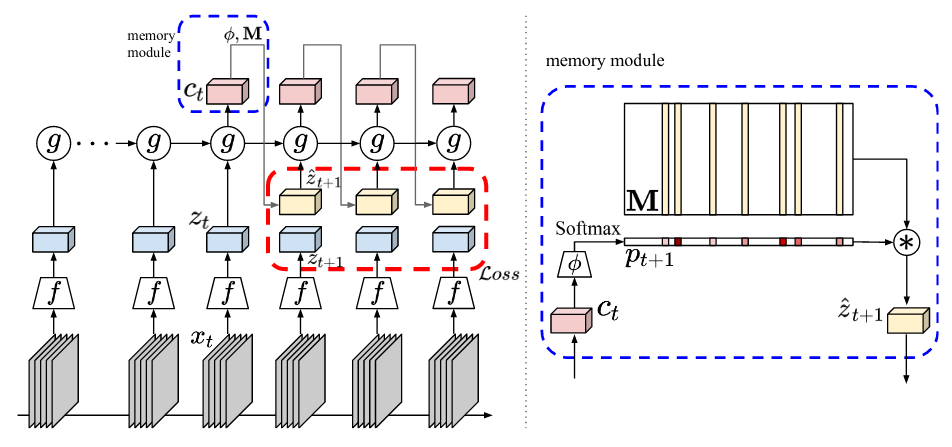

Memory-augmented Dense Predictive Coding for Video Representation Learning

(https://arxiv.org/abs/2008.01065) 近期在自監(jiān)督圖像表征學(xué)習(xí)領(lǐng)域的進步在下游任務(wù)中展現(xiàn)出了令人印象深刻的效果。盡管視頻的多模表征學(xué)習(xí)多有發(fā)展,然而不使用其他任何類似于文本與語音的模態(tài)信息,但使用視頻流進行自監(jiān)督學(xué)習(xí)還未有所發(fā)展。即使視頻的時域信息為自監(jiān)督地訓(xùn)練一個根據(jù)過去幀預(yù)測未來幀的模型提供了充足的監(jiān)督信號。由于確切的未來并不存在,并且在給定的時間步長內(nèi),對于未來狀態(tài)有許多可能和合理的假設(shè)(例如,當動作是“打高爾夫球”時,那么下一幀可能是手或者高爾夫俱樂部)。

本文將對比學(xué)習(xí)與存儲模塊結(jié)合使用,以解決未來幀的預(yù)測問題。為了減少不確定性,該模型會在特征級別上預(yù)測未來,并使用對比損失進行訓(xùn)練以避免過度約束。為了處理多種假設(shè),一個存儲模塊用于同時推斷多個未來狀態(tài)。給定一組連續(xù)幀,2d-3d CNN編碼器(即ff)產(chǎn)生上下文特征,而GRU(即g)整合所有過去的信息,然后將其用于從共享存儲模塊中選擇插槽。然后,將預(yù)測的未來狀態(tài)作為所選存儲插槽的凸組合生成。然后,使用對比損失將預(yù)測的未來狀態(tài)與未來狀態(tài)的真實特征向量進行比較。對于下游任務(wù),將g產(chǎn)生的特征匯總起來,然后提供給分類器處理。

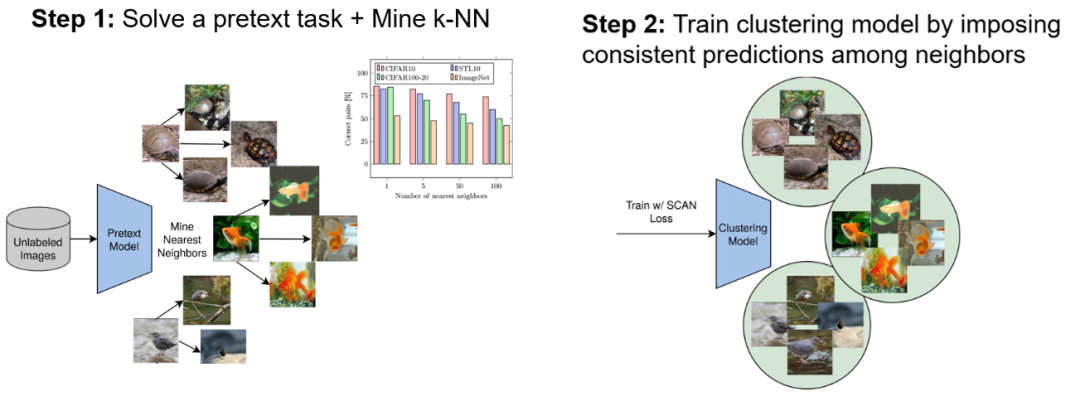

SCAN: Learning to Classify Images without Labels

(https://arxiv.org/abs/2005.12320) 要將未標記的輸入圖像分組為語義上有意義的聚類,我們需要僅使用視覺相似性來找到解決方案。先前的工作之一是(1)使用自我監(jiān)督的方法學(xué)習(xí)豐富的特征,然后對特征應(yīng)用k均值以找到聚類,但這很容易導(dǎo)致性能退化。(2)端到端群集方法,這些方法可以利用CNN的功能進行深度聚類,也可以基于互信息最大化。但是,生成的聚類結(jié)果在很大程度上取決于初始化,并且很可能會陷入低級特征主導(dǎo)中。

為了解決先前工作中發(fā)現(xiàn)的問題,本文提出了采用兩步過程的SCAN(采用最鄰方法的語義聚類)。第一步,通過前置任務(wù)學(xué)習(xí)特征表示,然后生成將語義上有意義的最近鄰用作先驗,以訓(xùn)練模型將每個圖像及其對應(yīng)的鄰居分為一類。模型通過損失函數(shù)來優(yōu)化,該函數(shù)會在 softmax 之后最大化輸出向量的點積,從而迫使網(wǎng)絡(luò)產(chǎn)生一致且有判別度的(one-hot 向量)預(yù)測。

GATCluster: Self-Supervised Gaussian-Attention Network for Image Clustering

(https://arxiv.org/abs/2002.11863)

聚類包括根據(jù)樣本相似性將數(shù)據(jù)分為多個聚類。傳統(tǒng)的方法是使用手工特征和特定于領(lǐng)域的距離函數(shù)來衡量相似度,但是這種手工制作的特征在表達能力上非常有限。隨后的工作將深度表示和聚類算法結(jié)合起來,但是當輸入數(shù)據(jù)很復(fù)雜時,深度聚類的性能還是會受到影響。有效的聚類在特征層面必須同時包含高層判別性特征并獲取對象語義信息。在聚類步驟上,必須避免使用將樣本分配到單個或少數(shù)幾個集群的算法,并且聚類需要高效地應(yīng)用于大尺寸圖像。 本文提出了GATCluster,它直接輸出語義聚類標簽而無需進一步的后處理,其中學(xué)習(xí)到的特征是一個 one-hot 編碼向量,以避免弱解。GATCluster在平移不變性、可分離性最大化、熵分析和注意力映射約束下,通過四個自學(xué)習(xí)任務(wù)以無監(jiān)督的方式進行了訓(xùn)練。

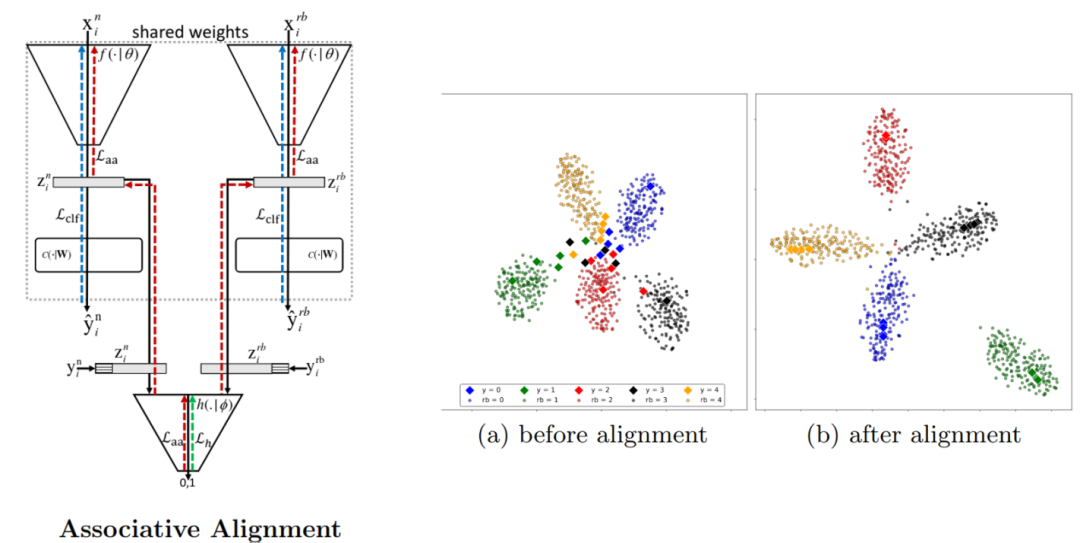

Associative Alignment for Few-shot Image Classification

(https://arxiv.org/abs/1912.05094) 小樣本圖像分類的目標是在訓(xùn)練樣本很少的情況下,生成一個能夠?qū)W習(xí)識別新的圖像類的模型。現(xiàn)在流行的方法之一是元學(xué)習(xí),它從大量包含基類的標記數(shù)據(jù)中提取公共知識,并用于訓(xùn)練模型。然后訓(xùn)練該模型以僅用幾個樣本就可以對來自新穎概念的圖像進行分類。元目標是找到一組良好的初始權(quán)重集合,這些初始權(quán)重在接受新概念訓(xùn)練時會迅速收斂。有趣的是,最近的研究表明,不使用元學(xué)習(xí)的標準轉(zhuǎn)移學(xué)習(xí),其中特征提取器首先在基類上進行了預(yù)訓(xùn)練,然后根據(jù)新的幾個類別上在預(yù)訓(xùn)練的提取器之上對分類器進行了微調(diào)。,其性能和更復(fù)雜的元學(xué)習(xí)策略不相上下。但是為了避免過擬合,特征提取器對部分層的權(quán)重凍結(jié)會阻礙性能。

本文提出了一種兩步法來解決這個問題。首先,特征提取器用于為新樣本生成特征。然后,使用嵌入空間中的相似性度量將每個樣本的特征映射到基類之一。第二步包括關(guān)聯(lián)對齊,其中對特征提取器進行微調(diào),以便將新圖像的嵌入向量更靠近其相應(yīng)基礎(chǔ)圖像的嵌入。這可以通過以下方法完成:在每個基類的中心與新類比之間的距離減小的質(zhì)心對齊方式,也可以使用對抗性對齊,其中鑒別器迫使特征提取器在嵌入空間中對齊基礎(chǔ)圖像和新樣本。

三維計算機視覺以及機器人學(xué)

NeRF: Representing Scenes as Neural Radiance Fields for View Synthesis

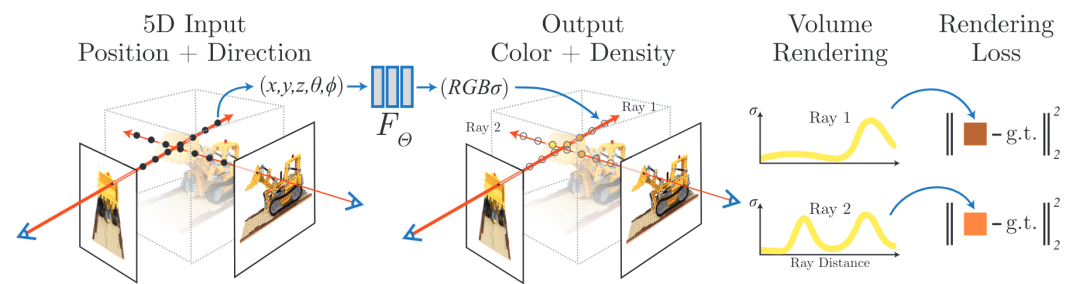

(https://arxiv.org/abs/2003.08934) 從2D圖像合成3D視圖是一個具有挑戰(zhàn)性的問題,尤其是在稀疏地采樣了輸入2D圖像的情況下。改目標的任務(wù)是是訓(xùn)練一個模型,該模型拍攝3D場景的2D圖像集合(具有可選的相機姿勢及其內(nèi)參),然后,使用訓(xùn)練后的模型,我們可以渲染3D場景中未找到的新2D視圖。種成功的方法是基于體素的表示法,該表示方法使用離散的網(wǎng)格表示3D場景。使用3D CNN可以預(yù)測3D體素中對應(yīng)的RGB-alpha網(wǎng)格值。是,由于這種基于體素的方法復(fù)雜度與空間分辨率成三次比,難以優(yōu)化并且無法平滑地對場景表面進行參數(shù)化,因此它們的存儲效率不高。計算機視覺社區(qū)的最新趨勢是使用全連接的神經(jīng)網(wǎng)絡(luò)將給定的3D場景表示為連續(xù)函數(shù)。因此,神經(jīng)網(wǎng)絡(luò)本身就是3D場景的壓縮表示,使用2D圖像集進行訓(xùn)練,然后用于渲染新的視圖。但是,現(xiàn)有方法仍無法匹配現(xiàn)有基于voxed的方法。

NeRF(神經(jīng)輻射場)使用9個層和256個通道的全連接網(wǎng)絡(luò)將場景表示為連續(xù)5D函數(shù),其輸入是單個連續(xù)5D函數(shù),即3D空間位置(xx,yy,zz)和視角方向(θθ,??),其輸出為RGB顏色和不透明度(輸出密度)。為了合成給定的視圖,渲染過程包括沿攝像機光心所在的直線查詢5D坐標,并使用經(jīng)典的體素渲染技術(shù)將輸出的顏色和密度投影到圖像中。由于體素渲染是可以區(qū)分的,因此優(yōu)化表示所需的唯一輸入就是具有已知攝影機姿勢參數(shù)的一組圖像。這樣,NeRF能夠有效地優(yōu)化神經(jīng)輻射場,以渲染具有復(fù)雜幾何形狀和外觀的場景的逼真視圖,并且在渲染的圖像和真實圖像之間具有簡單的重建損失,并證明其結(jié)果優(yōu)于先前的神經(jīng)渲染和視圖工作合成研究。

Towards Streaming Perception

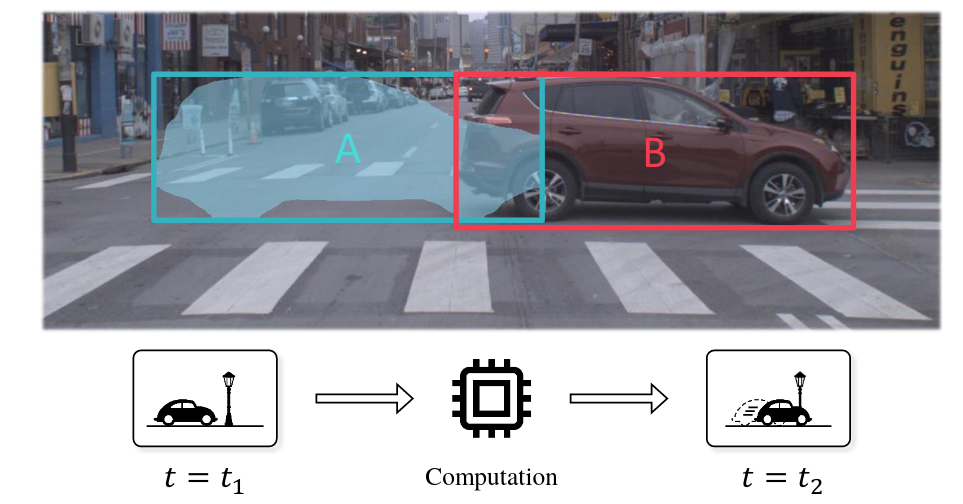

(https://arxiv.org/abs/2005.10420) 諸如自動駕駛汽車之類的實際應(yīng)用需要類似于人類的快速反應(yīng)時間,通常為200毫秒。在這種情況下,需要使用低延遲算法來確保安全運行。但是,即使經(jīng)常研究計算機視覺算法的延遲,也僅主要在離線環(huán)境中進行了研究。在線視覺感知會帶來完全不同的延遲需求。因為到了算法完成處理特定圖像幀的時間(例如200毫秒后),周圍的世界就發(fā)生了變化,如下圖所示。這迫使感知最終預(yù)測了未來,這是人類視覺的基本屬性(例如,當棒球運動員擊中快球時,這是必需的)。

為了開發(fā)更好的基準以反映現(xiàn)實情況,并使現(xiàn)有方法的比較更加容易。本文介紹了流感知的目標,即實時在線感知,并提出了一種新的元基準,該基準將系統(tǒng)地將任何圖像理解任務(wù)系統(tǒng)地轉(zhuǎn)換為流圖像理解任務(wù)。該基準基于基于以下 的幾點提出了:流感知需要在任何時刻都了解世界的狀態(tài)。因此,當新幀到達時,流算法必須報告世界的狀態(tài),即使它們尚未處理前一幀,也迫使它們考慮在進行計算時應(yīng)忽略的流數(shù)據(jù)量。具體來說,當比較模型的輸出和真實標簽時,對齊是使用時間而不是輸入索引來完成的,因此在處理相應(yīng)的輸入之前,模型需要對時間步t給出正確的預(yù)測,即驗證模型需要Δt來處理輸入并處理,它只能使用t-Δt之前的數(shù)據(jù)來預(yù)測在時間t對應(yīng)于輸入的輸出。

Teaching Cameras to Feel: Estimating Tactile Physical Properties of Surfaces From Images

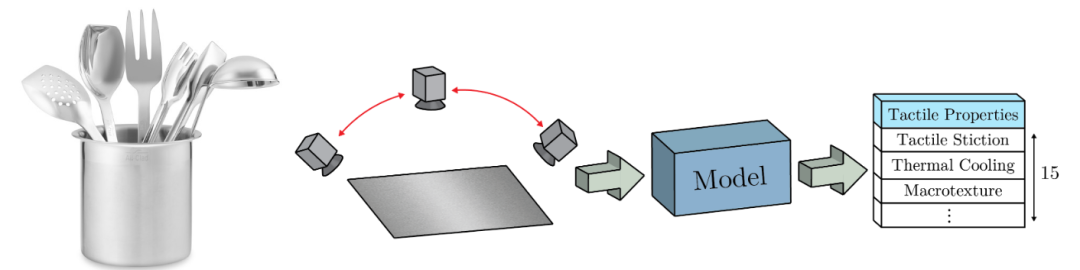

(https://arxiv.org/abs/2004.14487) 人類能夠在小時候就開始形成一種心理模型,該模型以對物體的感知和對應(yīng)的觸覺來映射,這是基于與不同物品互動時的先前經(jīng)驗。當與新對象進行交互時,尤其是當簡單的對象類別無法提供足夠的信息以準確估計觸覺物理特性時,讓具有這種心理模型的自主智能體成為非常有價值的工具。

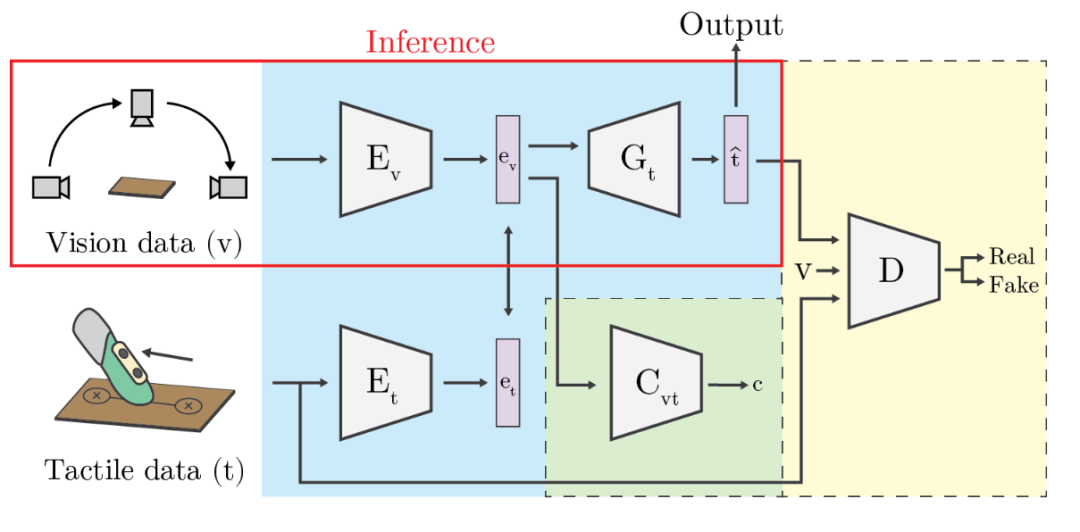

為了更直接地模擬這種心理模型,本文提出直接估計物理特性,從而允許直接利用對象的屬性。首先,作者提出了包含400多個表面圖像序列和觸覺特性測量值的數(shù)據(jù)集。因為當估計表面特性時,人們經(jīng)常不自覺地移動他們的頭部,獲取表面的多個視圖,所以所捕獲的圖像序列包括每個材料表面的多個視角。然后,他們提出了一種跨模式框架,用于學(xué)習(xí)視覺提示到觸覺特性的復(fù)雜映射。該模型的訓(xùn)練目標是在給定視覺信息的情況下生成精確的觸覺特性估計。視覺和觸覺信息都通過單獨的編碼器網(wǎng)絡(luò)嵌入到共享的潛在空間中。然后,生成器函數(shù)根據(jù)嵌入的視覺矢量估算觸覺屬性值。鑒別器網(wǎng)絡(luò)學(xué)習(xí)預(yù)測觸覺-視覺對是真實的還是合成的例子。在推斷期間,如果輸入圖像,則使用編碼器-生成器對來推斷觸覺屬性。

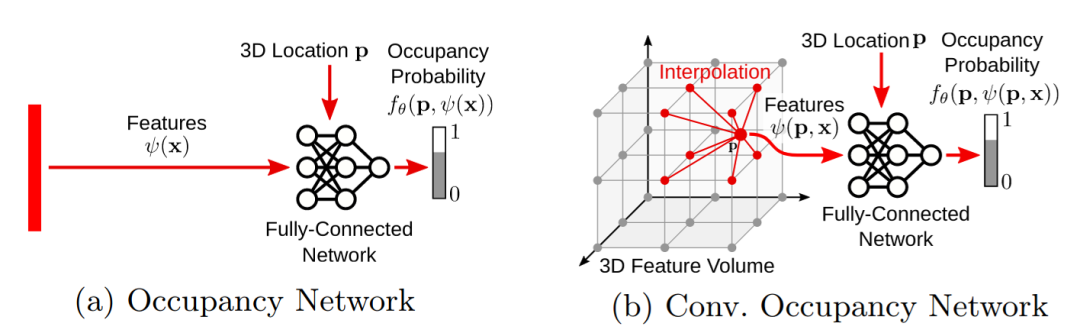

Convolutional Occupancy Networks

(https://arxiv.org/abs/2003.04618) 三維重建是計算機視覺中的一個重要問題,有著廣泛的應(yīng)用。對于三維幾何圖形的理想表示,我們需要能夠達到以下幾點:a)編碼復(fù)雜的幾何圖形和任意拓撲結(jié)構(gòu),b)縮放到大型場景,c)封裝局部和全局信息,以及d)在內(nèi)存和計算方面易于處理。然而,現(xiàn)有的三維重建表示方法并不能滿足所有這些要求。雖然最近的隱式神經(jīng)表示在三維重建中表現(xiàn)出了令人印象深刻的性能,但是由于使用了一種簡單的全連接的網(wǎng)絡(luò)結(jié)構(gòu),這種結(jié)構(gòu)不允許在觀測值中集成局部信息,也不允許包含諸如平移等變的歸納偏差,因此它們有著一些局限性。

Convolutional Occupancy Networks卷積占用網(wǎng)絡(luò)使用卷積編碼器和隱式占用解碼器結(jié)合來歸納偏差,并實現(xiàn)三維空間的結(jié)構(gòu)化推理。從而得到單個對象進行隱式三維重建,具有擴展到大型室內(nèi)場景的能力,并能很好地從合成數(shù)據(jù)推廣到真實數(shù)據(jù)。

圖像和視頻合成

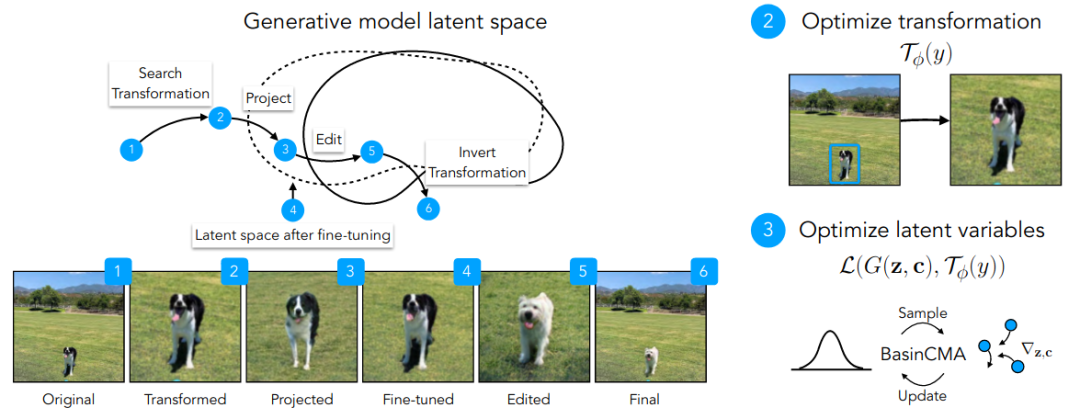

Transforming and Projecting Images into Class-conditional Generative Networks

(https://arxiv.org/abs/2005.01703) GaNs能夠從不同的類別中生成不同的圖像。例如,BigGaN,一個類體哦阿健生成對抗網(wǎng)絡(luò)GaN,給定一個噪聲向量z和一個類嵌入向量c,該模型能夠生成對應(yīng)類的新的圖像。然后,就可以通過編輯噪聲向量的隱變量和類別嵌入向量來操縱圖像。但反過來可能嗎?例如,給定一幅輸入圖像,我們能找到與該圖像最匹配的潛變量z和嵌入類向量c嗎?這個問題仍然具有挑戰(zhàn)性,因為許多輸入圖像不能由GaN生成。另外,由于目標函數(shù)具有多個局部極小值,搜索算法容易陷入此類局部極小值區(qū)域。

為了解決這些問題,本文提出了兩種新的思路:估計輸入圖像的尺度變換,以及使用非局部搜索算法來尋找更好的解。如上所示,給定輸入圖像,pix2potent首先找到最佳仿射變換,使得變換后的輸入可能由GaN生成,然后使用所提出的basicma優(yōu)化方法將圖像投影到隱空間中。然后對獲得的隱變量進行編輯,將其投影回圖像空間,獲得編輯后的圖像,然后可以使用初始仿射變換的逆運算對其進行變換并得到圖像。

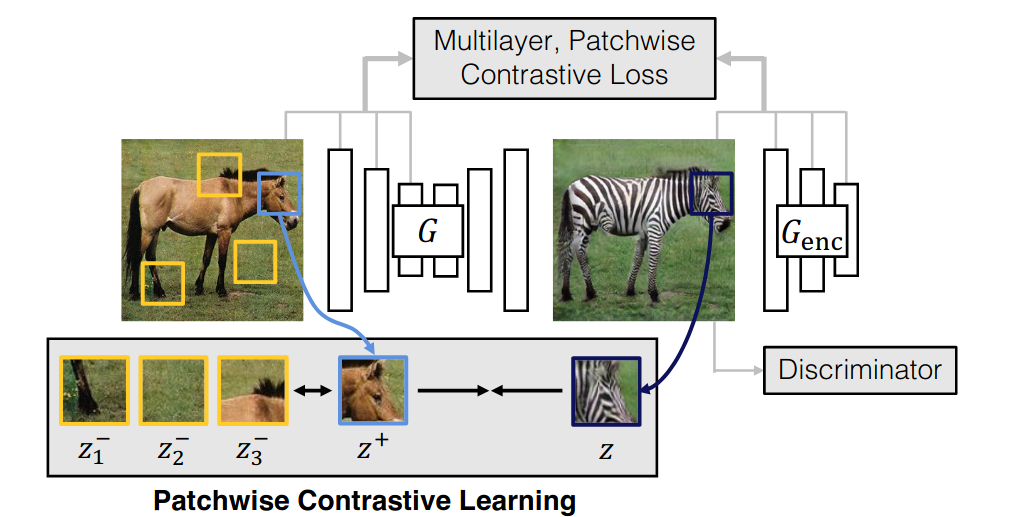

Contrastive Learning for Unpaired Image-to-Image Translation

(https://arxiv.org/abs/2007.15651)

給定兩組不同屬性和模式的圖像對訓(xùn)練集,例如馬和斑馬的圖像組合,非配對圖像到圖像的轉(zhuǎn)換的目的是學(xué)習(xí)兩種模圖像式之間的變化函數(shù),例如將馬轉(zhuǎn)換為斑馬,反之亦然,同時保留諸如姿勢或大小等敏感信息,而不必確保兩種模式之間的一對一匹配集。現(xiàn)有的方法,如CycleGaN迫使模型能夠?qū)⑥D(zhuǎn)換后的圖像變換回原始圖像。但是這樣的方法假設(shè)一個雙射變換,這通有太多限制,因為一個給定的變換后的圖像可能有許多似是而非的源圖像。一個理想的損失應(yīng)該是在不同的樣式下仍然保持不變的,不同的風(fēng)格,但區(qū)分敏感信息。

Contrastive Unpaired Translation(CUT)旨在學(xué)習(xí)這樣一個嵌入空間。除了標準的GAN損失外,生成器被訓(xùn)練生成夠真實的翻譯圖像,而鑒別器試圖區(qū)分轉(zhuǎn)換圖像和真實圖像。還要增加一個額外的損失,用來迫使網(wǎng)絡(luò)對輸入圖像與轉(zhuǎn)換圖像的對應(yīng)圖像塊生成相似的嵌入向量。該損失在優(yōu)化時采用對比損失,即拉近兩個對應(yīng)圖像塊的嵌入向量的距離,同時拉遠給定圖像塊和隨機抽樣圖像塊嵌入之間的距離(只使用同一輸入圖像的內(nèi)部區(qū)塊,其他圖像的區(qū)塊會降低性能)。

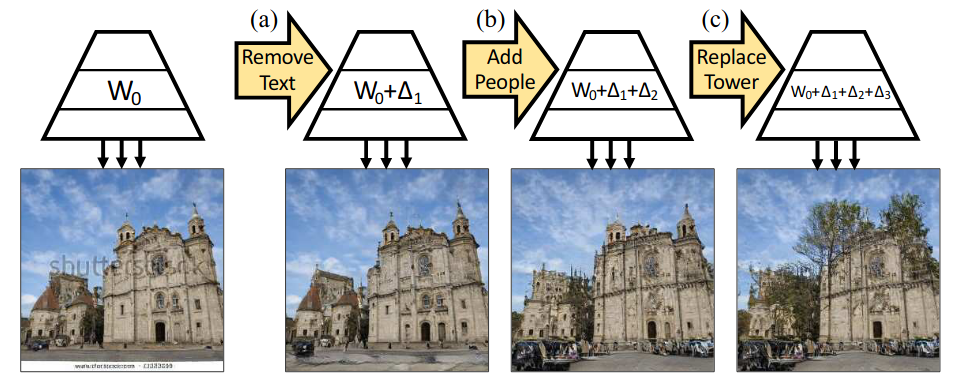

Rewriting a Deep Generative Model

(https://arxiv.org/abs/2007.15646) GAN 能夠?qū)?shù)據(jù)分布中豐富的語義和物理規(guī)則進行建模,但是到目前為止,這些規(guī)則是如何在網(wǎng)絡(luò)中編碼的,或者一個規(guī)則是如何被改變的我們還不是十分清楚。本文介紹了一種新的問題:操作由深度生成網(wǎng)絡(luò)模型編碼的特定規(guī)則。因此,給定一個生成模型,目標是調(diào)整其權(quán)重,使新的和修改后的模型遵循新的規(guī)則,并生成遵循新規(guī)則集的圖像,如下所示。

通過將網(wǎng)絡(luò)的每一層視為一個關(guān)聯(lián)存儲器,將潛在生成規(guī)則儲存為隱藏特征上的一組鍵值關(guān)系。可以通過定義約束優(yōu)化來編輯和修改模型,約束優(yōu)化在關(guān)聯(lián)性儲存器中添加或編輯一個特定規(guī)則,同時盡可能保留模型中現(xiàn)有的語義關(guān)系。論文直接通過度量和操縱模型的內(nèi)部結(jié)構(gòu)來實現(xiàn)這一點,而不需要任何新的訓(xùn)練數(shù)據(jù)。

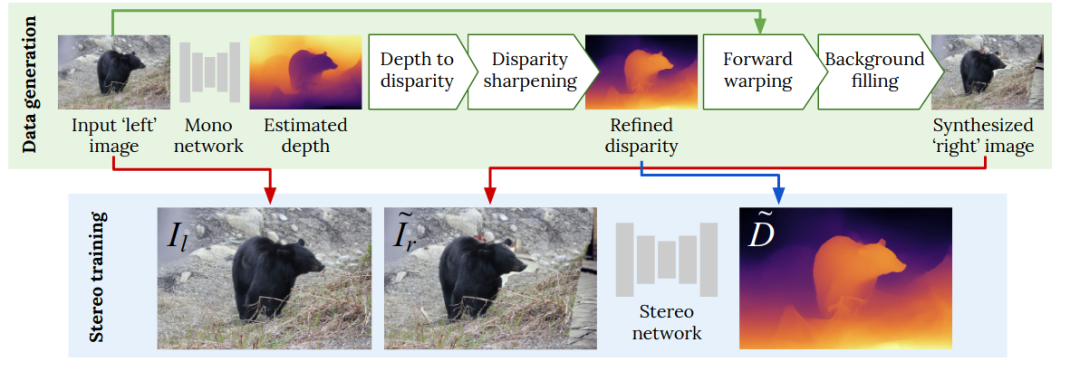

Learning Stereo from Single Images

(https://arxiv.org/abs/2008.01484) 給定一對對應(yīng)的圖像,視差匹配的目標是估計從第一視圖到第二視圖的每個像素的對應(yīng)位置之間的每像素水平位移(即視差),反之亦然。雖然全監(jiān)督的方法可以給出很好的結(jié)果,但一對視察圖像之間精確的真實視差往往很難獲得。一種可能的替代方法是對合成數(shù)據(jù)進行訓(xùn)練,然后對有限數(shù)量的實際標記數(shù)據(jù)進行微調(diào)。但是,如果沒有一個帶有足夠標簽的微調(diào)步驟,這樣的模型就不能很好地生成真實的圖像。

該文提出了一種新的、全自動的視差估計訓(xùn)練流程,通過使用圖像深度估計網(wǎng)絡(luò),該方法可以由已知深度信息的非結(jié)構(gòu)化單幅圖像生成視差估計訓(xùn)練數(shù)據(jù),這樣就無需人工合成數(shù)據(jù)或真實視差圖像對即可進行訓(xùn)練。。首先,通過使用深度視差的前向形變操作將給定的左輸入圖像轉(zhuǎn)換為合成的右圖像。然后,利用視差圖像對,以有監(jiān)督的方式對視差估計網(wǎng)絡(luò)進行訓(xùn)練,得到一個泛化的模型。

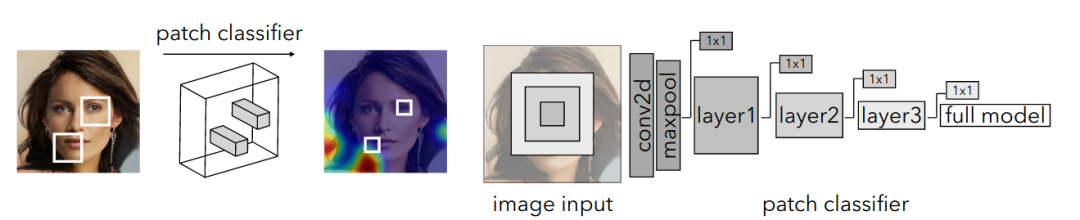

What makes fake images detectable? Understanding properties that generalize

(https://arxiv.org/abs/2008.10588) 雖然GaN生成圖像的質(zhì)量已經(jīng)達到了令人印象深刻的水平,但是經(jīng)過訓(xùn)練的深度網(wǎng)絡(luò)仍然可以檢測到生成圖像中的細微偽影,并且這種訓(xùn)練的網(wǎng)絡(luò)還可以在不同數(shù)據(jù)集和不同方法上訓(xùn)練的多個模型中發(fā)現(xiàn)相同的偽影。本文旨在可視化和理解哪些工件在模型之間是共享的,并且容易在不同的場景中檢測和轉(zhuǎn)移。

由于全局面部結(jié)構(gòu)在不同的生成器和數(shù)據(jù)集之間可能有所不同,因此生成的圖像的局部面片更加確定,并且可能產(chǎn)生冗余的偽影。為此,本文采用了一種基于區(qū)塊的全卷積分類器來關(guān)注局部區(qū)塊而不是全局結(jié)構(gòu)。然后可以使用路徑級分類器來可視化和分類在各種測試數(shù)據(jù)集中最能指示真實或虛假圖像的區(qū)塊。另外,可以對生成的圖像進行操作以夸大假圖像的特征屬性。

視覺和語言

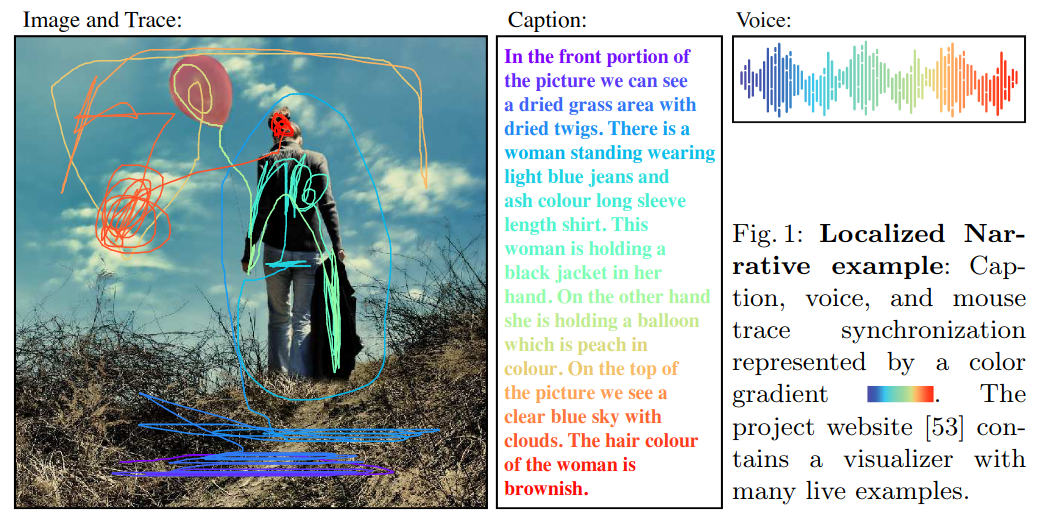

Connecting Vision and Language with Localized Narratives

(https://arxiv.org/abs/1912.03098) 連接視覺和語言的一種流行方式是圖像標題,其中每個圖像都與人類編寫的文本標題配對,但這種鏈接僅在完整的圖像尺度范圍內(nèi),其中的文本描述了整個圖像。為了改進這種若的關(guān)聯(lián),有人嘗試著將圖片標題的特定部分和圖像中的目標框聯(lián)系起來。但是,這種關(guān)聯(lián)仍然非常稀疏,大多數(shù)對象和單詞都沒有對應(yīng)的目標框,且注釋過程可能會非常昂貴。

本文提出了一種新的有效的多模態(tài)圖像標注形式,稱之為定位敘事。定位敘述是通過要求注釋者用他們的聲音描述一個圖像,同時將鼠標懸停在他們描述的區(qū)域上而生成的。例如,如上圖所示,注釋者一邊說“woman”,一邊用鼠標指示她的空間范圍,從而為這個名詞提供了視覺基礎(chǔ)。后來,他們把鼠標從女人身上移到氣球上,跟著氣球的繩子,說“holding”。這為這種關(guān)系提供了直接的視覺基礎(chǔ)。它們還描述了“晴朗的藍天”和“淺藍色牛仔褲”等屬性。由于語音與鼠標指針同步,因此可以確定描述中每個單詞的圖像位置。這以鼠標軌跡段的形式為每個單詞提供了密集視覺基礎(chǔ)。這一豐富的注釋方法具有多種形式(圖像、文本、語音和位置),可用于文本到圖像生成、視覺問答和語音驅(qū)動的環(huán)境導(dǎo)航等不同的任務(wù)。或者,為了更精細地控制任務(wù),可以在圖像的特定部分設(shè)置條件化字幕,視力不理想的人可以通過將手指懸停在圖像上來獲得特定部分的描述。

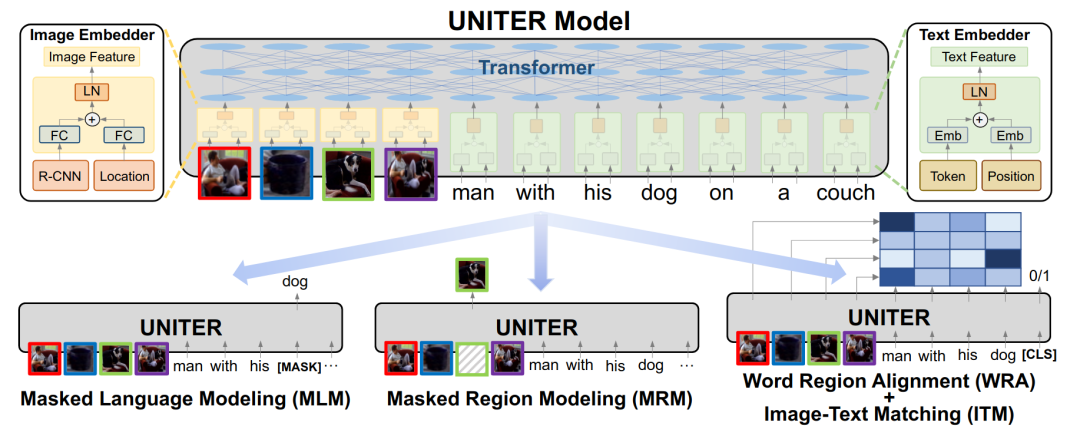

UNITER: UNiversal Image-TExt Representation Learning

(https://arxiv.org/abs/1909.11740) 大多數(shù)視覺與語言任務(wù)(V&L)如視覺問答(VQA)依賴于多模態(tài)聯(lián)合嵌入來彌補圖像和文本中視覺和文本線索之間的語義鴻溝。但是這種表示通常是為特定的任務(wù)定制的,并且需要特定的體系結(jié)構(gòu)。為了學(xué)習(xí)可用于所有V&L下游任務(wù)的通用聯(lián)合嵌入。本文介紹了一種大規(guī)模聯(lián)合多模態(tài)嵌入預(yù)訓(xùn)練模型 UNITER ,如下圖所示。在transformer模型的基礎(chǔ)上,對UNITER進行了4個任務(wù)的預(yù)訓(xùn)練:基于圖像的蒙版語言建模(MLM),利用圖像和文本特征恢復(fù)隨機蒙版單詞。以文本為條件的蒙版區(qū)域建模(MRM),即重構(gòu)給定圖像的某些區(qū)域;圖像文本匹配(ITM),即預(yù)測圖像和文本實例是否配對;以及單詞區(qū)域?qū)R(WRA),即學(xué)習(xí)最佳變換找到單詞和圖像之間的最佳對齊。為了在下游任務(wù)中使用UNITER,首先將其重新表示為分類問題,然后使用交叉熵損失對添加在[CLS]特征上的分類器進行訓(xùn)練。

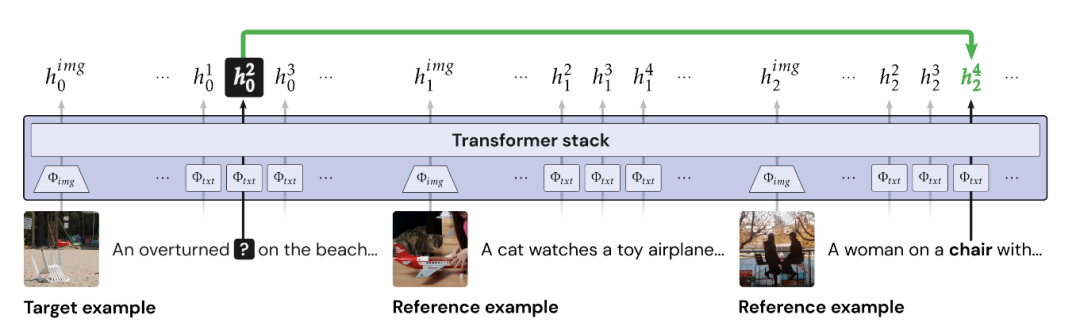

Learning to Learn Words from Visual Scenes

(https://arxiv.org/abs/1911.11237) 視覺和語言任務(wù)的標準方法是學(xué)習(xí)一個共同的嵌入空間,但是這種方法效率很低,通常需要數(shù)百萬個例子來學(xué)習(xí),對語言的自然構(gòu)成結(jié)構(gòu)的泛化很差,而且所學(xué)嵌入在推理時無法適應(yīng)新詞。因此,本文提出讓網(wǎng)絡(luò)嘗試學(xué)習(xí)單詞嵌入的過程,而不是學(xué)習(xí)單詞嵌入。

該模型基于transformer模型,在每次迭代中,該模型接收一個圖像語言對,然后元學(xué)習(xí)一個策略從該集中獲取詞表示。這就使得我們能夠在推理時獲得新單詞的表示,并且能夠更魯棒地推廣到新的描述任務(wù)中。具體來說,每一個任務(wù)都是一個語言習(xí)得任務(wù)或一個小插曲,由訓(xùn)練樣本和測試樣本組成,測試樣本對從訓(xùn)練樣本中獲得的語言進行評價。例如,在上圖中,模型需要從訓(xùn)練樣本中獲取單詞“chair”,這是它以前從未見過的單詞。元訓(xùn)練是在向前傳遞中完成的,并使得模型需要指向訓(xùn)練示例中正確的單詞“chair”,并使用匹配損失來訓(xùn)練整個模型。經(jīng)過多種事件和任務(wù)的訓(xùn)練,該模型能夠很快適應(yīng)推理過程中的新任務(wù)。 結(jié)語 讓人感到遺憾的是,論文的數(shù)量使得總結(jié)任務(wù)變得困難和耗時。所以對于其余的論文,我將簡單地列出一些我遇到的論文的標題,如果讀者對這些主題感興趣的話也方便自行查找研究(參考原文)。

責(zé)任編輯:lq

-

計算機視覺

+關(guān)注

關(guān)注

9文章

1706瀏覽量

46580 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1223瀏覽量

25283 -

遷移學(xué)習(xí)

+關(guān)注

關(guān)注

0文章

74瀏覽量

5688

原文標題:ECCV 2020 亮點摘要(下)

文章出處:【微信號:livevideostack,微信公眾號:LiveVideoStack】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

使用MATLAB進行無監(jiān)督學(xué)習(xí)

什么是機器學(xué)習(xí)?通過機器學(xué)習(xí)方法能解決哪些問題?

時空引導(dǎo)下的時間序列自監(jiān)督學(xué)習(xí)框架

如何使用 PyTorch 進行強化學(xué)習(xí)

人工智能、機器學(xué)習(xí)和深度學(xué)習(xí)存在什么區(qū)別

半監(jiān)督學(xué)習(xí),無監(jiān)督學(xué)習(xí),遷移學(xué)習(xí),表征學(xué)習(xí)以及小樣本學(xué)習(xí)

半監(jiān)督學(xué)習(xí),無監(jiān)督學(xué)習(xí),遷移學(xué)習(xí),表征學(xué)習(xí)以及小樣本學(xué)習(xí)

評論