通常,我們的人工智能系統(tǒng)都是以人的視角去構(gòu)造的,這些系統(tǒng)已經(jīng)用于自動駕駛、人臉識別、操作重型機(jī)器,甚至檢測疾病。那么,我們可以從動物的角度構(gòu)建一個智能系統(tǒng)嗎?比如讓 AI 去模擬狗的行為。

華盛頓大學(xué)與 Allen 人工智能研究所的研究人員最新的論文公開了他們開發(fā)的一種深度學(xué)習(xí)系統(tǒng),該系統(tǒng)可以訓(xùn)練并模擬狗的行為特征。研究人員表示訓(xùn)練智能機(jī)器的目標(biāo)是使其能夠充當(dāng)一個智能視覺體的角色。不過,讓智能機(jī)器充當(dāng)狗的角色這個想法是非常具有挑戰(zhàn)性的任務(wù)。

簡介

我們研究了如何直接構(gòu)建一個視覺智能體(visually intelligent agent)。通常,計算機(jī)視覺技術(shù)專注于解決與視覺智能相關(guān)的各種子任務(wù)。但我們的研究不同于這種標(biāo)準(zhǔn)的計算機(jī)視覺方法。相反,我們嘗試直接構(gòu)建一個視覺智能體,我們的模型將視覺信息作為輸入,并直接預(yù)測智能體在未來的行為。

此外,我們引入了 DECADE 數(shù)據(jù)集,這是一個以狗的視角所搜集的狗的行為數(shù)據(jù)集。利用這些數(shù)據(jù),我們可以模擬狗的行為和動作規(guī)劃方式。在多種度量方法下,對于給定的視覺輸入,我們成功地構(gòu)建了一個視覺智能體,它能夠準(zhǔn)確預(yù)測并模擬狗的行為。不僅如此,與圖像分類任務(wù)學(xué)到的特征表征相比,我們的智能體學(xué)習(xí)到的特征能夠編碼不同的信息,也可以推廣到其他領(lǐng)域。尤其需要指出的是,通過將這種狗的建模任務(wù)作為表示學(xué)習(xí),我們在可行走區(qū)域預(yù)測和場景分類任務(wù)中取得非常卓越的結(jié)果。

方法與模型

為了訓(xùn)練,研究人員使用了一個叫做 Kelp 的阿拉斯加雪橇犬,并在其腿部配備了 GoPro 相機(jī),尾部和后備箱上配備六個慣性測量傳感器,一個麥克風(fēng)以及一個把這些數(shù)據(jù)綁在一起的 Arduino 開發(fā)板。研究人員在超過 50 個不同的地點,在長達(dá)數(shù)小時的時間內(nèi),記錄了 Kelp 的活動數(shù)據(jù),如步行、追蹤、抓取,與其他狗互動以及跟蹤物體等。利用英偉達(dá)提供的 GeForce GTX 1080 GPU,TITAN X GPU 以及 cuDNN 加速的深度學(xué)習(xí)框架,研究人員用所獲得的視覺和感官信息來訓(xùn)練神經(jīng)網(wǎng)絡(luò)。

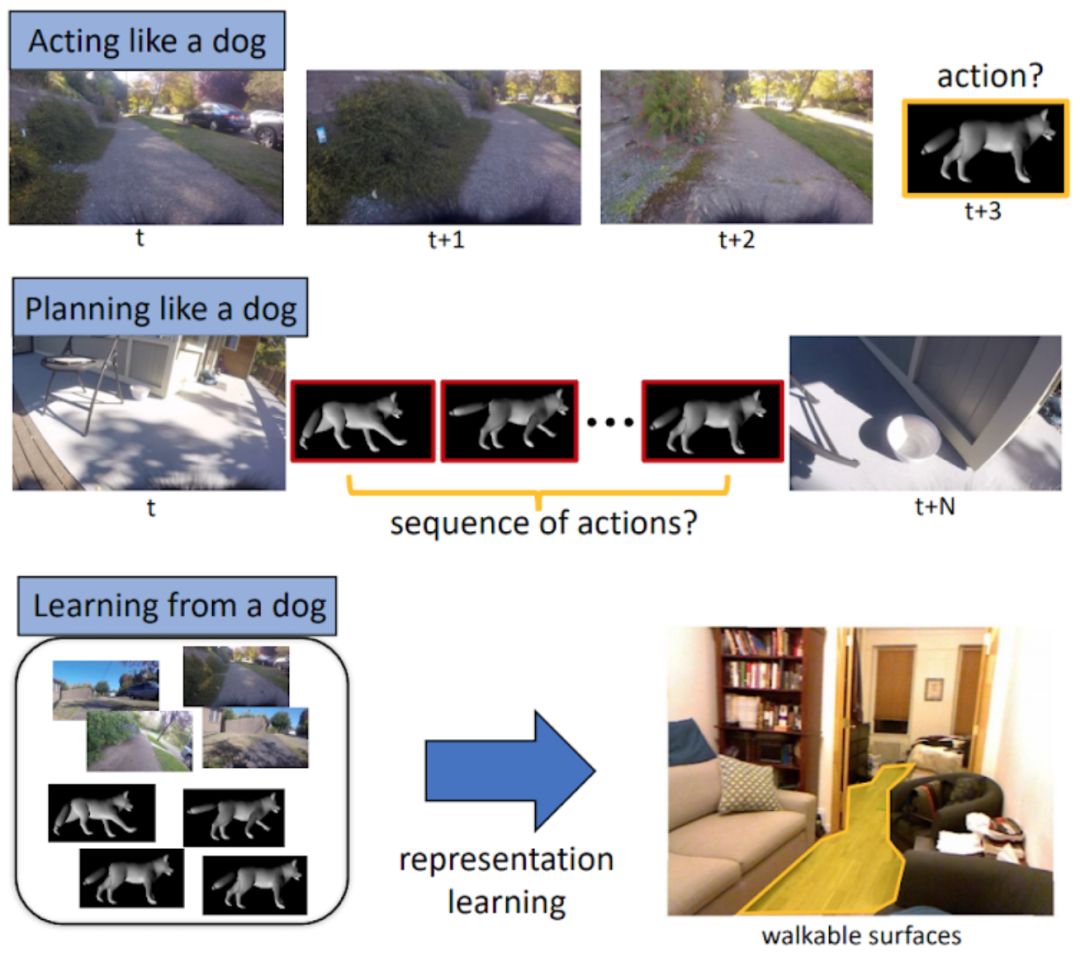

在這里,研究人員解決了三個問題:

像狗一樣行動:根據(jù)一系列先前看到的圖像,神經(jīng)網(wǎng)絡(luò)的目標(biāo)是預(yù)測狗未來的運動軌跡;

像狗一樣規(guī)劃:目標(biāo)是找到一系列動作,讓狗在給定的一對圖像的位置之間移動。

從狗身上學(xué)習(xí):我們將學(xué)習(xí)的表現(xiàn)用于第三項任務(wù)(如可行走的表面評估(Walkable surface estimation),預(yù)測狗的可行走區(qū)域)。

這些任務(wù)需要一些相當(dāng)復(fù)雜的數(shù)據(jù):例如,就像真的狗一樣,我們的 AI 系統(tǒng)必須知道,當(dāng)它需要從一個地點移動到另一地點的時候,可行走區(qū)域的位置有哪些。它不能在樹上或汽車上行走,也不能在沙發(fā)上行走(這也取決于房子)。因此,我們的模型也要學(xué)會這一點,它可以作為一個獨立的計算機(jī)視覺模型,在一張給定圖像中找出一個寵物(或一個有足機(jī)器人)所能夠到達(dá)的位置。下面我們將逐一介紹這三個任務(wù)所用到的模型結(jié)構(gòu)。

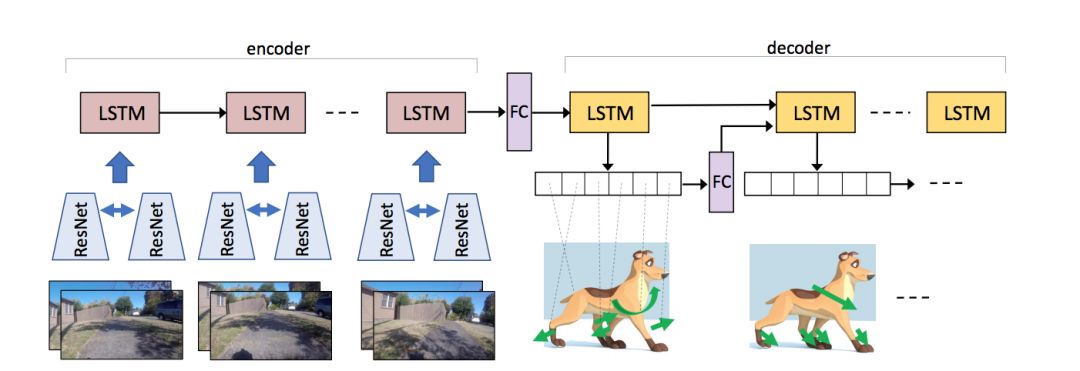

這是用于模擬狗的行為的模型結(jié)構(gòu)。這個模型是一個編碼-解碼器結(jié)構(gòu)的神經(jīng)網(wǎng)絡(luò),編碼器接收成對的圖片流作為輸入,而解碼器輸出每個節(jié)點未來的行動決策。在編碼器和解碼器之間有一個全連接層(FC),它能夠更好地捕捉區(qū)域內(nèi)的行為變化。在解碼器中,每個時步輸出的行動概率將被用于下一個時步(timestep)。我們在兩個 ResNet 中共享模型的權(quán)重參數(shù)。

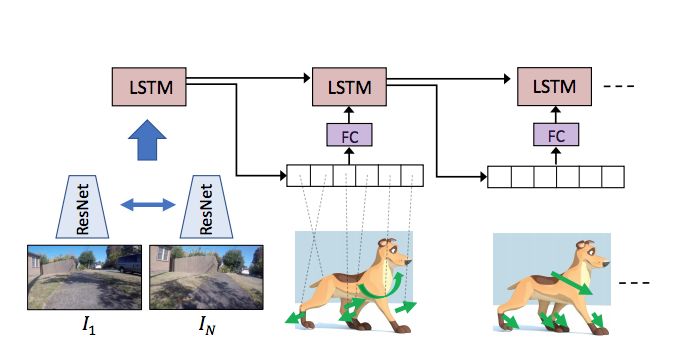

這是用于規(guī)劃狗的行為的模型結(jié)構(gòu)。這個模型是卷積神經(jīng)網(wǎng)絡(luò) CNN 和長短期記憶模型 LSTM 的結(jié)合體。模型的輸入是兩張圖片 I1 和 IN,這是在視頻系列的第 N-1 時間步截取來的數(shù)據(jù)。長短期記憶模型 LSTM 接收 CNN 的特征作為輸入,并輸出狗從 I1 移動到 IN 過程的行動序列。

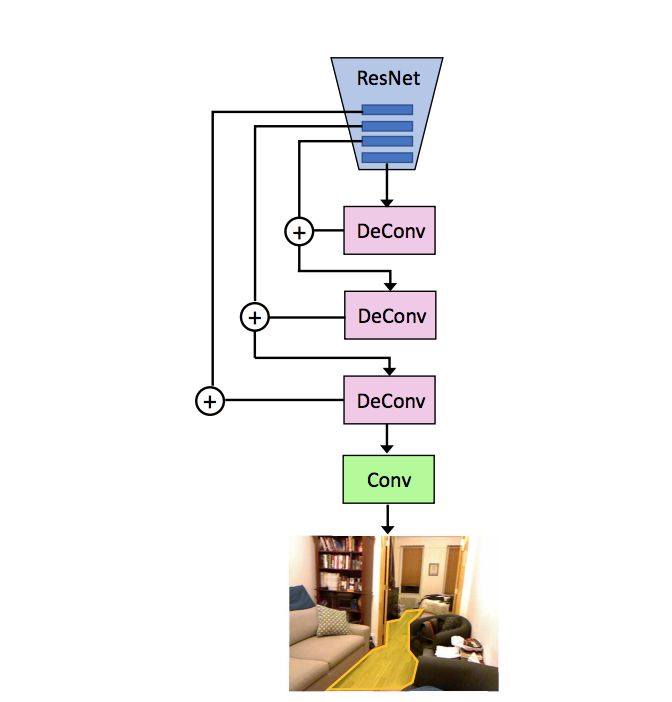

這是用于可行走區(qū)域預(yù)測的模型結(jié)構(gòu)。我們用 ResNet 模型的后四層,對其進(jìn)行卷積、反卷積來推斷可行走區(qū)域。

評估指標(biāo)

在實驗評估階段,我們使用多種不同的評價指標(biāo)來綜合地評判我們的方法,包括分類精度、混淆度(perplexity)等。

定量分析結(jié)果:我們展示了模型識別視頻中 5 幀數(shù)據(jù)的結(jié)果,視頻中一個男人開始向一只狗投擲一個球。在視頻中,當(dāng)球飛向那只狗時,狗會向右方移動以躲避球飛過來的方向。僅僅使用這 5 幀數(shù)據(jù),模型就能夠在球飛來時準(zhǔn)確地預(yù)測出狗的移動方向。

實驗結(jié)果

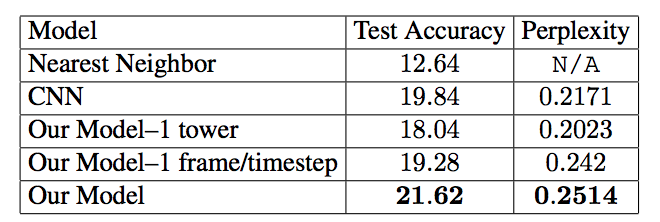

“像狗一樣行動”的結(jié)果: 我們觀察了 5 幀的視頻序列并預(yù)測了接下來的 5 個動作。

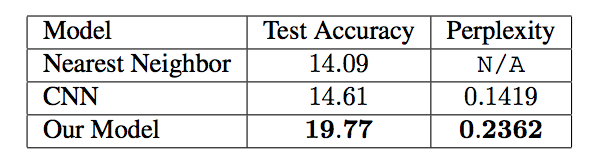

“像狗一樣規(guī)劃”的結(jié)果:在開始和結(jié)束幀之間進(jìn)行規(guī)劃, 我們考慮了相隔 5 步的起始圖像。

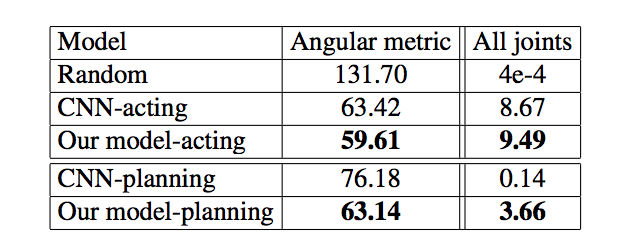

持續(xù)評估和全節(jié)點評估。在第一欄中數(shù)值越低越好,在第二欄中數(shù)值越高越好。

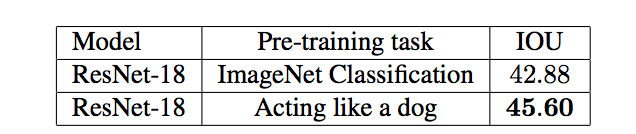

“步行式表面評估”結(jié)果。我們將在 ImageNet 上訓(xùn)練的網(wǎng)絡(luò)結(jié)果與為我們做任務(wù)訓(xùn)練的網(wǎng)絡(luò)進(jìn)行了比較。 評估指標(biāo)是 IOU。

實驗結(jié)果表明,我們的模型能夠在不同的情況下學(xué)習(xí)并模擬狗的行為,并像狗一樣的規(guī)劃并采取行動。

在研究報告中,研究人員指出,“狗的行動空間比人類要簡單得多,這使得我們的任務(wù)更加易于處理。然而,它們能夠清楚地表現(xiàn)出智能視覺的能力,如識別食物、障礙物、其他人類和動物,并對這些輸入做出相應(yīng)地反應(yīng),但我們對于這些行為的目標(biāo)和動機(jī)常常知之甚少。”

未來展望

研究人員提到,他們的評估實驗顯示出有趣而富有希望的結(jié)果。他們的模型可以在各種情況下預(yù)測狗的行為,并能像狗一樣采取行動,還能像狗一樣計劃如何從一種狀態(tài)轉(zhuǎn)移到另一種狀態(tài)。

在未來的應(yīng)用中,研究團(tuán)隊表示這只是一個初步的實驗。他們打算從多只狗身上收集更多數(shù)據(jù)(建立多樣的數(shù)據(jù)庫),并考慮引入更多的感官信息,如找到一些捕捉聲音、觸覺和嗅覺的方法。他們希望這項工作能夠為人類更好理解視覺智能和生物智能奠定基礎(chǔ)。

-

AI

+關(guān)注

關(guān)注

88文章

34781瀏覽量

277135 -

人工智能

+關(guān)注

關(guān)注

1805文章

48899瀏覽量

247977 -

測量傳感器

+關(guān)注

關(guān)注

0文章

55瀏覽量

13533

原文標(biāo)題:AI變身記:不光能有人的智能,還要像狗一樣“思考”

文章出處:【微信號:AI_Thinker,微信公眾號:人工智能頭條】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

是否可以將智能插頭直接連接到將充當(dāng)控制器的imx8mm?

傅利葉借助NVIDIA Isaac Gym開發(fā)人形機(jī)器人GR-2

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗】2.具身智能機(jī)器人的基礎(chǔ)模塊

《具身智能機(jī)器人系統(tǒng)》第10-13章閱讀心得之具身智能機(jī)器人計算挑戰(zhàn)

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗】+兩本互為支持的書

單軸測徑儀也可以智能化

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗】2.具身智能機(jī)器人大模型

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗】1.初步理解具身智能

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗】1.全書概覽與第一章學(xué)習(xí)

《具身智能機(jī)器人系統(tǒng)》第7-9章閱讀心得之具身智能機(jī)器人與大模型

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗】+數(shù)據(jù)在具身人工智能中的價值

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗】+初品的體驗

《具身智能機(jī)器人系統(tǒng)》第1-6章閱讀心得之具身智能機(jī)器人系統(tǒng)背景知識與基礎(chǔ)模塊

康謀分享 | 在基于場景的AD/ADAS驗證過程中,識別挑戰(zhàn)性場景!

智能機(jī)器也可以充當(dāng)狗的角色?這個想法非常有挑戰(zhàn)性

智能機(jī)器也可以充當(dāng)狗的角色?這個想法非常有挑戰(zhàn)性

評論