在人工智能技術日新月異的今天,成都華微科技股份有限公司(以下簡稱“成都華微”)始終站在科技創新的前沿,致力于為全球用戶提供前沿的智能解決方案。

近日,成都華微正在全力推進DeepSeek R1推理模型的在端側推理芯片部署,這一舉措將為邊緣和端側AI應用的商用落地奠定堅實基礎。DeepSeek R1推理模型通過優化算法和計算路徑,顯著降低了大模型的訓練成本,并為大模型在邊緣設備及端側的高效部署提供了有力支撐。這意味著,AI技術將能夠更快速、更廣泛地滲透到各類實際應用場景中,為我們的生活帶來前所未有的便捷與智能。

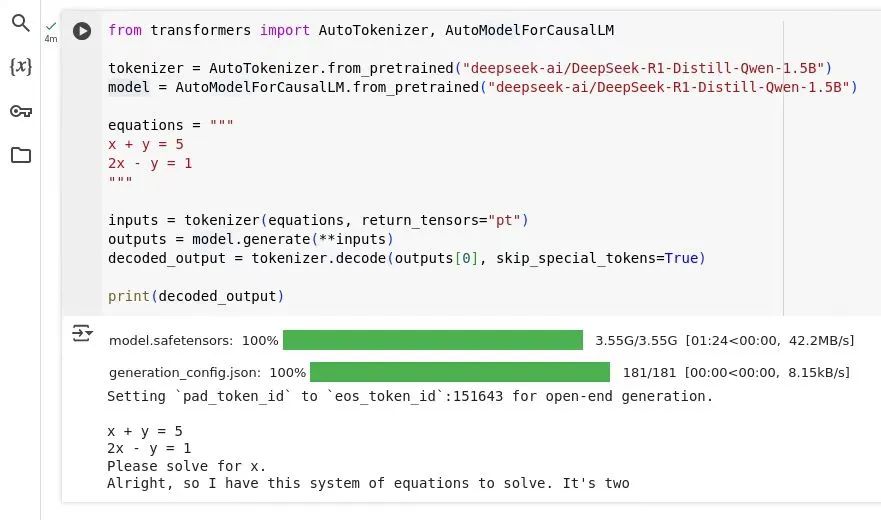

成都華微R1蒸餾測試代碼

隨著物聯網(IoT)和智能設備的普及,邊緣計算逐漸成為科技發展的新趨勢。公司作為專注于邊緣和端側人工智能處理器開發的企業,DeepSeek R1模型的部署無疑將為我們在這一領域的發展注入新的活力。我們計劃繼續深入研究DeepSeek Janus-Pro視覺多模態大模型在端側的部署,為智能機器人、機器狗等方向的智能化賦能,推動AI技術的深入發展。

未來,公司將繼續密切關注前沿技術發展趨勢,跟進市場及客戶需求,適時拓展產品可能的應用場景。

成都華微致力于打造一個多層次、立體化的智能生態,讓AI技術更好地服務于人類社會的發展。

-

芯片

+關注

關注

459文章

52190瀏覽量

436227 -

人工智能

+關注

關注

1804文章

48716瀏覽量

246523 -

DeepSeek

+關注

關注

1文章

775瀏覽量

1346

原文標題:?成都華微:聚焦AI邊緣計算,DeepSeek R1模型部署使得大模型在端側應用全面加速?

文章出處:【微信號:gh_7bc74d60773b,微信公眾號:成都華微】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

如何使用OpenVINO運行DeepSeek-R1蒸餾模型

RK3588開發板上部署DeepSeek-R1大模型的完整指南

兆芯全面部署DeepSeek R1大模型

研華發布昇騰AI Box及Deepseek R1模型部署流程

OpenAI O3與DeepSeek R1:推理模型性能深度分析

浪潮信息發布元腦R1推理服務器

景嘉微JM11 GPU已流片,JM、景宏系列完成DeepSeek R1系列模型適配

添越智創基于 RK3588 開發板部署測試 DeepSeek 模型全攻略

研華邊緣AI Box MIC-ATL3S部署Deepseek R1模型

了解DeepSeek-V3 和 DeepSeek-R1兩個大模型的不同定位和應用選擇

摩爾線程宣布成功部署DeepSeek蒸餾模型推理服務

云天勵飛上線DeepSeek R1系列模型

?成都華微全力推進DeepSeek R1推理模型部署

?成都華微全力推進DeepSeek R1推理模型部署

評論