據(jù)報(bào)道,2023年5月14日,OpenAI正式公布其最新人工智能模型GPT-4o,預(yù)計(jì)其將于數(shù)周內(nèi)在OpenAI的各類產(chǎn)品中逐步實(shí)現(xiàn)集成。尤其值得關(guān)注的是,GPT-4o將向所有用戶免費(fèi)開(kāi)放。

OpenAI首席技術(shù)官穆里·穆拉蒂(Muri Murati)指出,GPT-4o具備與GPT-4相同的智能水平,且在文本、圖像及語(yǔ)音處理方面有顯著進(jìn)步。他在OpenAI總部的主題演講中表示:“GPT-4o能整合語(yǔ)音、文本和視覺(jué)信息進(jìn)行推理。”GPT-4是OpenAI先前的旗艦?zāi)P停瞄L(zhǎng)處理圖像和文本混合信息,如從圖像中提取文字或描述圖像內(nèi)容等任務(wù);而GPT-4o在此基礎(chǔ)上增加了語(yǔ)音處理功能。

GPT-4o的運(yùn)行速度將得到極大提高,其中最大亮點(diǎn)為其語(yǔ)音交互模式采用了創(chuàng)新技術(shù)。OpenAI一直致力于使用戶能以語(yǔ)音方式與ChatGPT進(jìn)行交流,如同與真人對(duì)話一樣。然而,早期版本因延遲問(wèn)題影響了對(duì)話的沉浸感。GPT-4o采用全新技術(shù),使得聊天機(jī)器人的響應(yīng)速度大幅度提升。

IT之家觀察到,發(fā)布會(huì)現(xiàn)場(chǎng)OpenAI展示了GPT-4o進(jìn)行語(yǔ)音對(duì)話的實(shí)例。演示者提問(wèn)后,GPT-4o幾乎能立即作出回應(yīng),并通過(guò)文本轉(zhuǎn)語(yǔ)音功能進(jìn)行朗讀,使對(duì)話更具真實(shí)感。

另一演示展示了GPT-4o根據(jù)需求調(diào)整語(yǔ)調(diào)的能力,GPT-4o能根據(jù)指令改變聲音,從夸張戲劇到冰冷機(jī)械,表現(xiàn)出卓越的可塑性。最后,演示還展示了GPT-4o的歌唱功能。

過(guò)去,OpenAI發(fā)布新版ChatGPT模型時(shí),往往將其設(shè)為付費(fèi)服務(wù)。此次GPT-4o將對(duì)所有用戶免費(fèi)開(kāi)放,付費(fèi)用戶則享有五倍的調(diào)用額度。

此外,OpenAI還發(fā)布了桌面版ChatGPT和新的用戶界面。穆拉蒂表示:“我們意識(shí)到這些模型正在變得日益復(fù)雜,因此我們希望用戶與人工智能模型的交互體驗(yàn)更為自然、輕松,讓他們能專注于與模型的協(xié)作,而不必過(guò)多關(guān)注界面本身。”

-

圖像

+關(guān)注

關(guān)注

2文章

1092瀏覽量

41030 -

人工智能

+關(guān)注

關(guān)注

1804文章

48717瀏覽量

246540 -

GPT

+關(guān)注

關(guān)注

0文章

368瀏覽量

15942 -

OpenAI

+關(guān)注

關(guān)注

9文章

1202瀏覽量

8644

發(fā)布評(píng)論請(qǐng)先 登錄

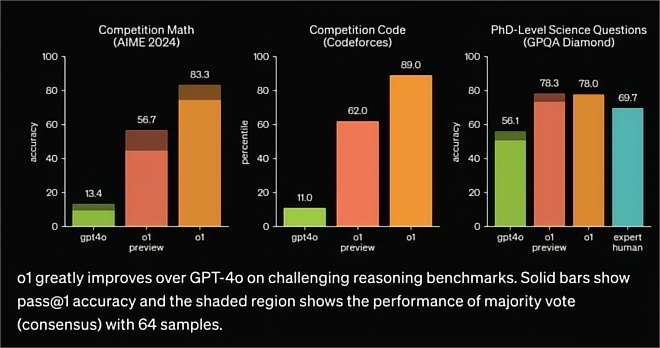

OpenAI發(fā)布o1大模型,數(shù)理化水平比肩人類博士,國(guó)產(chǎn)云端推理芯片的新藍(lán)海?

從性能到商業(yè),Grok3、GPT-4o、DeepSeek如何重塑AI版圖?

OpenAI簡(jiǎn)化大模型選擇:薩姆·奧特曼制定路線圖

OpenAI報(bào)告GPT-4o及4o-mini模型性能下降,正緊急調(diào)查

OpenAI:GPT-4o及4o-mini模型性能下降,正展開(kāi)調(diào)查

OpenAI正式推出Canvas:寫(xiě)作編碼新平臺(tái),支持Python

解鎖 GPT-4o!2024 ChatGPT Plus 代升級(jí)全攻略(附國(guó)內(nèi)支付方法)

Orion模型即將面世,OpenAI采用新發(fā)布模式

OpenAI解鎖GPT-4o定制功能,助力企業(yè)精準(zhǔn)優(yōu)化AI應(yīng)用

OpenAI提前解鎖GPT-4o語(yǔ)音模式,引領(lǐng)對(duì)話新紀(jì)元

OpenAI向部分用戶推出GPT-4o語(yǔ)音模式產(chǎn)品

OpenAI 推出 GPT-4o mini 取代GPT 3.5 性能超越GPT 4 而且更快 API KEY更便宜

OpenAI發(fā)布高性價(jià)比小型AI模型GPT-4o mini

OpenAI發(fā)布最新人工智能模型——GPT-4o mini

國(guó)內(nèi)直聯(lián)使用ChatGPT 4.0 API Key使用和多模態(tài)GPT4o API調(diào)用開(kāi)發(fā)教程!

OpenAI發(fā)布GPT-4o模型,供全體用戶免費(fèi)使用

OpenAI發(fā)布GPT-4o模型,供全體用戶免費(fèi)使用

評(píng)論