在OpenAI研發(fā)出Sora后不久,谷歌Deep Mind團(tuán)隊(duì)公開(kāi)了在世界模型領(lǐng)域的新進(jìn)展——基礎(chǔ)世界模型Genie。該模型主要借鑒非對(duì)抗方式進(jìn)行訓(xùn)練,可根據(jù)各類(lèi)圖像乃至草圖生成具有豐富動(dòng)作表現(xiàn)的2D世界,從而實(shí)現(xiàn)人們與虛構(gòu)世界的深度互動(dòng)。只需輸入一張圖像,Genie便可構(gòu)建一個(gè)全新的交互環(huán)境。

DeepMind指出,Genie有能力根據(jù)最新的文生圖大模型生成初始幀,再借助Genie的能力賦予這些圖像更深層次的含義。Genie作為一個(gè)包含110億參數(shù)的基礎(chǔ)世界模型,成功研發(fā)得益于谷歌聲名在外的潛在動(dòng)作模型,用于推斷視頻幀間的運(yùn)動(dòng),視頻分詞器則可以將原始視頻幀轉(zhuǎn)化為離散標(biāo)記,而動(dòng)態(tài)模型則負(fù)責(zé)預(yù)測(cè)下一幀的活動(dòng)情況。

值得注意的是,相較于號(hào)稱(chēng)“高清晰度、高真實(shí)感”的Sora, Genie似乎更注重潛在行為的預(yù)測(cè),而不是極力展現(xiàn)畫(huà)面的真實(shí)性。現(xiàn)階段,從圖像或文本中生成高質(zhì)量視頻尚未成為Genie關(guān)注的核心業(yè)務(wù)點(diǎn)。DeepMind進(jìn)一步透露,Genie主要圍繞“2D平臺(tái)類(lèi)游戲及大約率算法”展開(kāi)應(yīng)用,這種處理方法具有廣泛適應(yīng)性,可應(yīng)用于各領(lǐng)域,也可以擴(kuò)展至更大規(guī)模的互聯(lián)網(wǎng)數(shù)據(jù)集。

然而,這個(gè)還在試驗(yàn)階段的Genie尚不能視為商業(yè)產(chǎn)品問(wèn)世。據(jù)DeepMind人士解釋?zhuān)珿enie的訓(xùn)練視頻為160x90像素且每秒僅10幀的超低分辨率視頻,生成的模擬游戲以每秒1幀的速率運(yùn)行。因此,實(shí)際場(chǎng)景更為復(fù)雜且要求更高實(shí)時(shí)性的商業(yè)應(yīng)用仍需耐心等待解決方案。

-

DeepMind

+關(guān)注

關(guān)注

0文章

131瀏覽量

11343 -

genie

+關(guān)注

關(guān)注

0文章

7瀏覽量

4325 -

OpenAI

+關(guān)注

關(guān)注

9文章

1200瀏覽量

8617 -

大模型

+關(guān)注

關(guān)注

2文章

3011瀏覽量

3790

發(fā)布評(píng)論請(qǐng)先 登錄

盤(pán)點(diǎn)#機(jī)器人開(kāi)發(fā)平臺(tái)

【「# ROS 2智能機(jī)器人開(kāi)發(fā)實(shí)踐」閱讀體驗(yàn)】視覺(jué)實(shí)現(xiàn)的基礎(chǔ)算法的應(yīng)用

【「# ROS 2智能機(jī)器人開(kāi)發(fā)實(shí)踐」閱讀體驗(yàn)】機(jī)器人入門(mén)的引路書(shū)

大象機(jī)器人攜手進(jìn)迭時(shí)空推出 RISC-V 全棧開(kāi)源六軸機(jī)械臂產(chǎn)品

名單公布!【書(shū)籍評(píng)測(cè)活動(dòng)NO.58】ROS 2智能機(jī)器人開(kāi)發(fā)實(shí)踐

普渡機(jī)器人接入DeepSeek滿血版模型

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗(yàn)】2.具身智能機(jī)器人的基礎(chǔ)模塊

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗(yàn)】2.具身智能機(jī)器人大模型

【「具身智能機(jī)器人系統(tǒng)」閱讀體驗(yàn)】1.初步理解具身智能

《具身智能機(jī)器人系統(tǒng)》第7-9章閱讀心得之具身智能機(jī)器人與大模型

Google DeepMind發(fā)布Genie 2:打造交互式3D虛擬世界

名單公布!【書(shū)籍評(píng)測(cè)活動(dòng)NO.51】具身智能機(jī)器人系統(tǒng) | 了解AI的下一個(gè)浪潮!

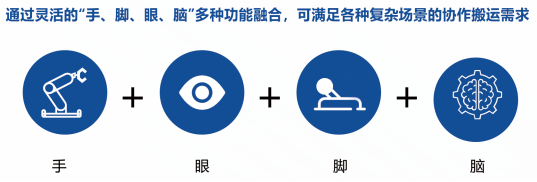

引領(lǐng)通用具身新時(shí)代:普渡發(fā)布首款類(lèi)人形機(jī)器人PUDU D7

智能移動(dòng)機(jī)器人

谷歌公布基礎(chǔ)模型Genie,主攻2D平臺(tái)類(lèi)游戲及機(jī)器人應(yīng)用

谷歌公布基礎(chǔ)模型Genie,主攻2D平臺(tái)類(lèi)游戲及機(jī)器人應(yīng)用

評(píng)論