論騷操作,硅谷恐怕沒有CEO能比得上黃仁勛。

去年,黃仁勛向微軟、谷歌和亞馬遜這些云計算廠商提出了一個計劃:這些廠商都有很多搭載了英偉達GPU的服務器,由英偉達租用這些服務器,然后讓英偉達的工程師對其進行“優化”,再以英偉達的名義租給普通的AI企業,從中賺取差價。

說簡單點,以前微軟會直接把云服務賣給中小公司,現在由英偉達進來當中間商。當然按照英偉達官方的說法,此舉是為了“向云計算廠商展示在數據中心配置GPU的正確方法”[1]。

服務器還是那個服務器,但經過英偉達“優化”后,客戶就從微軟優化到英偉達了。但就是這樣一個匪夷所思的提議,除了亞馬遜之外,各大云計算廠商居然都同意了。

2023年3月,英偉達正式上線云計算服務DGX Cloud。事實證明,經過英偉達工程師的優化后,DGX Cloud在訓練大模型時表現得的確更好;在此基礎上,英偉達還破例允許短期租賃。僅僅半年時間,英偉達就拿下了軟件公司ServiceNow等大客戶。

科技公司愿意配合英偉達騷操作的真實原因,可能還是因為英偉達手中握有大模型時代最稀缺的資源——H100。

當下,幾乎所有的企業都沒有足夠的算力。連OpenAI創始人阿爾特曼,都曾在一次聽證會上無奈地表示:“如果人們減少使用ChatGPT,我們會非常高興,因為我們的GPU非常短缺[2]。”

買了多少H100,甚至可以成為決定AI成就的關鍵因素。這也讓英偉達有了“挾H100以令諸侯”的底氣。

計算機的“稀土”

通常來說,科技企業會通過購買云計算廠商的服務,來滿足算力需求。從2023年3月開始,微軟Azure、亞馬遜AWS等云計算廠商也先后上架了HGX H100的租賃服務,HGX H100是由4個或8個H100組成的服務器。

然而,當下供需嚴重失衡,云計算廠商這點H100存貨已經遠遠滿足不了市場的胃口。2023年H1的財報中,微軟專門更新了一條風險因素:如果無法獲得足夠多的AI芯片,云計算業務可能會中斷。

許多初創公司需要排隊等待3-12個月,一旦友商搶在自己前面,那可能就是幾十上百億估值的損失。

無數“H100窮人”們,只能被迫發揮主觀能動性,看誰的路子更野。

面對《紐約時報》的采訪,一位創業者將H100比作“稀土”。早些時候,他跑去請求美國國家科學基金會投資自己,僅僅因為基金會底下一個項目剛好有少數空置的H100。

在硅谷,AI創業者打招呼的方式,都變成了“我認識一個有H100的家伙”——不知道的還以為在買賣毒品[4]。

GPU Utils曾測算過H100搶購潮背后具體的需求數據:

對需要自己訓練大模型、追求大力出奇跡的企業來說,沒有個上萬塊H100都不好意思出門。由前DeepMind聯合創始人蘇萊曼創辦的InflectionAI,成立方才一年,已買了2.2萬個H100;至于Meta這樣財大氣粗的公司,很可能會購買10萬個甚至更多。

對微軟Azure等云計算廠商來說,每一家也都需要至少3萬個H100。而其余幾家私有云,還將消耗總計約10萬個H100。

測算后發現,僅美國大型科技公司和少數幾家明星初創公司,需求量已達到約43萬個[5]。如果再算上其他初創企業、研究機構、大學,乃至富裕國家的追逐、再加之黃牛、黑市等不可控因素,實際需求很可能遠大于這個數字。然而據英國《金融時報》爆料,今年H100的出貨量大約是55萬個[6]。

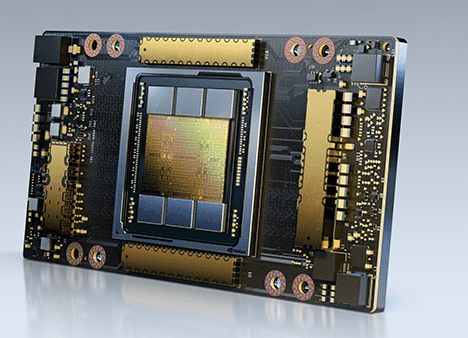

H100之所以令人如饑似渴,其中一個核心原因在于其近乎壟斷的市場地位。

面對大模型訓練對極致效率的需求,H100在大多數情況下都是最優解。

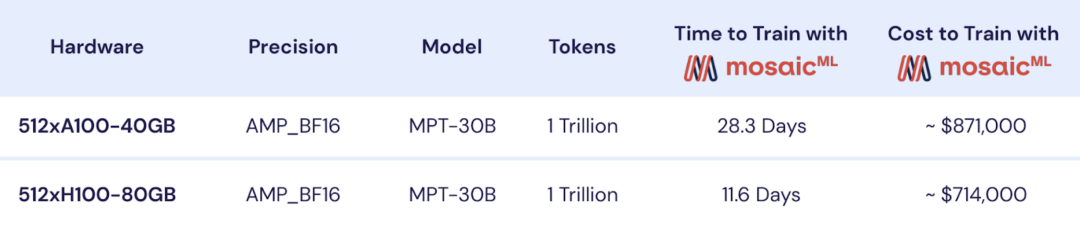

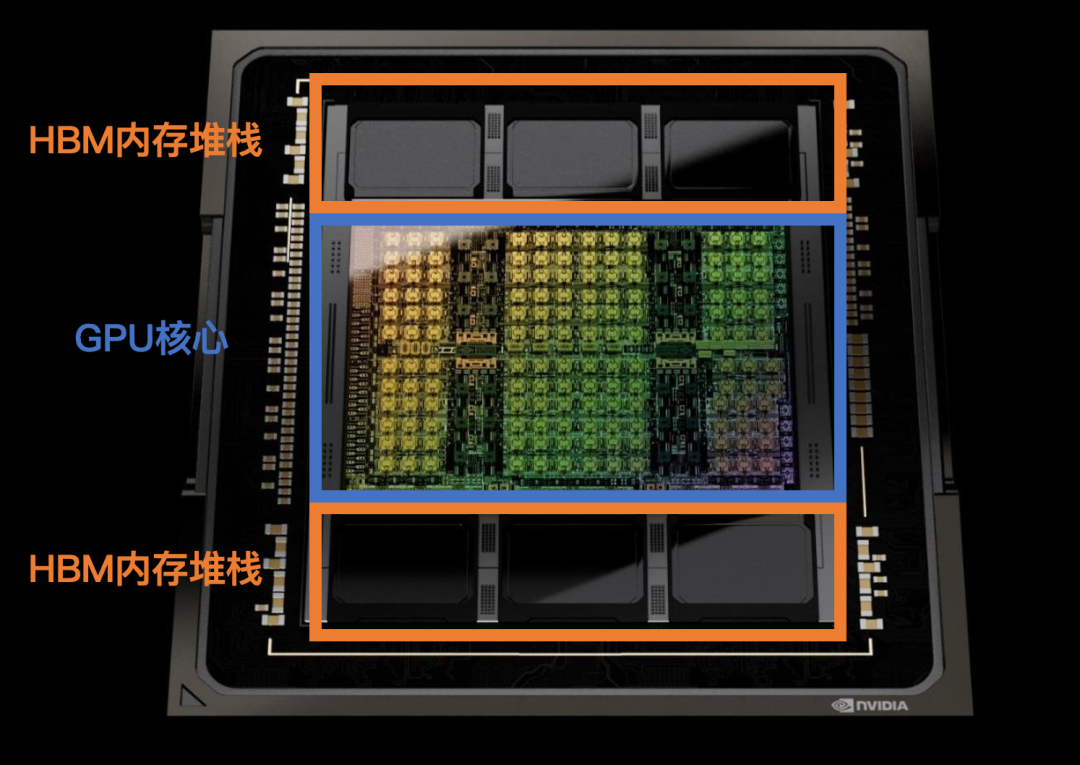

MPT-30B是第一個使用H100訓練的開源LLM(大語言模型),實際訓練只耗費了11.6天;相比之下,使用前一代的A100訓練則需要28.3天[7]。如若換成參數規模更龐大的AI,例如1800B的GPT-4,效率差異會更加明顯。跑馬圈地的時代,時間就是一切。

除此之外,H100在模型推理上的效率也遠高于A100。盡管H100的首發價約為3.3萬美元,如今二手市場價格更上漲至4-5萬美元;但若將H100和A100的性能分別除以各自的價格,能發現H100的性價比實際也高于A100。

MPT-30B的具體訓練、推理情況

黃仁勛說,“Buy more GPUs , the more money you save(買得多,省得多)”,似乎不無道理。

也正因為如此,即便美國限制了H/A100的對華出口,國內科技公司仍在搶購閹割版的H/A800——盡管閹割版的芯片間數據傳輸速度只有前者一半,意味著需要在大模型訓練上花費更多時間。

除需求量龐大之外,造成H100短缺的另一個原因是產能的嚴重不足。

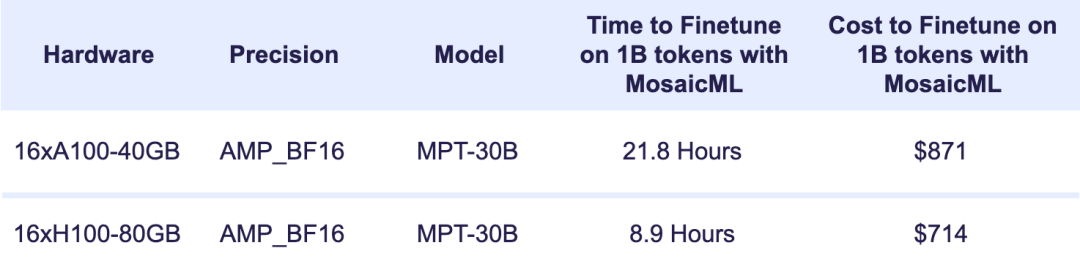

H100芯片需要使用SK海力士的HBM內存,以及臺積電的CoWoS封裝——兩者都因過于昂貴,此前并沒能大規模市場化,預備產能并不多。由于產能爬坡尚需時間,有分析師預測H100的短缺至少會持續至明年一季度,也有人認為要到明年年底才有可能有所緩解[9]。

H100內部結構

H100的空前盛況,讓黃仁勛在短短一年時間內體驗了一回坐過山車的感覺。

去年二季度,消費市場萎靡不振加上挖礦企業扎堆倒閉,英偉達交出了一份不及格的財報,“GPU滯銷,幫幫我們”的表情包一度遍地都是。一年之后,黃仁勛成功向資本市場展示了什么叫“反向暴雷”,同比營收暴漲854%,大幅超出了最樂觀分析師的預測。

巔峰換來了漫天的吹捧,但黃仁勛心里清楚,英偉達的頭上一直懸著一把劍。

不可避免的戰爭

今年8月,傳奇工程師吉姆·凱勒對媒體評論道,“我不認為GPU是運行AI的全部,世界憎惡壟斷[11]。”

此番發言雖有給自家AI芯片打廣告之嫌,卻也是業界的共識。

事實上,那些購買了最多H100的大型科技公司,基本都不太“安分”:微軟、谷歌、Meta,或多或少都嘗試過自研AI芯片。

這讓英偉達面臨著一個異常尷尬的處境:在AI芯片領域,自己與“大客戶”之間,未來幾乎必有一戰。

大型科技公司們選擇自研AI芯片,最初都源于一個非常質樸的需求——省錢,其中最典型的便是谷歌。

早在2014年,谷歌已啟動了自研芯片計劃。彼時,OpenAI的首席科學家伊利亞還在谷歌工作,打造出了一套頗具顛覆性的AI模型。該模型脫胎于伊利亞的“大力出奇跡”理念,只需要灌入足夠多且正確的數據,它便能更好地完成翻譯、語音識別等工作。然而待到實際應用時,谷歌卻犯了難:

如果將AI服務安裝至10億多臺安卓手機中,哪怕每個人每天只使用3分鐘,谷歌都需要2倍于當前數據中心的算力。當時谷歌已經建了15個數據中心,每個造價上億美金,“超級加倍”顯然不切實際。

最終,谷歌自研出了性能更強、功耗更低的TPU,大大提升了單個數據中心的算力供應,以一種更經濟實惠的方式解決了算力難題。

TPU的出現,令黃仁勛如坐針氈,開始了“爆改GPU”,很快在性能上實現了反超,其最新成果便是H100。不過,H100的售價實在過于昂貴。

如果按重量售賣H100,那么其每盎司售價將達到黃金的一半;即便對地球上最賺錢的科技公司而言,這筆“英偉達稅”也堪稱天文數字。

然而,H100的實際制造成本并不高。據金融咨詢公司Raymond James測算,H100的成本約為3320美金,僅占首發價的1/10,黃仁勛含淚賺10倍[12]。

自研芯片的經濟收益毋庸置疑,但除此之外其實還有另一個好處:垂直整合打造差異化。

堆疊算力不是簡單的往車里加汽油,需要考慮軟件適配性、自身業務需求等一系列問題。例如AI所使用的深度學習框架有多個派別,谷歌是TensorFlow,Meta用的PyTorch,而百度則有PaddlePaddle,硬件需要根據不同框架做適配。

專門定制的AI芯片,可以更加緊貼自身AI業務的需求。所以Meta在今年又重啟了自研芯片計劃,針對PyTorch框架定制了全新的MTIA芯片。

對大公司來說,考量芯片的核心其實不是算力,而是“單位美元提供的算力”,也就是成本。谷歌的TPU和特斯拉的Dojo都證明了,定制服務的成本是可以接受的。

眼下,“反抗的星火”已經點燃。據外媒爆料,大型科技公司的云計算團隊,已開始頻繁勸說客戶改用其自研芯片,而不是英偉達的GPU。英偉達固然是目前為止絕對的贏家,但沒人知道平衡什么時候會被打破。

不過,面對這場不可避免的戰爭,英偉達也留了后手。

挾H100以令諸侯

英偉達打出的第一張牌,叫CoreWeave。

CoreWeave成立于2017年,最初是一家以太坊挖礦公司,后來轉型做起了云計算業務。據CoreWeave創始人透露,2022年公司收入為3000萬美金,僅有微軟Azure的1/1133,在硅谷幾乎沒什么存在感。

然而到了2023年,CoreWeave突然一夜成名,接連簽下Inflection AI和Stability AI兩個大客戶,年營收預計將達到5億美金,一年翻16倍。除此之外,微軟甚至決定在未來幾年花費數十億美金購買其服務;其中僅2024年的訂單,已有20億美金。

改變CoreWeave命運的貴人,正是英偉達。

今年4月,英偉達參與了對CoreWeave的投資;但比起美元,英偉達還給了它一項更稀有的資源——H100。CoreWeave是全球第一家上線HGX H100租賃服務的云計算企業,比微軟Azure還要早一個月。

這番安排,其實是黃仁勛的有意為之。

H100近乎壟斷的市場地位加之嚴重短缺的現狀,讓英偉達手中多了一層權力:他可以自由決定優先供貨的對象。

相比自己跟Big Tech們同床異夢的塑料友誼,CoreWeave和英偉達是實打實的革命戰友。因此,英偉達削減了對大型科技公司的H100供應,轉而將這部分產能交給了CoreWeave等“自家兄弟”——它們曾確保不會自研芯片。

從結果來看,這一戰略不僅避免了囤積現象的出現,也確實搶到了大型科技公司的蛋糕:

例如前文提到的Stability AI,在2022年底時一直將亞馬遜AWS視作唯一云服務商;然而到了今年3月,困于算力不足的Stability AI,悄悄叩開了CoreWeave的大門。

事實上,英偉達手中并非僅有CoreWeave一張牌。這位手握H100的投資人,還投資了同為云計算公司的Lambda Labs,以及三家從事大模型、應用開發的明星初創企業。

在畝產十萬大模型的當下,H100是比美元還珍貴的硬通貨,也為英偉達創造了一個寶貴的窗口期:盡可能讓更多公司用上H100,趁早建立起生態,“把朋友搞得多多的”。

那么這個窗口期能持續多久呢?

尾聲

英偉達的一系列“騷操作”已經引來了美國反壟斷機構的注意,同時,全球瘋搶H100的現狀,很可能不會長期持續下去。

正如前文所述,H100產能受限是因為臺積電和SK海力士的預備產能不足;隨著新產線陸續落地,短缺狀況會逐漸得到緩解。

除此之外,旺盛的需求也未必會延續下去。

事實上,越來越多的科技公司和研究機構都選擇將大模型開源。隨著市場上的優質開源模型越來越多,初創企業和研究機構可以不必再自己動手訓練,轉而直接下載開源模型,根據自身業務需求進行開發或者推理。

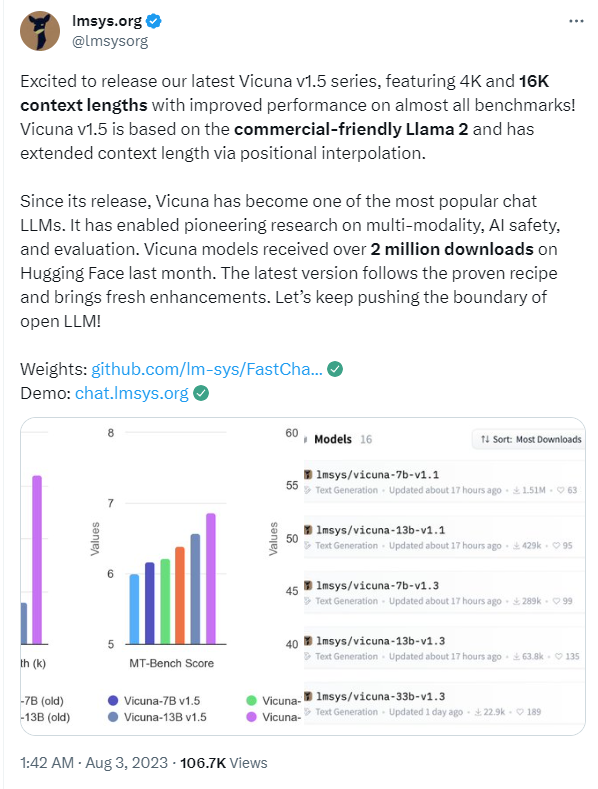

Meta發布開源大模型Llama后,斯坦福、卡內基梅隆等多所高校的研究人員就曾聯合起來,以此為基礎打造了開源大模型Vicuna,很快便突破了200萬次下載。

Vicuna

在肉眼可見的未來,算力的主要使用場景很可能會從訓練轉向推理——屆時,H100便不再是獨孤求敗了。因為不同于追求極致效率的訓練場景,AI推理其實更看重性價比。

另一方面,以大模型為代表的生成式AI如今面臨的問題在于:面對高昂的算力成本,除了英偉達,大家都還沒賺到錢。

2006年CUDA平臺推出時,英偉達以超脫于行業的前瞻性推動了AI的飛速進步。而如今,英偉達氣勢如虹的業績似乎也是一種拷問:它是不是已經從AI的推動者,變成了AI前進的阻力?

-

云計算

+關注

關注

39文章

7965瀏覽量

139223 -

英偉達

+關注

關注

22文章

3910瀏覽量

93023 -

AI芯片

+關注

關注

17文章

1965瀏覽量

35663

原文標題:英偉達的反擊:挾H100以令諸侯

文章出處:【微信號:IC大家談,微信公眾號:IC大家談】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

GPU 維修干貨 | 英偉達 GPU H100 常見故障有哪些?

特朗普要叫停英偉達對華特供版 英偉達H20出口限制 或損失55億美元

英偉達H100芯片市場降溫

亞馬遜云科技宣布Amazon EC2 P5e實例正式可用 由英偉達H200 GPU提供支持

英偉達或取消B100轉用B200A代替

英偉達的反擊:挾H100以令諸侯

英偉達的反擊:挾H100以令諸侯

評論