本篇測評由電子發燒友的優秀測評者“HonestQiao”提供。

01.

評測規劃

米爾MYD-Y6ULX-V2開發板上帶有SIM卡的插槽,于是結合我之前的使用米爾板子的經驗,想制作一個遠程監控的平臺。

不過通過硬件手冊了解到,板子自身不帶有LTE模塊,需要安裝一個Mini PCI-E接口的LTE 模塊才能夠使用4G網絡,且僅支持僅支持移遠EC20型號。

而手頭暫時沒有這個型號的LTE模塊,于是退而且其次,使用有線網絡來進行數據的傳輸。

這塊板子的full鏡像,提供了通過V4L對USB攝像頭的支持,直接插接上USB攝像頭就能使用了。

最終,具體的評測規劃如下:

使用米爾MYD-Y6ULX-V2開發板提供攝像頭監控數據

使用OLED呈現開發板的設備負載、IP地址和服務信息

使用PyQT5開發監控顯示界面

使用opencv進行人臉識別檢測

02.

硬件準備

- 海康威視USB攝像頭

使用USB連接的攝像頭即可

- SSD1306 OLED

MYD-Y6ULX-V2開發板支持IIC和SPI通訊,我手頭正好有合適的IIC通訊的SSD1306 OLED用上 ?

?

- USB2TTL

開始使用MYD-Y6ULX-V2開發板的時候,需要使用串口連接做一些基礎的設置 ?

?

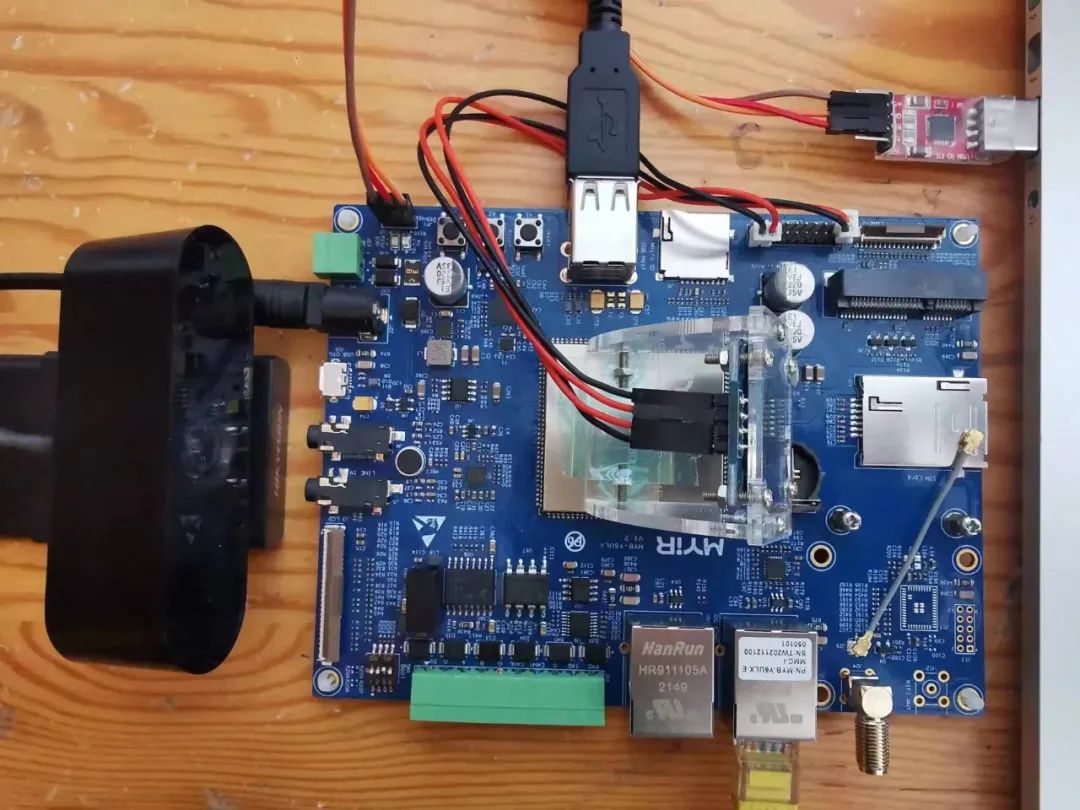

- 米爾MYD-Y6ULX-V2開發板

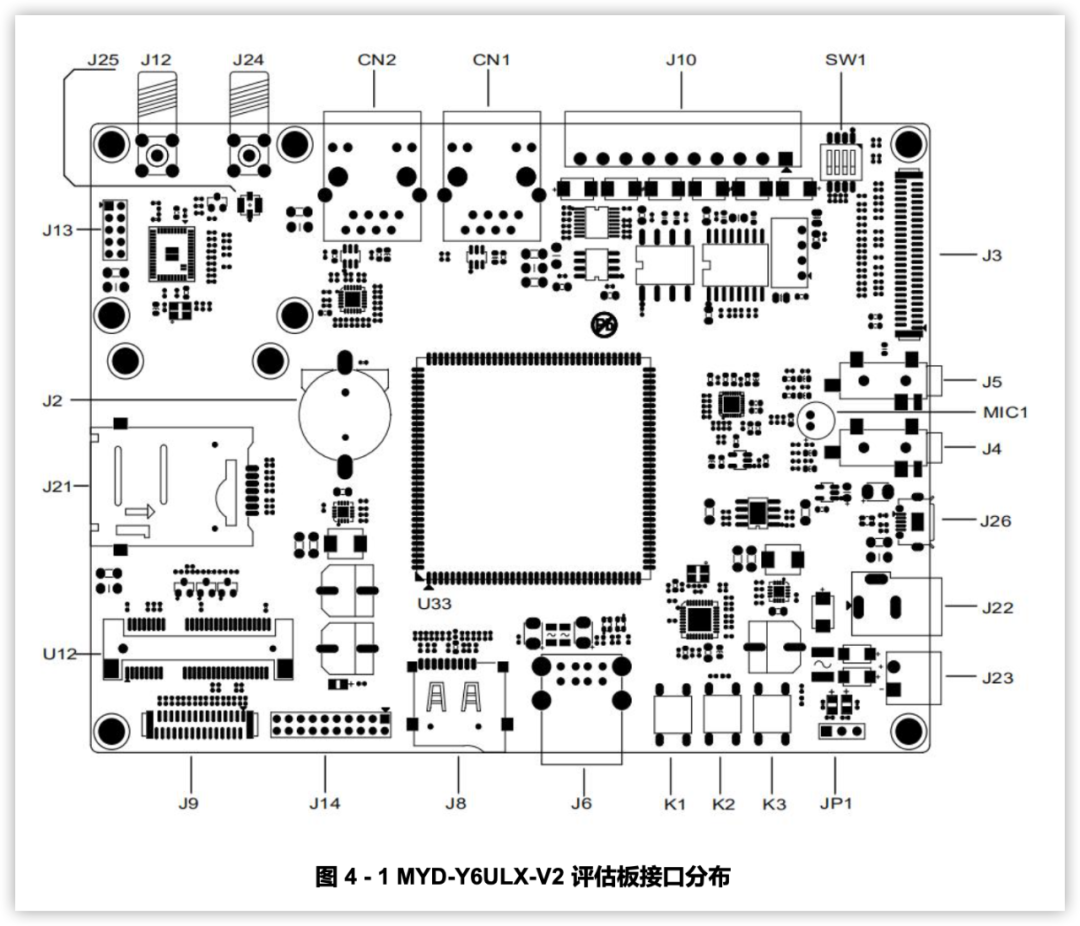

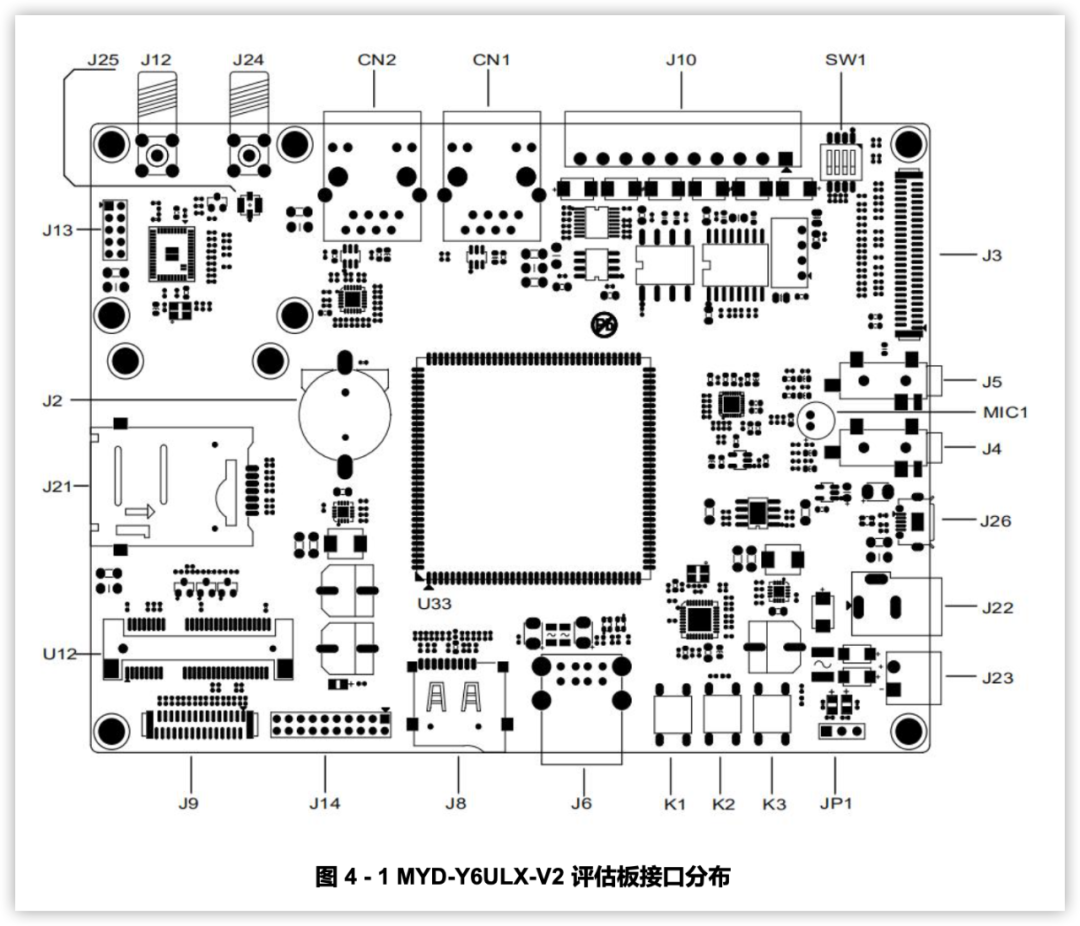

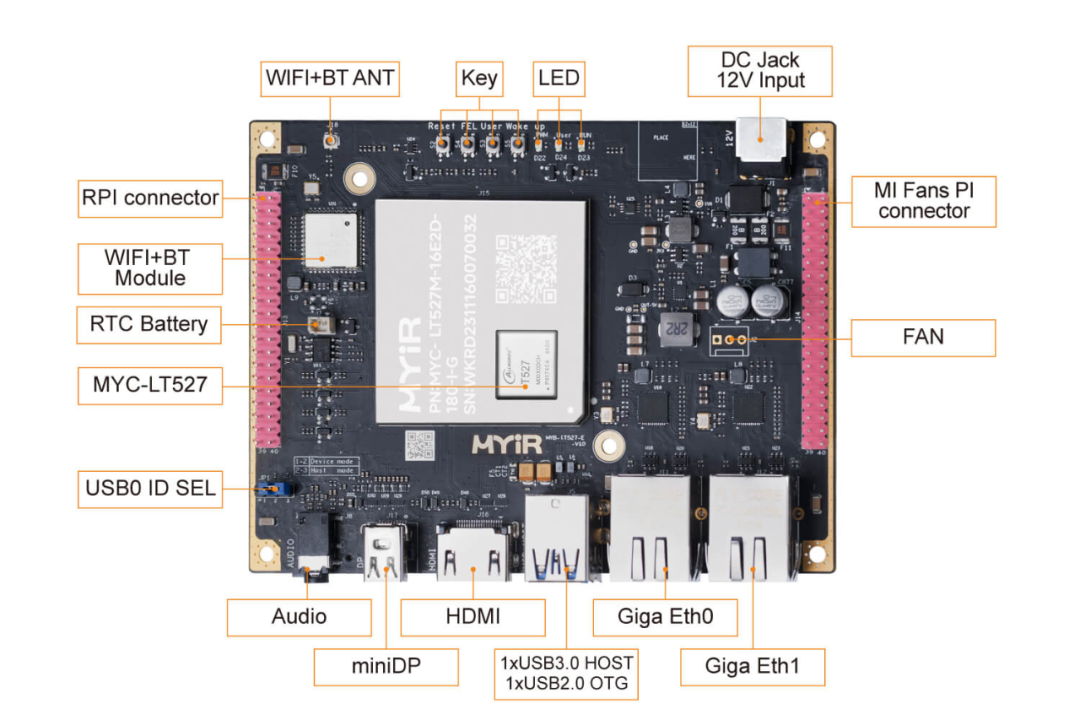

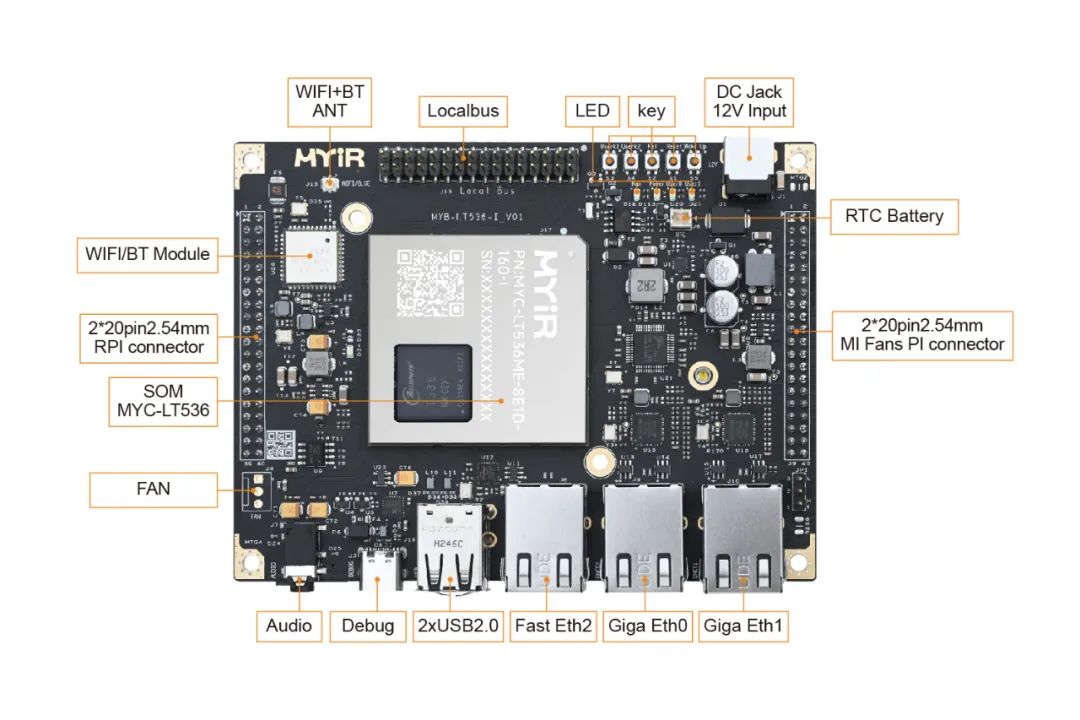

將以上設備都連接到開發板以后,具體如下: 具體的配置連線,后續會進行說明;具體的接口分布如下:

具體的配置連線,后續會進行說明;具體的接口分布如下: MYD-Y6ULX-V2開發板默認已經少錄了系統,但是屬于較老的版本,我們需要自己燒錄為最新的版本。

MYD-Y6ULX-V2開發板默認已經少錄了系統,但是屬于較老的版本,我們需要自己燒錄為最新的版本。

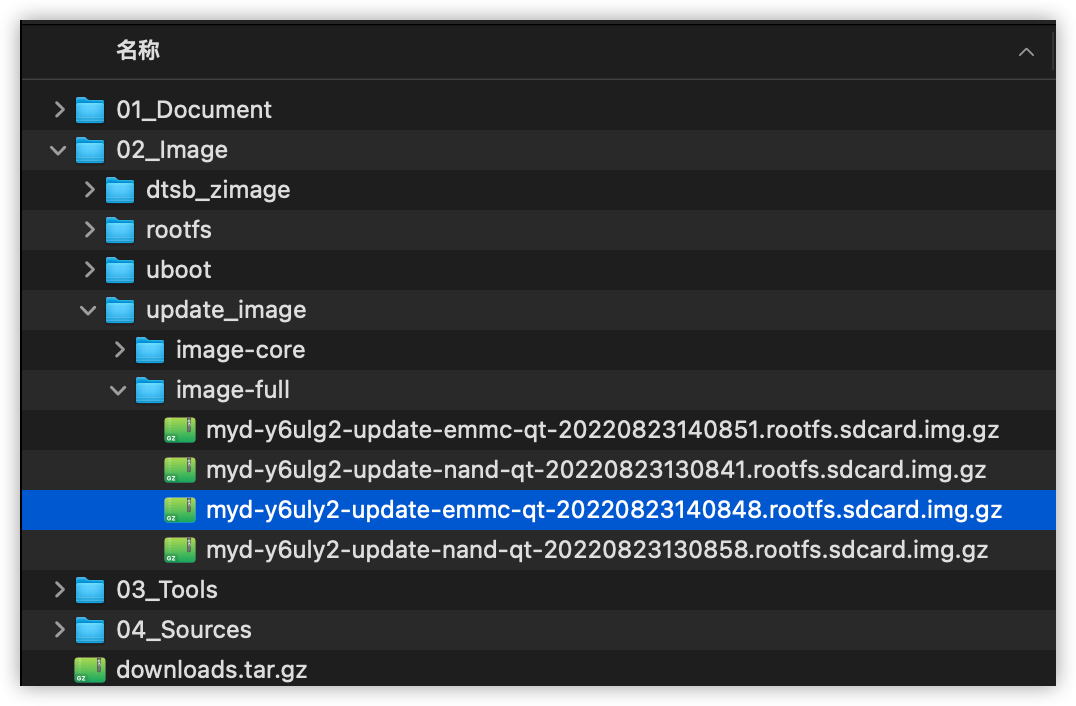

根據使用手冊,選用如下的鏡像,并按照手冊設定好啟動方式,進行燒錄更新。

- 鏡像類型:

FullEMMC ?

?

- 燒錄方式:

述鏡像需要先解壓,然后使用官方提供的Win32 Disk Imager燒錄到SD卡,然后接到開發板上 ?

?

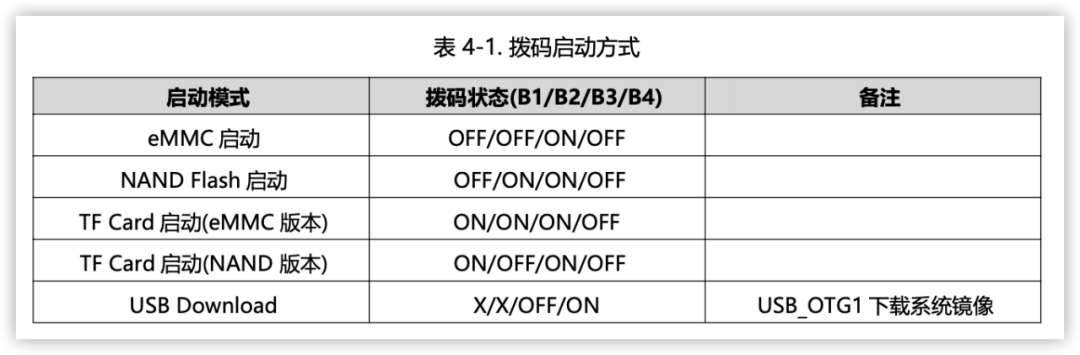

- 撥碼開關

MYD-Y6ULX-V2開發板有幾個不同的子型號,以及設置不同的啟動方式的時候,需要通過板載的撥碼開關來控制。我評測的開發板,為eMMC版本,所以更新選擇TF Card啟動(eMMC版本)模式,具體如下: ?

?

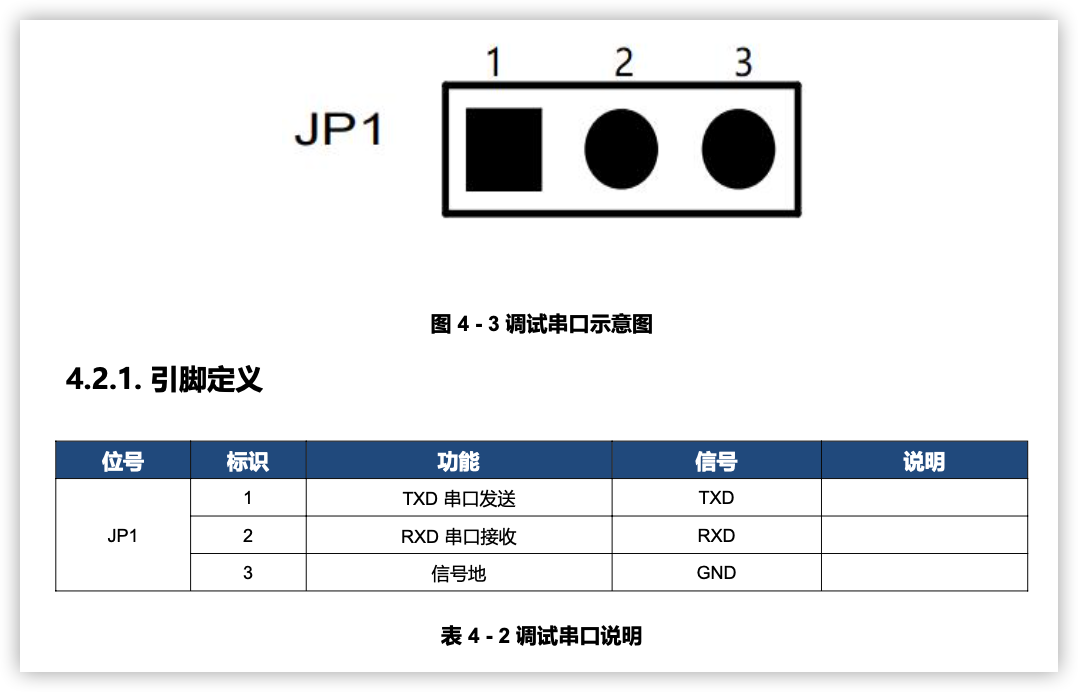

- 連接調試串口:

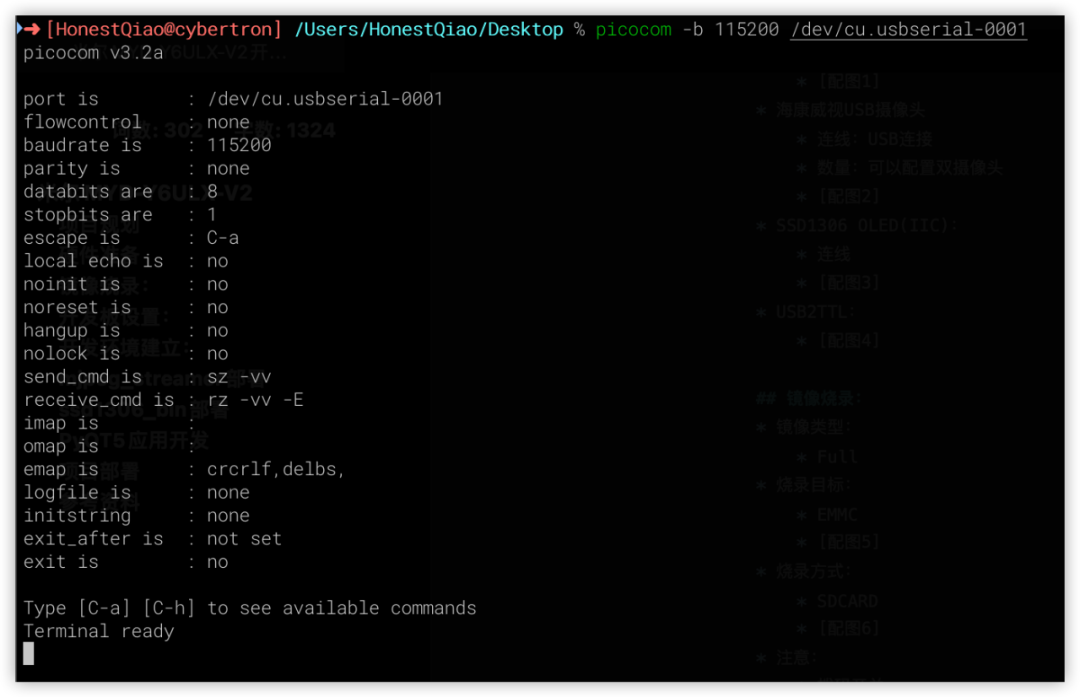

參考之前的接口分布,使用USB2TTL連接開發板的調試串口和電腦: 在電腦端,使用串口終端工具進行連接:Windows系統可以視同使用Putty或者mobaxterm,Linux和macOS系統可以使用minicom或者picocom我用的是macOS,所以使用picocom連接:

在電腦端,使用串口終端工具進行連接:Windows系統可以視同使用Putty或者mobaxterm,Linux和macOS系統可以使用minicom或者picocom我用的是macOS,所以使用picocom連接: ?

?

- 燒錄:

關機裝狀態下,插好SD卡后,重新上電開機,就會自動啟動,并進刷機狀態,并輸出正在升級的提示信息。升級需要一段時間,請耐心等待。

- 驗證:

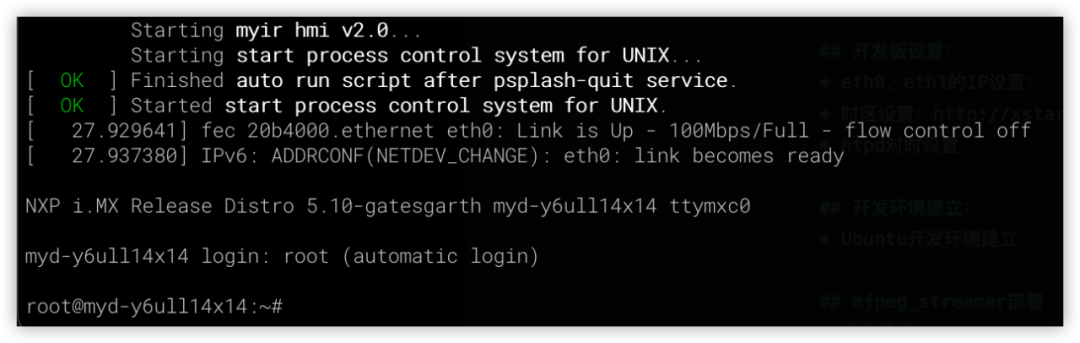

更新成功后,斷電,然后將撥碼開關設置回eMMC啟動模式,重啟上電開機,最終會看到如下的啟動信息,其中NXP i.MX Release Distro 5.10-gatesgarth表示已經更新到了當前系統: ?

?

在更新完畢后,需要對開發板進行一些基礎的設置,以方便后續進一步操作。

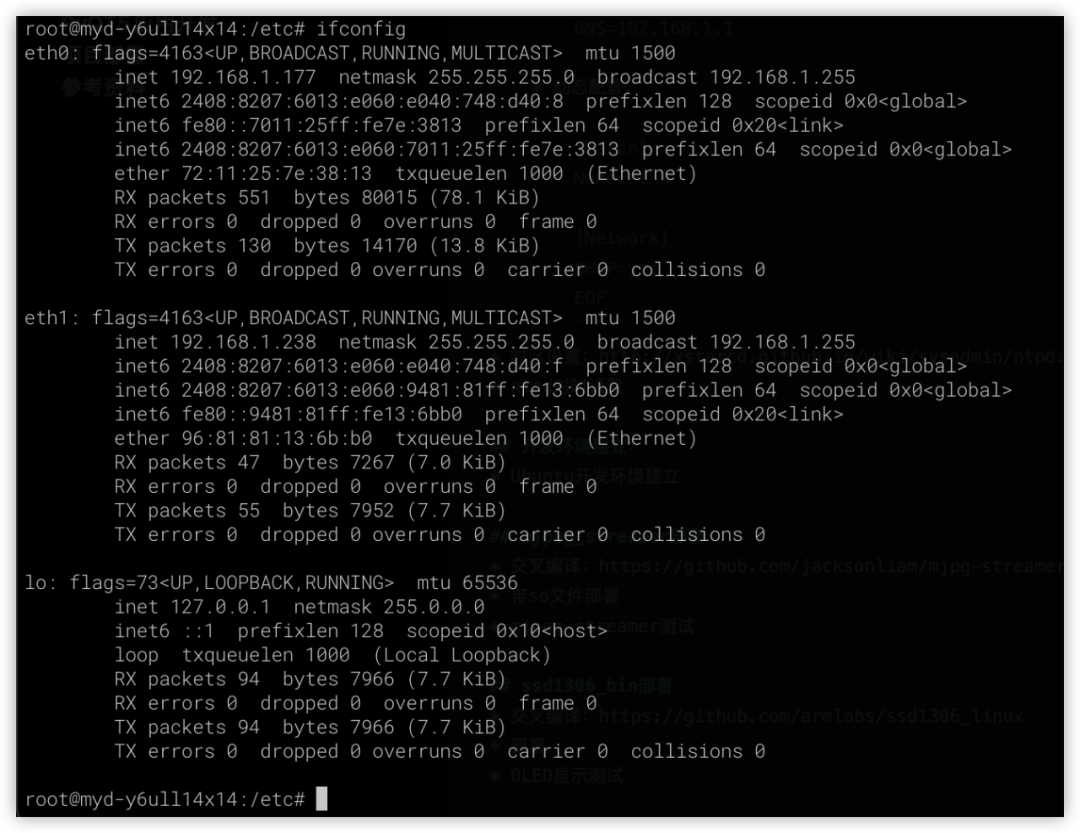

- eth0、eth1的IP設置:

參考:7.2. 通用網絡配置

使用vi修改文件:/etc/systemd/network/10-static-eth0.network使用vi修改文件:/etc/systemd/network/11-static-eth1.network靜態配置示例如下:

[Match]Name=eth0[Network]Address=192.168.1.177/24Gateway=192.168.1.1DNS=192.168.1.1

動態配置示例如下:

[Match]Name=eth0

[Network]DHCP=yesEOF

配置后,可以重啟網絡服務,然后查看結果:

service systemd-networkd restartifconfig

?

?

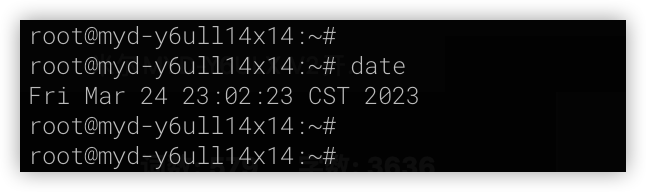

時區設置:

參考:ntpd時鐘同步服務使用vi修改:/etc/sysconfig/clock

ZONE="Asia/Shanghai"UTC=trueARC=false

cp /usr/share/zoneinfo/Asia/Shanghai /etc/localtime

ntpd對時設置

參考:ntpd時鐘同步服務使用vi修改:/etc/sysconfig/ntpd

# Drop root to id 'ntp:ntp' by default.OPTIONS="-u ntp:ntp -p /var/run/ntpd.pid"# Set to 'yes' to sync hw clock after successful ntpdateSYNC_HWCLOCK=yes #make no into yes; BIOS的時間也會跟著修改# Additional options for ntpdateNTPDATE_OPTIONS=""

使用vi修改:/etc/ntp.conf

重啟服務生效:

service ntpd restart

date

查看結果:

?

?

遠程連接:

以上設置完成后,就可以在其他電腦上,使用ssh遠程連接,來連接開發板了。然后,在其他電腦上,使用ssh工具進行遠程連接:

Windows系統可以視同使用Putty或者mobaxterm,Linux和macOS系統可以直接使用ssh命令

米爾為MYD-Y6ULX-V2開發板提供了詳細的開發環境建立的指導,參考《MYD-Y6ULX_Linux軟件開發指南.pdf》即可完成所需要的工作。

開發環境需要在一個Ubuntu環境下建立,而不是開發板自身的系統上。

Ubuntu開發環境建立

從開發板的資料包頁面,下載光盤鏡像:http://down.myir-tech.com/MYD-Y6ULX/,也可以從百度網盤下載相應的資料包。

首先安裝基礎工具包,并進行工作目錄的構建:

sudo apt-get install gawk wget git-core diffstat unzip texinfo gcc-multilib build-essential chrpath socat cpio python3 python3-pip python3-pexpect xz-utils debianutils iputils-ping python3-git python3-jinja2 libegl1-mesa libsdl1.2-dev

mkdir -p ~/MYD-Y6ULX-develexport DEV_ROOT=~/MYD-Y6ULX-devel

sudo mkdir /media/cdimagesudo mount -o loop ~/Downloads/MYD-Y6ULX_L5.10.9_20220826.iso /media/cdimagecp -r /mnt/cdimage/02_Images $DEV_ROOT/cp -r /mnt/cdimage/03_Tools $DEV_ROOT/cp -r /mnt/cdimage/04_Sources $DEV_ROOT/

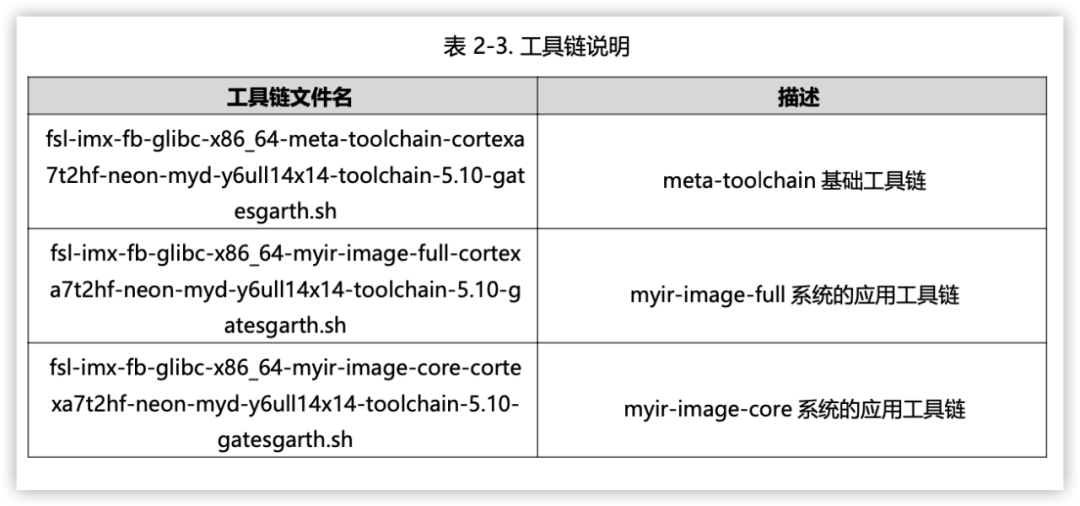

安裝編譯鏈編譯鏈:根據手冊的說明,使用full系統的應用工具鏈,以便進行應用的交叉編譯

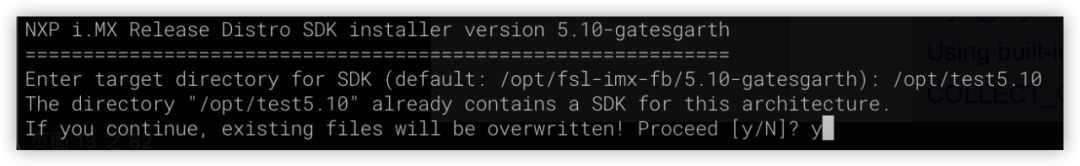

cd $DEV_ROOT/03_Tools/Tools_chain/bash fsl-imx-fb-glibc-x86_64-myir-image-full-cortexa7t2hf-neon-myd-y6ull14x14-toolchain-5.10-gatesgarth.sh

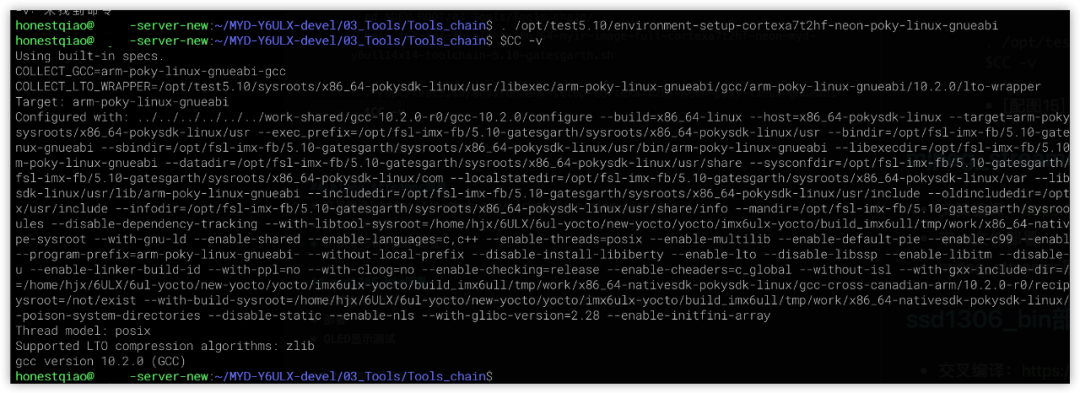

. /opt/test5.10/environment-setup-cortexa7t2hf-neon-poky-linux-gnueabi$CC -v

安裝編譯工具鏈時的提示:安裝到/opt/test5.10目錄

安裝完成后的驗證:

要使用到攝像頭,并對外提供監控數據,使用mjpg_streamer最合適了。

在網上也有不少 iMX6移植原版mjpeg-streamer的文章可供參考,不過我查看后大受誤導。

直接使用我之前的版本,進過簡單的修改,就能使用MYD-Y6ULX-V2開發板的編譯工具鏈進行成功編譯了。

mjpg_streamer分支版本:https://github.com/jacksonliam/mjpg-streamer

下載地址:https://github.com/jacksonliam/mjpg-streamer/archive/refs/heads/master.zip

交叉編譯:

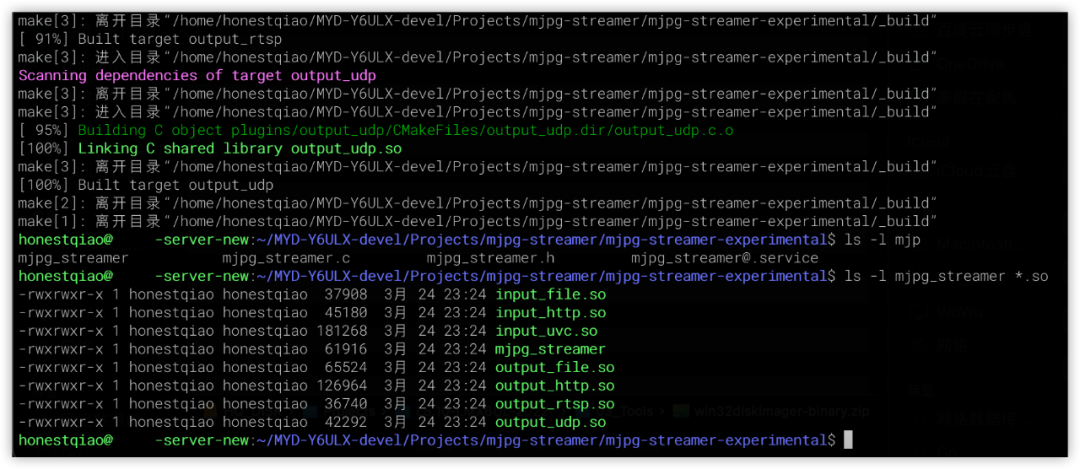

完成編譯后,結果如下:

?

?

- 帶so文件部署

使用scp將以上文件拷貝到開發板

ssh [email protected] "mkdir ~/mjpeg_server/"scp mjpg_streamer [email protected]:~/mjpeg_server/scp *.so [email protected]:~/mjpeg_server/

- mjpeg_streamer測試

將mjpg_streamer部署到開發板上以后,就可以遠程連接到開發板進行測試了。

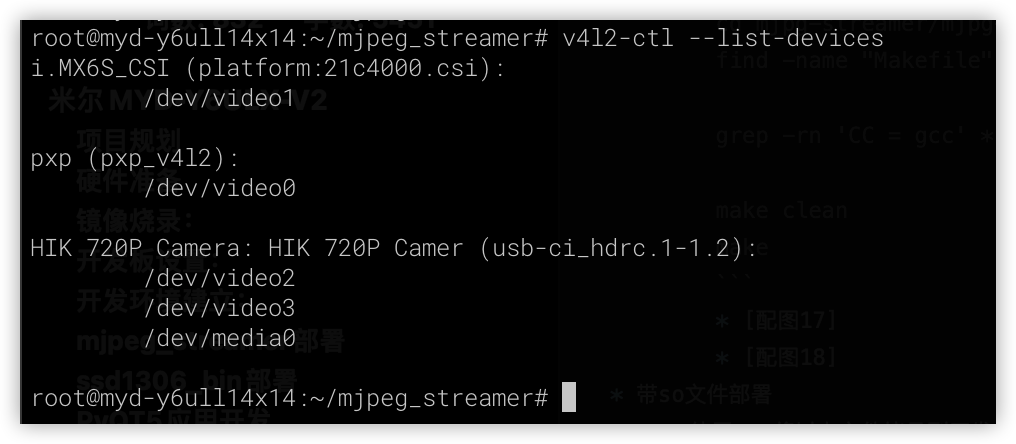

查看攝像頭設備

查看設備指令:v4l2-ctl --list-devices

從上圖可以看出,識別到了連接的USB攝像頭HIK 720P Camera,對應的第一個設備地址/dev/video2可以被mjpg_streamer調用。

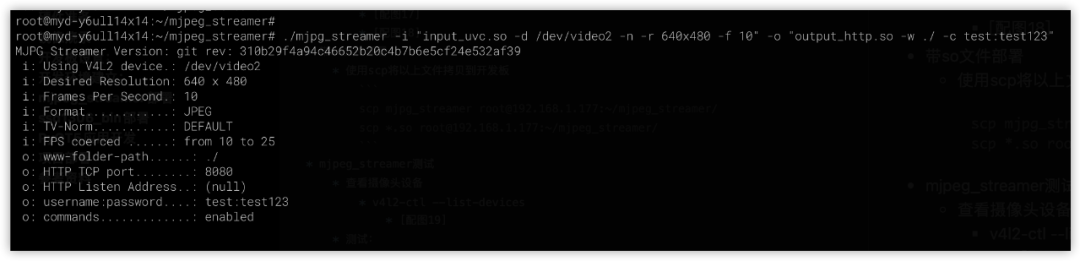

- 啟動mjpg_streamer測試:

cd ~/mjpeg_server./mjpg_streamer -i "input_uvc.so -d /dev/video2 -n -r 640x480 -f 10" -o "output_http.so -w ./"

默認啟動的mjpg_streamer是可以任意訪問的,這很危險。但可以使用-c 用戶名:密碼來設置一個訪問密碼,可以參考下圖中的指令:

?

?

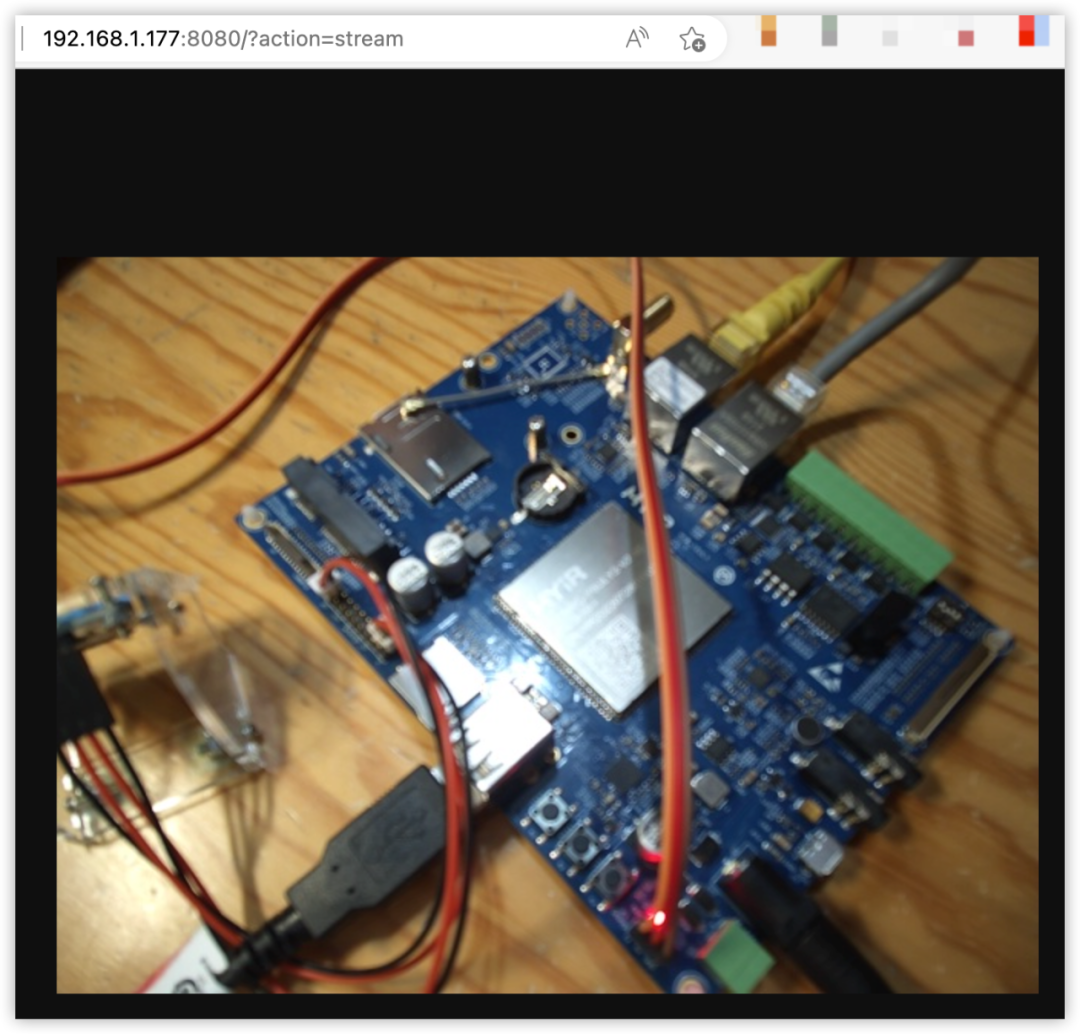

- 訪問測試:

現在在其他電腦上,可以直接通過瀏覽器訪問開發板上提供的攝像頭數據流在我的環境下,訪問地址為:http://192.168.1.177:8080/?action=stream

我所使用的SSD1306 OLED使用IIC通訊的,之前我也使用過一個Linux環境下的ssd1306工具。

經過嘗試,這個工具可以使用MYD-Y6ULX-V2開發板的編譯工具鏈進行編譯和使用。

- 下載地址:https://github.com/armlabs/ssd1306_linux/archive/refs/heads/master.zip

- 交叉編譯:

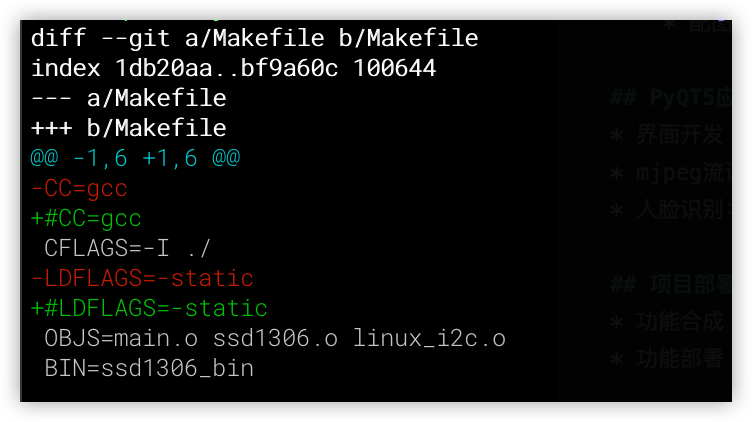

修改配置文件 Makefile,具體修改如下:

修改完成后,進行編譯,編譯完成后,部署ssd1306_bin一個文件即可

makels -l ssd1306_bin

# 部署文件到開發板scp ssd1306_bin [email protected]:~/mjpeg_server/

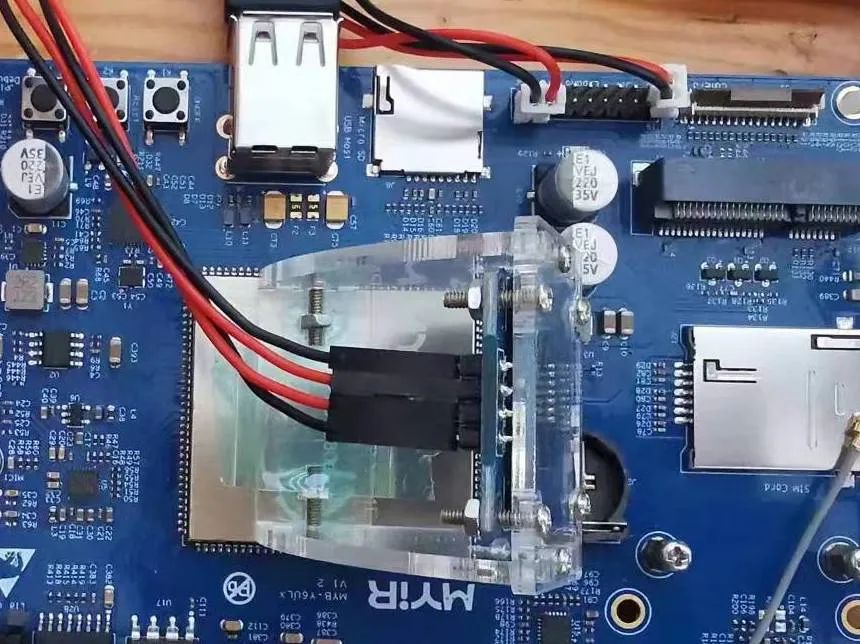

- 硬件連接

參考手冊上的說明,進行硬件的連接。我所使用的OLED使用到了VDD_5V、DGND、I2C2_SCL、I2C2_SDA。務必要注意所使用的OLED的電壓,有的只能使用3.3V,使用5V會完蛋。

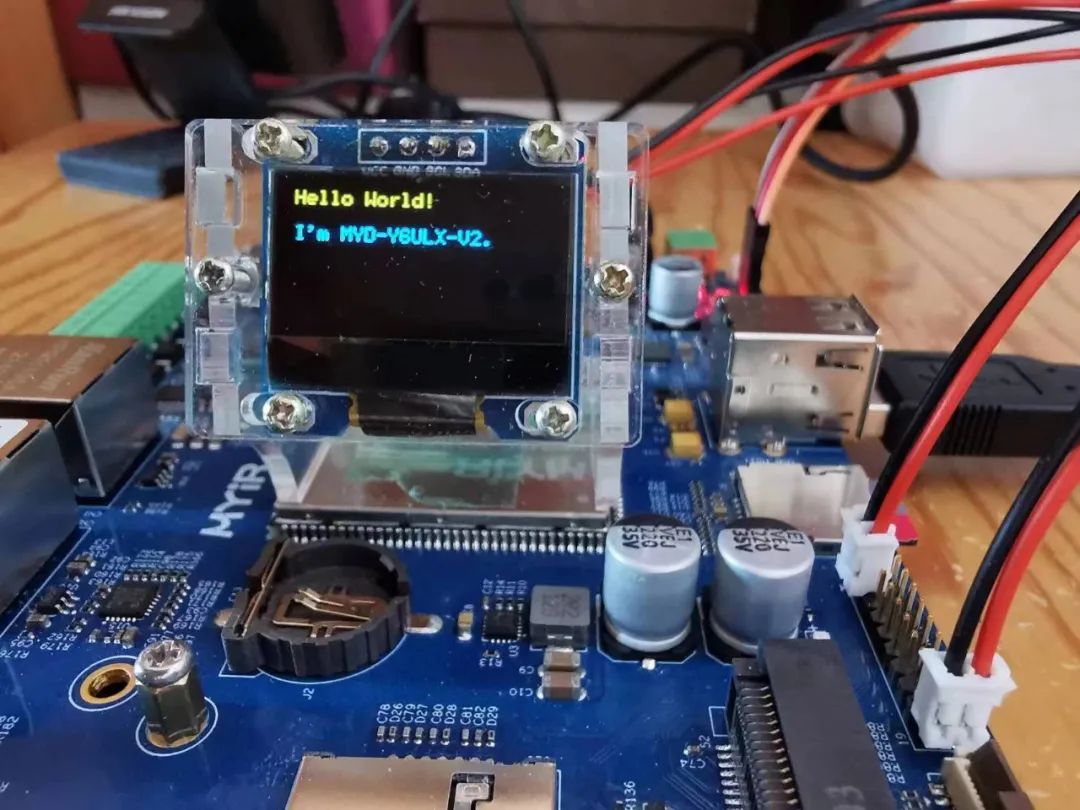

OLED顯示測試

上述硬件連接完成后,就可以遠程連接到開發板,進行測試了。

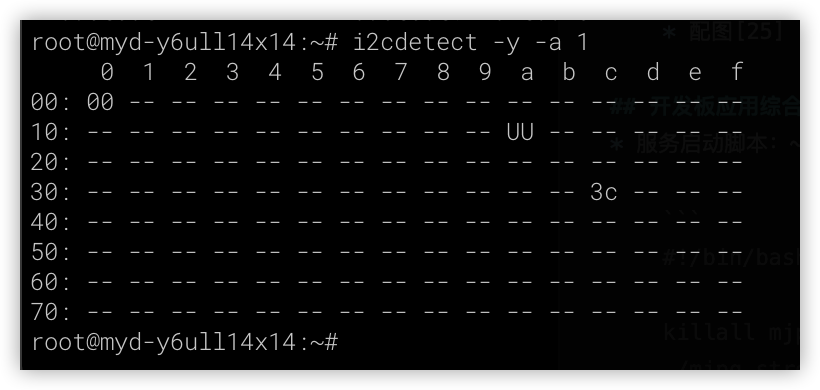

查看OLED設備是否成功硬件連接,通常IIC地址為3c:i2cdetect -y -a 1

然后,進行顯示測試

cd ~/mjpeg_server./ssd1306_bin -n 1 -I 128x64./ssd1306_bin -n 1 -c./ssd1306_bin -n 1 -r 0./ssd1306_bin -n 1 -x 0 -y -0 -m "Hello World!\n\nI'm MYD-Y6ULX-V2."

完成以上兩項工作,開發板部分的基礎工作就完成了,可以寫一個啟動腳本來進行控制,具體如下:

為了安全訪問,在腳本中設置了訪問的用戶名和密碼,可以根據實際需要進行修改。

以下的操作,都需要遠程連接到開發板上進行。

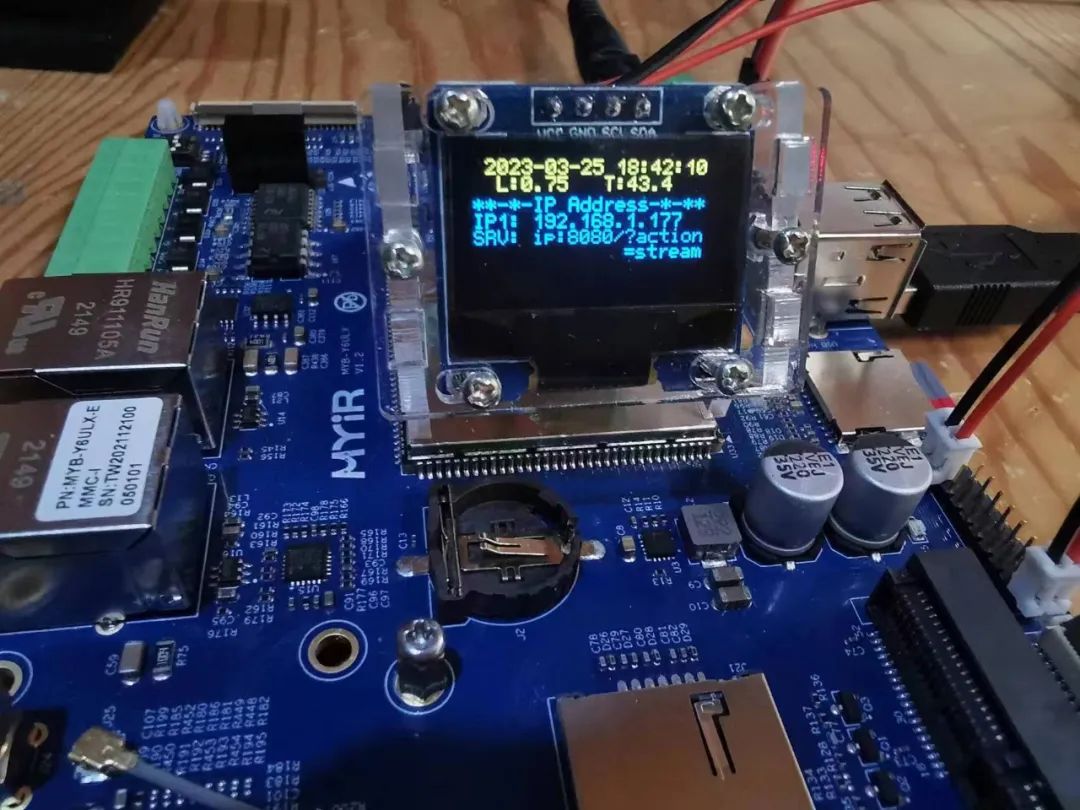

服務啟動腳本:~/mjpeg_server/mjpeg_server_start.sh

#!/bin/bash

cd "${0%/*}"

killall mjpg_streamer >/dev/nul 2>&1device=$(v4l2-ctl --list-devices | grep 'Camera' -A1 | grep /dev/video | head -1 | awk '{print $NF}')./mjpg_streamer -i "input_uvc.so -d $device -n -r 640x480 -f 10" -o "output_http.so -w ./ -c test:test123" &

./ssd1306_bin -n 1 -I 128x64./ssd1306_bin -n 1 -r 0

let count=0while truedo nowdate="$(date '+%Y-%m-%d %H:%M:%S')" load="$(w | head -1 | sed -e 's/^.*average: //' | cut -d ',' -f 1)" temp=$(echo "scale=1;$(cat /sys/devices/virtual/thermal/thermal_zone0/temp)/1000" | bc) ipstr=" ${nowdate}\n L:${load} T:${temp}" if [[ $count -gt 0 ]];then ./ssd1306_bin -n 1 -x 0 -y 0 -m "${ipstr}" else ./ssd1306_bin -n 1 -c ipstr="${ipstr}\n**-*-IP Address-*-**" i=0 for ip in $(ip addr show | grep -v "127.0.0.1" | awk -F'[ /]+' '{if($0 ~ / inet /) print $3;}') do let i=i+1 ipstr="${ipstr}\nIP${i}: ${ip}" done

ipstr="${ipstr}\nSRV: ip:8080/?action" ipstr="${ipstr}\n =stream"

echo -e "${ipstr}" ./ssd1306_bin -n 1 -x 0 -y 0 -m "${ipstr}" fi let count=count+1 if [[ $count -gt 15 ]];then let count=0 fi sleep 1done

開機啟動:

screen-Smjpeg_server/home/root/mjpeg_server/mjpeg_server_start.sh

配置完成后,就可以重新啟動開發板,OLED顯示屏上會顯示對應的信息:

然后在電腦上,打開之前的訪問地址,進行測試了。

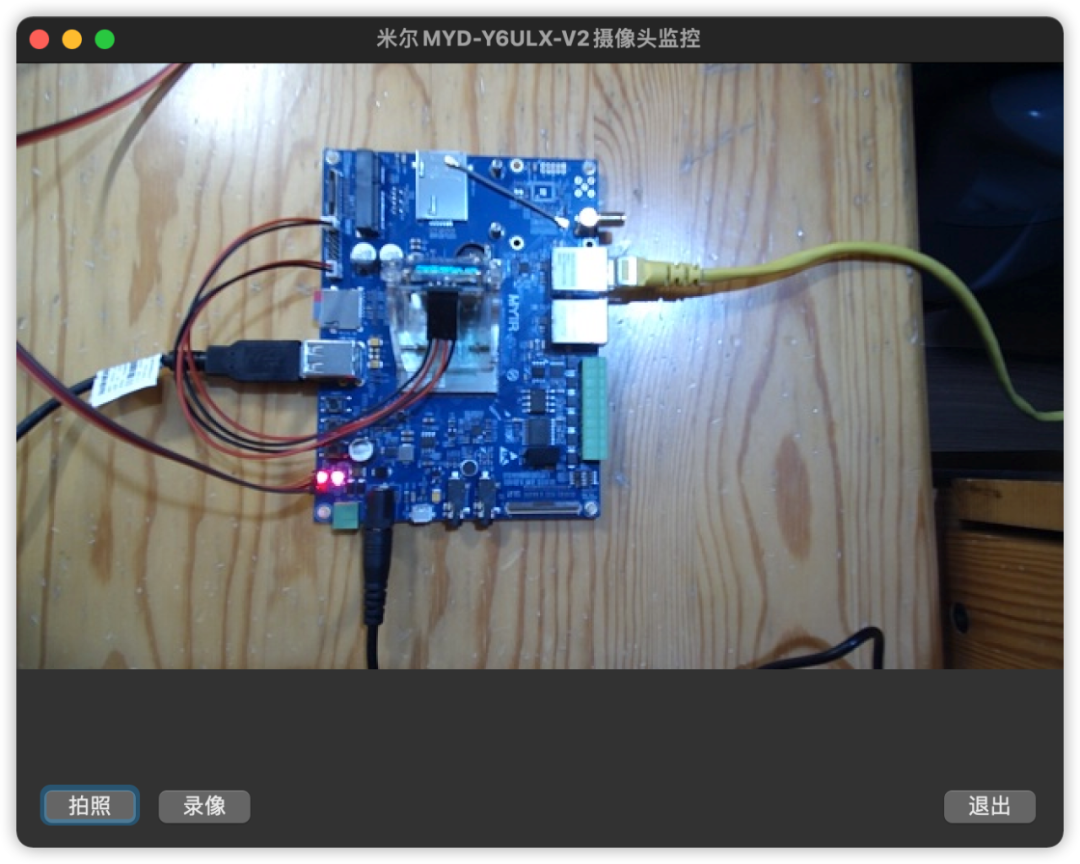

MYD-Y6ULX-V2開發板的full環境支持使用QT5進行應用開發,但實際使用中,需要屏幕配合。

我手頭沒有對應的屏幕,所以這一步的工作,就在電腦上進行,并使用PyQT5進行開發。

具體要做的工作如下:

操作界面開發

mjpeg流讀取顯示

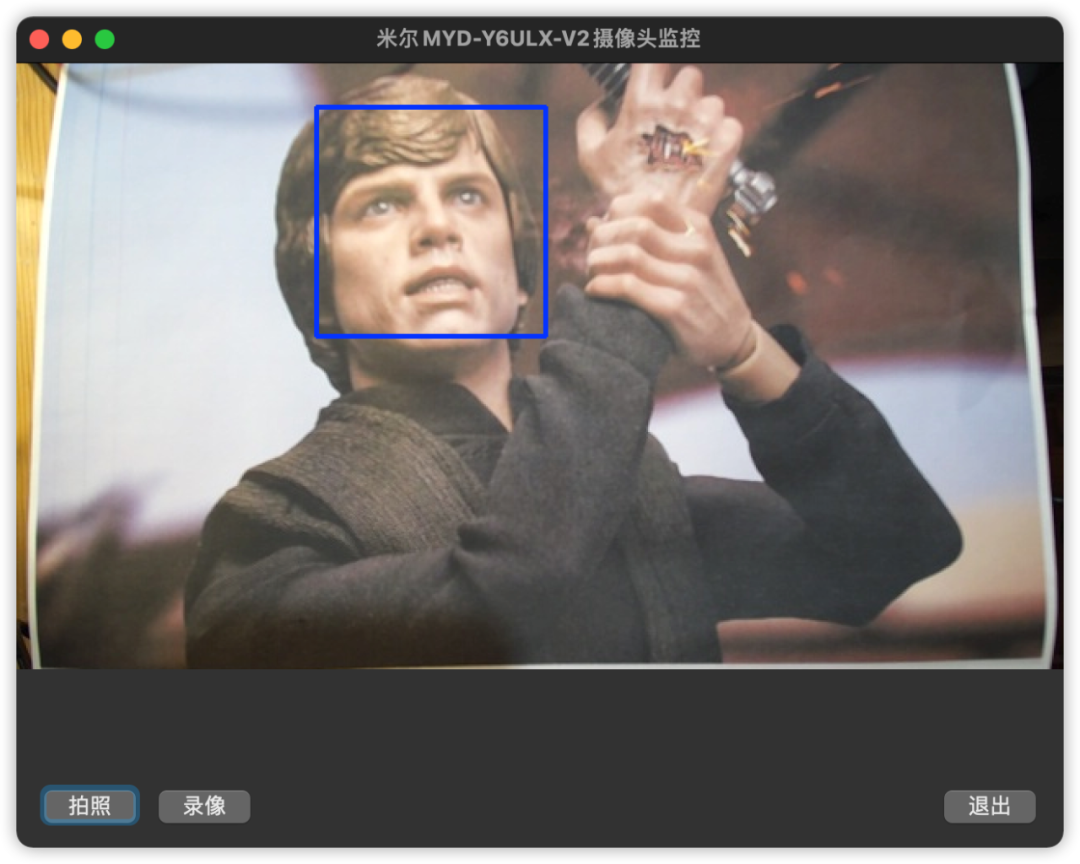

人臉識別

其中人臉識別部分,參考了:* opencv快速入門人臉檢測與人臉識別

涉及到具體的代碼的開發,我就直接上代碼了,感興趣的同學,可以查看代碼進行學習。

from PyQt5 import QtWidgetsfrom PyQt5.QtGui import QImage, QPixmap, QKeySequencefrom PyQt5.QtCore import QThreadimport sys, cv2, threading, random, signalimport numpy as npimport socketimport time, datetimeimport requestsfrom requests.auth import HTTPBasicAuth

# 0-攝像頭 1-socket 2-from remoteCAMERA_SOURCE = 2CAMERA_LOCAL_INDEX = 0 # 如果使用本地攝像頭,則表示其videoN的NCAMERA_SOCKET_PORT = 8888 # 如果視同socket,設置端口# CAMERA_REMOTE_URL = "http://192.168.1.15:8080/live.mjpg"CAMERA_REMOTE_URL = "http://192.168.1.177:8080/?action=stream"CAMERA_SOURCE_NAME = ["USB攝像頭", "網絡圖像流", "米爾MYD-Y6ULX-V2攝像頭監控"]AUTH_CONFIG = {"user":"test","pass":"test123"}FACE_DETECTION = True

if FACE_DETECTION == True: # https://blog.csdn.net/FontThrone/article/details/105314973 # https://github.com/FontTian/DS-Exhibitio face_cascade = cv2.CascadeClassifier('haarcascade_frontalface_default.xml') face_cascade.load('./haarcascades/haarcascade_frontalface_default.xml') face_box_colors = [ (255, 0, 0), (0, 255, 0), (0, 255, 0), (255, 255, 0), (255, 0, 255), (0, 255, 255), (255, 128, 128), (128, 255, 128), (128, 255, 128), (255, 255, 128), (255, 128, 255), (128, 255, 255) ]

# 應用定義app = QtWidgets.QApplication(sys.argv)window_w, window_h = 640, 480 # 窗口寬度和高度scale = 0.58 # 視頻信息寬高比

# 界面定義Form = QtWidgets.QWidget()Form.setWindowTitle(CAMERA_SOURCE_NAME[CAMERA_SOURCE])Form.resize(window_w, window_h)

# 窗口大小改變時自動調整按鈕def windowResize(self): global window_w, window_h, scale window_w = Form.width() # 窗口寬度 window_h = Form.height() # 窗口高度 label.setGeometry(0,0, window_w, int(window_w*scale)) # 調整 QLabel 尺寸 btn1.setGeometry(10, window_h-40,70,30) # 調整按鈕位置 btn2.setGeometry(80, window_h-40,70,30) # 調整按鈕位置 btn3.setGeometry(window_w - 80, window_h-40,70,30) # 調整按鈕位置

Form.resizeEvent = windowResize # 設置窗口大小改變時觸發

# 關閉應用時的處理ocv = True # 設置是否處理視頻def closeOpenCV(self): global ocv, output ocv = False # 關閉窗口時,停止處理視頻 print("關閉程序") try: output.release() # 關閉窗口時,釋放視頻處理資源 except: pass

Form.closeEvent = closeOpenCV # 窗口關閉時觸發

label = QtWidgets.QLabel(Form)label.setGeometry(0,0, window_w, int(window_w*scale)) # 設置 QLabel 的位置和大小

# 存儲文件時使用的文件名def rename(): # return str(random.random()*10).replace('.','') return datetime.datetime.now().strftime('%Y%m%d_%H%M%S')

photo = False # 按下拍照按鈕時,設置處于拍照狀態

# 按下拍照按鈕時的處理def takePhoto(): global photo photo = True # 設定拍照狀態為True print("馬上拍照")

btn1 = QtWidgets.QPushButton(Form)btn1.setGeometry(10, window_h-40,70,30) # 設置拍照按鈕的位置和大小btn1.setText('拍照')btn1.clicked.connect(takePhoto) # 按下拍照按鈕時觸發

fourcc = cv2.VideoWriter_fourcc(*'mp4v') # 設置視頻中的存儲格式recorderType = False # 按下錄像按鈕時,設置處于錄像狀態

# 按下錄像按鈕時的處理def recordVideo(): global recorderType, output if recorderType == False: # 如果按下按鈕時沒有在錄像,則開始錄像 # 設定存儲的視頻信息 output = cv2.VideoWriter(f'videos/{rename()}.mp4', fourcc, 20.0, (window_w, int(window_w*scale))) recorderType = True # 設置正在錄制狀態 btn2.setGeometry(80, window_h-40,200,30) # 根據顯示內容設置大小 btn2.setText('錄像中,點擊停止保存') else: # 如果按下按鈕時正在在錄像,則停止錄像 output.release() # 釋放視頻存儲資源 recorderType = False # 設置非錄制狀態 btn2.setGeometry(80, window_h-40,70,30) # 根據顯示內容設置大小 btn2.setText('錄像')

btn2 = QtWidgets.QPushButton(Form)btn2.setGeometry(80, window_h-40,70,30) # 設置錄像按鈕的位置和大小btn2.setText('錄像')btn2.clicked.connect(recordVideo) # 按下錄像按鈕時觸發

# 按下退出按鈕時的處理def quitApp(): global video_server print("退出程序") closeOpenCV(False) app = QtWidgets.QApplication.instance() app.quit()

btn3 = QtWidgets.QPushButton(Form)btn3.setGeometry(window_w-80, window_h-40,70,30) # 設置退出按鈕的位置和大小btn3.setText('退出')btn3.clicked.connect(quitApp) # 按下退出按鈕時觸發

# 人臉識別處理def face_detection_process(frame): if FACE_DETECTION == True: face_count = 0 gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY) faces = face_cascade.detectMultiScale(gray, 1.3, 5) for (x, y, w, h) in faces: color = face_box_colors[face_count % len(face_box_colors)] cv2.rectangle(frame, (x, y), (x + w, y + h), color, 2) face_count+=1

# 此處省略本項目用不到的數百行...

# mjpeg數據流處理服務def mjpeg_remote_server(): global window_w, window_h, scale, photo, output, recorderType, ocv

r = requests.get(CAMERA_REMOTE_URL, auth=HTTPBasicAuth(AUTH_CONFIG["user"], AUTH_CONFIG["pass"]), stream=True) if(r.status_code != 200): print("Received unexpected status code {}".format(r.status_code)) return

count = 0 is_first = False recv_data_mjpeg = bytes() for recv_data in r.iter_content(chunk_size=1024): if not ocv: break

count+=1 if count % 10000 == 1: print("\trecv stream success") recv_data_mjpeg += recv_data

a = recv_data_mjpeg.find(b'\xff\xd8') b = recv_data_mjpeg.find(b'\xff\xd9') if not (a != -1 and b != -1): continue

mjpg_data_raw = recv_data_mjpeg[a:b+2] recv_data_mjpeg = recv_data_mjpeg[b+2:]

mjpeg_data = np.frombuffer(mjpg_data_raw, 'uint8') img = cv2.imdecode(mjpeg_data, cv2.IMREAD_COLOR) # cv2.imshow('stream', img)

if not is_first: is_first = True sp = img.shape sz1 = sp[0] #height(rows) of image sz2 = sp[1] #width(colums) of image sz3 = sp[2] #the pixels value is made up of three primary colors print('網絡圖像: width=%d \theight=%d \tnumber=%d' % (sz1, sz2, sz3)) scale = sz1/sz2

frame = cv2.resize(img, (window_w, int(window_w*scale))) # 改變幀大小 if photo == True: name = rename() # 設置文件名稱 name_save = f'photos/{name}.jpg' print("照片存儲:%s" % name_save) cv2.imwrite(name_save, frame) # 存儲圖片 photo = False # 拍照完,設置非拍照狀態 if recorderType == True: output.write(frame) # 按下錄像按鈕時,輸出到存儲文件

face_detection_process(frame) frame = cv2.cvtColor(frame, cv2.COLOR_BGR2RGB) # 設置為 RGB height, width, channel = frame.shape bytesPerline = channel * width img = QImage(frame, width, height, bytesPerline, QImage.Format_RGB888) label.setPixmap(QPixmap.fromImage(img)) # 顯示

if CAMERA_SOURCE == 2: video_server = QThread() video_server.run = mjpeg_remote_server video_server.start()

Form.show()sys.exit(app.exec_())

設置好開發板的MJPEG視頻地址,然后啟動上面的python程序,就能打開如下界面了:

?

?

如果畫面中有人臉,就會自動識別了:

-

處理器

+關注

關注

68文章

19811瀏覽量

233600 -

開發板

+關注

關注

25文章

5532瀏覽量

102424

發布評論請先 登錄

米爾NXP i.MX 91核心板發布,助力新一代入門級Linux應用開發

【米爾-STM32MP257開發板試用體驗】初次體驗米爾-STM32MP257開發板

OpenCV行人檢測應用方案--基于米爾全志T527開發板

【米爾RK3576開發板評測】+項目名稱【米爾RK3576開發板評測】一個視頻和你共同認識一下米爾RK3576開發板

米爾基于NXP iMX.93開發板的M33處理器應用開發筆記

基于iMX6ULL處理器的監控平臺體驗--米爾MYD-Y6ULX-V2開發板

基于iMX6ULL處理器的監控平臺體驗--米爾MYD-Y6ULX-V2開發板

評論