本文是新浪微博新技術(shù)研發(fā)負責(zé)人、中國中文信息學(xué)會理事張俊林在知乎問題「OpenAI 發(fā)布 GPT-4,有哪些技術(shù)上的優(yōu)化或突破?」下的回答,總結(jié)了GPT4技術(shù)報告里指出的三個方向,還提及了兩個其它技術(shù)方向。

在這個歷史性的時刻,回答個問題,留下自己作為歷史見證人的足跡。

GPT4的技術(shù)報告里很明確地指出了三個新的方向:

第一,LLM最前沿研究的封閉化或小圈子化。技術(shù)報告里說了,出于競爭以及安全等方面的考慮,未公布模型規(guī)模等技術(shù)細節(jié)。從GPT 2.0的開源,到GPT 3.0的只有論文,再到ChatGPT連論文也沒有,直到GPT 4.0的技術(shù)報告更像效果評測報告。一個很明顯的趨勢是,OpenAI做實了CloseAI的名號,之后OpenAI的LLM最前沿研究不會再放出論文。

在這個情形下,其它技術(shù)相對領(lǐng)先的公司有兩種選擇。一種是做更極致的LLM開源化,比如Meta貌似選擇了這條道路,這一般是競爭處于劣勢的公司作出的合理選擇,但是往往相關(guān)技術(shù)不會是最前沿的技術(shù);另外一種選擇是跟進OpenAI,也選擇技術(shù)封閉化。Google之前算是LLM的第二梯隊。但在“微軟+OpenAI”的一頓組合拳下,現(xiàn)在局面有點狼狽不堪。GPT 4.0去年8月就做好了,估計現(xiàn)在GPT 5.0正在煉丹過程中,這么長的時間窗口,結(jié)果Google都能落到目前這個局面,想想Transformer、CoT等非常關(guān)鍵的一些研究都是自己做出來的,竟淪落至此,不知一眾高層作何感想。Google在后面能快速跟進,維持在第二梯隊?wèi)?yīng)該問題不大,很可能比第三名技術(shù)也領(lǐng)先很多。出于競爭關(guān)系考慮,我猜Google大概率會跟進OpenAI走技術(shù)封閉的路線,最先進的LLM技術(shù)優(yōu)先用來煉屬于自己的丹,而不是寫成論文放出來普惠大眾尤其是普惠OpenAI。而這很可能導(dǎo)致LLM最前沿研究的封閉化。

從現(xiàn)在算起,國內(nèi)在經(jīng)過一陣時間后(要做到ChatGPT的6到7折應(yīng)該比較快,要追平估計要較長時間),必然被迫進入自主創(chuàng)新的局面。從最近三個月國內(nèi)的各種情況看,將來會如何?大概率不太樂觀。當(dāng)然,這個關(guān)肯定很難,但必須得過,只能祝愿有能力且有初心者盡力加油了。

第二,GPT 4技術(shù)報告里提到的LLM模型的“能力預(yù)測(Capability Prediction)”是個非常有價值的新研究方向(其實之前也有個別其它資料,我記得看過,但是具體哪篇記不起來了)。用小模型來預(yù)測某些參數(shù)組合下對應(yīng)大模型的某種能力,如果預(yù)測足夠精準(zhǔn),能夠極大縮短煉丹周期,同時極大減少試錯成本,所以無論理論價值還是實際價值巨大,這個絕對是非常值得認真研究具體技術(shù)方法的。

第三,GPT 4開源了一個LLM評測框架,這也是后面LLM技術(shù)快速發(fā)展非常重要的方向。尤其對于中文,構(gòu)建實用的中文LLM評測數(shù)據(jù)和框架具備特別重要的意義,好的LLM評測數(shù)據(jù)可以快速發(fā)現(xiàn)LLM目前存在的短板和改進方向,意義重大,但是很明顯目前這塊基本處于空白狀態(tài)。這個對于資源要求其實沒那么高,適合很多機構(gòu)去做,不過確實是個辛苦活。

除了GPT 4技術(shù)報告里明確指出的三個方向,因為最近LLM各方面新聞比較多,順手再寫兩個其它技術(shù)方向。

首先,斯坦福大學(xué)近在Meta的7B 開源LLaMA基礎(chǔ)上,加上Self Instruct技術(shù)構(gòu)造的Alpaca,也代表了一個技術(shù)方向。如果歸納下,這個方向可以被稱為“低成本復(fù)現(xiàn)ChatGPT”的方向。所謂Self Instruct,就是采取一定技術(shù)手段,不用人工標(biāo)注Instruct,而是從OpenAI的接口里,好聽點叫“蒸餾”出Instruct,也就是不用人標(biāo)注,而是ChatGPT作為teacher,給你的Instruct打上標(biāo)注結(jié)果。這個把Instruct標(biāo)注成本直接打到了幾百美金的基準(zhǔn),時間成本就更短了。再加上模型7B規(guī)模也不大,所以可以看成一種“低成本復(fù)現(xiàn)ChatGPT”的技術(shù)路線。

我估計國內(nèi)早就有不少人采取這個技術(shù)路線了。毫無疑問,這是一條捷徑,但是走捷徑有好處有壞處,具體不展開談了。在追趕ChatGPT的過程中,先把成本打下來去復(fù)現(xiàn)ChatGPT到七八成,我個人還是覺得可行也支持的,畢竟窮人有窮人的玩法。當(dāng)然,追求把模型做小,效果又不怎么往下掉,如果能扎扎實實去做,是非常具有價值的。

另外,具身智能毫無疑問會是LLM下一階段的重點研究方向。這方面的代表就是前陣子Google放出來的PaLM-E。目前的GPT 4,我們可以認為人類創(chuàng)造出了一個超級大腦,但還是把它封鎖在GPU集群里。而這個超級大腦需要一個身體,GPT 4要和物理世界發(fā)生聯(lián)系、交流和互動,并在物理世界中獲得真實的反饋,來學(xué)會在真實世界里生存,并根據(jù)真實世界的反饋,利用比如強化學(xué)習(xí)來學(xué)習(xí)在世界游走的能力。這個肯定是最近的將來最熱門的LLM研究方向。

多模態(tài)LLM給予了GPT 4以眼睛和耳朵,而具身智能給予GPT 4身體、腳和手。GPT 4和你我發(fā)生一些聯(lián)系,而依托于GPT 4本身強大的學(xué)習(xí)能力,這個事情估計很快會出現(xiàn)在我們身邊。

如果你細想,其實還有很多其它有前途的方向。我的個人判斷是:未來5到10年,將會是AGI最快速發(fā)展的黃金十年。如果我們站在未來30年的時間節(jié)點,當(dāng)我們回顧這10年時,我們中一定會有人,想起下面的詩句:“懂得,但為時太晚,他們使太陽在途中悲傷, 也并不溫和地走進那個良夜。”

審核編輯 :李倩

-

框架

+關(guān)注

關(guān)注

0文章

404瀏覽量

17796 -

OpenAI

+關(guān)注

關(guān)注

9文章

1202瀏覽量

8649

原文標(biāo)題:OpenAI發(fā)布GPT-4,有哪些技術(shù)趨勢值得關(guān)注?

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

OpenAI簡化大模型選擇:薩姆·奧特曼制定路線圖

OpenAI宣布GPT 4o升智計劃

OpenAI即將發(fā)布GPT-4.5與GPT-5

OpenAI即將推出GPT-5模型

OpenAI報告GPT-4o及4o-mini模型性能下降,正緊急調(diào)查

OpenAI:GPT-4o及4o-mini模型性能下降,正展開調(diào)查

Llama 3 與 GPT-4 比較

科大訊飛發(fā)布訊飛星火4.0 Turbo:七大能力超GPT-4 Turbo

OpenAI api key獲取并可調(diào)用GPT-4.0、GPT-4o、GPT-4omini

OpenAI 推出 GPT-4o mini 取代GPT 3.5 性能超越GPT 4 而且更快 API KEY更便宜

OpenAI發(fā)布最新人工智能模型——GPT-4o mini

OpenAI GPT-5:未來已來,但何時降臨

OpenAI揭秘CriticGPT:GPT自進化新篇章,RLHF助力突破人類能力邊界

OpenAI推出新模型CriticGPT,用GPT-4自我糾錯

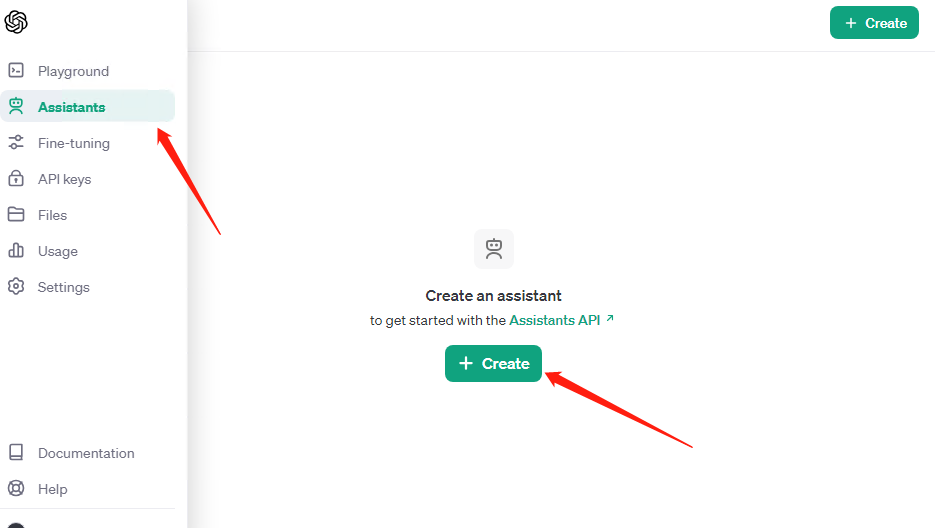

OpenAI API Key獲取:開發(fā)人員申請GPT-4 API Key教程

OpenAI發(fā)布GPT-4,有哪些技術(shù)趨勢值得關(guān)注?

OpenAI發(fā)布GPT-4,有哪些技術(shù)趨勢值得關(guān)注?

評論