擴(kuò)散模型在文本到圖像生成方面是最好的嗎?不見得,英偉達(dá)等機(jī)構(gòu)推出的新款 StyleGAN-T,結(jié)果表明 GAN 仍具有競爭力。

文本合成圖像任務(wù)是指,基于文本內(nèi)容生成圖像內(nèi)容。當(dāng)下這項(xiàng)任務(wù)取得的巨大進(jìn)展得益于兩項(xiàng)重要的突破:其一,使用大的預(yù)訓(xùn)練語言模型作為文本的編碼器,讓使用通用語言理解實(shí)現(xiàn)生成模型成為可能。其二,使用由數(shù)億的圖像 - 文本對組成的大規(guī)模訓(xùn)練數(shù)據(jù),只要你想到的,模型都可以合成。

訓(xùn)練數(shù)據(jù)集的大小和覆蓋范圍持續(xù)飛速擴(kuò)大。因此,文本生成圖像任務(wù)的模型必須擴(kuò)展成為大容量模型,以適應(yīng)訓(xùn)練數(shù)據(jù)的增加。最近在大規(guī)模文本到圖像生成方面,擴(kuò)散模型(DM)和自回歸模型(ARM)催生出了巨大的進(jìn)展,這些模型似乎內(nèi)置了處理大規(guī)模數(shù)據(jù)的屬性,同時還能處理高度多模態(tài)數(shù)據(jù)的能力。

有趣的是,2014 年,由 Goodfellow 等人提出的生成對抗網(wǎng)絡(luò)(GAN),在生成任務(wù)中并沒有大放異彩,正當(dāng)大家以為 GAN 在生成方面已經(jīng)不行的時候,來自英偉達(dá)等機(jī)構(gòu)的研究者卻試圖表明 GAN 仍然具有競爭力,提出 StyleGAN-T 模型。

StyleGAN-T: Unlocking the Power of GANs for Fast Large-Scale Text-to-Image Synthesis

論文地址:https://arxiv.org/abs/2301.09515

論文主頁:https://sites.google.com/view/stylegan-t/

StyleGAN-T 只需 0.1 秒即可生成 512×512 分辨率圖像:

?

?

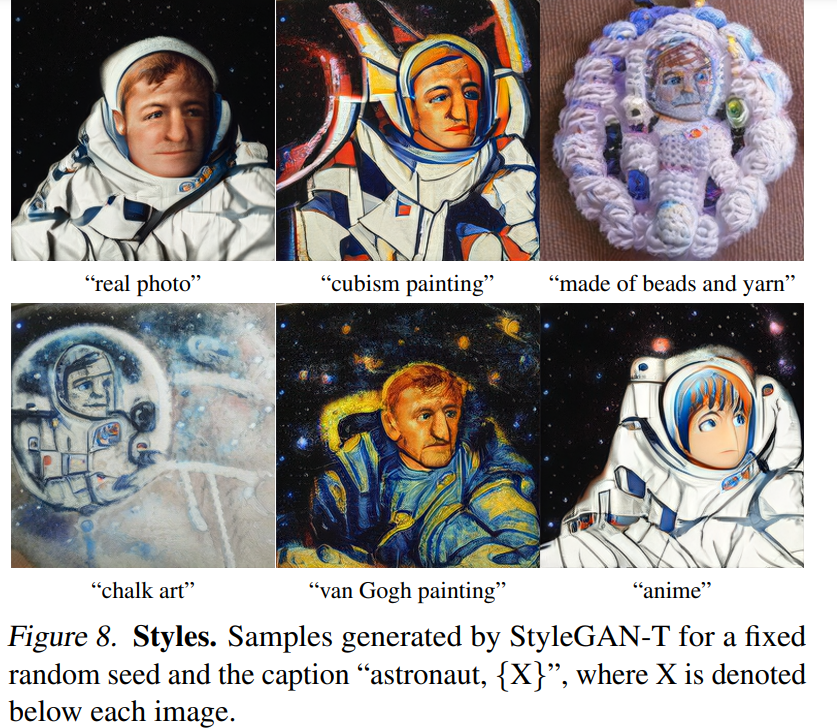

StyleGAN-T 生成宇航員圖像:

?

值得一提的是,谷歌大腦研究科學(xué)家 Ben Poole 表示:StyleGAN-T 在低分辨率 (64x64) 時生成的樣本比擴(kuò)散模型更快更好,但在高分辨率 (256x256) 時表現(xiàn)不佳。

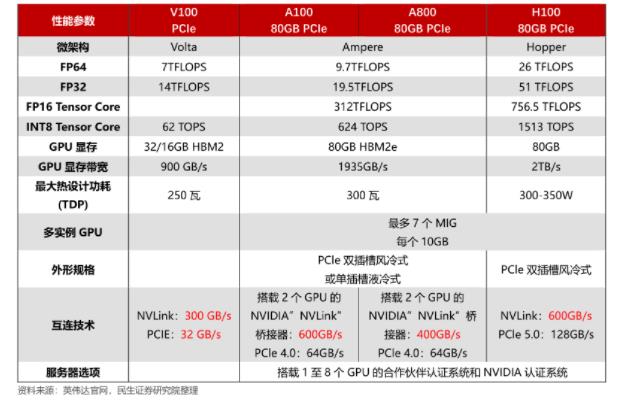

研究者們表示,他們在 64 臺 NVIDIA A100 上進(jìn)行了 4 周的訓(xùn)練。有人給這項(xiàng)研究算了一筆賬,表示:StyleGAN-T 在 64 塊 A100 GPU 上訓(xùn)練 28 天,根據(jù)定價約為 473000 美元,這大約是典型擴(kuò)散模型成本的四分之一……

GAN 提供的主要好處在于推理速度以及可以通過隱空間控制合成的結(jié)果。StyleGAN 的特別之處在于,其具有一個精心設(shè)計(jì)的隱空間,能從根本上把控生成的圖像結(jié)果。而對于擴(kuò)散模型來說,盡管有些工作在其加速方面取得了顯著進(jìn)展,但速度仍然遠(yuǎn)遠(yuǎn)落后于僅需要一次前向傳播的 GAN。

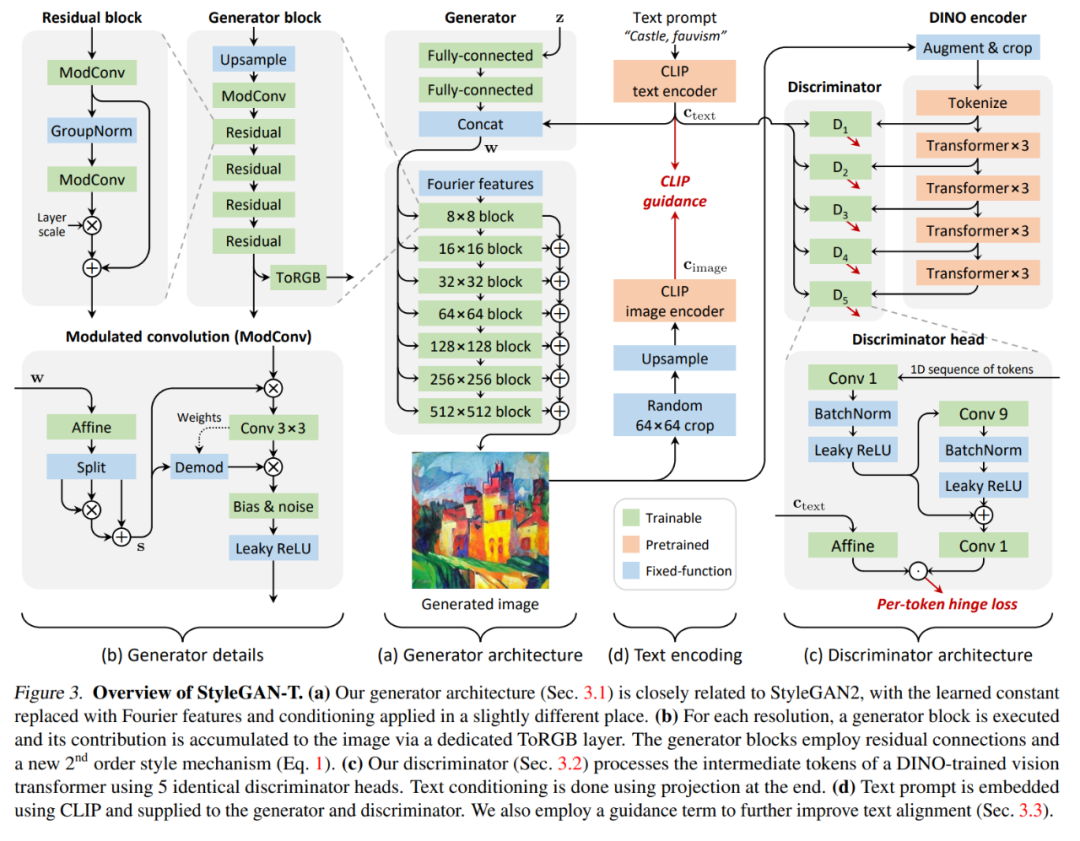

本文從觀察到 GAN 在 ImageNet 合成中同樣落后于擴(kuò)散模型中得到啟發(fā),接著受益于 StyleGAN-XL 對判別器的架構(gòu)進(jìn)行了重構(gòu),使得 GAN 和擴(kuò)散模型的差距逐漸縮小。在原文的第 3 節(jié)中,考慮到大規(guī)模文本生成圖像任務(wù)的特定要求:數(shù)量多、類別多的數(shù)據(jù)集、強(qiáng)大的文本對齊以及需要在變化與文本對齊間進(jìn)行權(quán)衡,研究者以 StyleGAN-XL 作為開始,重新審視了生成器和判別器的架構(gòu)。

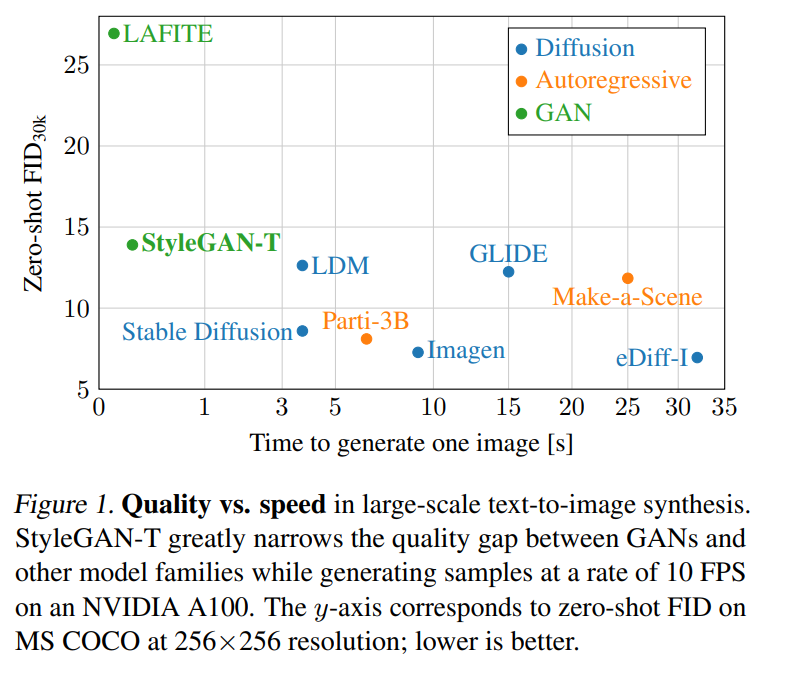

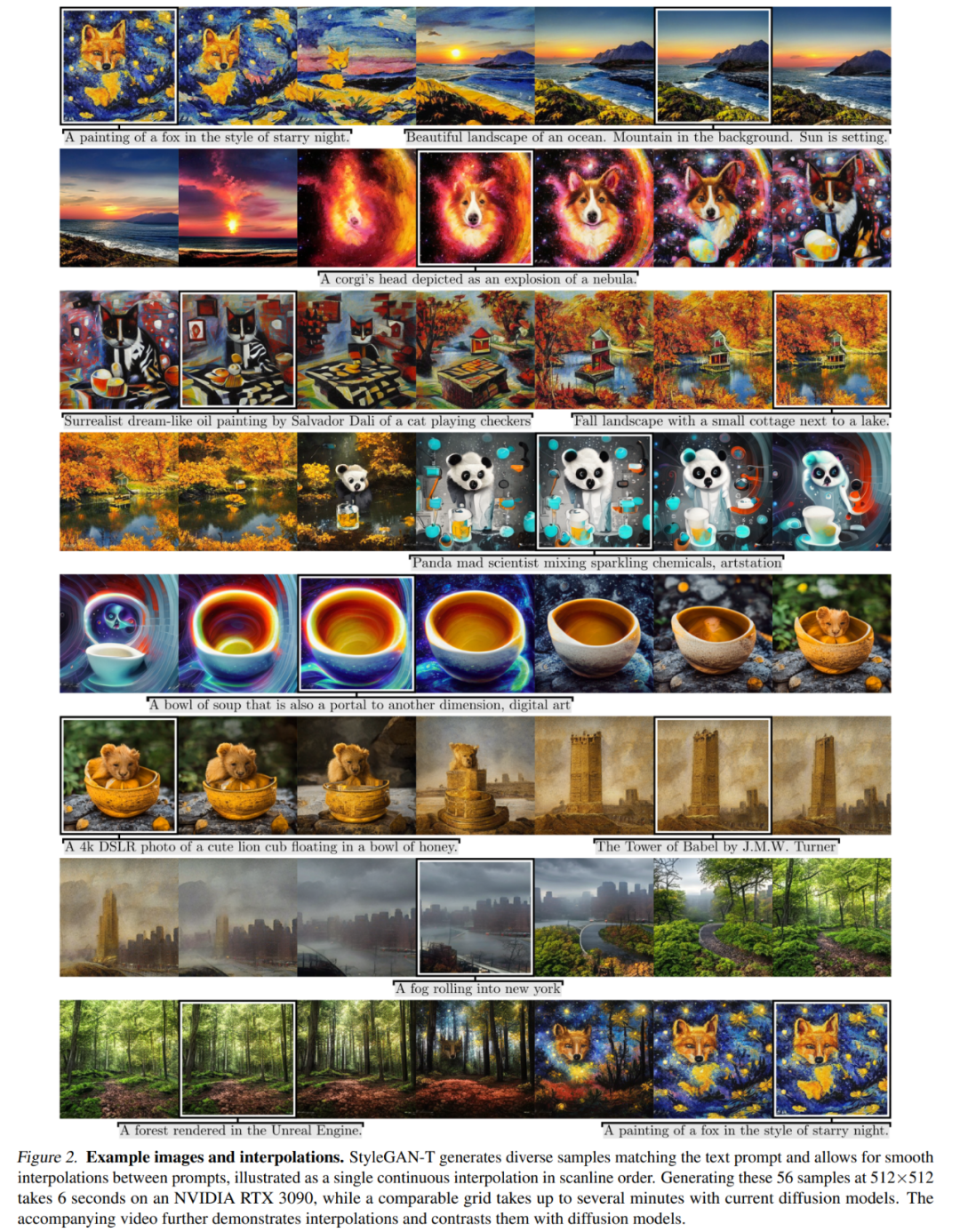

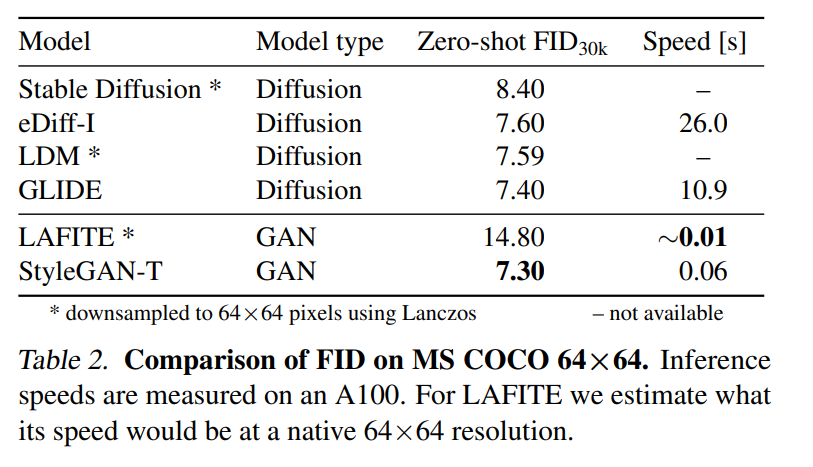

在 MS COCO 上的零樣本任務(wù)中,StyleGAN-T 以 64×64 的分辨率實(shí)現(xiàn)了比當(dāng)前 SOTA 擴(kuò)散模型更高的 FID 分?jǐn)?shù)。在 256×256 分辨率下,StyleGAN-T 更是達(dá)到之前由 GAN 實(shí)現(xiàn)的零樣本 FID 分?jǐn)?shù)的一半,不過還是落后于 SOTA 的擴(kuò)散模型。StyleGAN-T 的主要優(yōu)點(diǎn)包括其快速的推理速度和在文本合成圖像任務(wù)的上下文中進(jìn)行隱空間平滑插值,分別如圖 1 和圖 2 所示。

StyleGAN-T 架構(gòu)概覽

該研究選擇 StyleGAN-XL 作為基線架構(gòu),因?yàn)?StyleGAN-XL 在以類別為條件的 ImageNet 合成任務(wù)中表現(xiàn)出色。然后該研究依次從生成器、判別器和變長與文本對齊的權(quán)衡機(jī)制的角度修改 StyleGAN-XL。

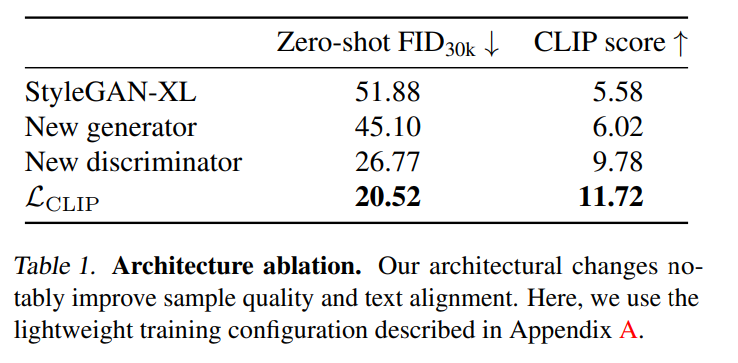

在整個重新設(shè)計(jì)過程中,作者使用零樣本 MS COCO 來衡量改動的效果。出于實(shí)際原因,與原文第 4 節(jié)中的大規(guī)模實(shí)驗(yàn)相比,測試步驟的計(jì)算資源預(yù)算有限,該研究使用了更小模型和更小的數(shù)據(jù)集;詳見原文附錄 A。除此以外,該研究使用 FID 分?jǐn)?shù)來量化樣本質(zhì)量,并使用 CLIP 評分來量化文本對齊質(zhì)量。

為了在基線模型中將以類別為引導(dǎo)條件更改為以文本為引導(dǎo)條件,作者使用預(yù)訓(xùn)練的 CLIP ViT-L/14 文本編碼器來嵌入文本提示,以此來代替類別嵌入。接著,作者刪除了用于引導(dǎo)生成的分類器。這種簡單的引導(dǎo)機(jī)制與早期的文本到圖像模型相匹配。如表 1 所示,該基線方法在輕量級訓(xùn)練配置中達(dá)到了 51.88 的零樣本 FID 和 5.58 的 CLIP 分?jǐn)?shù)。值得注意的是,作者使用不同的 CLIP 模型來調(diào)節(jié)生成器和計(jì)算 CLIP 分?jǐn)?shù),這降低了人為夸大結(jié)果的風(fēng)險。

實(shí)驗(yàn)結(jié)果

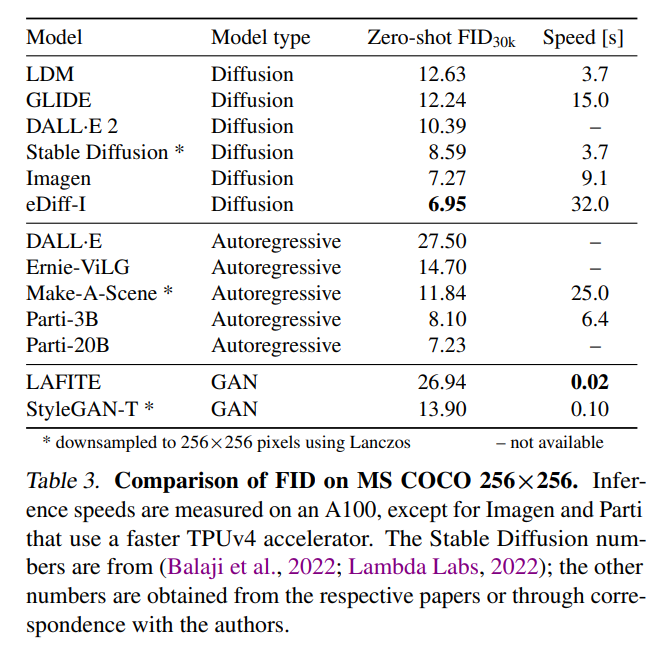

該研究使用零樣本 MS COCO 在表 2 中的 64×64 像素輸出分辨率和表 3 中的 256×256 像素輸出分辨率下定量比較 StyleGAN-T 的性能與 SOTA 方法的性能。

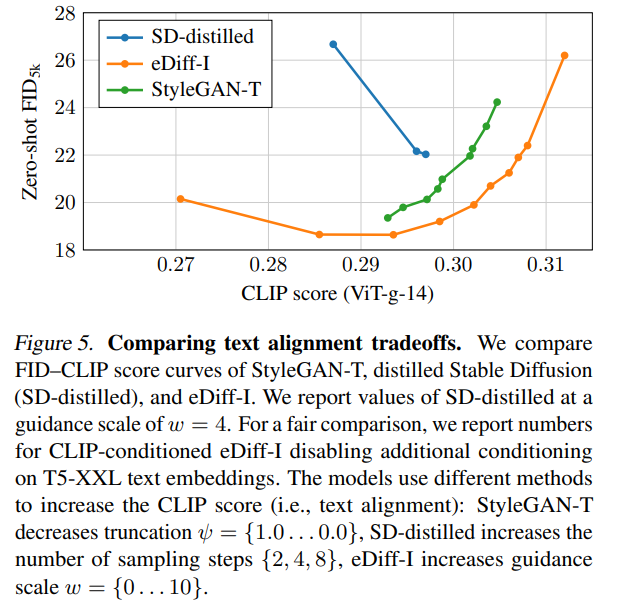

圖 5 展示了 FID-CLIP 評分曲線:

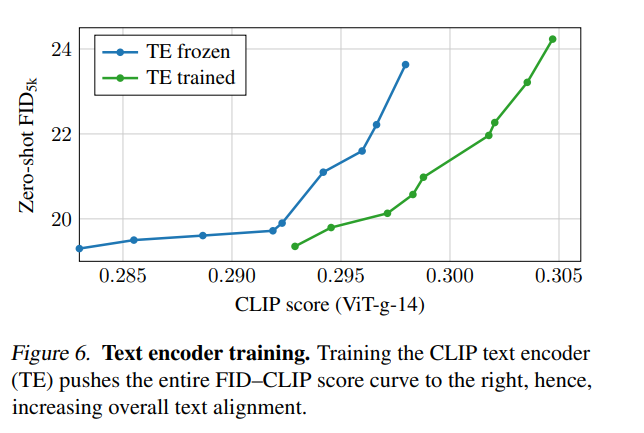

為了隔離文本編碼器訓(xùn)練過程產(chǎn)生的影響,該研究評估了圖 6 中的 FID–CLIP 得分曲線。

圖 2 顯示了 StyleGAN-T 生成的示例圖像,以及它們之間的插值。

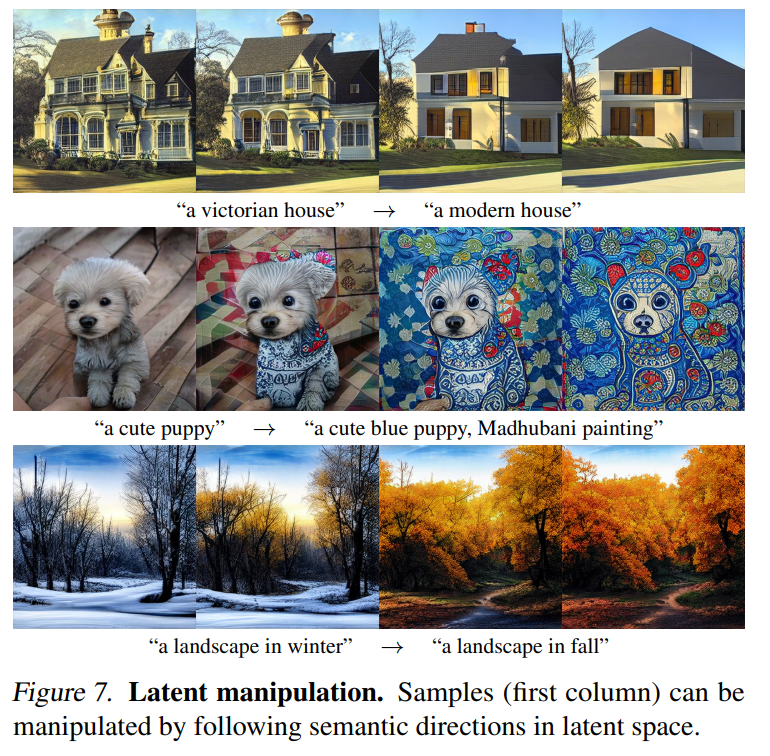

在不同的文本提示之間進(jìn)行插值非常簡單。對于由中間變量 w_0 = [f (z), c_text0] 生成的圖像,該研究用新的文本條件 c_text1 替換文本條件 c_text0。然后將 w_0 插入到新的隱變量 w_1 = [f (z), c_text1] 中,如圖 7 所示。

通過向文本提示附加不同的樣式,StyleGAN-T 可以生成多種樣式,如圖 8 所示。

審核編輯 :李倩

-

編碼器

+關(guān)注

關(guān)注

45文章

3770瀏覽量

137046 -

語言模型

+關(guān)注

關(guān)注

0文章

558瀏覽量

10655 -

英偉達(dá)

+關(guān)注

關(guān)注

22文章

3916瀏覽量

93066

原文標(biāo)題:GAN強(qiáng)勢歸來?英偉達(dá)耗費(fèi)64個A100訓(xùn)練StyleGAN-T!僅為擴(kuò)散模型成本的四分之一

文章出處:【微信號:CVer,微信公眾號:CVer】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

英偉達(dá)耗費(fèi)64個A100訓(xùn)練StyleGAN-T!

英偉達(dá)耗費(fèi)64個A100訓(xùn)練StyleGAN-T!

評論