無需打字、無需搜索表情,只需對著手機微笑,就能發出微笑表情包。

同樣的,對著手機皺眉,就能發出皺眉表情包。

以上功能來自一款名為 C-Face 耳機的設備,它誕生于康奈爾大學華人科學家張鋮的 SciFi 實驗室。他近日以通訊作者身份在 UIST 2020(User Interface Software and Technology)會議上發表了這項研究,論文名為《即使戴著口罩耳機也可以跟蹤面部表情》(Earphone tracks facial expressions, even with a face mask)。 圖 | 張鋮(來源:受訪者) 除張鋮之外,論文第一作者還有來自北京大學、目前在康奈爾大學訪問的本科生陳拓潮。 論文表示,該耳機可通過觀察臉頰輪廓,來連續跟蹤面部表情,并能把表情轉換為表情符號、或無聲語音命令。DeepTech 聯系到張鋮,并就該耳機和其進行了深入交流。 圖 | 耳機的展示視頻 他表示,C-Face 耳機是實驗室系列研究的其中一款設備。該系列研究主要探索信息的獲知,如果缺乏信息,計算機就很難理解人類動機和行為。而 SciFi 實驗室的長期工作,是致力于提升人機交流,但是第一步,計算機需要獲取到信息。 攝像頭是獲取信息的最常用手段之一,比如在室內外布置攝像頭,并且攝像頭必須沒有遮擋,這就導致傳統的 “攝像頭方法” 會在某些場景中失靈。比如,在獲取臉部表情時,是用攝像頭直接 “捕捉” 人臉,但用戶在外面時,不可能時刻臉部對著攝像頭。 而本次的 C-Face 耳機,正是一款可用于實時獲取臉部信息的耳機。其原理是,由于人臉有很多肌肉,肌肉之間相互連接,臉部在做不同表情時,其他肌肉也會被牽動,嘴巴、眼睛和眉毛的位置與形狀也會發生變化。基于此,經該實驗室的設計后,耳機可通過比較容易捕捉到的肌肉變化來推測出面部表情。

圖 | 不戴口罩時戴著耳機做表情 由于新冠疫情的影響,研究人員只能在 9 名參與者的情況下測試耳機。盡管如此,表情符號的識別準確度仍然超過 88%,面部提示的準確度超過 85%。

圖 | 戴口罩時戴著耳機做表情 具體來說,耳機內置兩個迷你攝像頭,它們可以捕捉到側面臉頰形狀,并通過臉頰形狀來判斷你的臉部表情。因為人在執行面部特征時,面部肌肉組織就會拉伸和收縮,進而推動和拉動毛孔和皮膚,并對面部肌肉組織的緊繃產生影響,這種影響會導致臉頰輪廓發生改變。

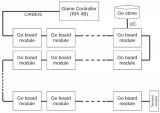

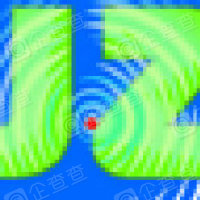

在耳機中,攝像頭可以傳輸數據,數據會傳輸到微處理器(Raspberry Pi),微處理器收集數據,并把它發到計算機上,這時深度學習算法就能開始工作。 深度學習在耳機中的應用 很多情況下,深度學習在數據上的效果,比傳統機器學習的效果更好。本次耳機之要想實現根據側臉和臉頰形狀來推斷整個面部表情,其實并不容易,因為每個人的側臉都不一樣。 因此,就得通過深度學習來采集訓練數據,具體做法是先采集到用戶臉頰變化情況,并結合前置攝像頭來捕捉面部表情,以標記出相對應的臉部表情。 這相當于攝像頭每一幀圖片,都有一個對應的面部表情。采集到訓練數據后,研究人員就能發掘出不同臉頰形狀與面部表情間的復雜對應關系。

張鋮表示,深度學習的好處是能通過復雜學習,來學習一些人類不擅長的技能。有的技能人類很擅長,比如一眼就能識別某些物體。但有些技能人類并不擅長,比如只根據側面臉頰,我們很難判斷出臉部全部形狀。 深度學習的能力是,可通過算法找出事物間的復雜聯系,從而根據側部面頰,準確推斷出面部表情。 具體工作時,在攝像機捕獲圖像后,計算機視覺和深度學習模型會對其進行重建。由于原始數據是二維的,因此卷積神經網絡(一種擅長對圖像進行分類、檢測和檢索的人工智能模型)有助于將輪廓重構為表達式。 此外,該模型可將臉頰圖像轉換為 42 個面部特征點,它們分別代表受表情變化影響最大的部位,如嘴巴、眼睛、眉毛等。 這 42 個特征點代表的面部表情,也可用于推測出 8 個表情符號,包括 “無表情”“生氣” 和 “ Kissy-face”,另外還有 8 個可用于控制音樂設備的靜音語音命令,如 “播放” ,“下一首” 和 “音量增大” 等。

相比傳統方法用前置攝像頭來識別表情,C-Face 耳機的獨特優勢是戴著口罩也能被耳機捕捉到表情,即攝像機無需對著人臉,只需觀察從耳朵到側面臉頰的形狀就能識別表情。 因為即使你戴著口罩(超大口罩除外),側面臉頰形狀并不會發生巨大改變,這時深度學習仍然可以工作。

本次研究還展示了 C-Face 耳機的兩大功能:無聲語音識別和前文的輸入表情包。 無聲語音識別指的是,一般的語音識別,都是通過聲音來識別。如果不通過聲音,是否也能識別?因為,假如你在開會、看電影等場合,突然說話就會很奇怪。再就是,當周圍有很多噪音,即便說話也無法識別。 而 C-Face 耳機可通過分析用戶表情,來識別沉默的語音指令。這一功能的常見應用場景有,當你跑步時只需做個嘴形,相關智能設備就能以非常私密的方式,來獲悉你的指令。 另一個可以想象的應用場景是健康預測,張鋮表示,未來該耳機有望連續記錄表情。獲得大量表情數據后,就可獲知用戶每天的心情狀況。這樣大量的情緒信息,還可幫助計算機了解用戶的精神健康狀況。

兩款耳機:入耳式和頭戴式 本次耳機分為兩款:入耳式和頭戴式,功能上它們非常類似。張鋮表示,它們所屬項目都叫 C-Face,該項目并不局限于某一種特定的設備,只是在本次論文中展示了入耳式耳機和頭戴式耳機。 唯一的區別是,兩種耳機的攝像頭位置略微不同。頭戴耳機相對大一點,有較大空間放攝像頭。 談及耳機是否可用于 VR 游戲,張鋮表示,經常有人問他這個問題,而他的答案一直是 Yes or NO。 即當然可以用在 VR 上面,但以他了解到的最新技術來說,VR 眼鏡已有更好的解決方案。 VR 眼鏡本身已經很大,通過在上面加設備來捕捉人的表情,此前已經有人做過。而 C-Face 耳機的好處是它非常小,日常可以進行穿戴。因此,他覺得 VR 眼鏡不一定是 C-Face 耳機最核心的爆點。

他舉例稱,該實驗室的耳機可以潛在地提供視頻聊天功能。現在的視頻聊天,都需要用戶面前放置一個攝像頭 (桌子上或者手舉著)。 但如果用耳機來聊天,耳機自己就能捕捉你的面部表情,你也不需要把攝像頭對著臉,你的朋友時時刻刻都能看到你的臉,包括走路時、開車時、甚至做飯時都可以跟人聊天。 解決功耗問題,就能加速落地 談及商業落地,張鋮表示本次論文發表后,有廠商已經和他們聯系討論一些初步的合作可能性。但想在短期內實現到現有設備,最需要解決的仍然是可穿戴設備上的功耗問題。而這一難題,超出了該實驗室的能力,因此需要工業界投入資金去優化功耗問題。

目前的耳機,是研究人員買來零件組裝的,攝像頭可以選配,只是價錢和分辨率會有區別。在零件的選擇上,他們未做過高要求,目的是讓設備更快速落地成產品。 他認為,該實驗室做這款設備,更多是著眼于未來。他們做研究的目的,更多是描述研究人員眼中的未來可能性。 張鋮表示,未來的攝像頭可能會變得非常小、功耗也非常低。盡管現在的耳機只是實驗室設備,但是如果能耗問題得以解決,它有可能在 5 到 10 年后實現應用。 如果想把小型攝像頭利用到現有設備上,能耗是個很大的問題。因為,攝像頭會耗電,處理攝像頭數據也會耗電,這是該設備的最大局限性。 就落地為產品來說,頭戴式耳機短期內可能相對方便一點,因為它可以放置更大的電池。對于入耳式耳機,該實驗室未來也會尋找更加低功耗的方法來解決問題。

因為如果把攝像頭裝在耳機上,那么攝像頭的耗電量肯定比耳機多。這種情況下,無論產品有多么酷炫,如果使用十分鐘就沒電了,也不會有人愿意購買。 如果想快速推出該耳機,可能只能先實現一部分功能,因為工業界做產品都有一個提前周期,比如要想現在發布一款產品,可能兩年前就得開始規劃。 與此同時,該實驗室并不局限于耳機,他們關注的是 “無處不在的計算和人機交互”,未來還有可能研發出智能耳環、智能衣服,而他們的愿望就是讓似乎無法智能的物體也變得智能起來。 -End-

原文標題:耳機可檢測表情?戴著口罩也可以,華人科學家新發明讓人臉變成“表情包”

文章出處:【微信公眾號:DeepTech深科技】歡迎添加關注!文章轉載請注明出處。

責任編輯:haq

-

處理器

+關注

關注

68文章

19798瀏覽量

233423 -

耳機

+關注

關注

28文章

3039瀏覽量

83043 -

人臉識別

+關注

關注

76文章

4069瀏覽量

83616

原文標題:耳機可檢測表情?戴著口罩也可以,華人科學家新發明讓人臉變成“表情包”

文章出處:【微信號:deeptechchina,微信公眾號:deeptechchina】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

基于XIAO RP2040和樹莓派的圍棋棋盤游戲系統設計

開源項目!能夠精確地行走、跳舞和執行復雜動作的機器人—Tillu

mtu配置步驟詳解 mtu與數據包丟失的關系

ATA-7030高壓放大器在電致變形柔性致動器表情機器人實驗中的應用

LM4875可通過控制DC Vol腳的電壓來改變增益,如果用兩個音量按鍵來控制音量要怎么做?

低功耗Bluetooth–有關CC1350和CC26x0器件通過SPI發送的UNPI數據包缺失長度檢查

開源六軸協作機器人myCobot 320結合人臉表情識別情緒!

esp8266怎么做才能每秒發送更多的數據包呢?

請問如何使用AT CIPSEND或AT CIPSENDBUF發送多個數據包?

曠視AI開源新突破:上傳照片即可生成表情包視頻!

NONOS如何檢查是否實際發送了UDP數據包?

加入IGMP組后,數據包不再通過UDP發送,為什么?

若用mdf的router例程來做開發,是否需要在應用層通過心跳包來檢測mesh組網網絡是否正常?

機器人動態表情模塊JZRF-----江智公司開始全面對外開放提供

可通過面部表情來發送表情包的耳機

可通過面部表情來發送表情包的耳機

評論