一些科技公司在成立之初就引起了轟動,而另一些公司似乎則大跌眼鏡。

Genderify是一項新服務,承諾通過幫助AI通過分析某人的姓名,電子郵件地址或用戶名來識別某人的性別,該服務肯定會進入后者。該公司上周在Product Hunt上啟動,但由于用戶發現其算法中存在偏見和不準確之處,因此在社交媒體上引起了很多關注。

例如,在Genderify中輸入名稱“ Meghan Smith”,該服務將提供評估:“男性:39.60%,女性:60.40%。” 將該名稱更改為“ Dr. 但是,梅根·史密斯(Meghan Smith)的評估改為:“男性:75.90%,女性:24.10%。” 以“ Dr”開頭的其他名稱也會產生相似的結果,而輸入似乎通常會使男性傾斜。例如,“ Te[email protected]”是男性的96.90%,而“ Joan smith太太”是男性的94.10%。

對該服務的強烈抗議令Genderify告訴The Verge它已完全關閉。“如果社區不想要它,也許這很公平,”一位代表通過電子郵件說。Genderify.com已脫機,其免費API不再可用。

盡管這類偏見經常出現在機器學習系統中,但是Genderify的輕率性似乎使該領域的許多專家感到驚訝。AI Now Institute的聯合創始人梅雷迪思·惠特克(Meredith Whittaker)的回應有些典型,它研究了人工智能對社會的影響。“我們被巨魔了嗎?” 她問。“這是一種意念,旨在分散技術+正義世界的注意力嗎?現在是愚蠢的高科技愚人節嗎?”

對人們的性別進行大規模假設可能有害

問題不在于Genderify根據某人的名字對某人的性別做出假設。人們一直在這樣做,有時會在過程中犯錯。這就是為什么禮貌地找出人們如何自我識別以及如何應對他們的原因。Genderify的問題在于它會自動執行這些假設。在將個體分類為男性/女性二進制數(從而忽略識別為非二進制數的個體)的同時大規模應用它們,同時在此過程中加強性別定型觀念(例如:如果您是醫生,您可能是男人)。

這樣做的潛在危害取決于使用Genderify的方式和位置。例如,如果將服務集成到醫療聊天機器人中,則其關于用戶性別的假設可能導致聊天機器人發布誤導性的醫療建議。

值得慶幸的是,Genderify似乎并非旨在實現這種系統的自動化,而是主要被設計為一種營銷工具。正如Genderify的創建者Arevik Gasparyan在Product Hunt上所說:“ Genderify可以獲得的數據將有助于您進行分析,增強客戶數據,細分營銷數據庫,人口統計數據等。”

在同一評論節中,Gasparyan承認一些用戶對偏見和無雙數個人的關注,但未提供任何具體答案。

一位用戶問:“假設我選擇不識別男性還是女性,您如何處理?您如何避免性別歧視?您如何應對性別偏見?” Gasparyan回答說,該服務基于“已經存在的二進制名稱/性別數據庫”做出決定,并且該公司正在“通過分離“概念”來“積極尋找改善跨性別和非二進制訪問者體驗的方法”。性別身份的姓名/用戶名/電子郵件。” 鑒于Genderify的整個前提是該數據是性別身份的可靠代表,所以這是一個令人困惑的答案。

該公司告訴The Verge,該服務與使用名稱數據庫猜測一個人的性別的現有公司非常相似,盡管它們都沒有使用AI。

一位代表通過電子郵件表示:“我們知道我們的模型永遠無法提供理想的結果,并且算法需要進行重大改進,但我們的目標是構建一種不會像任何現有解決方案一樣受到偏見的自學習AI。” “并且要使其發揮作用,我們非常依賴跨性別和非二進制訪問者的反饋,以幫助我們為LGBTQ +社區盡最大可能改善我們的性別檢測算法。”

-

AI

+關注

關注

88文章

35065瀏覽量

279285 -

自動化

+關注

關注

29文章

5778瀏覽量

84785 -

人工智能

+關注

關注

1806文章

48996瀏覽量

249180

發布評論請先 登錄

HarmonyOS AI輔助編程工具(CodeGenie)報錯分析

AI智能體對電子企業的幫助是什么

高頻PCB設計中出現的干擾分析及對策

DCDC BUCK通過加RC Snubber解決EMI輻射超標的仿真和實測數據分析

企業通過AI技術定制提升營業收入

通過Java和MCP創建Git AI倉庫助手

《零基礎開發AI Agent——手把手教你用扣子做智能體》

廣和通AI玩具解決方案通過火山引擎成功接入DeepSeek開源模型

0xmd公司通過NVIDIA GPU打造醫療AI解決方案

名單公布!【書籍評測活動NO.55】AI Agent應用與項目實戰

如何通過駐波分析電路

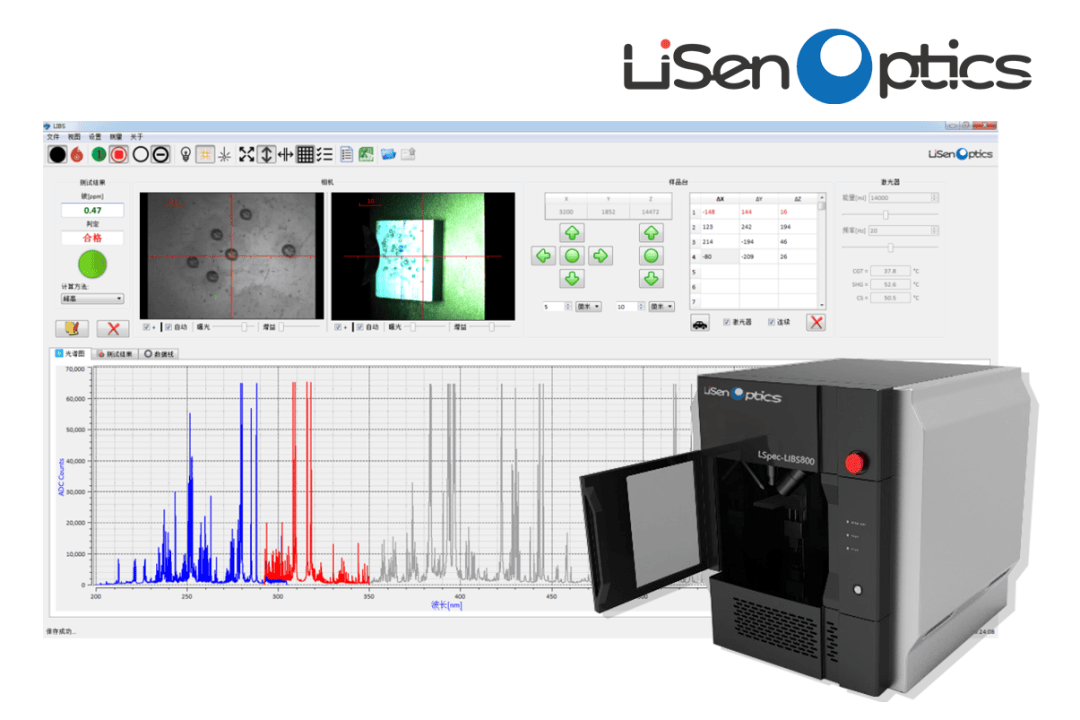

如何通過LIBS推動綠色科技?

通過幫助AI通過分析某人的姓名?

通過幫助AI通過分析某人的姓名?

評論