MIT開發的GANpaint工具可以輕松修圖,允許用戶上傳任何照片進行編輯,而不會破壞其原始細節。除了幫助藝術家和設計師快速調整視覺效果外,研究人員表示,這項工作可能有助于計算機科學家識別“虛假”圖像。

當我們還沉浸在GauGAN憑借幾根線條,就讓草圖秒變風景照的黑科技之時,MIT也帶來了一項類似的黑科技。

自從GAN誕生以來,一次一次創造著奇跡:填充紋理、變臉易容。但這一次,這款名叫GANpaint的神器,簡單幾筆就能成畫。

麻省理工學院和IBM的團隊推出“GANpaint Studio”,允許用戶上傳任何照片,然后對照片進行創作,例如更改對象的大小或者添加全新的項目(如樹木和建筑物),接下來這個系統可以自動生成逼真的攝影圖像。

除了幫助藝術家和設計師快速調整視覺效果外,研究人員表示,這項工作還可能有助于計算機科學家識別“虛假”圖像。

也難怪網友驚呼:“以后拆樓都不用費勁了!”

那么這款神器如何操作呢?先奉上傳送門:

http://gandissect.res.ibm.com/ganpaint.html?project=churchoutdoor&layer=layer4

首先,在界面下方選擇底圖;其次,在左側選擇一個對象,如“草”、“門”、“天空”等等;然后選擇要進行的操作,例如“繪畫”、“刪除”等;最后,只需要在圖片中想要更改的區域涂抹幾筆即可。

“現在的機器學習系統就是黑盒子,我們并不總是知道如何改進,有點像你小時候通過拍打舊電視機來修正圖像不能顯示的bug。”論文主要作者、麻省理工學院計算機科學與人工科學博士生David Bau說。他將該項目描述為計算機科學家首次能夠實際“用神經元繪制神經網絡”。

設計師的福報

項目領導人、麻省理工學院教授Antonio Torralba認為該項目具有巨大的潛在應用。設計師和藝術家可以使用它來更快地調整視覺效果。想象一下,一位導演拍完戲后發現,背景中少一個對劇情很重要的道具!這個時候GANpaint Studio就可以來大顯身手了。

通過分析需要刪除的“人造”單元,GANpaint Studio還可用于改進和調試正在開發的其他GAN。除此之外,它還可以幫助研究人員更好地理解神經網絡及其底層結構。

一個意外的發現是系統實際上似乎已經學習了一些關于對象之間關系的簡單規則。它自己會通過某種方式,知道什么東西應該出現在什么地方,不應該出現在不屬于它的地方(例如天空中不應該出現窗戶)。

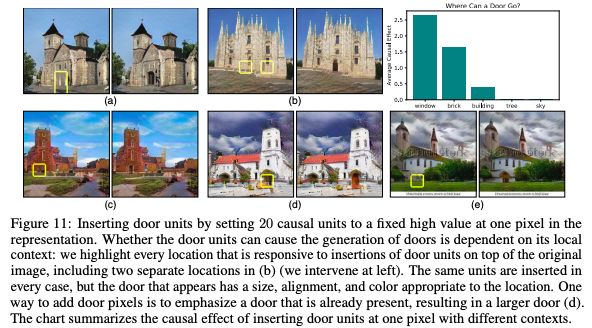

在不同的環境中,它可以創造出不同的視覺效果。例如,假設圖像中有兩個不同的建筑物,我們需要為這兩個建筑物添加兩個門,GANpaint Studio并不會粗暴的復制兩個相同的門上去,而是會添加兩扇不一樣的門。

“所有繪圖應用程序都將遵循用戶指令,但如果用戶命令將對象放在不合理的位置,我們可能決定不繪制任何內容”Torralba說。“這是一個具有強烈個性的繪圖工具,它打開了一個窗口,讓我們了解GAN如何學會代表視覺世界。”

“這項工作確實簡直令人興奮,讓我們直接看到GAN學習東西的方式,開始看起來有點像常識認知。”芬蘭阿爾托大學副教授Jaakko Lehtinen說,“我認為這種能力是擁有可以在人類世界中發揮作用的自主系統的關鍵基石,這種系統是無限的,復雜的,不斷變化的。”

找出“假”圖像

該團隊的目標是讓人們更好地控制 GAN 網絡。但是他們認識到,隨著性能的增加,濫用的可能性非常可怕,試想一下將這些技術用在醫療照片上將會多么的可怕!論文共同作者朱俊彥表示,他相信更好地了解 GAN,包括 GAN 所犯的錯誤,這將有助于研究人員更好地消除假冒的照片。

“你需要先了解你的對手才能防御它,”CSAIL的博士后朱俊彥說。“這種理解可能有助于我們更輕松地檢測假圖像。”

為了開發該系統,研究團隊首先確定了GAN內部與特定類型的對象(如樹木)相關的單元。然后,單獨測試這些單元,看看是否擺脫它們會導致某些物體消失或出現。重要的是,他們還確定了導致視覺錯誤(工件)的單元,并努力將其移除以提高圖像的整體質量。

IBM的研究科學家Hendrik Strobelt說:“每當GAN產生非常不切實際的圖像時,這些錯誤的原因以前就是一個謎。但現在我們發現這些錯誤是由特定的神經元觸發的,那么就可以先停掉這個神經元,以提高圖像的質量。”

“這個系統為更好地理解GAN模型打開了一扇大門,這將有助于我們對GAN進行任何類型的研究,”Lehtinen說。

GANpaint憑什么如此神奇?

生成對抗網絡(GANs)最近在許多實際應用中取得了令人印象深刻的結果,并且隨著樣本質量和訓練穩定性的提高,出現了許多GAN的變體。然而,對GAN的可視化和理解在很大程度上是缺失的。

因此,來自MIT、香港中文大學、IBM等學校/機構的David Bau、朱俊彥、Joshua B.Tenenbaum、周博磊等人發表論文,并在文中提出了GANpaint這款工具。他們將于下個月在洛杉磯舉行的SIGGRAPH會議上發表演講。

在這項工作中,研究人員提出了一個分析框架來在單元、對象和場景級別可視化和理解GAN:

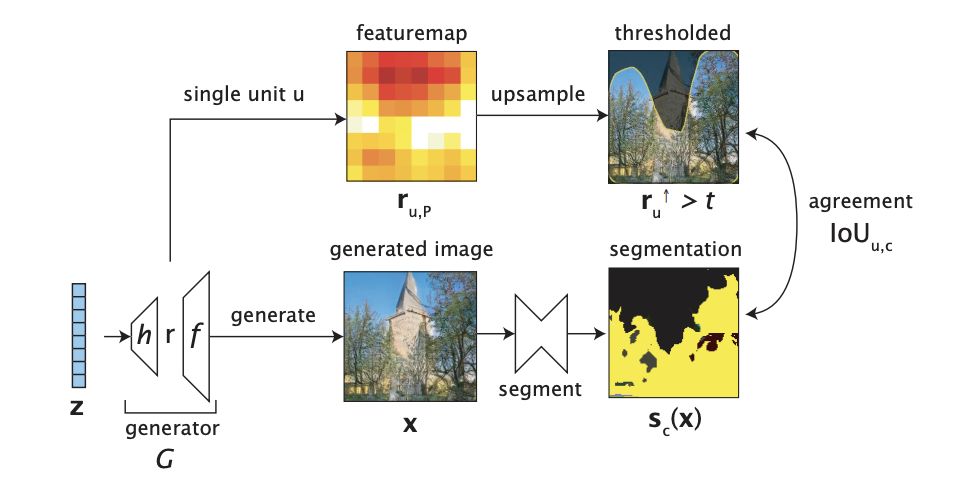

首先,用基于分段的網絡剖分方法識別一組與對象概念密切相關的可解釋單元;

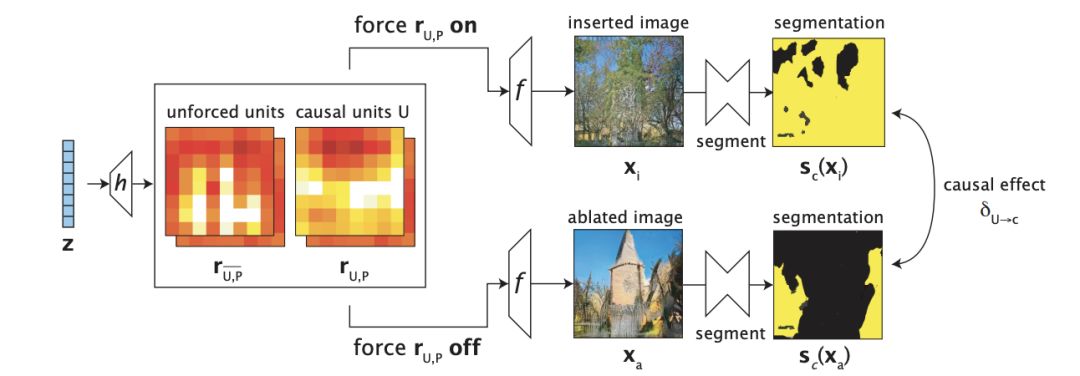

然后,通過測量“干預”的能力來量化可解釋單位的因果效應;

最后,通過將發現的對象概念插入到新圖像中,以此來檢查這些單元與其周圍環境之間的關系。

研究人員的主要目標是分析如何通過GAN生成器的內部表征,來對“樹”等對象進行編碼:

通過剖析(dissection)來表征單元

使用干預(intervention)測量因果關系

實驗結果

工作人員研究了在LSUN場景數據集上訓練的三種Progressive GAN的變體。為了對生成的圖像進行分割,我們使用一個最近的模型 (Xiao et al., 2018) 在ADE20K場景數據集上訓練。

該模型可以將輸入圖像分割為336個物體類,29個大物體和25個材質類。為了進一步識別專門用于對象部件的單元,我們將每個對象類c擴展為另外的對象部件類ct,cb,cl和cr,分別表示連接組件的邊界框的頂部,底部,左半部分或右半部分。。

診斷和改進GANS

框架不僅可以揭示GAN是如何成功地生成真實圖像的,也可以分析結果失敗的原因。

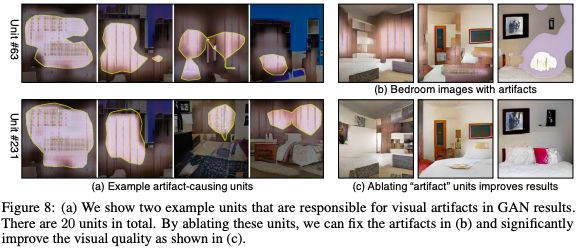

如圖8所示,圖8a顯示了幾個注釋單元,負責GAN結果中的visual artifacts;圖8b顯示了artifacts被成功移除,并且自由像素保持不變的改進的生成結果。

圖8: (a)兩個負責GAN結果中 visual artifacts的示例單元。總共有20個單元。通過消融這些單元,我們可以修復(b)中的artifacts,并顯著提高(c)中的視覺質量。

通過消融定位因果單元

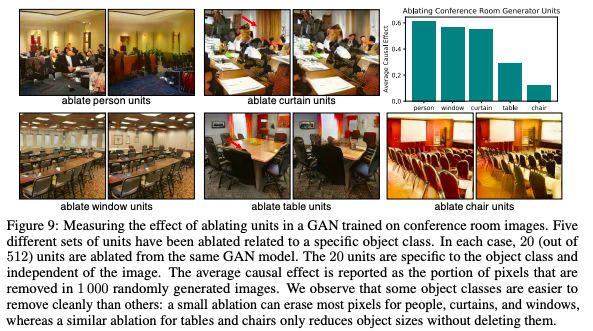

圖9:測量在會議室圖像訓練的GAN中消融單元的效果

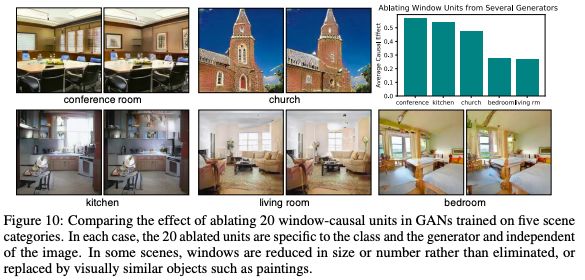

如圖10所示,雖然可以在會議室圖像中很好地移除窗戶,但是在其他場景中刪除窗戶則比較困難。

圖10:比較在五個場景類別訓練的GAN中消融20個窗戶單位的效果。

通過插入表征上下文關系

也可以通過強制單元和插入這些功能到場景中的特定位置來學習GAN的操作。圖11顯示了在教堂場景中插入20層門單元的效果。

圖11:通過在表示中的一個像素處將20個causal units設置為固定的高值來插入 door units。

-

圖像

+關注

關注

2文章

1092瀏覽量

41003 -

MIT

+關注

關注

3文章

254瀏覽量

24200 -

計算機科學

+關注

關注

1文章

144瀏覽量

11542

原文標題:暴力解剖GAN!MIT、港中文團隊GANpaint,一筆成畫不是夢

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

麻省理工學院打造人工智能應用Shelley寫小說

ADI公司與麻省理工學院合作研發用于病人監護的醫療技術

麻省理工學院開發了一個名為MapLite的框架,允許在缺乏3D地圖的道路上進行操作

麻省理工學院探索如何使用VR/MR技術,成立高級VR技術中心

麻省理工學院發布了你獵豹小型四足機器人 最終不被人所控制

谷歌聯手麻省理工學院研究冷聚變 進展才得以發布

麻省理工學院研究團隊開發出了一款線性機器人

麻省理工學院開發新系統,通過肌肉信號控制機器人

基于麻省理工學院的磁鐵為商業聚變發電提供了可行的途徑

麻省理工學院和IBM的團隊推出“GANpaint Studio”自動生成逼真的攝影圖像

麻省理工學院和IBM的團隊推出“GANpaint Studio”自動生成逼真的攝影圖像

評論