看點:AI被騙?解密神奇貼紙背后的算法,如何讓人類躲過智能監(jiān)控。

智東西4月24日消息,攝像頭用AI識別圖像和視頻中的人臉和身體正變得越來越常見,小到超市、辦公室,大到自動駕駛、智慧城市,能夠快速抓取人體、識別人臉的智能攝像頭正變得無處不在。

不過,最近,一組研究團隊設(shè)計了一張?zhí)貏e的彩色圖案,只要你將這塊40cmx40cm的神奇貼紙掛在身上,就可以避開AI攝像頭的監(jiān)控。

這個團隊來自比利時魯汶大學(xué)(Katholieke Universiteit Leuven),他們發(fā)表了一篇論文,名為《欺騙自動監(jiān)控攝像頭:針對攻擊人類監(jiān)控的對抗補丁(Fooling automated surveillance cameras: adversarial patches to attack person detection)》。

論文上署名的三位研究人員Simen Thys、Wiebe Van Ranst和Toon Goedeme使用了流行的YOLOv2開源對象識別探測器進行了演示,他們通過用一些技巧成功騙過了探測器。

論文鏈接:https://arxiv.org/pdf/1904.08653.pdf

他們已經(jīng)在論文中公布了源代碼:

https://gitlab.com/EAVISE/adversarial-yolo。

宛如“隱形斗篷”的神器貼紙

我們先來看看這個研究小組究竟做了個什么東西。

如圖,右邊的人身上掛了一塊彩色貼紙,這張貼紙成功欺騙了AI系統(tǒng),使他即便正面攝像頭,也沒有像左邊的人那樣被AI系統(tǒng)檢測出來(粉色框)。

右邊的人將貼紙反轉(zhuǎn)過來,立即被檢測出。

等右邊的人將貼紙交給左邊的人后,AI瞬間就檢測不出左邊的人。

研究人員指出,該技術(shù)可用于“惡意繞過監(jiān)視系統(tǒng)”,允許入侵者“通過在他們的身體前面拿著一塊小紙板朝向監(jiān)控攝像頭做些偷偷摸摸的行為(而不被發(fā)現(xiàn))”。

據(jù)外媒報道,論文作者之一Van Ranst透露,采用現(xiàn)成的視頻監(jiān)控系統(tǒng)來解決這個問題應(yīng)該不會太難。“目前我們還需要知道哪個探測器正在使用中。我們今后想要做的是生成一個同時適用于多個探測器的補丁”,“如果這樣有效,那么補丁也可能對監(jiān)控系統(tǒng)中使用的探測器起作用。”

▲貼片的角度和位置對AI檢測人的能力有所不同

該小組現(xiàn)在正計劃將補丁應(yīng)用于服裝。

好比著名的威廉·吉布森(William Gibson)科幻小說《零歷史(Zero History)》所描述的情節(jié),研究人員寫道:“我們相信,如果我們將這種技術(shù)與精致的服裝模擬結(jié)合起來,我們就可以設(shè)計出一種T恤印花,可以讓一個人對自動監(jiān)控相機幾乎不可見。”

未來他們的工作將側(cè)重于使補丁更加健壯和可遷移,因為它們不能很好地適用于不同的檢測架構(gòu),如Faster R-CNN 。

“對抗補丁”是怎樣煉成的?

這項研究的核心目的是創(chuàng)造一個系統(tǒng),能夠生成可打印的對抗補丁,用于“愚弄”人類探測器。

研究人員寫道:“我們通過優(yōu)化圖像來實現(xiàn)這一目標,以最大限度地減少與探測器輸出中人物外觀相關(guān)的不同概率。在我們的實驗中,我們比較了不同的方法,發(fā)現(xiàn)最小化對象丟失創(chuàng)造了最有效的補丁。”

然后他們打印出經(jīng)過優(yōu)化的補丁,并通過拍攝持有他們的人來測試它們。

研究人員發(fā)現(xiàn),只要定位正確,補丁就能很好地工作。

“根據(jù)我們的結(jié)果,我們可以看到我們的系統(tǒng)能夠顯著降低人體探測器的準確性……在大多數(shù)情況下,我們的補丁能夠成功地將人員隱藏在探測器之外。在不是這種情況下,補丁與人的中心不對齊。”研究人員說。

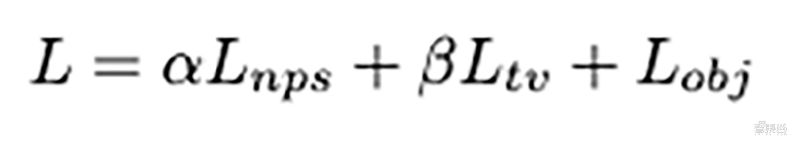

優(yōu)化器的目標就是最小化總損失函數(shù)L。具體優(yōu)化目標包括三個損失函數(shù):Lnps(非可打印性得分)、Ltv(圖像總變化)、Lobj(圖像中的最大對象分數(shù))。

Lnps代表貼紙中的顏色在多大程度上可由普通打印機打印出來;

Ltv確保優(yōu)化器支持平滑顏色過渡的圖像并防止圖像噪聲;

Lobj用于對探測器輸出的目標或類別分數(shù)實現(xiàn)最小化。

上述三個損失函數(shù)相加即可得到總損失函數(shù):

YOLOv2探測器輸出一個單元網(wǎng)格,每個單元格包含一系列錨點,每個錨點包含邊界框的位置、對象概率和類別得分。

為了讓探測器忽略圖像中的人,研究人員使用MS COCO數(shù)據(jù)集進行訓(xùn)練,嘗試了三種不同的方法:最小化類人的分類得分(圖4d),最小化對象得分(圖4c),或兩者的組合(圖4b和4a)。

其中,第一種方法可能致使生成的補丁被檢測成COCO數(shù)據(jù)集的另一個類,第二種方法不存在這一問題,但生成貼紙針對某個類的特定性比其他方法低。

通過對各類“補丁”做實驗,最后研究人員發(fā)現(xiàn),經(jīng)過多次圖像處理的隨機物體的照片效果最好,他們嘗試了多種隨機轉(zhuǎn)換,包括圖像旋轉(zhuǎn)、隨機放大和縮小、隨機添加隨機噪聲、隨機修改正確率和對比度等處理。

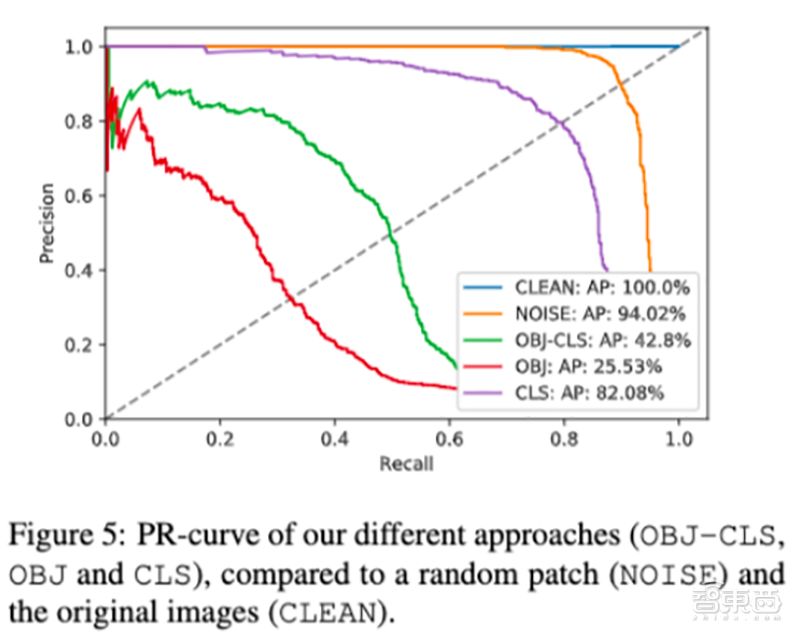

最終,研究人員將獲得的幾個補丁和NOISE(隨機添加噪聲)、CLEAN(無補丁baseline)一起放在Inria測試集上做評估,重點評估這些補丁能避開多少監(jiān)控系統(tǒng)產(chǎn)生的警報。

結(jié)果表明,OBJ補丁觸發(fā)的警報數(shù)量最低(25.53%)。

不同補丁的測試效果對比如下:

第1行沒有補丁,第2行使用隨機補丁,第3行使用最佳補丁,效果很明顯,最佳補丁在多數(shù)情況下能成功讓人類躲過AI的檢測。

不過,這個補丁并不是完美的,效果不好時可能是因為它沒和人對齊。

對抗攻擊并非新鮮事

隨著AI的快速發(fā)展,視頻監(jiān)控、自動駕駛、無人機和機器人、語音識別、文本篩查等多個AI細分領(lǐng)域都涉及到了越來越多的安全問題。

精確度日益增長的深度學(xué)習(xí)網(wǎng)絡(luò),被發(fā)現(xiàn)極容易受到對抗攻擊的影響。

比如向原圖像添加一點精心設(shè)計的干擾,就有可能會使得一個分類模型做出錯誤的判斷,致使它將被修改后的圖像標注為完全不同的其他物體。

基于這一背景,越來越多的研究人員正在對真實世界的對抗攻擊感興趣。

2016年11月,來自卡內(nèi)基梅隆大學(xué)和北卡羅來納大學(xué)的研究人員展示了如何使用一對打印的眼鏡架來擊敗面部識別系統(tǒng)。

研究人員稱:“當它的圖像提供給一個國家的最先進的面部識別算法的攻擊者戴,眼鏡讓她逃避被認可或假冒他人”。

據(jù)稱,戴上鏡框后識別錯誤率高達100%,壞人可以利用這種識別漏洞躲過軟件的檢測,進而輕易偽裝成他人,成功用面部識別完成設(shè)備解鎖。

▲上面為真人,下面為系統(tǒng)識別出的人

2017年10月,日本九州大學(xué)的Su Jiawei等人提出了黑箱DNN攻擊,通過使用差分進化(differential evolution)擾亂少數(shù)像素(1024個像素中只擾亂1、3、5個像素)的方式,只需修改圖片中的幾個像素,即可讓深度神經(jīng)網(wǎng)絡(luò)完全判斷錯誤。

2018年,伯克利人工智能研究實驗室(BAIR))演示了針對 YOLO 檢測器的實體對抗樣本,同樣采用貼紙擾動的形式,在“STOP”路標上粘貼了一些精心設(shè)計過的貼紙。

結(jié)果YOLO 網(wǎng)絡(luò)在幾乎所有幀中都無法感知識別出「停止」標志。同樣,其為 YOLO 檢測器生成的實體對抗樣本也可以騙過標準的 Faster-RCNN。

我們可以想象一下,假使一輛在道路上行駛的自動駕駛汽車,看見被貼了這樣貼紙的路標,一旦它被貼紙誤導(dǎo),沒看懂路標,就有可能發(fā)生難以挽回的交通慘案。

結(jié)語:最優(yōu)防御策略還在探索中

長期以來,對抗攻擊一直是機器學(xué)習(xí)領(lǐng)域有趣又非常重要的課題。

如今AI逐漸大面積應(yīng)用于日常監(jiān)控攝像頭和軟件中,出現(xiàn)在零售、工作空間、社區(qū)、交通等諸多場景。

而對抗樣本有可能會鉆神經(jīng)網(wǎng)絡(luò)的漏洞,比如使得一些小偷可以避開監(jiān)控攝像頭在無人商店自由偷東西,或者使得入侵者成功進入某棟建筑。

當前,研究人員們還遠未找到針對這些對抗樣本的最優(yōu)防御策略,我們不妨期待對這一激動人心的研究領(lǐng)域會在不久之后出現(xiàn)突破性的進展。

本賬號系網(wǎng)易新聞·網(wǎng)易號“各有態(tài)度”簽約帳號

-

攝像頭

+關(guān)注

關(guān)注

61文章

4948瀏覽量

97635 -

AI

+關(guān)注

關(guān)注

87文章

34146瀏覽量

275282 -

智能監(jiān)控

+關(guān)注

關(guān)注

5文章

258瀏覽量

32189

原文標題:神奇貼紙騙過AI!人類被“隱形”,智能監(jiān)控的危機來了?

文章出處:【微信號:CAAI-1981,微信公眾號:中國人工智能學(xué)會】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

AI算法的本質(zhì)是模擬人類智能,讓機器實現(xiàn)智能化

了解AI人工智能背后的科學(xué)?

騰訊叮當聯(lián)手Alavening發(fā)布智能鬧鐘“阿拉的神奇小鬧鬧”

AI芯片談算法不談智能,談實現(xiàn)不談芯片!

『深思考』打造人工智能機器大腦,讓AI更懂你!

機器能超越真正的人類嗎?人工智能未來發(fā)展如何?

【技術(shù)雜談】動畫演示各大算法,助力 AI 小白順利入門

人工智能能否取代人類?

【免費直播】AI芯片專家陳小柏博士,帶你解析AI算法及其芯片操作系統(tǒng)。

【免費直播】讓AI芯片擁有最強大腦—AI芯片的操作系統(tǒng)設(shè)計介紹.

《移動終端人工智能技術(shù)與應(yīng)用開發(fā)》人工智能的發(fā)展與AI技術(shù)的進步

AI 人工智能的未來在哪?

一南京女子疑遇AI換臉被騙錢

AI 新騙局:某科技公司老板 10 分鐘被騙 430 萬!

中偉視界:解密AI智能攝像機算法,讓傳送帶跑偏檢測更高效!

AI被騙?解密神奇貼紙背后的算法,如何讓人類躲過智能監(jiān)控

AI被騙?解密神奇貼紙背后的算法,如何讓人類躲過智能監(jiān)控

評論