Nemotron-4 340B 是針對 NVIDIA NeMo 和 NVIDIA TensorRT-LLM 優(yōu)化的模型系列,該系列包含最先進的指導(dǎo)和獎勵模型,以及一個用于生成式 AI 訓(xùn)練的數(shù)據(jù)集。

NVIDIA 于近日發(fā)布Nemotron-4 340B。開發(fā)者可以使用這組開源模型生成用于訓(xùn)練大語言模型(LLM)的合成數(shù)據(jù),訓(xùn)練出的 LLM 可用于醫(yī)療、金融、制造、零售等各個行業(yè)的商業(yè)應(yīng)用。

高質(zhì)量的訓(xùn)練數(shù)據(jù)對于自定義 LLM 的性能、準(zhǔn)確性和回答質(zhì)量來說至關(guān)重要,但強大的數(shù)據(jù)集通常非常昂貴且難以獲得。

通過獨樹一幟的開源模型許可證,Nemotron-4 340B 為開發(fā)者提供了一種免費、可擴展的合成數(shù)據(jù)生成方法,幫助他們構(gòu)建強大的 LLM。

Nemotron-4 340B 系列包含基礎(chǔ)模型、指導(dǎo)模型和獎勵模型,由它們組成的流水線能夠生成用于訓(xùn)練和完善 LLM 的合成數(shù)據(jù)。為了能夠與NVIDIA NeMo協(xié)同工作,這些模型專門進行了優(yōu)化。NVIDIA NeMo 是一個適用于端到端模型訓(xùn)練的開源框架,涵蓋數(shù)據(jù)管護、定制、評估等步驟。該系列模型還針對開源NVIDIA TensorRT-LLM庫的推理進行了優(yōu)化。

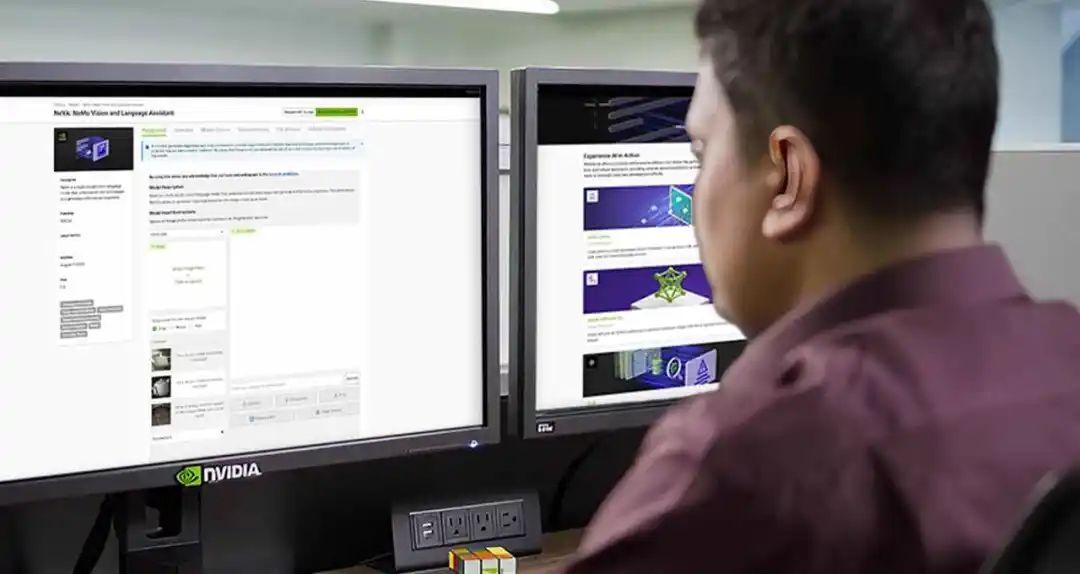

Nemotron-4 340B 現(xiàn)已可以從NVIDIA NGC目錄和 Hugging Face 下載。開發(fā)者很快就能在 ai.nvidia.com 上訪問這些模型,它們將被打包成帶有標(biāo)準(zhǔn)應(yīng)用編程接口的NVIDIA NIM微服務(wù),可在任意位置進行部署。

將 Nemotron 用于生成合成數(shù)據(jù)

在難以獲得大型多樣化標(biāo)記數(shù)據(jù)集的情況下,這些 LLM 可以幫助開發(fā)者生成合成訓(xùn)練數(shù)據(jù)。

Nemotron-4 340B Instruct模型可生成各種模擬現(xiàn)實世界數(shù)據(jù)特征的合成數(shù)據(jù),通過提高數(shù)據(jù)質(zhì)量,增強自定義 LLM 在各個領(lǐng)域的性能和穩(wěn)健性。

隨后,為了提高 AI 生成數(shù)據(jù)的質(zhì)量,開發(fā)者可以使用Nemotron-4 340B Reward模型來篩選高質(zhì)量的回答。Nemotron-4 340B Reward 模型根據(jù)五個方面對回答進行評分,這五個方面分別是:有用性、正確性、連貫性、復(fù)雜性和冗長性。該模型目前在 AI2 專為評估獎勵模型能力、安全性和缺陷而創(chuàng)建的“Hugging Face RewardBench 排行榜”上排名第一。

在這個合成數(shù)據(jù)生成流水線中,(1)Nemotron-4 340B Instruct 模型首先生成基于文本的合成輸出。然后來到評估模型,

(2)Nemotron-4 340B Reward 模型對生成的文本進行評估,并提供指導(dǎo)反復(fù)改進的反饋,確保合成數(shù)據(jù)準(zhǔn)確、相關(guān)且符合特定要求。

研究者還可以使用自己的專有數(shù)據(jù),并結(jié)合隨附的HelpSteer2 數(shù)據(jù)集自定義 Nemotron-4 340B Base 模型,創(chuàng)造出自己的指導(dǎo)或獎勵模型。

使用 NeMo 進行微調(diào)

并使用 TensorRT-LLM 優(yōu)化推理

開發(fā)者可以使用開源的 NVIDIA NeMo 和 NVIDIA TensorRT-LLM 提高其指導(dǎo)和獎勵模型的效率,以便生成合成數(shù)據(jù)并對回答進行評分。

所有 Nemotron-4 340B 模型均使用 TensorRT-LLM 優(yōu)化,能夠利用張量并行性,這是一種模型并行技術(shù),通過將單個權(quán)重矩陣分割到多個 GPU 和服務(wù)器上,實現(xiàn)大規(guī)模的高效推理。

Nemotron-4 340B Base在 9 萬億個 token 上訓(xùn)練而成。可使用 NeMo 框架對它進行自定義,使其適應(yīng)特定的用例或領(lǐng)域。這一微調(diào)過程得益于大量的預(yù)訓(xùn)練數(shù)據(jù),使模型能夠針對特定的下游任務(wù)提供更加準(zhǔn)確的輸出。

NeMo 框架提供多種自定義方法,包括有監(jiān)督的微調(diào)和各種參數(shù)高效微調(diào)方法,比如低秩自適應(yīng)(LoRA)。

為了提升模型質(zhì)量,開發(fā)者可以使用NeMo Aligner以及由 Nemotron-4 340B Reward 模型注釋的數(shù)據(jù)集對齊模型。校準(zhǔn)是 LLM 訓(xùn)練過程中的一個關(guān)鍵步驟。在該步驟中,模型的行為通過人類反饋強化學(xué)習(xí)(RLHF)等算法進行微調(diào),以保證其輸出結(jié)果安全、準(zhǔn)確、符合上下文并與其預(yù)期目標(biāo)一致。

尋求企業(yè)級支持和生產(chǎn)環(huán)境安全性的企業(yè)也可以通過NVIDIA AI Enterprise云原生軟件平臺訪問 NeMo 和 TensorRT-LLM。該平臺為生成式 AI 基礎(chǔ)模型提供更加快速和高效的運行時。

評估模型安全性并開始使用

Nemotron-4 340B Instruct 模型經(jīng)過包括對抗測試在內(nèi)的大量安全性評估,其各項風(fēng)險指標(biāo)均表現(xiàn)良好。但用戶仍應(yīng)對該模型的輸出結(jié)果進行仔細評估,確保合成生成的數(shù)據(jù)適合且安全而準(zhǔn)確地用于自己的用例。

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5238瀏覽量

105753 -

模型

+關(guān)注

關(guān)注

1文章

3483瀏覽量

49968 -

LLM

+關(guān)注

關(guān)注

1文章

319瀏覽量

678

原文標(biāo)題:NVIDIA 發(fā)布適用于訓(xùn)練大語言模型的開源合成數(shù)據(jù)生成流水線

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業(yè)解決方案】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

NVIDIA AI Foundry 為全球企業(yè)打造自定義 Llama 3.1 生成式 AI 模型

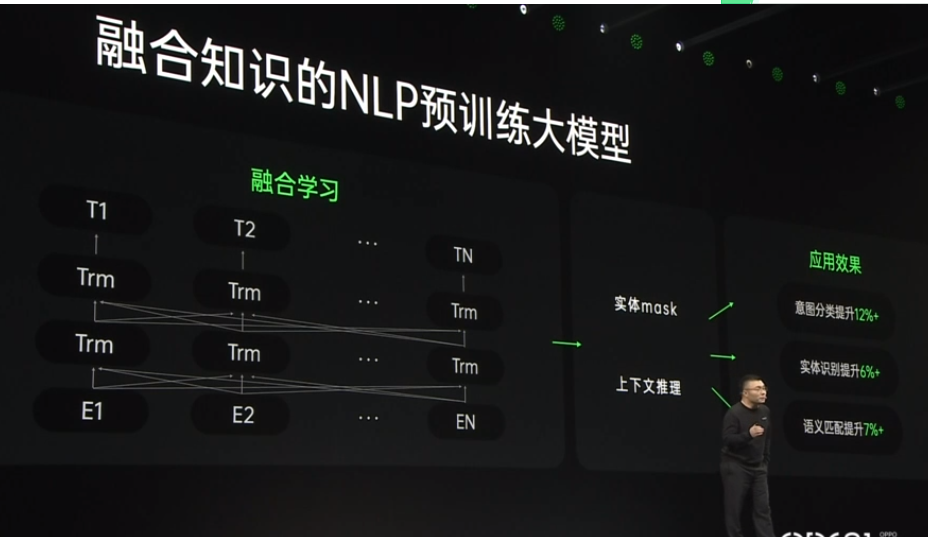

2021 OPPO開發(fā)者大會:NLP預(yù)訓(xùn)練大模型

NVIDIA提供用于AI訓(xùn)練的合成數(shù)據(jù)生成工具

NVIDIA NeMo最新語言模型服務(wù)幫助開發(fā)者定制大規(guī)模語言模型

一文看懂 DRIVE Replicator:合成數(shù)據(jù)生成加速自動駕駛汽車的開發(fā)和驗證

使用 NVIDIA TAO 工具套件和預(yù)訓(xùn)練模型加快 AI 開發(fā)

Rendered.ai 將 NVIDIA Omniverse 集成到其合成數(shù)據(jù)生成平臺

NVIDIA 與 Hugging Face 將連接數(shù)百萬開發(fā)者與生成式 AI 超級計算

NVIDIA 加快企業(yè)自定義生成式 AI 模型開發(fā)

NVIDIA 為部分大型亞馬遜 Titan 基礎(chǔ)模型提供訓(xùn)練支持

NVIDIA將全球數(shù)百萬開發(fā)者轉(zhuǎn)變?yōu)?b class='flag-5'>生成式 AI 開發(fā)者

英偉達開源Nemotron-4 340B系列模型,助力大型語言模型訓(xùn)練

英偉達推出基石世界模型Cosmos,解決智駕與機器人具身智能訓(xùn)練數(shù)據(jù)問題

NVIDIA 推出開放推理 AI 模型系列,助力開發(fā)者和企業(yè)構(gòu)建代理式 AI 平臺

NVIDIA Nemotron-4 340B模型幫助開發(fā)者生成合成訓(xùn)練數(shù)據(jù)

NVIDIA Nemotron-4 340B模型幫助開發(fā)者生成合成訓(xùn)練數(shù)據(jù)

評論