BP神經網絡,全稱為反向傳播神經網絡(Backpropagation Neural Network),是一種在機器學習、數據挖掘和模式識別等領域廣泛應用的人工神經網絡模型。其工作原理基于多層前饋網絡結構,通過誤差反向傳播算法(Error Backpropagation Algorithm)來訓練網絡,實現對復雜問題的學習和解決。以下將詳細闡述BP神經網絡的工作方式,涵蓋其基本原理、訓練過程、應用實例以及優缺點等多個方面。

一、BP神經網絡的基本結構

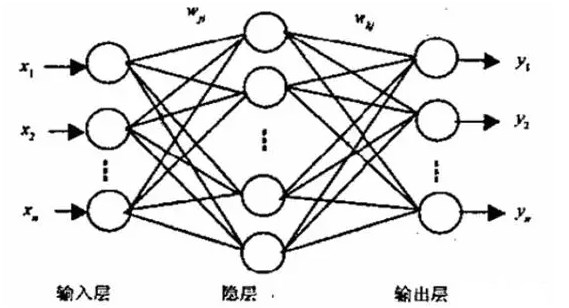

BP神經網絡由多個層次組成,主要包括輸入層、隱藏層(可以有多個)和輸出層。每一層都包含多個神經元,這些神經元通過帶有權重的連接相互連接。信息在網絡中從輸入層開始,逐層向前傳遞,通過各層的激活函數進行計算和轉化,最終到達輸出層。

- 輸入層 :接收外部輸入信號,不進行任何計算,僅作為數據輸入的接口。

- 隱藏層 :對輸入信號進行非線性變換,是神經網絡的核心部分,負責學習輸入與輸出之間的復雜映射關系。隱藏層可以有一層或多層,層數和神經元數量根據具體問題而定。

- 輸出層 :輸出網絡的處理結果,通常與問題的具體目標(如分類、回歸等)相對應。

如圖所示為BP神經網絡的拓撲結構,一般包含三層前饋網,即輸入層、中間層(也稱隱層)和輸出層。它的特點是:各層神經元僅與相鄰層神經元之間相互全連接,同層內神經元之間無連接,各層神經元之間無反饋連接,構成具有層次結構的前饋型神經網絡系統。單計算層前饋神經網絡只能求解線性可分問題,能夠求解非線性問題的網絡必須是具有隱層的多層神經網絡。

如圖所示的BP神經網絡,輸入層包含m個節點,輸出層包含n個節點,可以看做是一個m維向量到一個n維向量的映射。

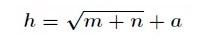

隱層節點的選擇有一個經驗公式:

其中h為隱含層節點數目,m為輸入層節點數目,n為輸出層節點數目,a為1~10之間的調節常數。

二、BP神經網絡的訓練過程

BP神經網絡的訓練過程主要分為兩個階段:前向傳播和反向傳播。

1. 前向傳播

前向傳播是信號在網絡中從輸入層向輸出層傳播的過程。具體來說,輸入層的信號經過加權和運算后傳遞給隱藏層,隱藏層的神經元接收來自前一層的信號,經過激活函數處理后再傳遞給下一層,直到最終到達輸出層。每一層的輸出都是下一層輸入的來源。

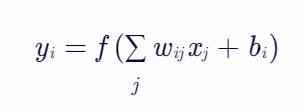

在前向傳播過程中,神經元的輸出計算方式通常為:

其中,yi?表示當前神經元的輸出,f(?)為激活函數,wij?為從神經元j到神經元i的連接權重,xj?為前一層的輸入(或神經元j的輸出),bi?為神經元i的偏置項。

2. 反向傳播

反向傳播是誤差從輸出層向輸入層反向傳播的過程,用于調整網絡中的連接權重和偏置項,以減小網絡輸出與期望輸出之間的誤差。

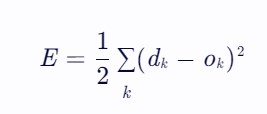

首先,計算網絡輸出與期望輸出之間的誤差,常用的誤差函數為均方誤差(Mean Squared Error, MSE):

其中,dk為期望輸出,ok為實際輸出。

然后,利用鏈式法則計算誤差關于各層權重的梯度,即誤差信號在各層之間的反向傳播。梯度表示了權重變化對誤差減少的影響程度,通過梯度下降法更新權重,使誤差逐步減小。

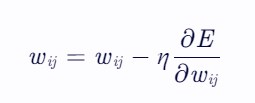

權重更新公式為:

其中,η為學習率,決定了權重更新的步長。

三、BP神經網絡的算法實現

BP神經網絡的算法實現包括網絡初始化、前向傳播、誤差計算、反向傳播和權重更新等步驟。以下是一個簡化的算法流程:

- 初始化網絡 :隨機初始化網絡中所有連接的權重和偏置項。

- 前向傳播 :根據輸入數據,通過加權和和激活函數計算每一層的輸出,直至得到輸出層的輸出。

- 誤差計算 :計算輸出層的誤差,并將其反向傳播到隱藏層。

- 反向傳播 :根據誤差和梯度下降法,計算每一層權重的梯度,并更新權重。

- 迭代訓練 :重復步驟2-4,直到滿足停止條件(如達到最大迭代次數、誤差小于預定閾值等)。

四、BP神經網絡的應用實例

BP神經網絡在多個領域有著廣泛的應用,如模式識別、分類、回歸、預測等。以下列舉幾個具體的應用實例:

- 手寫數字識別 :通過訓練BP神經網絡,可以實現對手寫數字圖像的分類識別。網絡輸入為數字圖像的像素值,輸出為數字類別。

- 人臉識別 :在人臉識別系統中,BP神經網絡可以學習人臉圖像的特征,實現人臉的檢測和識別。

- 語音識別 :通過訓練BP神經網絡,可以提取語音信號的特征,實現對語音的識別和理解。

- 股票價格預測 :利用歷史股票價格數據訓練BP神經網絡,可以預測未來股票價格的走勢,為投資者提供決策支持。

五、BP神經網絡的優缺點

優點:

- 非線性映射能力 :BP神經網絡通過隱藏層的非線性激活函數,能夠學習和逼近復雜的非線性映射關系,解決傳統方法難以處理的問題。

- 自學習和自適應能力 :網絡在訓練過程中能夠自動調整權重和偏置項,以適應不同輸入數據的特性,表現出較強的自學習和自適應能力。

- 容錯能力強 :BP神經網絡具有一定的容錯性,即當輸入數據存在噪聲或缺失時,網絡仍能給出較為合理的輸出。

- 并行處理能力 :神經網絡的計算是高度并行的,每個神經元都可以獨立進行計算,這使得網絡在處理大規模數據時具有較高的效率。

缺點:

- 訓練時間長 :由于BP神經網絡采用梯度下降法來更新權重,而梯度下降法本身可能陷入局部最小值,導致訓練過程耗時較長,且可能無法找到全局最優解。

- 過擬合問題 :當網絡結構過于復雜或訓練數據不足時,BP神經網絡容易出現過擬合現象,即網絡對訓練數據過度擬合,而對新數據的泛化能力較差。

- 權重初始化敏感 :BP神經網絡的性能對權重的初始值較為敏感,不同的初始值可能導致網絡收斂到不同的局部最小值。

- 參數選擇困難 :網絡中的學習率、隱藏層數、神經元數量等參數需要人工設定,且這些參數的選擇對網絡的性能有較大影響,缺乏統一的選擇標準。

六、BP神經網絡的改進方法

為了克服BP神經網絡的上述缺點,研究者們提出了多種改進方法,包括但不限于以下幾種:

- 優化算法 :引入更高效的優化算法,如動量法、共軛梯度法、牛頓法等,以加快訓練速度并減少陷入局部最小值的風險。

- 正則化技術 :通過添加正則化項(如L1正則化、L2正則化)到誤差函數中,限制網絡權重的復雜度,從而減輕過擬合問題。

- 早停法 :在訓練過程中監控網絡在驗證集上的性能,當性能開始下降時停止訓練,以避免過擬合。

- Dropout技術 :在訓練過程中隨機丟棄一部分神經元及其連接,以減少神經元之間的共適應性,提高網絡的泛化能力。

- 批量歸一化 :在每個隱藏層之后添加批量歸一化層,對輸入數據進行歸一化處理,以加速訓練過程并提高網絡的穩定性。

- 深度學習框架 :利用深度學習框架(如TensorFlow、PyTorch等)來構建和訓練BP神經網絡,這些框架提供了豐富的工具和庫,使得網絡的設計、訓練和評估變得更加簡單和高效。

七、結論

BP神經網絡作為一種經典的人工神經網絡模型,在多個領域展現了其強大的學習和適應能力。然而,它也存在一些固有的缺點和挑戰。通過不斷優化算法、引入正則化技術、采用Dropout和批量歸一化等方法,可以進一步提高BP神經網絡的性能和穩定性。隨著深度學習技術的不斷發展,BP神經網絡及其改進版本將在更多領域發揮重要作用,推動人工智能技術的持續進步。

-

BP神經網絡

+關注

關注

2文章

127瀏覽量

30848 -

人工神經網絡

+關注

關注

1文章

120瀏覽量

14859 -

模型

+關注

關注

1文章

3483瀏覽量

49980

發布評論請先 登錄

BP神經網絡的基本結構和訓練過程

BP神經網絡的基本結構和訓練過程

評論