12 月 20 日,追蹤虛假信息的組織 NewsGuard 發布報告顯示,自今年 4 月起,人工智能生成虛假新聞網站增長超過 1100%,每月平均增長率達近 144%,由原先的 49 個猛增至上百 600 余個。這些網站通過未經監管的 AI 創作出所有肆無忌憚的虛假信息和虛假數據。

NewsGuard 團隊現已識別出 614 個此類不可信的新聞和信息網站,共包括 15 種語言,部分網站每日可產生數百乃至數千篇文章。這些網站冒充正規新聞站點,隱蔽地使用如“頭條新聞”、“每日時事更新”、“商界日報”之類看似可靠的名字,誘使毫無防范之心的用戶瀏覽。

值得關注的是,NewsGuard 的研究還揭示,AI 工具讓虛假信息傳播者和內容農場生產假新聞變得輕而易舉且高效。無論身處何方,有才能的或是沒有才能的人都可以創建這些網站。

更為嚴重的挑戰在于,眾多人群尚未具備區分真假信息的能力,極度易于被精心編造的虛假報道所迷惑。虛假新聞多以引人注目的名人離世、丑聞八卦等內容為主,有意捕捉人性中的情感缺陷并惡意散播。事實上,這些由 AI 機器人生成的大量虛假信息存在眾多錯誤、不合理的細節和獨特的機器人表述,稍加觀察就能輕易察覺。

據 IT 之家消息,更具憤怒氣息的是,很多著名品牌竟將廣告投放到這些虛假網站,對虛假新聞的滋生給予明目張膽的資金支持。為了謀求利潤,他們完全無視這些網站上內容的真實性,將廣告投向這些假新聞站點,繼續為虛假新聞的大量生產投錢。

面對此狀況,我們應采取哪些行動呢?NewsGuard 給出以下幾點提醒,供廣大讀者參考:

錯誤事實和語言風格:對比某某機器生成的新聞,往往出現事實錯誤和迥異于人類記者的語言風格,持續大量重復使用某些特定詞匯或短語。

發布新聞頻率:真正嚴肅的新聞網站從不每天發布海量新聞,純屬為了緊抓眼球的虛假新聞平臺才會制作如此大規模的虛假內容。

缺乏編輯審查:專業資訊網站會有編輯進行嚴謹審查,但虛假新聞網站就沒有這種審查機制。

盡管預示著未來大部分新聞網站可能采用 AI 工具協助內容編制,然而,他們不會像目前這些問題嚴重的虛假新聞網站那樣,毫不在意地生產海量未曾核實過的信息。

-

機器人

+關注

關注

213文章

29463瀏覽量

211520 -

AI

+關注

關注

87文章

34146瀏覽量

275319 -

人工智能

+關注

關注

1804文章

48677瀏覽量

246382

發布評論請先 登錄

【「零基礎開發AI Agent」閱讀體驗】+讀《零基礎開發AI Agent》掌握扣子平臺開發智能體方法

首創開源架構,天璣AI開發套件讓端側AI模型接入得心應手

如何利用AI創造更多無限可能

國內生成式AI備案數量突破300款

Spectrum儀器數字化儀應用:通過量子傳感器控制假肢

《AI for Science:人工智能驅動科學創新》第二章AI for Science的技術支撐學習心得

特斯拉2025年末批量裝備Dojo 2 AI訓練芯片

人工智能ai4s試讀申請

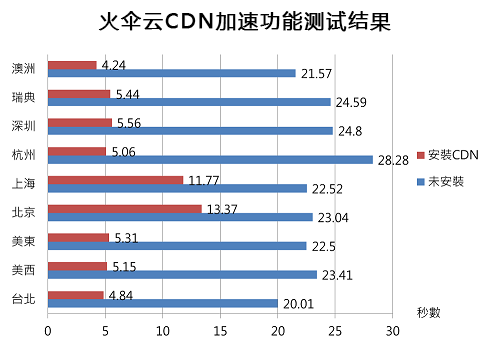

CDN網站加速

“AI換臉”掠走數百萬美金,跨境支付企業如何應對深度偽造風險?

虛假新聞網站利用AI批量炮制假新聞,數量猛增驚人

虛假新聞網站利用AI批量炮制假新聞,數量猛增驚人

評論