手中沒(méi)有足夠GPU的人,在商業(yè)化戰(zhàn)爭(zhēng)中鐵定出局。

著名的SemiAnalysis分析師Dylan Patel和Daniel Nishball,又來(lái)爆料行業(yè)內(nèi)幕了。而整個(gè)AI社區(qū),再次被這次的消息所震驚:OpenAI的算力比起谷歌來(lái),只能說(shuō)是小兒科——谷歌的下一代大模型Gemini,算力已達(dá)GPT-4的5倍!

根據(jù)Patel和Nishball的說(shuō)法,此前屢屢被爆料將成為GPT-4大殺器的谷歌Gemini,已經(jīng)開始在新的TPUv5 Pod上進(jìn)行訓(xùn)練了,算力高達(dá)~1e26 FLOPS,比訓(xùn)練GPT-4的算力還要大5倍。如今,憑借著TPUv5,谷歌已經(jīng)成為了算力王者。它手中的TPUv5數(shù)量,比OpenAI、Meta、CoreWeave、甲骨文和亞馬遜擁有的GPU總和還要多!雖然TPUv5在單芯片性能上比不上英偉達(dá)的H100,但谷歌最可怕的優(yōu)勢(shì)在于,他們擁有高效、龐大的基礎(chǔ)設(shè)施。沒(méi)想到,這篇爆料引來(lái)Sam Altman圍觀,并表示,「難以置信的是,谷歌竟然讓那個(gè)叫semianalysis的家伙發(fā)布了他們的內(nèi)部營(yíng)銷/招聘圖表,太搞笑了。 」

有網(wǎng)友卻表示,這僅是一篇評(píng)論性文章,并非實(shí)際新聞,完全是推測(cè)。

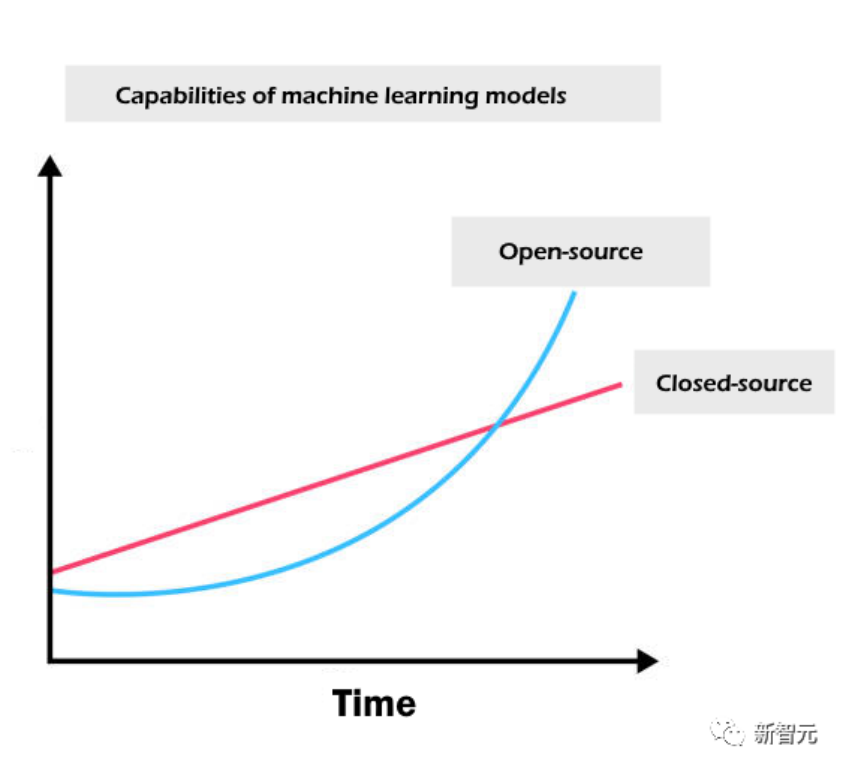

不過(guò),此前Dylan Patel參與的兩篇稿件,無(wú)一例外都被證實(shí),并且引發(fā)了業(yè)內(nèi)的軒然大波。無(wú)論是谷歌的內(nèi)部文件泄漏事件(「我們沒(méi)有護(hù)城河,OpenAI也沒(méi)有」)——

谷歌DeepMind的首席執(zhí)行官Demis Hassabis在一次采訪中確認(rèn)了谷歌護(hù)城河的真實(shí)性

還是GPT-4的架構(gòu)、參數(shù)等內(nèi)幕消息大泄密——

下面讓我們來(lái)仔細(xì)看看,這次的爆料文章,又將帶來(lái)多少重磅內(nèi)幕消息。

沉睡的巨人谷歌已經(jīng)醒來(lái)

提出Transformer開山之作「Attention is all you need」的作者之一、LaMDA和PaLM的關(guān)鍵參與者Noam Shazeer,曾受MEENA模型的啟發(fā),寫過(guò)一篇文章。

在這篇文章里,他準(zhǔn)確地預(yù)言了ChatGPT的誕生給全世界帶來(lái)的改變——LLM會(huì)越來(lái)越融入我們的生活,吞噬全球的算力。這篇文章遠(yuǎn)遠(yuǎn)領(lǐng)先于他的時(shí)代,但卻被谷歌的決策者忽略了。

論文地址:https://arxiv.org/pdf/2001.09977.pdf

現(xiàn)在,谷歌擁有算力王國(guó)所有的鑰匙,沉睡的巨人已經(jīng)醒來(lái),他們的向前迭代的速度已經(jīng)無(wú)法阻擋,在2023年底,谷歌的算力將達(dá)到GPT-4預(yù)訓(xùn)練FLOPS的五倍。而考慮谷歌現(xiàn)在的基建,到明年年底,這個(gè)數(shù)字或許會(huì)飆升至100倍。谷歌是否會(huì)在不削減創(chuàng)造力、不改變現(xiàn)有商業(yè)模式的基礎(chǔ)上在這條路上繼續(xù)深耕?目前無(wú)人知曉。

「GPU富豪」和「GPU窮人」

現(xiàn)在,手握英偉達(dá)GPU的公司,可以說(shuō)是掌握了最硬的硬通貨。OpenAI、谷歌、Anthropic、Inflection、X、Meta這些巨頭或明星初創(chuàng)企業(yè),手里有20多萬(wàn)塊A100/H100芯片,平均下來(lái),每位研究者分到的計(jì)算資源都很多。

個(gè)人研究者,大概有100到1000塊GPU,可以玩一玩手頭的小項(xiàng)目。

CoreWeave已經(jīng)拿英偉達(dá)H100抵押,用來(lái)買更多GPU

而到2024年底,GPU總數(shù)可能會(huì)達(dá)到十萬(wàn)塊。現(xiàn)在在硅谷,最令頂級(jí)的機(jī)器學(xué)習(xí)研究者自豪的談資,就是吹噓自己擁有或即將擁有多少塊GPU。在過(guò)去4個(gè)月內(nèi),這股風(fēng)氣越刮越盛,以至于這場(chǎng)競(jìng)賽已經(jīng)被放到了明面——誰(shuí)家有更多GPU,大牛研究員就去哪兒。Meta已經(jīng)把「擁有世界上第二多的H100 GPU」,直接拿來(lái)當(dāng)招聘策略了。

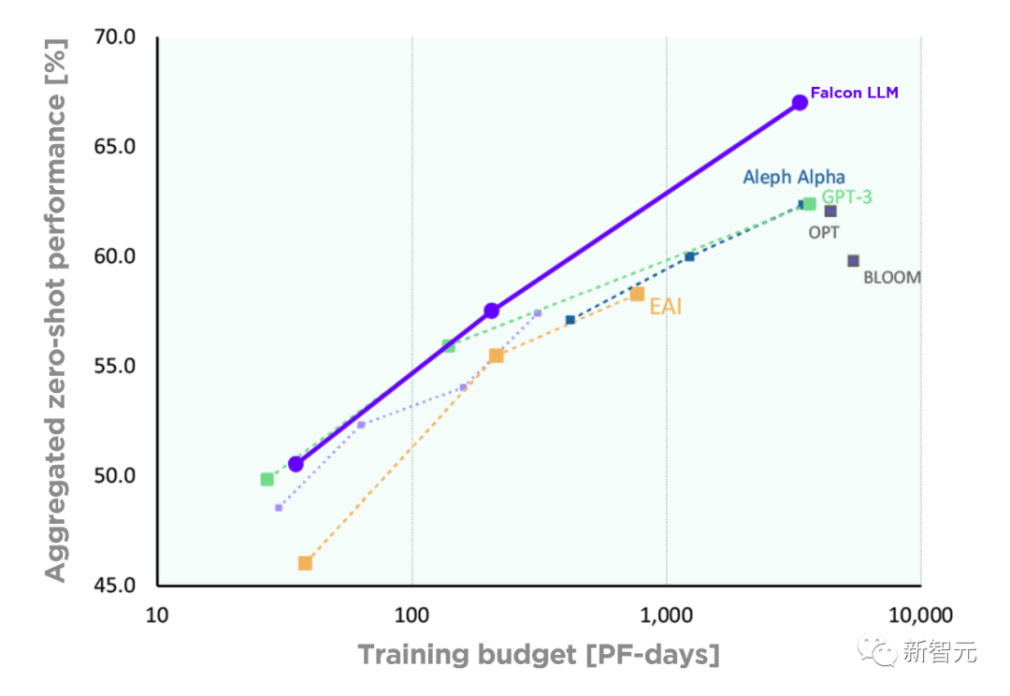

與此同時(shí),數(shù)不清的小初創(chuàng)公司和開源研究者,正在為GPU短缺而苦苦掙扎。因?yàn)闆](méi)有足夠虛擬內(nèi)存的GPU,他們只能虛擲光陰,投入大量時(shí)間和精力,去做一些無(wú)關(guān)緊要的事。他們只能在更大的模型上來(lái)微調(diào)一些排行榜風(fēng)格基準(zhǔn)的小模型,這些模型的評(píng)估方法也很支離破碎,更強(qiáng)調(diào)的是風(fēng)格,而不是準(zhǔn)確性、有用性。他們也不知道,只有擁有更大、更高質(zhì)量的預(yù)訓(xùn)練數(shù)據(jù)集和IFT數(shù)據(jù),才能讓小開源模型在實(shí)際工作負(fù)載中得到改進(jìn)。

「誰(shuí)將獲得多少H100,何時(shí)獲得H100,都是硅谷現(xiàn)在的頂級(jí)八卦。」OpenAI聯(lián)合創(chuàng)始人Andrej Karpathy曾經(jīng)這樣感慨

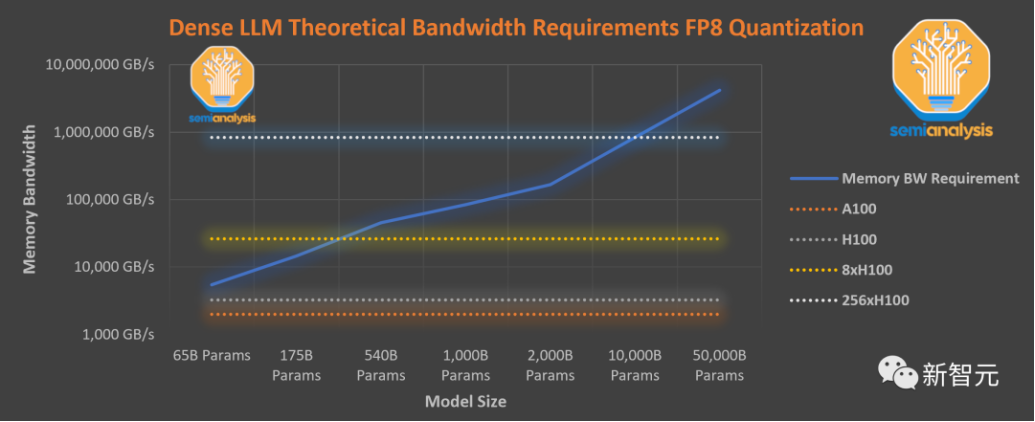

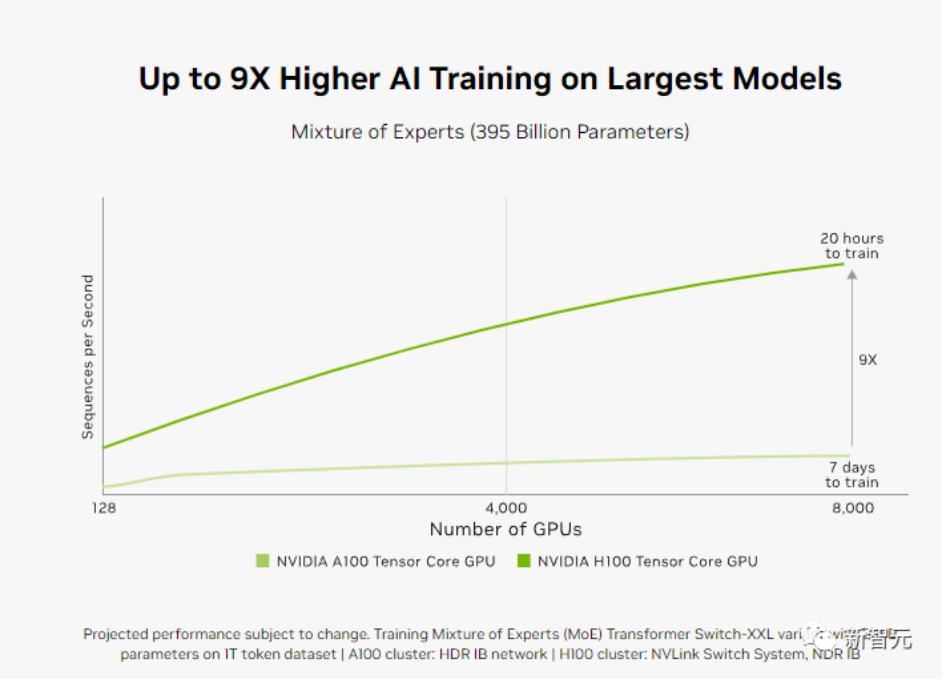

是的,高效使用GPU很重要,許多GPU窮人把這一點(diǎn)忽視了。他們不關(guān)心規(guī)模效應(yīng)的效率,也沒(méi)有有效利用自己的時(shí)間。到明年,世界就會(huì)被350萬(wàn)H100所淹沒(méi),而這些GPU窮人,將徹底與商業(yè)化隔絕。他們只能用手中的游戲用GPU來(lái)學(xué)習(xí)、做實(shí)驗(yàn)。大部分GPU窮人仍然在使用密集模型,因?yàn)檫@就是Meta的Llama系列模型所提供的。如果不是扎克伯格的慷慨,大部分開源項(xiàng)目會(huì)更糟。如果他們真的關(guān)心效率,尤其是客戶端的效率,他們會(huì)選擇MoE這樣的稀疏模型架構(gòu),并且在更大的數(shù)據(jù)集上進(jìn)行訓(xùn)練,并且像OpenAI、Anthropic、Google DeepMind這樣的前沿LLM實(shí)驗(yàn)室一樣,采用推測(cè)解碼。

此圖表假設(shè),無(wú)法融合每個(gè)操作、注意力機(jī)制所需的內(nèi)存帶寬、硬件開銷相當(dāng)于參數(shù)讀取,都會(huì)導(dǎo)致效率低下。實(shí)際上,即使使用優(yōu)化的庫(kù),比如英偉達(dá)的FasterTransformer庫(kù),總開銷甚至還會(huì)更大

處于劣勢(shì)的公司應(yīng)該把重點(diǎn)放在提高模型性能或減輕token到token延遲上,提高計(jì)算和內(nèi)存容量要求,減少內(nèi)存帶寬,這些才是邊緣效應(yīng)所需要的。他們應(yīng)該專注于在共享基礎(chǔ)架構(gòu)上高效地提供多個(gè)微調(diào)模型,而不必為小批量模型付出可怕的成本代價(jià)。然而,事實(shí)卻恰恰相反,他們卻過(guò)于關(guān)注內(nèi)存容量限制或量化程度太高,卻對(duì)模型實(shí)際質(zhì)量的下降視而不見。總的來(lái)說(shuō),現(xiàn)在的大模型排行榜,已經(jīng)完全亂套了。雖然閉源社區(qū)還有很多人在努力改進(jìn)這一點(diǎn),但這種開放基準(zhǔn)毫無(wú)意義。出于某種原因,人們對(duì)LLM排行榜有一種病態(tài)的癡迷,并且為一些無(wú)用的模型起了一堆愚蠢的名字,比如Platypus等等。在以后,希望開源的工作能轉(zhuǎn)向評(píng)估、推測(cè)解碼、MoE、開放IFT數(shù)據(jù),以及用超過(guò)10萬(wàn)億個(gè)token清洗預(yù)訓(xùn)練數(shù)據(jù),否則,開源社區(qū)根本無(wú)法與商業(yè)巨頭競(jìng)爭(zhēng)。

現(xiàn)在,在大模型之戰(zhàn)的世界版圖已經(jīng)很明顯:美國(guó)和中國(guó)會(huì)持續(xù)領(lǐng)先,而歐洲因?yàn)槿狈Υ蠊P投資和GPU短缺已經(jīng)明顯落后,即使有政府支持的超算儒勒·凡爾納也無(wú)濟(jì)于事。而多個(gè)中東國(guó)家也在加大投資,為AI建設(shè)大規(guī)模基礎(chǔ)設(shè)施。

當(dāng)然,缺乏GPU的,并不只是一些零散的小初創(chuàng)企業(yè)。即使是像HuggingFace、Databricks(MosaicML),以及Together這種最知名的AI公司,也依然屬于「GPU貧困人群」。事實(shí)上,僅看每塊GPU所對(duì)應(yīng)的世界TOP級(jí)研究者,或者每塊GPU所對(duì)應(yīng)的潛在客戶,他們或許是世界上最缺乏GPU的群體。雖然擁有世界一流的研究者,但所有人都只能在能力低幾個(gè)數(shù)量級(jí)的系統(tǒng)上工作。雖然他們獲得了大量融資,買入了數(shù)千塊H100,但這并不足以讓他們搶占大部分市場(chǎng)。

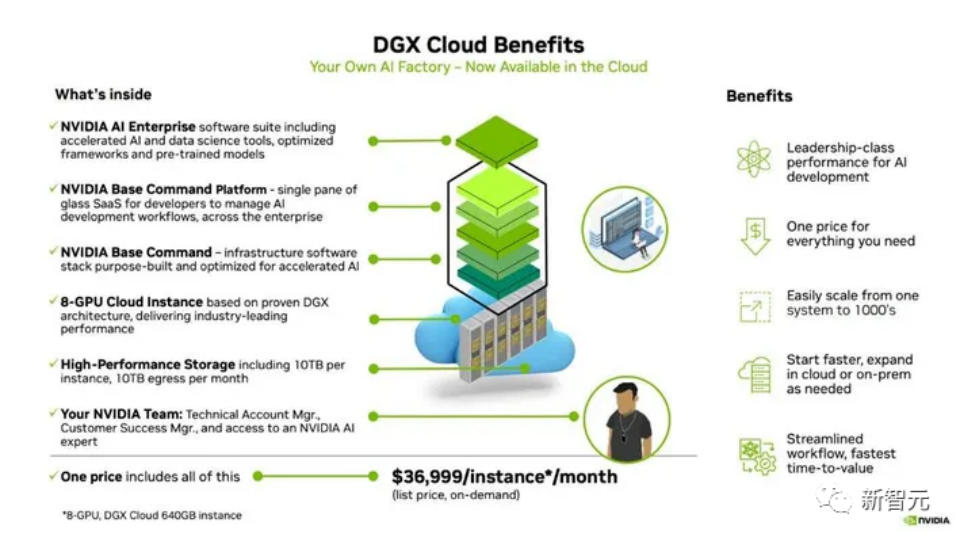

你所有的算力,全是從競(jìng)品買的

在內(nèi)部的各種超級(jí)計(jì)算機(jī)中,英偉達(dá)擁有著比其他人多出數(shù)倍的GPU。其中,DGX Cloud提供了預(yù)訓(xùn)練模型、數(shù)據(jù)處理框架、向量數(shù)據(jù)庫(kù)和個(gè)性化、優(yōu)化推理引擎、API以及英偉達(dá)專家的支持,幫助企業(yè)定制用例并調(diào)整模型。

如今,這項(xiàng)服務(wù)也已經(jīng)吸引了來(lái)自SaaS、保險(xiǎn)、制造、制藥、生產(chǎn)力軟件和汽車等垂直行業(yè)的多家大型企業(yè)。即便是不算上那些未公開的合作伙伴,僅僅是由安進(jìn)(Amgen)、Adobe、CCC、ServiceNow、埃森哲(Accenture)、阿斯利康(AstraZeneca)、蓋蒂圖片社(Getty Images)、Shutterstock、晨星(Morningstar)、Evozyne、Insilico Medicine、Quantiphi、InstaDeep、牛津納米孔(Oxford Nanopore)、Peptone、Relation Therapeutics、ALCHEMAB Therapeutics和Runway等巨頭組成的這份比其他競(jìng)爭(zhēng)對(duì)手要長(zhǎng)得多的名單,就已經(jīng)足夠震撼了。考慮到云計(jì)算的支出和內(nèi)部超級(jí)計(jì)算機(jī)的建設(shè)規(guī)模,企業(yè)從英偉達(dá)這里購(gòu)買的似乎比HuggingFace、Together和Databricks所能夠提供的服務(wù)加起來(lái)還要多。

作為行業(yè)中最有影響力的公司之一,HuggingFace需要利用這一點(diǎn)來(lái)獲得巨額投資,建立更多的模型、定制和推理能力。但在最近一輪的融資中,過(guò)高的估值讓他們并沒(méi)有得到所需的金額。Databricks雖然可以憑借著數(shù)據(jù)和企業(yè)關(guān)系迎頭趕上。但問(wèn)題在于,如果想要為超過(guò)7,000個(gè)客戶提供服務(wù),就必須將支出增加數(shù)倍。不幸的是,Databricks無(wú)法用股票來(lái)購(gòu)買GPU。他們需要通過(guò)即將開始的私募/IPO來(lái)進(jìn)行大規(guī)模融資,并進(jìn)一步用這些現(xiàn)金來(lái)加倍投資于硬件。從經(jīng)濟(jì)學(xué)的角度來(lái)看有些奇怪,因?yàn)樗麄儽仨毾冉ㄔO(shè),然后才能引來(lái)客戶,而英偉達(dá)同樣也在為他們的服務(wù)一擲千金。不過(guò),這也是參與競(jìng)爭(zhēng)的前提條件。

這里的關(guān)鍵在于,Databricks、HuggingFace和Together明顯落后于他們的主要競(jìng)爭(zhēng)對(duì)手,而后者又恰好是他們幾乎所有計(jì)算資源的來(lái)源。也就是說(shuō),從Meta到微軟,再到初創(chuàng)公司,實(shí)際上所有人都只是在充實(shí)英偉達(dá)的銀行賬戶。那么,有?能把我們從英偉達(dá)奴役中拯救出來(lái)嗎?是的,有?個(gè)潛在的救世主——谷歌。

谷歌算?之巔,OpenAI不及一半

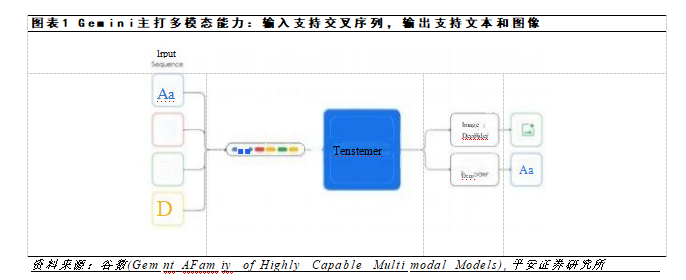

雖然內(nèi)部也在使用GPU,但谷歌的手中卻握著其他「王牌」。其中,最讓業(yè)界期待的是,谷歌下一代大模型Gemini,以及下一個(gè)正在訓(xùn)練的迭代版本,都得到了谷歌無(wú)以倫比的高效基礎(chǔ)設(shè)施的加持。

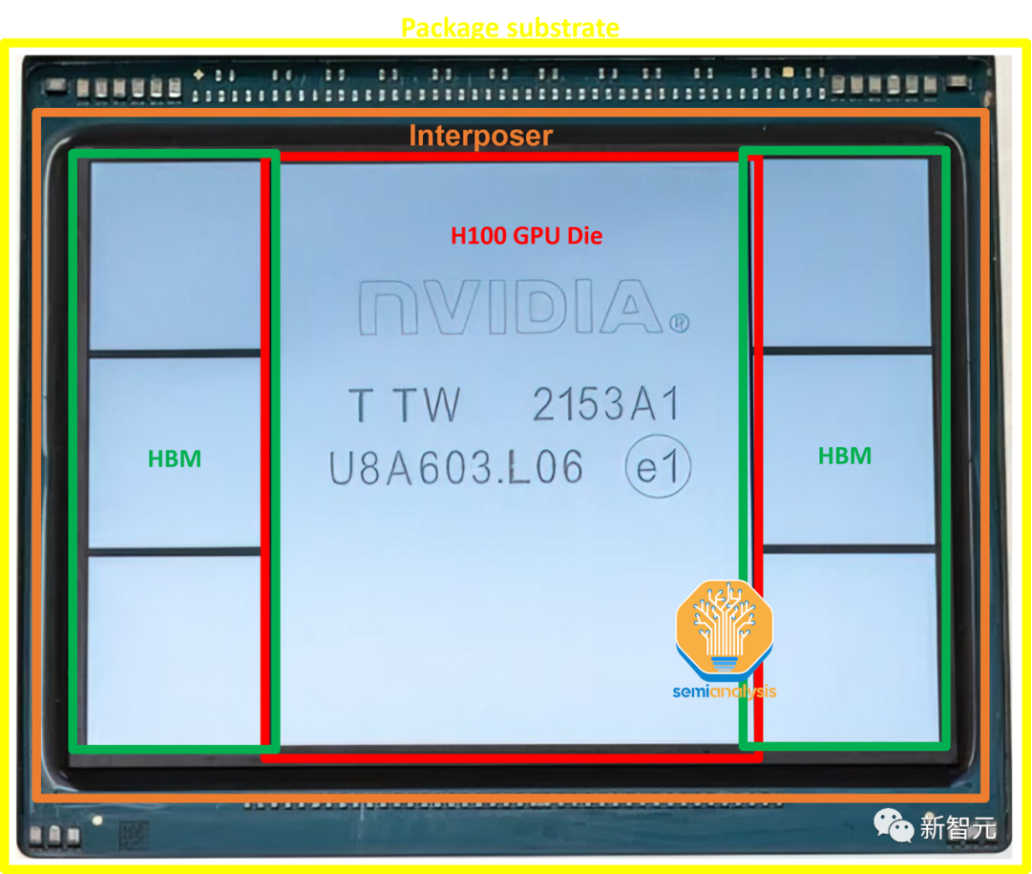

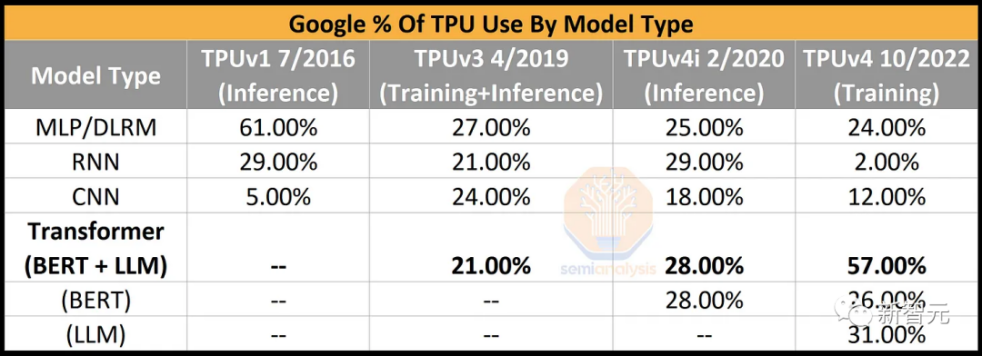

早在2006年,谷歌就開始提出了構(gòu)建人工智能專用基礎(chǔ)設(shè)施的想法,并于2013年將這一計(jì)劃推向高潮。他們意識(shí)到,如果想大規(guī)模部署人工智能,就必須將數(shù)據(jù)中心的數(shù)量增加一倍。因此,谷歌開始為3年后能夠投入生產(chǎn)的TPU芯片去做準(zhǔn)備。最著名的項(xiàng)目Nitro Program在13年發(fā)起,專注于開發(fā)芯片以優(yōu)化通用CPU計(jì)算和存儲(chǔ)。主要的目標(biāo)是重新思考服務(wù)器的芯片設(shè)計(jì),讓其更適合谷歌的人工智能計(jì)算工作負(fù)載。自2016年以來(lái),谷歌已經(jīng)構(gòu)建了6種不同的AI芯片,TPU、TPUv2、TPUv3、TPUv4i、TPUv4和TPUv5。谷歌主要設(shè)計(jì)這些芯片,并與Broadcom進(jìn)行了不同數(shù)量的中后端協(xié)作,然后由臺(tái)積電生產(chǎn)。TPUv2之后,這些芯片還采用了三星和SK海力士的HBM內(nèi)存。

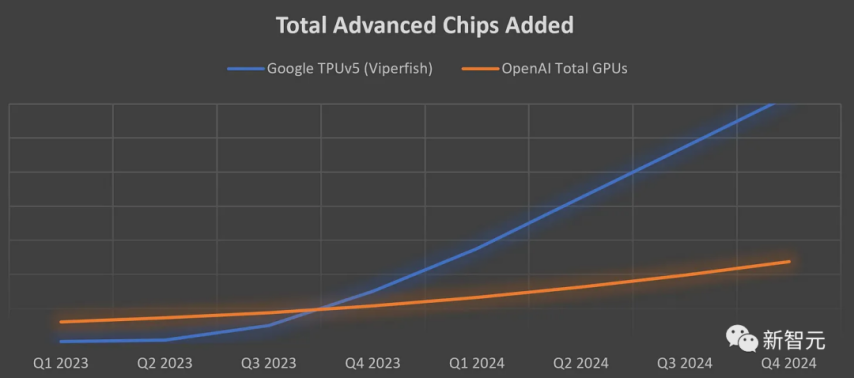

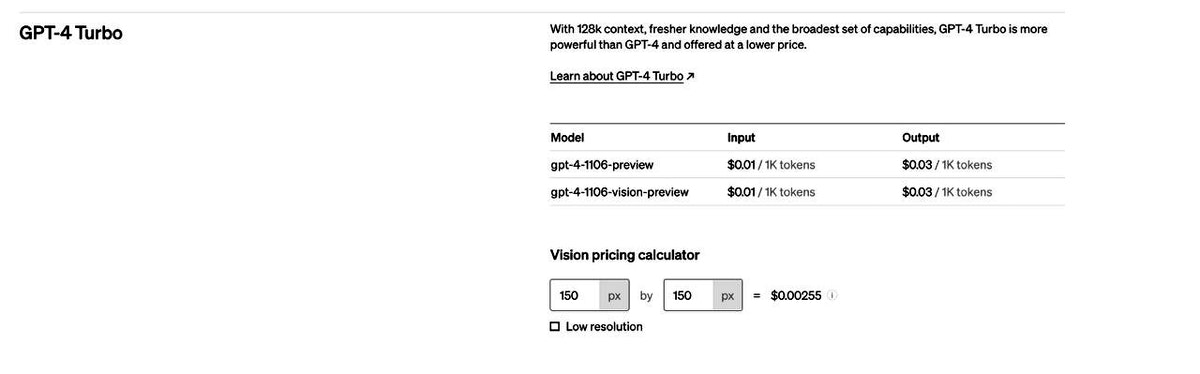

在介紹Gemini和谷歌的云業(yè)務(wù)之前,爆料者先分享了關(guān)于谷歌瘋狂擴(kuò)張算力的一些數(shù)據(jù)——各季度新增加的?級(jí)芯?總數(shù)。對(duì)于OpenAI來(lái)說(shuō),他們擁有的總GPU數(shù)量將在2年內(nèi)增加4倍。而對(duì)于谷歌來(lái)說(shuō),所有人都忽視了,谷歌擁有TPUv4(PuVerAsh)、TPUv4 lite,以及內(nèi)部使?的GPU的整個(gè)系列。此外,TPUv5 lite沒(méi)有在這里算進(jìn)去,盡管它可能是推理較?語(yǔ)?模型的主?。如下圖表中的增長(zhǎng),只有TPUv5(ViperAsh)可視化。

即使對(duì)他們的能力給予充分肯定,谷歌的算力也足以讓所有人都傻了眼。實(shí)際上,谷歌擁有的TPUv5比OpenAI、Meta、CoreWeave、甲骨文和亞馬遜擁有的GPU總和還要多。并且,谷歌能夠?qū)⑦@些能力的很大一部分出租給各種初創(chuàng)公司。當(dāng)然,就每個(gè)芯片方面的性能來(lái)說(shuō),TPUv5與H100相比有顯著的差距。

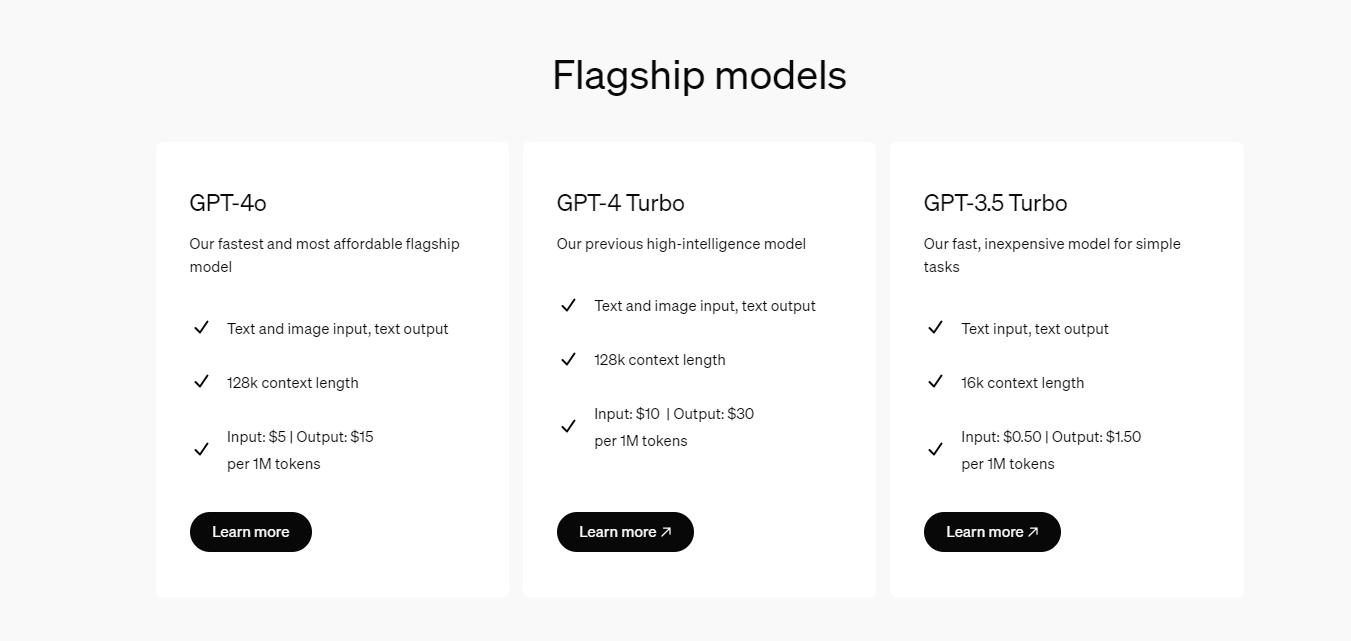

撇開這點(diǎn)不說(shuō),OpenAI的算力只是谷歌的一小部分。與此同時(shí),TPUv5的構(gòu)建能夠大大提升訓(xùn)練和推理能?。此外,谷歌全新架構(gòu)的多模態(tài)大模型Gemini,一直在以令人難以置信的速度迭代。據(jù)稱,Gemini可以訪問(wèn)多個(gè)TPU pod集群,具體來(lái)講是在7+7 pods上進(jìn)行訓(xùn)練。

爆料者表示,初代的Gemini應(yīng)該是在TPUv4上訓(xùn)練的,并且這些pod并沒(méi)有集成最大的芯片數(shù)——4096個(gè)芯?,而是使用了較少的芯片數(shù)量,以保證芯片的可靠性和熱插拔。如果所有14個(gè)pod都在合理的掩模場(chǎng)利用率(MFU)下使?了約100天,那么訓(xùn)練Gemini的硬件FLOPS將達(dá)到超過(guò)1e26。作為參考,爆料者在上次「GPT-4架構(gòu)」文章中曾詳細(xì)介紹了GPT-4模型的FLOPS比2e25稍高一點(diǎn)。而?歌模型FLOPS利?率在TPUv4上?常好,即使在?規(guī)模訓(xùn)練中,也就是Gemini的第?次迭代,遠(yuǎn)遠(yuǎn)?于GPT-4。

尤其是,就模型架構(gòu)優(yōu)越方面,如增強(qiáng)多模態(tài),更是如此。真正令人震驚的是Gemini的下一次迭代,它已經(jīng)開始在基于TPUv5的pod上進(jìn)?訓(xùn)練,算力高達(dá)~1e26 FLOPS,這比訓(xùn)練GPT-4要大5倍。據(jù)稱,第?個(gè)在TPUv5上訓(xùn)練的Gemini在數(shù)據(jù)??存在?些問(wèn)題,所以不確定谷歌是否會(huì)發(fā)布。這個(gè)~1e26模型可能就是,公開稱為Gemini的模型。再回看上?的圖表,這不是?歌的最終形態(tài)。?賽已經(jīng)開始了,而?歌有著巨?的優(yōu)勢(shì)。如果他們能夠集中精力并付諸實(shí)施,至少在訓(xùn)練前的計(jì)算規(guī)模擴(kuò)展和實(shí)驗(yàn)速度方面,他們終將勝出。

他們可以擁有多個(gè)比OpenAI最強(qiáng)大的集群,還要強(qiáng)大的集群。谷歌已經(jīng)摸索了一次,還會(huì)再來(lái)一次嗎?當(dāng)前,?歌的基礎(chǔ)設(shè)施不僅滿?內(nèi)部需求,Anthopic等前沿模型公司和?些全球最?的公司,也將訪問(wèn)TPUv5進(jìn)?內(nèi)部模型的訓(xùn)練和推理。?歌將TPU遷移到云業(yè)務(wù)部門,并重新樹立了商業(yè)意識(shí),這讓他們贏得了一些大公司的青睞果斷戰(zhàn)斗。未來(lái)幾個(gè)月,你將會(huì)看到谷歌的勝利。這些被推銷的公司,有的會(huì)為它的TPU買單。

-

gpu

+關(guān)注

關(guān)注

28文章

4908瀏覽量

130622 -

算力

+關(guān)注

關(guān)注

2文章

1141瀏覽量

15434 -

OpenAI

+關(guān)注

關(guān)注

9文章

1201瀏覽量

8623

原文標(biāo)題:侵吞全球算力!谷歌Gemini被曝算力達(dá)GPT-4五倍,手握TPU王牌碾壓OpenAI

文章出處:【微信號(hào):ICViews,微信公眾號(hào):半導(dǎo)體產(chǎn)業(yè)縱橫】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

ChatGPT升級(jí) OpenAI史上最強(qiáng)大模型GPT-4發(fā)布

人工通用智能的火花:GPT-4的早期實(shí)驗(yàn)

GPT-4創(chuàng)造力竟全面碾壓人類!最新創(chuàng)造力測(cè)試GPT4排名前1%

GPT-4創(chuàng)造力竟全面碾壓人類!最新創(chuàng)造力測(cè)試GPT4排名前1%

OpenAI宣布GPT-4 API全面開放使用!

GPT-4沒(méi)有推理能力嗎?

OpenAI最新大模型曝光!劍指多模態(tài),GPT-4之后最大升級(jí)!

ChatGPT重磅更新 OpenAI發(fā)布GPT-4 Turbo模型價(jià)格大降2/3

OpenAI發(fā)布的GPT-4 Turbo版本ChatGPT plus有什么功能?

成都匯陽(yáng)投資關(guān)于谷歌攜 Gemini 王者歸來(lái),AI 算力和應(yīng)用值得期待

ChatGPT plus有什么功能?OpenAI 發(fā)布 GPT-4 Turbo 目前我們所知道的功能

OpenAI計(jì)劃宣布ChatGPT和GPT-4更新

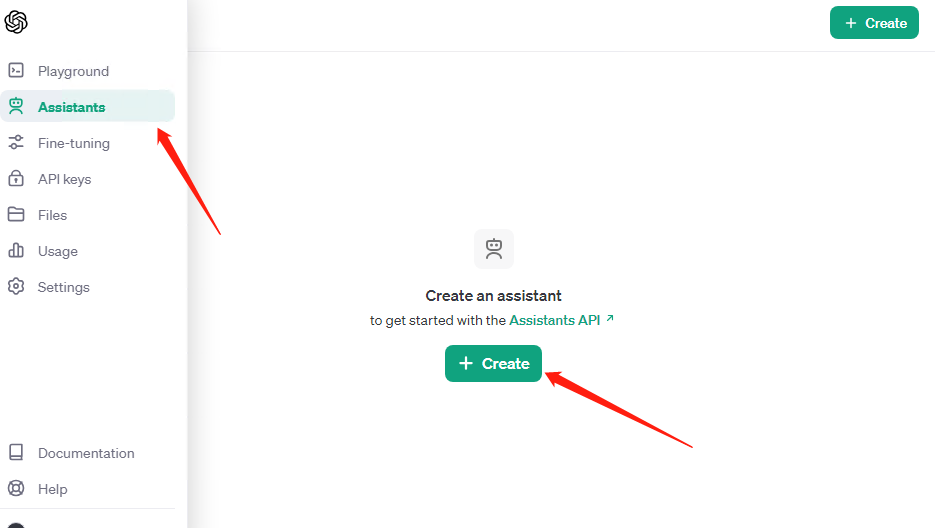

開發(fā)者如何調(diào)用OpenAI的GPT-4o API以及價(jià)格詳情指南

OpenAI API Key獲取:開發(fā)人員申請(qǐng)GPT-4 API Key教程

谷歌Gemini被曝算力達(dá)GPT-4五倍,手握TPU王牌碾壓OpenAI

谷歌Gemini被曝算力達(dá)GPT-4五倍,手握TPU王牌碾壓OpenAI

評(píng)論