芯東西 5 月 22 日報道,生成式 AI 的日益火爆,正對數據中心內存性能提出更加苛刻的要求。無論是云端 AI 訓練還是向網絡邊緣轉移的 AI 推理,都需要高帶寬、低時延的內存。邁向高性能 GDDR6 內存接口已是大勢所趨。

近日,推出業界領先 24Gb/s GDDR6 PHY 的美國半導體 IP 和芯片供應商 Rambus,其兩位高管與芯東西等媒體進行線上交流,分享了 Rambus 在 GDDR6 領域的技術創新及行業發展趨勢。

"ChatGPT 等 AIGC 應用與我們公司的產品組合是非常契合的。"Rambus 大中華區總經理蘇雷說,Rambus China 立足于中國市場,愿意更多、更緊密地支持中國公司在 ChatGPT 產業的發展,為他們保駕護航,"Rambus 面對中國客戶的需求,有最好的技術、最快的響應和最好的技術支持來服務中國市場。"

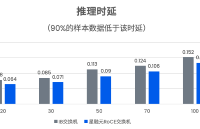

據 Rambus IP 核產品營銷高級總監 Frank Ferro 分享,AI 推理應用對帶寬的需求通常在 200 到 500Gb/s 的范圍之間波動,每一個 GDDR6 設備的帶寬都可以達到 96Gb/s,因此通過將 4-5 個 GDDR6 設備組合在一起,就能輕松滿足 500Gb/s 及以下的帶寬需求。

他談道,如果用到一個 HBM3 設備,基本上會把這個帶寬需求的數字翻倍,能夠達到接近 800Gb/s 的帶寬,而這超過了 AI 推理本身所需要的 400 到 500Gb/s 帶寬,會使成本增加 3~4 倍。在這種條件下,HBM 并非一個經濟高效的選擇,GDDR6 則是一個更好的替代。

他建議按需選擇 HBM 或是 GDDR6 內存,對于對高帶寬和低延遲有很高要求的 AI 訓練場景,HBM 可能是更好的選擇;對于需要更大容量、更高帶寬的 AI 推理場景,GDDR6 會是更合適的選擇。

高性能內存和互連方案,支持下一代數據中心發展

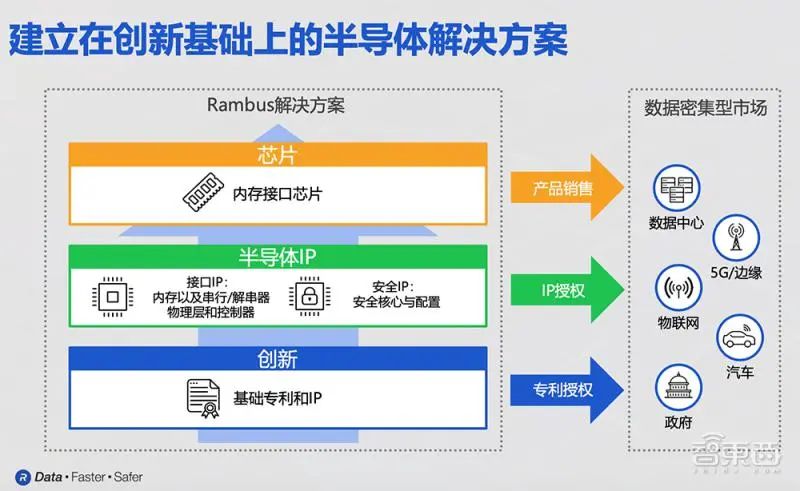

Rambus 大中華區總經理蘇雷談道,Rambus 主要業務包含基礎專利授權、芯片 IP 授權和內存接口芯片。其中芯片 IP 又主要分為接口 IP 和安全 IP。其技術和產品面向數據密集型市場,包括數據中心、5G、物聯網 IoT、汽車等細分市場,后續還將推出 CXL 家族各產品組合芯片。

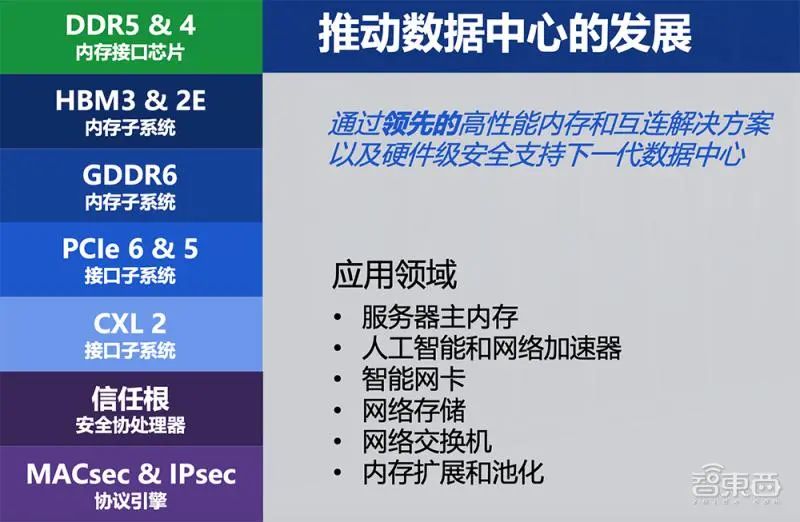

面向數據中心,Rambus 非常注重產品和方案的易用性,通過一站式的解決方案以及完善的服務機制,使產品方案變得更易在客戶端集成使用。Rambus 陸續推出了各內存子系統、接口子系統,提供業界領先、可靠的數據傳輸。其 GDDR6 接口子系統率先實現高達 24Gb/s 的內存接口數據速率,并能為每個 GDDR6 內存設備提供最高達到 96Gb/s 的帶寬。

Rambus 的內存接口芯片產品不斷提高數據中心內存模塊的速度和容量,同時它擁有非常豐富而全面的安全 IP 產品線,對用于靜態數據以及動態數據安全保護都有著專門安全的產品方案。

總體來說,Rambus 通過領先的高性能內存和互聯解決方案以及硬件級安全,支持下一代數據中心的發展。其產品應用領域聚焦于服務器主內存、人工智能和網絡加速器、智能網卡、網絡存儲、網絡交換機以及內存擴展和池化等。

內存是未來 AI 性能的關鍵

Rambus IP 核產品營銷高級總監 Frank Ferro 著重分享了迄今市場推動高性能需求的主要驅動力,以及未來如何更好滿足 AI 性能需求。

數據需求依舊呈現上漲趨勢。ChatGPT 等 AI 相關應用快速發展,對內存帶寬需求旺盛,因此市面上越來越多公司開始專注于開發自己個性化、定制化的處理器產品,以更好地滿足神經網絡以及專屬應用的需求。

Frank Ferro 強調說,盡管算力增長非常顯著,但帶寬的進步與之并不匹配,即現有高算力的基礎之上,很多的 GPU 資源其實并沒有得到充分的占用和利用,這造成了現在的困境。

AI 訓練環節需要錄入大量數據進行分析,需要消耗大量算力。AI 推理環節對算力的需求會大幅下降,但對成本和功耗更加敏感。Frank Ferro 談道,一個重要趨勢是 AI 推理越來越多地向邊緣設備上進行集成和轉移。在這個變化過程中,擁有更高帶寬、更低時延特性的 GDDR6 方案,能夠幫助邊緣端更好地處理數據。

對帶寬需求進一步的增加,驅動了像 Rambus 這樣的公司不斷地在去打造更加新一代的產品,不斷地提高內存帶寬以及接口帶寬的相關速度。

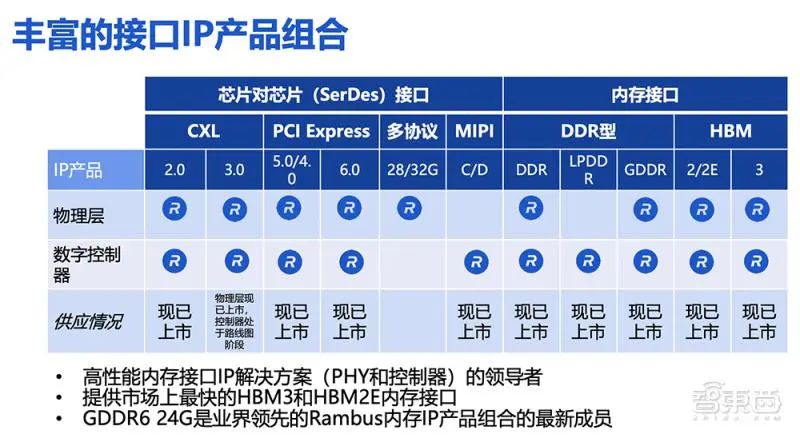

GDDR6 能夠提供 AI 推理所需的內存性能

Rambus 有著豐富的接口 IP 產品組合,同時也提供像 DDR、LPDDR 以及 HBM 等產品,并非常關注 SerDes 產品的開發,主要聚焦于 PCIe 和 CXL 接口,會開發配套的 PHY 及控制器。Rambus 的 HBM 產品擁有領先的市占率,同時其 HBM3 產品已經能夠提供高達 8.4Gbps/s 的數據傳輸速率。

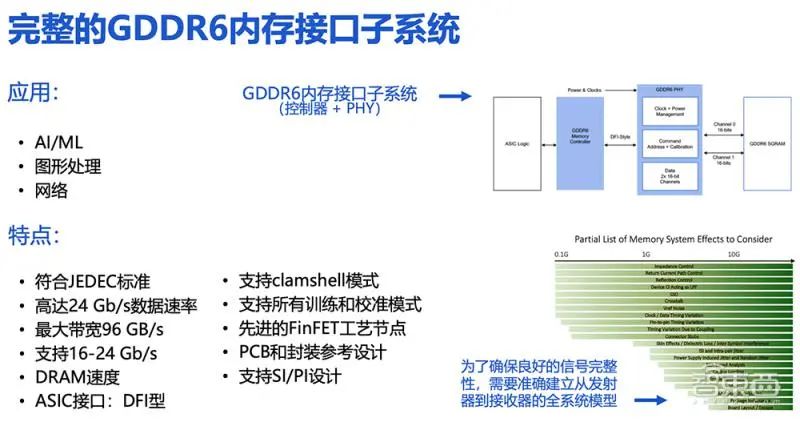

其全新 GDDR6 PHY 及控制器的配套產品已達到業界領先的 24Gb/s 的數據傳輸速率,可為 AI 推理等應用場景帶來巨大性能優勢和收益。此外,該產品在功耗管理方面優勢明顯,并實現了 PHY 以及控制器的完整集成,即客戶收到產品后,可以直接對其子系統進行定制化應用。

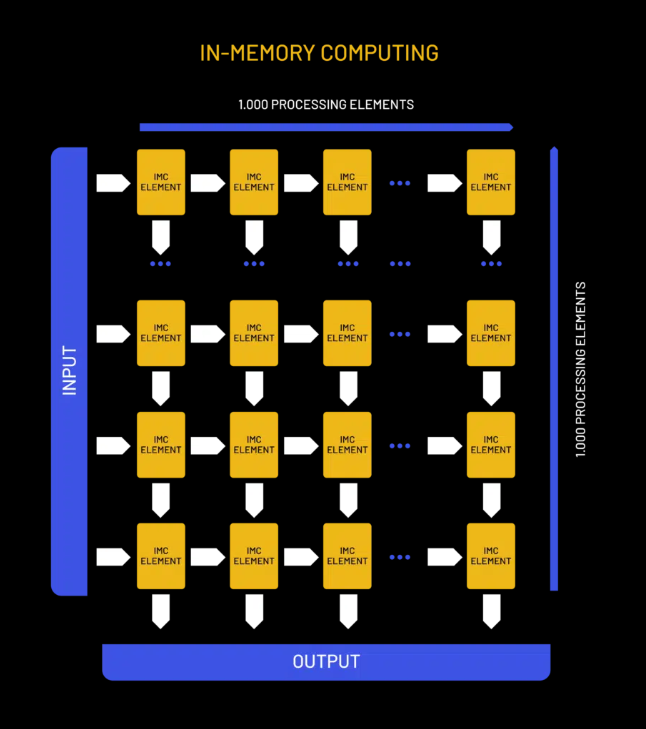

如圖是 GDDR6 內存接口系統,Rambus 提供的是中間標藍的兩個重要環節,也就是完整的子系統。Rambus 會根據客戶具體應用場景和實際的訴求對子系統來進行優化,并將其作為完整的子系統來交付給客戶。

clamshell 模式指每個信道可支持兩個 GDDR6 的設備。換句話說,在 clamshell 模式之下,整個容量是直接翻倍乘以 2 的。值得一提的是,GDDR6 現已支持先進的 FinFET 工藝節點環境。

此外,Rambus 也會針對 PCB 以及封裝提供相關的參考設計,同時內部有信號完整度和邊緣完整性方面的專家,來幫助客戶完成整個設計工作。

市面上很多 GPU 加速器都已經用到 GDDR6。由于在成本和性能之間達到不錯的平衡,GDDR6 成為在 AI 應用場景下比較合理的產品和選擇。而 Rambus 擁有領先的 SI/PI 專業知識,可以進行早期的協同設計和開發,確保 GDDR6 產品的性能表現,也能更好地去縮短產品的上市時間。

結語:在帶寬、成本、方案復雜性之間實現平衡

隨著 AI 應用趨于盛行,蘇雷談道,下游廠商首先關注高帶寬,并開始關注方案的成本和復雜性,"GDDR 技術是在帶寬、成本和方案復雜性的各因素之間提供了一個非常完美的折中技術方案。" 他預計到 2025 年或 2026 年市場上會出現使用 GDDR6 IP 的芯片。

進入全新的 GDDR6 時代,相關產品已開始采用 16 位的雙讀寫通道。雙讀寫通道加起來是 32 位的數據寬度,而 GDDR6 內存有 8 個雙讀寫通道,總共可實現 256 位的數據傳輸寬度,所以能夠顯著提高數據傳輸的速度和效率,系統層效率和功耗管理也能得到進一步的優化。

除了適用于 AI 推理場景外,Frank Ferro 說,GDDR6 也會在圖形領域和一些網絡應用場景中起到重要作用,能夠大幅降低網絡邊緣設備對 DDR 數量的需求。

審核編輯 :李倩

-

芯片

+關注

關注

459文章

52145瀏覽量

435946 -

控制器

+關注

關注

114文章

16959瀏覽量

182857 -

AI

+關注

關注

87文章

34146瀏覽量

275299

原文標題:【媒體報道】緩解 AI 推理算力焦慮,高帶寬 GDDR6 成殺手锏?

文章出處:【微信號:Rambus 藍鉑世科技,微信公眾號:Rambus 藍鉑世科技】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

6TOPS算力NPU加持!RK3588如何重塑8K顯示的邊緣計算新邊界

RAKsmart服務器如何重塑AI高并發算力格局

DeepSeek推動AI算力需求:800G光模塊的關鍵作用

國產推理服務器如何選擇?深度解析選型指南與華頡科技實戰案例

沖刺海外高端市場 傳音控股也有殺手锏 ?

AI時代核心存力HBM(上)

基站和雷達知識介紹

OpenAI開啟推理算力新Scaling Law,AI PC和CPU的機會來了

英偉達推出搭載GDDR6顯存的GeForce RTX 4070顯卡

成都匯陽投資關于跨越帶寬增長極限,HBM 賦能AI新紀元

美光出樣業界容量密度最高新一代 GDDR7 顯存

如何基于OrangePi?AIpro開發AI推理應用

緩解AI推理算力焦慮,高帶寬GDDR6成殺手锏?

緩解AI推理算力焦慮,高帶寬GDDR6成殺手锏?

評論