最近,在ChatGPT火了之后,國(guó)內(nèi)互聯(lián)網(wǎng)科技圈不時(shí)傳出計(jì)劃或者正在研究類ChatGPT大模型的消息。

然而在相關(guān)技術(shù)真正面世之前,近日,OpenAI又放出新消息,該公司正式開(kāi)放了ChatGPT的API接口,開(kāi)發(fā)人員可以將ChatGPT模型集成到他們的應(yīng)用程序和產(chǎn)品中。這意味著ChatGPT將會(huì)以更快的速度占領(lǐng)市場(chǎng),因此國(guó)內(nèi)企業(yè)在大模型的研究中更要加快進(jìn)度。

在大模型發(fā)展中,國(guó)內(nèi)具備了怎樣的條件

在類ChatGPT及其他大模型的發(fā)展中,國(guó)內(nèi)是否具備相應(yīng)的條件呢?登臨科技聯(lián)合創(chuàng)始人王平日前在接受電子發(fā)燒友采訪的時(shí)候談到了幾點(diǎn):

他認(rèn)為,國(guó)內(nèi)在這方面是具備一定條件的,首先是數(shù)據(jù),這是大模型技術(shù)中非常重要的一個(gè)生產(chǎn)要素,國(guó)內(nèi)在數(shù)據(jù)上是有一定積累的;其次是人才,在這方面國(guó)內(nèi)有不少優(yōu)秀的算法人才,在大模型方面具備一定的知識(shí)基礎(chǔ)與經(jīng)驗(yàn);此外,目前國(guó)內(nèi)也有比較不錯(cuò)的AI框架平臺(tái)以及具備核心技術(shù)完全自主研發(fā)能力的GPGPU廠商。整體來(lái)說(shuō)整套的生產(chǎn)要素上都有一定的基礎(chǔ),只不過(guò)在成熟度上跟OpenAI相比還存在一定差距。

具體來(lái)看,在AI框架方面,OpenAI能夠推出能力如此強(qiáng)大的ChatGPT,它應(yīng)該有自己專門的框架。現(xiàn)在各種商用的框架,包括國(guó)產(chǎn)的飛槳paddlepaddle,以及Tensorflow或者Pytorch,其實(shí)更多是用于常規(guī)模型,而不是大模型的調(diào)度。因此在發(fā)展ChatGPT類大模型方面,還存在一些挑戰(zhàn),需要去持續(xù)創(chuàng)新。

在人才方面,雖然目前國(guó)內(nèi)具備一些算法相關(guān)的人才,然而整體而言是處于較為緊缺的狀態(tài)。另外大模型的訓(xùn)練,也需要算法工程師具備豐富的經(jīng)驗(yàn)積累,因?yàn)槟P吞螅虚g涉及很多技術(shù),這并不是短時(shí)間砸錢就能達(dá)到的。

在硬件層面,國(guó)內(nèi)的GPGPU具有自身的特色,甚至在一些領(lǐng)域比NVIDIA更具優(yōu)勢(shì),在ChatGPT或者相關(guān)大模型上,也有它的優(yōu)勢(shì)。不過(guò)整體來(lái)看,還是存在差距,需要不斷進(jìn)行創(chuàng)新和迭代,要不停的向前走。

大模型發(fā)展對(duì)GPGPU提出了怎樣的要求

ChatGPT火熱之后,可以明顯看到國(guó)內(nèi)在AI大模型方面的發(fā)展將會(huì)加速,這對(duì)國(guó)內(nèi)GPGPU來(lái)說(shuō)意味著什么呢?大模型的發(fā)展,必然少不了GPGPU,GPGPU對(duì)于大模型就相當(dāng)于是發(fā)動(dòng)機(jī)之于汽車。王平認(rèn)為,近十幾年AI的再度興起,到現(xiàn)在ChatGPT的爆火,以及未來(lái)AI產(chǎn)業(yè)的發(fā)展再上一個(gè)臺(tái)階,如果沒(méi)有GPGPU,這些都不大可能會(huì)實(shí)現(xiàn)。

因?yàn)槊總€(gè)大模型訓(xùn)練和部署的背后,都有幾萬(wàn)個(gè)GPGPU在支持。可想而知,未來(lái)隨著這方面的研發(fā)和應(yīng)用的普及,GPGPU市場(chǎng)需求將會(huì)再度迎來(lái)爆發(fā)式增長(zhǎng)。

以電力為例,就可以很清楚的看到這個(gè)市場(chǎng)未來(lái)可能發(fā)生的變化。幾十年前,電力只是用在一些小用量的場(chǎng)景,隨著電力的供給越來(lái)越多,電器也越來(lái)越多的時(shí)候,最后電力就成了一個(gè)基本設(shè)施。可以說(shuō),算力也是朝著基礎(chǔ)設(shè)施的方向在發(fā)展。在王平看來(lái),現(xiàn)在GPGPU還遠(yuǎn)沒(méi)有到爆炸式需求的階段。

當(dāng)然在ChatGPT或者其他大模型訓(xùn)練和部署,對(duì)GPGPU或者說(shuō)算力也會(huì)有更高的要求。王平談到了幾個(gè)方面:

首先從單卡層面來(lái)看,先來(lái)看一組數(shù)據(jù),1月份的時(shí)候ChatGPT的用戶數(shù)突破1億,日訪問(wèn)量有幾千萬(wàn),在這種情況下,它的運(yùn)營(yíng)成本會(huì)相當(dāng)高,每天的電費(fèi)在幾十萬(wàn)人民幣量級(jí)。這時(shí)候計(jì)算效率很重要,如果計(jì)算架構(gòu)相比于傳統(tǒng)的GPGPU更有優(yōu)勢(shì)的話,比如,登臨科技一些計(jì)算密度更大的產(chǎn)品,在計(jì)算效率上就更有優(yōu)勢(shì)。

其次是單卡之外,卡片間的互聯(lián)也很重要。因?yàn)樵谟脩魝?cè)工作的實(shí)際上是一個(gè)超級(jí)計(jì)算機(jī)系統(tǒng),在訓(xùn)練的時(shí)候,帶寬、片間、服務(wù)器間的信息傳遞很重要,這就需要針對(duì)大模型的訓(xùn)練框架,在整個(gè)服務(wù)器集群的調(diào)度和協(xié)同工作中進(jìn)行升級(jí)優(yōu)化。

再者就是軟件方面,一般來(lái)說(shuō)在軟硬件協(xié)同的系統(tǒng)里,軟件的重要作用不可忽視,因?yàn)橐恍┸浖5脑颍蛘哕浖f(xié)同調(diào)度的問(wèn)題,硬件往往不能完全發(fā)揮出能力。所以我們經(jīng)常可以看到,在一些場(chǎng)景下,軟件稍微進(jìn)行優(yōu)化,整體應(yīng)用性能就會(huì)有百分之幾十,甚至百分之百的提升。

從硬件公司的角度來(lái)看,GPGPU是一個(gè)通用平臺(tái),行業(yè)整體有產(chǎn)品異構(gòu)化的走向,總體來(lái)說(shuō),GPGPU存在一些性能瓶頸。登臨科技是一家專注于高性能通用計(jì)算平臺(tái)的芯片研發(fā)與技術(shù)創(chuàng)新的公司,登臨自主研發(fā)的GPU+架構(gòu)正式采用了軟件定義的片內(nèi)異構(gòu)體系,目前首款基于GPU+的系列產(chǎn)品—Goldwasser已在云至邊緣的各個(gè)應(yīng)用場(chǎng)景實(shí)現(xiàn)規(guī)模化落地。據(jù)王平介紹:登臨科技希望通過(guò)異構(gòu),從由點(diǎn)及面在一些足夠大的市場(chǎng)領(lǐng)域,把產(chǎn)品做到比英偉達(dá)同系列產(chǎn)品更具性價(jià)比優(yōu)勢(shì),甚至超過(guò)英偉達(dá)。

帶著這樣的出發(fā)點(diǎn),在大型語(yǔ)言模型方面,登臨科技會(huì)更關(guān)心如何更好的提升產(chǎn)品的能效比。簡(jiǎn)單來(lái)說(shuō),在同樣功耗下,登臨科技可以提供英偉達(dá)1.5到2倍的算力,在算力一致的情況下,做到單位功耗更低這樣從計(jì)算的整體性能上實(shí)現(xiàn)英偉達(dá)同類產(chǎn)品的能效比3倍的優(yōu)勢(shì)。如此一來(lái),上面提到的電費(fèi)、運(yùn)維成本都將會(huì)有很大的節(jié)省。

小結(jié)

不難看出,以ChatGPT為代表的大語(yǔ)言模型發(fā)展和應(yīng)用,對(duì)人們生產(chǎn)生活意義重大。隨著它的技術(shù)和應(yīng)用逐步成熟,其對(duì)GPGPU等算力硬件的需求將會(huì)持續(xù)增加,就如同文中提到的電力的發(fā)展路徑一樣。當(dāng)然大模型對(duì)GPGPU及算力集群系統(tǒng)的也有更高的要求,比如計(jì)算效率更高,能夠節(jié)省電費(fèi)和運(yùn)維成本等,可想而知,對(duì)于硬件公司來(lái)說(shuō),誰(shuí)能夠在這方面更具優(yōu)勢(shì),誰(shuí)就更能在未來(lái)大模型處處落地的時(shí)候,更占據(jù)優(yōu)勢(shì)。

審核編輯 :李倩

-

算法

+關(guān)注

關(guān)注

23文章

4695瀏覽量

94647 -

API

+關(guān)注

關(guān)注

2文章

1559瀏覽量

63490 -

ChatGPT

+關(guān)注

關(guān)注

29文章

1586瀏覽量

8775 -

大模型

+關(guān)注

關(guān)注

2文章

3008瀏覽量

3784

原文標(biāo)題:ChatGPT等大模型的發(fā)展,對(duì)GPGPU有怎樣的性能要求?

文章出處:【微信號(hào):elecfans,微信公眾號(hào):電子發(fā)燒友網(wǎng)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

【「大模型啟示錄」閱讀體驗(yàn)】+開(kāi)啟智能時(shí)代的新鑰匙

國(guó)芯科技:已結(jié)束基于RISC-V架構(gòu)GPGPU研發(fā)

【「大模型啟示錄」閱讀體驗(yàn)】如何在客服領(lǐng)域應(yīng)用大模型

開(kāi)源與閉源之爭(zhēng):最新的開(kāi)源模型到底還落后多少?

國(guó)產(chǎn)大模型發(fā)展的經(jīng)驗(yàn)與教訓(xùn)

ChatGPT:怎樣打造智能客服體驗(yàn)的重要工具?

如何提升 ChatGPT 的響應(yīng)速度

ChatGPT 與人工智能的未來(lái)發(fā)展

怎樣搭建基于 ChatGPT 的聊天系統(tǒng)

如何使用 ChatGPT 進(jìn)行內(nèi)容創(chuàng)作

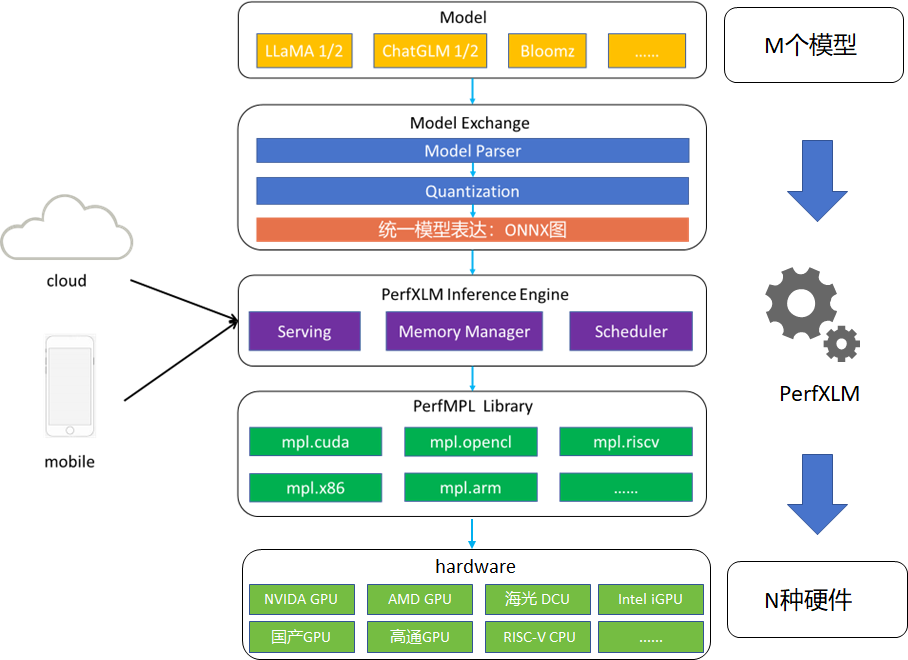

澎峰科技高性能大模型推理引擎PerfXLM解析

ChatGPT等大模型的發(fā)展,對(duì)GPGPU有怎樣的性能要求?

ChatGPT等大模型的發(fā)展,對(duì)GPGPU有怎樣的性能要求?

評(píng)論