我覺(jué)得這個(gè)問(wèn)題倒過(guò)來(lái)回答比較合適,先解答一下目前主流的大型游戲,都是使用什么語(yǔ)言開(kāi)發(fā)的。再說(shuō)說(shuō)哪種語(yǔ)言更適合開(kāi)發(fā)大型游戲。

首先,先說(shuō)下,大部分游戲,甚至是應(yīng)用,都極少只使用一種語(yǔ)言開(kāi)發(fā)的。

主流游戲的開(kāi)發(fā)語(yǔ)言

LOL

LOL登陸后的界面,是使用html編寫的,主界面的動(dòng)畫效果是html+flash動(dòng)畫處理的。重點(diǎn)來(lái)了,游戲所使用的引擎,是拳頭公司自己開(kāi)發(fā)的3D引擎,是基于C++開(kāi)發(fā)的。

GAT5

這里就說(shuō)GAT5吧,GAT5采用的是RAGE引擎,這個(gè)引擎適用于PC、PS3、PS4、Wii、Xbox One和Xbox 360平臺(tái)。據(jù)我所知,應(yīng)該是用C++寫的……

王者榮耀

王者榮耀是基于Unity3d(.NET C#)引擎開(kāi)發(fā)的跨平臺(tái)游戲,具網(wǎng)友拆包發(fā)現(xiàn),王者榮耀使用的開(kāi)發(fā)語(yǔ)言為C#。

絕地求生

據(jù)我所知,絕地求生(端游),使用的是虛幻4引擎,用的是C++。

游戲開(kāi)發(fā)語(yǔ)言

如果一家游戲公司要開(kāi)發(fā)自己的游戲引擎,為了效率,大部分都會(huì)選擇C++作為開(kāi)發(fā)語(yǔ)言。但可以開(kāi)發(fā)游戲的語(yǔ)言非常多,主要包括C/C++,匯編語(yǔ)言,腳本語(yǔ)言、高效的開(kāi)發(fā)語(yǔ)言C#或Java。可以說(shuō)開(kāi)發(fā)游戲,C/C++是基礎(chǔ)也是最強(qiáng)大的。

但隨著移動(dòng)時(shí)代的到來(lái),Unity3D引擎被越來(lái)越多的游戲使用,而Unity3D有三種腳本語(yǔ)言可供選擇:java、C#、Boo,而C#是比較主流的。

C++和C#哪個(gè)適合?

這個(gè)要看你對(duì)大型游戲是個(gè)什么定義了,精細(xì)一點(diǎn),MMORPG才算大型游戲,通俗點(diǎn),畫面精致,可創(chuàng)造性強(qiáng),籠統(tǒng)一點(diǎn),只要很多人玩,游戲也很需要技巧,就算大型游戲。

這樣,我列出一般開(kāi)發(fā)游戲使用的語(yǔ)言。

2D頁(yè)游:AS3 JS

3D頁(yè)游:AS3 C#(Unity)

IOS游戲:Obj-C js/lua(Cocos-2d-x) js/C#(Unity) AS3

安卓游戲:java js/lua(Cocos-2d-x) js/C#(Unity) AS3

在線小游戲:AS3 JS大型單機(jī)游戲/客戶端MMORPG::C++ C#

另外的話為了幫助大家,輕松,高效學(xué)習(xí)C語(yǔ)言/C++,我給大家分享我收集的資源,從最零基礎(chǔ)開(kāi)始的教程到C語(yǔ)言項(xiàng)目案例,幫助大家在學(xué)習(xí)C語(yǔ)言的道路上披荊斬棘!可以來(lái)我粉絲群領(lǐng)取哦~

審核編輯 :李倩

-

C語(yǔ)言

+關(guān)注

關(guān)注

180文章

7630瀏覽量

140182 -

編程語(yǔ)言

+關(guān)注

關(guān)注

10文章

1955瀏覽量

36042 -

C++

+關(guān)注

關(guān)注

22文章

2117瀏覽量

74763

原文標(biāo)題:編程語(yǔ)言:C++和C#,哪個(gè)更適合開(kāi)發(fā)大型游戲?

文章出處:【微信號(hào):cyuyanxuexi,微信公眾號(hào):C語(yǔ)言編程學(xué)習(xí)基地】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

購(gòu)買前須知:樹(shù)莓派和迷你PC,哪個(gè)更適合你?

樹(shù)莓派復(fù)古游戲“雙雄會(huì)”,Batocera 和 RetroPie 誰(shuí)更懂你?

底層開(kāi)發(fā)與應(yīng)用開(kāi)發(fā)到底怎么選?

無(wú)法在OVMS上運(yùn)行來(lái)自Meta的大型語(yǔ)言模型 (LLM),為什么?

大語(yǔ)言模型開(kāi)發(fā)框架是什么

大語(yǔ)言模型開(kāi)發(fā)語(yǔ)言是什么

如何選擇適合自己的編程語(yǔ)言

大語(yǔ)言模型如何開(kāi)發(fā)

ChatGPT 在游戲開(kāi)發(fā)中的創(chuàng)新應(yīng)用

如何利用大型語(yǔ)言模型驅(qū)動(dòng)的搜索為公司創(chuàng)造價(jià)值

使用哪種運(yùn)放比較適合做衰減用,且不會(huì)失真很嚴(yán)重?

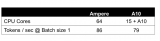

基于CPU的大型語(yǔ)言模型推理實(shí)驗(yàn)

哪種語(yǔ)言更適合開(kāi)發(fā)大型游戲

哪種語(yǔ)言更適合開(kāi)發(fā)大型游戲

評(píng)論