什么是神經(jīng)網(wǎng)絡激活函數(shù)?

激活函數(shù)有助于決定我們是否需要激活神經(jīng)元。如果我們需要發(fā)射一個神經(jīng)元那么信號的強度是多少。

激活函數(shù)是神經(jīng)元通過神經(jīng)網(wǎng)絡處理和傳遞信息的機制

為什么在神經(jīng)網(wǎng)絡中需要一個激活函數(shù)?

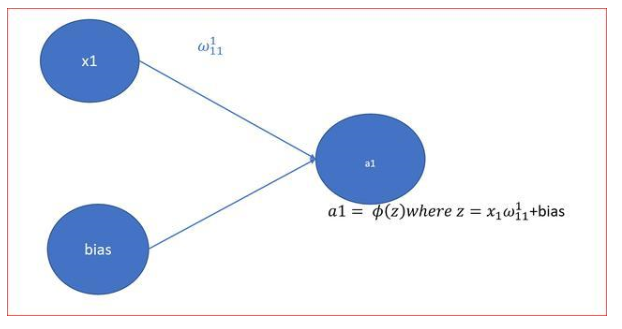

在神經(jīng)網(wǎng)絡中,z是輸入節(jié)點與節(jié)點權值加上偏差的乘積。z的方程與線性方程非常相似,取值范圍從+∞到-∞

如果神經(jīng)元的值可以從負無窮到正無窮變化,那么我們就無法決定是否需要激活神經(jīng)元。這就是激活函數(shù)幫助我們解決問題的地方。

如果z是線性的,那么我們就不能解決復雜的問題。這是我們使用激活函數(shù)的另一個原因。

有以下不同類型的激活函數(shù)

閥值函數(shù)或階梯激活函數(shù)

Sigmoid

Softmax

Tanh或雙曲正切

ReLU

Leaky ReLU

為什么我們需要這么多不同的激活函數(shù),我怎么決定用哪一個呢?

讓我們回顧一下每一個激活函數(shù),并了解它們的最佳使用位置和原因。這將幫助我們決定在不同的場景中使用哪個激活函數(shù)。

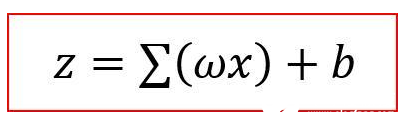

閥值函數(shù)或階梯激活函數(shù)

這是最簡單的函數(shù)

如果z值高于閾值,則激活設置為1或yes,神經(jīng)元將被激活。

如果z值低于閾值,則激活設置為0或no,神經(jīng)元不會被激活。

它們對二分類很有用。】

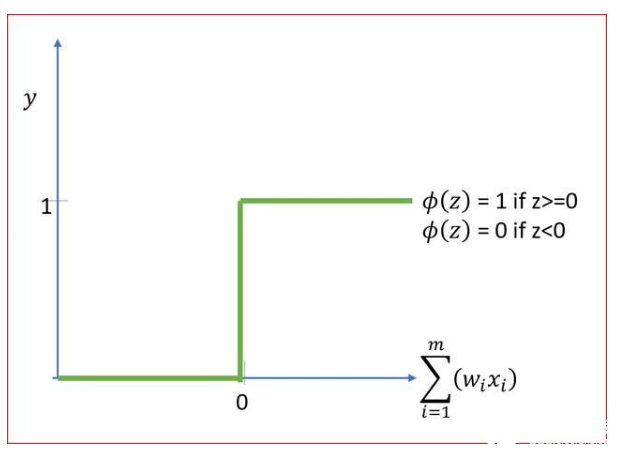

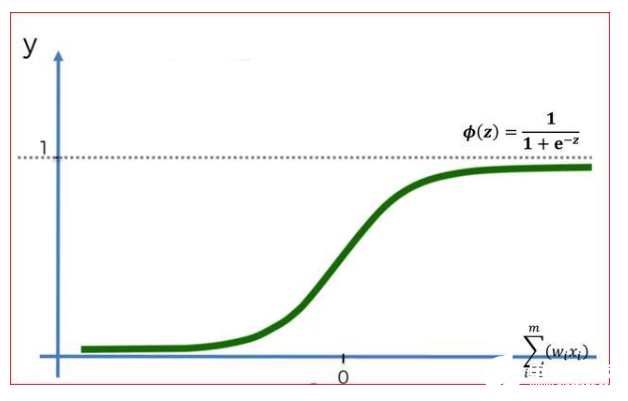

Sigmoid激活函數(shù)

Sigmoid函數(shù)是一種光滑的非線性函數(shù),無扭結,形狀類似于S形。

它預測輸出的概率,因此被用于神經(jīng)網(wǎng)絡和邏輯回歸的輸出層。

由于概率范圍在0到1之間,所以sigmoid函數(shù)值存在于0到1之間。

但是如果我們想分類更多的是或不是呢?如果我想預測多個類,比如預測晴天、雨天或陰天,該怎么辦?

Softmax激活有助于多類分類

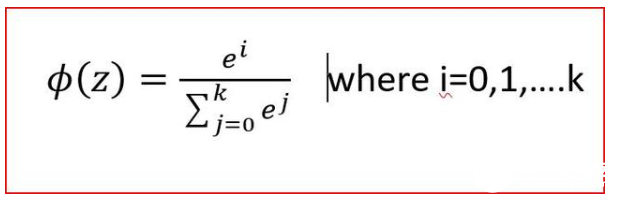

Softmax激活函數(shù)

Sigmoid激活函數(shù)用于兩類或二類分類,而softmax用于多類分類,是對Sigmoid函數(shù)的一種推廣。

在softmax中,我們得到了每個類的概率,它們的和應該等于1。當一個類的概率增大時,其他類的概率減小,因此概率最大的類是輸出類。

例如:在預測天氣時,我們可以得到輸出概率,晴天為0.68,陰天為0.22,雨天為0.20。在這種情況下,我們以最大概率的輸出作為最終的輸出。在這種情況下我們預測明天將是晴天。

Softmax計算每個目標類的概率除以所有可能的目標類的概率。

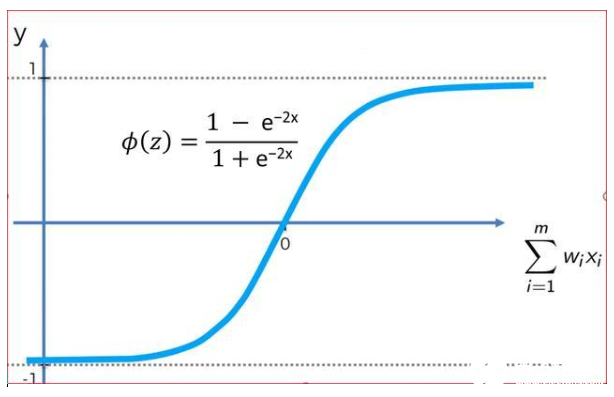

雙曲正切或Tanh激活函數(shù)

對于雙曲tanh函數(shù),輸出以0為中心,輸出范圍在-1和+1之間。

看起來很像Sigmoid。實際上雙曲tanh是縮放的s形函數(shù)。與Sigmoid相比,tanh的梯度下降作用更強,因此比Sigmoid更受歡迎。

tanh的優(yōu)點是,負輸入將被映射為強負,零輸入將被映射為接近零,這在sigmoid中是不會發(fā)生的,因為sigmoid的范圍在0到1之間

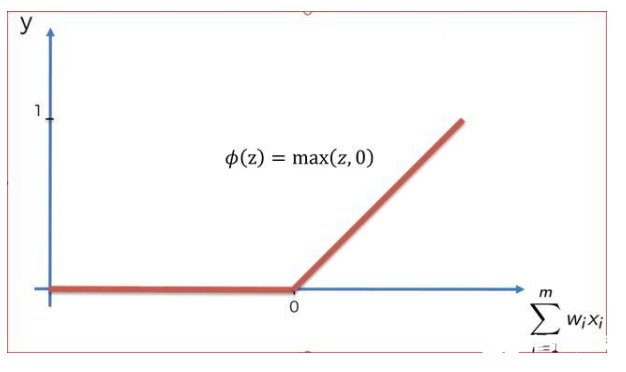

ReLU

ReLU本質(zhì)上是非線性的,這意味著它的斜率不是常數(shù)。Relu在0附近是非線性的,但斜率不是0就是1,因此具有有限的非線性。

范圍是從0到∞

當z為正時,ReLU的輸出與輸入相同。當z為0或小于0時,輸出為0。因此,當輸入為0或低于0時,ReLU會關閉神經(jīng)元。

所有的深度學習模型都使用Relu,但由于Relu的稀疏性,只能用于隱含層。稀疏性指的是空值或“NA”值的數(shù)量。

當隱層暴露于一定范圍的輸入值時,RELU函數(shù)將導致更多的零,從而導致更少的神經(jīng)元被激活,這將意味著更少的神經(jīng)網(wǎng)絡交互作用。

ReLU比sigmoid或tanh更積極地打開或關閉神經(jīng)元

Relu的挑戰(zhàn)在于,負值變?yōu)榱憬档土四P驼_訓練數(shù)據(jù)的能力。為了解決這個問題,我們有Leaky ReLU

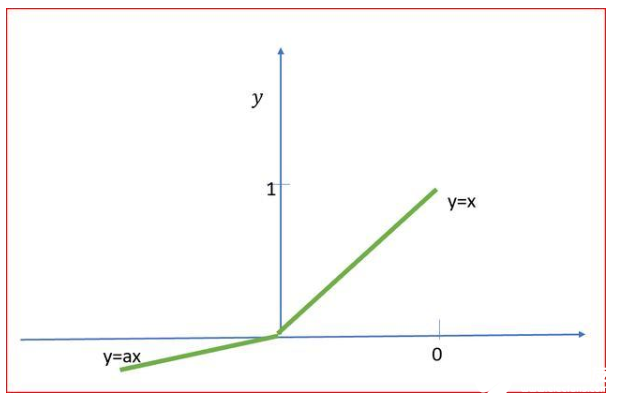

Leaky ReLU

a的值通常是0.01

在Leaky ReLU中,我們引入了一個小的負斜率,所以它的斜率不是0。這有助于加快訓練。

Leaky ReLU的范圍從-∞到+∞

-

神經(jīng)網(wǎng)絡

+關注

關注

42文章

4806瀏覽量

102735 -

函數(shù)

+關注

關注

3文章

4367瀏覽量

64164 -

神經(jīng)元

+關注

關注

1文章

368瀏覽量

18746

發(fā)布評論請先 登錄

圖文詳解:神經(jīng)網(wǎng)絡的激活函數(shù)

圖文詳解:神經(jīng)網(wǎng)絡的激活函數(shù)

評論