神經(jīng)網(wǎng)絡(luò)曾經(jīng)很火,有過(guò)一段低迷期,現(xiàn)在因?yàn)?a href="http://www.asorrir.com/v/tag/448/" target="_blank">深度學(xué)習(xí)的原因繼續(xù)火起來(lái)了。神經(jīng)網(wǎng)絡(luò)有很多種:前向傳輸網(wǎng)絡(luò)、反向傳輸網(wǎng)絡(luò)、遞歸神經(jīng)網(wǎng)絡(luò)、卷積神經(jīng)網(wǎng)絡(luò)等。本文介紹基本的反向傳輸神經(jīng)網(wǎng)絡(luò)(Backpropagation 簡(jiǎn)稱BP),主要講述算法的基本流程和自己在訓(xùn)練BP神經(jīng)網(wǎng)絡(luò)的一些經(jīng)驗(yàn)。

BP神經(jīng)網(wǎng)絡(luò)的結(jié)構(gòu)

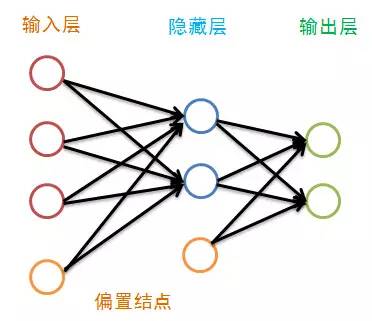

神經(jīng)網(wǎng)絡(luò)就是模擬人的大腦的神經(jīng)單元的工作方式,但進(jìn)行了很大的簡(jiǎn)化,神經(jīng)網(wǎng)絡(luò)由很多神經(jīng)網(wǎng)絡(luò)層構(gòu)成,而每一層又由許多單元組成,第一層叫輸入層,最后一層叫輸出層,中間的各層叫隱藏層,在BP神經(jīng)網(wǎng)絡(luò)中,只有相鄰的神經(jīng)層的各個(gè)單元之間有聯(lián)系,除了輸出層外,每一層都有一個(gè)偏置結(jié)點(diǎn):

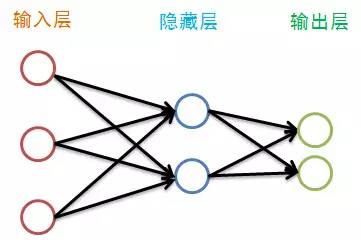

雖然圖中隱藏層只畫了一層,但其層數(shù)并沒有限制,傳統(tǒng)的神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)經(jīng)驗(yàn)認(rèn)為一層就足夠好,而最近的深度學(xué)習(xí)不這么認(rèn)為。偏置結(jié)點(diǎn)是為了描述訓(xùn)練數(shù)據(jù)中沒有的特征,偏置結(jié)點(diǎn)對(duì)于下一層的每一個(gè)結(jié)點(diǎn)的權(quán)重的不同而生產(chǎn)不同的偏置,于是可以認(rèn)為偏置是每一個(gè)結(jié)點(diǎn)(除輸入層外)的屬性。我們偏置結(jié)點(diǎn)在圖中省略掉:

在描述BP神經(jīng)網(wǎng)絡(luò)的訓(xùn)練之前,我們先來(lái)看看神經(jīng)網(wǎng)絡(luò)各層都有哪些屬性:

每一個(gè)神經(jīng)單元都有一定量的能量,我們定義其能量值為該結(jié)點(diǎn)j的輸出值Oj;

相鄰層之間結(jié)點(diǎn)的連接有一個(gè)權(quán)重Wij,其值在[-1,1]之間;

除輸入層外,每一層的各個(gè)結(jié)點(diǎn)都有一個(gè)輸入值,其值為上一層所有結(jié)點(diǎn)按權(quán)重傳遞過(guò)來(lái)的能量之和加上偏置;

除輸入層外,每一層都有一個(gè)偏置值,其值在[0,1]之間;

除輸入層外,每個(gè)結(jié)點(diǎn)的輸出值等該結(jié)點(diǎn)的輸入值作非線性變換;

我們認(rèn)為輸入層沒有輸入值,其輸出值即為訓(xùn)練數(shù)據(jù)的屬性,比如一條記錄X=<(1,2,3),類別1>,那么輸入層的三個(gè)結(jié)點(diǎn)的輸出值分別為1,2,3. 因此輸入層的結(jié)點(diǎn)個(gè)數(shù)一般等于訓(xùn)練數(shù)據(jù)的屬性個(gè)數(shù)。

訓(xùn)練一個(gè)BP神經(jīng)網(wǎng)絡(luò),實(shí)際上就是調(diào)整網(wǎng)絡(luò)的權(quán)重和偏置這兩個(gè)參數(shù),BP神經(jīng)網(wǎng)絡(luò)的訓(xùn)練過(guò)程分兩部分:

前向傳輸,逐層波浪式的傳遞輸出值;

逆向反饋,反向逐層調(diào)整權(quán)重和偏置;

我們先來(lái)看前向傳輸。

前向傳輸(Feed-Forward前向反饋)

在訓(xùn)練網(wǎng)絡(luò)之前,我們需要隨機(jī)初始化權(quán)重和偏置,對(duì)每一個(gè)權(quán)重取[-1,1]的一個(gè)隨機(jī)實(shí)數(shù),每一個(gè)偏置取[0,1]的一個(gè)隨機(jī)實(shí)數(shù),之后就開始進(jìn)行前向傳輸。

神經(jīng)網(wǎng)絡(luò)的訓(xùn)練是由多趟迭代完成的,每一趟迭代都使用訓(xùn)練集的所有記錄,而每一次訓(xùn)練網(wǎng)絡(luò)只使用一條記錄,抽象的描述如下:

while 終止條件未滿足:

for record

trainModel(record)

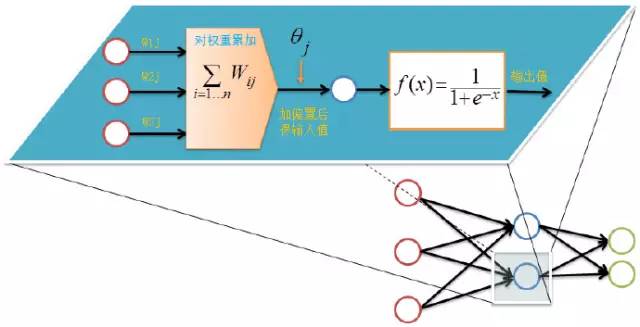

首先設(shè)置輸入層的輸出值,假設(shè)屬性的個(gè)數(shù)為100,那我們就設(shè)置輸入層的神經(jīng)單元個(gè)數(shù)為100,輸入層的結(jié)點(diǎn)Ni為記錄第i維上的屬性值xi。對(duì)輸入層的操作就這么簡(jiǎn)單,之后的每層就要復(fù)雜一些了,除輸入層外,其他各層的輸入值是上一層輸入值按權(quán)重累加的結(jié)果值加上偏置,每個(gè)結(jié)點(diǎn)的輸出值等該結(jié)點(diǎn)的輸入值作變換

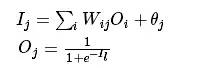

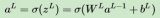

前向傳輸?shù)妮敵鰧拥挠?jì)算過(guò)程公式如下:

對(duì)隱藏層和輸出層的每一個(gè)結(jié)點(diǎn)都按照如上圖的方式計(jì)算輸出值,就完成前向傳播的過(guò)程,緊接著是進(jìn)行逆向反饋。

逆向反饋(Backpropagation)

逆向反饋從最后一層即輸出層開始,我們訓(xùn)練神經(jīng)網(wǎng)絡(luò)作分類的目的往往是希望最后一層的輸出能夠描述數(shù)據(jù)記錄的類別,比如對(duì)于一個(gè)二分類的問(wèn)題,我們常常用兩個(gè)神經(jīng)單元作為輸出層,如果輸出層的第一個(gè)神經(jīng)單元的輸出值比第二個(gè)神經(jīng)單元大,我們認(rèn)為這個(gè)數(shù)據(jù)記錄屬于第一類,否則屬于第二類。

還記得我們第一次前向反饋時(shí),整個(gè)網(wǎng)絡(luò)的權(quán)重和偏置都是我們隨機(jī)取,因此網(wǎng)絡(luò)的輸出肯定還不能描述記錄的類別,因此需要調(diào)整網(wǎng)絡(luò)的參數(shù),即權(quán)重值和偏置值,而調(diào)整的依據(jù)就是網(wǎng)絡(luò)的輸出層的輸出值與類別之間的差異,通過(guò)調(diào)整參數(shù)來(lái)縮小這個(gè)差異,這就是神經(jīng)網(wǎng)絡(luò)的優(yōu)化目標(biāo)。對(duì)于輸出層:

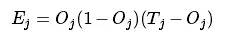

其中Ej表示第j個(gè)結(jié)點(diǎn)的誤差值,Oj表示第j個(gè)結(jié)點(diǎn)的輸出值,Tj記錄輸出值,比如對(duì)于2分類問(wèn)題,我們用01表示類標(biāo)1,10表示類別2,如果一個(gè)記錄屬于類別1,那么其T1=0,T2=1。

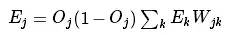

中間的隱藏層并不直接與數(shù)據(jù)記錄的類別打交道,而是通過(guò)下一層的所有結(jié)點(diǎn)誤差按權(quán)重累加,計(jì)算公式如下:

其中Wjk表示當(dāng)前層的結(jié)點(diǎn)j到下一層的結(jié)點(diǎn)k的權(quán)重值,Ek下一層的結(jié)點(diǎn)k的誤差率。

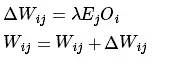

計(jì)算完誤差率后,就可以利用誤差率對(duì)權(quán)重和偏置進(jìn)行更新,首先看權(quán)重的更新:

其中λ表示表示學(xué)習(xí)速率,取值為0到1,學(xué)習(xí)速率設(shè)置得大,訓(xùn)練收斂更快,但容易陷入局部最優(yōu)解,學(xué)習(xí)速率設(shè)置得比較小的話,收斂速度較慢,但能一步步逼近全局最優(yōu)解。

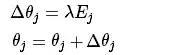

更新完權(quán)重后,還有最后一項(xiàng)參數(shù)需要更新,即偏置:

至此,我們完成了一次神經(jīng)網(wǎng)絡(luò)的訓(xùn)練過(guò)程,通過(guò)不斷的使用所有數(shù)據(jù)記錄進(jìn)行訓(xùn)練,從而得到一個(gè)分類模型。不斷地迭代,不可能無(wú)休止的下去,總歸有個(gè)終止條件

訓(xùn)練終止條件

每一輪訓(xùn)練都使用數(shù)據(jù)集的所有記錄,但什么時(shí)候停止,停止條件有下面兩種:

設(shè)置最大迭代次數(shù),比如使用數(shù)據(jù)集迭代100次后停止訓(xùn)練

計(jì)算訓(xùn)練集在網(wǎng)絡(luò)上的預(yù)測(cè)準(zhǔn)確率,達(dá)到一定門限值后停止訓(xùn)練

使用BP神經(jīng)網(wǎng)絡(luò)分類

我自己寫了一個(gè)BP神經(jīng)網(wǎng)絡(luò),在數(shù)字手寫體識(shí)別數(shù)據(jù)集MINIST上測(cè)試了一下,MINIST數(shù)據(jù)集中訓(xùn)練圖片有12000個(gè),測(cè)試圖片20000個(gè),每張圖片是28*28的灰度圖像,我對(duì)圖像進(jìn)行了二值化處理,神經(jīng)網(wǎng)絡(luò)的參數(shù)設(shè)置如下:

輸入層設(shè)置28*28=784個(gè)輸入單元;

輸出層設(shè)置10個(gè),對(duì)應(yīng)10個(gè)數(shù)字的類別;

學(xué)習(xí)速率設(shè)置為0.05;

訓(xùn)練經(jīng)過(guò)約50次左右迭代,在訓(xùn)練集上已經(jīng)能達(dá)到99%的正確率,在測(cè)試集上的正確率為90.03%,單純的BP神經(jīng)網(wǎng)絡(luò)能夠提升的空間不大了,但kaggle上已經(jīng)有人有卷積神經(jīng)網(wǎng)絡(luò)在測(cè)試集達(dá)到了99.3%的準(zhǔn)確率。代碼是去年用C++寫的,濃濃的JAVA的味道,代碼價(jià)值不大,但注釋比較詳細(xì),可以查看這里,最近寫了一個(gè)Java多線程的BP神經(jīng)網(wǎng)絡(luò),但現(xiàn)在還不方便拿出來(lái),如果項(xiàng)目黃了,再放上來(lái)吧。

訓(xùn)練BP神經(jīng)網(wǎng)絡(luò)的一些經(jīng)驗(yàn)

講一下自己訓(xùn)練神經(jīng)網(wǎng)絡(luò)的一點(diǎn)經(jīng)驗(yàn):

學(xué)習(xí)速率不宜設(shè)置過(guò)大,一般小于0.1,開始我設(shè)置了0.85,準(zhǔn)確率一直提不上去,很明顯是陷入了局部最優(yōu)解;

輸入數(shù)據(jù)應(yīng)該歸一化,開始使用0-255的灰度值測(cè)試,效果不好,轉(zhuǎn)成01二值后,效果提升顯著;

盡量是數(shù)據(jù)記錄隨機(jī)分布,不要將數(shù)據(jù)集按記錄排序,假設(shè)數(shù)據(jù)集有10個(gè)類別,我們把數(shù)據(jù)集按類別排序,一條一條記錄地訓(xùn)練神經(jīng)網(wǎng)絡(luò),訓(xùn)練到后面,模型將只記得最近訓(xùn)練的類別而忘記了之前訓(xùn)練的類別;

對(duì)于多分類問(wèn)題,比如漢字識(shí)別問(wèn)題,常用漢字就有7000多個(gè),也就是說(shuō)有7000個(gè)類別,如果我們將輸出層設(shè)置為7000個(gè)結(jié)點(diǎn),那計(jì)算量將非常大,并且參數(shù)過(guò)多而不容易收斂,這時(shí)候我們應(yīng)該對(duì)類別進(jìn)行編碼,7000個(gè)漢字只需要13個(gè)二進(jìn)制位即可表示,因此我們的輸出成只需要設(shè)置13個(gè)結(jié)點(diǎn)即可。

審核編輯:黃飛

?

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論