算力調度層可類比為“算網大腦”,是算力網絡中最核心的部分。除技術自身的難 度外,算力調度還需綜合考慮成本、需求等因素,是困難的多約束求解問題。1)技 術:算力調度的技術創新主要包括計算能力跨區域調度、多級調度、算力資源統一 安排、網絡協議、可視化監控和智能運維。2)需求:不同的應用場景對應不同的算 力或時延需求,如科學計算類和國計民生類工程項目需要超高算力,而普通商用、 民用交互場景則往往側重于對時延的要求。3)成本:算力調度的一般原則為,根據 算力、時延要求,選擇最經濟的算力網絡架構布局,來降低算力成本、網絡成本、 運營成本。

算力調度平臺建設如火如荼。“東數西算”工程啟動以來,各地區相關單位就算力 度量、算力互聯互通、算力調度、算力交易等重點問題展開前瞻性研究。據不完全 統計,目前全國已發布或建設 10 余個算力平臺,涉及 3 個省份和 7 個城市,其中既 有“東數西算”樞紐節點,也有非樞紐節點參與算力平臺建設。1)寧夏上線國內首 個一體化算力交易調度平臺——東數西算一體化算力服務平臺,該平臺可為智算、 超算、通用算力等各類算力產品提供算力發現、供需撮合、交易購買、調度使用等 綜合服務。2)北京發布算力互聯互通驗證平臺,并已初步實驗跨服務商、跨地區、 跨架構的算力互聯互通能力,未來將實現對京津冀地區,寧夏、內蒙等國家算力樞 紐、四部戰略合作地區的算力互聯互通。

算力平臺多以政府/國企/研究機構/數據單位/超算中心為建設主體,聯合數據運營公 司、數據服務企業、數字化轉型解決方案提供商等企業,及算力服務提供商、設備 商、大模型廠商等共同建設。以寧夏東數西算一體化算力服務平臺為例,該平臺通 過資源整合,已將中科曙光、華為、中興、阿里云、天翼云等國內大算力領先企 業,國家信息中心、北京大數據研究院等國內主要大數據機構,以及商湯、百度等 大模型頭部企業,中國電信、中興通訊、萬達信息、安恒信息、鵬博士、思特奇等 多家上市公司共計 27 家納入平臺。 ? ?

算力調度,算力網絡的大腦中樞

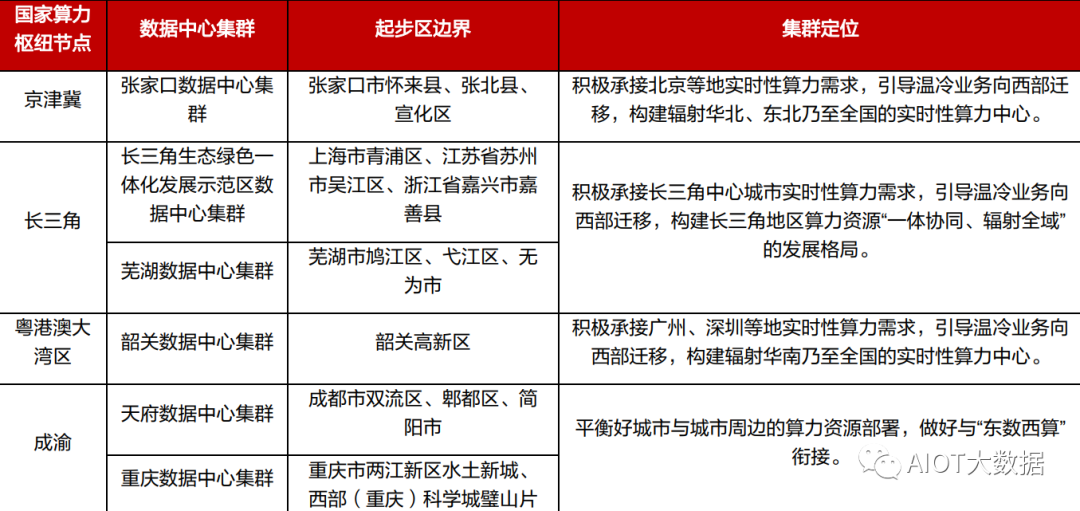

“東數西算”拉開全國一體化算力網絡序幕,布局 8 大樞紐節點、10 大集群。2022 年 2 月 17 日,國家發改委、中央網信辦、工信部、國家能源局聯合印發通知,同意在京津冀、長三角、粵 港澳大灣區、成渝、內蒙古、貴州、甘肅、寧夏等 8 地啟動建設國家算力樞紐節點,并規劃了 10 個國家數據中心集群。至此,全國一體化大數據中心體系完成總體布局設計,“東數西算”工程 正式全面啟動。根據布局,8 個國家算力樞紐節點將作為我國算力網絡的骨干連接點,開展數據中心與網絡、云 計算、大數據之間的協同建設,并作為國家“東數西算”工程的戰略支點。每個樞紐節點將發展 1-2 個數據中心集群,算力樞紐和集群的關系,類似于交通樞紐和客運車站,數據中心集群將匯 聚大型、超大型數據中心,具體承接數據流量。

?

?

? ?

算力網絡的目標,實現算力隨取隨用。

1961 年,美國科學家約翰·麥卡錫曾提出,算力應該像水 電資源一樣隨用隨取。以電力資源為例,電力基礎設施從發電、輸電、儲電、用電等各個環節全 面實現全局統一和環節解耦。發電環節,不論火力發電、水力發電還是光伏發電,都通過統一規 格和標準接入電網;輸電環節,電網建設已經實現大范圍覆蓋,可以實現分級分片的電力資源的 多級管理和統一調度,做到電力資源即插即用。然而類比來看,算力設施基礎化依然有一段路要 走。中國工程院院士、中國科學院計算技術研究所學術委員會主任孫凝暉認為,算力設施基礎化 存在兩個核心問題,一是標準化、統一供給,二是算力使用的抽象化。算力抽象的目的是使算力 的獲取、使用更便捷更易上手,并基于抽象的生成工具、傳輸工具、消費工具,做出豐富多樣的 各行各業應用。算網之于算力基礎設施,就類似于電網之于電力基礎設施,是串聯起各環節的橋 梁。 ? ?

算力網絡分為資源層、控制層、服務層和編排管理層。

算力國際標準 ITU-T Y.2501 中提出將算力 網絡功能架構分成 4 大模塊:算力網絡資源層、算力網絡控制層、算力網絡服務層和算力網絡編 排管理層。其中,算網資源層主要提供算力資源、存儲資源和網絡轉發資源,并結合網絡中計算 處理能力和網絡轉發能力的實際情況,實現各類計算、存儲資源的傳遞和流動;算網控制層主要 通過網絡控制平面實現計算和網絡多維度資源融合的路由;算網服務提供層主要實現面向用戶的 服務、原子功能能力開放;算網編排管理層主要解決異構算力資源、服務/功能資源的注冊、建模、 納管、編排、安全等問題。

編排管理(即調度)層可類比于算力網絡的大腦。

“算網大腦”即算力網絡中最核心的部分,主 要進行全網算力資源的智能編排、彈性調度,具體而言有四個作用:

1) 獲取全域實時的算、網、數資源,以及云、邊、端分布情況,構建全域態勢感知地圖。

2) 跨域協同調度,將多域協同的調度任務智能、自動地分解給各個使能平臺,實現算、網、數 的資源調度。

3) 多域融合編排,針對多域融合業務需求,基于算、網、數的原子能力按需靈活組合編排。

4) 智能輔助決策,基于不同業務的 SLA 要求、網絡整體負載、可用算力資源池分布等因素,智 能、動態地計算出算、網、數的最優協同策略。

算力調度需綜合考慮需求、成本等因素。

目前,我國東中西部數字新型基礎設施布局不平衡的問 題依然存在,東西部數據中心在用機架數大概比例在7:3,北上廣深等一線城市存在明顯的供不應 求,平均缺口率達 25%,而中西部地區能源條件豐富,算力資源有一定的產能過剩。因此需通過 編排管理調度實現資源的合理分配與使用。由于平臺異構、部署差異、網絡帶寬資源性價比差異等原因,算力調度存在諸多挑戰。除了技術 本身的挑戰外,還存在是否調度的問題,即資源在跨中心的流通還需考慮成本問題、代價問題以 及一些商業情況的問題。一般而言,算力調度主要針對計算、存儲、時延等要求高的場景。 ? ?

需求 1:算力。算力要求高的場景,如科學計算類和國計民生類工程項目,需依托超級算力 平臺來實現。截至 2022 年 12 月,科技部批準建立了 10 家國家超級計算中心,分別位于天 津、廣州、深圳、長沙、濟南、無錫、鄭州、昆山、成都、西安。另外鵬城實驗室、華為公 司等聯合建設了包括 20 個節點的中國算力網,主打 AI 算力。從布局看,均為集中式的算力 能力庫需求。

需求 2:時延。針對普通商用、民用交互場景,時延則是關鍵因素。時延敏感型業務可分為 通信類、功能類、三維交互類。

(1)通信類:主要解決人的通信需求。一般而言,實時競 技類游戲的時延要求是 50ms;實時交互類游戲的時延要求是 100ms;實時交互語音類的時 延要求是 100ms;實時交互視頻類的時延要求是 150ms;非實時大部分互聯網應用時延要 求是 300ms。

(2)功能類:主要指機器之間的通信需求,例如工業自動化控制的時延要求 是小于 10ms;遠程 / 遙控駕駛的時延要求是小于 10ms。

(3)三維交互類:基于三維顯示 和交互的元宇宙應用,為了避免頭暈,需要 10ms 以內的交互時延。

成本:不同業務的需求決定了選擇算力、網絡的下限,往往對應多種算力調度方式。最終的 算力調度方式還取決于成本,一般原則為,根據算力、時延要求,選擇最經濟的算力網絡架 構布局,來降低算力成本、網絡成本、運營成本。 ? ?

據不完全統計,目前全國已發布或建設 10 余個算力平臺,涉及 3 個省份和 7 個城市,其中既有“東數西算”樞紐節點,也有非樞紐節點參 與算力平臺建設。已經發布算力平臺的地區有北京市、上海市、南京市、寧夏回族自治區、貴州 省、甘肅省,待發布算力平臺的地區有深圳市,正在建設算力平臺的地區有合肥市、鄭州市、慶 陽市。數據顯示,算力產業中每投入 1 元,平均將帶動 3-4 元的經濟產出,算力指數每提高 1 個 百分點可帶來數字經濟 3.3‰的增長和 GDP1.8‰的增長。

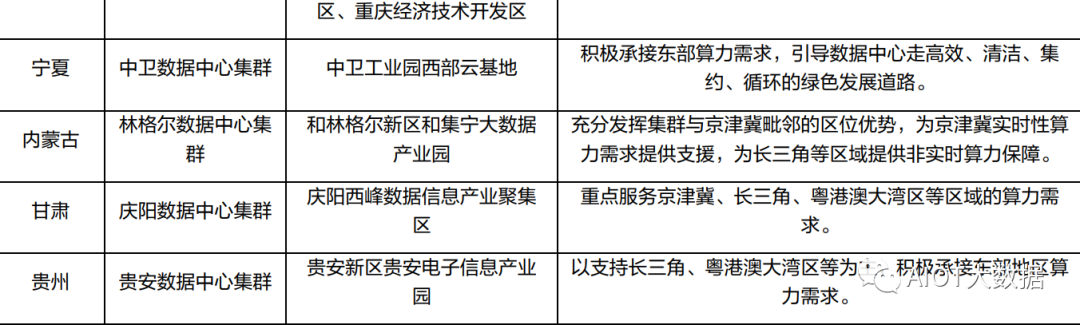

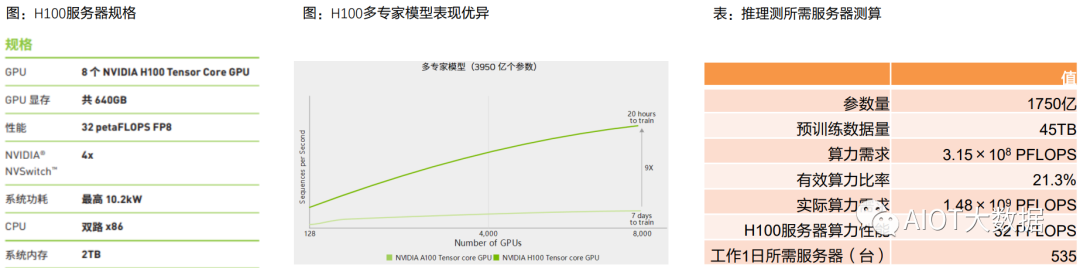

基于 GPT 4.0 模型的通信基礎設施需求測算

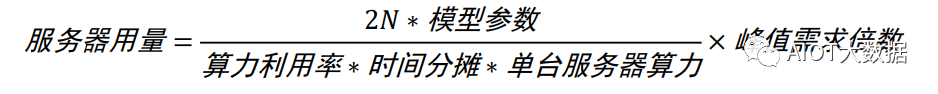

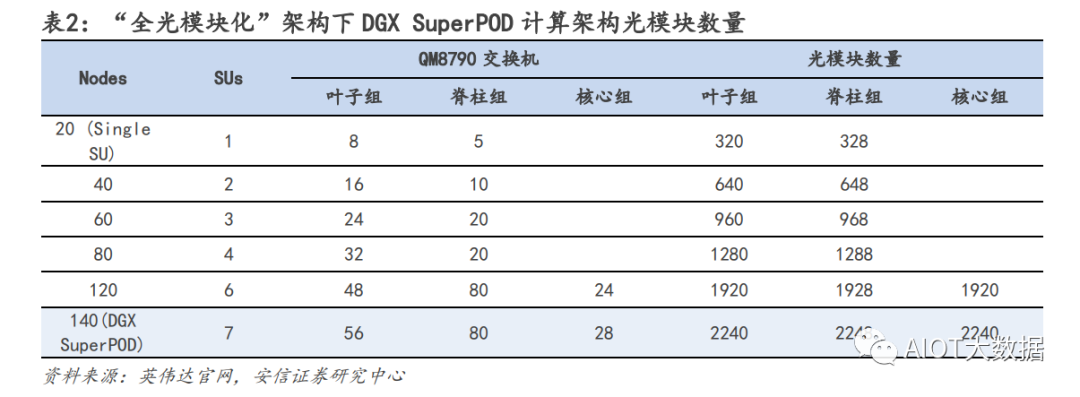

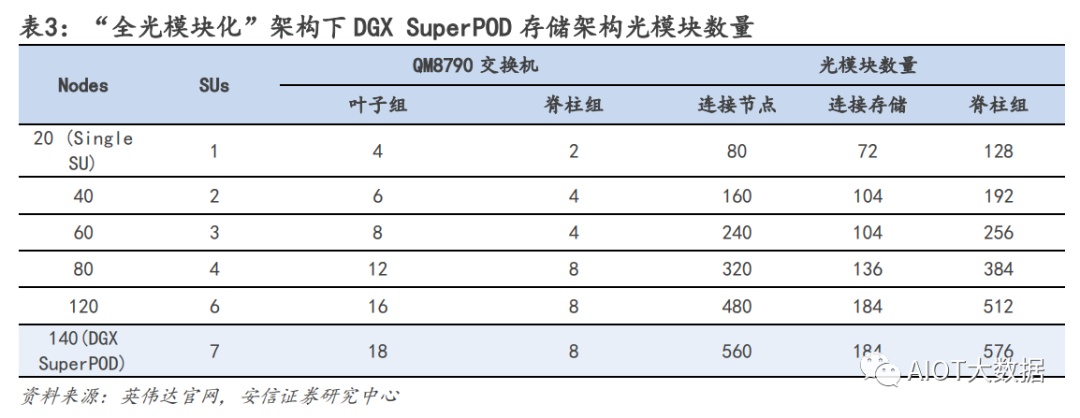

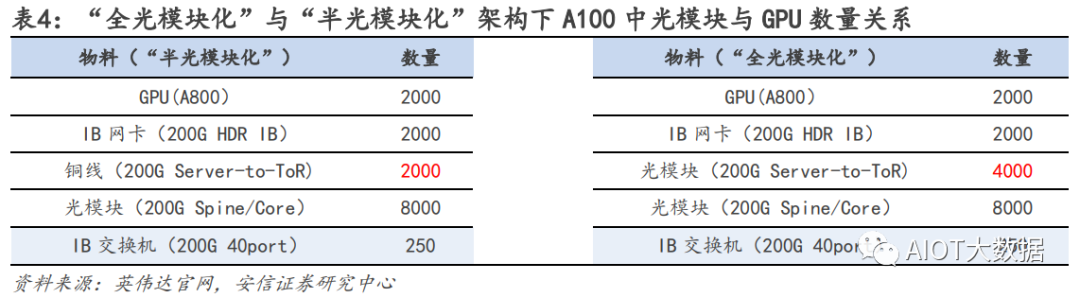

基于英偉達 AI 網絡架構硬件需求比例:服務器:交換機:光模塊=1:1.2:11.4 由于當前大部分 AIGC 模型都是基于英偉達方案來部署,我們從英偉達的 AI 集群模型架構進行拆解。對于較大的 AI 數據中心集群,一般可多達幾千臺 AI 服務器的需求,在部署方面會拆分成一個個基本單元 進行組件,英偉達對應的一個基本單元為 SuperPOD。根據 SuperPOD 公開信息:一個標準的 SuperPOD 由 140 臺 DGX A100 GPU 服務器、HDR InfiniBand 200G 網卡和 170 臺 NVIDIA Quantum QM8790 交換機構建而成,其中交換機速率為 200G,每個端口數為 40 個。

網絡結構上,英偉達采用 Infinband 技術(“無限帶寬”技術,簡稱 IB)和 fat tree(胖樹)網絡拓撲 結構,和傳統的數據中心的區別在于,在 IB fat tree 結構下,使用的交換機數量更多,且因為每個節點 上行下行的端口數完全一致,使得該網絡是是無收斂帶寬的,每個端口可采用同樣速率的光模塊.

光模塊用量測算:我們從線纜角度測算光模塊需求,一個 SuperPOD 170 個交換機,每個交換機有 40 個端 口,最簡單方式上下個 70 臺服務器,依次端口互聯(上下 1:1 連接)對應的線纜需求為 40×170/2=3400 根,但是由于實際網絡拓撲結構交換價不是該情況,連接情況更加復雜且會分為三層結構,因此線纜數需 求有所提升,我們假設上升至 4000 根線纜需求。線纜的需求分為三種,第一種用在機柜內部,互聯距離 5m 以內,常用需求為銅纜,不需要光模塊;第二 類互聯距離為 10m 以內,可以采用 AOC(有源光纖)連接,也不需要光模塊;第三類,帶光模塊的光纖, 單根需求為 2 個光模塊。考慮到 10m 以內的連接占據多數,我們假設銅纜:AOC:光模塊光纖比例=4:4:2. 光模塊需求=4000*0.2*2=1600 個。 ? ?

對于一個 SuperPod,服務器:交換機:光模塊的用量比例=140:170:1600=1:1.2:11.4. u 應用層面:單 GPT4.0 模型對于服務器需求用量測算 從用戶使用角度來測算,我們對于服務器算力的測算受大模型參數,日活人數,每日每人提問等多因素影 響。在 ChatGPT 中,一個 token 通常指的是響應請求所需的最小文本單位,一般一個 30 詞的提問大約對應 40 個 token,推理是 token 的算力調用是 2N。對應模型算力的需求我們分攤在一天 24h 的每一秒。

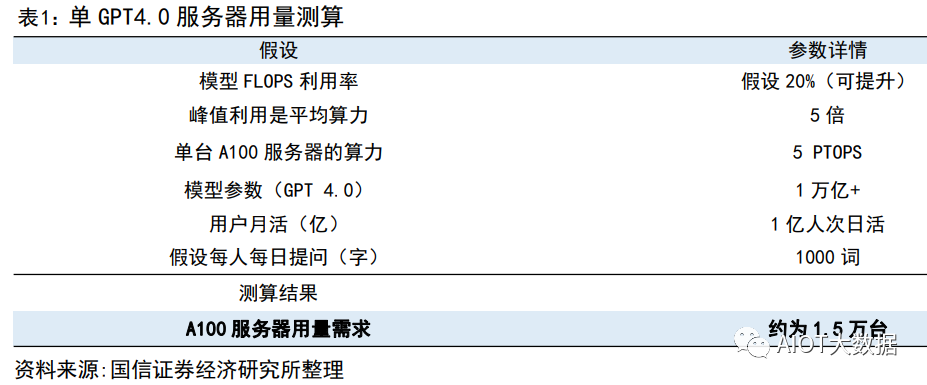

基于以下假設,我們可得到對應一個在 1 億日活的應用需要的 AI 服務器的需求約為 1.5 萬臺。

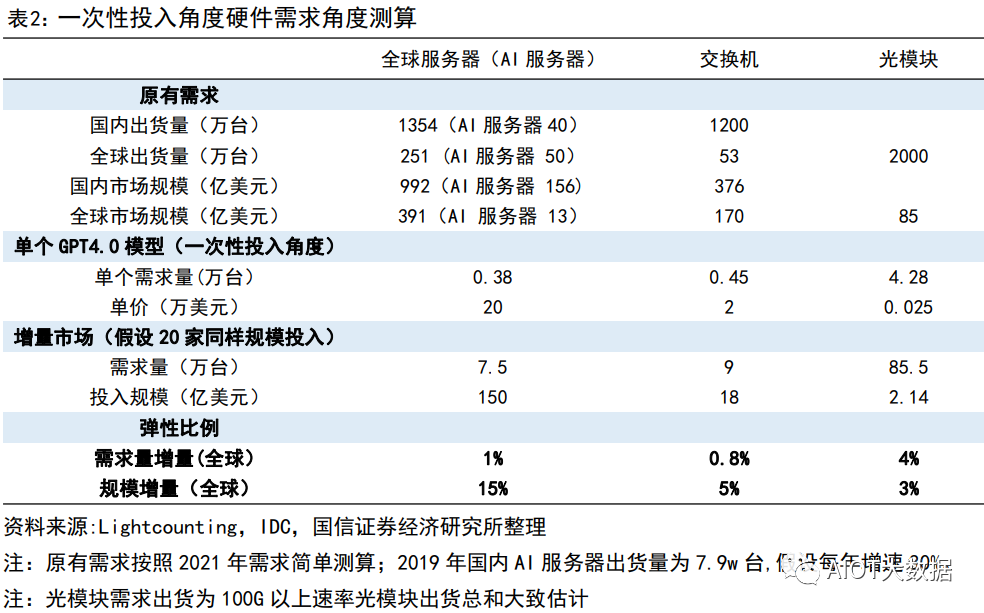

彈性測算一:現有采購部署層面彈性測算(基礎投入維度)

角度 1 我們選擇從現有完成一個類似 GPT4.0 入門級別要求的需求假設去測算硬件基礎設施層面需求。假設 1:結合現有各類公開數據,完成 ChatGPT4.0(訓練+推理)需要至少 3 萬張英偉達 A100 卡的算力投 入,對應 3750 臺 A100 的 DGX 服務器。假設 2:全球假設國內和海外有潛在 20 家公司可能按照此規模進行測投入。假設 3:網絡結構比例按照單個 SuperPOD 方式部署,即服務器:交換機:光模塊的用量比例=1:1.2:11.4。假設 4:服務器價格參考英偉達價格,為 20 萬美元;交換價結合 Mellanox 售價,假設單價為 2w 美金,光 模塊根據交換機速率,現在主流為 200G,假設售價為 250 美金。結論:服務器、交換機、光模塊的市場彈性分別為 15%、5%、3%。 ? ?

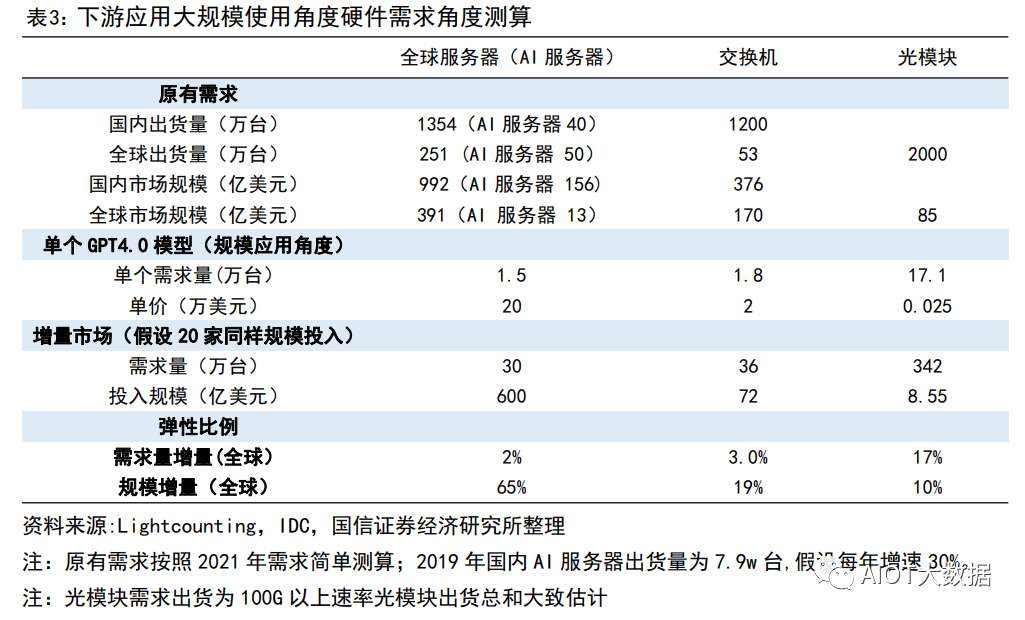

彈性測算二:下游需求億級別大規模響應(遠期應用規模起量角度) 角度 2:基于下游應用呈現規模角度,即按照單 GPT4.0 模型對于服務器需求用量測算。假設 1:單個應用的需求角度開看,服務器潛在用量為 1.5 萬臺。假設 2:全球假設國內和海外有潛在 20 家公司可能形成同樣類型規模應用。假設 3:網絡結構比例按照單個 SuperPOD 方式部署,即服務器:交換機:光模塊的用量比例=1:1.2:11.4。假設 4:服務器價格參考英偉達價格,為 20 萬美元;交換價結合 Mellanox 售價,假設為 2.5-3w 美金,光 模塊根據交換機速率,現在主流為 200G,假設售價為 250 美金。結論:服務器、交換機、光模塊的市場彈性分別為 65%、19%、10%。 ? ?

?

? ?

?

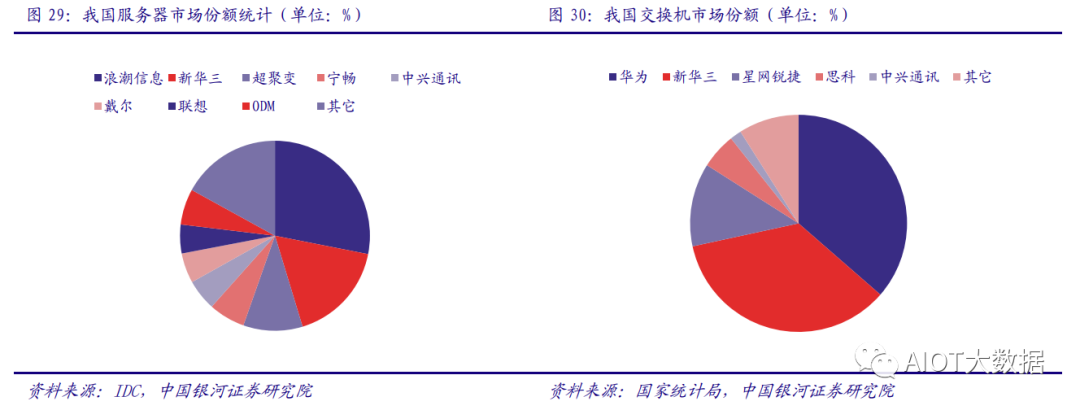

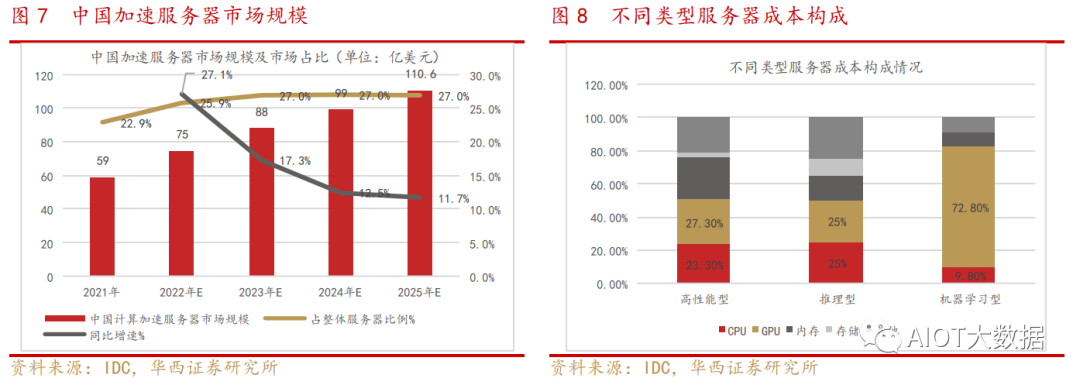

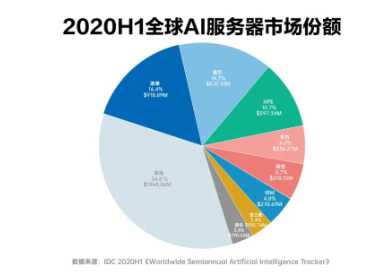

服務器整體市場情況

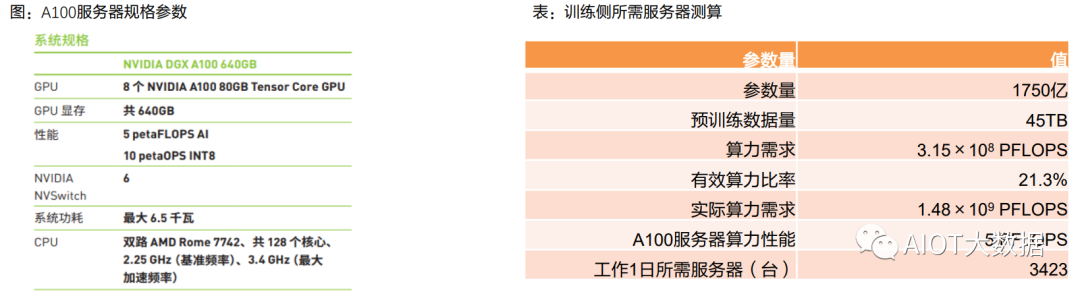

服務器構成:主要硬件包括處理器、內存、芯片組、I/O (RAID卡、網卡、HBA卡) 、硬盤、機箱 (電源、風 扇)。以一臺普通的服務器生產成本為例,CPU及芯片組大致占比50% 左右,內存大致占比 15% 左右,外部 存儲大致占比10%左右,其他硬件占比25%左右。

服務器的邏輯架構和普通計算機類似。但是由于需要提供高性能計算,因此在處理能力、穩定性、可靠性、 安全性、可擴展性、可管理性等方面要求較高。

邏輯架構中,最重要的部分是CPU和內存。CPU對數據進行邏輯運算,內存進行數據存儲管理。

服務器的固件主要包括BIOS或UEFI、BMC、CMOS,OS包括32位和64位。

2022年12月,Open AI的大型語言生成模型ChatGPT火熱,它能勝任刷高情商對話、生成代碼、構思劇本 和小說等多個場景,將人機對話推向新的高度。全球各大科技企業都在積極擁抱AIGC,不斷推出相關技術、 平臺和應用。

生成算法、預訓練模式、多模態等AI技術累計融合,催生了AIGC的大爆發。

目前,AIGC產業生態體系的雛形已現,呈現為上中下三層架構:①第一層為上游基礎層,也就是由預訓練 模型為基礎搭建的AIGC技術基礎設施層。②第二層為中間層,即垂直化、場景化、個性化的模型和應用工 具。③第三層為應用層,即面向C端用戶的文字、圖片、音視頻等內容生成服務。 ? ?

GPT模型對比BERT模型、T5模型的參數量有明顯提升。GPT-3是目前最大的知名語言模型之一,包含了 1750億(175B)個參數。在GPT-3發布之前,最大的語言模型是微軟的Turing NLG模型,大小為170 億(17B)個參數。GPT-3 的 paper 也很長,ELMO 有 15 頁,BERT 有 16 頁,GPT-2 有 24 頁,T5 有 53 頁,而 GPT-3 有 72 頁。

訓練數據量不斷加大,對于算力資源需求提升。

回顧GPT的發展,GPT家族與BERT模型都是知名的NLP模型,都基于Transformer技術。GPT,是一種 生成式的預訓練模型,由OpenAI團隊最早發布于2018年,GPT-1只有12個Transformer層,而到了 GPT-3,則增加到96層。其中,GPT-1使用無監督預訓練與有監督微調相結合的方式,GPT-2與GPT-3 則都是純無監督預訓練的方式,GPT-3相比GPT-2的進化主要是數據量、參數量的數量級提升。

未來異構計算或成為主流

異構計算(Heterogeneous Computing)是指使用不同類型指令集和體系架構的計算單元組成系統的計算方式,目前主 要包括GPU云服務器、FPGA云服務器和彈性加速計算實例EAIS等。讓最適合的專用硬件去服務最適合的業務場景。

在CPU+GPU的異構計算架構中,GPU與CPU通過PCle總線連接協同工作,CPU所在位置稱為主機端 (host),而GPU所在 位置稱為設備端(device)。基于CPU+GPU的異構計算平臺可以優勢互補,CPU負責處理邏輯復雜的串行程序,而GPU重 點處理數據密集型的并行計算程序,從而發揮最大功效。

越來越多的AI計算都采用異構計算來實現性能加速。 ? ?

阿里第一代計算型GPU實例,2017年對外發布GN4,搭載Nvidia M40加速器.,在萬兆網絡下面向人工智能深度學習場 景,相比同時代的CPU服務器性能有近7倍的提升。

CPU 適用于一系列廣泛的工作負載,特別是那些對于延遲和單位內核性能要求較高的工作負載。作為強大的執行引擎, CPU 將它數量相對較少的內核集中用于處理單個任務,并快速將其完成。這使它尤其適合用于處理從串行計算到數據 庫運行等類型的工作。

GPU 最初是作為專門用于加速特定 3D 渲染任務的 ASIC 開發而成的。隨著時間的推移,這些功能固定的引擎變得更加 可編程化、更加靈活。盡管圖形處理和當下視覺效果越來越真實的頂級游戲仍是 GPU 的主要功能,但同時,它也已經 演化為用途更普遍的并行處理器,能夠處理越來越多的應用程序。

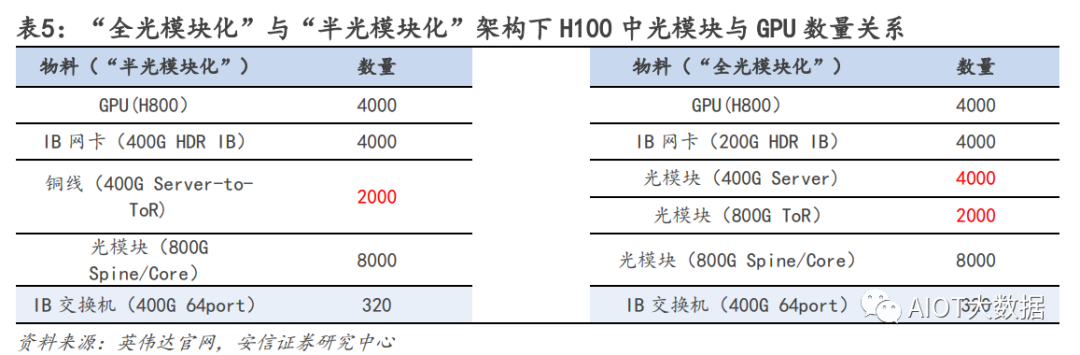

訓練和推理過程所處理的數據量不同。

在AI實現的過程中,訓練(Training)和推理(Inference)是必不可少的,其中的區別在于:

訓練過程:又稱學習過程,是指通過大數據訓練出一個復雜的神經網絡模型,通過大量數據的訓練確定網絡中權重和 偏置的值,使其能夠適應特定的功能。

推理過程:又稱判斷過程,是指利用訓練好的模型,使用新數據推理出各種結論。

簡單理解,我們學習知識的過程類似于訓練,為了掌握大量的知識,必須讀大量的書、專心聽老師講解,課后還要做 大量的習題鞏固自己對知識的理解,并通過考試來驗證學習的結果。分數不同就是學習效果的差別,如果考試沒通過 則需要繼續重新學習,不斷提升對知識的掌握程度。而推理,則是應用所學的知識進行判斷,比如診斷病人時候應用 所學習的醫學知識進行判斷,做“推理”從而判斷出病因。 ? ?

訓練需要密集的計算,通過神經網絡算出結果后,如果發現錯誤或未達到預期,這時這個錯誤會通過網絡 層反向傳播回來,該網絡需要嘗試做出新的推測,在每一次嘗試中,它都要調整大量的參數,還必須兼顧 其它屬性。再次做出推測后再次校驗,通過一次又一次循環往返,直到其得到“最優”的權重配置,達成 預期的正確答案。如今,神經網絡復雜度越來越高,一個網絡的參數可以達到百萬級以上,因此每一次調 整都需要進行大量的計算。吳恩達(曾在谷歌和百度任職)舉例“訓練一個百度的漢語語音識別模型不僅 需要4TB的訓練數據,而且在整個訓練周期中還需要20 exaflops(百億億次浮點運算)的算力”,訓練是 一個消耗巨量算力的怪獸。

推理是利用訓練好的模型,使用新數據推理出各種結論,它是借助神經網絡模型進行運算,利用輸入的新 數據“一次性”獲得正確結論的過程,他不需要和訓練一樣需要循環往復的調整參數,因此對算力的需求 也會低很多。

此外,訓練和推理過程中,芯片的部署位置、準確度/精度要求、存 儲要求等都有所不同。

訓練和推理所應用的GPU/服務器也有不同。

推理常用:NVIDIA T4 GPU 為不同的云端工作負載提供加速,其 中包括高性能計算、深度學習訓練和推理、機器學習、數據分析和 圖形學。引入革命性的 Turing Tensor Core 技術,使用多精度計算 應對不同的工作負載。從 FP32 到 FP16,再到 INT8 和 INT4 的精 度,T4 的性能比 CPU 高出 40 倍,實現了性能的重大突破。 ? ?

訓練:A100和H100。對于具有龐大數據表的超大型模型,A100 80GB 可為每個節點提供高達 1.3TB 的統一顯存,而且吞吐量比 A100 40GB 多高達 3 倍。在 BERT 等先進的對話式 AI 模型上, A100 可將推理吞吐量提升到高達 CPU 的 249 倍。

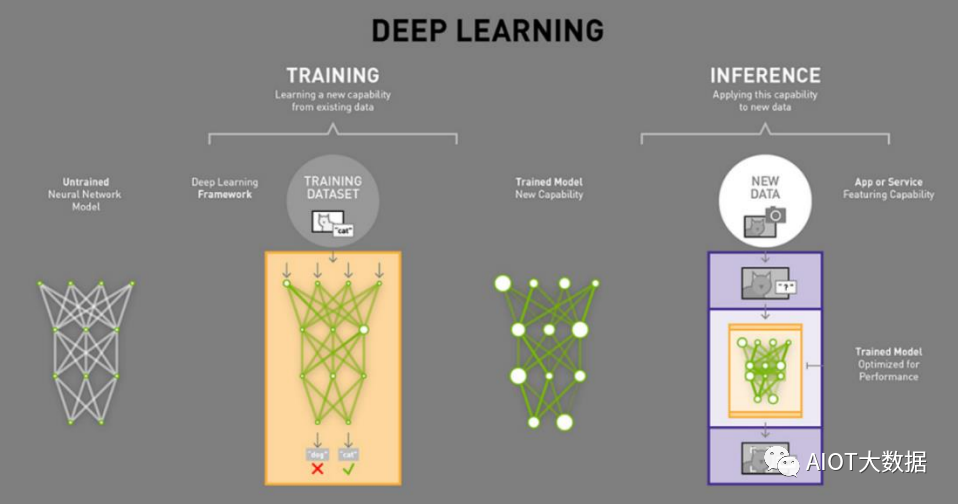

根據OpenAI在2020年發表的論文,訓練階段算力需求與模型參數數量、訓練數據集規模等有關,且為兩者乘積的 6倍:訓練階段算力需求=6×模型參數數量×訓練集規模。

GPT-3模型參數約1750億個,預訓練數據量為45 TB,折合成訓練集約為3000億tokens。即訓練階段算力需求 =6×1.75×1011×3×1011=3.15×1023 FLOPS=3.15×108 PFLOPS

依據谷歌論文,OpenAI公司訓練GPT-3采用英偉達V100 GPU,有效算力比率為21.3%。GPT-3的實際算力需求應 為1.48×109 PFLOPS(17117 PFLOPS-day)。

假設應用A100 640GB服務器進行訓練,該服務器AI算力性能為5 PFLOPS,最大功率為6.5 kw,則我們測算訓練 階段需要服務器數量=訓練階段算力需求÷服務器AI算力性能=2.96×108臺(同時工作1秒),即3423臺服務器工 作1日。

H100性能更強,與上一代產品相比,H100 的綜合技術創新可以將大型語言模型的速度提高 30 倍。根據Nvidia測 試結果,H100針對大型模型提供高達 9 倍的 AI 訓練速度,超大模型的 AI 推理性能提升高達 30 倍。 ? ?

在數據中心級部署 H100 GPU 可提供出色的性能,并使所有研究人員均能輕松使用新一代百億億次級 (Exascale) 高性能計算 (HPC) 和萬億參數的 AI。

H100 還采用 DPX 指令,其性能比 NVIDIA A100 Tensor Core GPU 高 7 倍,在動態編程算法(例如,用于 DNA 序列比對 Smith-Waterman)上比僅使用傳統雙路 CPU 的服務器快 40 倍。

假設應用H100服務器進行訓練,該服務器AI算力性能為32 PFLOPS,最大功率為10.2 kw,則我們測算訓練階段需 要服務器數量=訓練階段算力需求÷服務器AI算力性能=4.625×107臺(同時工作1秒),即535臺服務器工作1日。

根據天翼智庫,GPT-3模型參數約1750億個,預訓練數據量為45 TB,折合成訓練集約為3000億tokens。按照有 效算力比率21.3%來計算,訓練階段實際算力需求為1.48×109 PFLOPS。

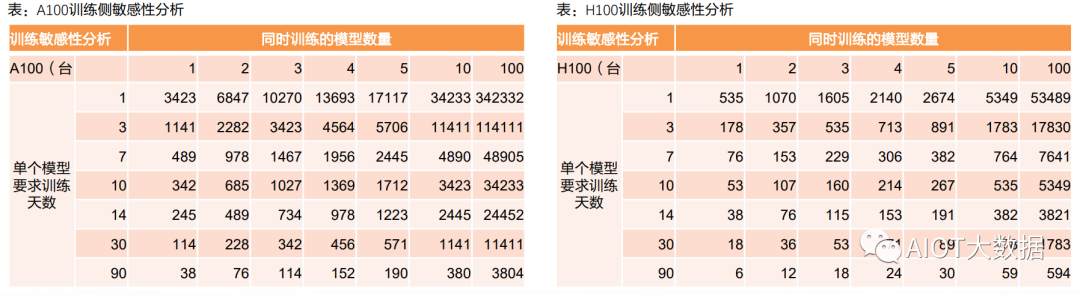

對AI服務器訓練階段需求進行敏感性分析,兩個變化參數:①同時并行訓練的大模型數量、②單個模型要求訓練完 成的時間。

按照A100服務器5 PFLOPs,H100服務器32 PFLOPs來進行計算。

若不同廠商需要訓練10個大模型,1天內完成,則需要A100服務器34233臺,需要H100服務器5349臺。

此外,若后續GPT模型參數迭代向上提升(GPT-4參數量可能對比GPT-3倍數級增長),則我們測算所需AI服務 器數量進一步增長。 ? ?

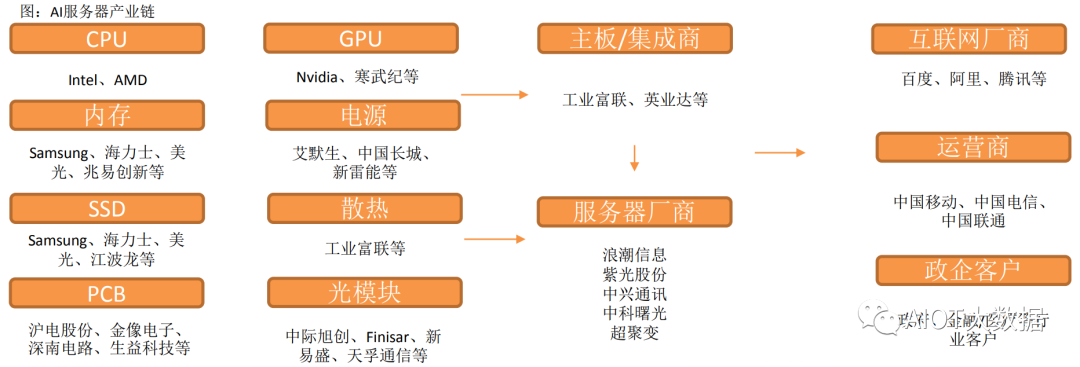

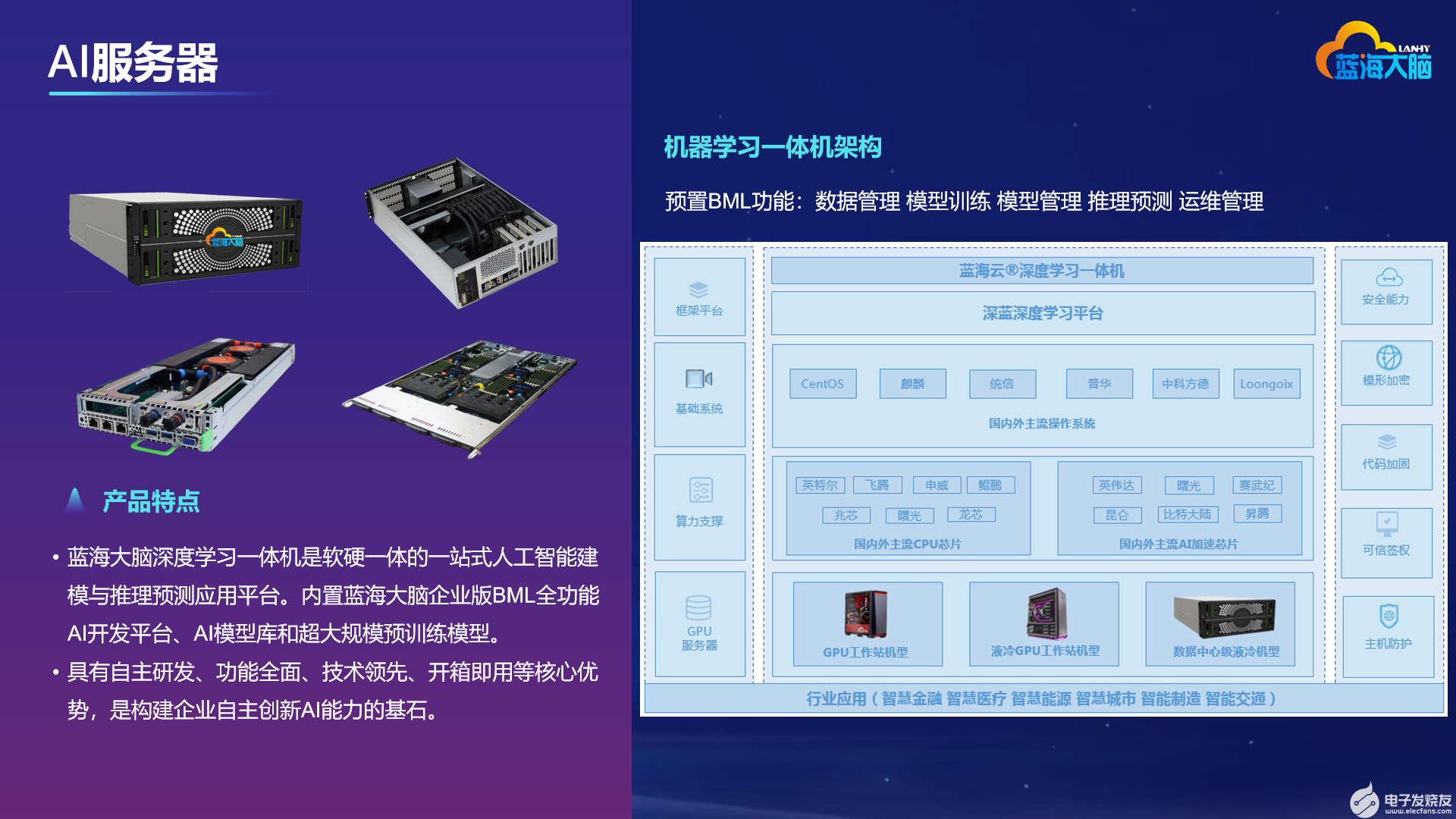

AI服務器產業鏈

AI服務器核心組件包括GPU(圖形處理器)、DRAM(動態隨機存取存儲器)、SSD(固態硬盤)和 RAID卡、CPU(中央處理器)、網卡、PCB、高速互聯芯片(板內)和散熱模組等。

CPU主要供貨廠商為Intel、GPU目前領先廠商為國際巨頭英偉達,以及國內廠商如寒武紀、海光信息等。

SSD廠商包括三星、美光、海力士等,以及國內江波龍等廠商。

PCB廠商海外主要包括金像電子,國內包括滬電股份、鵬鼎控股等。

主板廠商包括工業富聯,服務器品牌廠商包括浪潮信息、紫光股份、中科曙光、中興通訊等。

? ?

?

? ?

審核編輯:黃飛

?

電子發燒友App

電子發燒友App

評論